文章目录

摘要

本周阅读河网多站点水质预测论文。论文提出STF-GNN:以河网构图,GCN提取空间拓扑,GRU建模时间依赖,注意力融合时空特征预测DO/TN。漓江数据上误差最小,跨流域与未训练站点泛化稳定。局限为最近水文站赋值致异质图,拟引入异质GNN进行进一步的改进。

Abstract

This week's reading: A paper on water quality prediction for multi-site river networks. The paper proposes STF-GNN: utilising river network composition, GCN to extract spatial topology, GRU to model temporal dependencies, and attention mechanisms to fuse spatio-temporal features for predicting DO/TN. It achieves minimal error on Li River data, with stable cross-basin and untrained site generalisation. A limitation is the heterogeneous graph caused by recent hydrological station values; introducing a heterogeneous GNN is proposed for further improvement.

文献阅读

论文题目

Temporal and spatial feature extraction using graph neural networks for

multi-point water quality prediction in river network areas

问题引入

研究背景

:人类活动和工业化加剧了水体污染,威胁水资源安全、生态环境与人类健康,因此需要更准确的水质预测来支持污染治理和政策制定。机理模型虽然可解释,但参数校准复杂、算力要求高、简化假设多,限制了应用。深度学习/时间序列模型(RNN/LSTM/GRU/Transformer 等)擅长捕捉时间依赖,但多数只针对单站点,忽略河网中站点之间的空间联系与污染传播规律。CNN 这类"像素邻接"的空间建模不适合站点分布不规则的河网,会带来空间表达误差。

研究动机:

作者认为河网是天然"图结构",需要一个能同时学习空间拓扑关联 + 时间演化规律的模型,来提升多站点水质预测的准确性与可推广性。

研究目标:

具体问题定义上,把多监测站点看成图的节点、站点邻近/拓扑关系构成边,输入是各站点的多变量历史序列(水质+水文因子),输出是对多个站点未来水质指标(实验重点 DO 溶解氧与 TN 总氮)的同步预测;目标就是让预测值尽量贴近观测值,并用 RMSE、MAE、SMAPE 这三种误差指标衡量效果,数值越小表示预测越好。

论文的主要贡献

1.提出了一个新的多站点河网水质预测模型 STF-GNN:把河网监测站表示成图的节点与边,用 GCN 提取空间拓扑相关性 + GRU 捕捉时间依赖 + 自注意力做时空特征深度融合,显式建模"空间传播 + 时间演化"的多尺度耦合关系,解决了以往深度学习多只做单站点/弱空间建模的问题。

2.构建了更符合河网特性的图网络空间表示:不再用图像像素邻接,而是基于站点间距离与上下游方向建立邻接矩阵,使模型能在不规则河网结构上有效学习空间相关性,从结构上提升了空间建模的合理性。

3.通过系统实验验证了方法的优越性与泛化/鲁棒性:在 DO 与 TN 预测上显著优于多种基线模型(误差大幅降低),并在跨流域/未训练站点上仍保持较好精度与峰谷同步能力;消融实验也证明空间模块和时间模块都不可或缺。

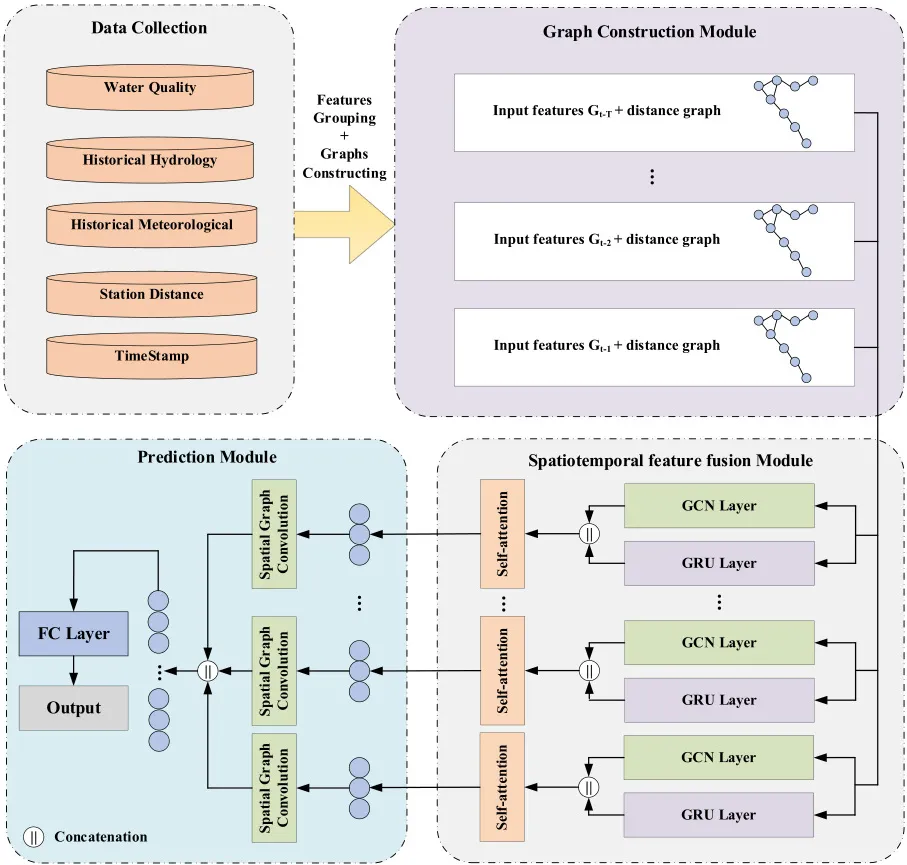

模型设计

整体框架:先做数据预处理(用 Z-score 筛异常/补缺失),然后把河网监测站构成一张"图"(站点是节点、边是站点间的空间邻近/水流方向关系),接着进入核心的时空特征融合模块:用 GCN 提取空间拓扑特征、用 GRU 提取时间序列动态特征,最后用自注意力计算空间特征与时间特征的相关性并加权融合,得到深度的联合时空表示;融合后的特征再送入预测模块(再过一层空间图卷积+全连接)输出各站点未来的 DO/TN 等指标。

该模型的创新点:

(1) 更符合河网的构图方式:若两站距离小于阈值且存在上下游方向,就连边,权重用距离倒数表示,避免 CNN 那种"像素邻接"对不规则河网的失真表达。

监测站点被表示为图中的节点,基于站点之间的空间邻近关系构建邻接矩阵。具体来说,如果两个站点之间的距离小于预设阈值(实验中设置为20公里),则认为它们之间存在邻接关系,邻接矩阵的元素为两站点之间距离的倒数。

(2) 时空特征深度融合:GCN 只会空间、GRU 只会时间,用自注意力把二者的相关性算成权重矩阵做融合(Attention(Q,K,V) ),从而让模型自动"更关注关键的时空耦合片段"。

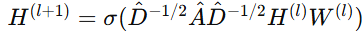

GCN(空间):图卷积神经网络---邻居信息传递:A 是图的邻接矩阵,用来编码"每个站点与哪些邻居站点相连/有空间影响",从而让 GCN利用公式

在更新节点特征时能把邻居信息一起聚合进来。

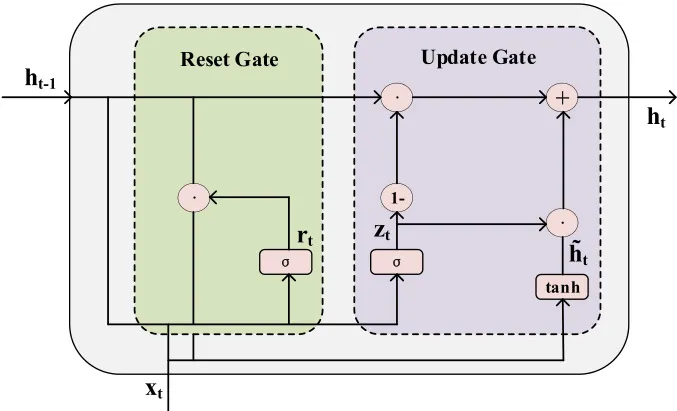

GRU原理(时间):RNN 的一种变体,通过门控机制(重置门、更新门)解决梯度消失/爆炸问题,有效学习时间序列的长期依赖。

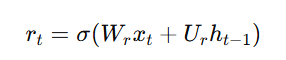

重置门:决定忘记多少"过去"

公式:

σ 是 sigmoid,输出在 0~1

rₜ 越接近 0 → 过去影响越小(几乎重置/忘掉)

rₜ 越接近 1 → 过去照单全收

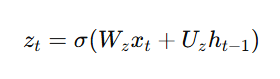

更新门:zₜ 决定最终 hₜ 中"旧记忆 hₜ₋₁ 该保留多少,新信息该写入多少"。

公式:

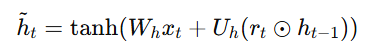

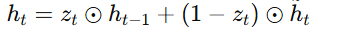

两个门同时工作:

第一步:用重置门算"候选新记忆",

第二步:用更新门把新旧记忆加权混合,得到最终 hₜ,

时空特征融合:通过自注意力机制计算空间特征和时间特征之间的相关矩阵,从而实现时空特征的深度融合。具体公式如下:

实验研究

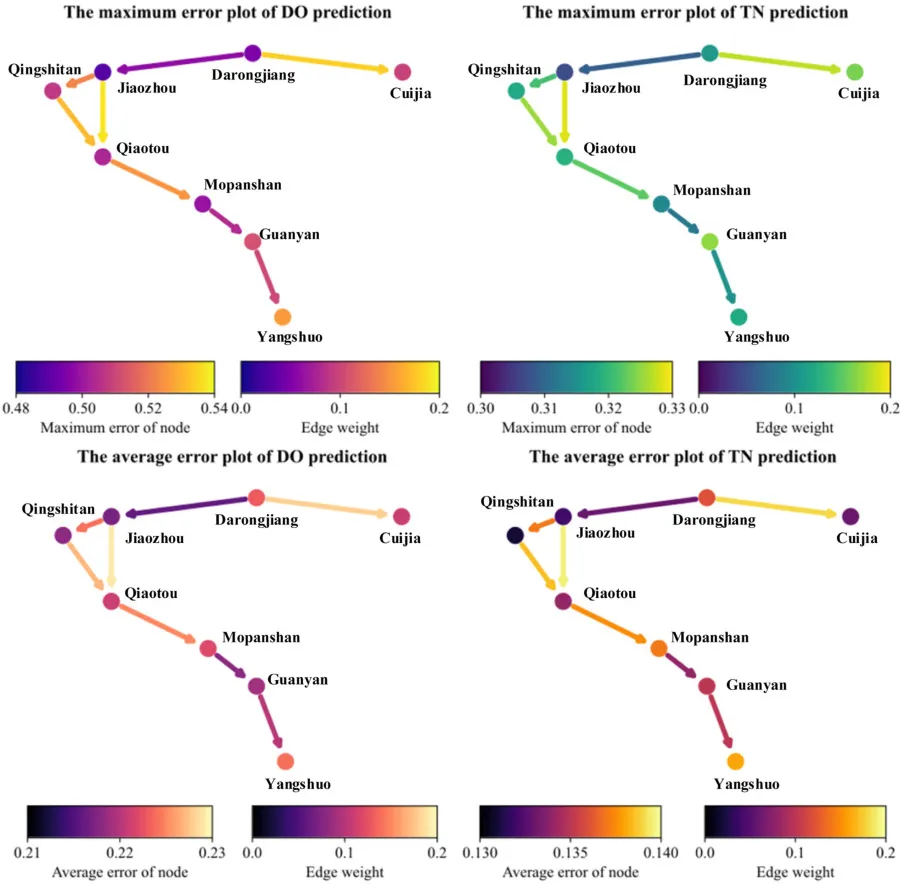

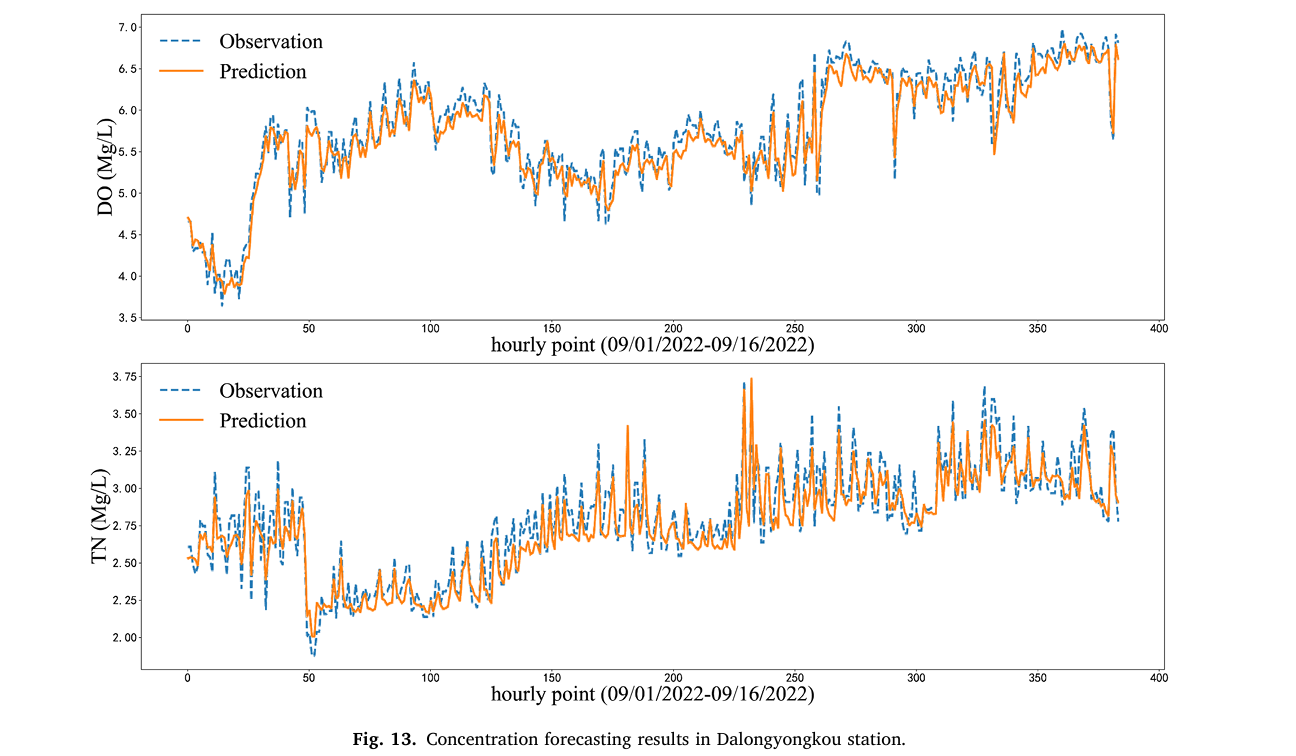

用桂林漓江流域的真实监测数据做多站点预测实验,训练集是 2020.01--2022.02 的小时数据,测试预测 2022.03--12 的 DO 和 TN;评价指标是 RMSE/MAE/SMAPE。结果显示 STF-GNN 在主流站点上能很好跟踪 DO、TN 的时序趋势,污染物剧烈波动时相对误差也较低(DO 最大相对误差约 10.8%,TN 约 18.6%),说明稳定性不错。

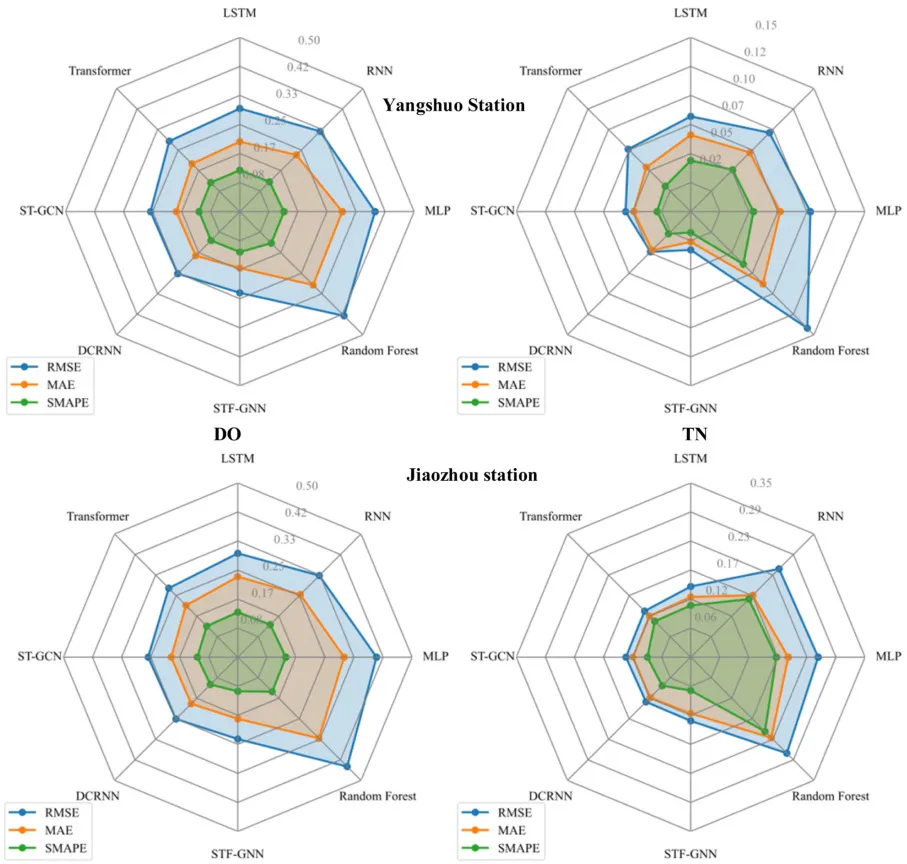

在与 7 个基线模型(RF、MLP、RNN、LSTM、Transformer、ST-GCN、DCRNN)对比中,STF-GNN 的误差最小:以训练站点为例 DO 的 RMSE=0.233、TN 的 RMSE=0.033,整体精度提升约 36.54%--161.47%,领先时序模型和已有时空图模型。

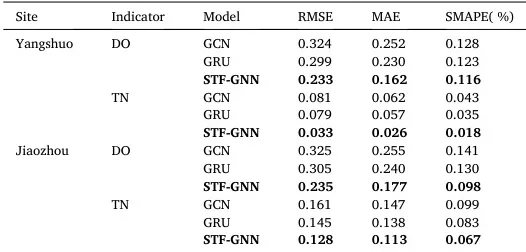

消融实验把模型拆成只要空间的 GCN 版、只要时间的 GRU 版,二者性能都明显下降:去掉空间或时间模块会让 DO 精度降约 12.07%--18.09%,TN 降约 18.23%--19.25%,证明"空间+时间+注意力融合"三者缺一不可。

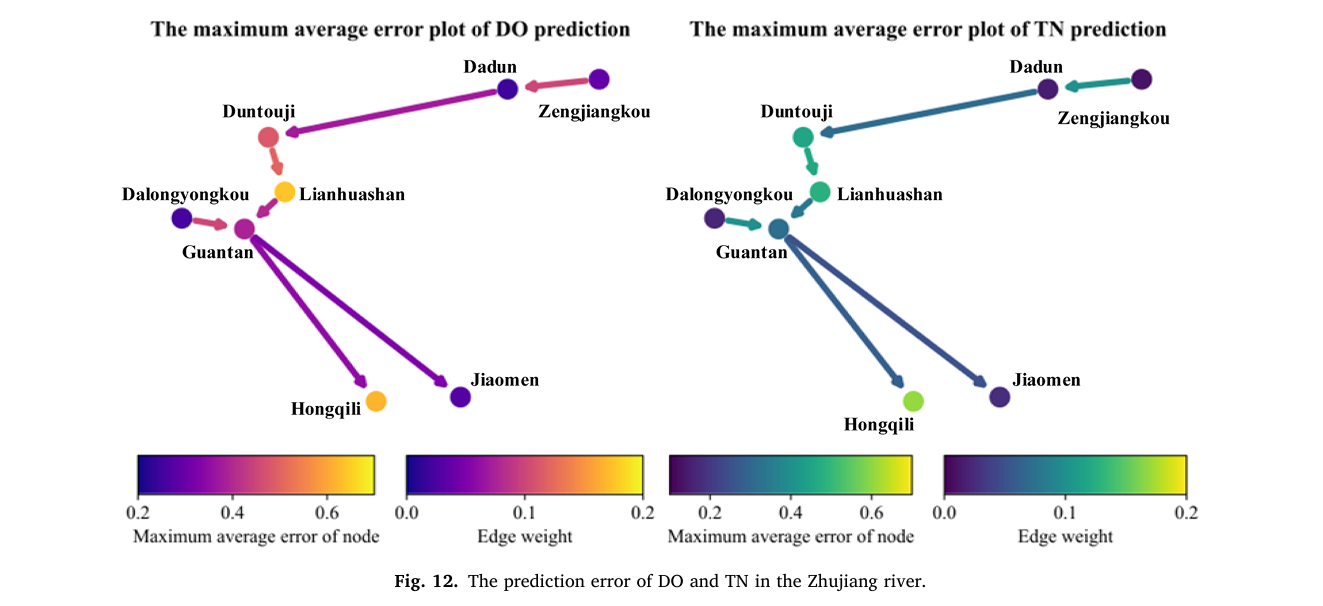

此外还做了泛化测试:跨流域(珠江流域)和同流域未训练站点上依然保持较好误差与峰谷同步(未训练站点峰谷同步 >88%),说明模型有较强迁移与泛化能力

结论

这篇论文提出的STF-GNN模型通过集成图卷积网络(GCN)、门控循环单元(GRU)和自注意力机制,有效地捕捉和融合时空特征,显著提高了河网区域多点水质预测的准确性。实验结果表明,STF-GNN模型在溶解氧(DO)和总氮(TN)的预测中表现出色,均方根误差(RMSE)分别为0.233和0.033,平均绝对误差(MAE)分别为0.162和0.026,对称平均绝对百分比误差(SMAPE)分别为0.116和0.018。该模型在处理复杂时空耦合特征时表现出强大的预测优势,适用于河网区域的多点水质预测。未来的研究可以考虑将异质图神经网络方法引入水质预测,以进一步提高模型的预测精度。