生成式人工智能通识

生成式人工智能概述

生成式人工智能是人工智能领域的重要分支,一种基于算法和模型生成文本、图片、声音、视频、代码等内容的技术,不同于传统AI的分析功能,生成式AI能学习并生成具有逻辑的新内容。

生成式AI的核心优势

- 创作效率高:生成式AI能快速生成大量初稿、草图、方案或内容片段。这极大地加速了创意构思、内容创作和原型设计的过程。

- 生成内容多样:基于训练数据和不同的提示词(Prompt),生成式AI可以产生风格迥异、形式多变的内容。它能突破单一人类创作者的思维惯性和风格限制。

- 为企业降本增效:加速产品设计、营销内容制作、软件研发、报告生成等流程,减少人力投入和时间成本。

生成式AI的核心架构

序列模型

- 序列模型是实现生成式AI的核心技术架构之一,而生成式AI是序列模型最典型的应用方向

- 序列模型是专门设计用来处理具有顺序关系的数据的机器学习模型

- 序列模型的关键特征:数据点不是孤立的,而是按特定顺序排列的,后面的数据点依赖前面的数据点

- 序列模型有许多典型应用,比如:音乐生成、文本情感分类、机器翻译、视频动作识别等

扩散模型

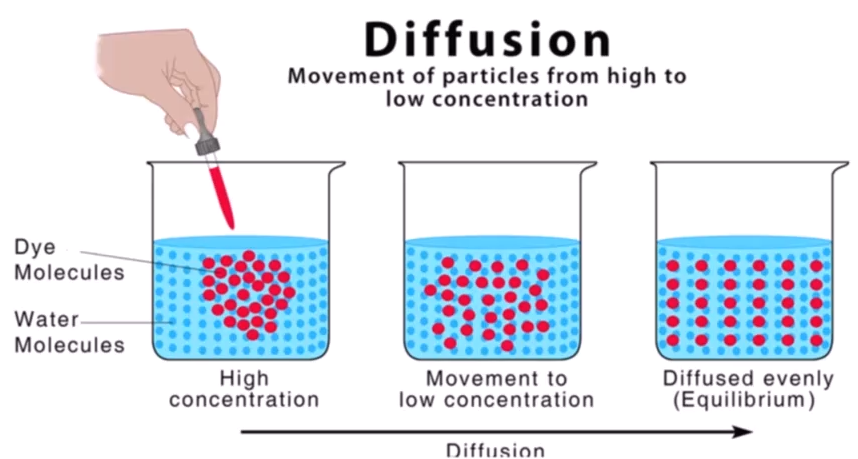

- 扩散模型(Diffusion Models)是一类基于概率生成的深度学习模型,通过模拟数据在噪声与信号之间的扩散过程实现数据生成。

- 其核心思想源于热力学中的扩散现象,可以概括为分布加噪与去噪。

生成式人工智能的伦理及安全

伦理原则

生成式人工智能具有强大的创造力,但也可能带来隐私侵犯、偏见放大、虚假信息传播、版权争议、甚至人身伤害等风险。伦理原则就像AI发展的"指南针"和"刹车片",确保技术创新始终以人为本、向善发展。

- 尊重人类尊严和权利

- 包含个人隐私和数据安全

- 尊重知识产权、商业道德

- 防止伤害他人身心健康

- 遵循公平、透明和可解释的原则

数据安全挑战

- 用户数据泄露:模型可能在输出中意外"记忆"并复现训练数据中的敏感信息。用户在与大模型交互时输入的提示词、上传的文件等可能包含高度明信息

- 模型的可靠性弱:AIGC模型会生成看似合理实则错误或编造的内容(AI幻觉),如果用户依赖AIGC生成的错误信息做出决策或行动,可能导致严重后果

- 模型黑盒:黑盒特性可能掩盖模型内部存在的安全漏洞

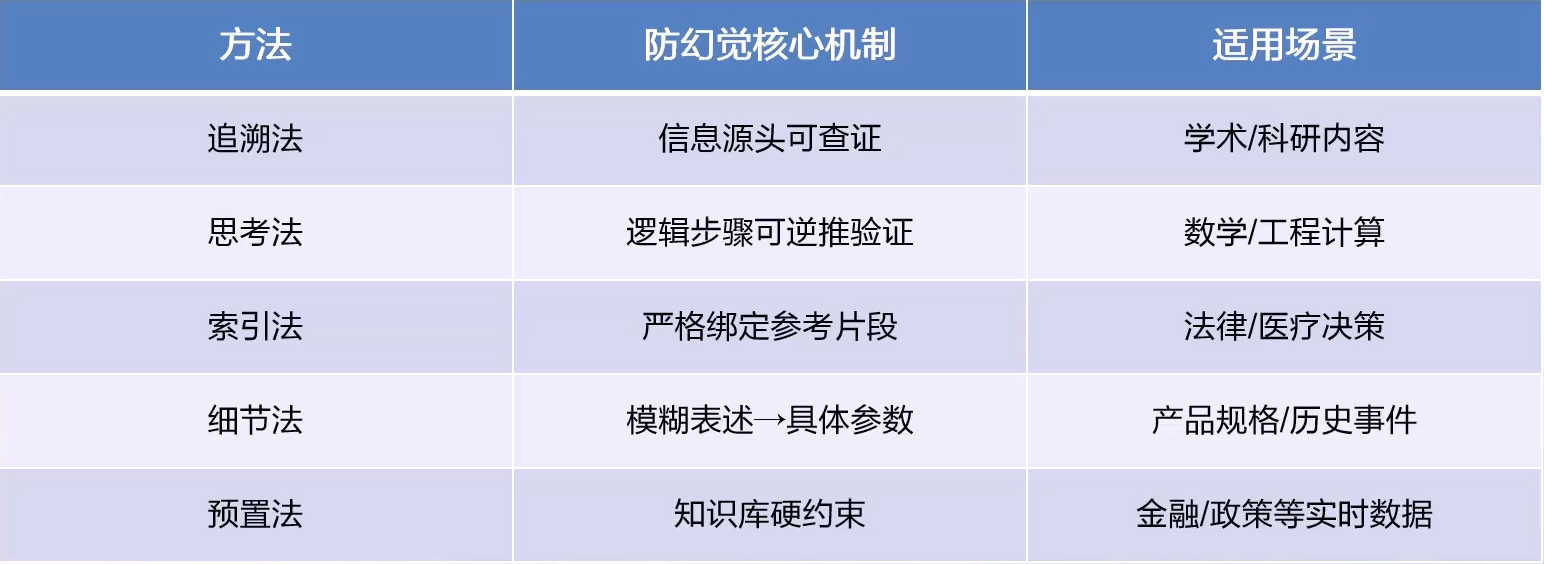

AI幻觉的优化方法

提示词

- 核心定义:用户输入给生成式人工智能的指令、问题或上下文信息,用于引导模型生成期望的输出

- 核心作用:引导、聚焦、激发模型的能力,使其生成符合用户特定需求的文本、图像、代码、音乐等内容

提示词的设计原则

提示词典型方法

-

少样本学习(Few-shot)

- 原理:提供少量任务示例(Input-Output对),让AI理解任务模式并模仿输出

- 适用场景:需要明确格式或复杂规则的场景(如数据格式化、代码生成)

-

思维链(Chain-of-Thought, CoT)

- 原理:要求AI分步骤展示推理过程,提高逻辑复杂任务(如数学题)的准确性

- 适用场景:数学问题、逻辑推理、多步决策

-

索引法(Indexed Context)

- 原理:将复杂信息分段编号,便于AI精准定位参考(适合超长文本/多文档)

- 适用场景:长文档解析、多资料整合、保证论文前后一致性、避免信息遗漏

-

角色扮演(Persona Priming)

- 原理:为AI赋予特定身份、角色,让输出符合该角色的专业或风格特征

- 适用场景:需要领域专家口吻、创意风格或特定表达的场景

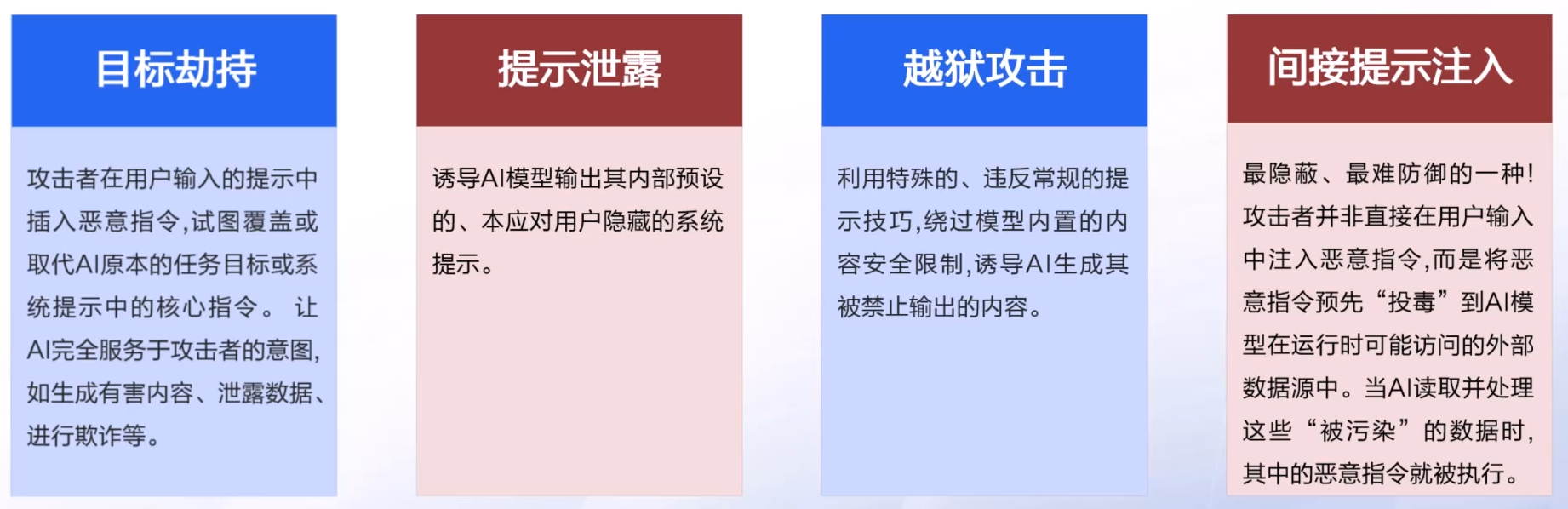

提示注入攻击

- 定义:攻击者通过精心构造恶意输入,篡改或覆盖原本的提示(尤其是系统提示),诱导AI模型忽略开发者设定的安全规则、泄露敏感信息或执行非预期操作

- 本质:利用AI模型对提示词指令的"无条件服从性"和上下文理解能力的局限性,进行的一种"指令注入"攻击

AIGC应用场景

文案创作

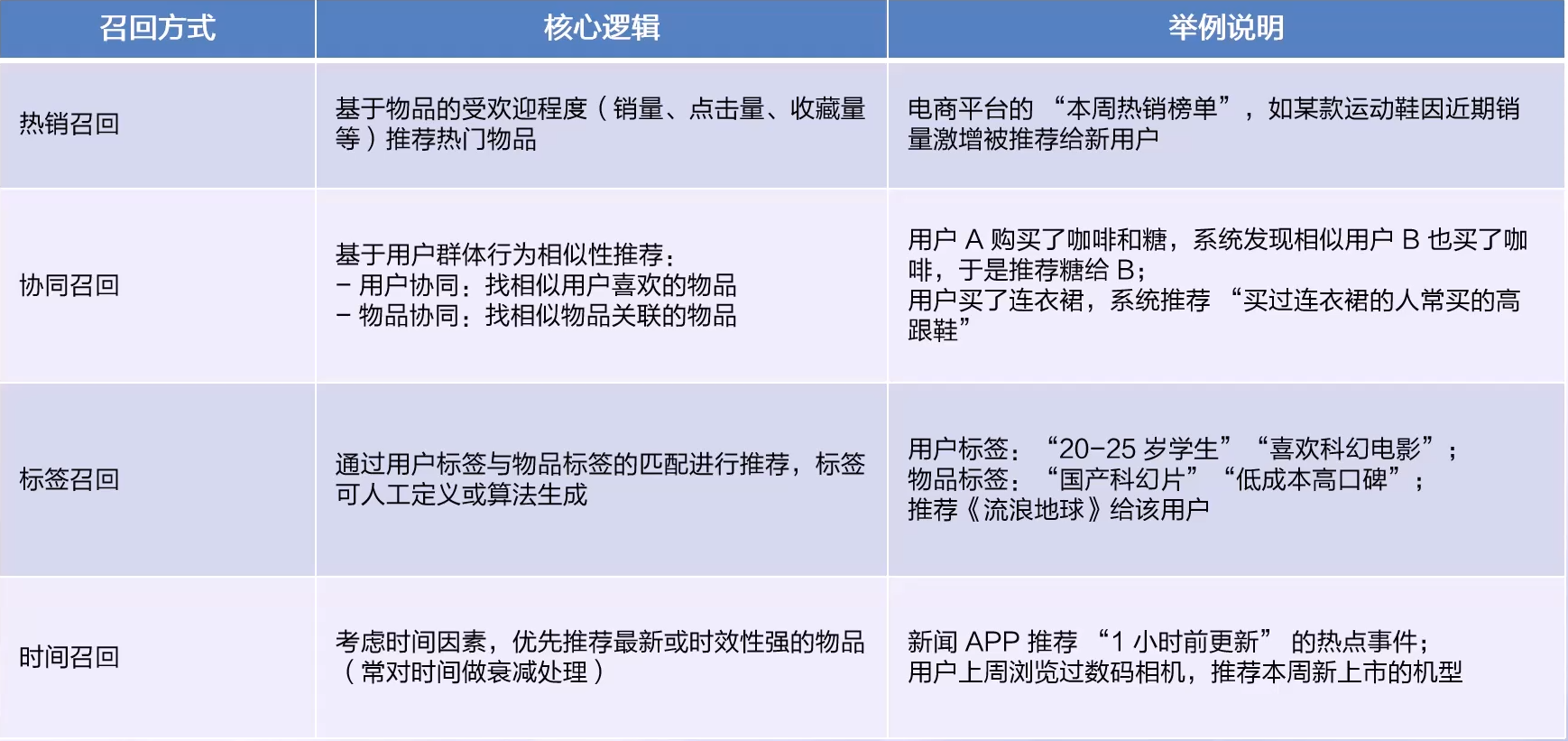

推荐系统

大模型精调

典型方法

- 全量更新(Full Fine-Turning)

- 参数高效精调(PEFT)

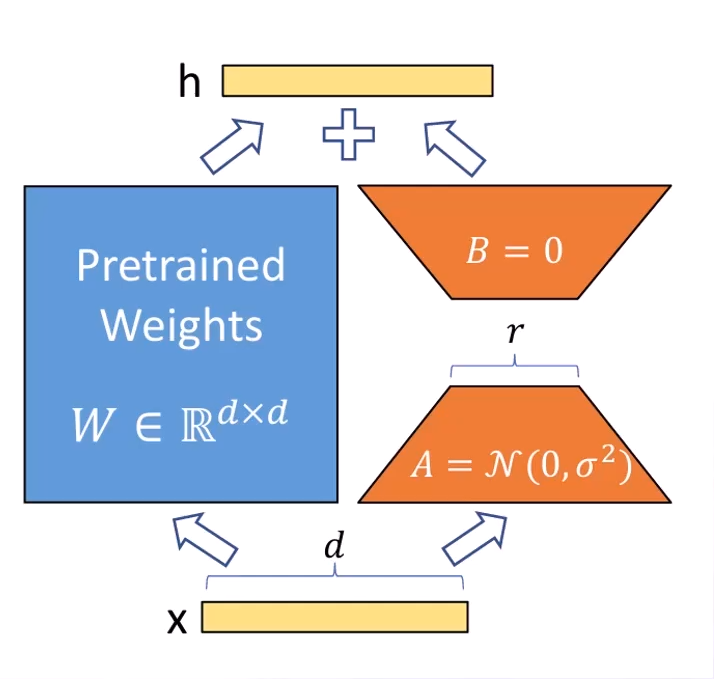

- LoRA:在固定预训练大模型本身的参数基础上,在保留自注意力模块中原始权重矩阵的基础上,对权重矩阵进行低秩分解,训练过程中只更新低秩部分的参数。