引言

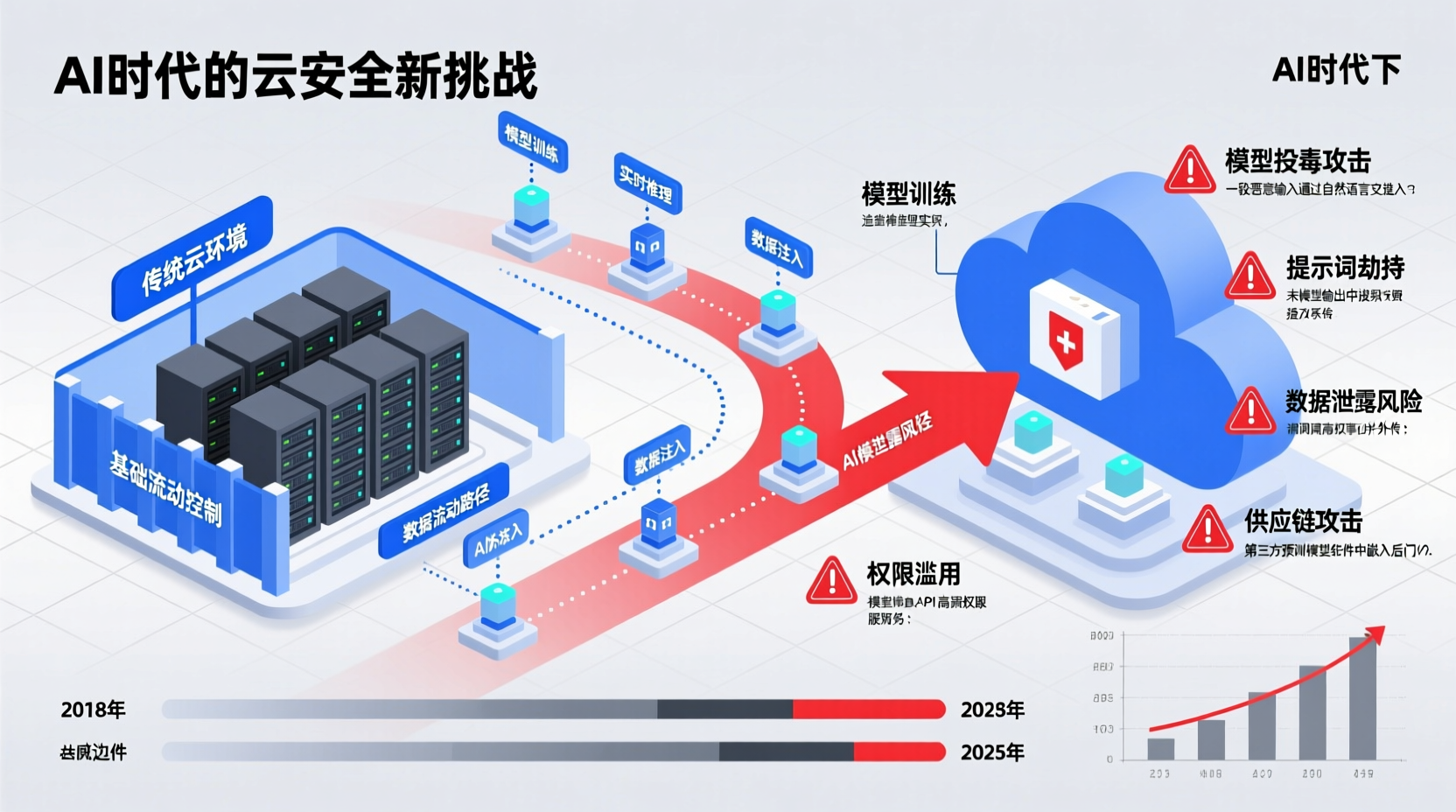

云计算与人工智能的深度融合正在重塑数字基础设施的底层逻辑。当企业竞相将大语言模型、生成式AI服务部署至云端,传统云安全模型正面临前所未有的压力。这种压力并非简单的威胁数量增加,而是源于AI技术特性与云原生架构交织后产生的系统性风险位移------攻击面从代码漏洞扩展到数据偏见,防御重心从边界防护转向模型行为治理。

本文将系统剖析AI时代云安全面临的核心挑战,探讨技术演进带来的新型风险范式,并梳理当前行业形成的应对思路。需要明确的是,这些问题尚未形成标准答案,但理解其复杂性是构建有效防御体系的前提。

正文:五大核心挑战的深层解析

一、攻击面的非线性扩张:从API到提示词注入

传统云安全的攻击面主要围绕网络端口、API接口和身份凭证展开。AI服务的引入创造了全新的交互层:自然语言接口。提示词注入(Prompt Injection)攻击已证明,恶意构造的输入可以绕过应用层控制,直接操纵模型行为。在云环境中,这种风险被进一步放大:

-

多租户隔离失效风险:共享模型服务环境下,攻击者可能通过精心设计的查询探测其他租户的数据模式,甚至提取训练数据中的敏感信息。2023年某研究中,研究人员通过特定提示词成功从商业AI助手恢复出训练数据片段,这种"数据记忆提取"在公有云多租户场景中威胁尤为突出。

-

函数调用链污染:现代AI应用常通过Function Calling机制连接外部工具与数据库。攻击者可通过提示词诱导模型生成恶意函数调用参数,间接访问云存储或执行管理操作。这种攻击路径在云原生微服务架构中,可能跨越多个服务边界,传统WAF设备难以识别。

-

模型服务API的滥用:云厂商提供的模型托管服务(如SageMaker、Vertex AI)通常暴露预测API。攻击者可能利用这些API进行模型窃取攻击------通过大量查询重建模型行为,或发起成本攻击,迫使目标账户产生巨额推理费用。

应对思路:安全团队需要建立"AI网关"层,对输入输出进行语义级过滤与审计。这并非简单的正则匹配,而是需要理解任务上下文的动态策略引擎。同时,对模型API调用实施严格的速率限制与异常检测,将推理请求模式纳入SIEM分析范畴。

二、数据安全的范式转移:静态加密与动态训练的矛盾

云数据安全长期遵循"静态加密、传输加密、访问控制"三原则。但在AI工作负载中,数据生命周期发生根本性变化:

-

训练数据的残余风险:企业通常将海量数据上传至云存储用于模型训练。即使存储桶配置了加密和IAM策略,训练完成后数据仍可能以梯度信息、权重参数等形式"残留"在模型中。研究表明,特定算法可从模型参数中重构训练样本,尤其是在小批量、多轮训练场景下。这意味着传统"删除数据即安全"的逻辑不再成立。

-

向量数据库的隐私困境:RAG(检索增强生成)架构依赖向量数据库存储企业知识。这些向量化表示虽非明文,但通过最近邻搜索可能泄露数据关联关系。攻击者若获得向量库访问权限,可通过成员推断攻击判断特定记录是否存在,这在医疗、金融等敏感领域构成合规风险。

-

数据标注的供应链风险:云端数据标注服务涉及大量外包人员访问原始数据。某案例显示,标注平台的权限配置错误导致测试环境数据被公开访问,其中包含未脱敏的用户信息。AI数据管道的复杂性使得传统DLP工具难以追踪数据流向。

应对思路:差分隐私(Differential Privacy)和同态加密等技术走向实用化是长期方向,但当前更现实的方案是建立"数据血缘"追踪机制,明确哪些数据被用于哪些模型版本训练。对于敏感场景,采用联邦学习架构,将数据保留在本地,仅共享加密梯度,可能是更具可控性的选择。

三、模型供应链的脆弱性:MLOps安全盲区

MLOps管道已成为现代AI应用的软件供应链,但其安全成熟度远不及传统DevOps。从预训练模型到开源数据集,每个环节都可能引入风险:

-

模型序列化攻击 :PyTorch、TensorFlow等框架的模型文件(如

.pkl、.h5)本质上是可执行代码。攻击者可构造恶意模型文件,在加载时执行任意代码。2023年Hugging Face平台发现多个公开模型包含隐藏的后门载荷,这些模型被下载数万次。在云环境中,自动化CI/CD管道可能直接拉取并部署这些恶意模型,缺乏传统代码审计环节。 -

依赖项的级联风险:机器学习项目常依赖数百个Python库,其中不乏未维护的遗留代码。某分析显示,主流NLP库的依赖树中平均存在23个已知高危漏洞。云原生镜像若未进行依赖扫描,这些漏洞将直接进入生产容器。

-

模型版本控制的权限陷阱:模型注册表(Model Registry)作为MLOps核心组件,其访问控制常被简化处理。某企业案例中,数据科学团队为便利配置了过于宽泛的S3存储桶策略,导致模型版本历史可被匿名访问,其中包含未清理的调试日志,泄露了业务策略信息。

应对思路:将软件物料清单(SBOM)理念延伸至AI领域,建立模型物料清单(MBOM),记录模型来源、训练数据版本、依赖库等信息。在CI/CD中集成模型安全扫描工具,检查序列化文件中的可疑操作。更重要的是,对模型注册表实施与代码仓库同等级别的访问审计和分支保护策略。

四、身份与访问管理的再定义:从人类到服务账号

云IAM体系围绕人类用户和应用程序设计,但AI代理(AI Agent)的出现创造了第三类主体:

-

非确定性访问模式:AI代理根据用户请求动态决定调用哪些云资源。传统基于静态角色的访问控制(RBAC)难以适应。例如,一个数据分析助手可能需要临时访问多个S3存储桶和Redshift集群,其访问路径在运行前不可预知。过度授权成为常态,违背了最小权限原则。

-

服务账号爆炸:每个微服务化的AI组件(嵌入服务、向量检索、模型推理)都需要独立身份。某中型AI应用可能涉及数十个服务账号,其凭证管理复杂度指数级增长。云厂商的元数据服务虽可提供临时凭证,但在跨账户、跨云场景中,身份联邦的配置错误频发。

-

人类身份的AI冒充风险:攻击者可能利用AI生成的语音、视频绕过生物识别认证,访问云控制台。更深层的风险是,AI可模拟合法用户的操作模式,使UEBA(用户与实体行为分析)系统产生误判。

应对思路:转向基于属性的访问控制(ABAC)与策略即代码(Policy as Code),允许定义动态授权规则,如"仅当请求源自特定VPC端点且数据标签为公开时允许访问"。同时,为AI代理建立独立的身份域,使用短期令牌和即时(Just-In-Time)权限提升机制。对所有服务账号的操作实施无日志不运行(No Logs, No Ops)的强制要求。

五、合规与审计的复杂性:可解释性要求与黑盒模型的冲突

GDPR、CCPA等法规赋予用户"解释权",要求企业说明自动化决策逻辑。但云端托管的深度学习模型本质上是不透明:

-

审计轨迹的断裂:云日志可记录谁调用了模型API,但无法记录模型内部为何做出特定判断。当AI拒绝用户贷款申请时,企业难以向监管证明决策无歧视性偏见,因为训练数据中的历史偏见已嵌入模型权重。

-

跨境数据流动的AI特例:欧盟《AI法案》对高风险AI系统提出数据本地化要求。但企业可能使用多云策略训练模型,数据分布在AWS、Azure不同区域。模型聚合过程中,数据实质跨境流动,传统数据驻留控制手段失效。

-

责任共担模型的模糊:云厂商提供安全的基础设施,但模型层面的偏见与毒性内容属于客户责任。然而,当使用云厂商的托管模型服务时,责任边界变得模糊。某案例中,客户因使用云厂商预训练模型生成有害内容被起诉,双方就责任划分产生争议。

应对思路:技术上,采用可解释AI(XAI)方法如SHAP、LIME生成事后解释,虽不完美但可作为审计证据。治理上,建立AI影响评估(AIA)流程,在部署前评估模型对隐私、公平性的影响。合同层面,需与云厂商明确模型服务等级协议(SLA),将安全责任细化到具体组件。

总结:从边界防御到全栈韧性

AI时代的云安全挑战本质上是复杂性管理问题。传统安全模型假设系统行为可预测、攻击路径可枚举,但在AI驱动下,这些假设不再成立。我们需要的不是单点解决方案,而是三个层面的范式转变:

技术层面 :从边界隔离转向行为观测,将安全控制嵌入MLOps每个环节,接受"无法完全信任"的前提,建立零信任架构(Zero Trust)在AI工作负载中的具体实践。

治理层面 :从合规检查转向持续风险评估,将模型视为动态演化的生命体而非静态软件,建立跨数据、模型、应用的统一治理框架。

组织层面 :从安全团队独立作战转向嵌入式协作,数据科学家、ML工程师需理解基础安全原则,安全专家需学习AI技术特性,形成共同语言。

云厂商正在快速演进其安全服务,推出模型监控、AI网关等托管功能。然而,工具无法解决根本性问题。企业更需要的是安全思维的升级:承认不确定性的存在,接受部分风险的不可避免,通过冗余、观测、快速响应构建系统韧性,而非追求绝对安全。这才是AI时代云安全实践的核心要义。