买好deepseek云服务,买本国的后可以使用学术加速,依然能访问外部资源:

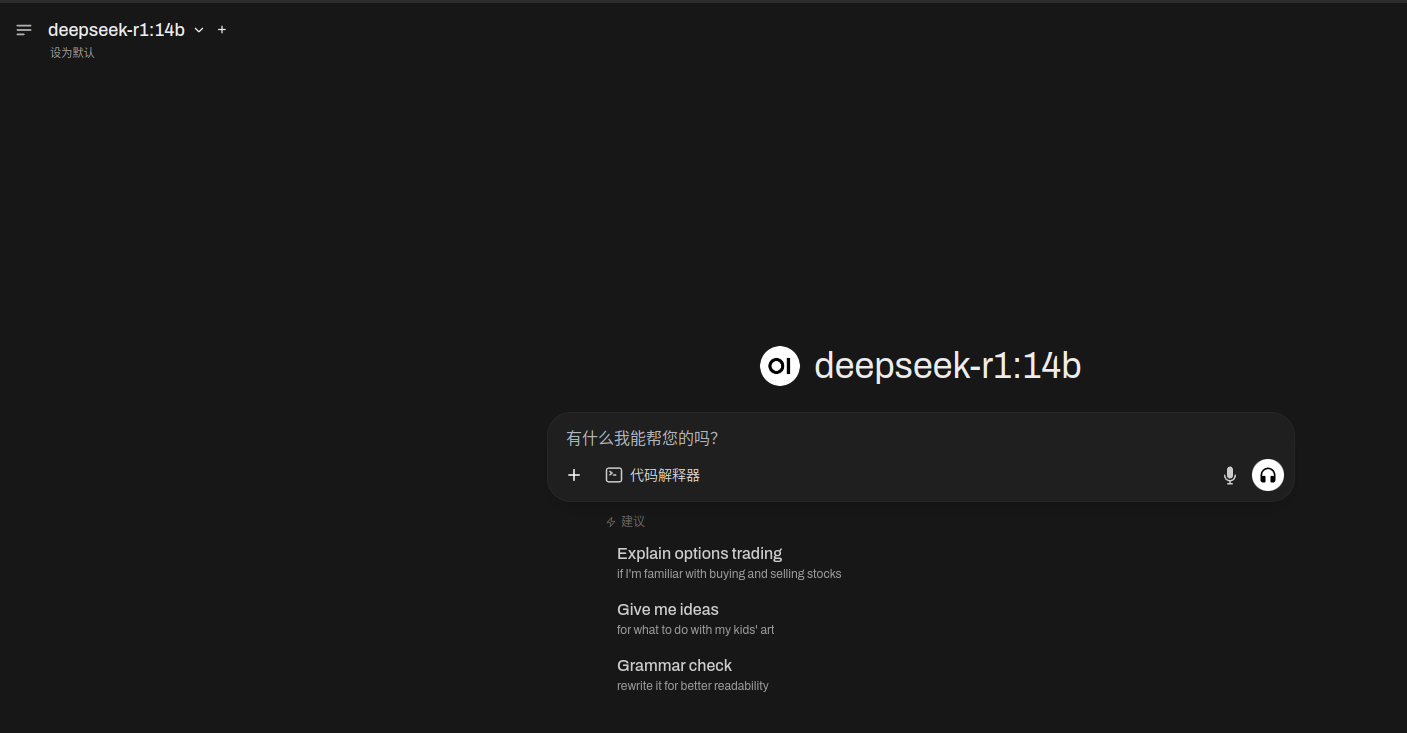

访问http://IP:6699,在做上角还可以选择模型。

访问http://IP:6399/v1/models , 可以看到它都支持哪些models。同时它支持/v1/models的访问,说明它是满足openai规范的。

cpp

{

"object": "list",

"data": [

{

"id": "deepseek-r1:14b",

"object": "model",

"created": 1739341827,

"owned_by": "library"

},

{

"id": "deepseek-r1:8b",

"object": "model",

"created": 1739341820,

"owned_by": "library"

},

{

"id": "deepseek-r1:7b",

"object": "model",

"created": 1739341810,

"owned_by": "library"

},

{

"id": "deepseek-r1:1.5b",

"object": "model",

"created": 1739341797,

"owned_by": "library"

}

]

}访问http://IP:6399,显示如下,说明它用ollama运行的deepseek。

cpp

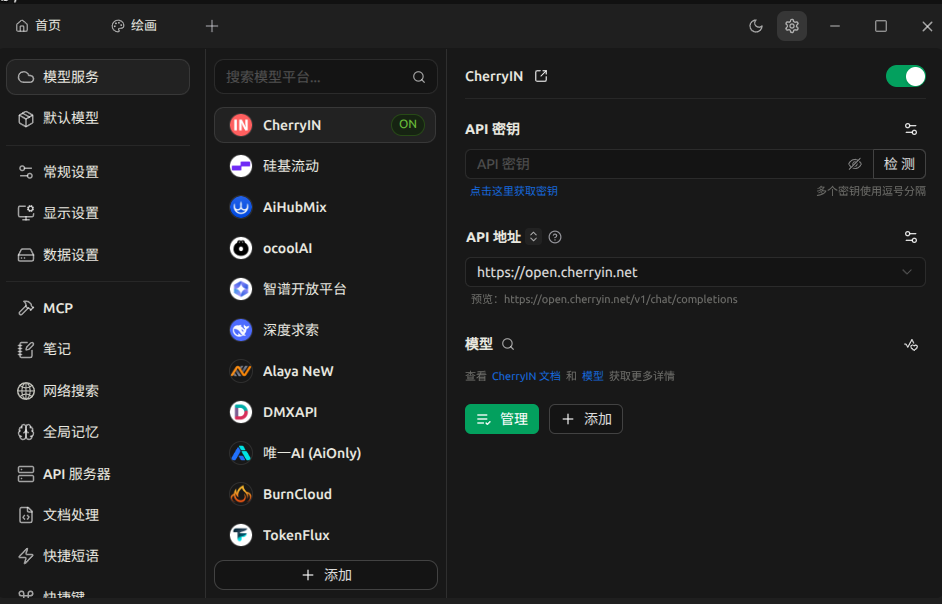

Ollama is running现在我们使用Cherry Studio来连接云服务的Ollama提供的deepseek服务。

点击右上角设置,点击下方添加

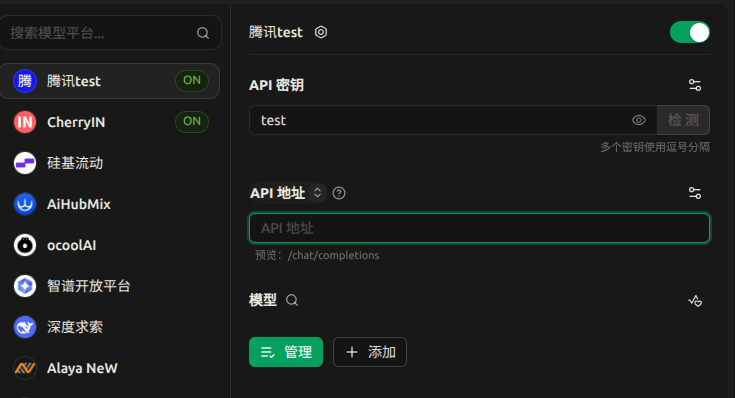

自定义名字,类型选择OpenAI

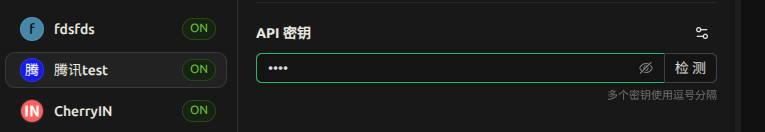

api地址填入:http://IP:6399,API密钥自定义填写

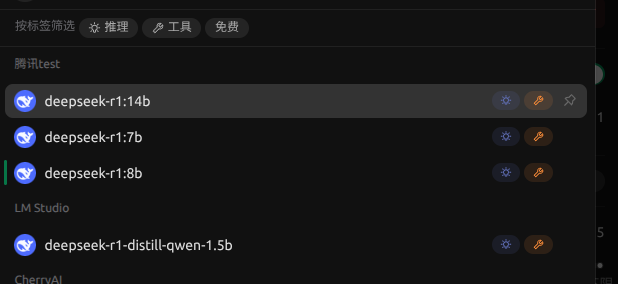

然后点击管理,就能看到和云上相同的模型list,点击+号添加。

点击检测,显示连接成功:

返回首页,点击默认助手

点击选择模型:

选择我们之前添加的模型即可:

在话题框可以看到已经接入云服务: