环境

系统:CentOS-7

CPU : E5-2680V4 14核28线程

内存:DDR4 2133 32G * 2

显卡:Tesla V100-32G【PG503】 (水冷)

驱动: 535

CUDA: 12.2

ComfyUI version: 0.4.0

ComfyUI frontend version: 1.34.8系统软件信息

系统信息

OS

linux

Python Version

3.12.12 | packaged by Anaconda, Inc. | (main, Oct 21 2025, 20:16:04) [GCC 11.2.0]

Embedded Python

false

Pytorch Version

2.9.1+cu128

Arguments

main.py --listen --port 8188 --cuda-malloc --lowvram

RAM Total

62.68 GB

RAM Free

60.25 GB启动

bash

python main.py --listen --port 8188 --cuda-malloc --lowvram参考

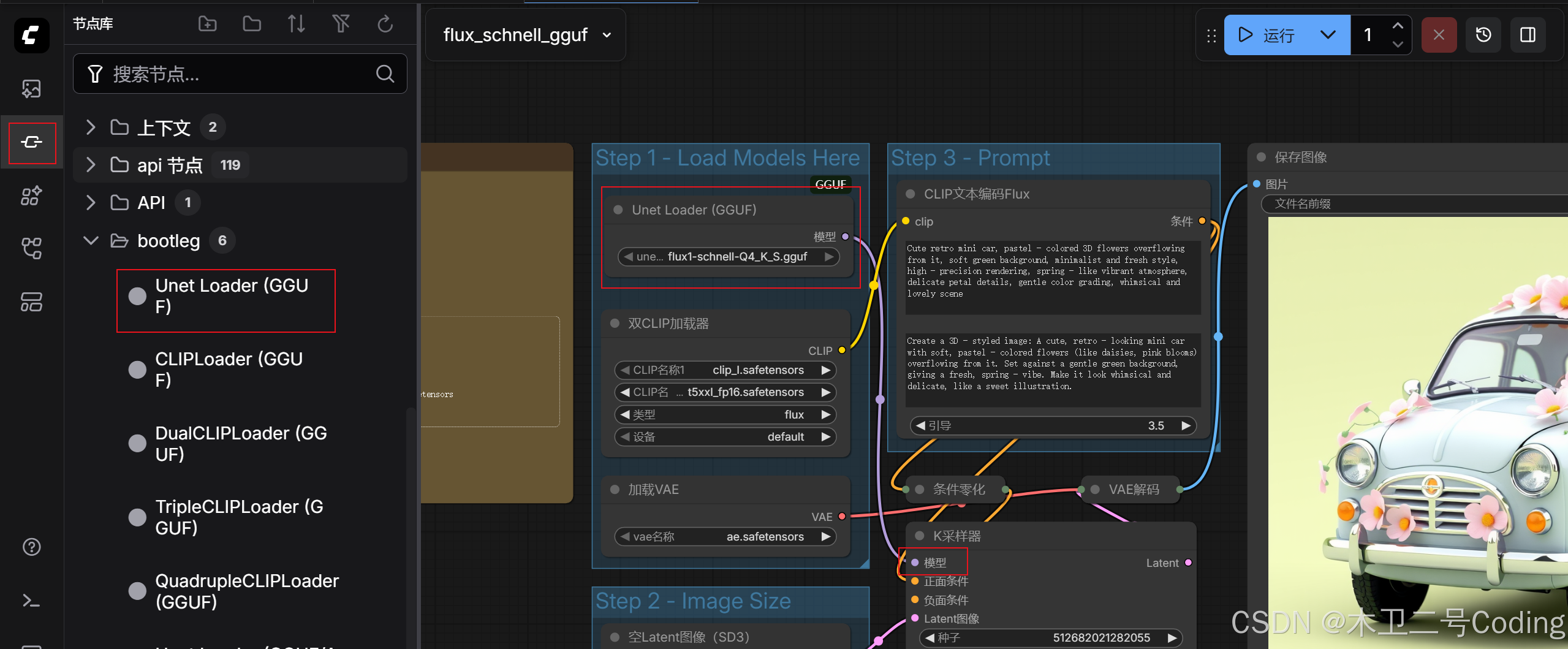

基于ComfyUI的Flux Schnell案例修改模型为GGUF加载器

[第五十九篇-ComfyUI+V100-32G+运行Flux Schnell-CSDN博客](https://blog.csdn.net/hai4321/article/details/155953374)ComfyUI安装GGUF支持

进入你看着ComfyUI目录的custom_nodes

cd ComfyUI/custom_nodes

克隆代码

git clone https://github.com/city96/ComfyUI-GGUF

安装依赖

pip install -r requirements.txt

重启ComfyUI下载GGUF模型

放入ComfyUI/models/unet文件夹中

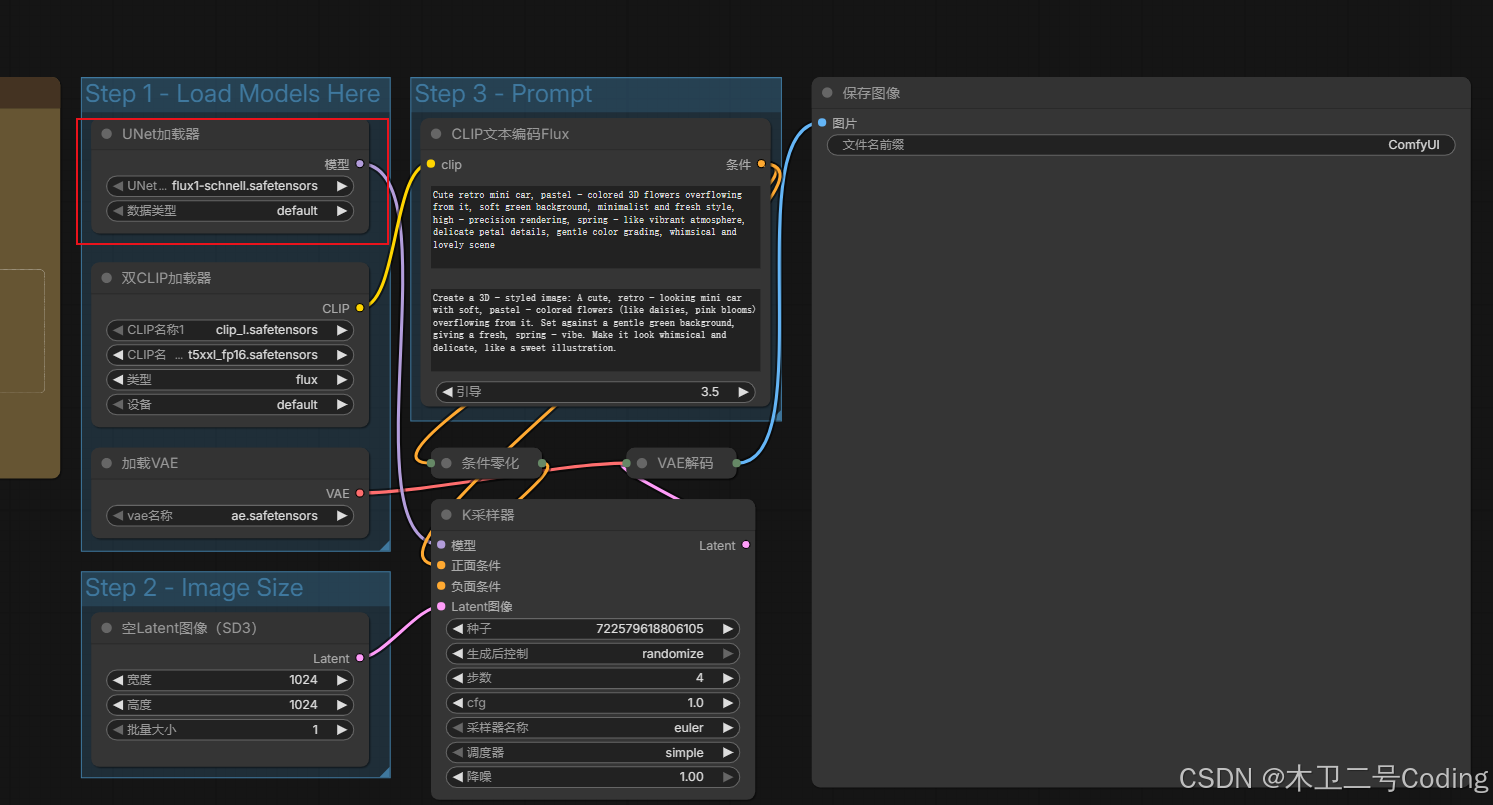

调整模型加载器

删除Setp1 UNet加载器

添加【节点库】--》【UnetLoader(GGUF)】-》【选择flux1-schnell-Q4_K_S.gguf】

Flux Schnell完整版文生图

保存工作流

Ctrl+S运行结果

第一次时间长一点

参数

1024*1024

时间

bash

gguf qtypes: F32 (468), Q4_K (304), F16 (4)

model weight dtype torch.float16, manual cast: None

model_type FLOW

Requested to load Flux

loaded completely; 30387.70 MB usable, 6595.58 MB loaded, full load: True

100%|███████████████████████████████████████████████████████████████████████████████████████| 4/4 [00:06<00:00, 1.69s/it]

Prompt executed in 11.09 seconds

got prompt

100%|███████████████████████████████████████████████████████████| 4/4 [00:06<00:00, 1.70s/it]

Prompt executed in 7.59 seconds

got prompt

100%|███████████████████████████████████████████████████████████| 4/4 [00:06<00:00, 1.70s/it]

Prompt executed in 7.61 secondsGPU

bash

Tue Dec 16 21:42:54 2025

+---------------------------------------------------------------------------------------+

| NVIDIA-SMI 535.129.03 Driver Version: 535.129.03 CUDA Version: 12.2 |

|-----------------------------------------+----------------------+----------------------+

| GPU Name Persistence-M | Bus-Id Disp.A | Volatile Uncorr. ECC |

| Fan Temp Perf Pwr:Usage/Cap | Memory-Usage | GPU-Util Compute M. |

| | | MIG M. |

|=========================================+======================+======================|

| 0 Tesla PG503-216 On | 00000000:04:00.0 Off | 0 |

| N/A 21C P0 36W / 250W | 7184MiB / 32768MiB | 0% Default |

| | | N/A |

+-----------------------------------------+----------------------+----------------------+总结

1.GPU 占用7-8G

2.GPU 100%

3.7 秒左右一张1024*1024

4.还是挺好用的,GPU内存占用只有7G多,比fp16少很多

bash