高性能接口忆阻器

第一节:类脑智能技术与系统对材料性能的要求及材料技术限制

类脑智能技术的发展,在很大程度上依赖于先进材料技术的突破。材料是实现类脑计算硬件(神经形态芯片)物理基础的基石。

一、涉及的先进材料技术

类脑智能硬件旨在模拟大脑的神经网络结构,其核心是构建人工神经元和突触。这推动了对超越传统硅基CMOS技术的新材料的需求。主要材料方向包括:

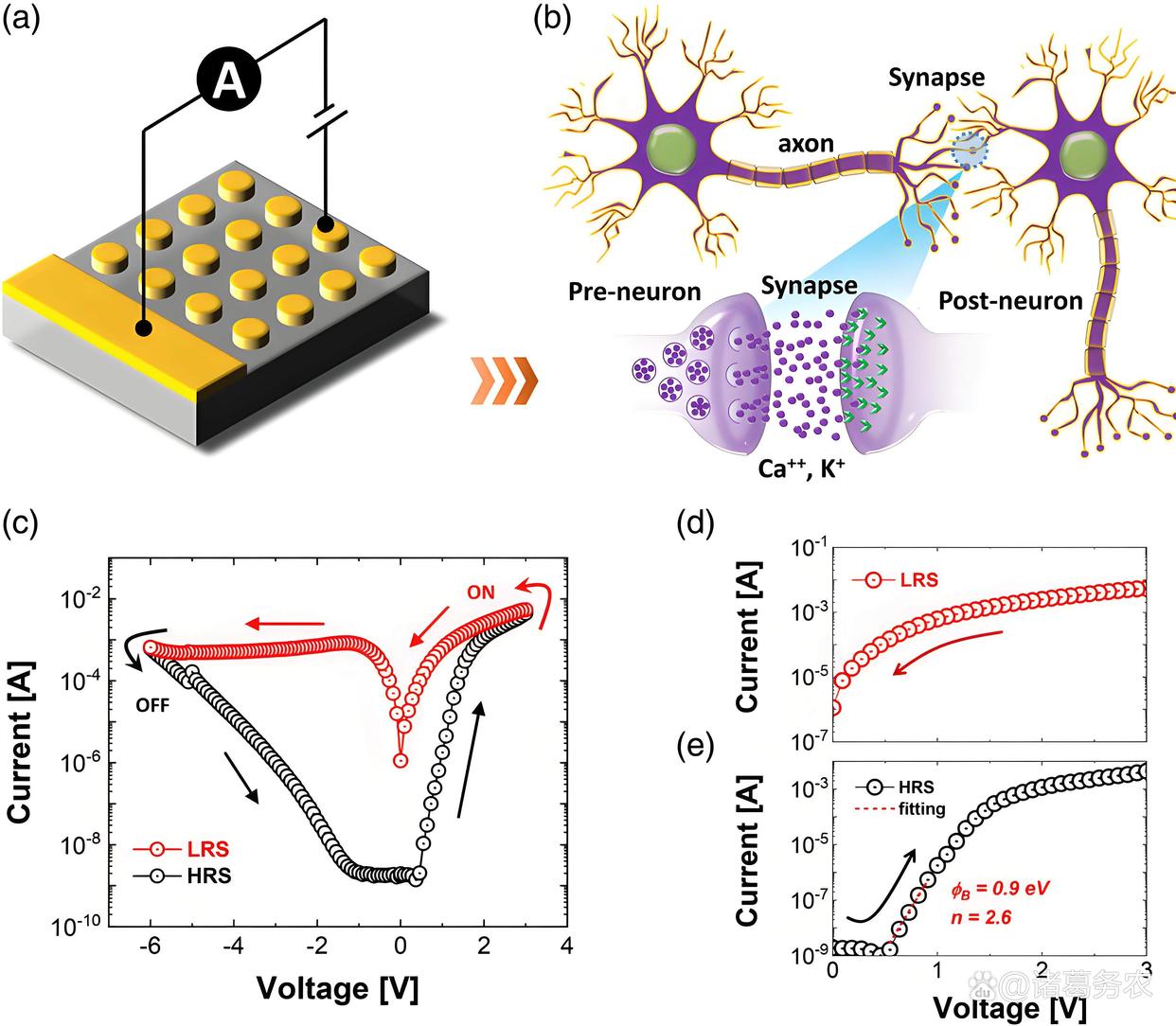

- 忆阻器(Memristor)及相关材料:

这是目前最受关注、发展最快的类脑计算材料体系。其电阻值随流经的电荷历史而变化,能天然模拟生物突触权重的增强或削弱(STDP机制)。

典型材料:

金属氧化物:如 HfO₂、TaOₓ、TiO₂。这些材料与CMOS工艺兼容性好,是当前研究的主流。

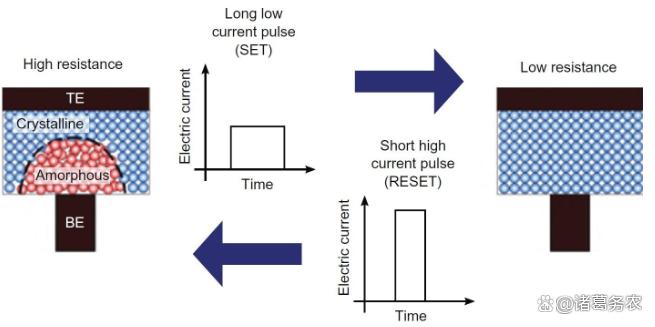

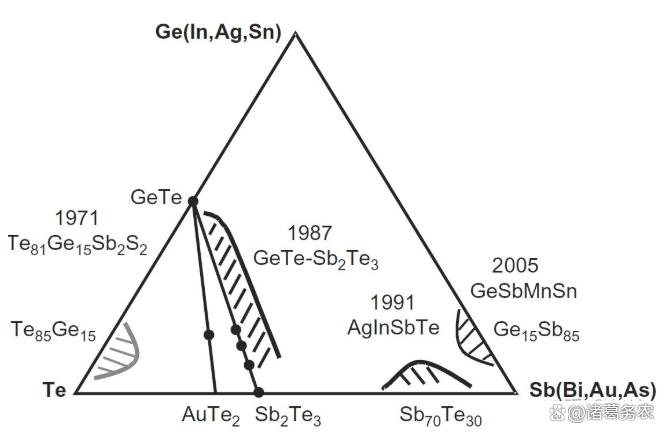

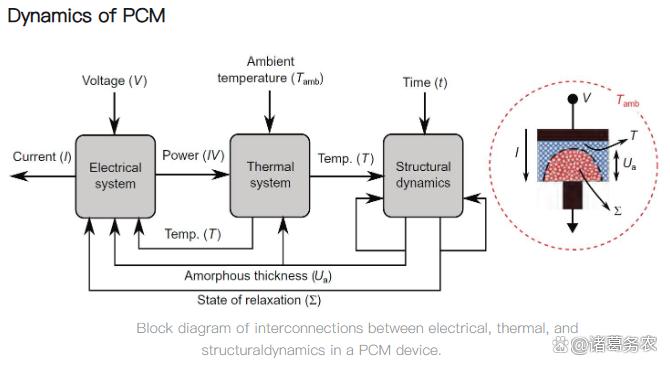

相变材料(PCM):如 Ge₂Sb₂Te₅ (GST)。通过晶态(低阻)与非晶态(高阻)的相变来实现电阻切换。

铁电材料:如 HfZrO₂ (HZO)、PZT。利用铁电畴的极化方向来改变势垒,实现电阻变化。

二维材料:如 MoS₂、石墨烯。具有原子级厚度、优异的电学特性和新奇的物理效应,可用于构建超薄、低功耗的忆阻器件。

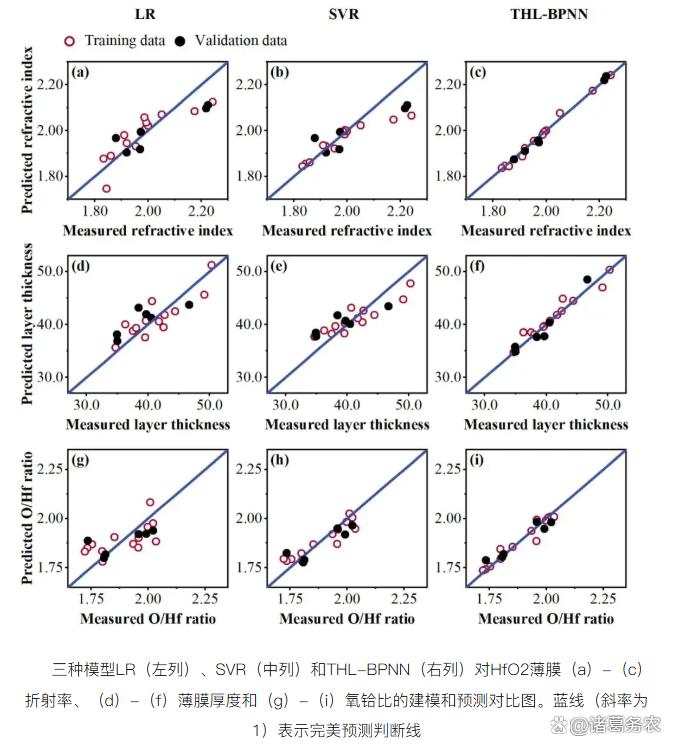

热退火工艺调控HfO₂薄膜性能的神经网络

- 低维半导体材料:

用于构建超高密度、低功耗的晶体管,作为人工神经元或用于读写忆阻器。

典型材料:碳纳米管(CNTs)、二维半导体(如MoS₂)。它们具有极高的载流子迁移率和原子级厚度,有望制造出比硅更小、更快的器件。

- 多铁性材料(Multiferroics):

同时具有铁电性和(反)铁磁性的材料。其重要性在于能够用电场控制磁化状态(磁电耦合效应),这对于实现超低功耗的磁忆阻器或新型神经元至关重要。

- 超导材料:

用于极低功耗的类脑计算。超导器件(如约瑟夫森结)可以利用磁通量子等物理量来模拟神经元和突触的行为,但其工作需要极低温环境,限制了应用场景。

- 生物相容/有机材料:

用于未来可能与生物系统直接集成的类脑器件或可穿戴/可植入设备。

典型材料:导电聚合物、分子电子学材料。

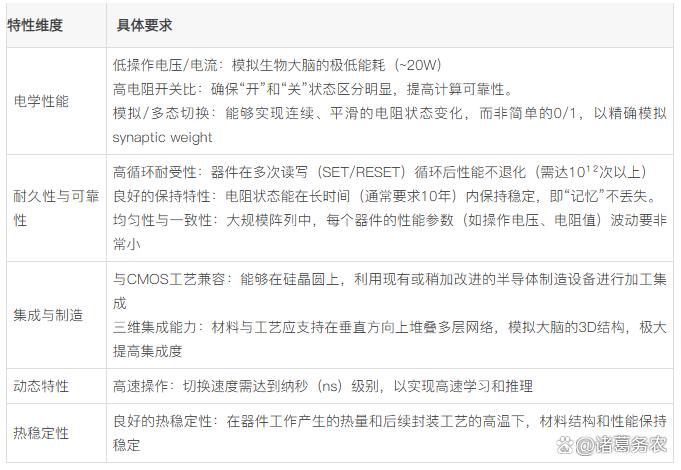

二、对材料技术的具体要求

类脑硬件对材料的要求极为苛刻,远高于传统数字电路:

类脑硬件对材料的要求

三、理想的材料技术

理想的类脑计算材料应尽可能接近地模拟生物神经元和突触的所有关键特性,并满足大规模集成的工程要求,应具备:

- 生物真实性:

其动力学行为(如弛豫、积分-发放)能天然地模拟生物单元,而无需复杂的电路模拟。

- 极致能效:

操作能量接近生物突触的每次事件飞焦(fJ)甚至阿焦(aJ) 级别。

相变材料类脑应用机制

- 高密度集成:

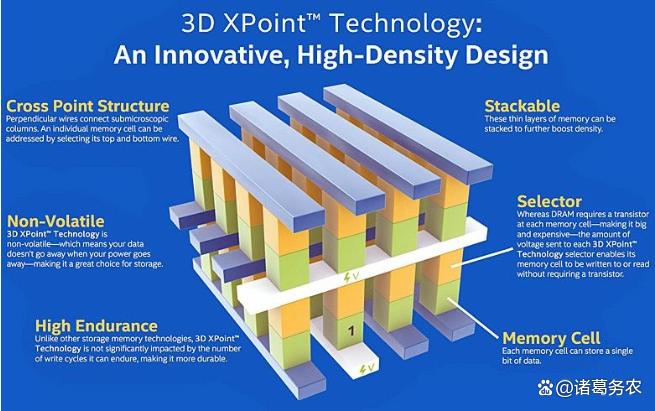

器件尺寸可微缩至纳米尺度,并支持3D垂直集成,从而实现人脑规模的千亿级突触互联。

- 多物理场调控:

不仅能用电场调控,还能被光、磁、应变等多种物理场调控,以实现更丰富的信息处理功能。

- 良好的学习能力:

支持脉冲时序依赖可塑性(STDP) 等多种学习规则,且能实现在线学习和非监督学习。

- 耐受缺陷与自适应:

像大脑一样,在部分器件失效或性能波动时,整个系统仍能通过学习和自适应保持稳健运行。

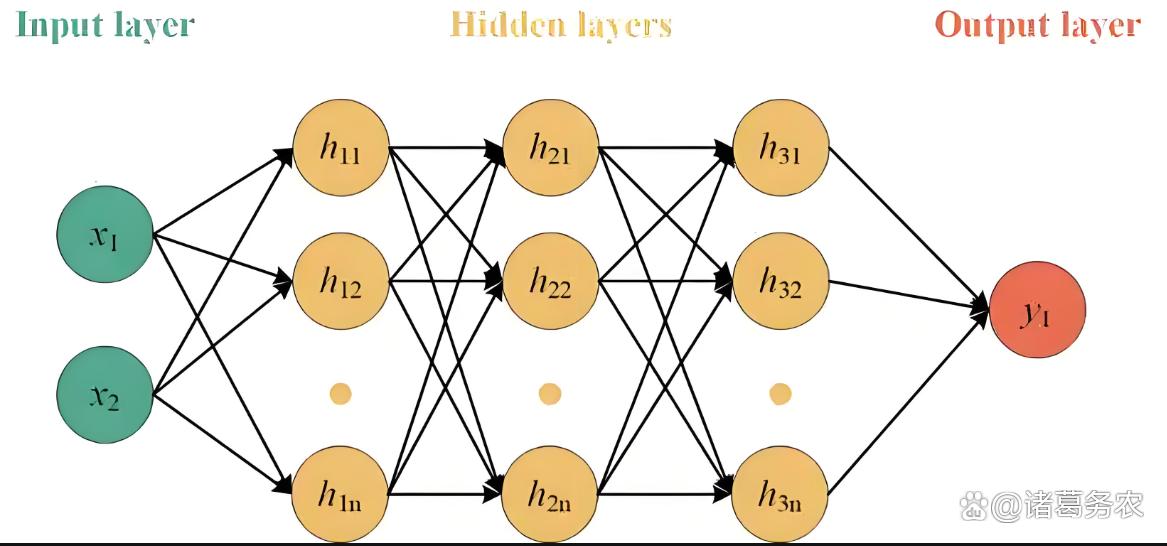

具有3层隐含层的BPNN全连接网络模型

四、限制性能提升和发展的材料技术不足

当前,材料技术的不足是制约类脑智能硬件性能和走向实用的最主要瓶颈:

- 忆阻器的均匀性与一致性差:

这是最大的挑战。同一芯片上不同忆阻器件的参数(如阈值电压、导通电阻)存在较大波动。这导致神经网络计算精度下降、预测结果不可靠,严重制约了大规规模阵列的实现。

- 耐久性(Endurance)不足:

许多忆阻器在经历数百万到数十亿次切换后就会失效,而类脑系统需要持续学习和调整,要求器件寿命极长(万亿次循环)。

- 数据保持(Retention)与操作速度的权衡:

通常,保持特性好的材料(如PCM)切换速度较慢;而切换速度快的材料(如金属氧化物)保持特性又相对较差。找到兼具两者优点的材料体系非常困难。

相变材料在类脑和人工智能领域的应用历

- 集成工艺挑战:

热预算:新型材料的沉积和加工温度可能与CMOS后端工艺不兼容。

串扰(Crosstalk):在高密度交叉阵列中,读写一个器件时可能会干扰到相邻器件的状态。

选通器(Selector):缺乏性能完美的选通器来抑制串扰。理想的选通器需要具有极高的非线性特性,目前尚无完美解决方案。

- 模拟行为的线性与对称性:

理想的突触权重更新应是线性且对称的。但大多数忆阻器的电导变化是非线性且不对称的(SET和RESET过程不同),这严重影响了神经网络训练的准确性和收敛速度。

- 新材料制造的可扩展性与成本:

许多低维材料(如碳纳米管、二维材料)的高质量、大面积、均匀制备技术尚不成熟,成本高昂,难以从实验室走向产业化。

五、小结

材料是类脑计算从概念走向现实的物理载体。虽然忆阻器等新型材料带来了巨大的希望,但其在均匀性、耐久性、可靠性等方面的不足,仍然是构筑大规模、高可靠性类脑智能系统的核心障碍。

未来的发展依赖于材料科学、器件物理、电子工程和计算机科学的深度融合,通过在原子尺度上精准设计和调控材料,最终研制出能真正模拟大脑高效与智能的"理想材料"。

第二节:类脑智能技术和系统能耗及节能技术进展

能耗是制约人工智能(包括类脑智能)发展的核心瓶颈之一,而类脑智能的初衷正是为了破解这一难题。下面我将从能耗制约、新型能源利用、节能技术进展和前沿趋势四个方面为您详细解析。

一、能耗与能量制约:问题的严重性

类脑智能系统的能耗主要制约来自以下几个方面,这些制约共同构成了其发展的"能量墙":

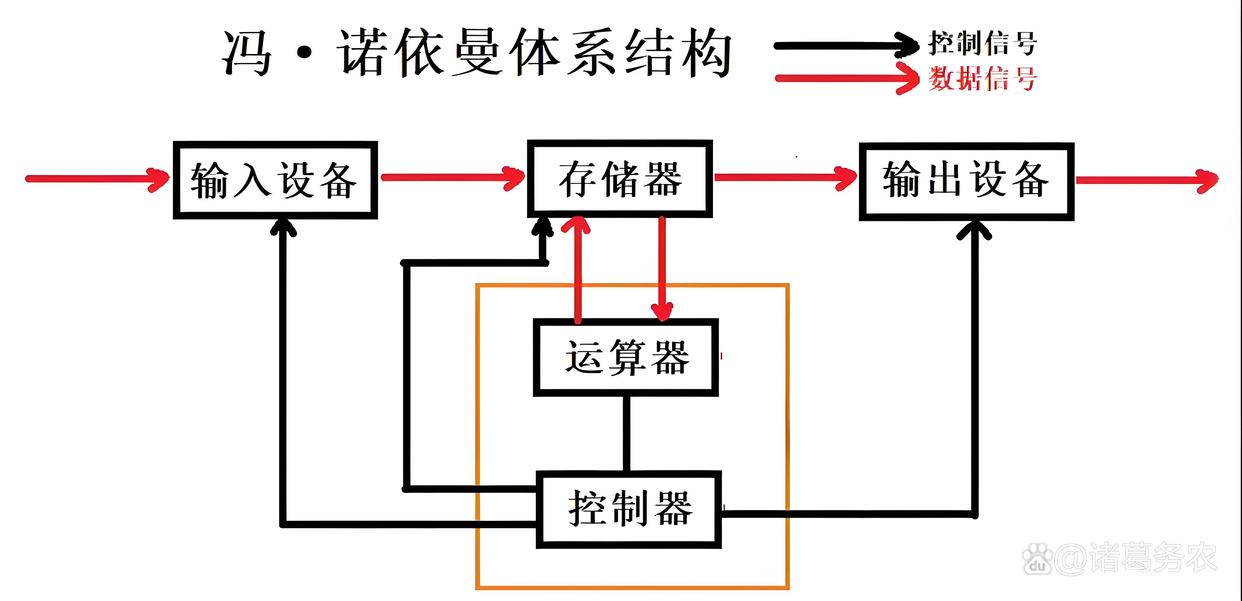

- 传统架构的"内存墙"问题:

在传统的冯·诺依曼架构中,计算单元和存储单元是分离的。处理数据需要在两者之间进行频繁搬运,这个过程所消耗的能量和时间远高于计算本身。对于数据密集型的AI任务,这成了能效的主要瓶颈。

冯·诺依曼架构

- 精度过高的代价:

传统AI芯片(如GPU)使用高精度(如32位浮点) 进行计算,每一步操作都消耗大量能量。然而,大脑使用稀疏的、低精度的脉冲进行计算,证明了高效智能无需高精度。

- 通信能耗:

在大型神经网络中,神经元/核心之间的通信能耗可能超过计算本身的能耗。如何高效地路由和传递信息是关键挑战。

- 冷却开销:

高功耗必然产生大量热量,需要复杂的冷却系统(如液冷),这又进一步增加了系统的总能耗和体积,使其难以部署在边缘设备上。

一句话总结:传统计算架构是为高精度、通用计算设计的,其能效本质上是与大脑的高效能背道而驰的。

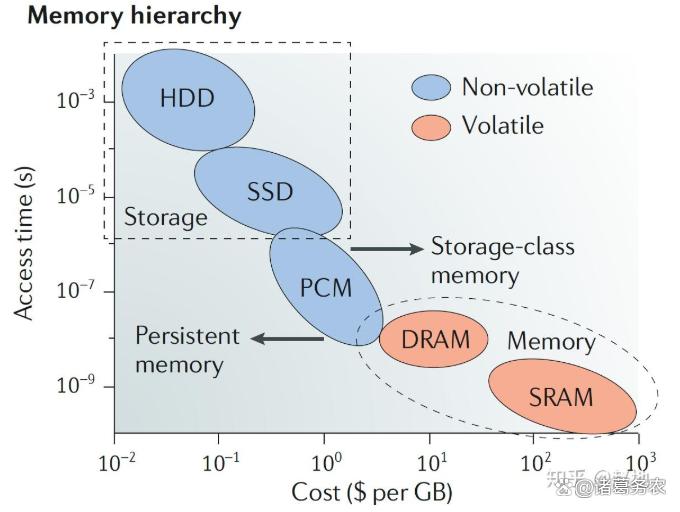

Memory hierarchy

二、新型能源利用:从"节能"到"自供能"的愿景

为了让类脑智能系统(尤其是植入式和远程边缘设备)长期自治运行,仅靠节能是不够的,还需要探索新型能源利用方式。

(一)能量收集(Energy Harvesting):

-

原理:从环境中采集微弱的、分散的能量并转换为电能。

-

技术:

光能收集:适用于有光的环境。

振动/动能收集:利用机械振动发电,适用于工业设备、可穿戴设备。

射频(RF)能量收集:捕获空间中的无线电波(如Wi-Fi、蜂窝信号)能量。

热电能收集:利用体温与环境温度的差异发电。

- 挑战:

能量通常微弱、不稳定,需要与超低功耗的类脑芯片配套使用才能有效。

(二)近/亚阈值计算(Near/Sub-threshold Computing):

原理:让晶体管工作在接近或低于其阈值电压的区域。此时开关速度变慢,但能耗呈指数级下降。

应用:这主要是一种节能技术,但它使得依靠微弱的环境能量驱动芯片成为可能,是实现"永远在线(always-on)"智能感知的关键。

英特尔 3D XPoint 技术

三、节能技术进展:类脑智能的核心贡献

类脑智能技术本身就是一整套节能技术的集合,其进展直接体现在能效的提升上。

(一)算法与模型层面

- 脉冲神经网络(SNN):

事件驱动:神经元仅在接收到足够输入时才发放脉冲,没有动态输入时就保持静默,几乎不耗能。这种"稀疏性"是能效革命的根源。

二进制通信:脉冲是全有或全无(0或1) 的事件,避免了高精度的浮点运算和数据传输。

- 本地学习与稀疏连接:

借鉴大脑的脉冲时序依赖可塑性(STDP) 等局部学习规则,避免需要反向传播这种全局、高能耗的训练方式;神经网络连接本身是稀疏的,减少了需要计算的连接数量。

相变材料器件

(二)硬件架构层面

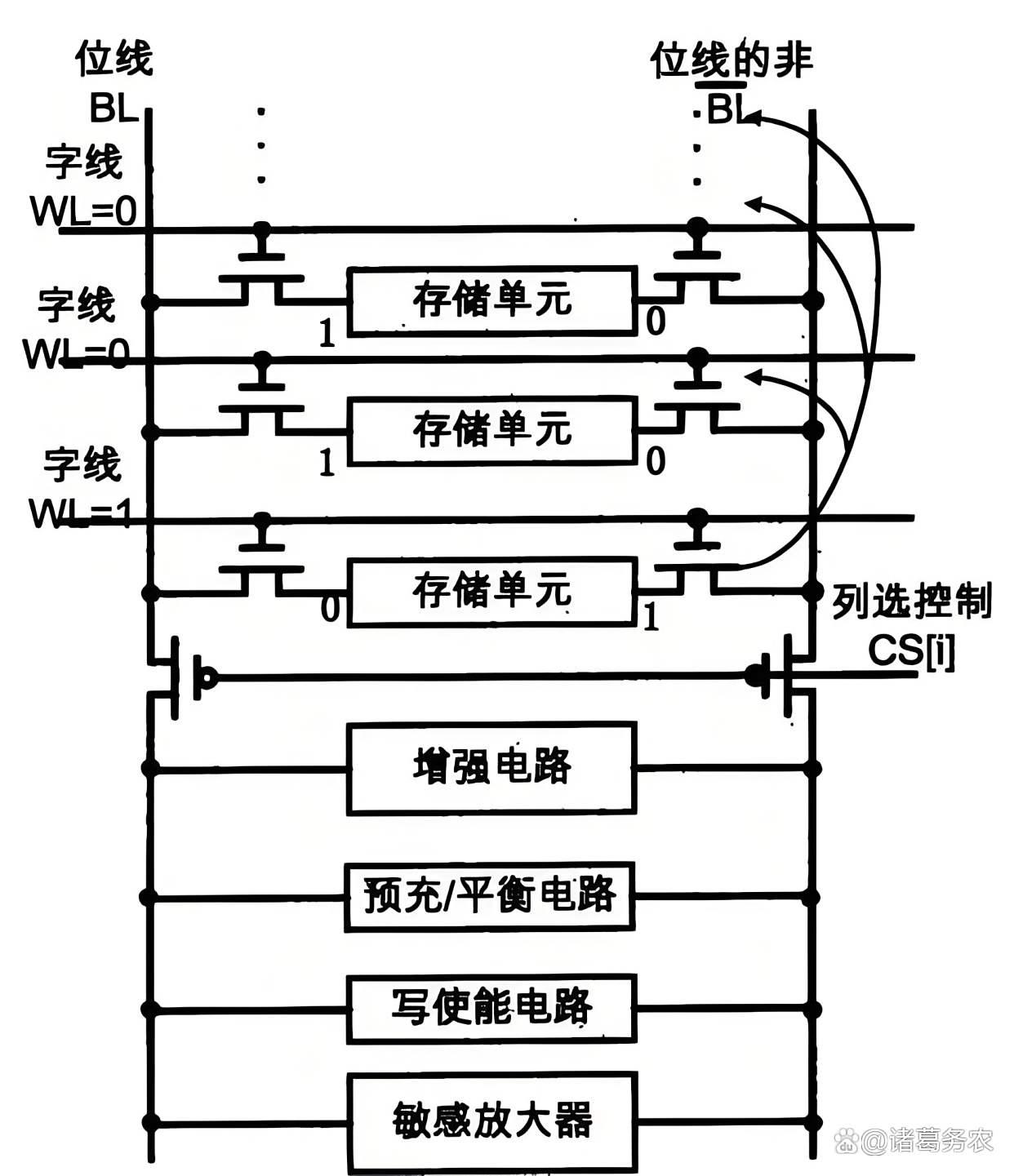

- 存算一体(In-Memory Computing):

这是打破"内存墙" 的终极解决方案。直接在数据存储的位置进行计算,彻底消除了数据搬运。

实现方式:① 数字存算一体:利用SRAM/MRAM等存储器单元实现;② 模拟存算一体:利用忆阻器(Memristor)、相变材料(PCM) 等新型器件。它们的电导值可以代表权重,利用欧姆定律和基尔霍夫定律直接在阵列中完成乘加运算,能效极高。

- 异步电路设计:

与传统全局同步时钟(Clock)芯片不同,神经形态芯片(如Intel Loihi)多采用异步电路。没有时钟树的翻转功耗,且只有在有事件发生时才会激活相关电路,进一步降低动态功耗。

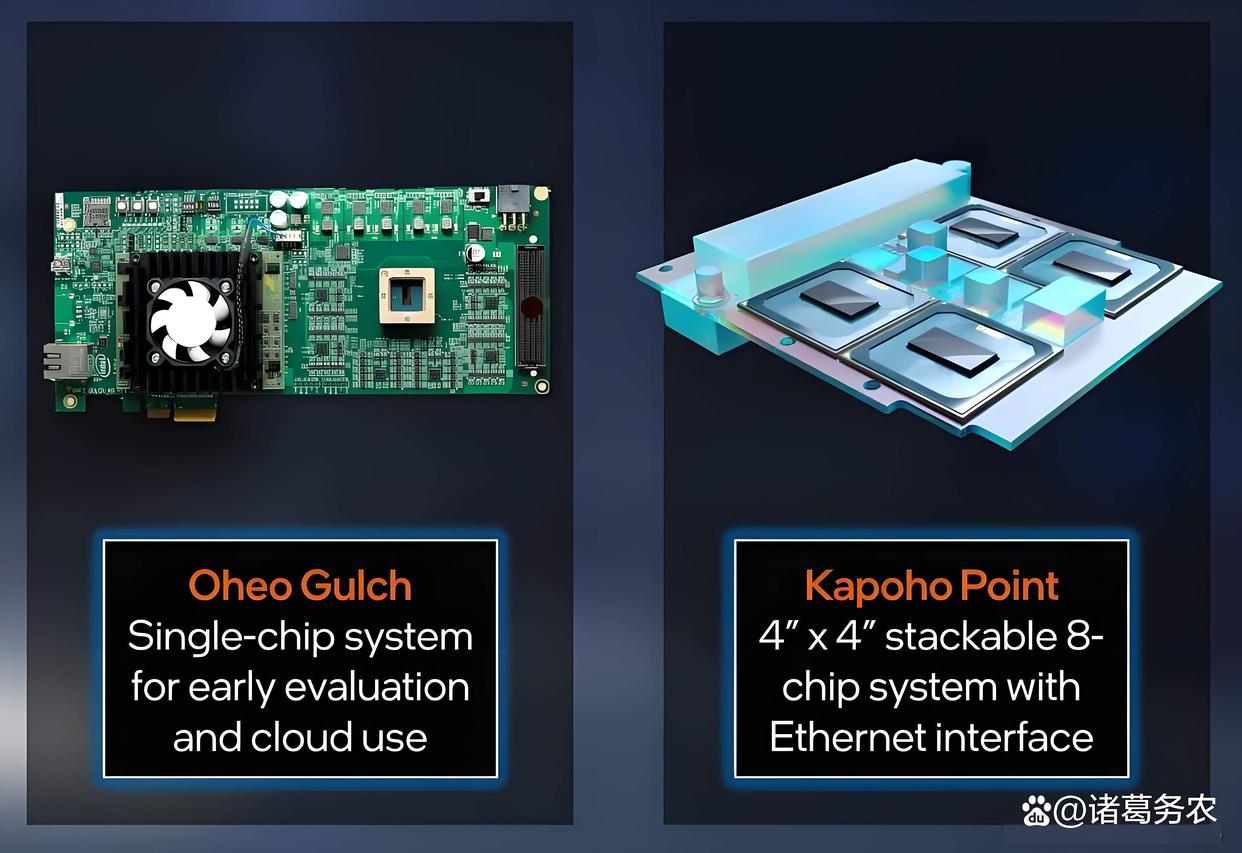

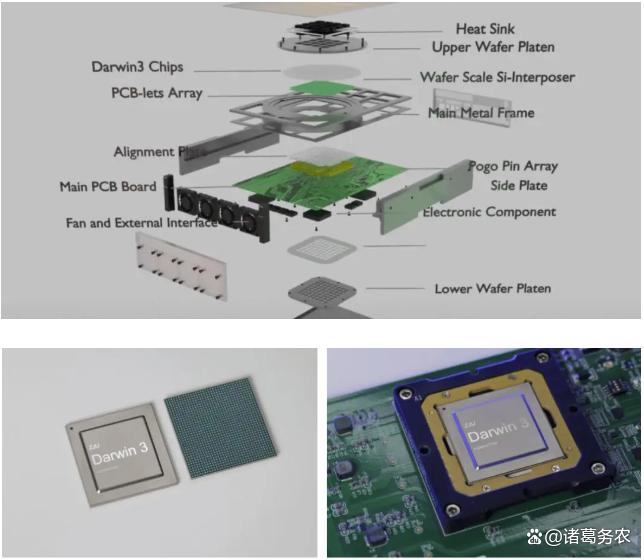

- 神经形态芯片的规模化:

如英特尔的Loihi 2、浙江大学Darwin芯片等,都在架构上极致优化了事件驱动的处理方式,实现了毫瓦(mW)级甚至微瓦(μW)级的超低功耗运行,为传统GPU能耗的千分之一甚至万分之一。

一种亚阈值存储阵列电路

四、前沿趋势与未来方向

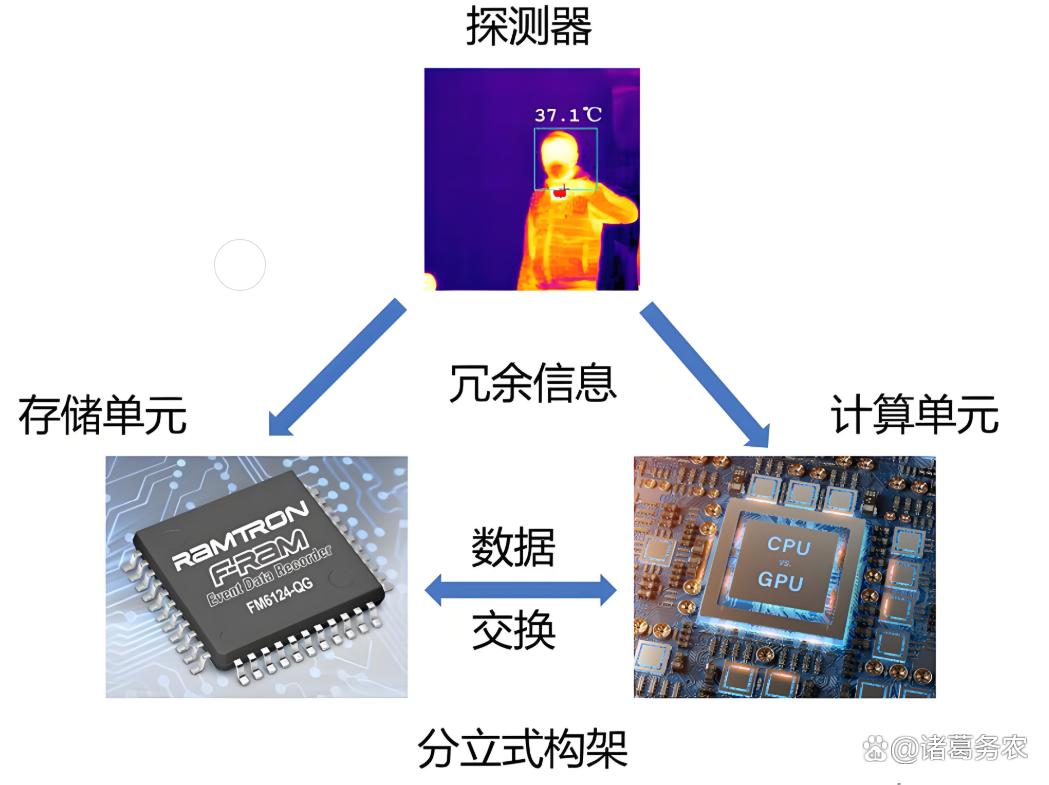

- 感存算一体(Sensor-Processing-In-Memory):

这是最前沿的趋势之一。将传感器(视觉、听觉)、内存、处理器三者紧密集成甚至融合。

案例:事件相机(Event-based Camera) 本身就是一种"类脑传感器",它只输出像素级的光强变化事件(脉冲),其后端的SNN处理器可以极低功耗处理这种稀疏数据流。现在的研究正尝试将处理电路直接放在传感器像素下方或旁边,实现终极能效优化。

- 算法-硬件协同设计(Algorithm-Hardware Co-Design):

未来的突破将更依赖于跨层优化。即为特定的低功耗算法(如SNN)设计专用硬件,同时根据硬件的特性(如忆阻器的非理想性)来优化算法,相互适应,实现全局能效最优。

- 新型器件与材料的探索:

Beyond忆阻器,研究人员在探索二维材料(如MoS₂)、拓扑绝缘体、自旋电子器件等,以期获得更低操作电压、更快速度、更好一致性的器件,进一步压低计算的物理基础能耗。

- 从"节能"到"自供能"的智能系统:

最终愿景是开发出 "能量自治的智能边缘节点" 。结合环境能量收集技术和超低功耗类脑芯片,构建无需更换电池、无需布线的智能感知系统,长期部署于物联网、农业、环境监测等领域。

- 量化与标准化:

建立更科学的能效评估标准。不仅是看"每瓦特能完成多少次操作"(TOPS/W),更要看"完成一个特定智能任务(如识别一张图像)所需要的总能量",这才是衡量智能能效的黄金标准。

达尔文3类脑计算芯片

五、总结

类脑智能技术与系统在能耗问题上采取的是 "标本兼治" 的策略:

治标:通过近阈值计算、电源管理等技术优化传统架构的能耗。

治本:通过事件驱动的SNN、存算一体架构等类脑核心技术,从计算范式上彻底革新,根源性地消除能耗浪费。

其发展路径是从传统架构节能 -> 神经形态芯片 -> 感存算一体 -> 能量自治的智能系统。

目前,我们正处在从"神经形态芯片"向"感存算一体"迈进的关键阶段。这场能效革命不仅将使AI在云端更绿色,更将赋能无数低功耗的边缘智能应用,真正让AI无处不在(AI Everywhere)而无需担忧能耗的制约。这是类脑智能最核心的价值和最具吸引力的未来。

感存算一体化全二维光电忆阻器

【免责声明】本文主要内容均源自公开资料和信息,部分内容引用了Ai。仅作参考,不作任何依据,责任自负。