🏆 本篇文章带你了解 LLM 的应用架构演进过程------从 Prompt 到 Multi-Agent~

🙌 如文章有误,恳请评论区指正,谢谢!

💖 写作不易,「点赞」+「收藏」+「转发」 谢谢支持!

从"陪聊"到"超级员工":一文看懂 AI 是如何进化的

自从 ChatGPT 爆火以来,大家都在研究怎么把这股"聪明劲"用到实际工作中。简单来说,我们对 AI 的使用方式经历了一场从"简单对话"到"自主干活"的进化。

为了方便理解,我们可以把 AI 想象成刚入职公司的 "超级实习生" 。它的成长经历了以下几个阶段:

一、 什么是 Agent(智能体)?

在深入了解进化史之前,先搞懂什么是 Agent。

- 学术定义: Agent 是一种能自主理解、规划、决策并执行复杂任务的智能系统。

- 通俗解释: 以前的 AI 只是个 "大脑" (LLM),能陪你聊天、回答问题,但没手没脚。而 Agent 就是 "大脑 + 双手 + 工具箱" 。它不仅能动脑子,还能根据你的目标,自己去上网、查文件、写代码,把活儿干完。

二、 为什么要搞出 Agent?

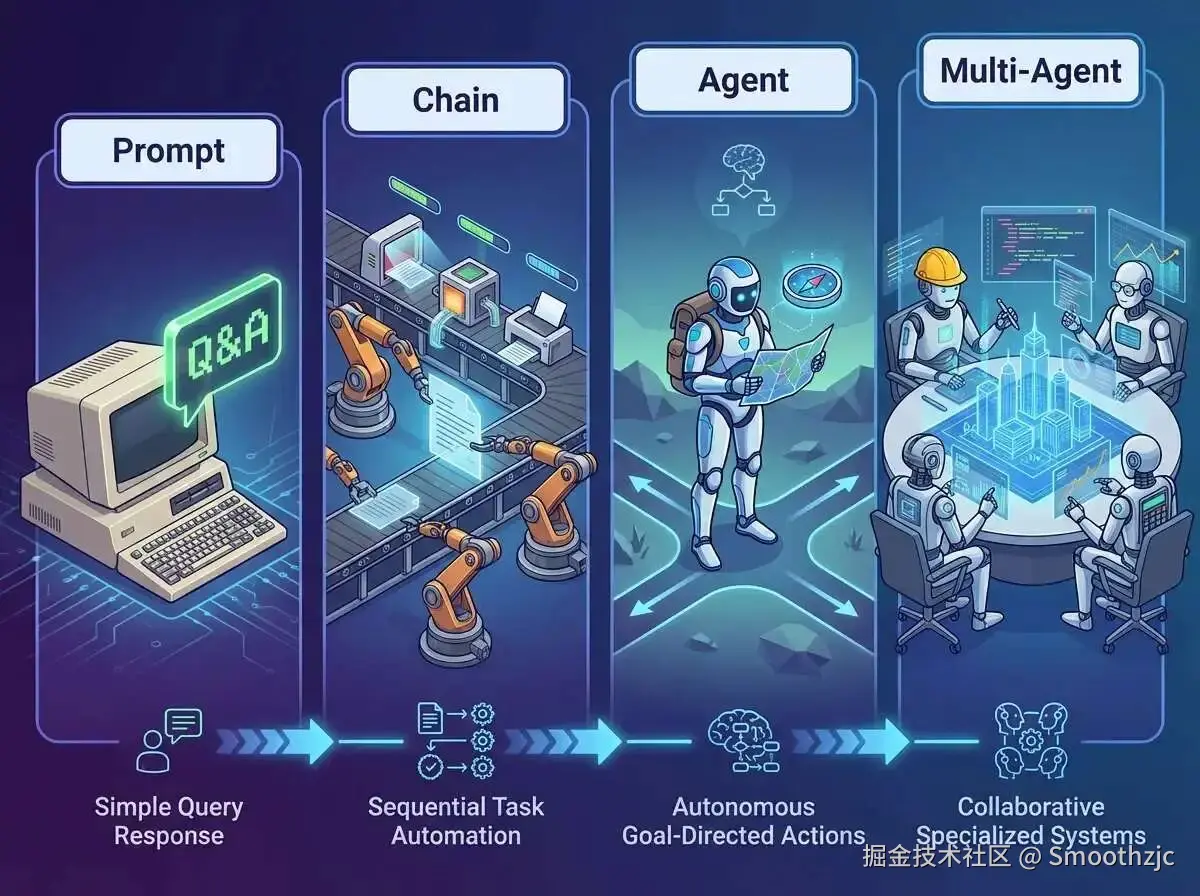

因为我们对 AI 的要求变高了。我们不满足于它只会"说话",我们希望它能"办事"。根据 AI 办事的自动化程度,我们可以把它的进化分为四个等级:

- Prompt(提示词)阶段: 你问一句,它答一句。

- Chain(工作流)阶段: 你给它画好流程图,它按部就班走流程。

- Agent(智能体)阶段: 你给个目标,它自己想办法搞定。

- Multi-Agent(多智能体)阶段: 一个 AI 搞不定,就叫上一群 AI 专家分工合作。

下面我们来详细拆解这四个阶段。

三、 进化四部曲详解

1. Prompt 阶段:也就是"对话时代"

- 场景描述: 这是大家最熟悉的阶段。你想让 AI 干活,就得在聊天框里精心设计"提示词"(Prompt)。

- 如何工作: 人类 --> 写提示词 --> AI 回答。

- 类比: 就像你带了一个很聪明但有点木讷的实习生。你必须非常精准地告诉他:"你现在是一个资深翻译,请把这句话翻译成英文。"

- 局限性: 它的能力完全取决于你有多会提问。而且它只能"动嘴",不能直接帮你把文件发给老板,也不能去操作数据库。

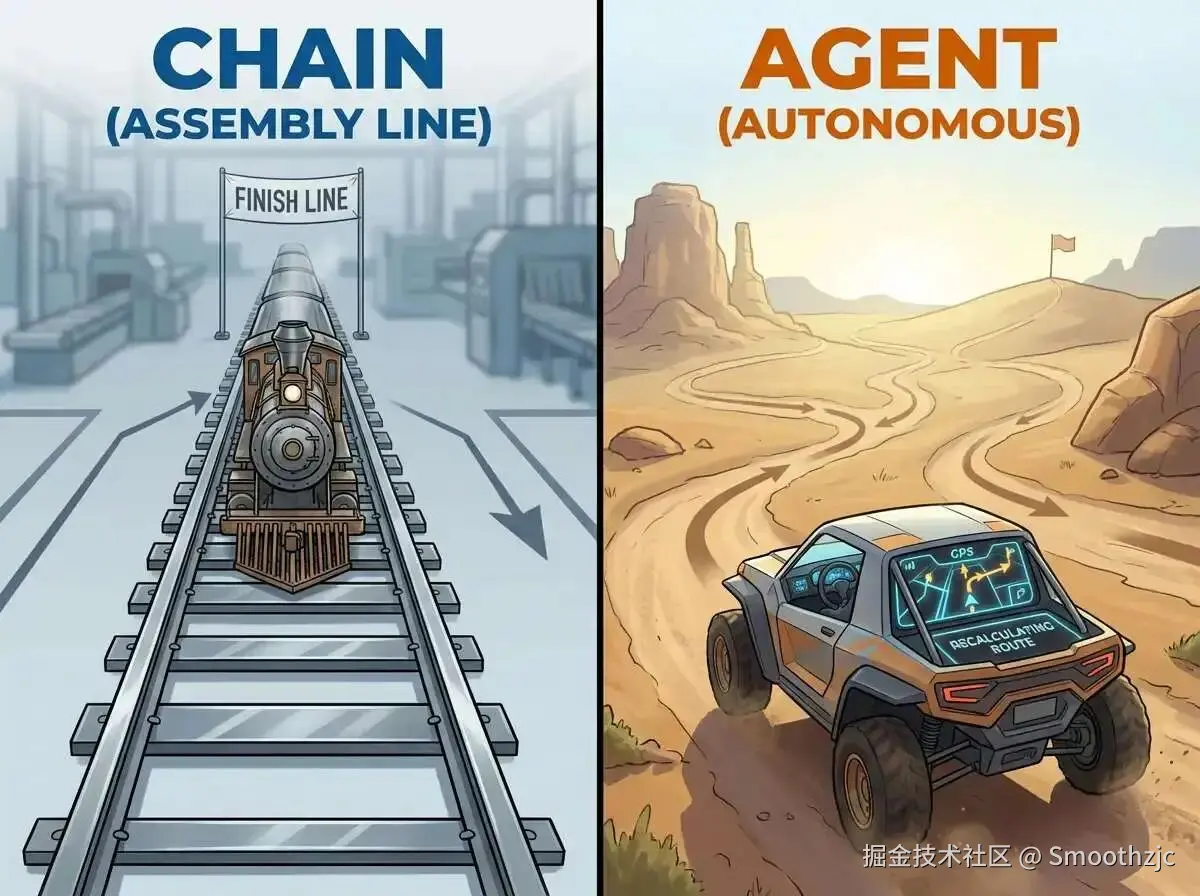

2. Chain 阶段:也就是"流水线时代"

- 场景描述: 为了让 AI 能处理复杂任务,程序员把 AI 和各种工具串联起来,形成固定的"流水线"。比如最流行的"文档问答助手"(RAG),就是先去知识库搜文档,再让 AI 总结。

- 如何工作: 人类 --> 设计固定流程图 --> AI 按步骤执行。

- 类比: 就像工厂的流水线。第一步拧螺丝,第二步刷漆,第三步打包。效率高,很稳定。

- 核心痛点: 太死板,不懂变通。

- 举个例子: 假设你要 AI 处理一堆乱码日志。你设定的流程是"先解码A,再分析"。但如果今天的日志被加密了两次(先A后B),流水线只会傻傻地执行一次解码,然后报错。它不会像人一样思考:"咦?好像还没解干净,我再解一次试试。"

- 总结: 这一阶段叫"+AI",本质上还是传统程序,只是把 AI 当个零件嵌进去了。

3. Agent 阶段:也就是"自主办事时代"

- 场景描述: 我们不再设计死板的流程,而是给 AI 一个目标,让它自己规划怎么做。

- 如何工作: 人类设定目标 --> AI 思考、拆解任务 --> AI 挑选工具执行 --> 完工。

- 类比: 这时候的实习生已经晋升为项目经理了。你跟他说:"帮我策划一次旅行。" 他会自己想:

- 先去查机票;

- 再去对比酒店价格;

- 发现预算超了,自己调整方案;

- 最后给你一份完整计划。不需要你告诉他第一步先打开哪个网站。

- 局限性: 累脑子。 让一个 AI 既负责记忆、又负责规划、还要执行,负担太重。容易出现"想多了入戏太深"或者"陷入死循环"出不来的情况。

4. Multi-Agent 阶段:也就是"团队协作时代"

- 场景描述: 既然一个 AI 干活太累容易出错,那就组建一个"AI 团队"。

- 如何工作: 让专业的 AI 干专业的事。

- 类比: 这是一个全功能的项目组。

- 产品经理 AI:负责拆解需求。

- 程序员 AI:负责写代码。

- 测试 AI:负责找 Bug。

- 大家互相检查,互相补位。

- 优势: "三个臭皮匠,顶个诸葛亮"。通过分工,AI 变得更稳定、更专业,能处理非常复杂的任务(比如开发一整个软件、模拟一家公司运营)。

四、 总结:一表看懂区别

| 阶段 | 核心特点 | 形象比喻 | 优点 | 缺点 |

|---|---|---|---|---|

| Prompt | 依靠提问技巧 | 问答机 | 简单直接,挖掘 AI 知识 | 只能对话,无法行动 |

| Chain | 固定流程编排 | 流水线 | 稳定、高效、可控 | 死板,遇到突发情况就卡壳 |

| Agent | 自主规划路径 | 独行侠 | 灵活,能解决未知问题 | 脑力负担重,容易死循环 |

| Multi-Agent | 多角色分工 | 正规军 | 专业、强大、容错率高 | 系统复杂,开发难度大 |

总而言之,AI 的发展就是从"教它说话",到"教它按规矩办事",再到"放手让它自己干",最后是"让它们组团干"。了解了这些,你就看懂了当下大模型应用的最前沿图景。

实操篇:如何打造你的第一个 AI 智能体 (Agent)

在了解了 Agent(智能体)的"进化史"后,我们接下来看看------如果想自己造一个"超级实习生",该怎么做?

这一部分,我们将揭开 Agent 的"解剖图",并用最直观的逻辑(伪代码)告诉你它背后是如何运转的。

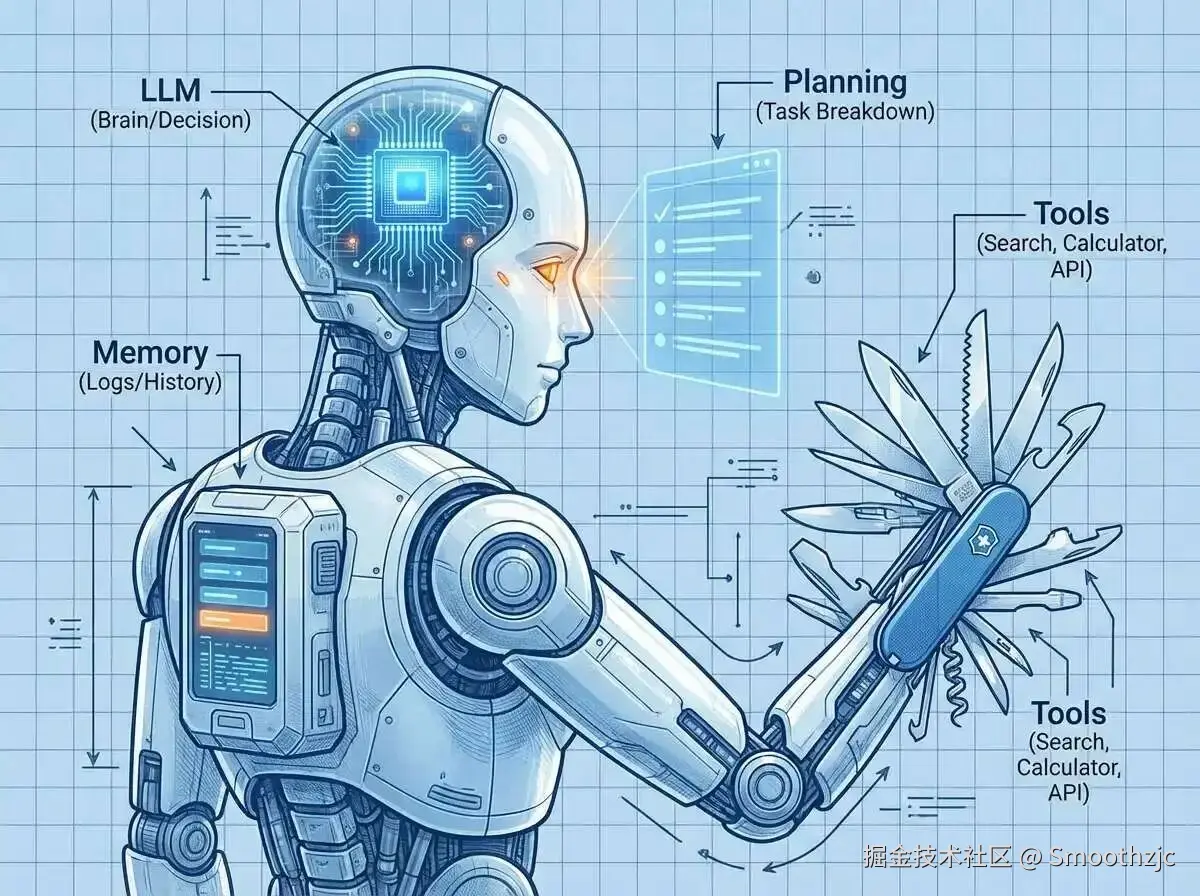

如果说 LLM(大模型)是的大脑,那么要把这个大脑变成一个能干活的 Agent,我们需要给它装备另外三个"器官"。我们可以把构建 Agent 的过程比作 "给大脑装义肢" 。

一、 Agent 的"身体构造"

一个成熟的 Agent 系统,通常由以下 4 个核心组件构成:

- 大脑 (LLM):

- 作用: 负责思考、逻辑推理和决策。它是指挥官。

- 关键点: 模型越强(如 GPT-4 等级),Agent 的规划能力就越强。

- 感官与手臂 (Tools/工具):

- 作用: 这是一个工具箱。LLM 本身无法联网,也算不清复杂的数学题。我们需要给它提供 API(接口),比如"谷歌搜索"、"计算器"、"天气查询接口"等。

- 比喻: 就像给实习生配了电脑和电话。

- 记事本 (Memory/记忆):

- 作用: 记录之前的步骤做到了哪里,以及查询到了什么结果。

- 比喻: 如果没有记忆,Agent 查完天气就会立刻忘记,无法进行下一步建议。它需要一个记事本来记录:"刚才查了北京天气,是下雨。"

- 任务清单 (Planning/规划):

- 作用: 把一个大目标拆解成小步骤(子任务)。

- 比喻: 面对"策划年会"这个大任务,它需要自动拆解为:定场地 -> 选餐食 -> 发通知。

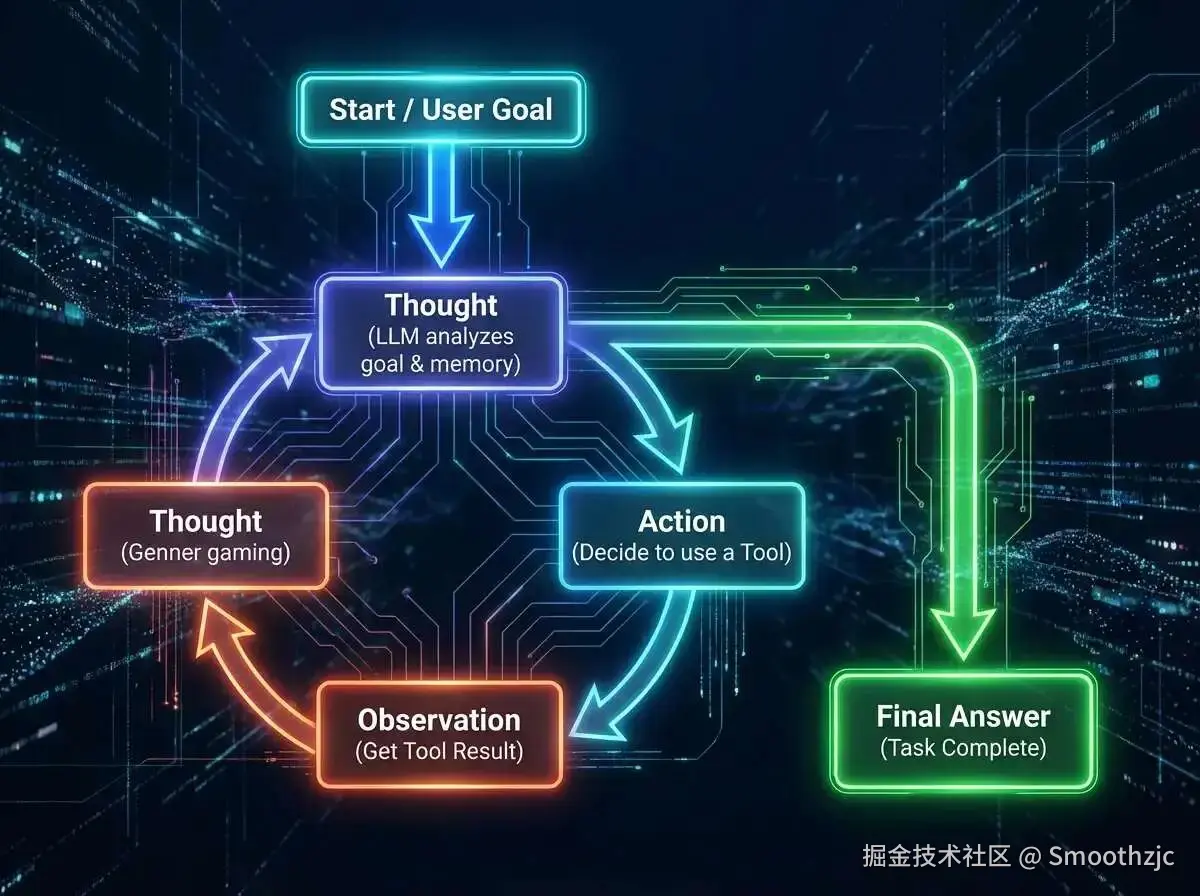

二、 Agent 是怎么思考的?(核心原理)

目前最流行的让 Agent 动起来的方法,叫 ReAct 模式 (Reasoning + Acting,即:推理 + 行动)。

它的工作流程像是一个 "自言自语"的循环。假设你问 Agent:"现在的比特币价格能买几个麦当劳巨无霸?"

Agent 的内心戏(运行日志)是这样的:

- 第一轮循环:

- 思考 (Thought): 用户问的是汇率换算问题。我需要知道两个信息:1. 比特币现价;2. 巨无霸价格。我现在都不知道,我得先查比特币。

- 行动 (Action): 调用工具

Search_Tool,搜索 "Bitcoin price USD"。 - 观察 (Observation): 搜索结果显示:95,000 美元。

- 第二轮循环:

- 思考 (Thought): 好,有了比特币价格。现在我需要查巨无霸价格。

- 行动 (Action): 调用工具

Search_Tool,搜索 "Big Mac price USD"。 - 观察 (Observation): 搜索结果显示:5.69 美元。

- 第三轮循环:

- 思考 (Thought): 两个数据都有了。我要计算 95000 除以 5.69。

- 行动 (Action): 调用工具

Calculator。 - 观察 (Observation): 结果是 16695.95。

- 最终环节:

- 思考 (Thought): 我已经有了答案。

- 最终回答 (Final Answer): 按当前汇率,一个比特币大约能买 16,695 个巨无霸。

三、 代码层面如何实现?(极简版)

你不需要精通复杂的编程,理解了下面的伪代码(逻辑代码),你就理解了 Agent 的本质。

其实,Agent 就是一个 While 循环(不断循环,直到任务完成)。

ini

# 初始化:给 Agent 一个目标和工具箱

User_Goal = "帮我查一下现在的比特币能买几个巨无霸"

Tools = [搜索工具, 计算器]

Memory = [] # 空的记事本

# 开始循环:只要还没得出最终答案,就一直跑

while (没有得到"最终答案"):

# 第一步:把 目标 + 工具箱 + 之前的记忆 打包发给 LLM

prompt = f"""

你的目标是:{User_Goal}

你可以使用的工具有:{Tools}

你之前的操作记录:{Memory}

请思考下一步该做什么?是使用工具,还是直接回答?

格式要求:

Thought: 你的思考

Action: 选用的工具

Action_Input: 工具的参数

"""

# 第二步:LLM 进行思考,返回决策

response = LLM.run(prompt)

# 第三步:判断 LLM 的决策

if "Final Answer" in response:

# 如果 LLM 说它算完了,就打印结果,结束循环

print("任务完成:", response)

break

else:

# 如果 LLM 决定要用工具(比如搜索)

tool_name = 解析(response) # 提取出它想用的工具

tool_input = 解析(response) # 提取出它想搜的词

# 第四步:真正去执行工具(这一步是程序替 AI 跑腿)

tool_result = 运行工具(tool_name, tool_input)

# 第五步:把这次的结果写进记事本,进入下一轮循环

Memory.append(f"我用了{tool_name},结果是{tool_result}")四、 总结:从"纸上谈兵"到"落地"的挑战

看到这里,你可能会觉得:"代码逻辑看起来很简单啊,为什么现在的 AI 还是经常出错?"

这就是我们在之前提到的 Agent 阶段的局限性 。虽然逻辑通顺,但在实际落地中,这套系统非常依赖 LLM 的"智商" 。

- "走火入魔": 如果 LLM 第一步规划错了(比如它决定去搜索"麦当劳股价"而不是"汉堡价格"),后面的循环就会全部跑偏。

- "死循环": 有时候 LLM 会卡在某个步骤,反复搜索同一个词,导致程序一直转圈,烧钱又不出结果。

- "工具不会用": 如果工具的说明书(API文档)写得不清楚,LLM 可能传错参数,导致报错。

所以,现在的开发者(也许就是未来的你),主要的工作不是重写那个 While 循环,而是优化 Prompt(让 AI 更懂任务)、优化工具描述(让 AI 更懂工具)、以及设计防错机制(防止 AI 陷入死循环)。

能看到这的,那么恭喜你,你已经基本跟上了 AI 时代现阶段最先进的理念和实践!

最后

我是 Smoothzjc,致力于产出更多且不仅限于 AI 方面的优质文章

写作不易,「点赞」+「收藏」+「转发」 谢谢支持💖