在机器人学与计算机视觉领域,人类仅凭一瞥和动作预判就能感知 3D 世界的物理响应,但现有技术难以在真实野生环境中实现精准的动态预测与操纵。

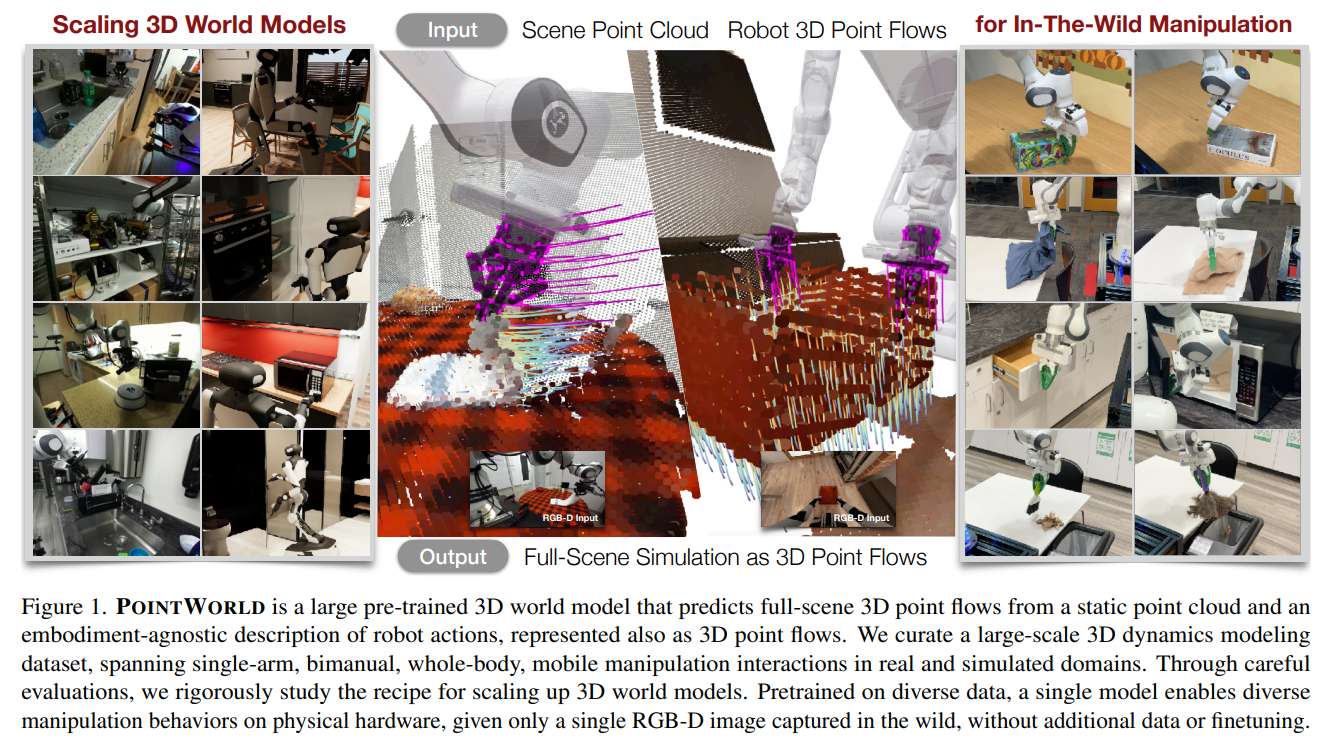

斯坦福大学与 NVIDIA 联合团队提出的 PointWorld 框架,以 "3D 点流统一表征" 为核心,通过 "大规模数据集构建 - 世界模型设计 - 实时操纵部署" 的三层技术体系,首次实现单一预训练模型在真实场景下的多类型物体操纵,为通用机器人技术提供了全新范式。

论文题目:PointWorld: Scaling 3D World Models for In-The-Wild Robotic Manipulation

核心亮点:3D 点流统一状态 - 动作表征、500 小时跨域数据集、实时 0.1s 推理、零样本真实机器人操纵

问题根源:野生环境 3D 世界建模的四大核心挑战

PointWorld 的设计逻辑源于对现有机器人世界建模痛点的精准洞察,四大核心挑战构成技术突破的起点:

- 表征割裂问题:传统模型将状态与动作采用不同模态表征,难以捕捉物理交互的几何关联性,跨机器人形态迁移困难;

- 场景适应性局限:物理基模型存在仿真到真实的鸿沟,学习基模型依赖特定领域归纳偏置,视频生成模型缺乏物理一致性;

- 数据稀缺瓶颈:野生环境下 3D 标注需精准深度、相机姿态与点追踪信息,现有数据集规模小且标注质量不足;

- 推理效率不足:复杂场景下的动态预测往往耗时过长,难以满足机器人实时操纵的低延迟需求。

方案设计:PointWorld 的三层技术闭环

针对上述挑战,PointWorld 构建了 "数据构建 - 模型设计 - 操纵部署" 的完整技术闭环,层层递进实现野生环境 3D 世界建模:

第一层:大规模数据构建 ------ 跨域高精度 3D 交互数据集

为解决数据稀缺问题,构建了覆盖真实与仿真场景的大规模 3D 动态数据集:

-

多源数据融合:整合 DROID 真实世界数据集与 BEHAVIOR-1K 仿真数据集,涵盖单臂、双足、全身等多种机器人形态,总计约 200 万条轨迹、500 小时交互数据;

-

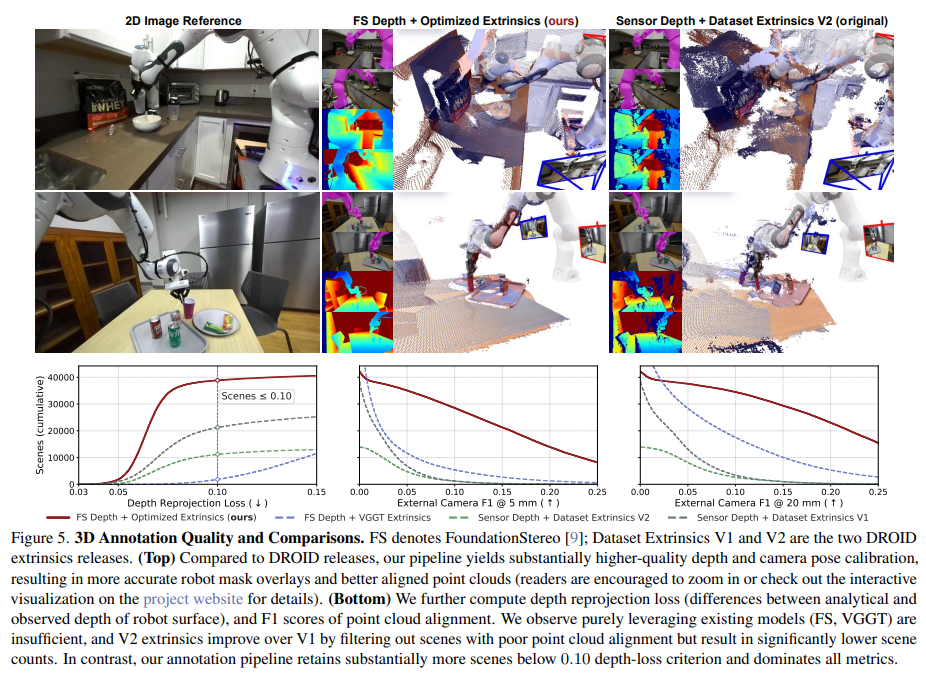

高精度 3D 标注流水线:结合 FoundationStereo 深度估计、VGGT 相机姿态优化与 CoTracker3 点追踪技术,解决野生环境下深度噪声与相机校准问题,将轨迹误差控制在 1.8cm、旋转误差 1.9 度以内;

- 场景与任务多样性:覆盖厨房、工作室等野生场景,包含刚性物体推送、可变形物体操纵、关节式物体交互与工具使用等多种任务,兼顾成功与失败轨迹以提升泛化性。

第二层:世界模型设计 ------ 3D 点流统一表征与高效推理

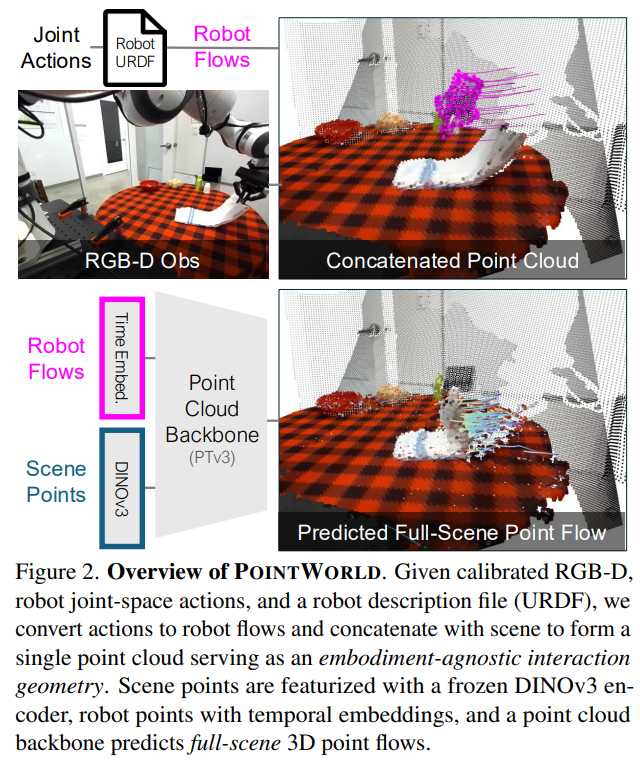

提出以 3D 点流为核心的统一表征方案,实现状态与动作的几何级关联建模:

-

统一表征设计:状态以 RGB-D 重建的全场景 3D 点云表示,动作通过机器人 URDF 模型生成 3D 点流轨迹,二者在同一 3D 空间中建模物理交互;

-

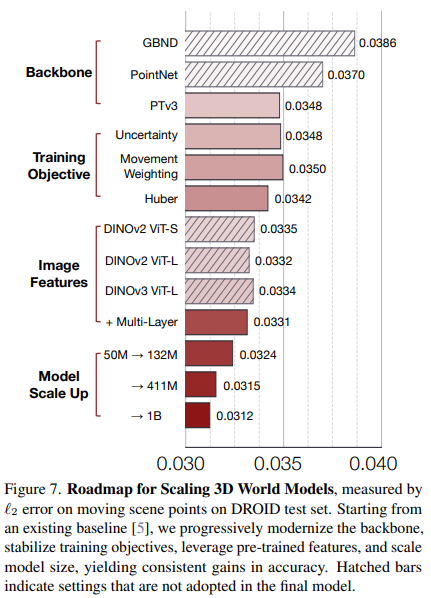

高效网络架构:采用 PointTransformerV3(PTv3)作为骨干网络,通过 U 型结构实现长距离依赖建模,支持从 50M 到 1B 参数的规模化扩展,同时保持高效推理;

-

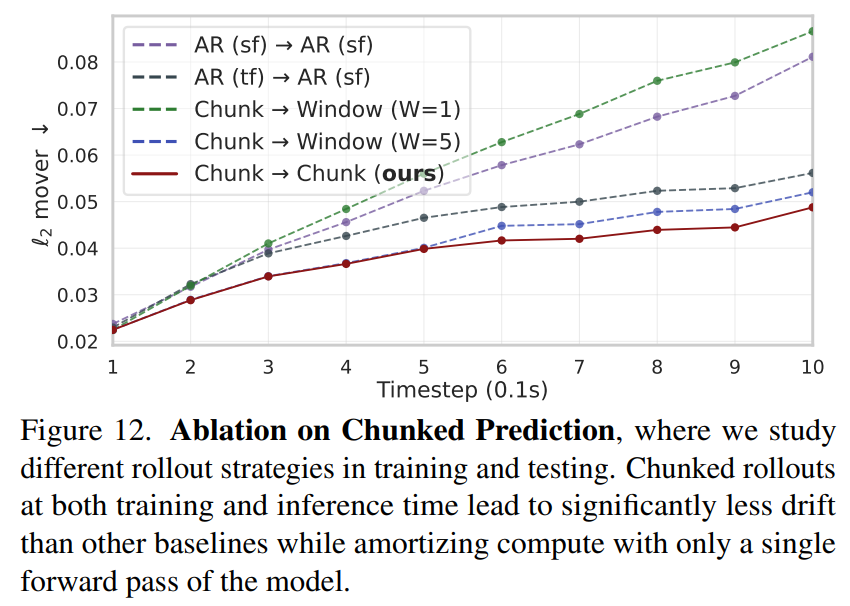

稳定训练机制:引入运动加权损失聚焦动态点学习,结合不确定性正则化与 Huber 损失提升噪声鲁棒性,采用 10 步块预测策略减少推理漂移;

-

实时推理能力:单次前向传播即可完成 10 步动态预测,推理延迟仅 0.1 秒,满足机器人模型预测控制(MPC)的实时需求。

第三层:操纵部署 ------ 零样本真实机器人动态规划

将预训练世界模型与模型预测控制结合,实现野生环境下的零样本机器人操纵:

-

MPC 集成方案:采用采样式 MPPI 控制器,通过 3D 点流预测结果构建成本函数,优化末端执行器的 6DOF 姿态序列;

-

任务适配能力:支持刚性物体推送(纸巾盒、书本)、可变形物体操纵(围巾折叠、枕头放置)、关节式物体交互(微波炉开关、抽屉推拉)与工具使用(扫帚清扫、除尘器操作)等多样化任务;

-

零样本部署特性:单一预训练模型无需额外演示或微调,仅通过单张野生环境 RGB-D 图像即可驱动真实 Franka 机器人完成操纵任务。

验证逻辑:从定量指标到真实部署的全面性能验证

PointWorld 通过 "模型性能 - 泛化能力 - 真实部署" 的三级验证体系,充分证明其技术有效性:

模型性能突破

在核心指标上显著优于传统基线模型:

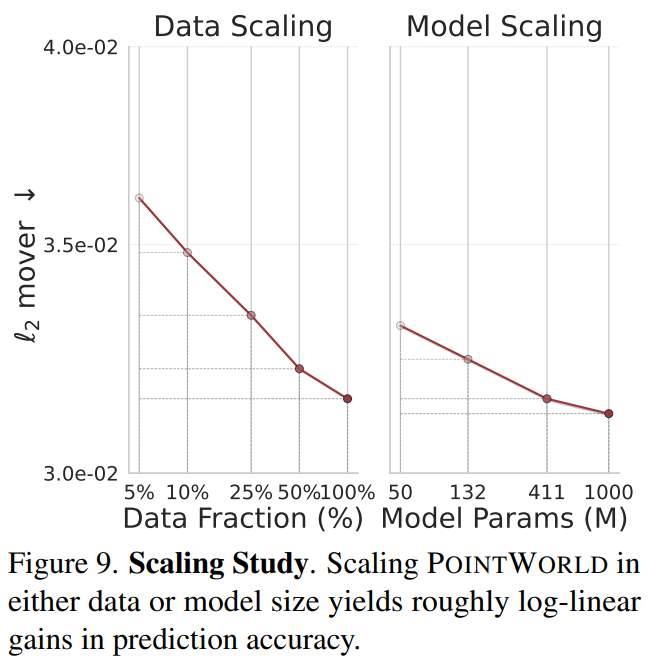

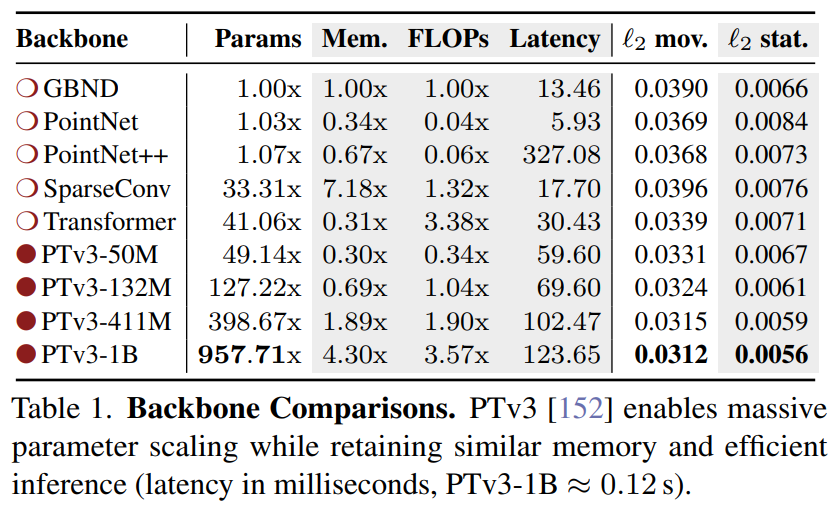

- 动态预测精度:在 DROID 测试集上,移动点的 L2 误差低至 0.0312,静态点误差 0.0056,较 GBND 等基线模型提升明显;

- 推理效率优势:1B 参数模型的推理延迟仅 0.12 秒,远低于像素级方法的秒级延迟,支持批量轨迹评估;

- 架构扩展性:PTv3 骨干网络可扩展至 957 倍于传统 GBND 模型的参数规模,同时保持内存与计算效率的平衡。

泛化能力验证

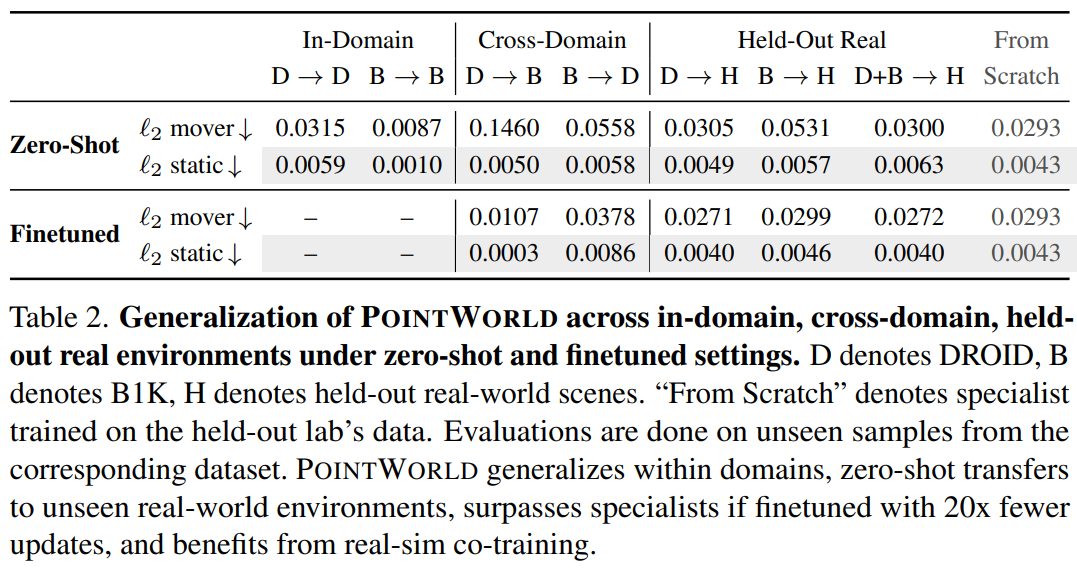

在跨域与跨形态迁移任务中表现出色:

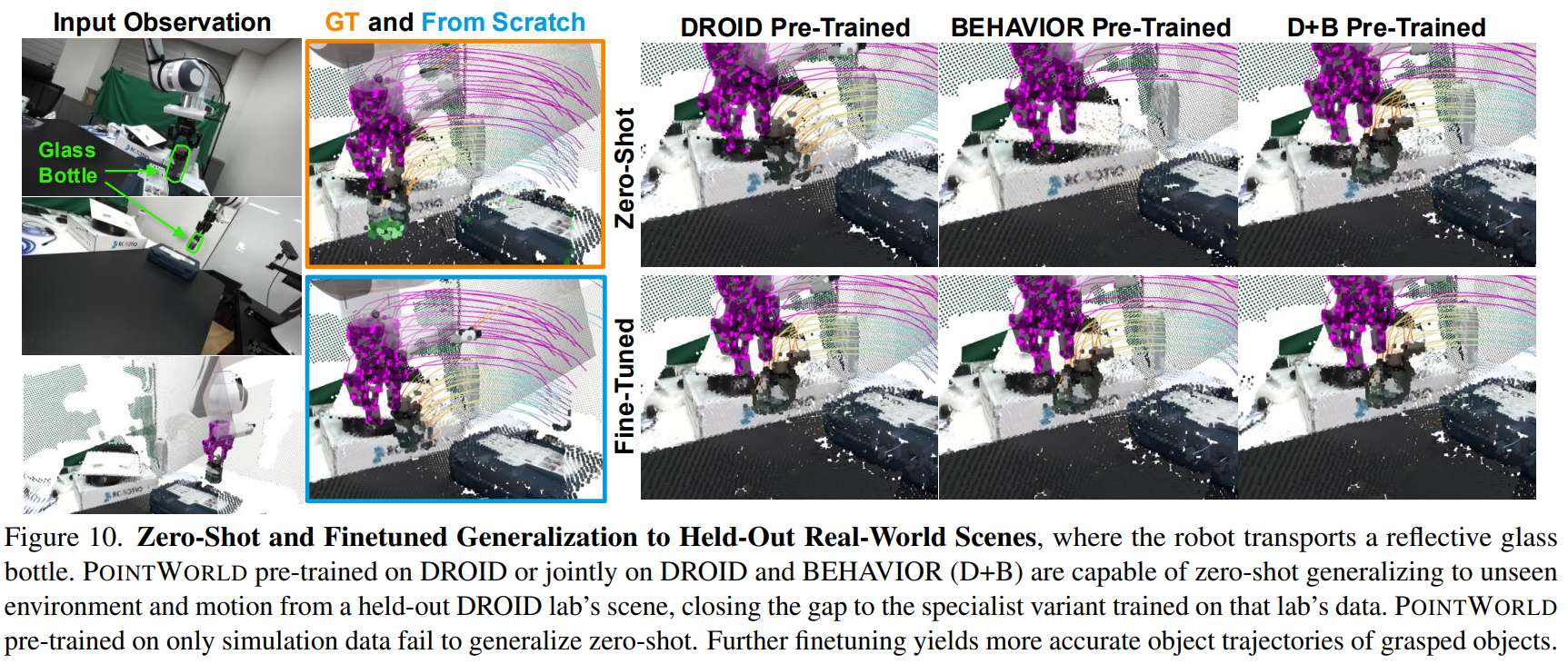

- 跨域迁移:零样本情况下实现真实到仿真、仿真到真实的双向迁移,微调仅需原始训练迭代次数的 1/20 即可达到领域专用模型性能;

- 跨场景泛化:对未见过的真实实验室场景,零样本性能与专用模型相当,微调后实现超越;

- 跨机器人形态迁移:通过 3D 点流的形态无关表征,支持从单臂 Franka 到双足人形机器人的无缝迁移。

真实部署效果

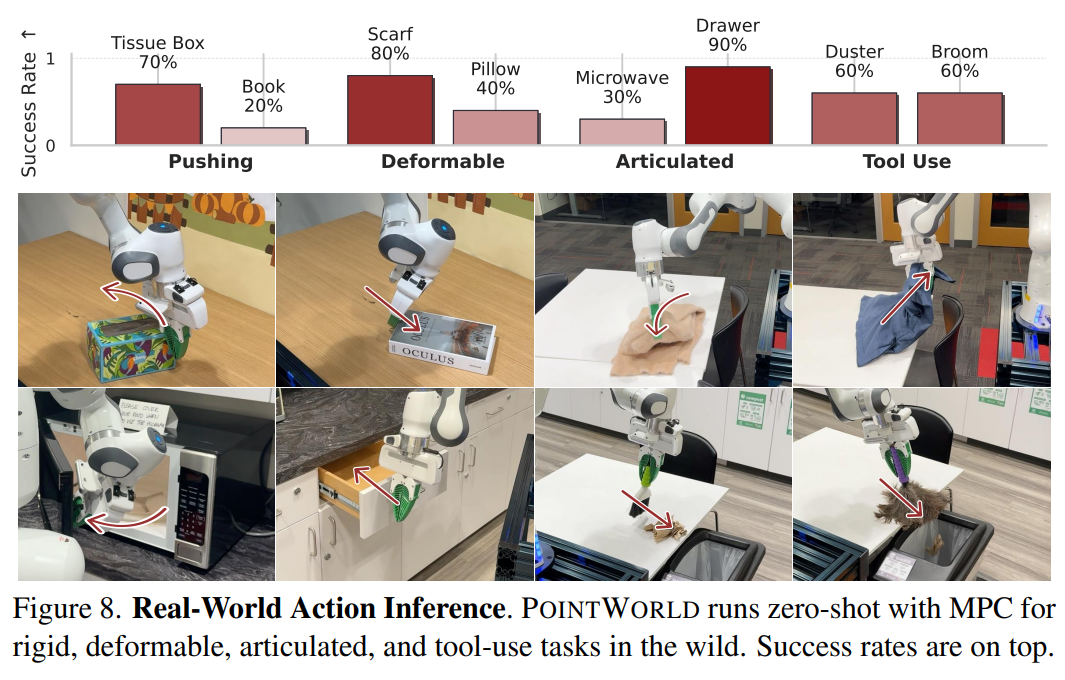

在真实机器人操纵任务中展现实用价值:

- 多样化任务成功率:抽屉关闭(90%)、围巾折叠(80%)、纸巾盒推送(70%)等任务成功率表现优异,覆盖刚性、可变形、关节式物体与工具使用场景;

- 鲁棒性表现:在部分遮挡、光照变化等野生环境条件下,仍能准确预测物体动态,实现稳定操纵。

局限与未来方向

PointWorld 作为大规模 3D 世界建模的突破性工作,仍存在可优化空间:

- 初始状态假设:当前模型假设观测时刻世界静态,需扩展至动态初始条件的建模;

- 精细交互局限:对纤细物体(如笔、线缆)的标注与预测精度有待提升,需优化深度估计与点追踪细节;

- 因果关系建模:当前模型主要捕捉相关性,未明确分离机器人动作与环境外源因素的因果影响;

- 多模态融合:未来可结合外观模型预测光度动态变化,增强对光照、屏幕等场景的适应性。

总结:PointWorld 的范式价值与行业影响

PointWorld 的核心贡献不仅在于提出 3D 点流统一表征的世界模型,更在于建立了 "大规模数据构建 - 模型设计原则 - 真实部署验证" 的完整技术链路。通过 500 小时跨域数据集、高效可扩展的网络架构与实时推理能力,首次实现单一预训练模型在野生环境下的多样化机器人操纵。其开源的数据集、模型权重与代码,为机器人学、计算机视觉等领域提供了统一研究平台,推动通用自主机器人从实验室走向真实生活场景,加速物理智能的规模化落地。

具身求职内推来啦

国内最大的具身智能全栈学习社区来啦!

推荐阅读

从零部署π0,π0.5!好用,高性价比!面向具身科研领域打造的轻量级机械臂

工业级真机教程+VLA算法实战(pi0/pi0.5/GR00T/世界模型等)

具身智能算法与落地平台来啦!国内首个面向科研及工业的全栈具身智能机械臂

VLA/VLA+触觉/VLA+RL/具身世界模型等!具身大脑+小脑算法与实战全栈路线来啦~

MuJoCo具身智能实战:从零基础到强化学习与Sim2Real

Diffusion Policy在具身智能领域是怎么应用的?为什么如此重要?