ISAT(Intelligent Segmentation Annotation Tool) 是由 北京理工大学 & IDEA 实验室 联合开发的一款开源、智能化、高效率的图像分割标注工具 ,专为语义分割、实例分割和全景分割任务设计。

✨ 核心理念:"人机协同" ------ 利用前沿 AI 模型(如 SAM)辅助人工标注,将标注效率提升 5~10 倍。

| 特性 | 说明 |

|---|---|

| ✅ AI 智能辅助 | 内置 SAM、Grounded-SAM、EfficientSAM 等模型,支持点/框交互式分割 |

| ⚡ 标注效率极高 | 点击几下即可生成精细掩码,告别手动描边 |

| 🖼️ 多模态支持 | 支持 RGB 图像、遥感图、医学影像、工业检测图等 |

| 🧩 专业级功能 | 撤销/重做、图层管理、边缘细化、批量导出 |

| 🇨🇳 中文友好 | 国产工具,中文界面 + 中文文档 + 国内社区支持 |

| 💾 离线可用 | 模型可本地部署,无需联网(适合内网/涉密环境) |

| 📤 格式灵活 | 直接输出 PNG 掩码、COCO JSON、LabelMe 兼容格式等 |

python

┌───────────────────────┐

│ 用户交互界面 │ ← Qt / PyQt5(现代化 UI)

└──────────┬────────────┘

↓

┌───────────────────────┐

│ AI 模型调度引擎 │ ← 支持 SAM / Grounded-SAM / EfficientSAM

└──────────┬────────────┘

↓

┌───────────────────────┐

│ 标注数据管理器 │ ← JSON + PNG 双存储,支持版本回溯

└──────────┬────────────┘

↓

┌───────────────────────┐

│ 导出模块 │ ← COCO / Pascal VOC / 自定义格式

└───────────────────────┘目录

1.ISAT--安装

官网源码链接:ISAT

1.1.pip安装

python

# create environment

conda create -n isat_env python=3.10

# activate environment

conda activate isat_env

pip install isat-sam

isat-sam可能需要配置pytorch环境:https://pytorch.org/get-started/locally/?spm=5176.28103460.0.0.460b7551NU4JrN

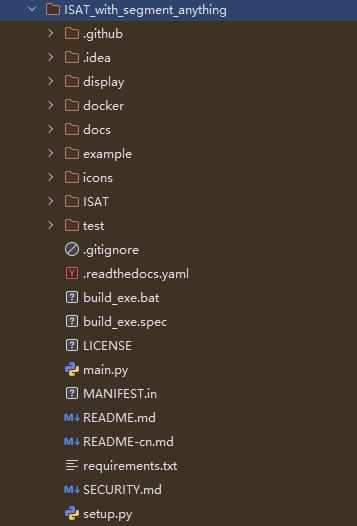

1.2.源码安装

python

# create environment

conda create -n isat_env python=3.8

# activate environment

conda activate isat_env

git clone https://github.com/yatengLG/ISAT_with_segment_anything.git

pip install -r requirements.txt -i https://pypi.mirrors.ustc.edu.cn/simple/

python main.py

2.ISAT--使用

2.1.分割模型下载

预训练模型必须提前下载好,不然等会运行后用不了segment anything功能,只能手动逐个像素点标记。

现在支持 SAM, Sam-HQ, MobileSAM, 及 EdgeSAM 等模型。

1.网址下载

| 模型分类 | 预训练模型文件 | 显存需求 | 文件大小 | 模型作用与适用场景 | 下载链接 |

|---|---|---|---|---|---|

| SAM | sam_vit_h_4b8939.pth | 6462M | 2.6G | 全能型(高精度): 最原始的 SAM 模型,精度极高,适合对边缘要求极高的科研场景。 | 官方原链 |

| sam_vit_l_0b3195.pth | 5016M | 1.3G | 平衡型: 精度和速度的平衡点,大多数通用场景的首选。 | 官方原链 | |

| sam_vit_b_01ec64.pth | 3302M | 375M | 轻量型: 速度最快,显存占用最低。适合处理简单物体。 | 官方原链 | |

| SAM-HQ | sam_hq_vit_h.pth | 6464M | 2.6G | 去噪型(推荐): 修复了原版噪点,边缘更平滑,适合精细标注。 | HuggingFace |

| sam_hq_vit_l.pth | 5016M | 1.3G | HQ 平衡版: HQ 系列的折中选择。 | HuggingFace | |

| sam_hq_vit_b.pth | 3304M | 379M | HQ 轻量版: HQ 系列中速度最快的。 | HuggingFace | |

| sam_hq_vit_tiny.pth | 598M | 43M | 极低配版: 仅用于测试或显存极小的设备。 | HuggingFace | |

| Mobile-SAM | mobile_sam.pt | 534M | 40M | 极速版: 速度极快,精度尚可,适合数据初筛。 | HuggingFace |

| Edge-SAM | edge_sam.pth | 360M | 38.8M | 边缘计算版: 适合 CPU 运行,GPU 上优势不大。 | GitHub |

| edge_sam_3x.pth | 360M | 38.8M | Edge-SAM 放大版: 解码器放大了 3 倍。 | GitHub | |

| SAM-Med | sam-med2d_b.pth | 1500M | 2.4G | 医学专用: 专为医学影像(CT/MRI)训练。 | 官方原链 |

| SAM2 | sam2_hiera_large.pt | 4000M | 900M | 视频流版: 支持视频分割,解决 sam_video_tag 报错。 |

HuggingFace |

| sam2_hiera_base_plus.pt | 4000M | 324M | SAM2 标准版: 基础视频/图像模型。 | HuggingFace | |

| sam2_hiera_small.pt | 3000M | 185M | SAM2 轻量版: 适合快速视频处理。 | HuggingFace | |

| sam2_hiera_tiny.pt | 2400M | 156M | SAM2 极速版: 视频处理首选,速度快。 | HuggingFace | |

| SAM3 | sam3.pt | 待定 | 待定 | 下一代(假设): 用于测试新架构兼容性或未来升级占位。 | [假设链接] https://huggingface.co/your_repo/sam3/resolve/main/sam3.pt |

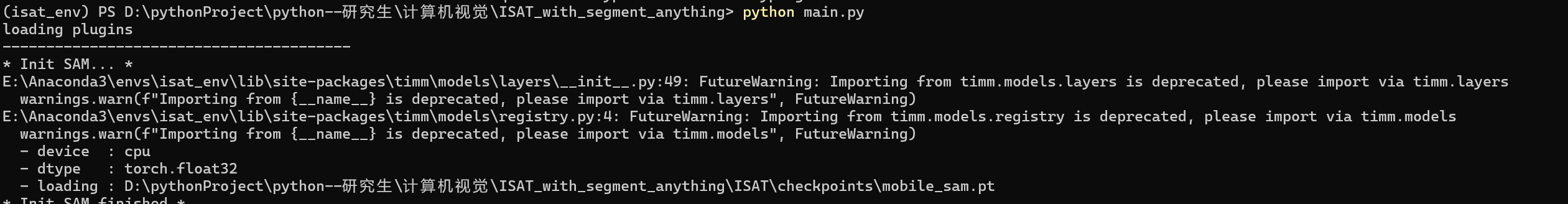

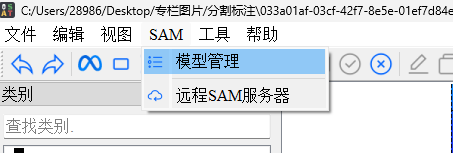

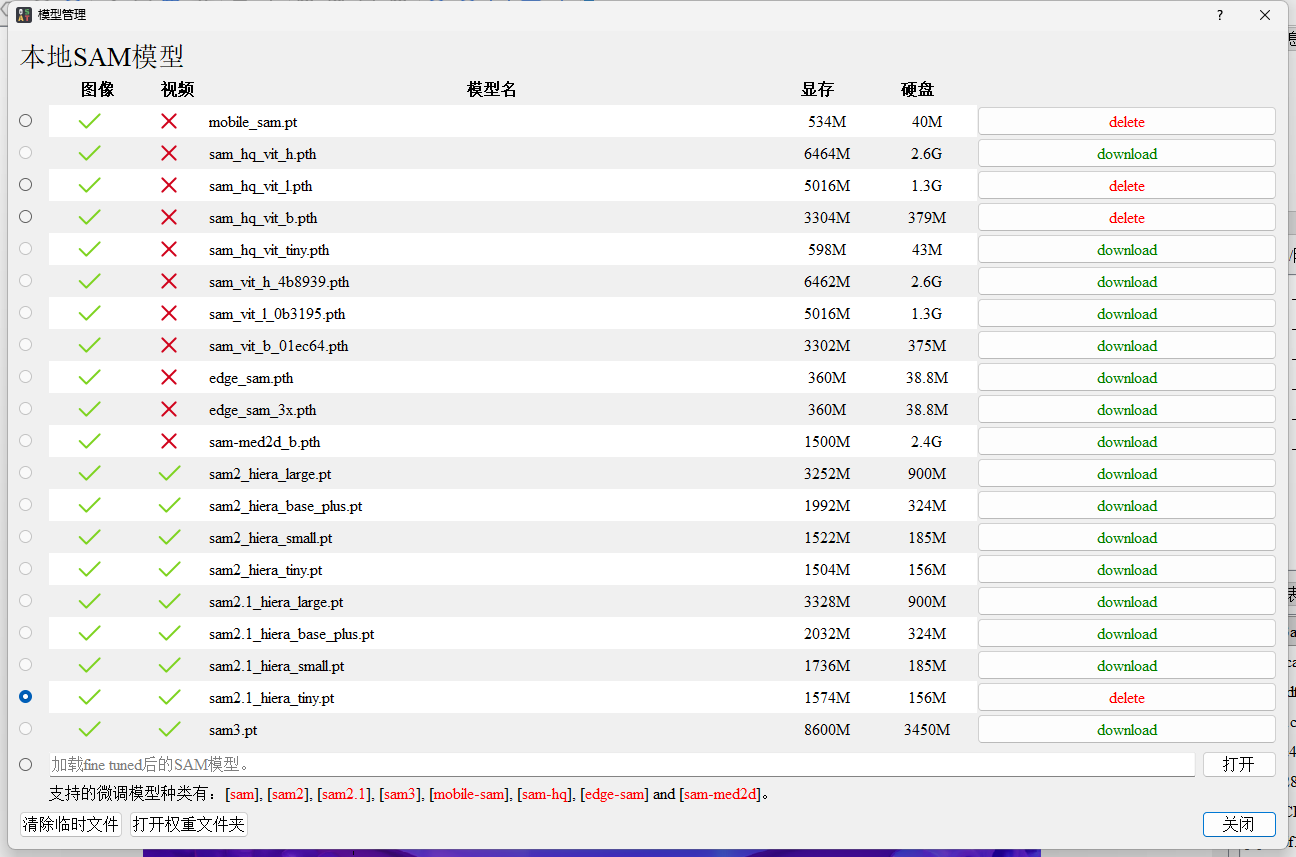

2.界面下载

下载完成之后,使用那个模型就点那个,然后终端会显示是否加载成功:

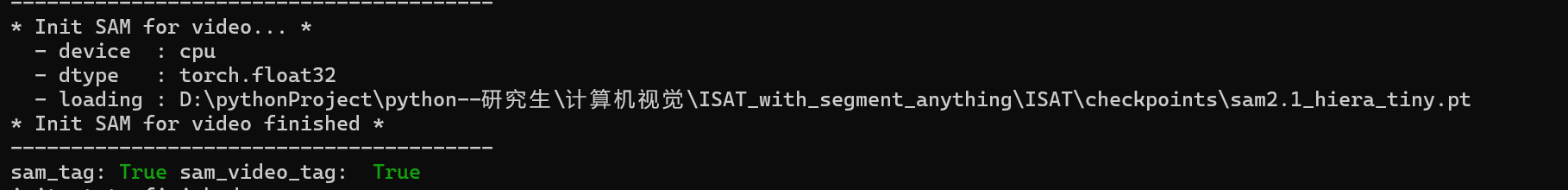

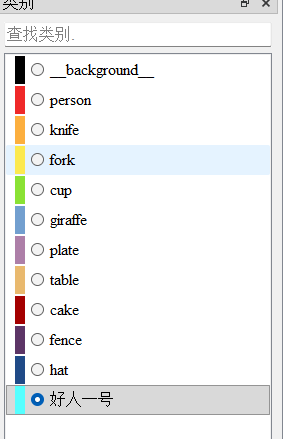

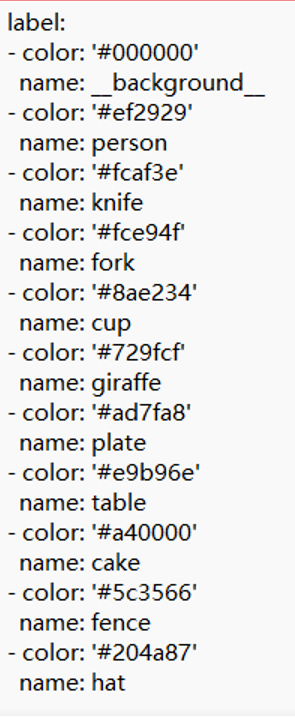

2.2.添加分类

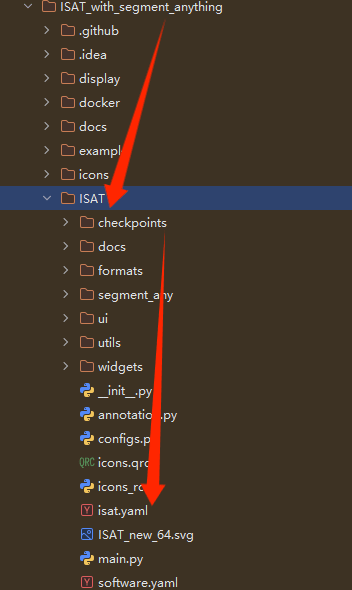

还可以导入提前准备好的类名,类名信息存放在.yaml文件中,yaml文件中存放内容及格式见下:

默认保存位置:

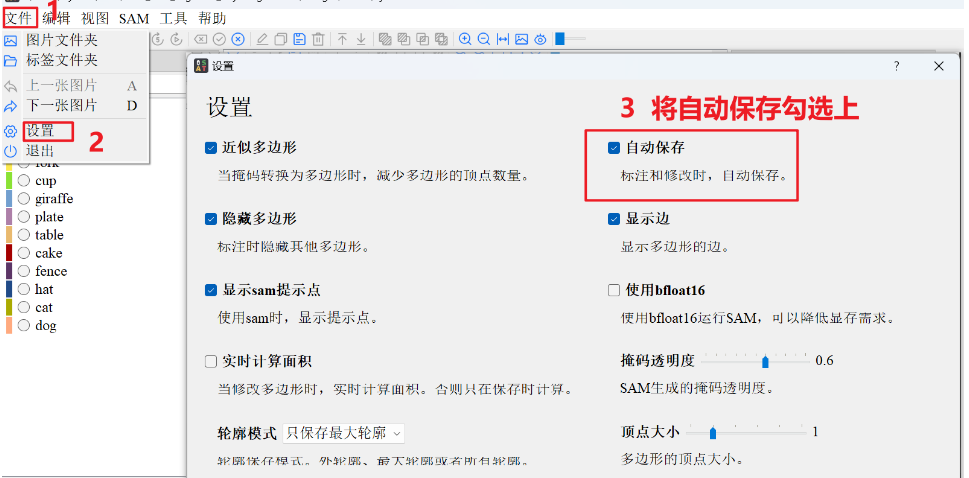

2.3.自动保存

建议开启自动保存,避免打标签过程出现意外中断无法保存,开启方法如下:

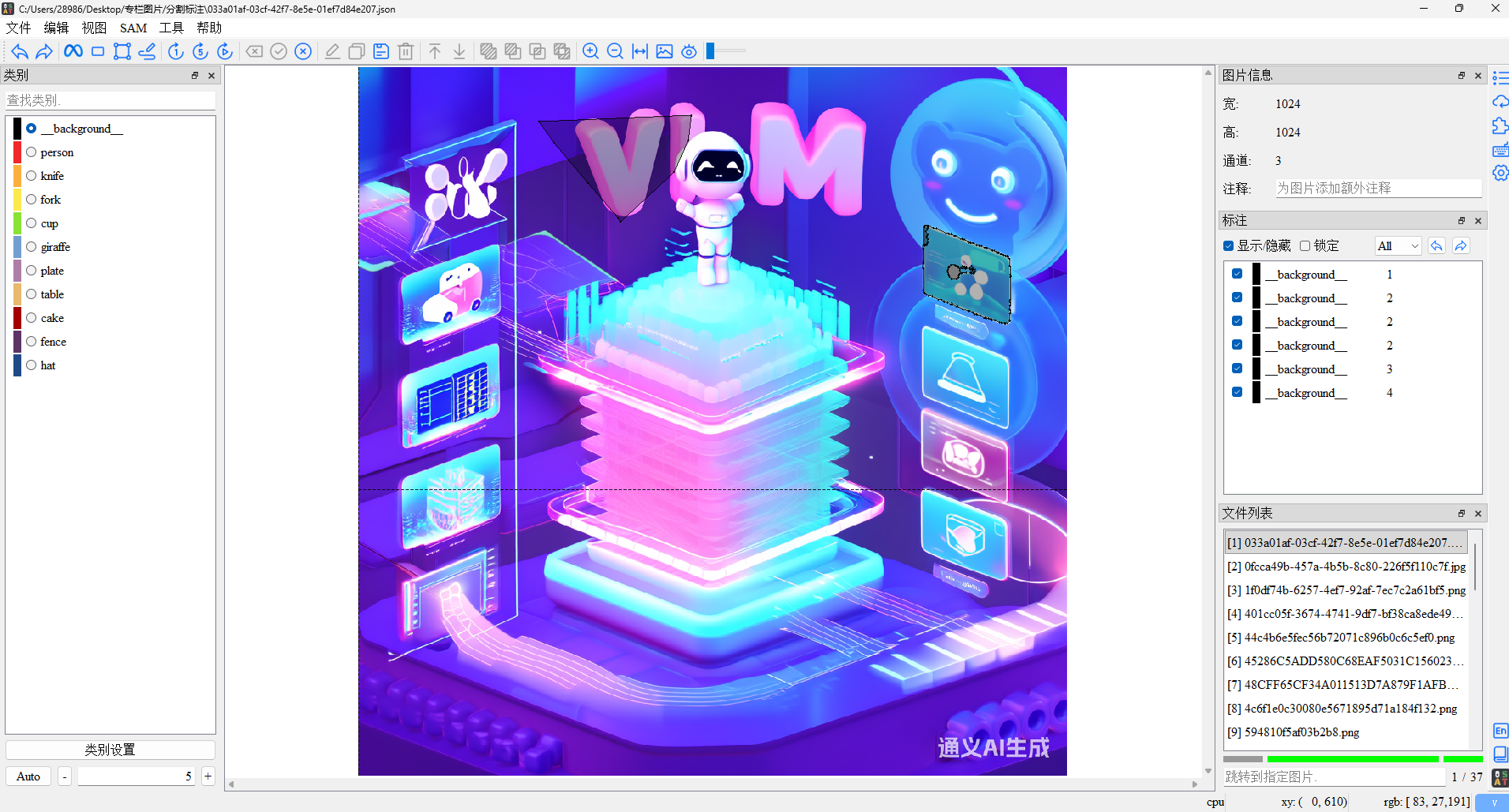

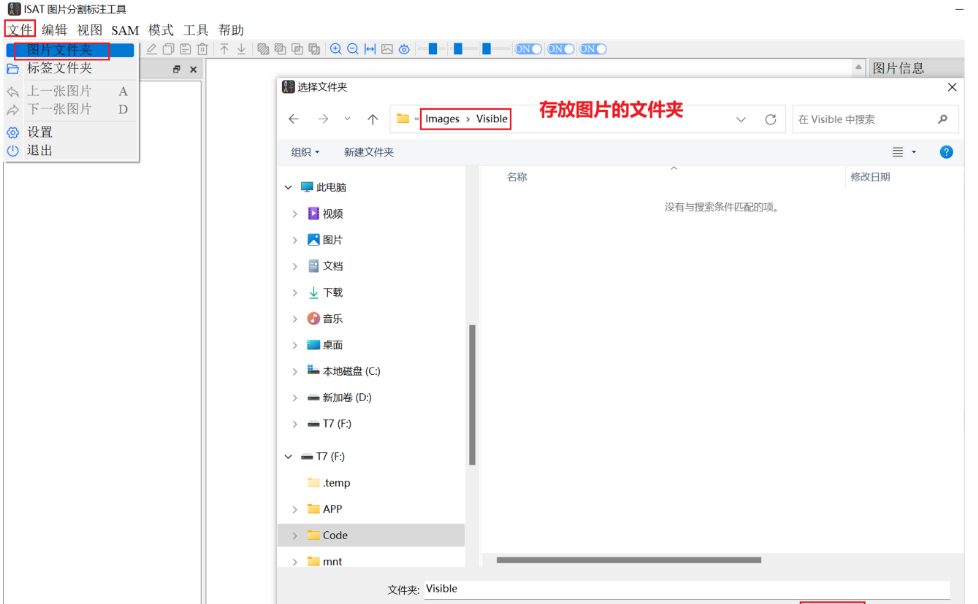

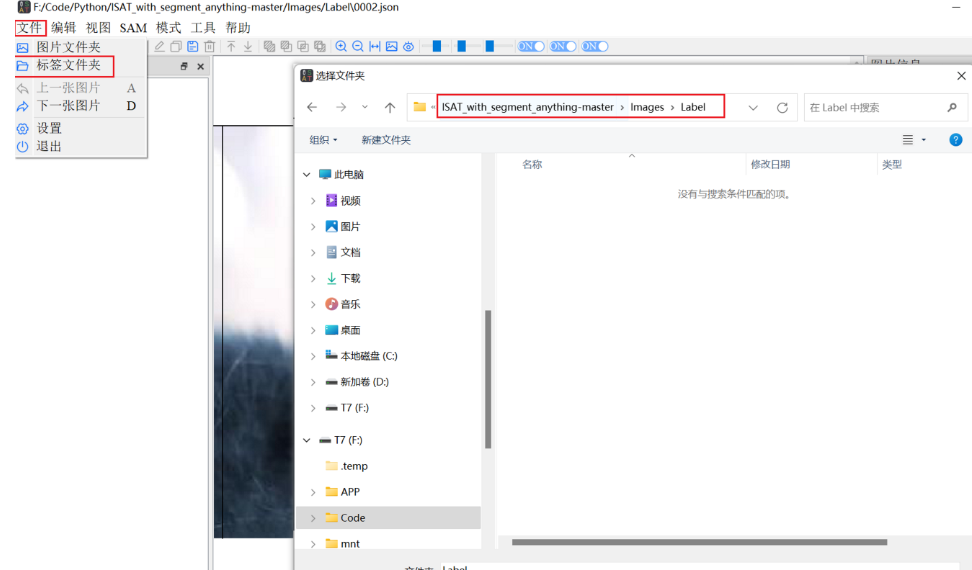

2.4.加载图片

载入图像文件

注:待标记的图像必须是三通道图,灰度图像会报错,是因为SAM中的官网模型都是针对三通道图像训练得到的模型,如果非得标记灰度图,可以先通过cv2.COLOR_GRAY2BGR转换一下再标记,标记完成后,如果深度学习训练想喂入单通道图,再用原来的灰度图。

标签保存位置:

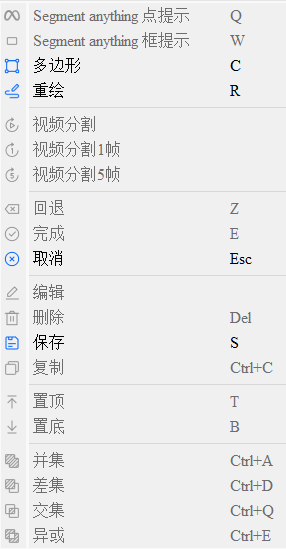

2.5.开始标记

这里的键只是默认单字母:

1.Q:sam点提示:

2.W: sam框提示:

3.C:多边形,

输出的默认是json数据:

python

{

"info": {

"description": "ISAT",

"folder": "C:/Users/28986/Desktop/专栏图片",

"name": "033a01af-03cf-42f7-8e5e-01ef7d84e207.png",

"width": 1024,

"height": 1024,

"depth": 3,

"note": ""

},

"objects": [

{

"category": "好人一号",

"group": 1,

"segmentation": [

[

574.0,

55.0

],

[

569.0,

63.0

],

[

569.0,

67.0

],

[

568.0,

68.0

],

[

568.0,

96.0

],

[

567.0,

97.0

],

[

567.0,

124.0

],

[

568.0,

125.0

],

[

568.0,

132.0

],

[

570.0,

139.0

],

[

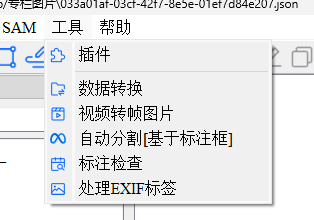

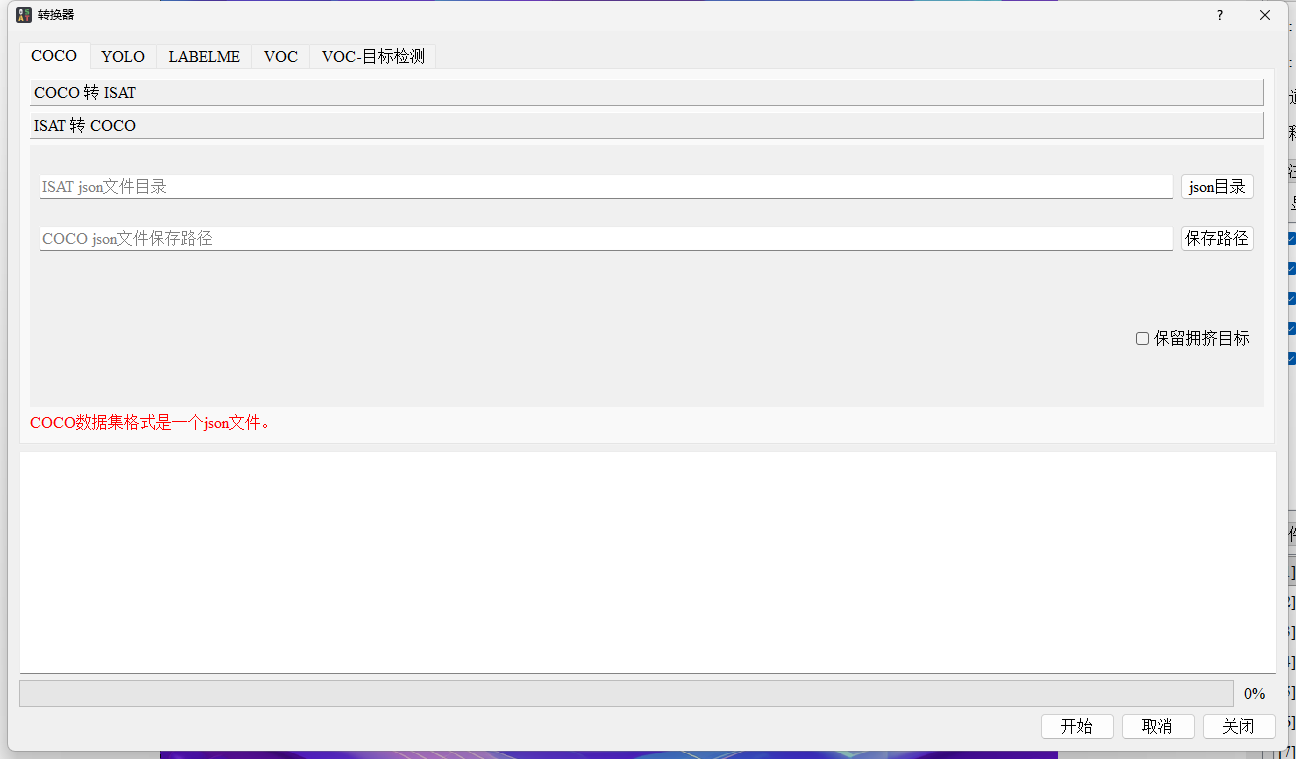

570.0,2.6.数据转换

例如:下面选择.json文件路径,和选择转为VOC格式后要保存的路径,如下: