导语|事件相机高速机器人研究的真实实验验证

2025 年,湖南大学周易教授团队 作为通讯作者,在机器人顶级期刊 IEEE Transactions on Robotics(TRO) 上发表两篇论文,统研究了事件相机在高速状态估计与 SLAM 场景中的应用 。

两项研究均在真实高速机器人实验中进行验证,并引入 NOKOV 度量动作捕捉系统提供高精度轨迹真值,为事件相机算法的精度与实时性评估提供了可靠实验基准。

一、 论文一 : 事件相机高速状态估计方法

Event-Based Visual-Inertial State Estimation for High-Speed Maneuvers

1. 方法概述|事件相机高速线速度估计

该论文提出了一种基于事件相机(Event Camera)与惯性测量单元(IMU)的高速运动状态估计方法 ,首次实现了仅依赖事件流与惯性数据的实时线速度估计 。

研究团队通过融合立体事件相机的稀疏法向流与 IMU 数据,并引入连续时间 B 样条模型,直接估计瞬时线速度,避免了传统特征匹配与环境结构依赖。

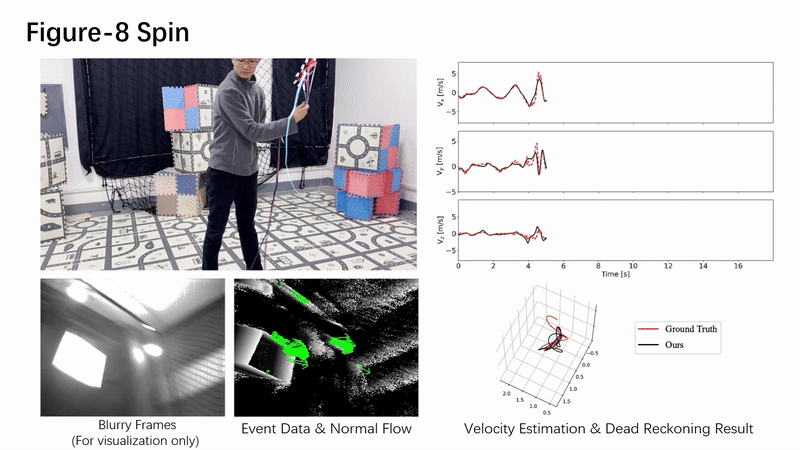

2. 实验验证|真实高速运动场景

该方法在无人机急转、绳索高速旋转等真实高速运动场景中进行了验证。实验结果表明,相较于现有技术,该方法的速度估计误差降低 50% 以上,并满足实时计算需求。

动作捕捉系统为本文提供事件相机轨迹真值,助力验证本文方法

动作捕捉系统为本文提供事件相机轨迹真值,助力验证本文方法

3. NOKOV 度量动作捕捉的作用|高速轨迹真值获取

在上述高速运动实验中,NOKOV 度量动作捕捉系统为事件相机提供高精度运动轨迹真值 ,用于评估事件相机速度估计结果的准确性与稳定性。

动作捕捉系统作为独立于视觉与惯性算法的外部测量基准,确保了实验结论的客观性与可复现性。

二、 论文二 : 事件相机 SLAM 与视觉惯性里程计

ESVO2: Direct Visual-Inertial Odometry With Stereo Event Cameras

1. 方法概述|双目事件相机视觉惯性里程计

在前期研究基础上,周易教授团队提出了 ESVO2 系统 ,一种基于双目事件相机的直接视觉惯性里程计方法 。

该方法通过优化边缘点采样策略,并融合前后帧与左右目深度信息,显著提升了 3D 建图完整性与位姿估计精度。

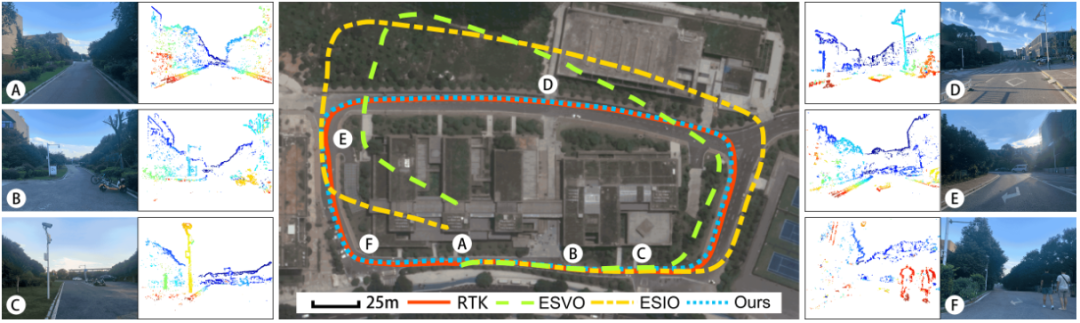

2. 实验验证|大尺度真实场景定位

湖南大学校园内的定位实验结果展示

湖南大学校园内的定位实验结果展示

研究团队在湖南大学校园等真实室外环境中进行了大尺度定位实验。实验结果显示,该系统在定位精度与实时性方面均优于主流算法。

3. NOKOV 度量动作捕捉的作用|位姿估计精度评估

在室内与受控实验场景中,NOKOV 度量动作捕捉系统为 ESVO2 提供精确位姿轨迹真值 ,用于验证事件相机 SLAM 系统在俯仰、偏航及速度估计方面的精度表现。该动作捕捉数据为算法评估提供了统一、可量化的对比标准。

三、NOKOV 度量动作捕捉在两篇论文中的作用

|-------------|--------------|----------------------------------|

| 论文 | 实验对象 | 动捕 系统 作用 |

| 事件相机 高速状态估计 | 无人机/高速运动体 | 提供线速度与高精度轨迹真值 |

| 事件相机 SLAM | 双目事件相机系统 | 提供高精度位姿 与路径真值 |

四、事件相机 高速机器人状态估计与 SLAM 研究 FAQ

Q 1 :事件相机算法如何进行精度验证?

A 1 :在事件相机的高速运动研究中,常通过高精度动作捕捉系统提供轨迹真值 ,对事件相机与 IMU 融合算法的速度与位姿估计结果进行定量对比。

在本文研究中,NOKOV 度量动作捕捉系统为高速无人机和机器人实验提供了精确运动轨迹真值,用于验证事件相机状态估计方法在真实高速场景下的准确性与稳定性。

Q 2 :为什么高速事件相机实验需要动作捕捉?

A 2 :由于事件相机主要面向高速、强动态运动场景 ,传统视觉或里程计方法难以提供可靠真值。

因此,研究中引入NOKOV 度量动作捕捉系统作为独立于视觉与惯性的外部测量基准,为事件相机算法提供高精度轨迹与位姿真值,确保实验评估结果具备客观性和可复现性。

Q 3 :事件相机是否适合用于高速无人机状态估计?

A 3 : 是的。事件相机具有高时间分辨率、低延迟和抗运动模糊 等优势,特别适合高速无人机与高速机器人场景。

在本研究中,事件相机与 IMU 融合实现了高速无人机线速度与位姿的实时估计,并通过 NOKOV 度量动作捕捉系统提供的真实轨迹真值 验证了算法在高速机动条件下的高精度表现。

Q 4 :事件相机 SLAM 或视觉惯性里程计的位姿真值通常如何获取?

A 4 : 在受控实验环境中,事件相机 SLAM 的位姿真值通常由高精度光学动作捕捉系统 获取。

相关 IEEE TRO 研究中,NOKOV 度量动作捕捉系统为事件相机 SLAM 提供完整三维位姿轨迹真值,用于评估双目事件相机视觉惯性里程计在定位精度与实时性方面的性能。

Q 5 :事件相机与 IMU 融合算法的效果如何进行客观评估?

A 5 : 事件相机与 IMU 融合算法通常通过与动作捕捉系统输出的真实运动轨迹进行对比 来评估其线速度、姿态和位姿估计精度 。

在本研究高速运动实验中,NOKOV 度量动作捕捉系统为事件相机视觉惯性算法提供高精度参考轨迹,用于量化算法在不同运动模式下的误差表现。

五、参考文献及 通讯作者 简介

引用格式

-

X. Lu, Y. Zhou, J. Mai, K. Dai, Y. Xu and S. Shen, "Event-Based Visual-Inertial State Estimation for High-Speed Maneuvers," in IEEE Transactions on Robotics, vol. 41, pp. 4439-4458, 2025, doi: 10.1109/TRO.2025.3584544.

-

J. Niu, S. Zhong, X. Lu, S. Shen, G. Gallego and Y. Zhou, "ESVO2: Direct Visual-Inertial Odometry With Stereo Event Cameras," in IEEE Transactions on Robotics, vol. 41, pp. 2164-2183, 2025, doi: 10.1109/TRO.2025.3548523.

作者简介

周易,湖南大学机器人学院教授、博士生导师,湖南大学NAIL实验室主任。主要从事基于先进视觉传感器的机器人感知与导航技术研究,包括高速自主机器人技术、视觉里程计(VO/SLAM)、动态视觉传感器 (Event-based Vision),多视角几何理论等。主要科研成果发表在IEEE T-RO,RSS,ECCV等机器人与计算机视觉的权威刊物,目前担任IEEE RA-L副主编。