前言

本文聚焦智能体演进框架 ------Agentic Context Engineering(ACE)展开系统性研究,通过对上下文工程技术的优势与现存缺陷进行深度剖析,结合 ACE 框架的核心设计原理、模块化运行机制及实验性能表现等关键维度,全面梳理该框架的技术创新点与实践价值,为大语言模型上下文优化及智能体系统自演进构建提供理论参考与实践借鉴。

上下文工程方案的优势

基于大型语言模型(LLM)的现代 AI 应用(如 LLM 智能体、复合 AI 系统)正日益依赖上下文工程,其核心是在模型训练后,通过向输入中融入清晰指令、结构化推理步骤或领域专用输入格式优化性能,而非修改模型权重。

上下文是诸多 AI 系统组件的基础,可支撑系统提示词(引导下游任务)、记忆模块(承载过往事实与经验)、事实依据(减少幻觉、补充知识)等核心功能。

相较于权重修改,上下文适配具备多重关键优势:

-

对用户和开发者而言可解释、易理解;

-

能在运行时快速整合新知识;

-

可在复合系统的不同模型或模块间共享。

-

加之长上下文 LLM 的发展及 KV 缓存复用等上下文高效推理技术的进步,上下文适配已逐渐成为构建高性能、可扩展、具备自改进能力 AI 系统的核心范式。

上下文工程方案的缺陷

尽管上下文适配技术已取得发展,但现有方法仍存在两大核心局限:

1. 简洁偏置问题:多数提示词优化方法优先追求指令的简洁性与普适性,而非知识的全面积累。这类抽象化处理往往会忽略领域专属启发策略、工具使用规范及常见失效场景等实践关键信息,难以满足智能体及知识密集型应用对细化策略的需求。

2. 上下文崩溃问题:依赖大语言模型进行整体改写的方法,会随着迭代次数增加,逐渐演变为更简短、信息量更低的摘要,最终导致系统性能大幅下降。而在交互式智能体、领域专用编程、金融与法律分析等场景中,高性能的实现恰恰需要保留详细的任务专属知识,而非对其进行压缩简化。

ACE框架的核心设计

随着智能体、知识密集型推理等应用对可靠性的需求提升,加之长上下文大语言模型的技术突破,近期研究已转向为上下文注入丰富且潜在有用的信息。研究提出,上下文不应仅作为简洁摘要,而应是兼具全面性与演进性的 "操作手册",承载详尽的领域洞察 ------ 与人类受益于简洁概括不同,大语言模型在长文本、细节丰富的上下文加持下更高效,能自主提炼关键信息,因此上下文需保留领域专属启发策略与方法,而非压缩舍弃。

为解决现有上下文适配的局限,斯坦福大学、SambaNova Systems 与加州大学伯克利分校联合研究提出了ACE(智能体上下文工程)框架 ,可同时适配离线场景(如系统提示词优化)与在线场景(如测试时记忆适配)。该框架以 "动态备忘单" 的智能体架构为基础,摒弃上下文压缩提炼的思路,将其视为可逐步积累、组织策略的演进式操作手册,通过 "生成、反思、整理" 的模块化流程,结合 "扩充 - 优化" 原则下的结构化增量更新,实现领域细节知识的留存、上下文崩溃的规避,最终构建兼具全面性与可扩展性的适配上下文。

ACE 架构的三项创新

为解决现有上下文适配方法存在的简洁偏置 与上下文崩溃两大核心痛点,ACE 框架提出了三项关键创新,具体内容如下:

-

**独立的反思器(Reflector)模块:**将「评估反馈」与「策略提炼」功能从上下文整理流程中分离,专门负责对生成器输出的推理轨迹和结果进行量化评估,并提炼可复用的领域策略、失败经验等关键洞察。该设计避免了整理环节的功能混杂,有效提升了上下文内容质量,进而推动下游任务性能的优化。

-

增量式差异更新(Incremental Delta Updates): 摒弃传统方法中高成本的整体重写模式,采用局部化的增量编辑方式更新上下文。仅对操作手册中需要优化的部分进行针对性修改,而非重构整个上下文内容,大幅降低了适配过程中的延迟与算力消耗。

-

**扩充 - 优化平衡机制(Grow-and-Refine Mechanism):**在持续扩充上下文领域知识、策略储备的同时,兼顾冗余信息的管控。通过动态平衡「知识增长」与「内容精简」,既保证了上下文对领域细节的完整覆盖,又避免了冗余信息堆积导致的效率下降,从根本上防止上下文崩溃问题。

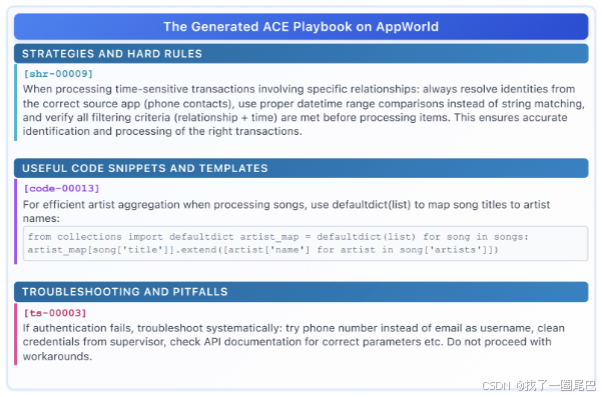

"操作手册"Playbook

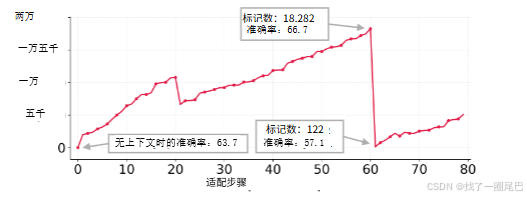

AppWorld基准测试中ACE生成的上下文示例(部分展示)。

ACE生成的上下文包含详细的、特定领域的见解,以及易于使用的工具和代码,可作为大型语言模型应用程序的综合手册。

Playbook 是 ACE 框架的核心数据载体,并非静态指令或简洁摘要,而是动态演进、结构化的知识集合,核心作用是积累、组织和优化领域策略、工具使用规则、常见错误解决方案等关键信息,支撑大模型自主决策与自我改进。

核心特征

-

动态演进性:通过 "生成 - 反思 - 整理" 的闭环流程持续更新,随任务推进不断补充新策略、修正错误经验,无需人工干预。

-

结构化组织:内容按功能模块分类存储,典型包含三大核心板块:

-

策略与硬规则(Strategies and Hard Rules):领域专属推理逻辑、必须遵循的操作规范(如身份识别需调用指定应用);

-

实用代码片段与模板(Useful Code Snippets and Templates):可复用的编程逻辑(如数据聚合、API 调用模板);

-

故障排除与常见陷阱(Troubleshooting and Pitfalls):典型错误场景及解决方案(如认证失败的排查步骤)。

-

-

轻量化存储:以 "结构化条目(bullet)" 为基本单位,每条目包含唯一标识、使用反馈计数器(标记有用 / 有害)及核心内容,支持细粒度检索与增量更新。

核心价值

-

解决 "简洁偏置":完整保留领域细节与实操经验,避免抽象化导致的关键信息丢失;

-

防止 "上下文崩溃":通过结构化增量更新替代整体重写,确保历史知识不被覆盖;

-

支撑跨任务复用:积累的策略可在同类任务或不同场景中迁移使用,提升模型适配效率。

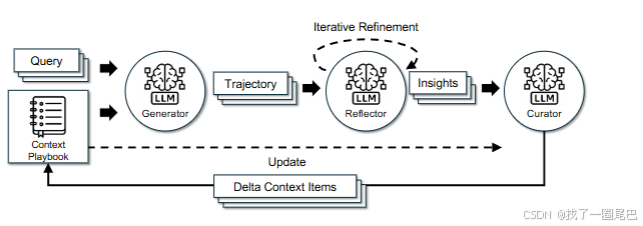

ACE 核心架构:生成、反思、整理

ACE 基于 "动态备忘单" 的智能体架构为基础,通过生成器、反思器、整理器的协同工作实现 Playbook 的动态演进,三者使用同一 LLM(确保性能提升仅来自上下文构建)。

生成器(Generator):任务执行与轨迹产出

-

核心职责:接收用户查询或任务请求,结合当前 Playbook 中的策略与知识,生成推理轨迹、操作代码或任务解决方案。

-

关键流程:

-

解析任务需求,检索 Playbook 中相关的策略、代码片段;

-

按任务要求逐步输出推理步骤(如多步 API 调用逻辑)、中间结果及最终执行代码;

-

标记执行过程中用到的 Playbook 条目,为后续反馈提供依据。

-

-

核心作用:作为 "执行者",既完成具体任务,又产出包含成功经验与失败案例的推理轨迹,为 Playbook 更新提供原始素材。

反思器(Reflector):洞察提取与错误诊断

-

核心职责:对生成器的推理轨迹、执行结果进行评估,提炼可复用的策略、诊断错误根源,为 Playbook 更新提供高质量洞察。

-

关键流程:

-

结合环境反馈(如代码执行结果、任务完成状态)或标注数据(可选),对比预期目标与实际输出;

-

识别成功策略(如有效 API 调用逻辑)、错误类型(如参数错误、策略误用)及根本原因(如对 API 返回格式理解偏差);

-

生成结构化反馈,包括关键洞察、修正方案及 Playbook 现有条目的有效性标签(有用 / 有害 / 中性)。

-

-

核心创新:独立于整理器的专属模块,专注于评估与洞察提取,避免功能混杂导致的反馈质量下降,直接提升 Playbook 更新的精准度。

整理器(Curator):Playbook 的结构化更新

-

核心职责:接收反思器输出的洞察,对现有 Playbook 进行增量更新,确保知识的有序积累与冗余控制。

-

关键流程:

-

筛选反思器提供的洞察,剔除与现有内容重复的信息;

-

将新策略、错误解决方案等封装为标准化条目,按分类(如策略规则、代码片段)添加到 Playbook;

-

执行去重与优化:通过语义嵌入对比删除冗余条目,更新既有条目的使用反馈计数器;

-

当上下文窗口不足时,触发 "懒惰优化",优先保留高价值条目。

-

-

核心作用:作为 Playbook 的 "管理员",通过 "扩充 - 优化" 平衡机制,确保 Playbook 既持续增长又保持精简高效,支撑框架的长期适配能力。

完整工作流程

-

初始化阶段:加载领域基础知识、任务模板与初始评估基准,构建 Playbook 的初始版本;

-

任务执行阶段:生成器结合 Playbook 处理用户任务,输出推理轨迹与执行结果;

-

反馈提炼阶段:反思器分析推理轨迹与执行反馈,提炼成功策略、诊断错误并生成结构化洞察;

-

知识更新阶段:整理器将洞察转化为标准化条目,增量更新到 Playbook,完成去重与优化;

-

迭代优化阶段:重复 "任务执行 - 反馈提炼 - 知识更新" 流程,支持多轮迭代与批量适配,持续强化 Playbook 的实用性。

提示词 / 上下文优化方法参考

ACE(Agentic Context Engineering)

-

核心逻辑:基于智能体架构的上下文工程框架,支持离线(如系统提示词优化)与在线(如测试时记忆适配)两种场景,通过生成器、反思器、整理器三模块的协同工作,实现上下文的结构化增量更新。

-

公平性配置

-

生成器、反思器、整理器使用同一 LLM(DeepSeek-V3.1 的无思考模式),避免更强的反思 / 整理模块向生成器传递知识,确保性能提升仅来自上下文构建本身;

-

批量大小设为 1(每个样本生成一个差异上下文);离线适配中反思器最大优化轮数与最大训练轮数均设为 5。

-

-

特点:解决简洁偏置与上下文崩溃问题,兼顾上下文的全面性与可扩展性,无需修改模型权重即可实现性能自提升。

上下文学习(In-Context Learning, ICL)

-

核心逻辑:通过在输入提示词中嵌入任务演示样本(少样本或多样本),让模型无需更新权重即可推断任务格式与输出要求。

-

配置规则:若训练样本总量不超过模型上下文窗口长度,则全部放入;否则填充窗口容量上限的样本数量。

-

特点:无需训练,依赖示例的直观引导,是大模型 Few-shot 能力的经典应用方式。

MIPROv2

-

核心逻辑 :主流的自动提示词优化器,基于贝叶斯优化算法,联合优化系统指令 与上下文演示样本,实现提示词的自动迭代。

-

实验配置 :采用官方 DSPy 框架实现,设置

auto="heavy"模式以最大化优化性能。 -

特点:端到端自动优化,无需人工设计提示词,适配各类结构化任务场景。

GEPA(Genetic-Pareto)

-

核心逻辑 :基于反射式提示词进化的样本高效型优化器,核心流程为:收集模型的执行轨迹(推理步骤、工具调用、中间输出)→ 自然语言反射诊断错误并分配归因→ 生成提示词更新方案;同时通过遗传帕累托搜索维护高性能提示词前沿集,避免陷入局部最优。

-

性能优势:实验验证其优于 GRPO 等强化学习类优化方法及 MIPROv2 等提示词优化器,可提升 10-20% 的准确率,且所需的任务推演次数(rollouts)减少 35 倍。

-

实验配置 :使用官方 DSPy 框架,设置

auto="heavy"模式。 -

特点:样本效率高,优化效果显著,兼顾推理轨迹的可解释性与提示词的性能稳定性。

动态备忘单(Dynamic Cheatsheet, DC)

-

核心逻辑 :一种测试时学习方法,通过构建自适应外部记忆库存储可复用的策略与代码片段;记忆库会随新输入和输出持续更新,实现跨任务的知识积累与复用。

-

关键优势:无需标注数据(ground-truth labels),模型可从自身生成结果中自主整理记忆内容,灵活性与泛化性极强。

-

实验配置 :采用官方实现,设置为累积模式(DC-CU),即记忆库持续增量更新。

-

特点:从 "静态提示词" 升级为 "动态记忆",实现上下文的持续进化,突破单次提示词的信息局限。