自动驾驶与 C-V2X 的融合

协同感知(Cooperative Perception):解决自动驾驶的长尾问题

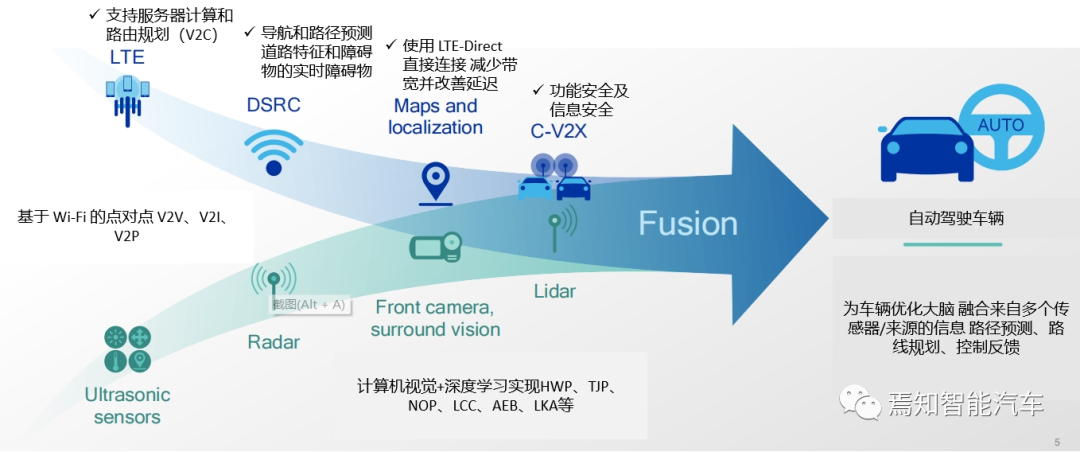

在自动驾驶领域,有一个著名的"90/10 定律":90% 的场景(高速巡航、跟车)很容易解决,但剩下 10% 的长尾场景(Corner Cases)(如鬼探头、被遮挡的障碍物、极端天气)却可能导致致命事故。C-V2X 的协同感知正是为了攻克这最后的 10% 而生。

单车智能 (AD) 就像是一个视力极好但视野受限的"独行侠"。无论它的雷达多么昂贵,它永远无法违反物理定律------看不穿水泥墙,看不透前面那辆大货车。 协同感知 (CP) 则是让这位独行侠拥有了"千里眼"和"透视眼",将感知范围从物理视距 (Line-of-Sight) 扩展到了数字视距 (Non-Line-of-Sight)。

- 什么是协同感知?

-

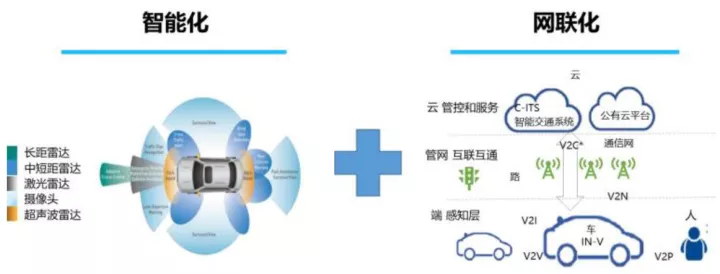

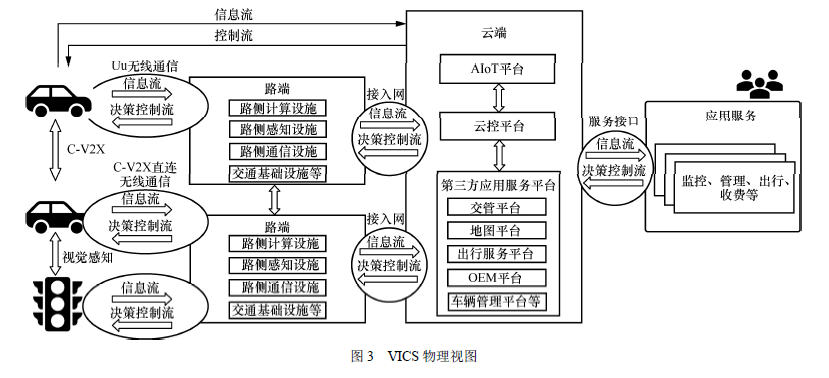

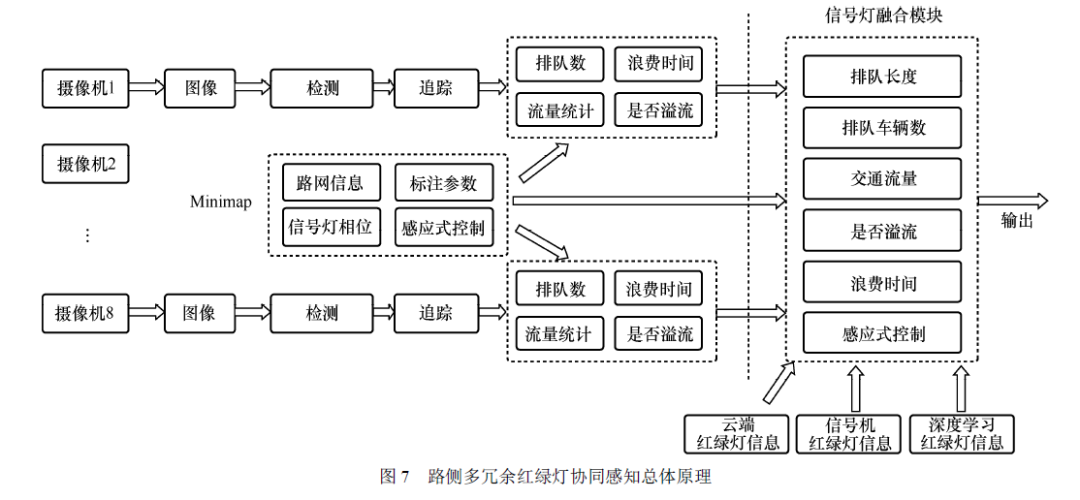

定义: 车辆不仅使用自己的传感器(Local Perception),还通过 V2X 网络接收周围其他车辆(V2V)和路侧设备(V2I)传来的感知数据。

-

融合逻辑: $$ \text{最终感知结果} = \text{本车传感器数据} \cup \text{他车共享数据} \cup \text{路侧共享数据} $$

-

数据载体: 核心是 CPM (Cooperative Perception Message) 协议。它不传输原始的视频(太占带宽),而是传输结构化的**"目标列表"**(Object List)。

-

例如: "我在坐标 (X,Y) 发现了一个行人,速度 V,航向角 θ,置信度 95%。"

- 直击痛点:协同感知解决的三大长尾难题

场景 A:鬼探头 (The Occluded Pedestrian)

-

长尾挑战: 车辆行驶在双向单车道,右侧路边停了一辆大公交车。一个小孩突然从公交车头跑出来。本车的激光雷达和摄像头完全被公交车挡住,根本看不见小孩。

-

协同解法:

-

上帝视角 (V2I): 路边的智慧灯杆(RSU)上的摄像头位置很高,正好能越过公交车看到那个小孩。

-

实时共享: RSU 识别出小孩,并立刻广播 CPM 消息。

-

提前决策: 本车虽然还没看见人,但在数字地图上已经收到了"前方 20 米有行人横穿"的警告,于是提前减速备刹。

场景 B:无保护左转 (Unprotected Left Turn)

-

长尾挑战: 在繁忙的十字路口左转,对面直行车流源源不断,且视线被左转待转区的大车遮挡。自动驾驶系统通常会因为无法确认安全而死锁 (Deadlock),一直停在路口不敢动。

-

协同解法:

-

他车共享 (V2V): 对向车道排队的第一辆车,或者侧向车道的车,能清楚地看到直行车流的空隙。它们将观测到的直行车辆位置和速度共享出来。

-

决策突破: 左转车根据融合后的全景数据,精准判断出"有个 4 秒的空档,足够安全通过",从而果断完成左转。

场景 C:超视距感知 (Beyond Visual Range)

-

长尾挑战: 高速公路大雾天气,能见度只有 50 米。前方 1 公里处发生了连环追尾。单车视觉此时完全失效。

-

协同解法:

-

接力传递: 事故现场的车辆发出报警。中间的车辆(即便不涉及事故)作为中继节点,或者通过路侧 RSU,将这一感知结果瞬间传给后方 1 公里外的车辆。

-

结果: 后车在还没进入浓雾区时就已经开始减速。

- 融合算法的挑战

协同感知听起来很美,但实现起来技术难度极大,核心在于**"怎么信"和"怎么拼"**。

-

时空对齐 (Time-Space Alignment):

-

别人的车在动,我的车也在动。如果不进行毫秒级的时间同步和厘米级的坐标变换,拼出来的世界就是错位的(比如把路边的树拼到了路中间)。

-

关键技术: 高精度定位 (RTK) + 预测补偿算法。

-

置信度评估 (Trust Evaluation):

-

如果路侧摄像头脏了,把一个塑料袋识别成了石头,我也要跟着急刹车吗?

-

关键技术: 贝叶斯融合 (Bayesian Fusion)。 本车系统会给不同来源的数据打分。

-

本车激光雷达:权重 0.9(亲眼所见,最信)。

-

路侧 RSU:权重 0.8(官方设备,比较信)。

-

旁边的小破车发来的数据:权重 0.3(参考一下,不全信)。

-

通信负载 (Communication Load):

-

如果路口 100 辆车都在广播自己看到的所有目标,信道瞬间就堵死了。

-

关键技术: 冗余抑制。 如果我已经听到别人广播了"前面有个行人",我就闭嘴,不再重复广播同一个目标。

小结: 协同感知是自动驾驶的**"补完计划"**。它并不取代单车智能,而是填补了物理感知无法触及的盲区。只有当车辆能够利用集体的智慧时,真正的 L4/L5 级全自动驾驶才敢放心地行驶在复杂的城市丛林中。

协同决策与控制(Cooperative Control):车辆编队行驶(Platooning)

如果说"协同感知"是让车辆共享眼睛,那么**"协同控制"**就是让车辆共享大脑和手脚。这是 V2X 的终极形态之一,它打破了车辆之间"各自为战"的局面,将多辆车变成一条在公路上飞驰的"无形列车"。

在高速公路上,我们经常看到一群大雁排成"人"字形飞行,因为这样最省力。车辆编队(Platooning) 就是受此启发,利用 C-V2X 技术让多辆车首尾相接,以极近的距离(如 5-10 米)同步高速行驶。

- 为什么要编队?(核心价值)

-

极致节能(风阻效应):

-

当车辆高速行驶时,60% 以上的油耗是用来克服风阻的。

-

在紧密编队中,头车破风,后车躲在"尾流(Slipstream)"的低压区里。研究表明,后车可节油 10%-15%,甚至头车因为尾部湍流减少也能节油 5%。这对物流车队来说是巨大的利润。

-

成倍提升道路容量:

-

正常驾驶需要保持 100 米车距。编队后车距缩短至 10 米,相当于把高速公路的通行能力提升了 3-4 倍。

-

解放司机:

-

在编队模式下,只有头车司机需要全神贯注(甚至头车也可以是自动驾驶),跟随车的司机可以休息或处理文书工作,这极大地缓解了长途物流的疲劳驾驶问题。

- C-V2X 在编队中的角色:从"弹簧连接"到"钢棍连接"

传统的自适应巡航(ACC)是靠雷达测距。前车减速 -> 雷达测到距离变近 -> 后车刹车。这个过程有 延迟。如果车队有 5 辆车,这种延迟会逐级放大(幽灵堵车效应),导致最后一辆车必须急刹车,根本无法保持近距离。

C-V2X 实现了 CACC(协同自适应巡航),将车队变成了一个刚性整体:

-

意图直接传递(前馈控制):

-

头车决定刹车。在制动卡钳夹紧之前,它已经通过 V2V 发出了"我要刹车"的指令。

-

第 2、3、4、5 号车几乎在同一毫秒收到指令。

-

同步动作:

-

所有车辆同时开始制动。就像火车车厢一样,中间没有延迟。

-

结果: 即使车距只有 5 米,车速 100km/h,也不会追尾。

- 编队的生命周期管理

编队不仅仅是"跟着跑",它涉及一套复杂的 FSM(有限状态机) 交互流程。

-

阶段一:发现与公告 (Discovery)

-

头车广播:"我是京东物流车队 001 号,我要去上海,当前速度 90,还有 3 个空位,欢迎加入。"

-

阶段二:加入 (Join)

-

后方散户卡车申请:"我想加入。"

-

头车批准:"同意。请驶入我的正后方,我们将建立加密连接。"

-

后车自动加速追赶,并在接近时由 CACC 接管控制权,锁定距离。

-

阶段三:巡航与维护 (Cruising)

-

这是常态。车辆之间高频(如 20Hz-50Hz)交换控制数据(加速度、油门开度、横向偏移)。

-

心跳检测: 一旦 V2X 信号出现波动或丢包(连续 3 次没收到心跳),后车会立即触发**"降级模式"**,自动拉大车距以保安全。

-

阶段四:拆解与离队 (Leave/Split)

-

中间的一辆车要下高速了。它申请"离队"。

-

编队策略:后方车辆主动减速拉开大空档,让离队车辆变道出去,然后后方车辆再加速补位,重新合拢编队。

- 技术挑战与未来

虽然原理完美,但落地很难。

-

异构编队 (Heterogeneous Platooning):

-

沃尔沃的车头能带解放的卡车吗?这就要求极高的标准统一性。不同品牌的动力学模型(刹车多灵敏、油门多重)完全不同,控制算法必须具备极强的鲁棒性。

-

切入干扰 (Cut-in):

-

如果有社会车辆强行插队进入编队空隙怎么办?

-

编队必须有能力识别"入侵者",并自动"断开"成两段,等入侵者离开后再重新愈合。

-

通信可靠性:

-

在编队中,V2X 通信就是那根"牵引绳"。如果绳子断了(无线干扰),后果不堪设想。因此,编队通常要求使用 NR-V2X 的组播功能 加上 Sidelink 的高可靠性设计。

小结: 车辆编队是 C-V2X 协同控制的巅峰之作。它将孤立的车辆整合成了一个分布式系统。通过消除反应延迟,它不仅重塑了物流行业的经济模型,也向我们展示了未来智慧高速公路的终极图景------车流如水,高速而静谧。

远程驾驶(Tele-operated Driving):5G Uu 接口的杀手级应用

在自动驾驶达到完美的 L5 阶段之前,总会有机器无法处理的突发状况(如交警手势指挥、复杂的临时施工)。这时,人类必须介入。但如果车上没有驾驶员怎么办?远程驾驶 就是那个最后的"救世主"。

远程驾驶(ToD)是 C-V2X 技术中极少数高度依赖网络(Uu接口) 而非直连(PC5接口)的关键应用。它通过 5G 网络这根无形的线,将人类驾驶员的感官延伸到了千里之外。

- 什么是远程驾驶?

-

场景描述: 一辆没有驾驶员的 Robotaxi(自动驾驶出租车)在繁忙路口遇到故障停滞,或者一辆无人矿卡在矿坑里遇到了未知的障碍物。

-

解决方案: 车辆自动向云端呼救。位于几百公里外调度中心的专业驾驶员,坐在模拟驾驶舱(有方向盘、踏板、三联屏)中,接管车辆控制权,远程把车开出困境。

-

角色定位: 它是自动驾驶商业化落地的安全兜底(Fallback)。没有它,无安全员的自动驾驶就不敢真正上路。

- 为什么它是 5G 的"杀手级"应用?

远程驾驶对网络的要求苛刻到了极致,完美契合了 5G 的三大特性:大带宽 (eMBB) 和 低时延高可靠 (uRLLC)。

-

上行大带宽(看得清):

-

需求: 驾驶员需要看清路况。车辆需要实时上传 4-6 路高清摄像头视频(前方、侧后视镜、后视)以及激光雷达点云数据。

-

数据量: 单车上行速率需求可能高达 30Mbps - 50Mbps。4G 网络很难支撑这种持续的高并发上行,只有 5G 能做到流畅不卡顿。

-

下行低时延(刹得住):

-

需求: 驾驶员踩下刹车,指令必须瞬间传到车上。

-

挑战: 假设时速 60km/h,如果网络延迟是 100ms(4G水平),车就会盲开 1.7 米。加上视频传输回来的延迟,驾驶员看到的画面本身就是"过去"的。这极易导致操作过头(画龙)或刹车不及。

-

指标: 5G 将端到端控制环路时延压缩到 10ms - 20ms 级别,使得远程驾驶的感觉和在车里开几乎一样。

- 核心技术挑战与对策

挑战 A:网络的抖动 (Jitter)

-

问题: 5G 虽快,但偶尔也会波动。一旦视频卡住 1 秒,车就失控了。

-

对策:

-

自适应码率: 网络变差时,自动降低视频画质,优先保证流畅度。

-

预测控制算法: 车辆本地依然有防碰撞系统。如果远程驾驶员指令失误(比如没看到延迟画面里的墙),车辆会拒绝执行撞墙指令并自动刹停。

挑战 B:空间迷失感

-

问题: 驾驶员看着屏幕开车,没有真实的身体加速度感(推背感、离心力),很容易误判车速和距离。

-

对策:

-

力反馈方向盘: 将车辆底盘的震动和转向阻力实时传回给驾驶员手中的方向盘。

-

增强现实 (AR): 在视频画面上叠加辅助线(如车宽线、刹车距离线),辅助判断。

- 商业应用场景

远程驾驶不仅仅是救急,它正在重构特定行业的用工模式。

-

矿山与港口:

-

现状: 环境恶劣,招工难,工资高。

-

变革: 一个驾驶员坐在空调房里,可以监管 10 辆自动驾驶卡车。只有在卡车遇到难点时,他才介入操作 1 分钟。实现了 1 人控多车,大幅降低成本。

-

代客泊车 (AVP):

-

场景: 车主在商场门口下车。车辆自动去地库找车位。如果地库里遇到乱停车堵路,远程安全员介入挪一下车,然后继续自动泊车。

-

无人物流配送车:

-

当配送小车在小区里被熊孩子围住或被石头卡住时,远程脱困。

小结: 远程驾驶是 C-V2X 体系中 V2N (车-网) 的巅峰之作。它不仅仅是一项技术,更是一种新的人机共生模式:机器负责枯燥的重复劳动,人类负责处理复杂的边缘情况。 5G 网络赋予了人类"隔空移物"的能力,让驾驶员彻底告别了方向盘后的方寸之地。