一、前言

在自然语言处理(NLP)的漫长进化史中,我们一直在追求一个终极目标:让机器能够像人类一样"阅读"并"理解"故事。当一个经验丰富的人类观察者阅读一份犯罪报告或一篇新闻报道时,大脑并不仅仅是在记录文字,而是构建了一个简洁且富有逻辑的"剧情图谱"。这个图谱包含了不同的参与者(Actors)、他们在特定时刻的原型角色(Roles)和状态(States),以及随着时间推移这些角色如何通过互动发生演变。甚至,人类观察者还能识别出语义中的缺失部分,并产生对未来的预期。这种能力在认知科学中被称为"工作记忆"或"情境化认知"。

然而,传统的AI系统------包括现代的大型语言模型(LLM)------在很大程度上仍然缺乏这种持久且结构化的世界模型。虽然LLM在生成流畅文本方面表现惊人,但在处理长篇连贯叙事时,它们往往面临"语义碎片化 "和"逻辑不连续 "的困境。为了填补这一空白,来自加州大学洛杉矶分校(UCLA)的研究团队提出了一种名为"生成式语义工作区"(Generative Semantic Workspace,简称 GSW)的新型计算框架。GSW不仅是一个技术工具,更是一个旨在模拟人类"观察者"行为的认知架构,它为空间计算助手和具备长期推理能力的智能体奠定了基础。

二、认知科学的支柱:GSW的设计哲学

GSW框架的构建并非凭空想象,而是深度植根于两大认知科学理论:全球工作区理论 (Global Workspace Theory, GWT)和情境认知理论(Situated Cognition)。

全球工作区理论与"剧场隐喻"

全球工作区理论由认知心理学家伯纳德·巴尔斯(Bernard Baars)于20世纪80年代提出,它提供了一个理解信息如何变得可意识化以及如何在全脑范围内广播的框架 。巴尔斯使用了一个生动的"剧场隐喻":意识就像剧场舞台上的一处"聚光灯亮点",只有在聚光灯下的信息才能被舞台下的"观众"(即大脑中成千上万个专门的无意识处理器)所获取 。这种机制允许不同的认知过程------如记忆、决策、语言和运动控制------进行协调与整合 。

在GSW的设计中,这种"黑板架构"被转化为一种计算模型,用于将零散的文本片段整合进一个统一的、可访问的语义地图中 。通过这种方式,GSW能够将"过去"的记忆、"现在"的感知和对"未来"的预测连接起来,实现经验的跨时间整合 。

情境认知与"交互式生成"

情境认知理论(由Clancey等学者推动)则强调,知识并非存储在脑海中的静态事实集合,而是在特定社会、文化和物理背景下的活动中产生的 。这意味着,"含义"不是被"检索"出来的,而是在感知与行动的循环中被"生成"的 。

GSW框架采用了这一理念,将语义建模为一种生成式过程。它不使用预定义的、死板的词典标签,而是根据观察者所处的具体情境,动态地生成角色和状态 。这种"知道即行动"的视角使得AI观察者能够超越单纯的文字识别,进入到理解行为意图和预测后续发展的更高维度 。

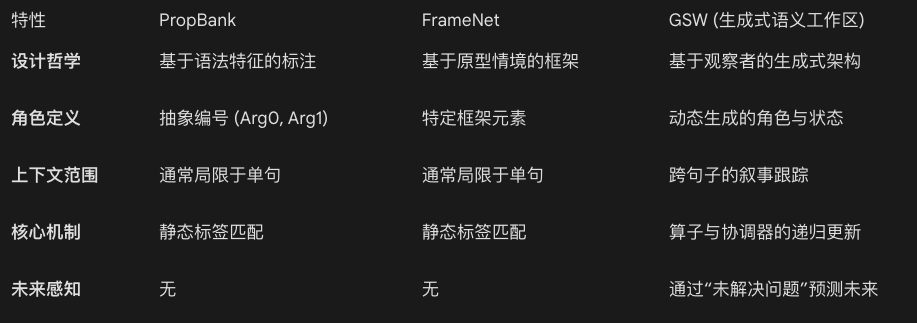

三、传统语义框架的局限性:为何我们需要GSW?

为了理解GSW的突破性,我们必须审视过去几十年中统治NLP领域的传统语义标注框架,如 PropBank、FrameNet 和 GLEN。

语义角色标注(SRL)的历史包袱

早期的语义角色标注任务主要关注单句分析,试图回答"谁对谁做了什么、何时、何地、为何" 。

- PropBank:采用自下而上的方法,基于谓词(通常是动词)定义了一套通用的编号参数(如 Arg0, Arg1)。虽然这种方法覆盖面广,但角色定义过于抽象,难以支持深层次的剧情理解 。

- FrameNet:采用自上而下的方法,将语义角色组织成"框架"(Frames)。它虽然提供了更丰富的语义细节,但受限于预定义的、有限的词典,且难以处理跨句子的状态演变 。

碎片化与不连续性挑战

在处理多句子叙事(如犯罪报告)时,传统框架面临两大难题:

- 语义碎片化(L1):例如,在描述逮捕过程时,FrameNet 可能会识别出"反应"框架和"逮捕"框架,但往往忽略了"谁在做出反应"以及反应与犯罪事件之间的内在逻辑关联 。

- 语义不连续性(L2):当第二句话提到"警察"而第一句话提到"执法官"时,传统模型若缺乏高效的指代消解和状态跟踪机制,就会将它们视为孤立的实体,从而无法构建连贯的情节 。

下表对比了传统框架与 GSW 的核心差异:

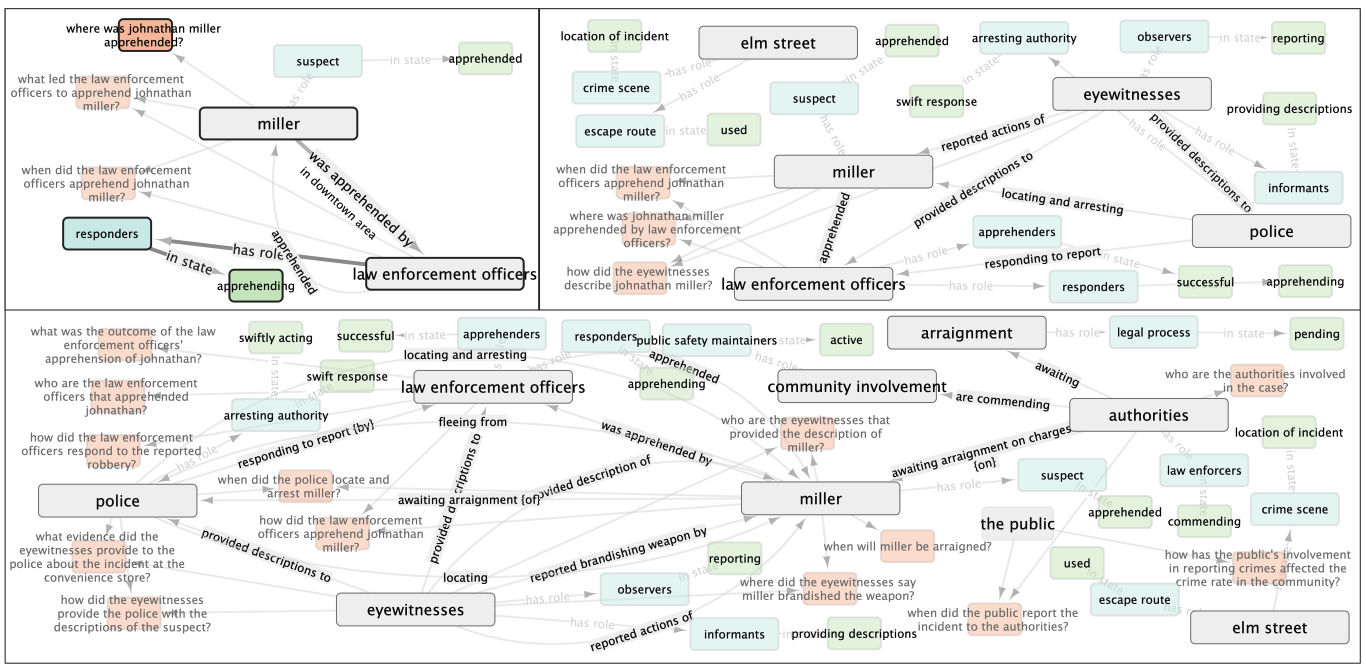

四、GSW 的核心架构:算子与协调器

GSW 框架由两个紧密耦合的计算单元组成:算子(Operator)和协调器(Reconciler) 。它们协同工作,将原始文本流转化为结构化的、可演化的复杂网络。

算子(Operator):语义的概率建模

算子的职责是将每一个文本段落 C n C_n Cn 映射到一个局部的"工作区实例" W n \mathcal{W}_n Wn 1。在计算上,算子被建模为一个条件随机场(Conditional Random Field, CRF) 。CRF 是一种统计建模方法,能够利用输出之间的结构依赖性,这在 NLP 中非常流行,因为它能够考虑到标签之间的邻近关系。

在 GSW 的语义 CRF 中,工作区实例被分解为五个部分的层级分布:

- 参与者(Actor):识别命名实体或其他名词短语 。

- 角色(Role):为每个参与者分配一个在当前情境下的原型目的(如"嫌疑人"、"逮捕者") 。

- 状态(State):根据语境确定参与者角色的属性(如"被捕"、"在逃") 。

- 谓词(Predicate):刻画参与者之间的互动关系 。

- 问题(Question):识别语义中尚未填补的空白,作为未来信息的占位符 。

数学上,这种分布可以表示为: P ( v ∣ C n ) : = P ( { a , r , s } ∣ C n ) = P ( s ∣ a , r ; C n ) × P ( r ∣ a ; C n ) × P ( a ∣ C n ) P(v|C_n) := P(\{a, r, s\}|C_n) = P(s|a, r; C_n) \times P(r|a; C_n) \times P(a|C_n) P(v∣Cn):=P({a,r,s}∣Cn)=P(s∣a,r;Cn)×P(r∣a;Cn)×P(a∣Cn)这种分解反映了认知上的优先级:我们先识别出"是谁",然后判断"他在做什么",最后评估"他现在处于什么状态" 。

为了高效地实现这一复杂模型,研究团队利用了 LLaMA-2-13B 作为主干网络,并通过 QLoRA 技术训练了针对不同情境(如犯罪、医疗、经济)的小型适配器(参数量小于 1M) 。这种设计既保留了基础模型的大规模语言理解能力,又实现了特定领域的深度语义提取。

协调器(Reconciler):工作记忆的递归更新

如果说算子是观察者的"眼睛",那么协调器就是其"大脑"。协调器负责维护一个持续更新的共识工作区 M ∗ \mathcal{M}^* M∗(类似于人类的长期记忆或工作记忆) 。

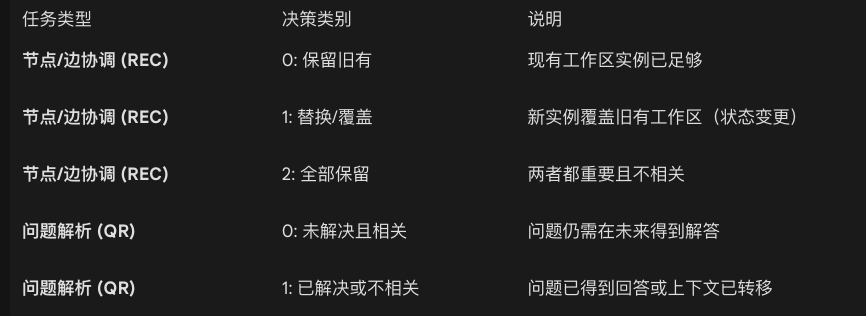

给定一个新的工作区实例 W n \mathcal{W}_n Wn 和先前的共识记忆 M n ∗ \mathcal{M}_n^* Mn∗,协调器执行一个分类任务,对每一对节点和边进行对比并做出如下决策:

- 保留旧有(0):现有记忆已经足够,新信息被视为噪声或多余 。

- 替换更新(1):新信息反映了参与者的状态演变(如从"搜寻中"变为"已抓获"),旧信息被覆盖 。

- 合并添加(2):两者都重要且彼此独立,共同构成更丰富的语义图谱 。

协调器还承担着"问题解析"(Question Resolution)的重任。当算子在文本片段 1 中提出一个问题(如"谁是纵火者?"),协调器会持续监控后续的工作区实例。一旦文本片段 2 提供了答案,协调器就会将该问题标记为"已解析"并将其从活动工作区中移除 。这种机制确保了 AI 观察者能够像人类一样,带着问题去阅读,并在获得答案后更新认知地图。

下表总结了协调器的子任务分类:

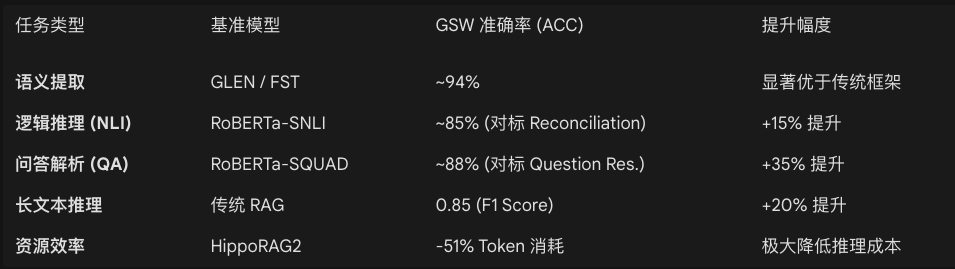

五、实验结果与性能评估:GSW 到底有多强?

研究团队通过人类评估(通过 UpWork 招募的专业标注员)和模型基准测试对 GSW 进行了全面验证 。

算子评估:超越 SOTA 基准

在多句子语义提取任务中,人类标注员对算子生成的输出表现出了极高的偏好。相比于 GLEN、BERT-SRL 和 Frame Semantic Transformer (FST),GSW 在多个情境下的表现均占据压倒性优势。

此外,算子生成的问题质量也被证明与 GPT-4 相当。人类标注员在 1-5 分的评分中,给算子生成的平均评分为 4.6,与 GPT-4 的 4.68 评分几乎没有统计学上的显著差异 。

协调器评估:逻辑一致性的守护者

协调器在处理信息更新方面的表现也大幅领先于传统模型。通过将协调任务转化为自然语言推理(NLI)和问答(QA)任务的变体,研究人员发现 GSW 协调器在准确率(ACC)和 F1 分数上比 DeBERTa 和 RoBERTa 等基线模型提高了 25% 到 50% 。这意味着协调器能够更准确地判断一段新信息是应该补充到记忆中,还是应该用来纠正旧的错误认知 。

情景记忆基准(EpBench):长上下文处理的革命

在针对长篇叙事的 Episodic Memory Benchmark (EpBench) 测试中,GSW 展现了其作为"大脑化"存储系统的优势 。传统的检索增强生成(RAG)系统通常将文档切成独立的块,并在查询时通过向量搜索召回。这种方式在面对需要跨多篇文档、追踪多个角色状态变化的复杂查询时效果不佳 。

在包含 200 到 2000 个章节的语料库测试中:

- 准确性:GSW 在 EpBench-200 上取得了 0.85 的 F1 分数,比次优方法(HippoRAG2)高出约 10% 。在最复杂的查询(涉及多达 17 个文档的合成)中,GSW 的召回率提升了 20% 。

- 效率:GSW 将查询时发送给 LLM 的上下文 Token 数量减少了 51% 。这是因为 GSW 不需要将冗长的原始文本块塞进窗口,而是直接利用其构建好的结构化"工作记忆"生成精准的实体摘要 。

六、空间计算与未来应用:GSW 的广阔图景

GSW 框架的意义远不止于处理新闻报道,它是构建未来"空间计算"和"实体 AI"的关键拼图 。

数字化助手与 AR 交互

随着 Apple Vision Pro (2025) 等设备的普及,空间计算正在从实验室走向日常 。在这种背景下,AI 助手需要具备"观察者"的视野。当用户佩戴 AR 眼镜时,GSW 可以作为其核心的语义层,不仅映射周围物体的几何位置,还能理解这些物体的语义演变 。 例如,在一个协同办公场景中,AI 能够通过 GSW 跟踪每一位参与者的讨论重点、达成的共识以及尚未解决的问题(即工作区中的 Question 节点) 。

工业元宇宙与数字孪生

在工业领域,GSW 可以通过构建"数字孪生"的语义工作区,监控复杂设备的运行状态 。通过实时感知 spatiotemporal(时空)数据流,AI 能够预测潜在的故障并主动提出解决方案 。

实体 AI 与 具身智能体

GSW 为自主智能体提供了一种类似于人类的"情节记忆"。这使得机器人进入一个全新的家庭环境后,能够快速学习各种物体的用途和操作顺序(Multitask Preplay),而不是通过机械的脚本运行 。通过 GSW 的"认知闭环",机器可以真正理解人类的意图,从而在共同作业中表现得更像一个伙伴而非工具 。

七、技术实施与实践考量

对于希望落地 GSW 的开发者来说,以下几个关键环节至关重要:

数据驱动的领域特化

GSW 的算子模型是在 GDELT 这一全球新闻索引平台上训练的 。研究显示,仅需约 80 篇特定情境的高质量文档(约 1200 个句子),就足以微调出性能卓越的 LoRA 适配器 。这种低数据需求得益于预训练 LLM 内部已经蕴含了丰富的语言规律,适配器的任务仅仅是将这些规律映射到 GSW 的结构化格式中 。

计算成本与资源要求

算子的训练成本相对较低,每个适配器在主流 GPU 上大约需要 72 小时的训练时间 。在推理阶段,由于 GSW 采用了"即插即用"的 LoRA 权重加载方式,可以非常灵活地在不同情境间切换,且不会对主干模型的处理速度造成显著负担 。

时空信息的捕获机制

GSW 通过将空间位置和时间点直接作为"参与者"节点引入图谱,巧妙地解决了时空感知问题 。

- 空间捕获:例如,"榆树街"(Elm Street)被实例化为一个节点,并被赋予"犯罪现场"或"逃跑路线"的角色 。

- 时间捕获:不仅通过"一月"或"周二"这样的显性节点,还通过参与者状态的递进(如"正在接近"或"待定")来隐式表达动作的进程 。

下表展示了 GSW 在不同任务中的表现指标对比:

八、局限性与伦理风险

尽管 GSW 迈出了重要一步,但挑战依然存在。

- 指代消解的长程挑战:在超长文本中,将不同句子的各种称呼准确映射到同一个参与者节点仍然是一个技术难点,这直接影响了工作区图谱的准确性 。

- 偏见与幻觉风险:作为基于 LLaMA 的模型,GSW 可能会在生成角色和状态时反映出微调数据中的偏见(如性别或种族刻板印象),尽管实验中证据较少,但仍需警惕 。

- 检索复杂性:随着工作区网络不断庞大,节点间的两两对比计算量会激增。目前的解决方案是采用启发式子图匹配,但这可能会漏掉一些边缘的语义更新 。

九、结论与行业启示

生成式语义工作区(GSW)不仅是一个 NLP 框架,它代表了 AI 迈向"观察者"角色的重要转型。通过整合认知科学的 GWT 理论和 Situated Cognition 哲学,GSW 克服了传统语义标注中碎片化和不连续性的顽疾,为 AI 赋予了类似于人类的工作记忆和情节追踪能力 。

对于技术从业者而言,GSW 提供的 51% Token 效率提升和显著的推理准确度增长,证明了结构化语义内存才是解决 LLM 长上下文瓶颈的"银弹" 。随着空间计算硬件的成熟,像 GSW 这样能够理解意图、追踪演变并能自主消解不确定性的 AI 观察者,将成为实现真正人机共生的核心引擎。在未来的智能系统中,AI 将不再是只会在窗口里被动响应的文本生成器,而是与我们并肩观察世界、共同编织叙事的数字化伙伴。