目录

[一、 什么是 ops-math?](#一、 什么是 ops-math?)

[二、 核心能力:AIGC 的三大支柱](#二、 核心能力:AIGC 的三大支柱)

[三、 开发者友好:从 0 到 1 的最佳入口](#三、 开发者友好:从 0 到 1 的最佳入口)

[四、AIGC 场景实战:自定义一个"噪声注入"算子](#四、AIGC 场景实战:自定义一个“噪声注入”算子)

[五、 结语](#五、 结语)

在 AIGC(生成式 AI)的宏大建筑中,我们往往惊叹于 Transformer 的精妙结构或 Diffusion 的神奇效果。但如果拆开这些算法的封装,你会发现底层流动的全是数学。

无论是扩散模型中的高斯噪声叠加,还是大语言模型推理时的混合精度计算,都离不开最基础的数学算子。在华为昇腾(Ascend)的 CANN 生态中,承担这一"数学基石"重任的,正是

ops-math仓库。今天,我们结合 AtomGit 上的官方信息,为大家全面拆解这个支撑 AIGC 运转的通用数学库。

一、 什么是 ops-math?

根据仓库的官方描述,ops-math 是 CANN (Compute Architecture for Neural Networks) 生态下,算子库中提供数学计算的基础子库。

它与 ops-nn(神经网络库)、ops-cv(计算机视觉库)并列,处于 CANN 算子库的底层核心位置。如果说 ops-nn 是针对 AI 业务的高级封装,那么 ops-math 就是更原子的指令集合,涵盖了:

-

Math 类:基础代数运算(加减乘除、指数对数等)。

-

Conversion 类:数据类型转换。

-

Random 类:概率分布与随机数生成。

二、 核心能力:AIGC 的三大支柱

在 ops-math 的目录结构中,我们可以清晰地看到它的核心能力版图,这些看似基础的功能,实则精准击中了 AIGC 的痛点:

1. Math 目录:潜空间的导航员

AIGC 的生成过程,本质上是在高维潜空间(Latent Space)中的向量移动。

-

lerp(线性插值) :仓库明确提及了lerp算子。在视频生成或图像过渡中,它是实现"丝滑渐变"的关键。 -

is_finite(数值检测) :在大模型训练中,梯度爆炸是常态。is_finite算子负责实时监控数值的合法性(检测 NaN/Inf),是训练稳定性的"看门人"。

2. Random 目录:创造力的源头

生成式 AI 的"创造力"源于随机性。

drop_out_v3:仓库中提及的这个随机类算子,利用 NPU 硬件随机数发生器,为模型引入高质量的随机扰动。这对于 Diffusion Model 的去噪过程至关重要,决定了生成图像的多样性。

3. Conversion 目录:效率的加速器

- 混合精度支持 :AIGC 模型通常需要在 FP32(保持精度)和 FP16/BF16(提升速度)之间频繁切换。

ops-math提供了极致优化的数据转换算子,最大化利用带宽,减少转换开销。

三、 开发者友好:从 0 到 1 的最佳入口

对于想要学习昇腾 TBE(Tensor Boost Engine)开发的工程师来说,ops-math 是目前最友好的"新手村"。根据仓库最新的 Latest News:

-

极低的上手门槛 :2026/01 的更新新增了

QuickStart和 Docker 环境支持,这意味着你不需要复杂的环境配置,拉起镜像即可开发。 -

无需实体板卡 :2025/12 的更新引入了 CANN Simulator 支持。即使你手头没有 Atlas 硬件,也能在 x86 服务器上通过仿真器运行算子,学习成本几乎为零。

-

开放的实验田 :仓库新增了

experimental目录,鼓励开发者提交自定义算子。这里没有复杂的审核包袱,是你验证新数学公式、尝试新算法的最佳沙盒。

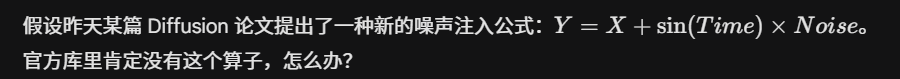

四、AIGC 场景实战:自定义一个"噪声注入"算子

我们完全可以在 experimental 目录下创建一个 SinNoiseAdd 项目。利用 ops-math 提供的基础设施,你只需要关注数学逻辑本身。

伪代码演示:在 experimental 目录下新增算子

cpp

// [Host 端] Tiling 策略 (op_host)

// 负责计算每个核处理多少数据,切分策略是什么

namespace op {

class SinNoiseAdd : public OpDef {

public:

void InferShape(InferShapeContext* ctx) {

// 输出形状与输入 X 一致

ctx->SetOutputShape(0, ctx->GetInputShape(0));

}

// 利用 ops-math 提供的通用 Tiling 模板

void Tiling(TilingContext* ctx) {

// 假设我们简单地将数据平均分给所有 AI Core

auto total_len = ctx->GetInputShape(0).GetShapeSize();

tiling_data.set_total_len(total_len);

tiling_data.set_tile_num(32); // 假设切成32块

// ... 序列化 tiling 参数

}

};

}

// [Device 端] 核函数实现 (op_kernel)

// 运行在 AI Core 上的核心逻辑

extern "C" __global__ void sin_noise_add_kernel(...) {

// 1. 初始化队列与内存

// ... (参考 ops-math 标准模板)

// 2. 计算循环

for (int i = 0; i < tile_num; i++) {

// [CopyIn] 搬运 X, Time, Noise

DataCopy(x_local, x_gm + offset, len);

DataCopy(t_local, t_gm + offset, len);

DataCopy(n_local, n_gm + offset, len);

// [Compute] 数学公式实现

// 这里的 Sin, Mul, Add 都是 Vector 单元的指令

Sin(t_local, t_local, len); // sin(Time)

Mul(n_local, n_local, t_local, len); // sin(Time) * Noise

Add(y_local, x_local, n_local, len); // X + ...

// [CopyOut] 搬运结果

DataCopy(y_gm + offset, y_local, len);

}

}写完这段代码后,你可以直接利用仓库提供的 QuickStart 脚本和 Docker 环境 进行编译和仿真测试。如果性能测试结果(通过 maProf 查看)优秀,你甚至可以发起一个 Pull Request,将你的算子合入仓库,成为贡献者!

五、 结语

ops-math 虽不显山露水,却无处不在。它是昇腾 AI 处理器上被调用频率最高的指令集之一。

无论你是想深入理解 AIGC 的底层原理,还是想入门高性能计算(HPC)开发,Clone 这个仓库,从实现一个简单的 Add 算子开始,都将是你技术进阶的一大步。

相关链接:

-

cann组织链接: https://atomgit.com/cann

-

ops-math仓库链接: https://atomgit.com/cann/ops-math