一 存在的问题

直接运行和使用docker后 推理速度差别很大,都是使用的本地的主机电脑,什么原因:

generator = self.cosyvoice.inference_zero_shot(

result_text,

prompt_text="希望你以后能够做的比我还好呦。",

prompt_wav="./CosyVoice/asset/zero_shot_prompt.wav",

prompt_text=settings.cosy_voice_text,

prompt_wav=settings.cosy_voice_path,

prompt_text="团结同志,这四个字,说起来抽象,但要落实在具体工作当中",

prompt_wav="./wang_voice/study_voice.wav",

stream=True,

text_frontend=False,

)

self.cosyvoice = CosyAutoModel(model_dir='chat_models/CosyVoice2-0.5B')

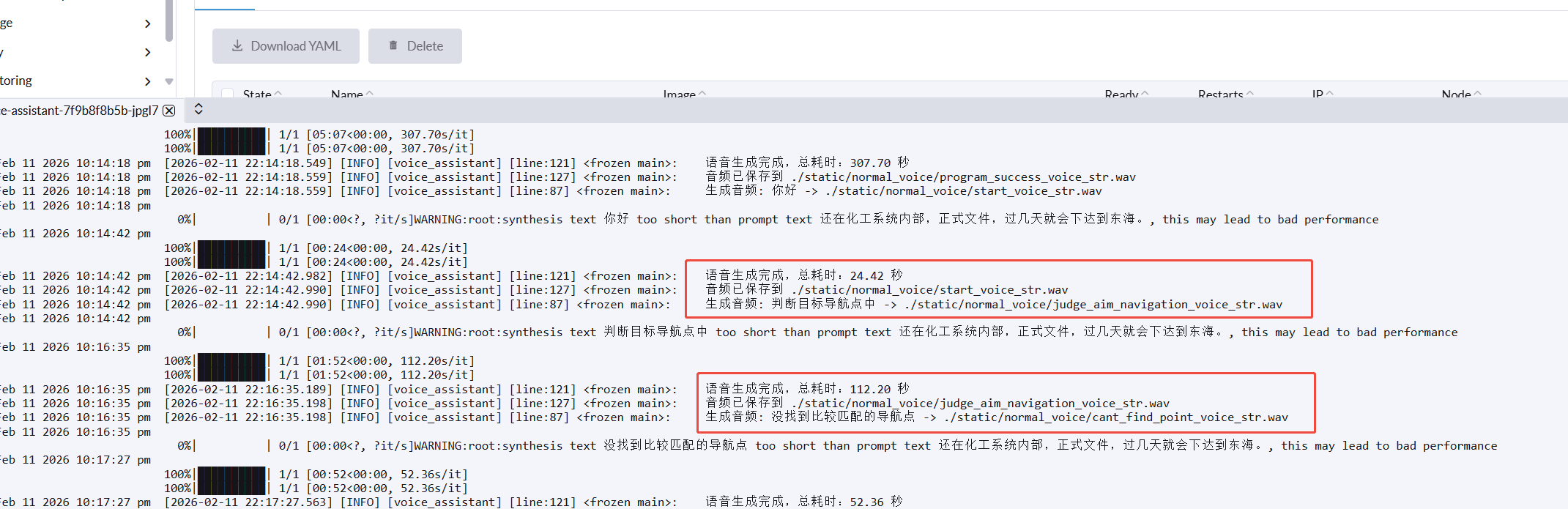

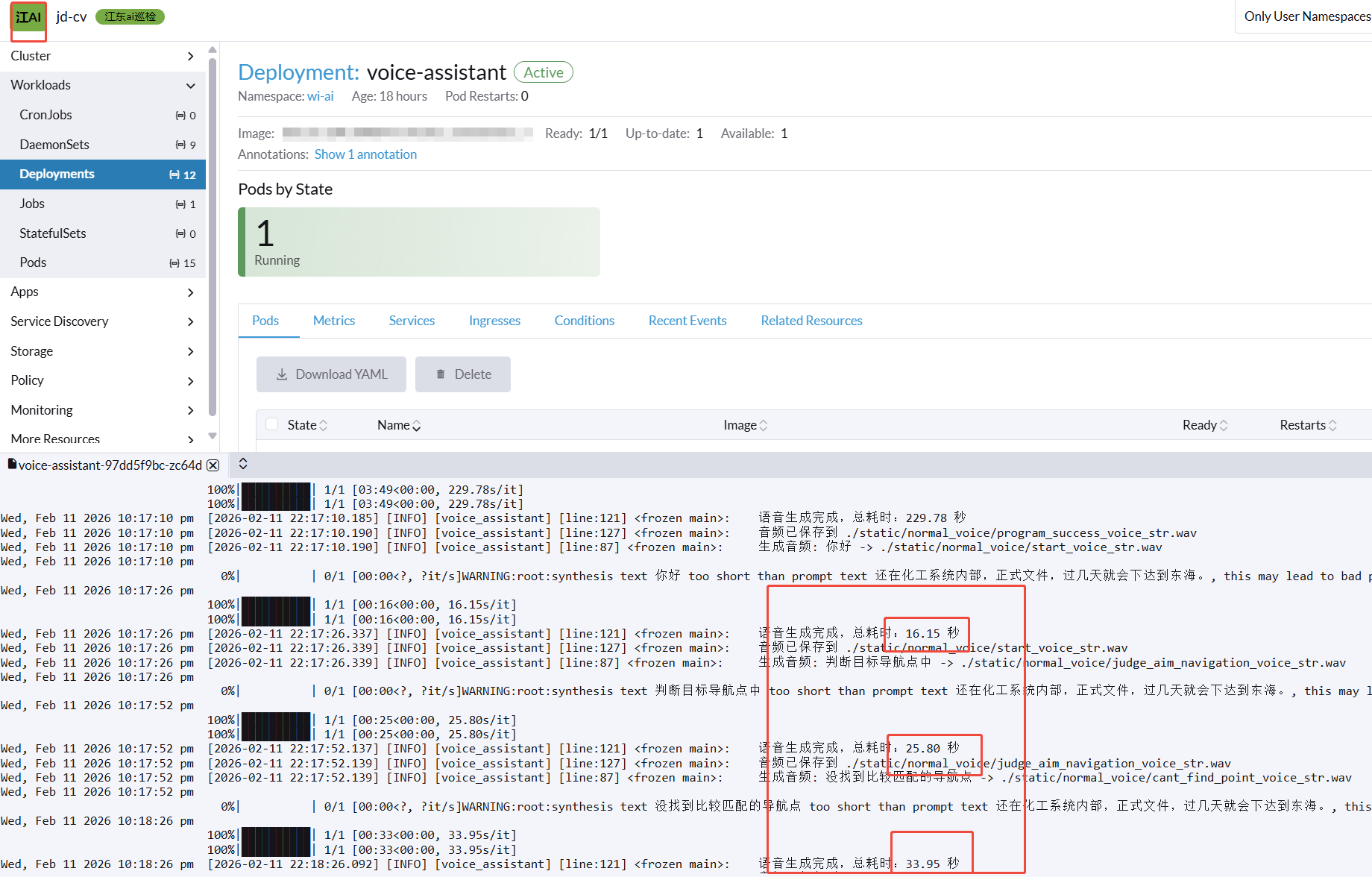

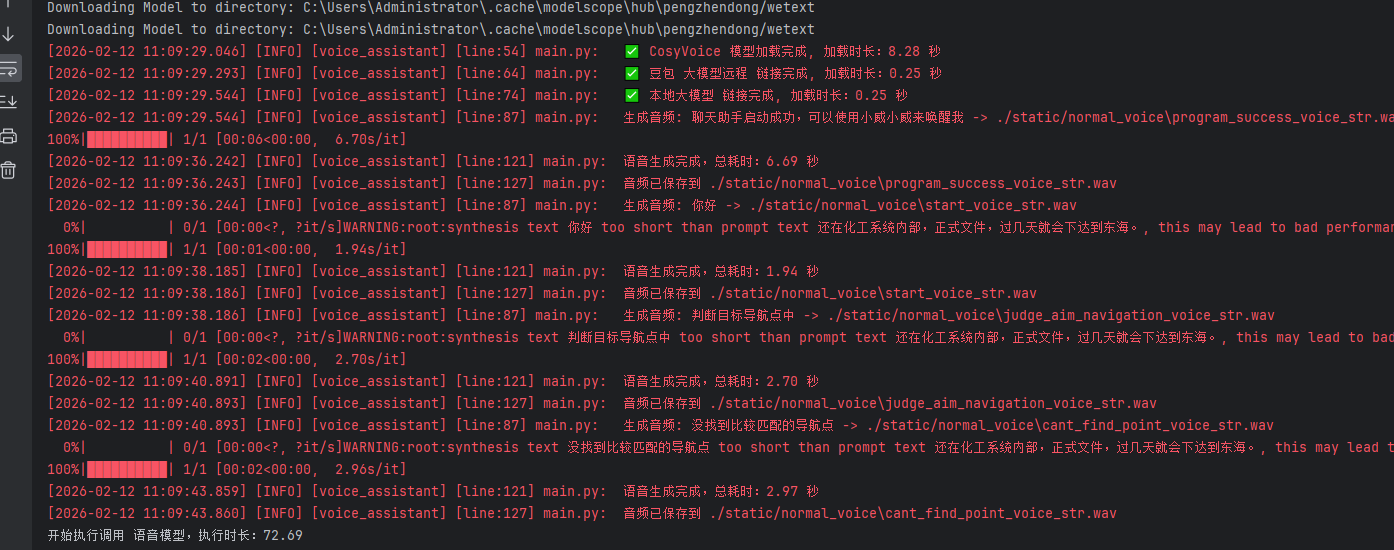

机器狗运行时长:

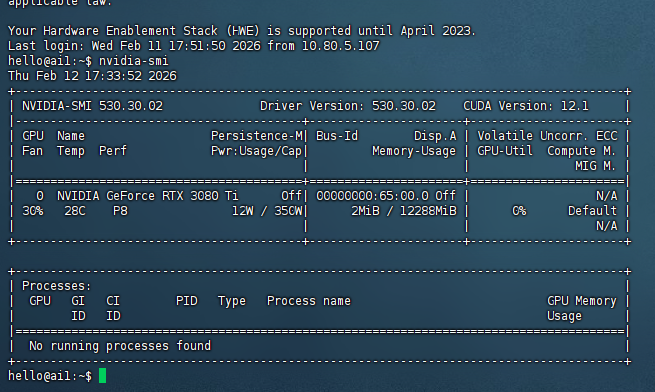

带显卡125 服务器运行时长:

本地运行时长:

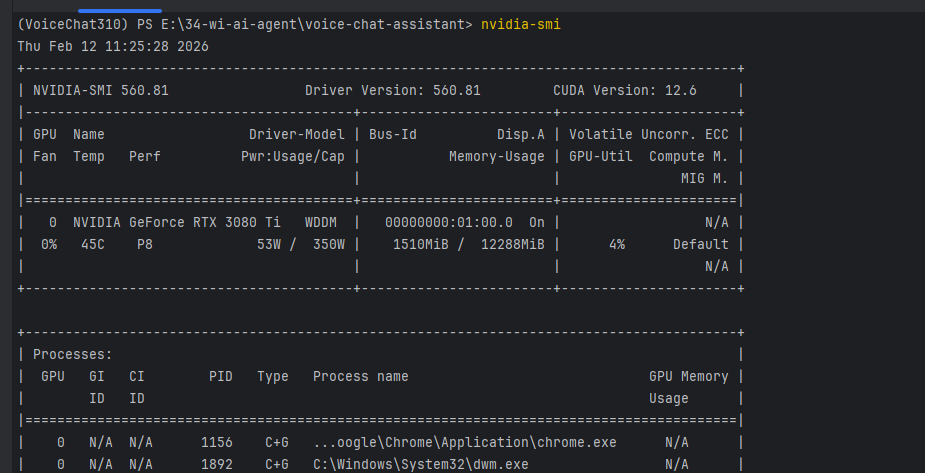

本机电脑配置: