一、研究背景

- 嵌入基推荐模型的主流地位 :协同过滤(CF)和图神经网络(GNN)类嵌入基模型是当前推荐系统的 SOTA 方法,CF 从用户 - 物品交互历史学习嵌入,GNN 通过邻居聚合优化嵌入,均在暖物品(有交互历史) 推荐中表现优异。

- 物品冷启动的核心痛点:互联网中新增物品(直播、短视频、商品等)无交互历史,嵌入基模型无法学习其嵌入;且 GNN 模型因冷物品无邻居,冷启动问题更严重。

- 现有冷启动方法分类

- 生成式模型:将冷物品的内容特征映射为嵌入(如 DeepMusic、MetaEmb),固定暖物品嵌入和推荐器,冷推荐性能受限;

- Dropout 模型:训练中随机丢弃暖物品嵌入以适配冷物品(如 DropoutNet、Heater),冷推荐性能提升但牺牲暖推荐性能。

二、核心问题提出

现有方法的本质缺陷是冷物品嵌入与暖物品嵌入的分布存在显著差异 ,进而引发跷跷板现象(seesaw phenomenon):

- 生成式模型:保暖物品推荐性能,但冷物品嵌入分布与暖嵌入不匹配,冷推荐效果差;

- Dropout 模型:提升冷推荐性能,但破坏了暖物品嵌入的学习,暖推荐效果下降。

论文的核心研究目标:让生成的冷物品嵌入与暖物品嵌入分布一致,同时优化推荐器,实现冷、暖物品推荐性能的共同提升,解决跷跷板现象。

三、方法设计:生成对抗推荐框架(GAR)

GAR 是通用型冷启动框架 ,可适配任意嵌入基推荐模型(CF/GNN),核心是通过生成器(G) 和推荐器(R) 的对抗训练,对齐冷 / 暖物品嵌入分布,同时保留推荐器的原有性能。

3.1 符号定义

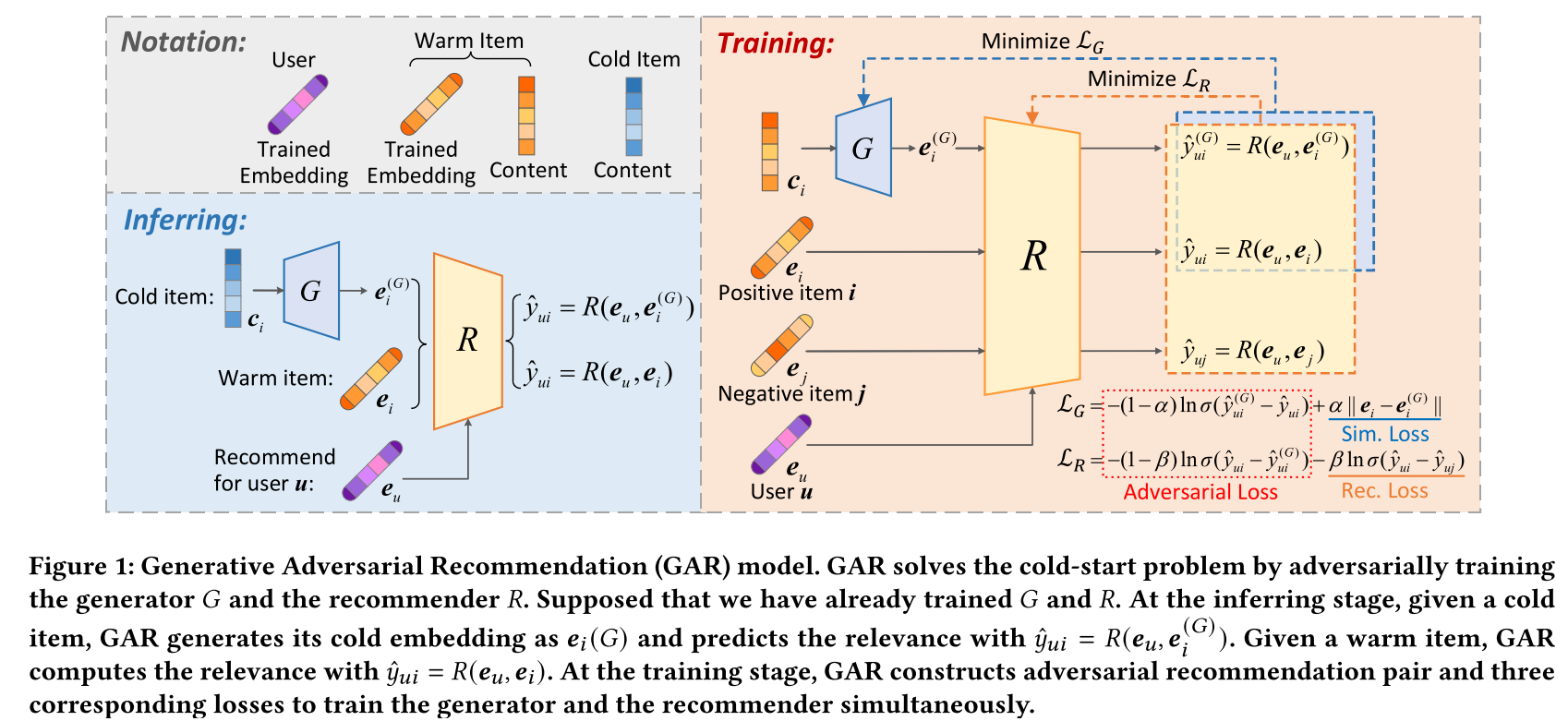

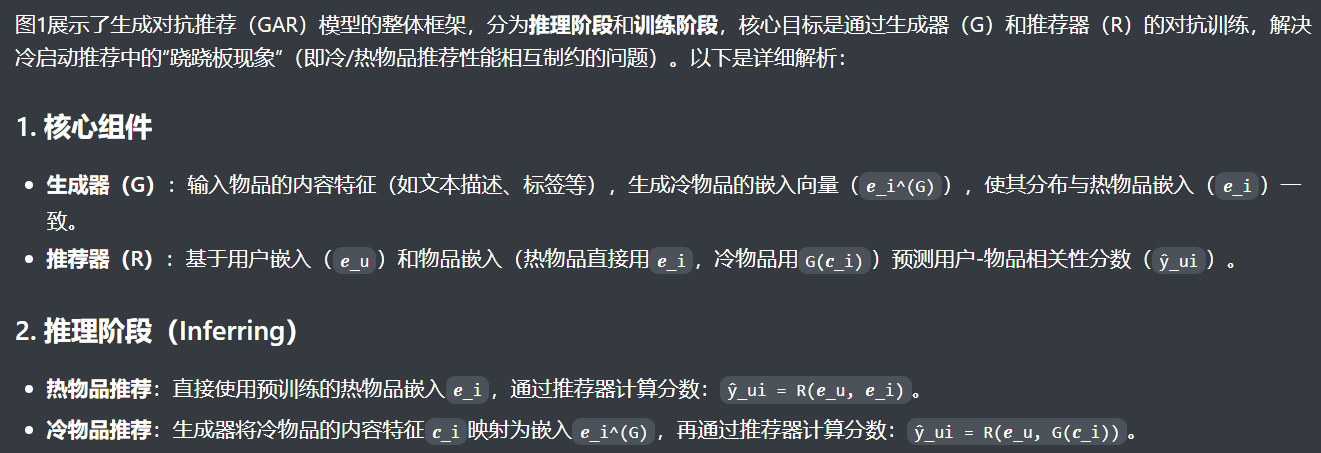

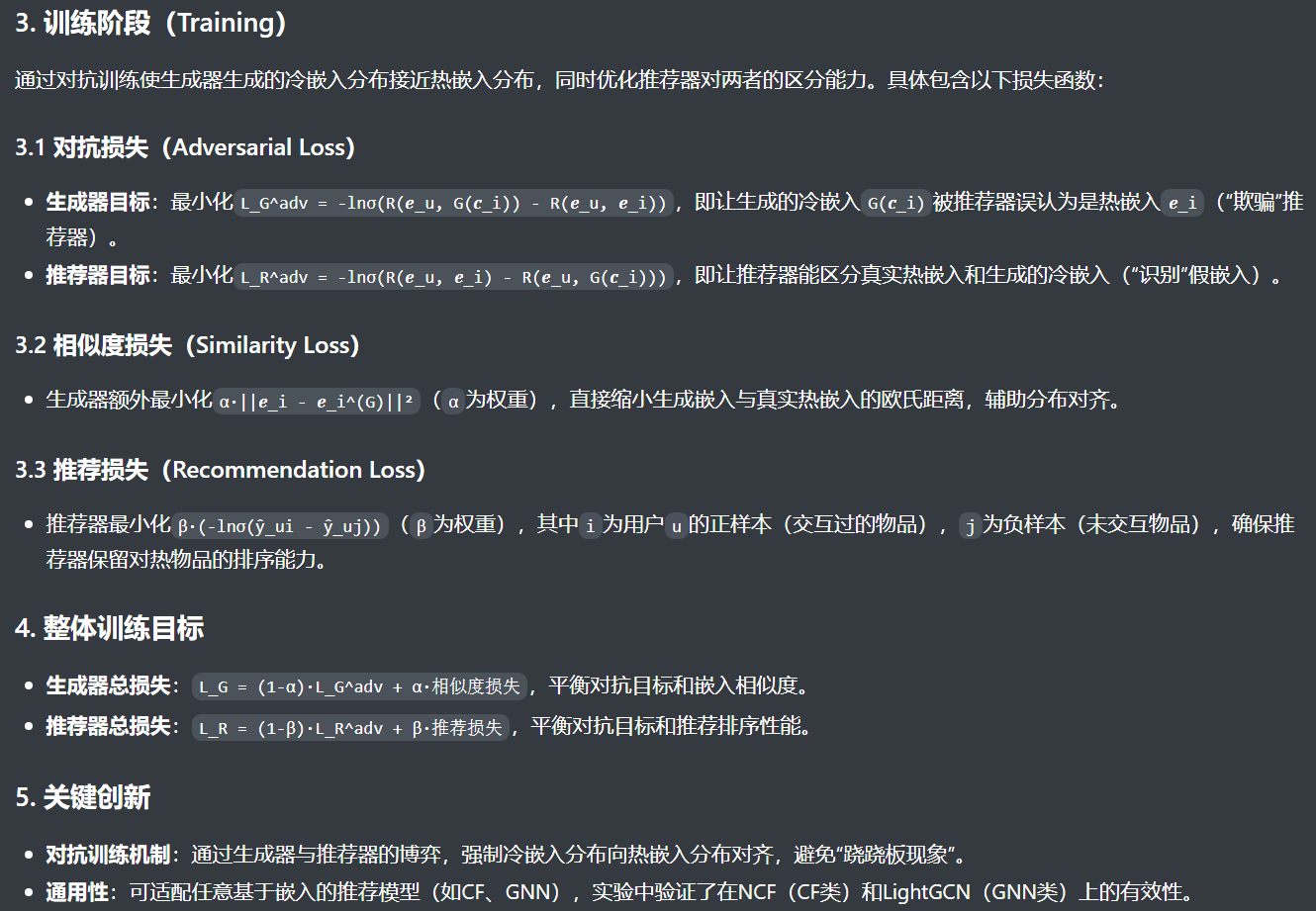

3.2 GAR 整体框架(图 1)

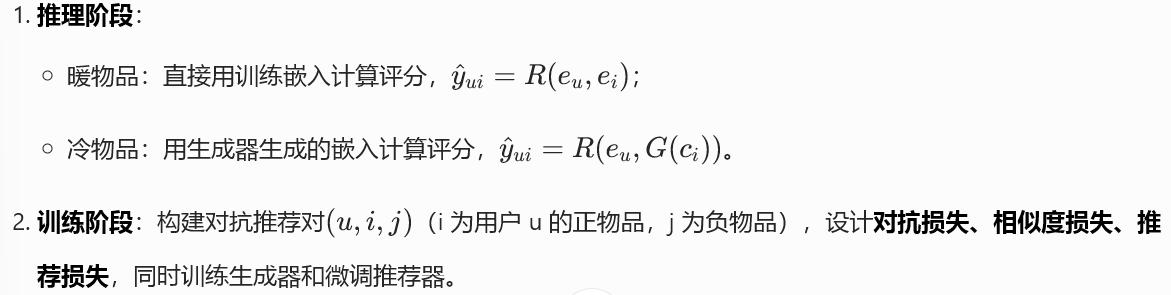

GAR 的训练和推理阶段分工明确,核心通过对抗训练连接生成器和推荐器,并设计三类损失实现联合优化:

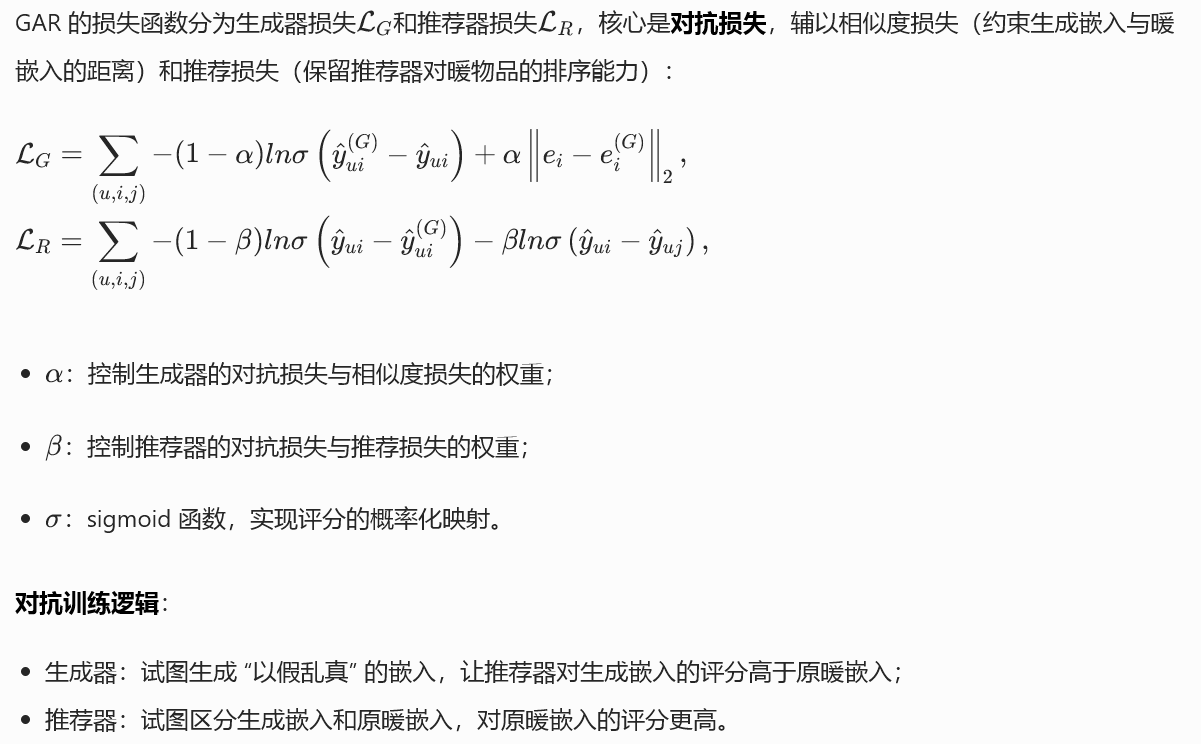

3.3 核心损失函数

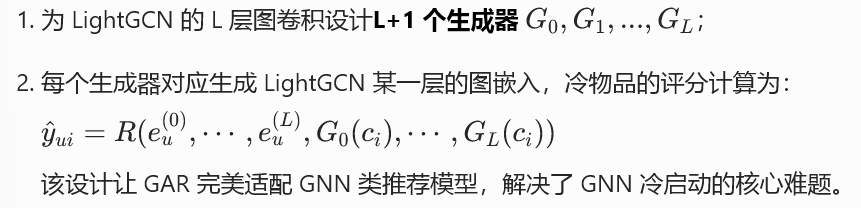

3.4 GAR 适配 GNN 模型的冷启动方案

GNN 模型(如 LightGCN)的嵌入是多层图卷积的聚合结果,冷物品无邻居无法完成卷积,GAR 的适配方案为:

四、实验设计与结果分析

4.1 实验设置

- 数据集 :选用两个公开推荐数据集,80% 为暖物品,20% 为冷物品:

- CiteULike:科学文章推荐,以文章摘要为内容特征;

- XING:职位推荐,以职位属性 / 标签为内容特征。

- 基线模型

- 基础模型:CF 类(NCF)、GNN 类(LightGCN);

- 冷启动 SOTA:生成式(DeepMusic、MetaEmb)、Dropout 式(DropoutNet、Heater)。

- 评价指标:Precision@20、NDCG@20(推荐系统主流 Top-K 评价指标)。

- 超参数:Adam 优化器(lr=0.001),嵌入维度 64,批次大小 1024。

4.2 主实验结果:解决跷跷板现象

核心结论:GAR-CF(适配 CF)和 GAR-GNN(适配 GNN)在整体、冷、暖三个维度的推荐性能均显著优于所有基线,彻底解决跷跷板现象:

- GAR-CF 在 XING 数据集的整体 NDCG@20 上较最优基线提升30.18%,CiteULike 提升 43.82%;

- GAR-GNN 在 CiteULike 数据集的整体 NDCG@20 上较 LightGCN 提升17.78%,XING 提升 19.21%;

- GAR 在提升冷推荐性能的同时,几乎不损失暖推荐性能,而 Dropout 基线(Heater/DropoutNet)的暖推荐性能显著下降。

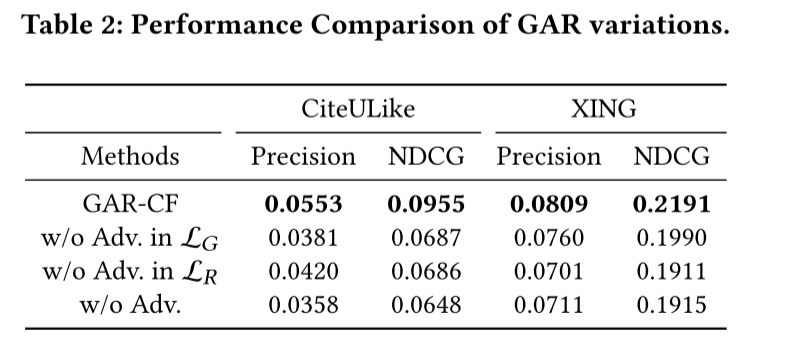

4.3 消融实验:验证对抗损失的必要性(表 2)

为验证对抗损失的核心作用,设计 GAR 的三个变体(移除生成器 / 推荐器的对抗损失、同时移除两者),实验结果表明:

- 原始 GAR 的性能远优于所有变体;

- 移除任意一方的对抗损失都会导致性能显著下降,破坏生成器与推荐器的对抗关系;

- 同时移除对抗损失后,模型性能降至最低,证明对抗训练是 GAR 的核心。

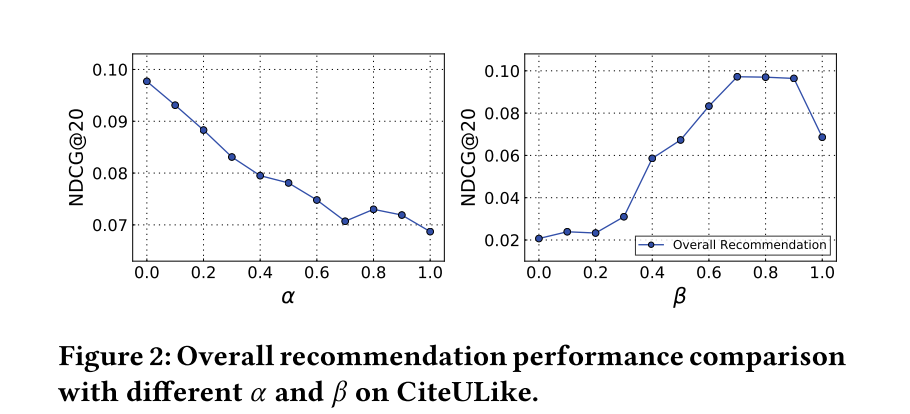

4.4 超参数分析:α 和 β 的影响(图 2)

实验探究了损失权重 α(0~1)和 β(0~1)对模型性能的影响,核心结论:

- 生成器的最优值为α=0.0:对抗损失比相似度损失更重要,仅用对抗损失即可实现冷 / 暖嵌入分布的对齐;

- 推荐器的最优值为β=0.7:结合对抗损失和推荐损失的效果最优,既完成嵌入区分,又保留暖物品排序能力。

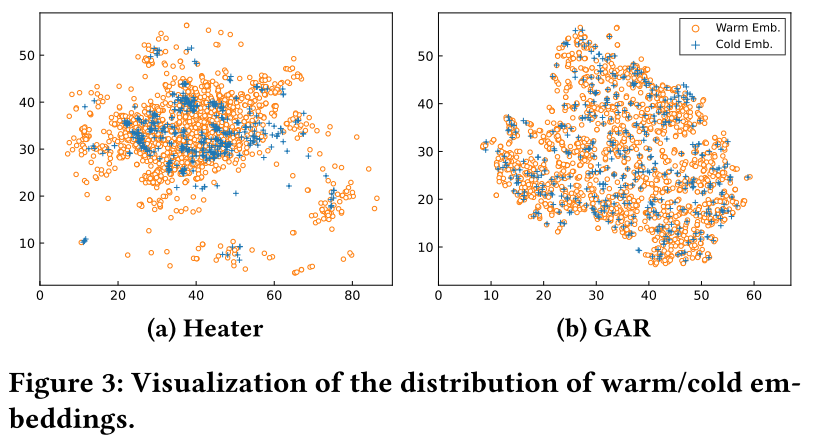

4.5 案例研究:嵌入分布可视化(图 3)

通过t-SNE将高维嵌入降维至 2 维,对比 GAR 和最优基线 Heater 的冷 / 暖嵌入分布,结果如下:

(a) Heater:冷物品嵌入与暖物品嵌入的分布差异显著,是其暖推荐性能下降的根本原因;

(b) GAR:冷物品嵌入与暖物品嵌入的分布几乎完全重合 ,验证了对抗训练实现了嵌入分布的对齐。

五、论文的核心贡献

- 提出新问题 :明确指出现有冷启动方法的跷跷板现象,并将其归因于冷 / 暖物品嵌入的分布差异,为冷启动研究提供了新的切入点;

- 提出通用框架 GAR:通过生成器 - 推荐器的对抗训练对齐冷 / 暖嵌入分布,从根本上解决跷跷板现象,实现冷 / 暖推荐性能的协同提升;

- 适配 GNN 冷启动:针对 GNN 模型的多层图嵌入特性,设计多生成器适配方案,解决了 GNN 模型冷启动更严重的难题;

- 充分的实验验证:在两个数据集上验证了 GAR 对 CF/GNN 模型的适配性,消融实验和可视化实验充分证明了方法的有效性,且代码开源。

六、学习总结与展望

6.1 核心总结

- GAR 的核心创新是将生成对抗思想引入推荐系统冷启动,通过对抗训练实现嵌入分布对齐,而非传统的 "映射 / 丢弃" 思路,为冷启动问题提供了新的解决范式;

- GAR 的通用性是其重要优势,可直接适配任意嵌入基推荐模型,无需对原模型做大幅修改,具有很强的工业落地潜力;

- 实验充分验证了 "分布差异是跷跷板现象的根源",证明了嵌入分布对齐是解决物品冷启动的关键。

6.2 研究展望

- 可将 GAR 拓展至用户冷启动场景,结合用户的内容特征(画像、行为偏好)生成用户嵌入,解决用户冷启动问题;

- 可融合多模态内容特征(文本、图片、视频)提升生成器的嵌入生成能力,适配更复杂的推荐场景;

- 可优化对抗训练的效率,解决大尺度数据集下 GAR 的训练耗时问题,进一步提升工业落地性。

6.3 启发

- 推荐系统的冷启动问题本质是数据缺失导致的嵌入学习困难,解决思路可从 "补全嵌入" 转向 "对齐嵌入分布";

- 跨领域思想的融合(如 GAN 与推荐系统)是推荐算法创新的重要方向,可借鉴其他领域的经典框架解决推荐系统的痛点问题;

- 通用型框架的设计更具研究和应用价值,GAR 无需修改原推荐器的结构,仅通过对抗训练微调,更易在工业系统中部署。

附 :论文开源代码地址:https://github.com/zfnWong/GAR