在Windows上部署Dify

一、配置环境

本地安装dify,需要先安装docker desktop,要安装docker desktop,需要安装wsl(windows下的linux系统)

|-------------------------------------------------------------------|------------------------------------------------------|

| 16GB 内存 | 24G内存 |

| * 能跑:Qwen3-4B(完美) * 能跑:Qwen3-8B(勉强能用) * 不能跑:14B / 32B | * 4B/8B:随便跑、丝滑 * 14B:Int4 可跑、够用 * 32B:别想 |

| | |

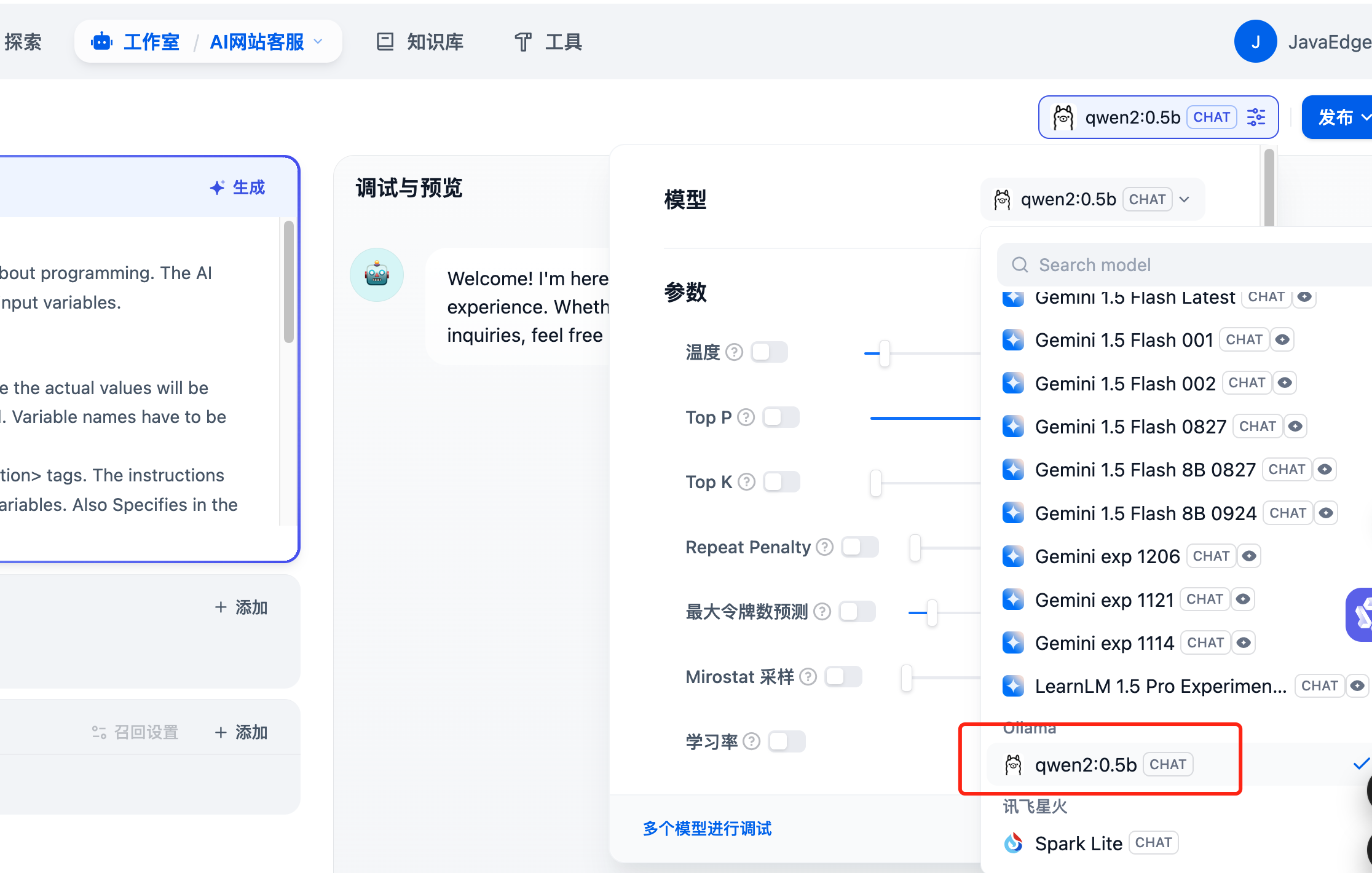

1、检查虚拟化是否已经开启

打开任务管理器(Ctrl + Shift + Esc),在 性能-CPU 界面查看是否开启虚拟化

注意:如果没有开启,需要重启电脑进入BIOS开启虚拟化

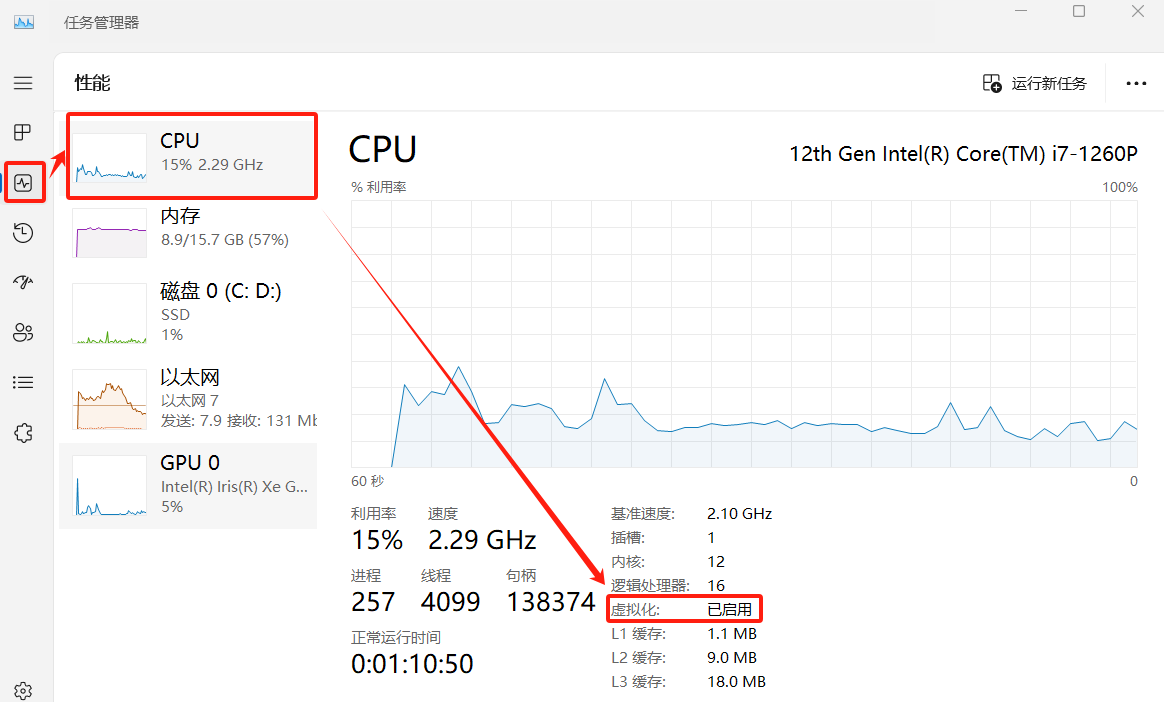

2、安装wsl2

右键windows图标 ➡️ 选择终端管理员 ➡️ 在终端管理员(PowerShell)中输入 wsl --version

如果没有安装wsl,则输入命令 wsl --install

等待系统安装Linux子系统和WSL2内核

二、安装Docker Desktop

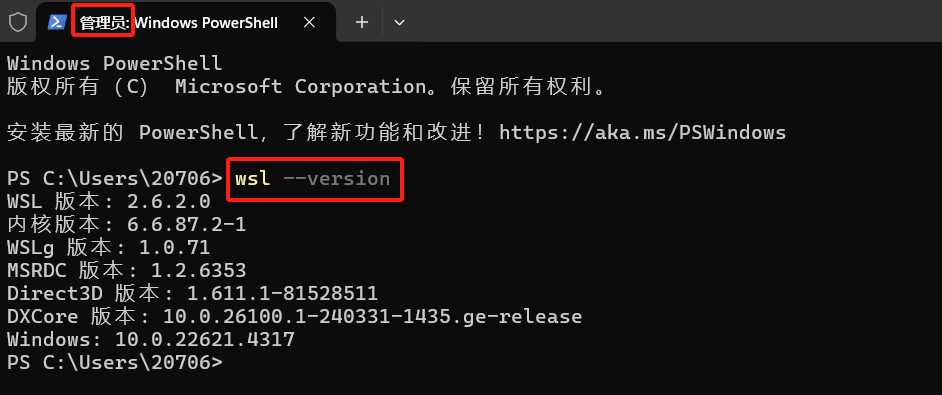

1、检查电脑属于AMD64还是ARM64

按 Win + R 键,输入 cmd 并按回车,打开命令提示符;

输入以下命令并按回车

echo %PROCESSOR_ARCHITECTURE%

- 如果返回 AMD64,则为 AMD64/x64 架构。

- 如果返回 ARM64,则为 ARM64 架构

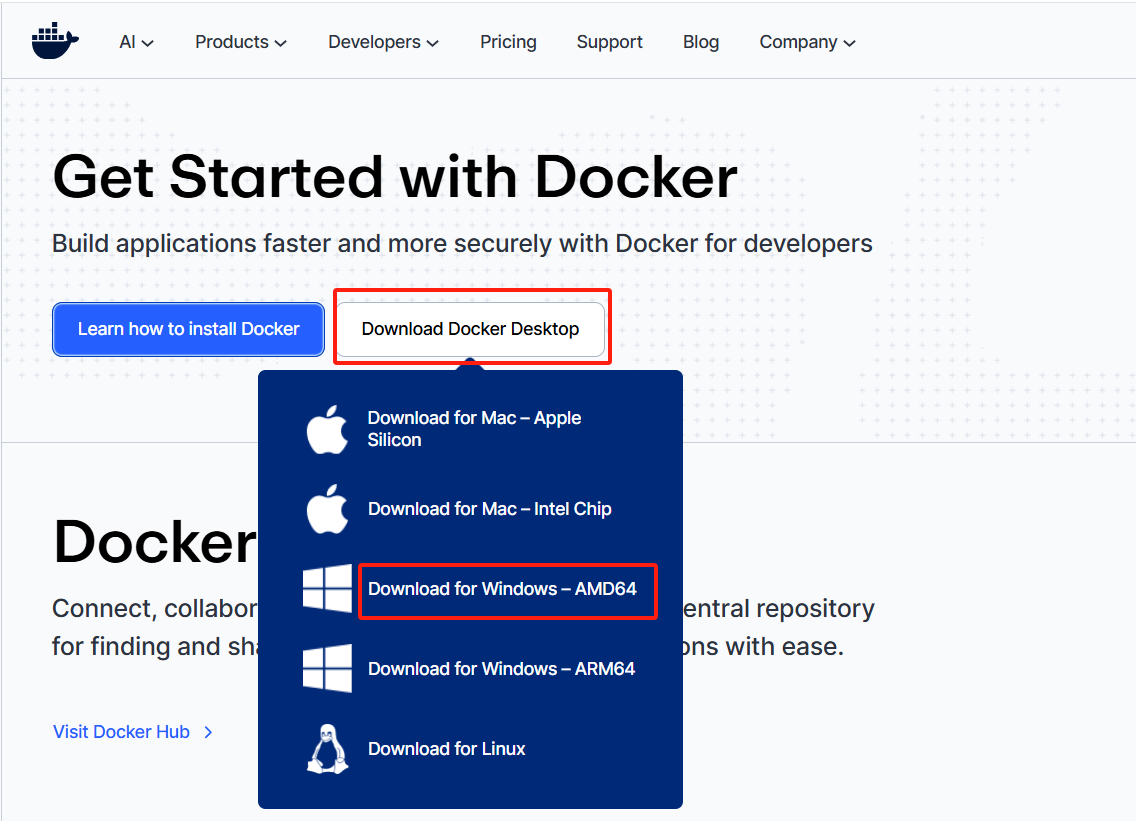

2、下载docker desktop

前往 Docker官方页面 或点击下方版本链接直接下载合适的版本

3、安装

3.1、安装方法一

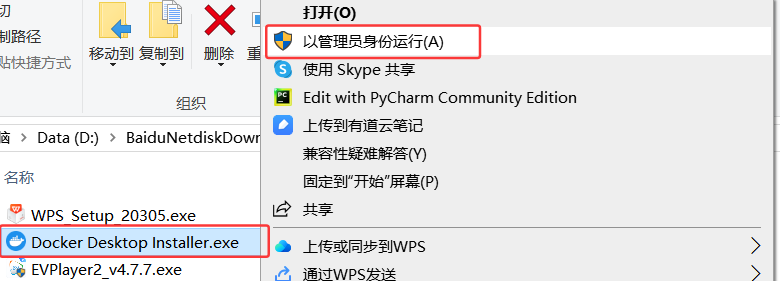

选中下载好的Docker Desktop Installer.exe 安装包,右键管理员运行(避免后面权限问题,导致docker启动不了)

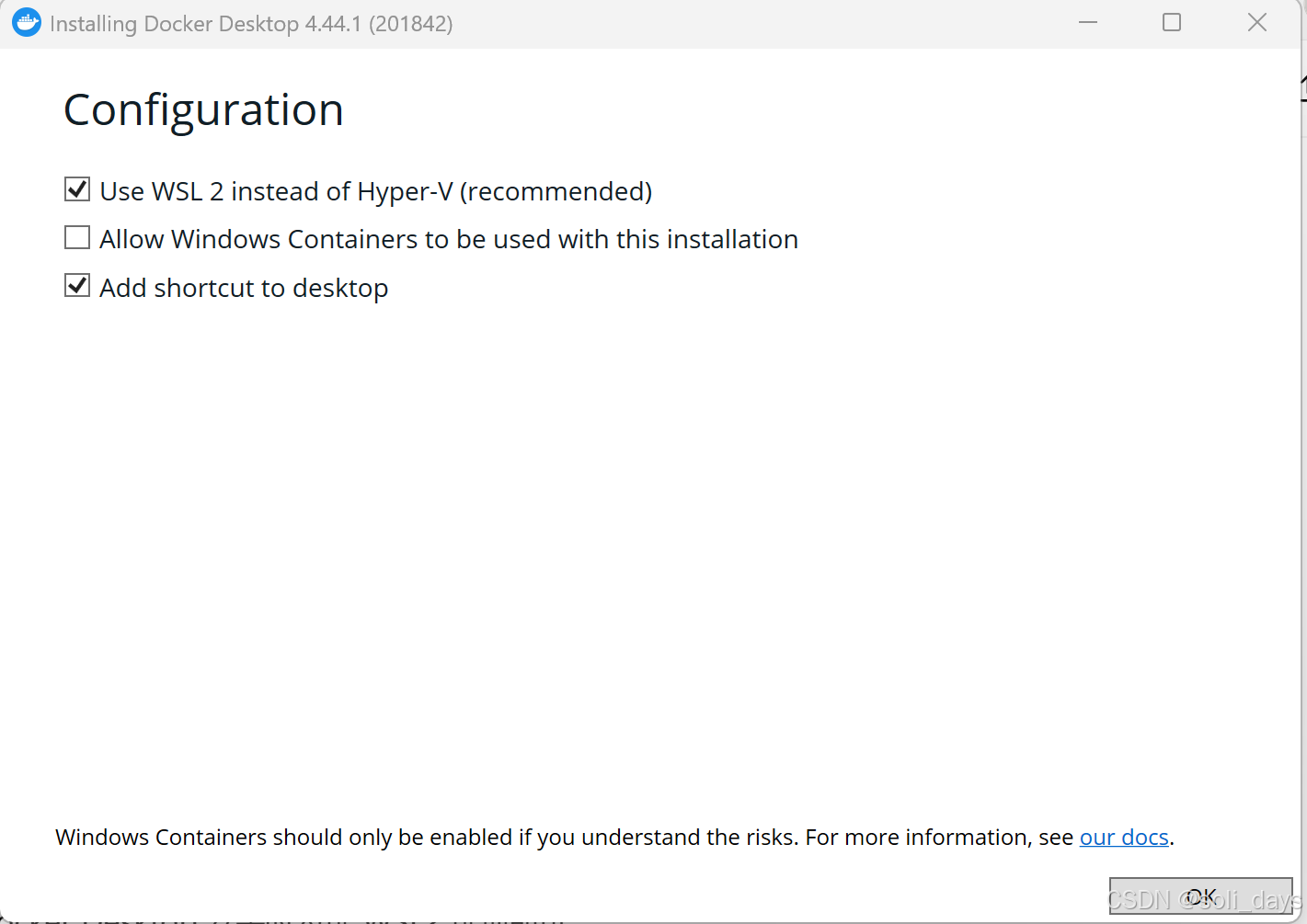

按上图所示勾选,点击 OK 开始安装

安装完成后会提示 重启电脑

3.2、安装方法二

C盘空间如果没有很大,可以按这种方式安装在其他盘。

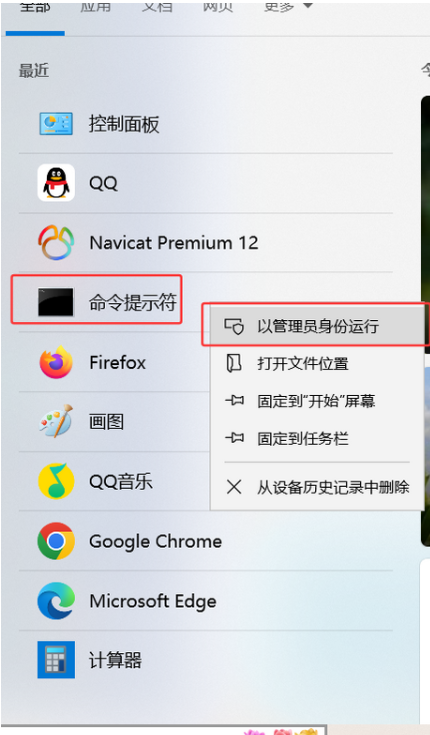

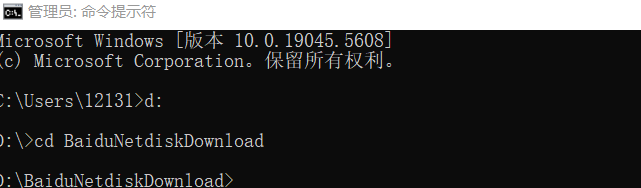

1)、以管理员身份打开windows命令提示符窗口

2)、切换到下载安装包的目录位置

3.3)、输入如下命令,回车

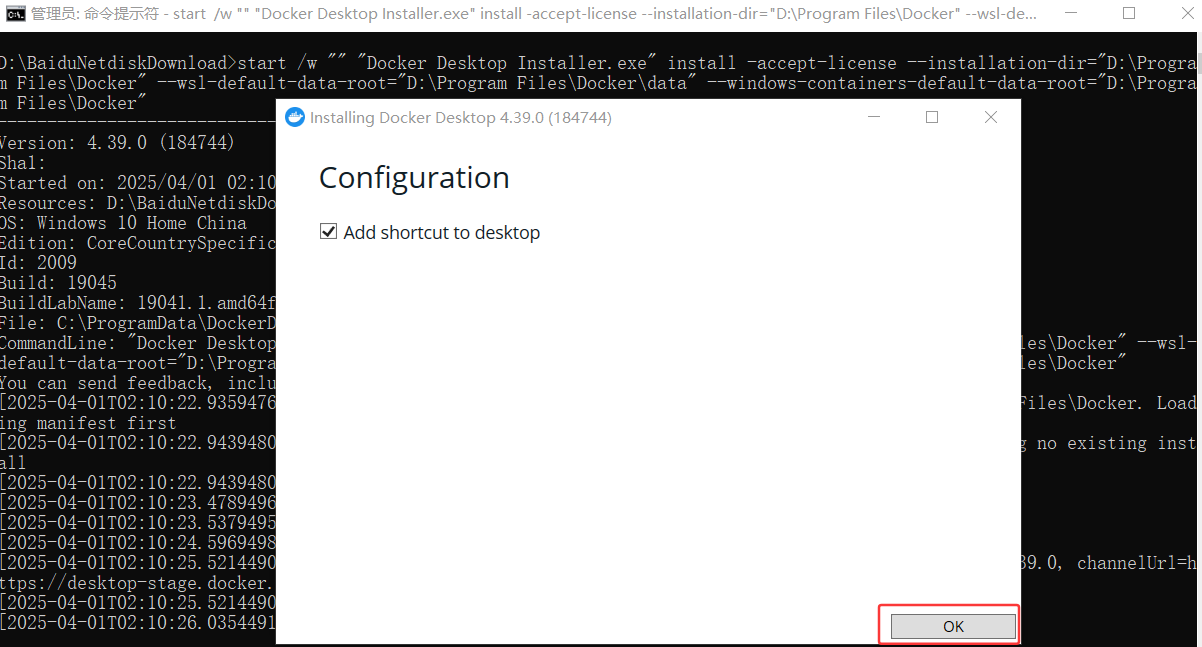

start /w "" "Docker Desktop Installer.exe" install -accept-license --installation-dir="D:\Program Files\Docker" --wsl-default-data-root="D:\Program Files\Docker\data" --windows-containers-default-data-root="D:\Program Files\Docker"

以上,第1个D:\Program Files\Docker 是Docker DeskTop的安装目录;D:\Program Files\Docker\data是Docker用于存储镜像、容器等数据的目录。最后1个D:Program Files\Docker,表示在Windows操作系统中,Docker程序将被安装在D盘的ProgramFiles文件夹内的一个名为Docker的子文件夹中。

注意 :运行代码之前,提前创建好对应文件夹D:\Program Files\Docker、D:\Program Files\Docker\data,可能会报错

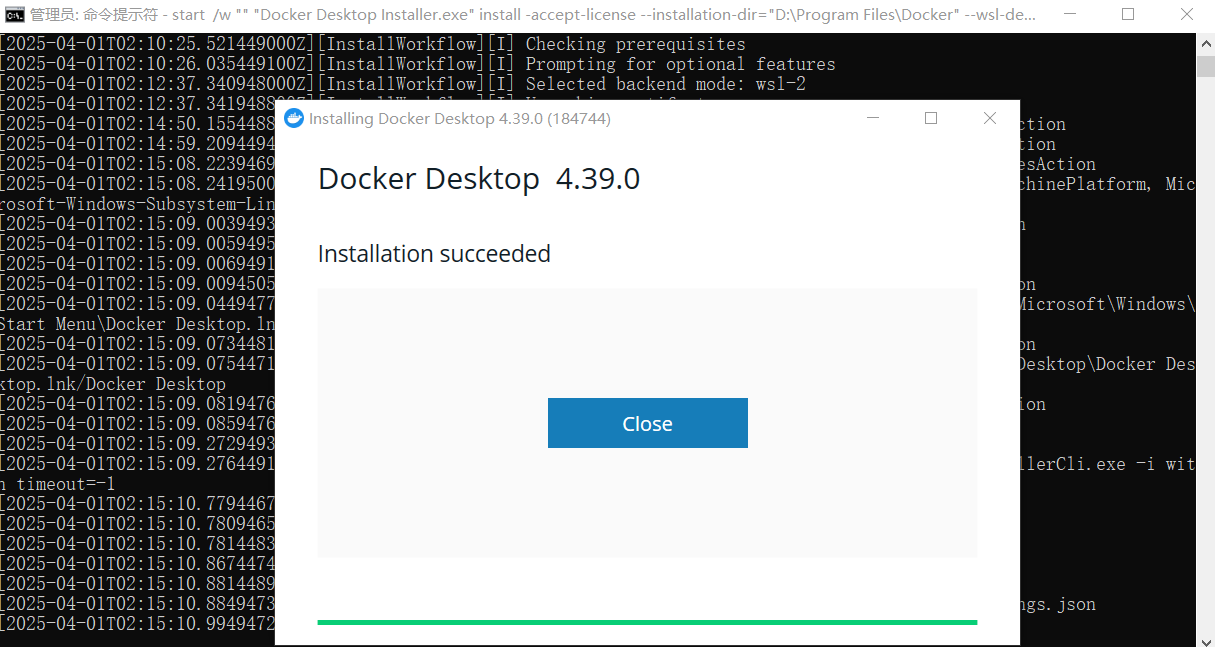

弹出窗口,选 OK,等待安装完毕,安装成功后,关闭。

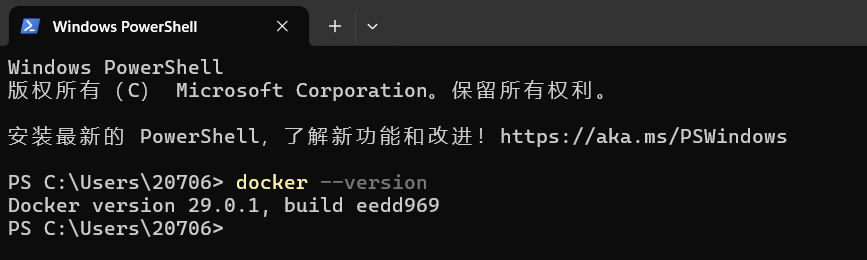

4、验证是否安装成功

打开 PowerShell 或 CMD ,输入 docker --version

如果显示版本号则说明安装成功。

5、启动docker desktop

安装完毕后,在桌面找到docker desktop图标,然后右键以管理员身份运行。自动弹出接受服务协议。

点击 Accept, 允许控制

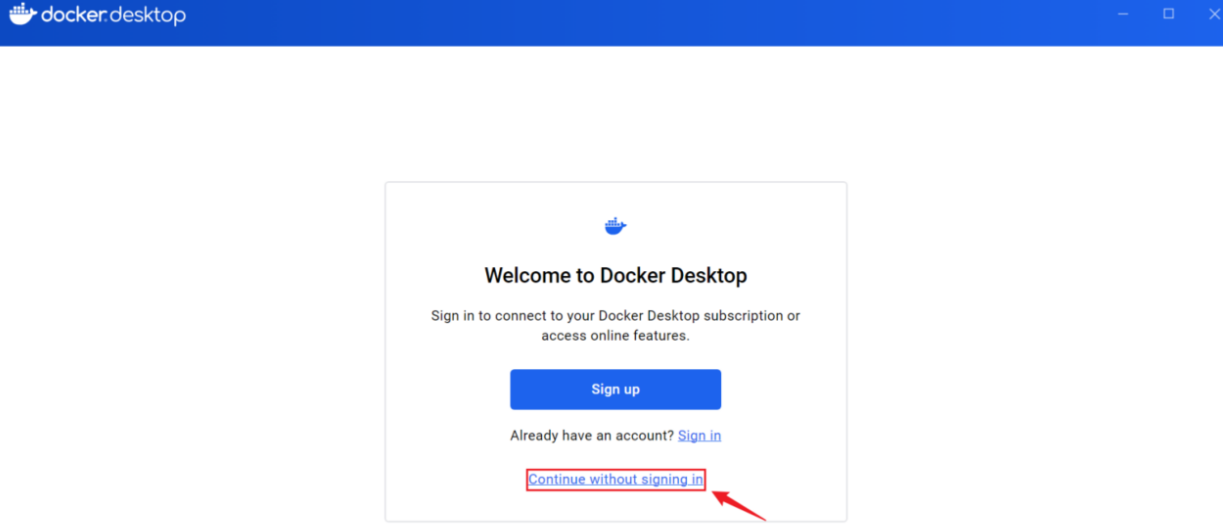

不登录使用

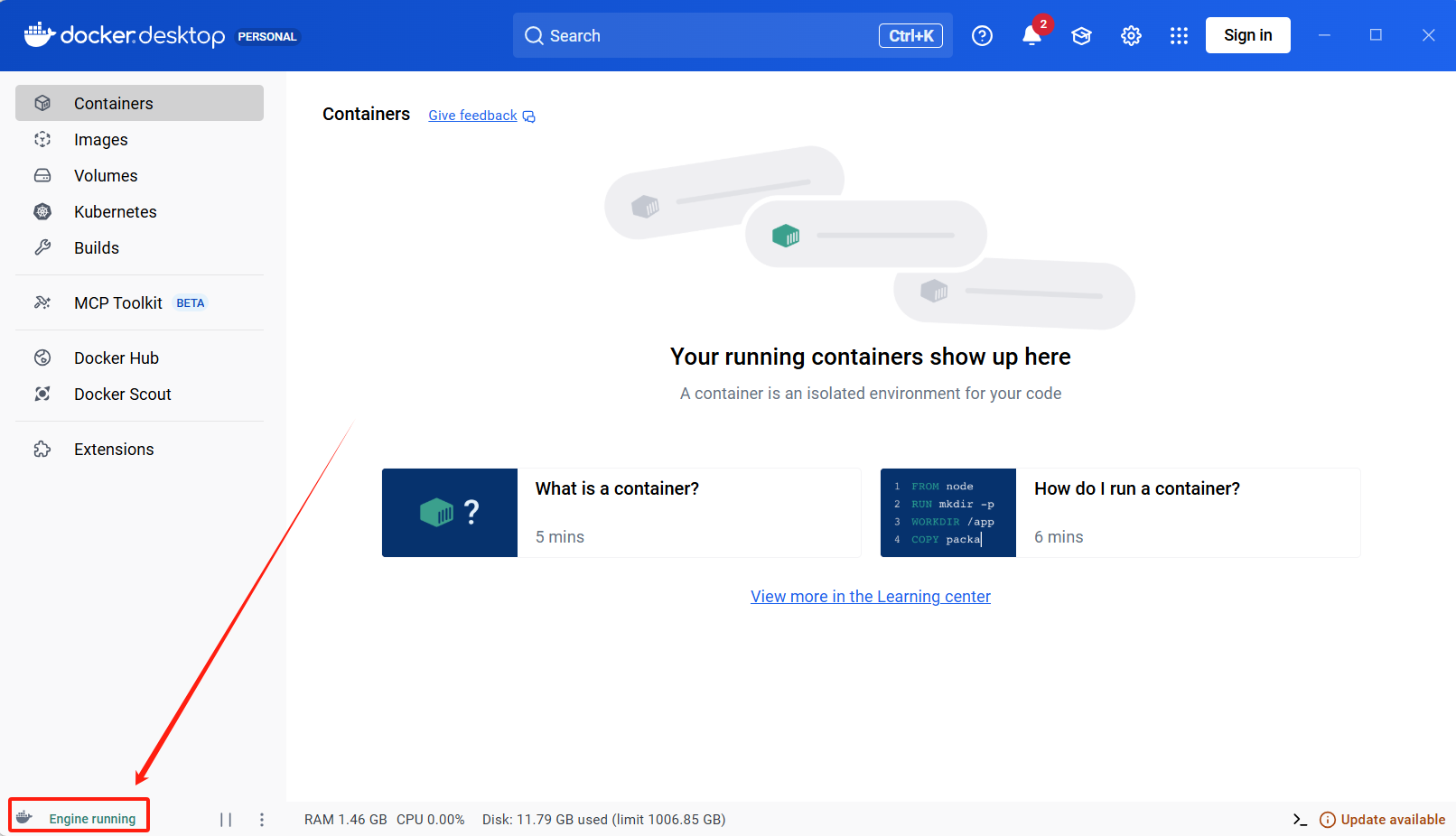

docker启动并进入docker desktop应用,左下角能看到 Engine running的状态。

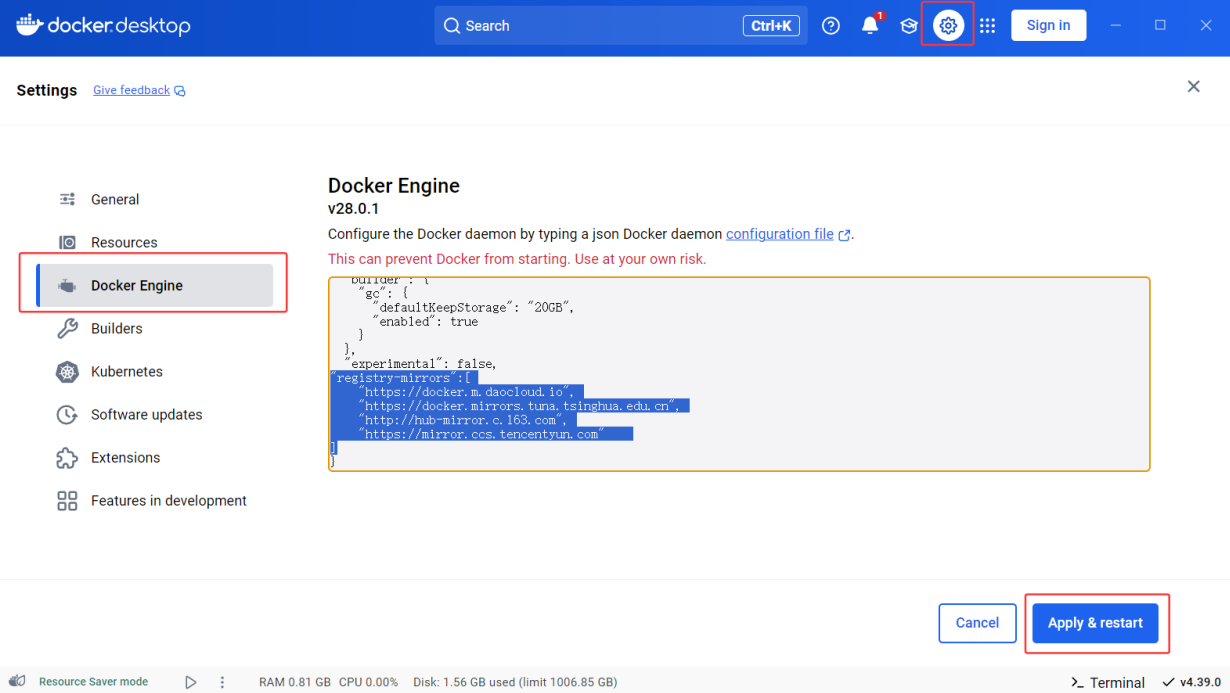

6、docker desktop配置国内镜像源

为了防止拉取镜像时超时,需要配置国内的镜像源。

右上角设置 - Docker Engine ,新增如下内容,点击 Apply & restart

"registry-mirrors":[

"http://mirrors.aliyun.com/pypi/simple/",

"https://docker.m.daocloud.io",

"https://docker.mirrors.tuna.tsinghua.edu.cn",

"http://hub-mirror.c.163.com",

"https://mirror.ccs.tencentyun.com"

]7、重启Docker DeskTop

三、安装dify

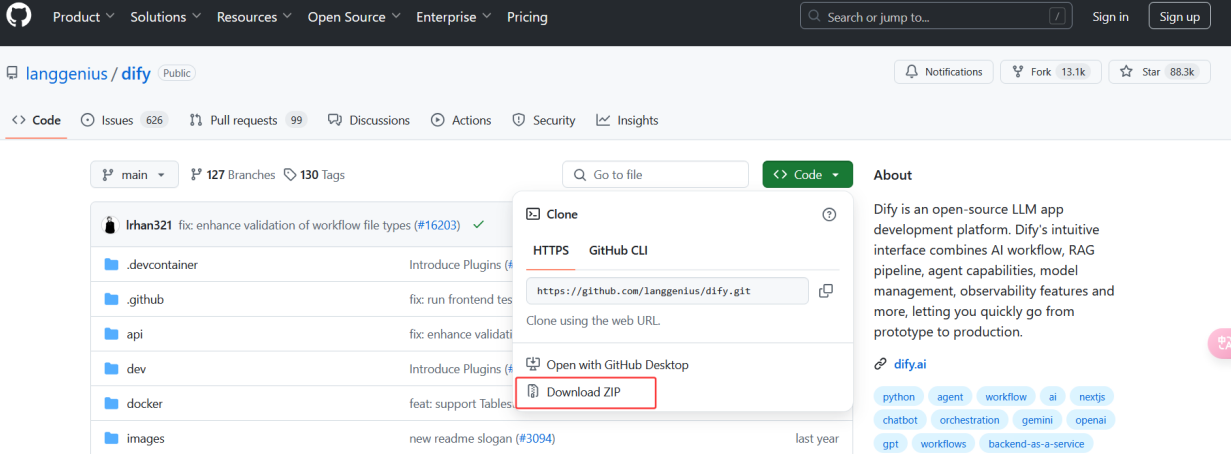

1、下载Dify压缩包

按照readme文档进行操作

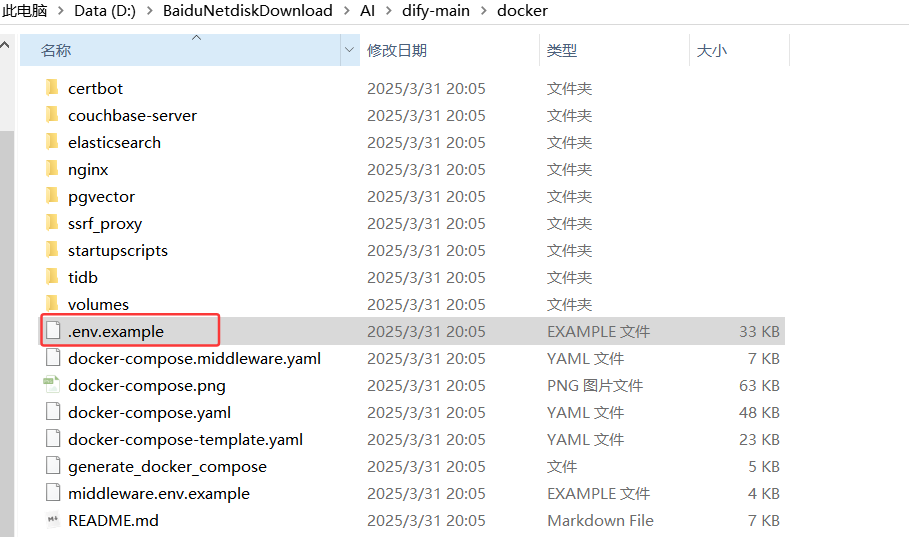

2、修改配置

进入dify解压目录下的docker目录,修改.env.example为.env

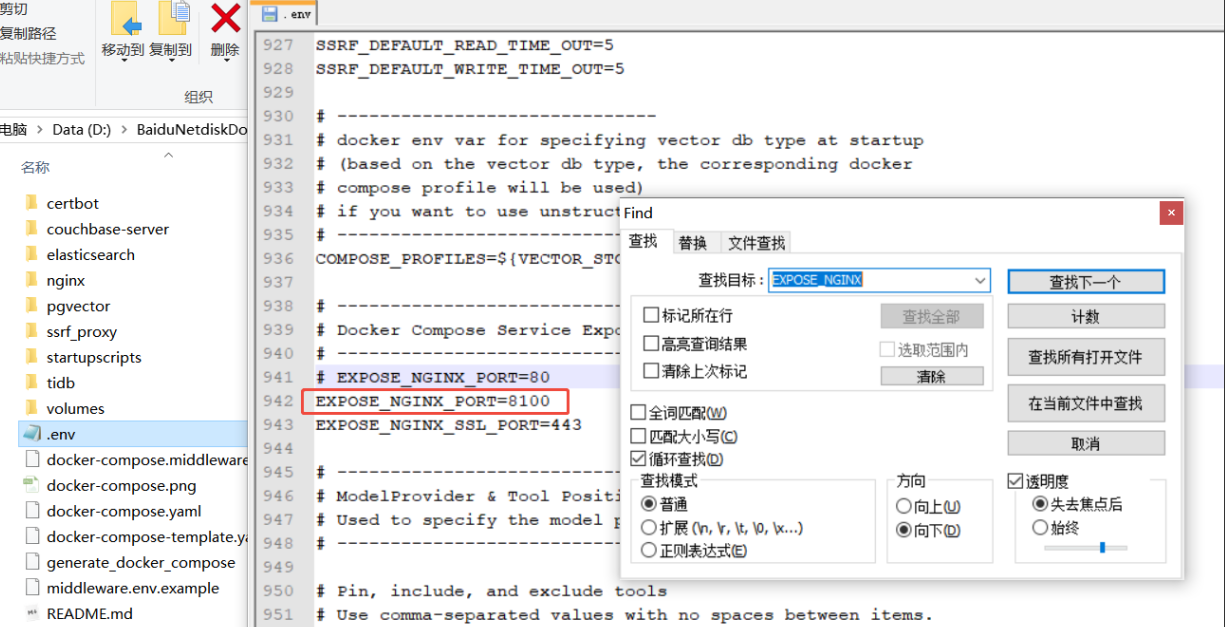

补充:修改dify页面端口

原因:如果win系统上有服务占用80或443端口的话,那么这里注意下修改dify的端口,以免端口冲突。

打开.env配置文件,找到NGINX_PORT和NGINX_SSL_PORT配置项,默认的值是80和443,这两个配置项是dify在我们的docker内部的端口,这两个值可以考虑不变,也可以同步调整。

继续找EXPOSE_NGINX_PORT和EXPOSE_NGINX_SSL_PORT配置项,默认值也是80和443,这两个配置项是dify对外映射的两个端口,这两个值必须更改,我这改成了8100和6443:

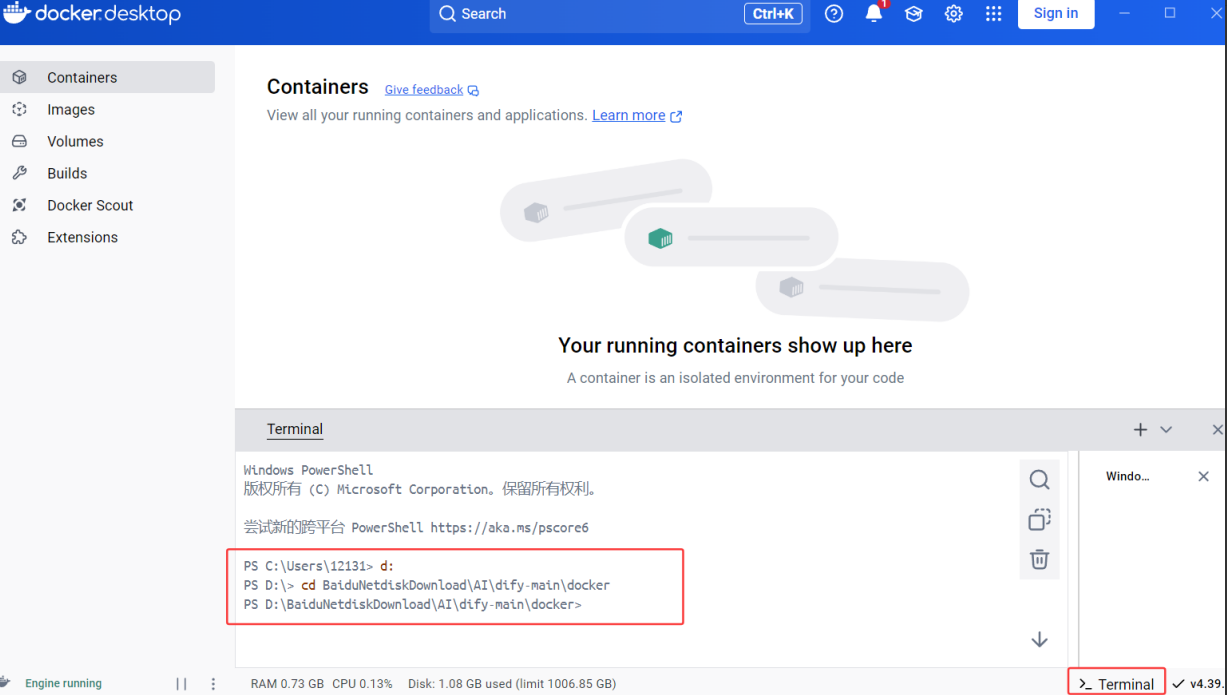

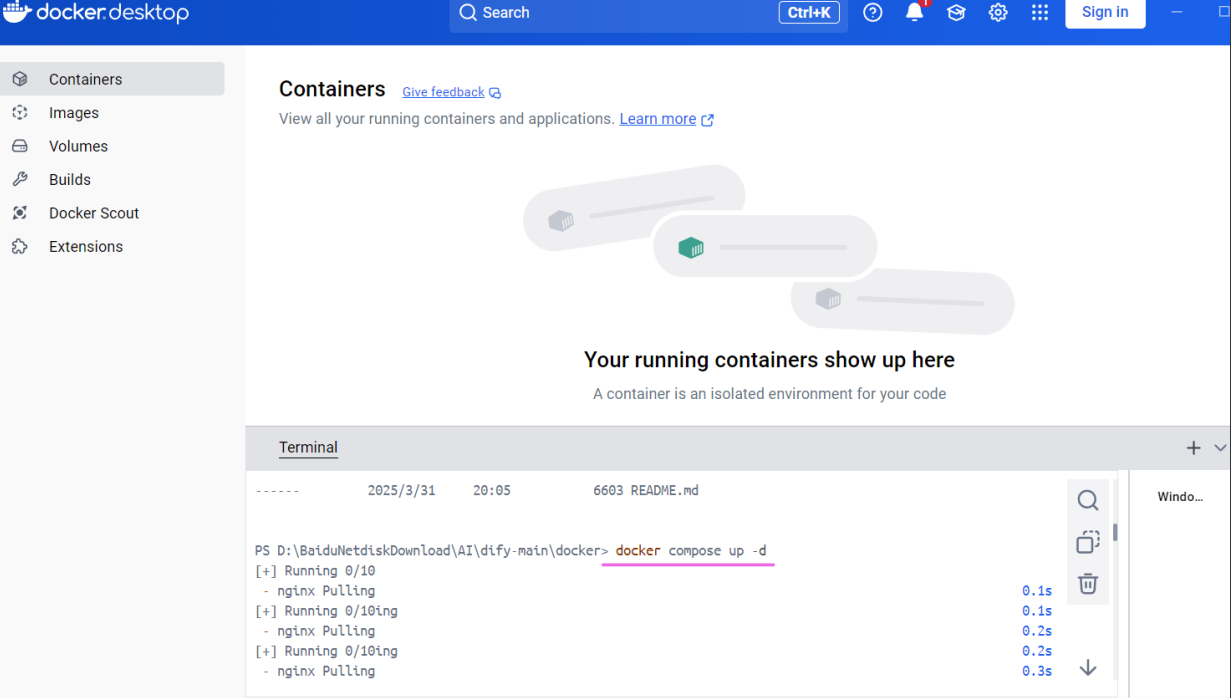

3、打开docker终端,安装dify

切换到dify的docker目录,执行docker compose up -d

注意 :安装过程中,某些镜像过大,因为网络不稳定导致下载中断。针对这种情况,可以先单独下载这些镜像,然后再执行命令docker compose up -d

✔ db_postgres Pulled 24.6s

- worker_beat [⠀⣿⣿⠀⠀⠀⠀⠀⠀⣶⣿⠀⠀⣿] Pulling 101.6s

✔ weaviate Pulled 22.6s

✔ nginx Pulled 18.4s

✔ redis Pulled 20.4s - plugin_daemon [⣶⣷⠀] 139.5MB / 524.3MB Pulling 101.6s

- sandbox [⣄⣤⣿⣿⣿⣤⣿⣿⣤⣿] 85.98MB / 171.4MB Pulling 101.6s

- web [⡀⠀⠀⠀⠀⠀⠀⠀⠀⠀⠀⠀] Pulling 101.6s

✔ ssrf_proxy Pulled 28.3s

failed to copy: httpReadSeeker: failed open: could not fetch content descriptor sha256:9c936843e78d4ded7fd1f6d746e32ca82fc2f58657d2ef842740f4a58af4d97e (application/vnd.oci.image.layer.v1.tar+gzip) from remote: not found

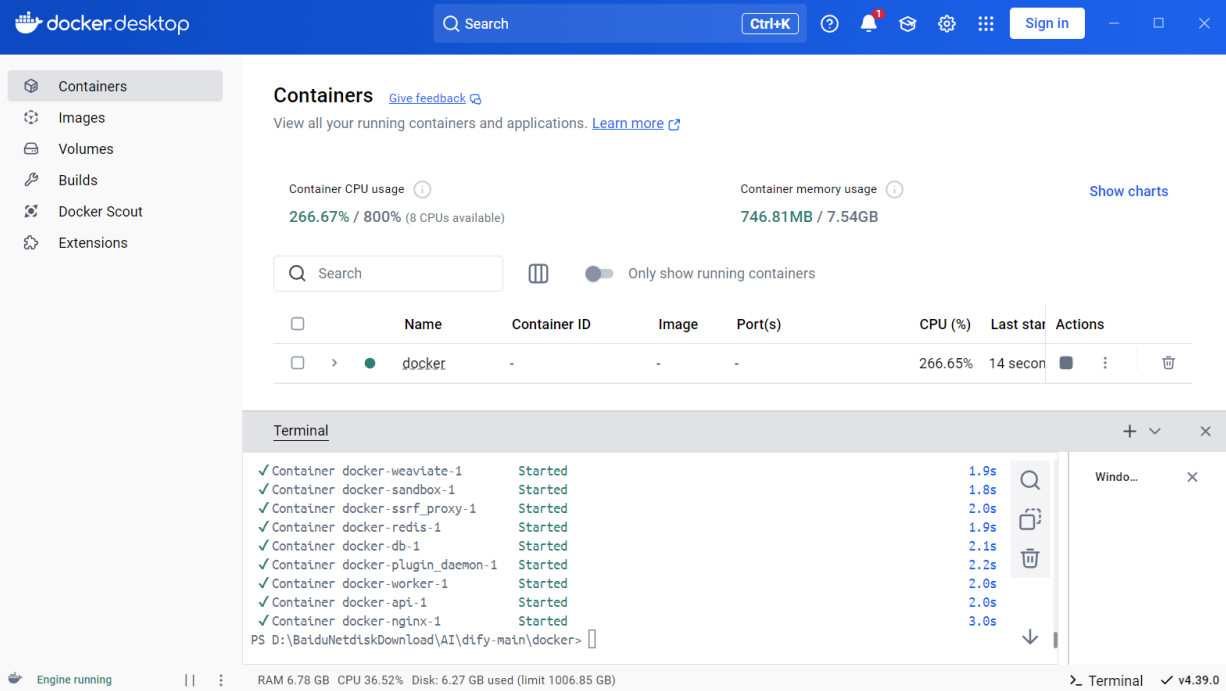

4、等待安装完成

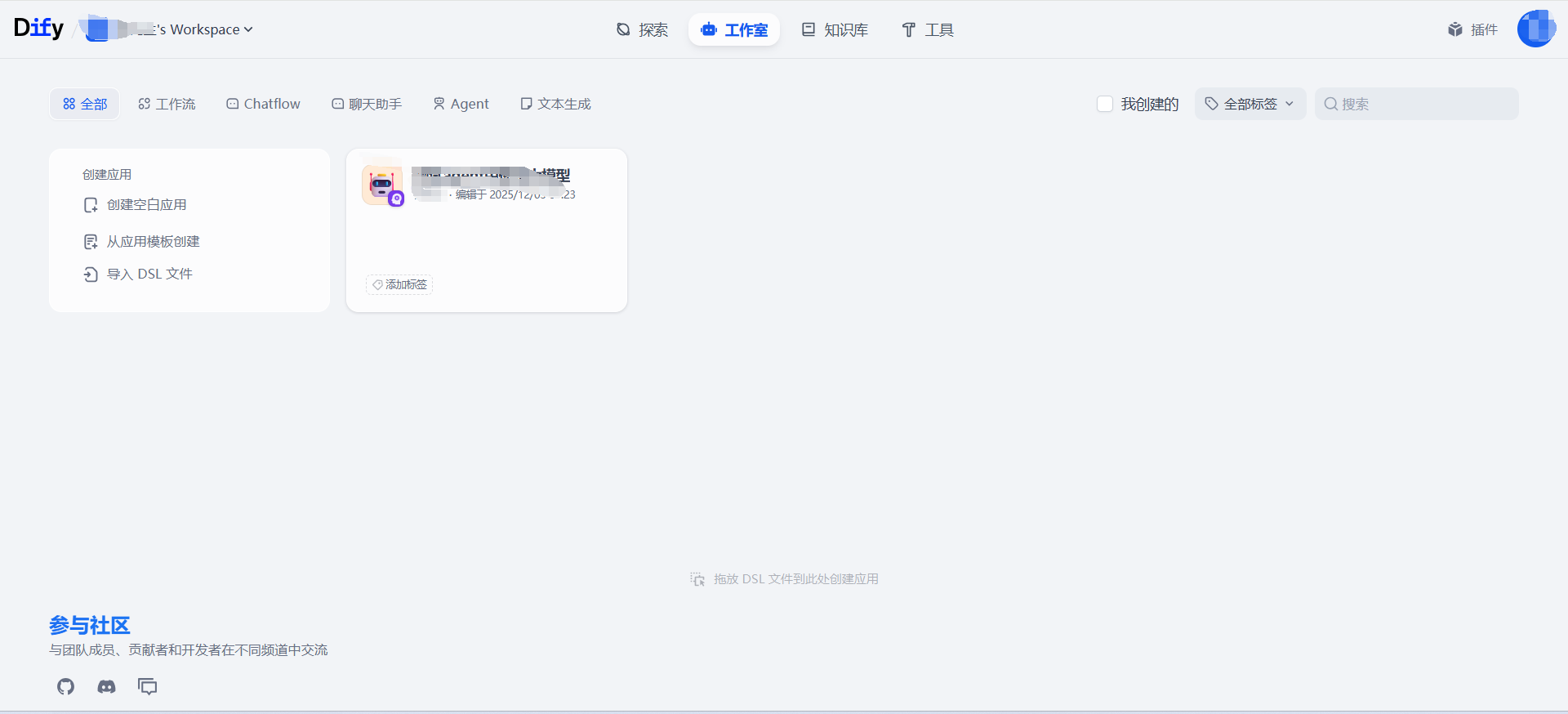

5、访问dify

浏览器输入 localhost:端口号/install 即可访问。首次访问需要设置用户名密码。使用方式和官方提供的平台是一样的。

四、安装ollama

1、下载ollama

Ollama官网

Ollama下载页

ollama github地址

因为OllamaSetup.exe安装包较大,官网下载太慢,大家可以参考下面这个博客,使用迅雷下载

三种快速下载OLLAMA的方法

2、安装ollama

下载好OllamaSetup.exe,如果直接双击安装,默认安装在C盘。如果不想安装到C盘,可以使用一下方式。

1)、创建目录

在D盘创建ollama文件夹,将下载的 OllamaSetup.exe 放入其中

D:\ollama\OllamaSetup.exe

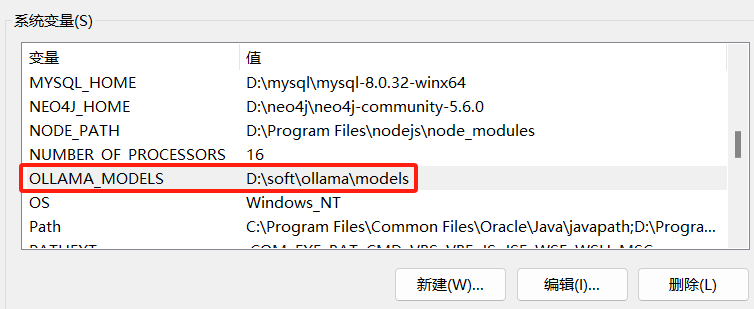

2)、设置环境变量 OLLAMA_MODELS

OLLAMA_MODELS = D:\ollama\models

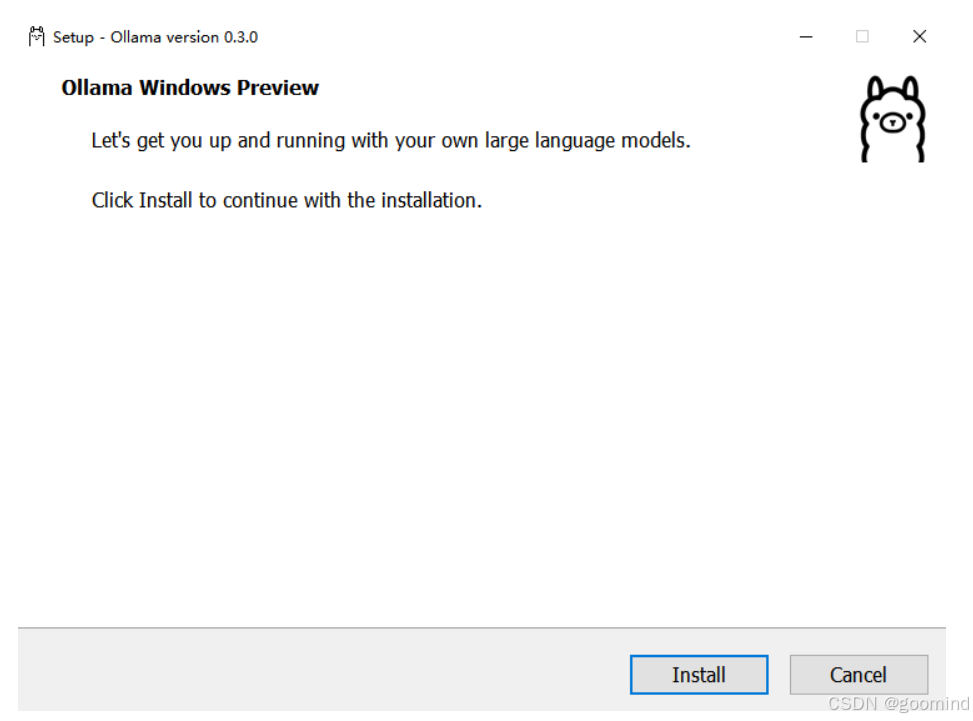

3)、执行安装

以管理员身份打开 Window PowerShell,进入OllamaSetup.exe所在的目录,执行一下命令:

.\OllamaSetup.exe /dir=D:\ollama

在弹出的安装界面中点击 Install,等待安装完成

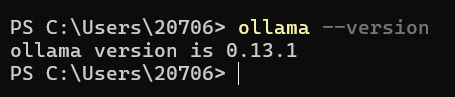

3、验证安装

安装完成后Ollama会自动启动,任务栏会有小羊驼图标

在PowerShell 或 CMD 中输入

ollama --version

如果有版本号的输出则说明安装成功

4、下载大模型

进入Ollama官网的Models页面,可以找到自己需要的大模型。

点击进入需要的大模型,选中具体的大模型参数,并复制下载命令。

ollama pull deepseek-r1:latest

models下载的目录就是环境参数OLLAMA_MODELS配置的地址

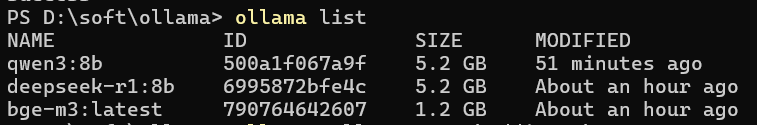

5、验证模型下载

在cmd中执行ollama list可查询已安装的大模型

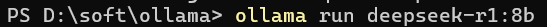

在cmd中执行ollama run [模型名]可运行大模型

当输入运行指令后看到下图所示,说明大模型已成功安装在本地并可以运行。

6运行 Ollama

与 qwen2:0.5b 聊天

代码语言:bash

AI代码解释

ollama run qwen2:0.5b启动成功后,ollama 在本地 11434 端口启动了一个 API 服务,可通过 http://localhost:11434 访问。

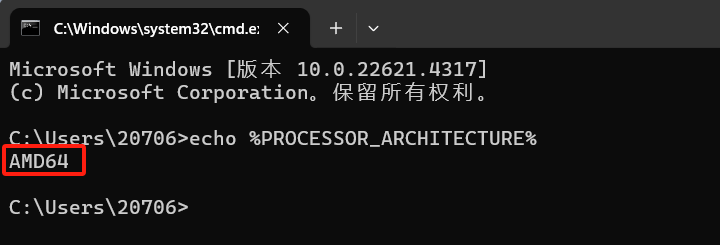

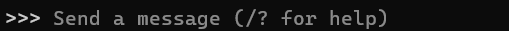

7 Dify 中接入 Ollama

7.1 添加模型

在 设置 > 模型供应商 > Ollama 添加模型:

填写 LLM 信息:

模型名称:以 ollama 返回的为准

代码语言:bash

AI代码解释

$ ollama ls

NAME ID SIZE MODIFIED

qwen2:0.5b 6f48b936a09f 352 MB 7 months ago那就得填写:qwen2:0.5b

基础 URL:http://<your-ollama-endpoint-domain>:11434

此处需填写 Ollama 服务地址。如果填写公开 URL 后仍提示报错,请参考常见问题,修改环境变量并使得 Ollama 服务可被所有 IP 访问。

若 Dify 为:http://192.168.65.0:11434

- Docker 部署,建议填写局域网 IP 地址,如:

http://192.168.1.100:11434或 Docker 容器的内部 IP 地址,例如:http://host.docker.internal:11434 - 若为本地源码部署,可填

http://localhost:11434 - 模型类型:

对话 - 模型上下文长度:

4096

模型的最大上下文长度,若不清楚可填写默认值 4096。

- 最大 token 上限:

4096

模型返回内容的最大 token 数量,若模型无特别说明,则可与模型上下文长度保持一致。

- 是否支持 Vision:

是

当模型支持图片理解(多模态)勾选此项,如 llava。

点击 "保存" 校验无误后即可在应用中使用该模型。

Embedding 模型接入方式类似LLM,只需将模型类型改为Text Embedding:

7.2 使用 Ollama 模型

进入需要配置的 App 提示词编排页面,选择 Ollama 供应商下的 llava 模型,配置模型参数后即可使用: