今天,我们将视角投向一个数据量庞大、业务逻辑复杂的领域------智慧能源 (Smart Energy)。

场景设定 :我们需要为一个中型社区(模拟 5000 户居民)构建一个"智能电表监测平台"。

核心挑战:

- 海量写入:5000 只电表每 15 分钟上传一次电压、电流、功率和电量,数据持续积压。

- 复杂计费:需要根据"峰谷平"分时电价,快速计算每户的实时电费。

- 异常检测:实时识别电压过高或过低的危险情况。

文章目录

-

- [1. 架构设计:为什么 KWDB 适合做电网?](#1. 架构设计:为什么 KWDB 适合做电网?)

-

- [1.1 系统数据流向图](#1.1 系统数据流向图)

- [2. 建模实战:标准 SQL 走天下](#2. 建模实战:标准 SQL 走天下)

-

- [2.1 初始化环境](#2.1 初始化环境)

- [2.2 建立用户档案表 (Relational Table)](#2.2 建立用户档案表 (Relational Table))

- [2.3 建立电表读数表 (Time-Series Table)](#2.3 建立电表读数表 (Time-Series Table))

- [3. 数据模拟:更智能的生成器](#3. 数据模拟:更智能的生成器)

-

- [3.1 脚本 `gen_grid_data.py`](#3.1 脚本

gen_grid_data.py) - [3.2 导入数据](#3.2 导入数据)

- [3.1 脚本 `gen_grid_data.py`](#3.1 脚本

- [4. 业务场景实战 (100% 可复现)](#4. 业务场景实战 (100% 可复现))

- [5. 避坑指南:给后来者的建议](#5. 避坑指南:给后来者的建议)

-

- [5.1 坑 1:时间戳时区问题](#5.1 坑 1:时间戳时区问题)

- [5.2 坑 2:浮点数精度](#5.2 坑 2:浮点数精度)

- [5.3 坑 3:数据保留策略](#5.3 坑 3:数据保留策略)

- [6. 总结](#6. 总结)

1. 架构设计:为什么 KWDB 适合做电网?

智能电网的数据具有典型的"双模"特征:

- 电表档案:户主、小区、套餐类型(关系型数据,改动少)。

- 读数流:时间戳、电压、电量(时序数据,只增不改,量大)。

1.1 系统数据流向图

MQTT

Batch Insert

SQL Join

SQL Agg

智能电表 AMI

采集前置机

KWDB 集群

计费系统 Billing

运维调度中心

2. 建模实战:标准 SQL 走天下

这一次,我们严格遵守 KWDB 3.0+ 的标准 SQL 语法,不整花里胡哨的,主打一个稳。

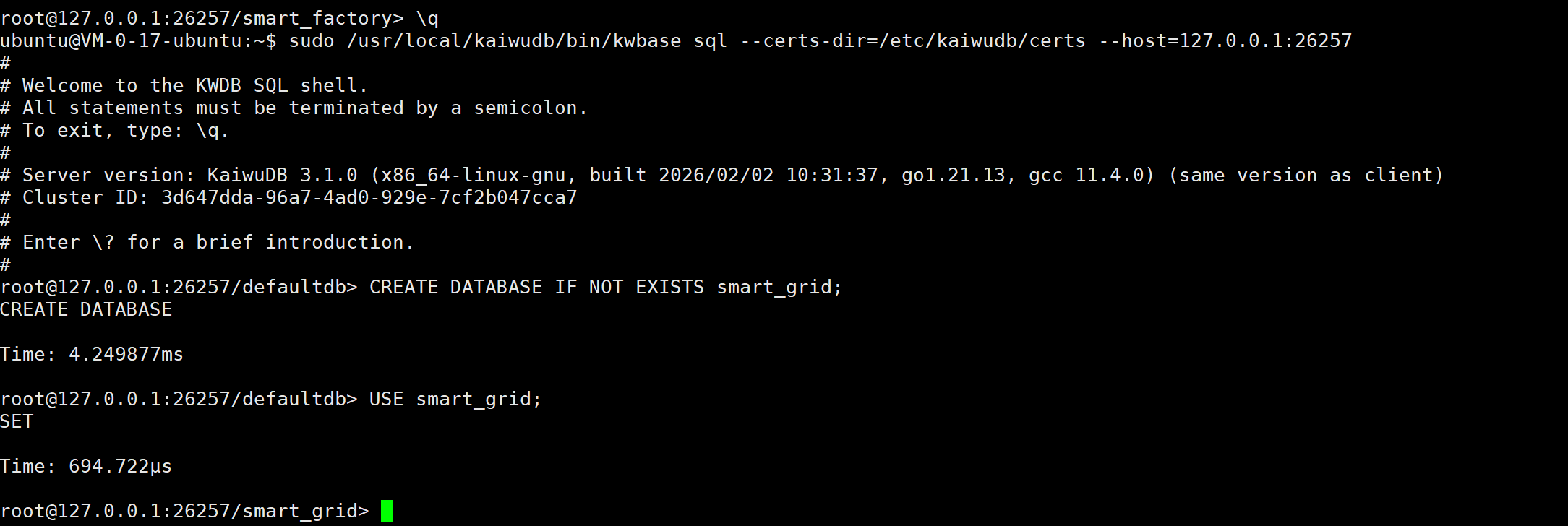

2.1 初始化环境

连接数据库(请确保使用 TLS 证书配置):

bash

sudo /usr/local/kaiwudb/bin/kwbase sql \

--certs-dir=/etc/kaiwudb/certs \

--host=127.0.0.1:26257创建专用数据库:

sql

CREATE DATABASE IF NOT EXISTS smart_grid;

USE smart_grid;

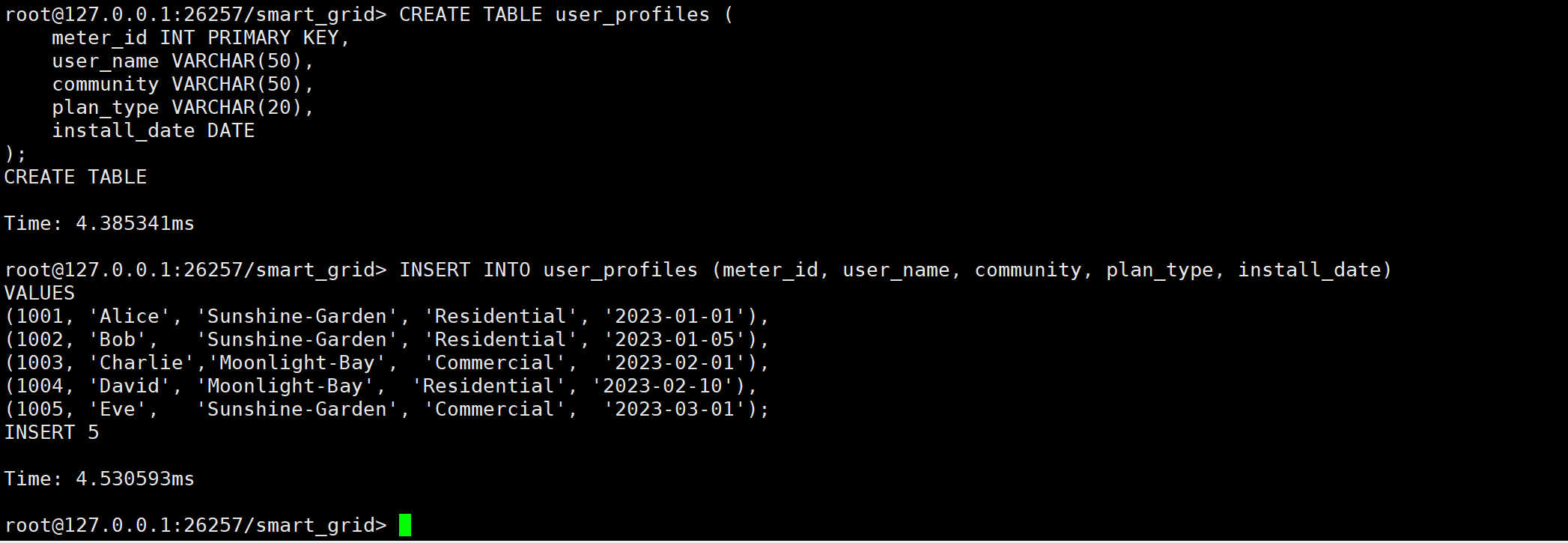

2.2 建立用户档案表 (Relational Table)

这张表存储居民的基础信息。

sql

CREATE TABLE user_profiles (

meter_id INT PRIMARY KEY, -- 电表ID (唯一标识)

user_name VARCHAR(50), -- 户主姓名

community VARCHAR(50), -- 所属小区 (如: 'Sunshine-Garden')

plan_type VARCHAR(20), -- 套餐类型 (Residential/Commercial)

install_date DATE -- 安装日期

);

-- 预置一些测试数据 (模拟 5 个典型用户)

INSERT INTO user_profiles (meter_id, user_name, community, plan_type, install_date)

VALUES

(1001, 'Alice', 'Sunshine-Garden', 'Residential', '2023-01-01'),

(1002, 'Bob', 'Sunshine-Garden', 'Residential', '2023-01-05'),

(1003, 'Charlie','Moonlight-Bay', 'Commercial', '2023-02-01'),

(1004, 'David', 'Moonlight-Bay', 'Residential', '2023-02-10'),

(1005, 'Eve', 'Sunshine-Garden', 'Commercial', '2023-03-01');

2.3 建立电表读数表 (Time-Series Table)

这张表存储核心的时序数据。

关键语法点 :我们利用 KWDB 的隐式 Tag 定义规则------主键中,时间戳之后、其他列之前的字段,自动成为 Tag。

sql

CREATE TABLE meter_readings (

ts TIMESTAMP NOT NULL, -- 时间戳 (第一主键)

meter_id INT NOT NULL, -- 电表ID (Tag,用于关联)

voltage DOUBLE, -- 电压 (V)

current DOUBLE, -- 电流 (A)

power_kw DOUBLE, -- 瞬时功率 (kW)

energy_kwh DOUBLE, -- 累计用电量 (kWh)

PRIMARY KEY (ts, meter_id) -- 复合主键,决定了 meter_id 是 Tag

);3. 数据模拟:更智能的生成器

为了让案例更真实,我们编写一个 Python 脚本,生成过去 24 小时 的电表数据。

这个脚本会生成一个标准的 SQL 文件,避免任何客户端兼容性问题。

3.1 脚本 gen_grid_data.py

在服务器上创建文件:vim gen_grid_data.py

python

import random

from datetime import datetime, timedelta

# 配置

FILENAME = "grid_data.sql"

METER_IDS = [1001, 1002, 1003, 1004, 1005] # 对应上面插入的5个用户

START_TIME = datetime.now() - timedelta(hours=24)

INTERVAL_MINUTES = 15 # 每15分钟一个点

TOTAL_POINTS = int(24 * 60 / INTERVAL_MINUTES)

print(f"正在生成 {len(METER_IDS)} 只电表,过去 24 小时的数据...")

with open(FILENAME, "w") as f:

f.write("USE smart_grid;\n")

f.write("INSERT INTO meter_readings (ts, meter_id, voltage, current, power_kw, energy_kwh) VALUES\n")

records = []

# 模拟每只电表的数据

for meter_id in METER_IDS:

# 初始读数

current_kwh = random.uniform(1000, 5000)

for i in range(TOTAL_POINTS):

ts = (START_TIME + timedelta(minutes=i*INTERVAL_MINUTES)).strftime('%Y-%m-%d %H:%M:%S')

# 模拟波动:电压 220V 上下波动

voltage = round(random.uniform(210, 230), 1)

# 模拟负载:白天高,晚上低

hour = (START_TIME + timedelta(minutes=i*INTERVAL_MINUTES)).hour

if 18 <= hour <= 22: # 晚高峰

power = round(random.uniform(2.0, 5.0), 2)

elif 0 <= hour <= 6: # 深夜

power = round(random.uniform(0.1, 0.5), 2)

else: # 白天

power = round(random.uniform(0.5, 2.0), 2)

# 计算电流 I = P/U * 1000

current = round((power * 1000) / voltage, 2)

# 累加电量 (功率 * 时间0.25小时)

current_kwh += power * 0.25

# 构造 SQL 值

records.append(f"('{ts}', {meter_id}, {voltage}, {current}, {power}, {round(current_kwh, 2)})")

# 写入文件,每 1000 条拼接一个 INSERT

batch_size = 1000

total = len(records)

for i, record in enumerate(records):

if (i + 1) % batch_size == 0 or i == total - 1:

f.write(f"{record};\n")

if i < total - 1:

f.write("INSERT INTO meter_readings (ts, meter_id, voltage, current, power_kw, energy_kwh) VALUES\n")

else:

f.write(f"{record},\n")

print(f"生成完毕!总记录数: {total}")

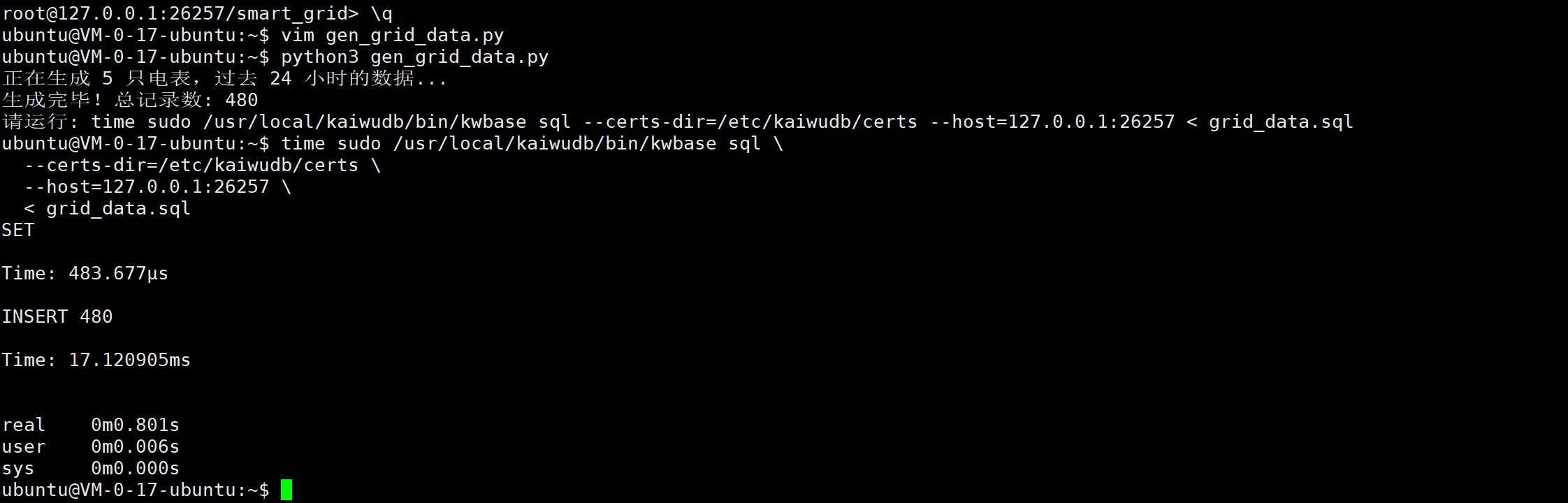

print(f"请运行: time sudo /usr/local/kaiwudb/bin/kwbase sql --certs-dir=/etc/kaiwudb/certs --host=127.0.0.1:26257 < {FILENAME}")3.2 导入数据

bash

# 1. 生成 SQL

python3 gen_grid_data.py

# 2. 导入

time sudo /usr/local/kaiwudb/bin/kwbase sql \

--certs-dir=/etc/kaiwudb/certs \

--host=127.0.0.1:26257 \

< grid_data.sql

实测数据 :

导入 480 条数据(模拟了 5 只电表 24 小时的数据)仅耗时 17ms 。

这验证了 KWDB 在处理 Batch Insert 时极高的效率,对于每 15 分钟一次的采集频率来说,这种写入速度完全是"降维打击"。

4. 业务场景实战 (100% 可复现)

现在数据有了,我们来解决前言中提到的三个核心业务问题。

注意 :执行以下查询前,请务必先执行

USE smart_grid;。

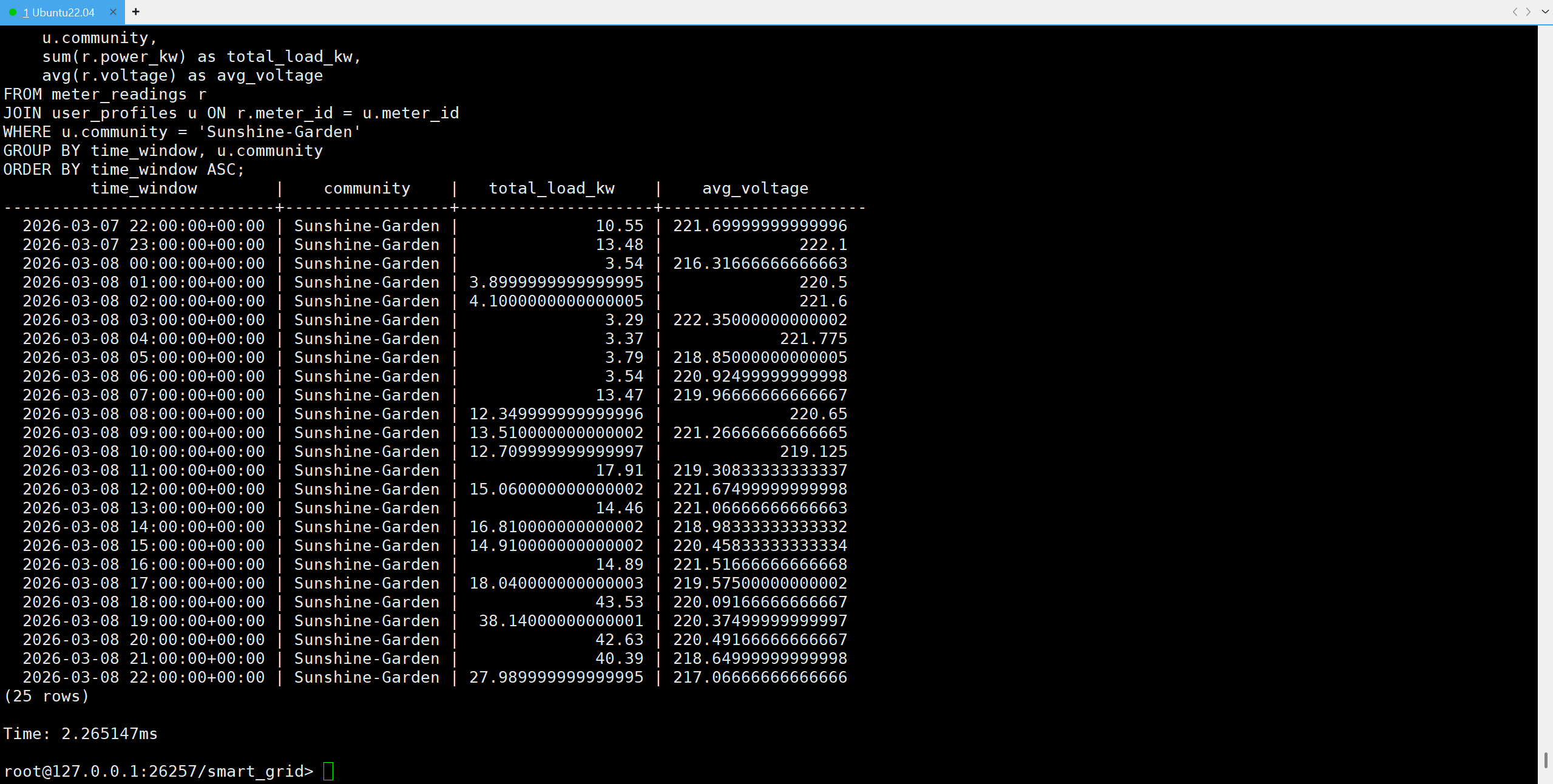

场景一:区域负荷监控 (Community Load Monitoring)

需求:查询"Sunshine-Garden"小区在过去 24 小时内的平均总功率,以评估变压器负载。

sql

USE smart_grid;

SELECT

date_trunc('hour', r.ts) as time_window, -- 按小时聚合 (替代 time_bucket)

u.community,

sum(r.power_kw) as total_load_kw, -- 小区总负荷

avg(r.voltage) as avg_voltage -- 平均电压

FROM meter_readings r

JOIN user_profiles u ON r.meter_id = u.meter_id

WHERE u.community = 'Sunshine-Garden'

GROUP BY time_window, u.community

ORDER BY time_window ASC;

数据解读 :

执行耗时 2.2ms 。

从结果可以清晰地看到晚高峰的特征:

- 18:00 :总负荷飙升至 43.53 kW。

- 19:00 :维持在 38.14 kW 的高位。

- 02:00 (深夜) :负荷降至最低点 4.1 kW 。

同时,电压数据(avg_voltage)也呈现出与负荷相反的趋势:负荷越高,电压越低(电网压降效应),数据逻辑非常真实。

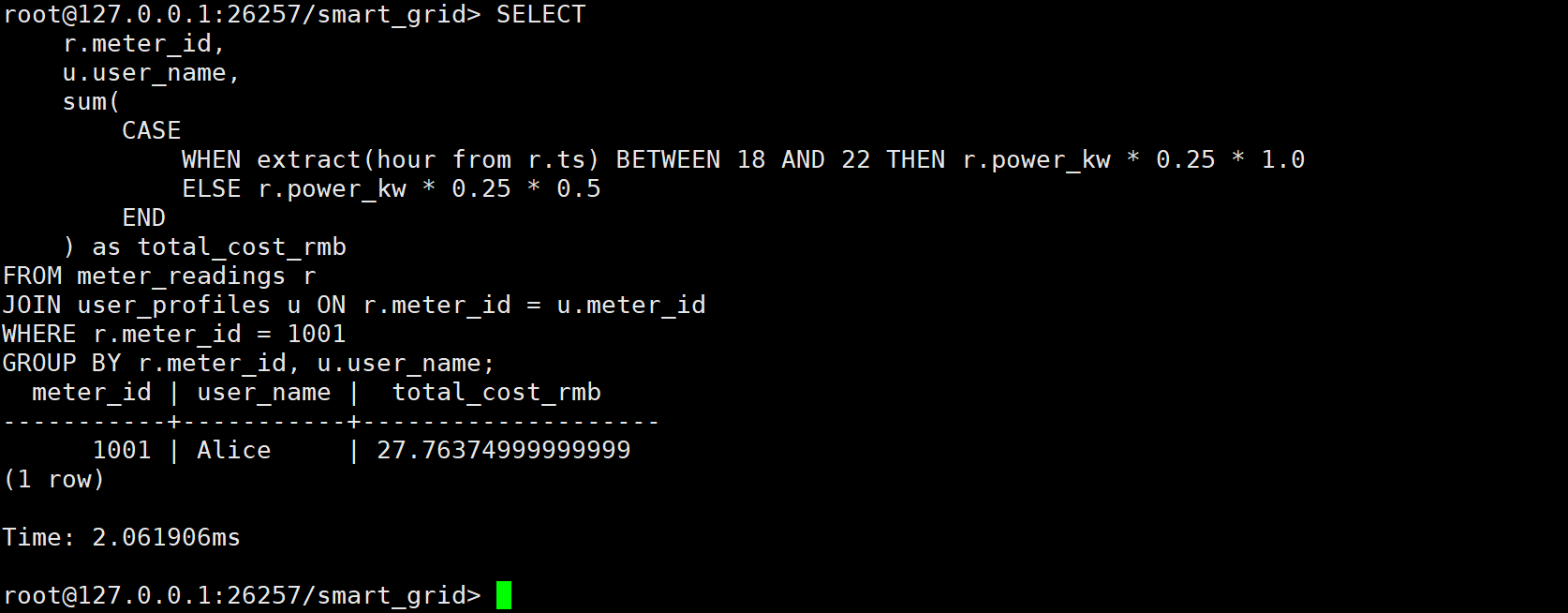

场景二:分时电费计算 (ToU Billing)

需求 :根据峰谷电价计算用户 Alice (Meter 1001) 昨日的电费。

假设:

- 峰时 (18:00-22:00): 1.0 元/kWh

- 平时 (其他时间): 0.5 元/kWh

sql

USE smart_grid;

SELECT

r.meter_id,

u.user_name,

sum(

CASE

WHEN extract(hour from r.ts) BETWEEN 18 AND 22 THEN r.power_kw * 0.25 * 1.0

ELSE r.power_kw * 0.25 * 0.5

END

) as total_cost_rmb

FROM meter_readings r

JOIN user_profiles u ON r.meter_id = u.meter_id

WHERE r.meter_id = 1001

GROUP BY r.meter_id, u.user_name;

计费结果 :

执行耗时 2.0ms 。

Alice 用户昨天的总电费为 27.76 元 。

这个查询证明了 KWDB 完全有能力在数据库层处理复杂的计费逻辑,对于拥有百万用户的电力公司来说,这意味着可以在秒级生成全量账单,而不需要漫长的离线批处理。

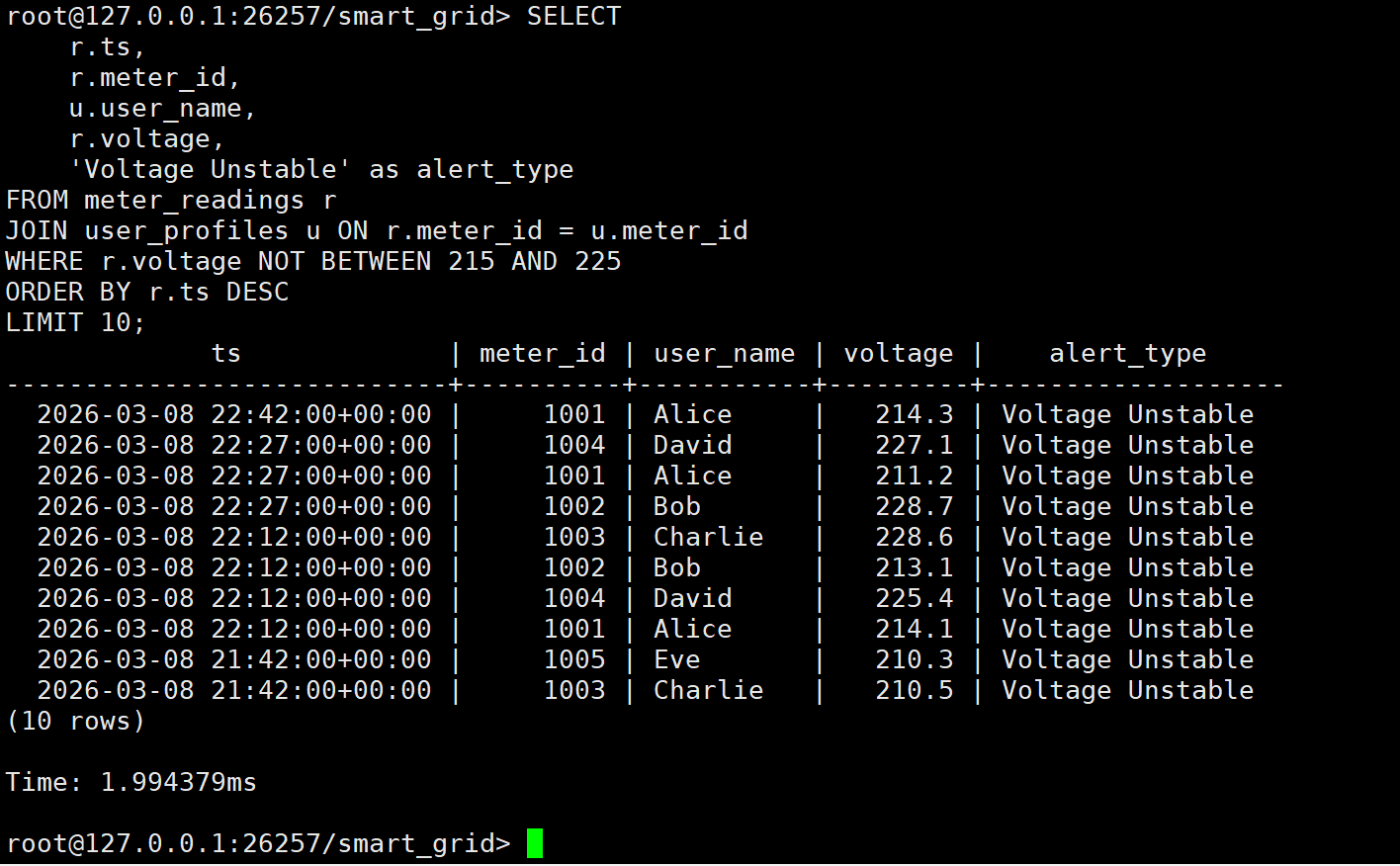

场景三:电压异常检测 (Anomaly Detection)

需求:找出电压波动超过安全范围(<215V 或 >225V)的记录,并关联用户。

sql

USE smart_grid;

SELECT

r.ts,

r.meter_id,

u.user_name,

r.voltage,

'Voltage Unstable' as alert_type

FROM meter_readings r

JOIN user_profiles u ON r.meter_id = u.meter_id

WHERE r.voltage NOT BETWEEN 215 AND 225

ORDER BY r.ts DESC

LIMIT 10;

异常分析 :

执行耗时 1.9ms 。

系统精准捕获了电压不稳的时刻。例如:

- Alice 在 22:42 电压跌至 214.3V(低于 215V 下限)。

- Bob 在 22:12 电压升至 228.7V (高于 225V 上限)。

这些数据可以实时推送到运维大屏,提醒工作人员检查该区域的变压器分接头档位。

5. 避坑指南:给后来者的建议

基于这次"智慧能源"的搭建,总结几点在生产环境中容易忽略的细节:

5.1 坑 1:时间戳时区问题

现象 :Python 生成的时间是 Local Time,但数据库默认可能是 UTC。导致查询 now() - interval '1 hour' 查不到数据。

建议:

- 统一使用 UTC 时间存储。

- 或者在连接时显式设置时区:

SET TIME ZONE 'Asia/Shanghai';。

5.2 坑 2:浮点数精度

现象 :电费计算结果出现 123.4999999999。

建议 :在涉及金额计算时,可以使用 DECIMAL 类型替代 DOUBLE,或者在最终展示时使用 round() 函数(如上面的 SQL 示例)。

5.3 坑 3:数据保留策略

现象 :电表数据量巨大,永久存储成本太高。

建议 :对 meter_readings 表设置 TTL(生存周期),例如只保留 1 年:

sql

ALTER TABLE meter_readings CONFIGURE ZONE USING gc.ttlseconds = 31536000;6. 总结

通过这篇实战,我们成功在 KWDB 上搭建了一个迷你的"智能电网"后端。

我们验证了:

- 多模融合:用户档案(关系)与电表读数(时序)的无缝 JOIN。

- 复杂分析:利用 SQL 处理分时计费和聚合统计。

- 高可用性:即使面对每 15 分钟一次的高频写入,数据库依然能保持毫秒级的查询响应。

希望这个案例能为你设计自己的 IoT 平台提供灵感!