Improving Language Understanding by Generative Pre-Training

通过生成式预训练提升语言理解能力

摘要

自然语言理解涵盖广泛多样的任务,例如文本蕴含、问答、语义相似度评估和文档分类。尽管大规模无标注文本语料库十分丰富,但用于学习这些特定任务的标注数据却相对稀缺,这使得基于判别式训练的模型难以取得理想性能。我们的研究表明,通过在多样化的无标注文本语料库上进行生成式预训练,再针对每个具体任务进行判别式微调,可以显著提升这些任务的性能。与以往方法不同,我们在微调过程中采用任务感知的输入转换方法,只需对模型架构进行最小改动即可实现有效的知识迁移。我们在多种自然语言理解基准测试中验证了该方法的有效性。我们的通用任务无关模型优于那些针对每个任务专门设计架构的判别式训练模型,在所研究的12项任务中有9项显著提升了当前最佳水平。例如,我们在常识推理(Stories Cloze Test)上实现了8.9%的绝对提升,在问答(RACE)上提升5.7%,在文本蕴含(MultiNLI)上提升1.5%。

1.引言

从原始文本中高效学习的能力,对于减轻自然语言处理(NLP)对监督学习的依赖至关重要。大多数深度学习方法需要大量手动标注数据,这限制了它们在许多缺乏标注资源的领域的适用性[61]。在这些情况下,能够从未标注数据中利用语言信息的模型,为获取更多标注(这一过程可能耗时且昂贵)提供了一个有价值的替代方案。此外,即使在有大量监督数据可用的情况下,以无监督方式学习良好的表征也能显著提升性能。迄今为止,最有力的证据是预训练词嵌入[10, 39, 42]的广泛使用,它提升了一系列NLP任务的性能[8, 11, 26, 45]。

然而,从无标注文本中利用超越词级的信息主要面临两大挑战。首先,目前尚不清楚何种优化目标能最有效地学习适用于迁移的文本表征。近期研究探讨了多种目标,如语言建模[44]、机器翻译[38]和语篇连贯性建模[22],不同方法在不同任务上各具优势。其次,对于如何将这些习得的表征迁移至目标任务,学界尚未形成共识。现有技术通常涉及对模型架构进行任务特定调整[43,44]、采用复杂的学习机制[21]以及添加辅助学习目标[50]等策略。这些不确定性使得开发有效的语言处理半监督学习方法变得尤为困难。

本文探索了一种结合无监督预训练与有监督微调的半监督方法,用于语言理解任务。我们的目标是学习一种通用表征,该表征只需少量调整即可迁移至广泛的任务。我们假设可访问大规模未标注文本语料库及多个包含人工标注训练样本的数据集(目标任务)。该设定不要求目标任务与未标注语料库处于同一领域。我们采用两阶段训练流程:首先,在未标注数据上使用语言建模目标学习神经网络模型的初始参数;随后,利用相应的有监督目标将这些参数适配至特定任务。

在我们的模型架构中,我们采用了Transformer[62]------该模型已被证明在机器翻译[62]、文档生成[34]和句法解析[29]等多种任务上表现卓越。与循环网络等替代方案相比,这一模型选择为我们提供了更具结构化的记忆机制,以处理文本中的长期依赖关系,从而在不同任务间实现稳健的迁移性能。在迁移过程中,我们采用了基于遍历式方法[52]的任务特定输入适配技术,将结构化文本输入处理为单一连续的标记序列。如实验所示,这些适配策略使我们能够在对预训练模型架构进行最小改动的前提下,实现高效微调。

我们在四类语言理解任务上评估了我们的方法------自然语言推理、问答、语义相似度与文本分类。我们的通用任务无关模型表现优于针对每项任务专门设计架构的判别式训练模型,在研究的12项任务中有9项显著提升了现有技术水平。例如,我们在常识推理(故事完形填空测试)[40]上实现了8.9%的绝对提升,在问答(RACE)[30]上提升5.7%,在文本蕴含(MultiNLI)[66]上提升1.5%,并在近期推出的GLUE多任务基准测试[64]上取得5.5%的提升。我们还分析了预训练模型在四种不同设置下的零样本学习行为,证明其能够为下游任务获取有效的语言学知识。

2.相关工作

面向自然语言处理的半监督学习

我们的研究工作总体上归属于自然语言处理领域的半监督学习范畴。这一范式已引起广泛关注,并应用于序列标注[24, 33, 57]或文本分类[41, 70]等任务。早期方法主要利用未标注数据计算词级或短语级统计特征,然后将这些特征应用于监督模型[33]。过去几年间,研究者们证明了使用基于未标注语料训练得到的词向量[11, 39, 42]能够有效提升多种任务的性能[8, 11, 26, 45]。然而,这些方法主要迁移的是词级信息,而我们的目标在于捕捉更高层次的语义信息。

近期研究方法探索了从未标注数据中学习和利用超越词汇层级的语义。短语级或句子级嵌入可通过未标注语料库进行训练,此类技术已被用于将文本编码成适用于各类目标任务的向量表示[28, 32, 1, 36, 22, 12, 56, 31]。

无监督预训练

无监督预训练是半监督学习的一种特殊形式,其目标在于寻找良好的初始化点,而非修改监督学习的目标函数。早期研究探索了该技术在图像分类[20, 49, 63]与回归任务[3]中的应用。后续研究[15]表明,预训练作为一种正则化方案,能够提升深度神经网络的泛化能力。在近期工作中,该方法已被用于辅助深度神经网络在图像分类[69]、语音识别[68]、实体消歧[17]及机器翻译[48]等多种任务上的训练。

与我们工作最接近的研究路线是使用语言建模目标对神经网络进行预训练,随后在有监督的情况下针对目标任务进行微调。Dai等人[13]以及Howard和Ruder[21]采用这种方法改进了文本分类。然而,尽管预训练阶段有助于捕获部分语言信息,但他们使用的LSTM模型将其预测能力限制在较短范围内。相比之下,我们选择的Transformer网络能够捕获更长距离的语言结构,这在我们的实验中得到了验证。此外,我们还证明了模型在更广泛任务上的有效性,包括自然语言推理、复述检测和故事补全。其他方法[43,44,38]在使用目标任务的监督模型进行训练时,将预训练语言模型或机器翻译模型的隐藏表示作为辅助特征。这需要为每个独立目标任务引入大量新参数,而我们的方法在迁移过程中仅需对模型架构进行最小程度的修改。

辅助训练目标

添加辅助无监督训练目标是半监督学习的另一种形式。Collobert和Weston的早期研究[10]使用了多种辅助自然语言处理任务,如词性标注、组块分析、命名实体识别和语言建模,以改进语义角色标注的效果。最近,Rei[50]在目标任务目标中添加了辅助语言建模目标,并在序列标注任务中展示了性能提升。我们的实验同样使用了辅助目标,但正如我们所展示的,无监督预训练已经学习了与目标任务相关的多个语言学层面。

3.方法

我们的训练流程包含两个阶段。第一阶段是在大规模文本语料上学习一个高容量语言模型。随后是微调阶段,在此阶段中,我们使用标注数据使模型适应判别性任务。

3.1 无监督预训练

给定一个无监督的词元语料库 U = { u 1 , . . . , u n } U = \{u_1, . . . , u_n\} U={u1,...,un},我们采用标准的语言建模目标来最大化以下似然概率:

L 1 ( U ) = ∑ i log P ( u i ∣ u i − k , ... , u i − 1 ; Θ ) L_1(\mathcal{U})=\sum_i\log P(u_i|u_{i-k},\ldots,u_{i-1};\Theta) L1(U)=i∑logP(ui∣ui−k,...,ui−1;Θ)

其中k为上下文窗口大小,条件概率P通过参数为Θ的神经网络进行建模。这些参数采用随机梯度下降法进行训练[51]。

在我们的实验中,采用多层Transformer解码器[34]作为语言模型,该模型是transformer架构[62]的一个变体。该模型对输入上下文标记执行多头自注意力操作,再通过逐位置前馈网络层处理,最终生成目标标记的输出概率分布:

h 0 = U W e + W p h l = transformer block ( h l − 1 ) ∀ i ∈ [ 1 , n ] P ( u ) = s o f t m a x ( h n W e T ) \begin{aligned}h_{0}&=UW_e+W_p\\h_{l}&=\text{transformer block}(h_{l-1})\forall i\in[1,n]\\P(u)&=\mathrm{softmax}(h_nW_e^T)\end{aligned} h0hlP(u)=UWe+Wp=transformer block(hl−1)∀i∈[1,n]=softmax(hnWeT)

其中 U = ( u − k , . . . , u − 1 ) U = (u_{−k}, . . . , u_{−1}) U=(u−k,...,u−1) 是词元的上下文向量,n 是层数, W e W_e We 是词元嵌入矩阵, W p W_p Wp 是位置嵌入矩阵。

3.2 监督式微调

在使用等式1中的目标训练模型后,我们将其参数适配至有监督目标任务。我们假设存在一个带标签的数据集C,其中每个样本由输入标记序列 x 1 , . . . , x m x^1,...,x^m x1,...,xm及其对应标签y组成。将输入通过预训练模型后,获取最终Transformer模块的激活值 h l m h^m_l hlm,随后将其馈入新增的线性输出层(参数为 W y W_y Wy)以预测y:

P ( y ∣ x 1 , ... , x m ) = s o f t m a x ( h l m W y ) . P(y|x^1,\ldots,x^m)=\mathrm{softmax}(h_l^mW_y). P(y∣x1,...,xm)=softmax(hlmWy).

由此我们得到以下需要最大化的目标函数:

L 2 ( C ) = ∑ ( x , y ) log P ( y ∣ x 1 , ... , x m ) . L_2(\mathcal{C})=\sum_{(x,y)}\log P(y|x^1,\ldots,x^m). L2(C)=(x,y)∑logP(y∣x1,...,xm).

我们还发现,将语言建模作为微调的辅助目标有助于学习,具体体现在:(a) 提升监督模型的泛化能力,(b) 加速收敛。这与先前的研究[50, 43]结果一致,它们也观察到此类辅助目标带来的性能提升。具体而言,我们优化了以下目标函数(权重为λ):

L 3 ( C ) = L 2 ( C ) + λ ∗ L 1 ( C ) L_3(\mathcal{C})=L_2(\mathcal{C})+\lambda*L_1(\mathcal{C}) L3(C)=L2(C)+λ∗L1(C)

总的来说,微调过程中我们仅需额外引入 W y W_y Wy参数以及分隔符标记的嵌入向量(具体描述见下文第3.3节)。

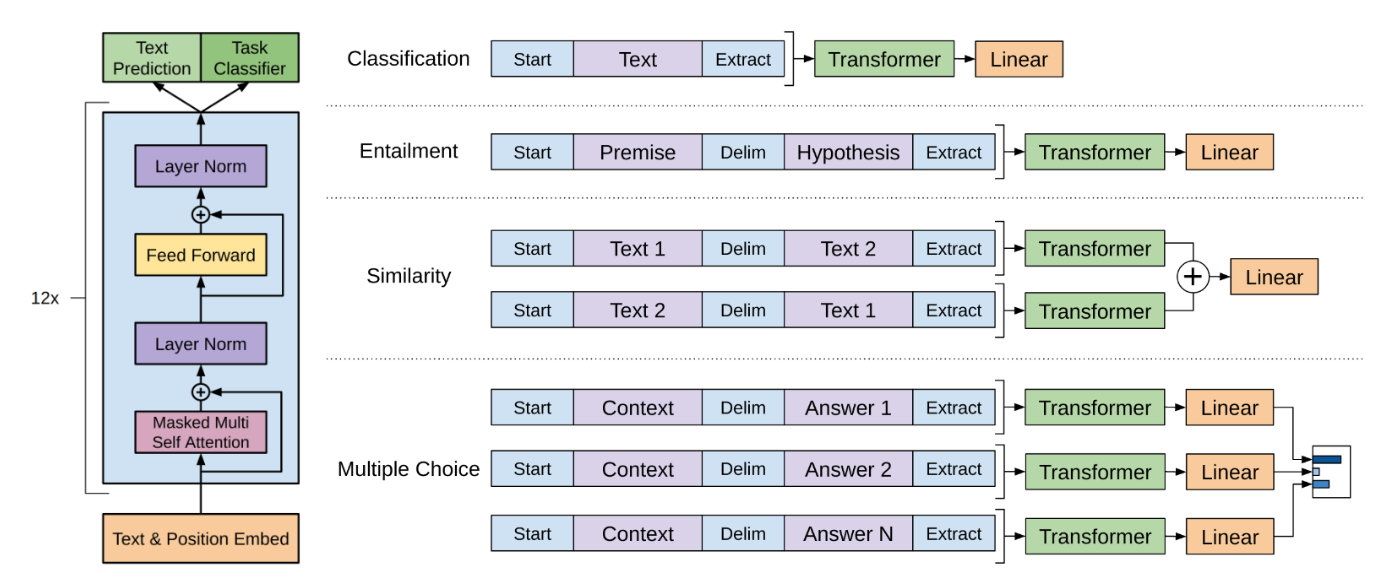

图1:(左)本研究采用的Transformer架构及训练目标。(右)针对不同任务进行微调的输入转换方法。我们将所有结构化输入转换为词元序列,由预训练模型进行处理,后接线性层与softmax层。

3.3 任务特定输入变换

对于某些任务(如文本分类),我们可以直接按上述方式对模型进行微调。而其他一些任务(如问答或文本蕴含任务)具有结构化的输入,例如有序句子对,或由文档、问题和答案组成的三元组。由于我们的预训练模型是基于连续文本序列进行训练的,需要对其进行一定修改才能适应这些任务。先前的研究提出在迁移表征之上学习特定于任务的架构[44]。这种方法重新引入了大量任务特定的定制化内容,且未对这些额外的架构组件使用迁移学习。相反,我们采用了一种遍历式方法[52],将结构化输入转换为预训练模型可处理的有序序列。这些输入转换使我们能够避免针对不同任务对架构进行大幅修改。下文简要描述了这些输入转换过程,图1提供了直观示意图。所有转换均包含添加随机初始化的起始与结束标记(〈s〉、〈e〉)。

对于蕴含任务,我们将前提p和假设h的标记序列与分隔符标记($)连接起来。

在相似性任务中,被比较的两个句子并无内在顺序关系。为体现此特性,我们将输入序列修改为包含两种可能的句子排列方式(中间以分隔符隔开),并分别独立处理以生成两个序列表示 h l m h^m_l hlm,经逐元素相加后馈入线性输出层。

问题解答与常识推理

针对此类任务,我们获得一个上下文文档 z、一个问题 q 以及一组可能的答案 { a k } \{ a_k \} {ak}。我们将文档上下文和问题分别与每个可能的答案拼接,并在中间加入分隔符,得到 \[z; q; ; a_k]$。这些序列均独立输入模型进行处理,随后通过 softmax 层进行归一化处理,生成针对可能答案的输出分布。

4.实验

4.1 实验设置

无监督预训练

我们使用BooksCorpus数据集[71]来训练语言模型。该数据集包含7,000余本未出版的独特书籍,涵盖冒险、奇幻和爱情等多种体裁。关键之处在于,它包含大量连续文本段落,这使得生成式模型能够学习对长距离信息的条件建模。另一种被类似方法ELMo[44]使用的数据集------1B Word Benchmark------其规模大致相当。但在句子层面进行了随机打乱------破坏了长程结构。我们的语言模型在该语料库上实现了极低的词元级困惑度,仅为18.4。

模型规格 我们的模型基本遵循原始Transformer架构[62]。我们训练了一个12层仅解码器结构的Transformer,采用掩码自注意力机制(768维状态和12个注意力头)。在位置前馈网络中,我们使用3072维内部状态。优化方案采用Adam[27],最大学习率为2.5e-4。学习率在前2000次更新中从零线性增长,随后通过余弦调度衰减至0。我们在小批量数据上训练100个周期,每批包含64条随机采样、连续长度为512个标记的序列。由于模型中广泛使用层归一化[2],采用简单的N(0, 0.02)权重初始化即可满足需求。我们使用包含40,000次合并的字节对编码(BPE)词汇表[53],并采用0.1比率的残差连接、嵌入层和注意力丢弃机制进行正则化。同时采用了[37]提出的改进版L2正则化方法,对所有非偏置或增益权重设置w=0.01。激活函数选用高斯误差线性单元(GELU)[18]。位置编码采用可学习的嵌入向量,而非原论文提出的正弦版本。我们使用ftfy库清理BooksCorpus原始文本,标准化标点符号与空格格式,并采用spaCy分词器进行文本处理。

微调细节

除非另有说明,我们沿用无监督预训练的超参数设置。我们在分类器中添加了丢弃率为0.1的Dropout。对于大多数任务,我们使用6.25e-5的学习率和32的批处理大小。我们的模型微调速度很快,3个训练周期在大多数情况下已足够。我们采用带热身的线性学习率衰减计划,热身阶段占训练的0.2%。λ值设定为0.5。

4.2 监督式微调

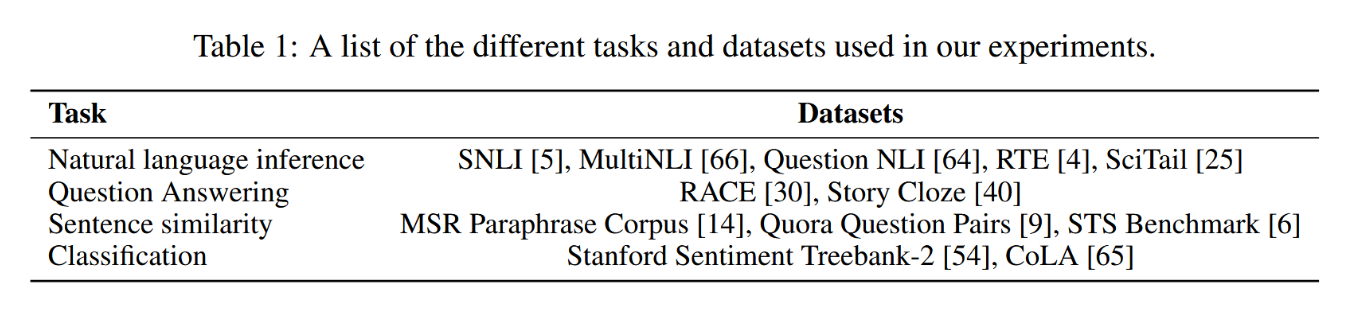

我们在多种监督任务上进行实验,包括自然语言推理、问答、语义相似度和文本分类。其中部分任务属于近期发布的GLUE多任务基准测试[64],我们将其纳入使用。图1展示了所有任务与数据集的概览。

表1:本实验所用各项任务与数据集的列表。

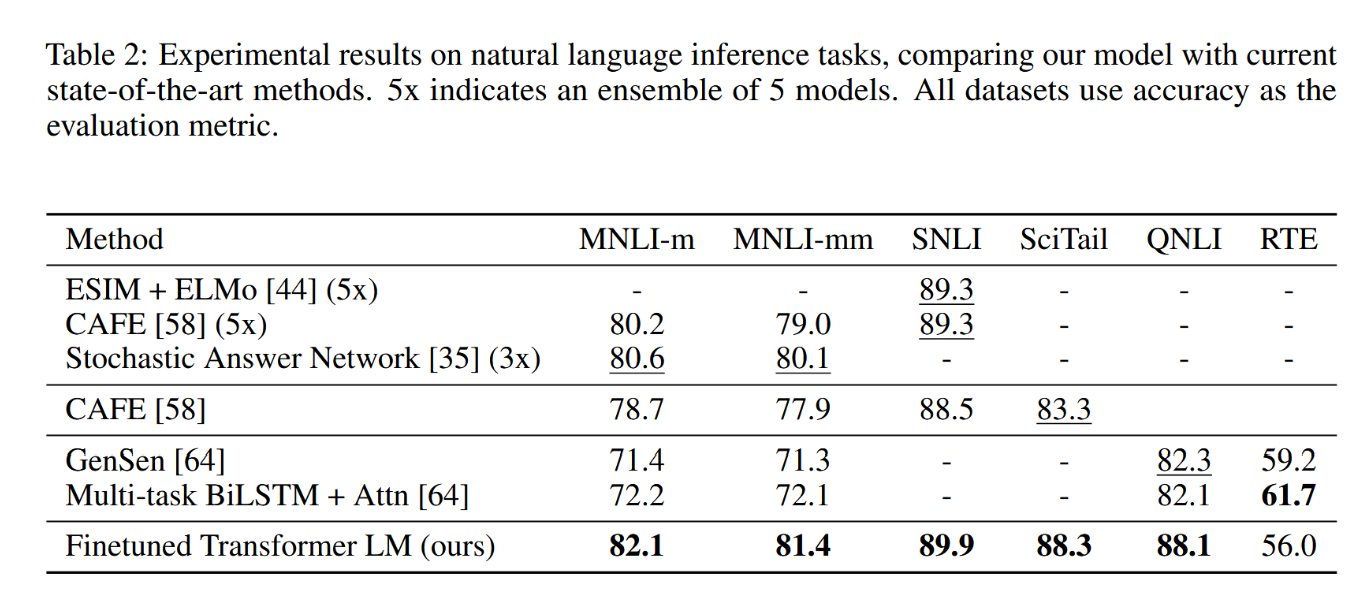

自然语言推理任务,又称文本蕴含识别,涉及阅读一对句子并判断其关系属于蕴含、矛盾或中立中的哪一种。尽管近期该领域研究热度显著[58,35,44],但由于存在词汇蕴含、指代消解、词汇与句法歧义等多种语言现象,该任务仍具挑战性。我们在五个不同来源的数据集上进行了评估,包括图像描述(SNLI)、转录语音、流行小说和政府报告(MNLI)、维基百科文章(QNLI)、科学考试(SciTail)以及新闻文章(RTE)。

表2详细列出了我们的模型与先前最先进方法在不同自然语言推理任务上的各项结果。我们的方法在五个数据集中的四个上显著优于基线模型,相较于先前最佳结果,在MNLI上实现了高达1.5%的绝对性能提升,在SciTail上提升5%,在QNLI上提升5.8%,在SNLI上提升0.6%。这证明了我们的模型能更好地进行多语句推理,并处理语言歧义问题。在RTE(我们评估的数据集中较小的一个,含2490个样本)上,我们取得了56%的准确率,低于多任务双向LSTM模型报告的61.7%。鉴于我们的方法在较大规模自然语言推理数据集上的优异表现,我们的模型很可能也会受益于多任务训练,但当前尚未对此进行探索。

表2:自然语言推理任务实验结果,将我们的模型与当前最优方法进行对比。"5x"表示5个模型的集成结果。所有数据集均使用准确率作为评估指标。

问答与常识推理

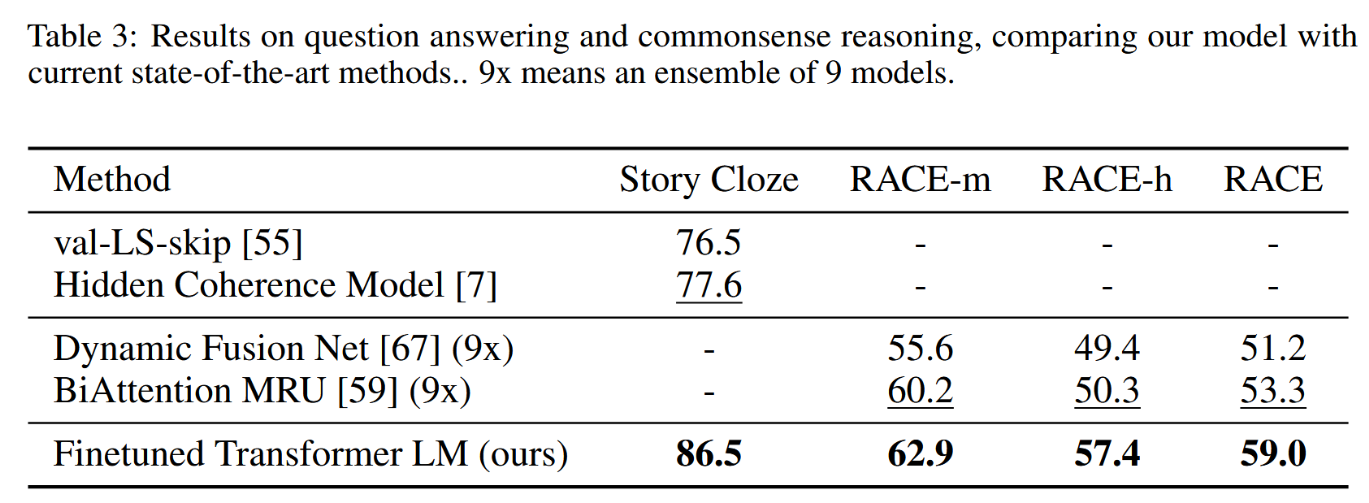

另一项需要单句及多句推理能力的任务是问答。我们使用最新发布的RACE数据集[30],该数据集包含来自初高中考试的英文篇章及相关问题。研究证明,相较于CNN[19]或SQuaD[47]等数据集,该语料库包含更多推理类问题,这为我们的模型提供了理想的评估场景------因为我们的模型正是为处理长程上下文而训练的。此外,我们在Story Cloze测试[40]上进行了评估,该测试要求从两个选项中选择多句故事的合理结尾。在这些任务中,我们的模型再次以显著优势超越先前最佳结果------在Story Cloze上提升高达8.9%,在RACE数据集上整体提升5.7%。这证明了我们的模型能有效处理长程上下文。

表3:问答与常识推理任务结果,将我们的模型与当前最先进方法进行对比。"9x"表示9个模型的集成。

语义相似性

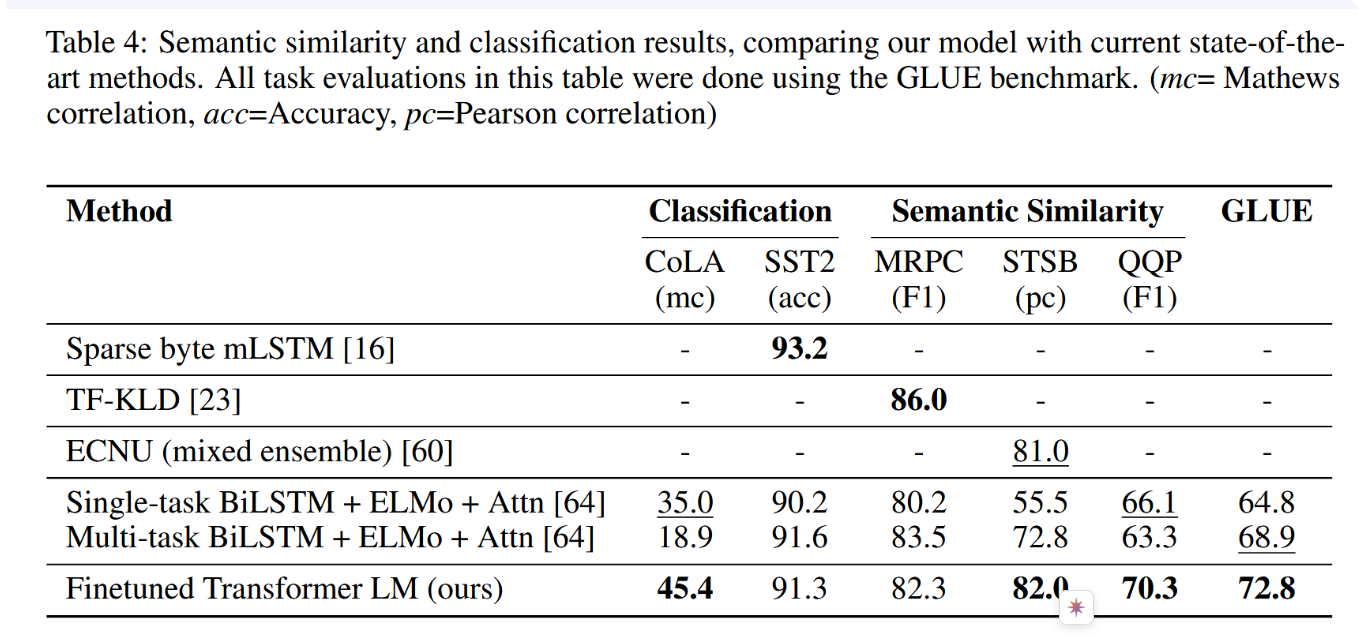

语义相似性(或称复述检测)任务旨在预测两个句子在语义上是否等同。该任务的挑战在于识别概念的重述表达、理解否定含义以及处理句法歧义。我们采用三个数据集进行此项研究:微软复述语料库(MRPC)[14](采集自新闻源)、Quora问题对(QQP)数据集[9]以及语义文本相似性基准(STS-B)[6]。我们在三项语义相似性任务中的两项取得了最先进的结果(表4),其中STS-B指标获得1个百分点的绝对提升。在QQP数据集上的性能提升尤为显著,相较于单任务BiLSTM+ELMo+注意力模型实现了4.2%的绝对改进。

分类任务

最后,我们还在两个不同的文本分类任务上进行了评估。语言可接受性语料库(CoLA)[65]包含专家对句子是否符合语法的判断,用于测试训练模型的内在语言偏误。而斯坦福情感树库(SST-2)[54]则是一个标准的二分类任务。我们的模型在CoLA上获得了45.4分,相比之前的最佳成绩35.0实现了显著提升,这展示了我们模型学习到的内在语言理解能力。该模型在SST-2上也达到了91.3%的准确率,与当前最优结果具有竞争力。在GLUE基准测试中,我们获得了72.8的整体分数,显著优于此前最佳的68.9分。

表4:语义相似度与分类结果,对比我们的模型与当前最先进方法。本表中所有任务评估均使用GLUE基准进行。(mc=马修斯相关系数,acc=准确率,pc=皮尔逊相关系数)

总体而言,我们的方法在评估的12个数据集中,有9个取得了最新的最先进成果,且在多数情况下超越了集成方法。我们的结果还表明,该方法在不同规模的数据集上均表现良好,从小型数据集如STS-B(约5.7k训练样本)到最大数据集SNLI(约550k训练样本)皆是如此。

5.分析

迁移层数的影响

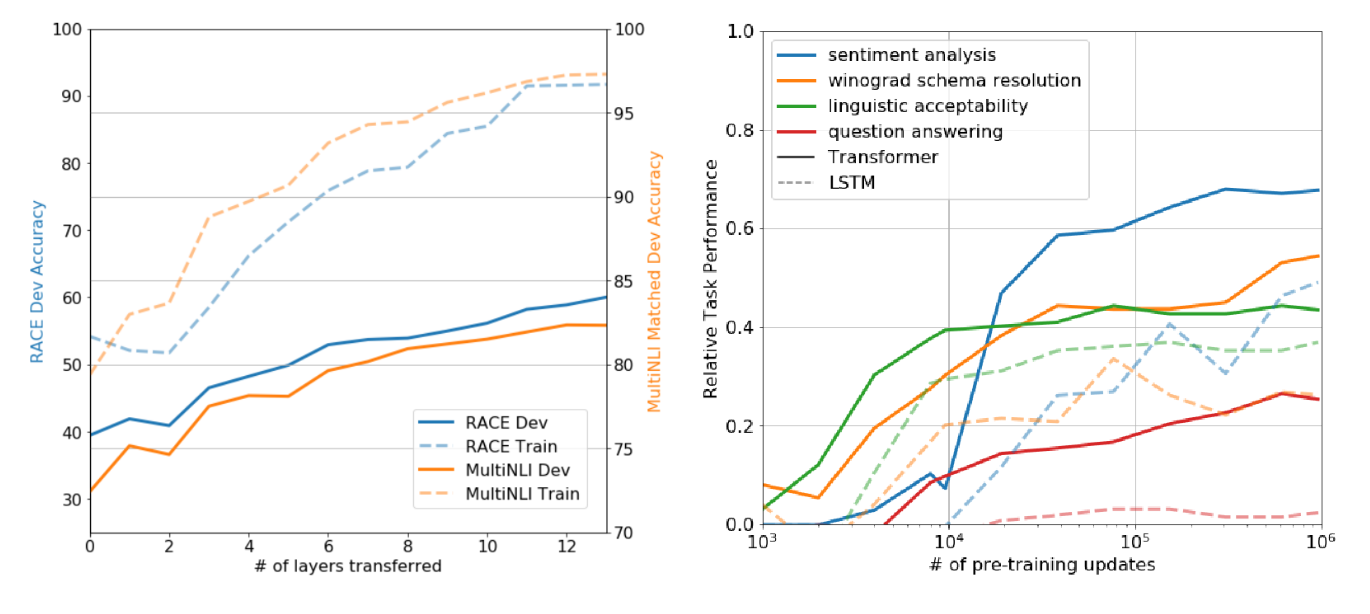

我们观察了将无监督预训练模型中可变数量的层迁移至有监督目标任务所产生的影响。图2(左)展示了在MultiNLI和RACE任务上,我们方法的性能随迁移层数变化的关系。我们观察到了标准结果:迁移词嵌入能提升性能,并且每个Transformer层的迁移都会带来进一步的收益------在MultiNLI任务上,完整迁移可达9%的提升。这表明预训练模型中的每一层都包含了对于解决目标任务有用的功能。

图2:(左图)迁移预训练语言模型逐层增加对RACE和MultiNLI数据集的影响。(右图)展示了在不同任务上,零样本性能随语言模型预训练更新次数增加的演变情况。每个任务的性能均以随机猜测基线和使用单一模型的当前最优性能为基准进行了归一化处理。

零样本行为:我们想要更深入地理解为何Transformer的语言模型预训练是有效的。一种假设是,其底层的生成模型为了提升语言建模能力,已经学会了执行我们所评估的众多任务,并且这些任务的结构性越强。相比LSTM,Transformer的注意力机制有助于提升迁移性能。我们设计了一系列启发式解决方案,利用底层生成模型在不进行监督微调的情况下执行任务。图2(右)可视化了这些启发式方法在生成式预训练过程中的有效性变化。我们观察到这些启发式方法的性能表现稳定,并随着训练持续提升,这表明生成式预训练支持学习多种与任务相关的功能。我们还观察到LSTM在零样本性能上表现出更高的方差,这表明Transformer架构的归纳偏置有助于迁移学习。

在CoLA(语言可接受性)任务中,示例的评分依据生成模型赋予的平均词元对数概率,并通过设定阈值进行预测。对于SST-2(情感分析)任务,我们在每个示例后附加词元"very",并将语言模型的输出分布限制为"positive"和"negative"两个词,选取模型赋予更高概率的词元作为预测结果。在RACE(问答)任务中,我们选择生成模型在给定文档和问题条件下、赋予最高平均词元对数概率的答案。对于DPRD[46](威诺格拉德模式)任务,我们将定指代词替换为两种可能的指代对象,并预测生成模型对替换后序列的剩余部分赋予更高平均词元对数概率的指代消解方案。

消融研究

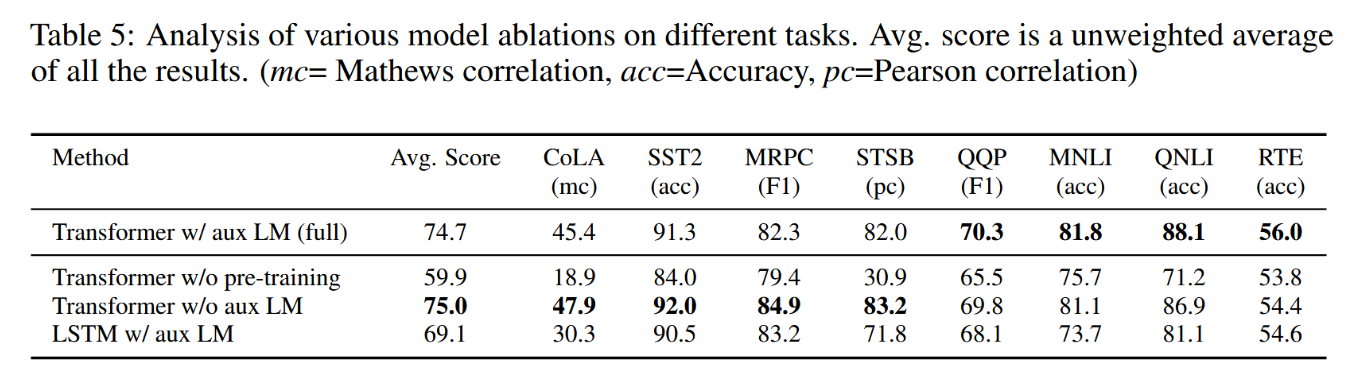

我们进行了三项不同的消融研究(见表5)。首先,我们检验了在微调阶段不使用辅助语言模型目标时我们方法的性能。我们观察到辅助目标在自然语言推理任务和QQP上具有提升效果。总体趋势表明,较大规模的数据集受益于辅助目标,而较小规模的数据集则无此效果。其次,我们通过将Transformer与在相同框架下使用单层2048单元LSTM进行比较,分析了Transformer的作用。使用LSTM替代Transformer导致平均分数下降5.6。LSTM仅在MRPC一个数据集上表现优于Transformer。最后,我们还将本方法与直接在监督目标任务上训练(未经预训练)的Transformer架构进行对比。我们观察到,缺乏预训练会损害所有任务的性能,与完整模型相比导致性能下降14.8%。

表5:不同任务上各类模型消融实验分析。平均分值为所有结果的未加权平均值。(mc=马修斯相关系数,acc=准确率,pc=皮尔逊相关系数)

6.总结

我们引入了一个框架,通过生成式预训练与判别式微调相结合的方式,用单一的任务无关模型实现强大的自然语言理解。通过在包含长距离连续文本的多样化语料库上进行预训练,我们的模型获得了丰富的世界知识以及处理长程依赖关系的能力。这些能力随后被成功迁移至问答、语义相似度评估、蕴含关系判定和文本分类等判别式任务中,在我们研究的12个数据集中,有9个取得了当时最先进的性能提升。利用无监督(预)训练来提升判别式任务性能,长期以来一直是机器学习研究的重要目标。我们的工作表明,实现显著的性能提升确实是可能的,并揭示了何种模型(Transformer)和数据集(具有长程依赖关系的文本)最适合这种方法。我们希望这项工作能够推动无监督学习在自然语言理解及其他领域的新研究,进一步深化我们对无监督学习如何及何时有效的理解。

7.引用文献

- [1] S. Arora, Y. Liang, and T. Ma. A simple but tough-to-beat baseline for sentence embeddings. 2016.

- [2] J. L. Ba, J. R. Kiros, and G. E. Hinton. Layer normalization. arXiv preprint arXiv:1607.06450, 2016.

- [3] Y. Bengio, P. Lamblin, D. Popovici, and H. Larochelle. Greedy layer-wise training of deep networks. In Advances in neural information processing systems, pages 153--160, 2007.

- [4] L. Bentivogli, P. Clark, I. Dagan, and D. Giampiccolo. The fifth pascal recognizing textual entailment challenge. In TAC, 2009.

- [5] S. R. Bowman, G. Angeli, C. Potts, and C. D. Manning. A large annotated corpus for learning natural language inference. EMNLP, 2015.

- [6] D. Cer, M. Diab, E. Agirre, I. Lopez-Gazpio, and L. Specia. Semeval-2017 task 1: Semantic textual similarity-multilingual and cross-lingual focused evaluation. arXiv preprint arXiv:1708.00055, 2017.

- [7] S. Chaturvedi, H. Peng, and D. Roth. Story comprehension for predicting what happens next. In Proceedings of the 2017 Conference on Empirical Methods in Natural Language Processing, pages 1603--1614, 2017.

- [8] D. Chen and C. Manning. A fast and accurate dependency parser using neural networks. In Proceedings of the 2014 conference on empirical methods in natural language processing (EMNLP), pages 740--750, 2014.

- [9] Z. Chen, H. Zhang, X. Zhang, and L. Zhao. Quora question pairs. https://data.quora.com/First-QuoraDataset-Release-Question-Pairs, 2018.

- [10] R. Collobert and J. Weston. A unified architecture for natural language processing: Deep neural networks with multitask learning. In Proceedings of the 25th international conference on Machine learning, pages 160--167. ACM, 2008.

- [11] R. Collobert, J. Weston, L. Bottou, M. Karlen, K. Kavukcuoglu, and P. Kuksa. Natural language processing (almost) from scratch. Journal of Machine Learning Research, 12(Aug):2493--2537, 2011.

- [12] A. Conneau, D. Kiela, H. Schwenk, L. Barrault, and A. Bordes. Supervised learning of universal sentence representations from natural language inference data. EMNLP, 2017.

- [13] A. M. Dai and Q. V. Le. Semi-supervised sequence learning. In Advances in Neural Information Processing Systems, pages 3079--3087, 2015.

- [14] W. B. Dolan and C. Brockett. Automatically constructing a corpus of sentential paraphrases. In Proceedings of the Third International Workshop on Paraphrasing (IWP2005), 2005.

- [15] D. Erhan, Y. Bengio, A. Courville, P.-A. Manzagol, P. Vincent, and S. Bengio. Why does unsupervised pre-training help deep learning? Journal of Machine Learning Research, 11(Feb):625--660, 2010.

- [16] S. Gray, A. Radford, and K. P. Diederik. Gpu kernels for block-sparse weights. 2017.

- [17] Z. He, S. Liu, M. Li, M. Zhou, L. Zhang, and H. Wang. Learning entity representation for entity disambiguation. In Proceedings of the 51st Annual Meeting of the Association for Computational Linguistics (Volume 2: Short Papers), volume 2, pages 30--34, 2013.

- [18] D. Hendrycks and K. Gimpel. Bridging nonlinearities and stochastic regularizers with gaussian error linear units. arXiv preprint arXiv:1606.08415, 2016.

- [19] K. M. Hermann, T. Kocisky, E. Grefenstette, L. Espeholt, W. Kay, M. Suleyman, and P. Blunsom. Teaching machines to read and comprehend. In Advances in Neural Information Processing Systems, pages 16931701, 2015.

- [20] G. E. Hinton, S. Osindero, and Y.-W. Teh. A fast learning algorithm for deep belief nets. Neural computation, 18(7):1527--1554, 2006.

- [21] J. Howard and S. Ruder. Universal language model fine-tuning for text classification. Association for Computational Linguistics (ACL), 2018.

- [22] Y. Jernite, S. R. Bowman, and D. Sontag. Discourse-based objectives for fast unsupervised sentence representation learning. arXiv preprint arXiv:1705.00557, 2017.

- [23] Y. Ji and J. Eisenstein. Discriminative improvements to distributional sentence similarity. In Proceedings of the 2013 Conference on Empirical Methods in Natural Language Processing, pages 891--896, 2013.

- [24] F. Jiao, S. Wang, C.-H. Lee, R. Greiner, and D. Schuurmans. Semi-supervised conditional random fields for improved sequence segmentation and labeling. In Proceedings of the 21st International Conference on Computational Linguistics and the 44th annual meeting of the Association for Computational Linguistics, pages 209--216. Association for Computational Linguistics, 2006.

- [25] T. Khot, A. Sabharwal, and P. Clark. Scitail: A textual entailment dataset from science question answering. In Proceedings of AAAI, 2018.

- [26] Y. Kim. Convolutional neural networks for sentence classification. EMNLP, 2014.

- [27] D. P. Kingma and J. Ba. Adam: A method for stochastic optimization. arXiv preprint arXiv:1412.6980, 2014.

- [28] R. Kiros, Y. Zhu, R. R. Salakhutdinov, R. Zemel, R. Urtasun, A. Torralba, and S. Fidler. Skip-thought vectors. In Advances in neural information processing systems, pages 3294--3302, 2015.

- [29] N. Kitaev and D. Klein. Constituency parsing with a self-attentive encoder. ACL, 2018.

- [30] G. Lai, Q. Xie, H. Liu, Y. Yang, and E. Hovy. Race: Large-scale reading comprehension dataset from examinations. EMNLP, 2017.

- [31] G. Lample, L. Denoyer, and M. Ranzato. Unsupervised machine translation using monolingual corpora only. ICLR, 2018.

- [32] Q. Le and T. Mikolov. Distributed representations of sentences and documents. In International Conference on Machine Learning, pages 1188--1196, 2014.

- [33] P. Liang. Semi-supervised learning for natural language. PhD thesis, Massachusetts Institute of Technology, 2005.

- [34] P. J. Liu, M. Saleh, E. Pot, B. Goodrich, R. Sepassi, L. Kaiser, and N. Shazeer. Generating wikipedia by summarizing long sequences. ICLR, 2018.

- [35] X. Liu, K. Duh, and J. Gao. Stochastic answer networks for natural language inference. arXiv preprint arXiv:1804.07888, 2018.

- [36] L. Logeswaran and H. Lee. An efficient framework for learning sentence representations. ICLR, 2018.

- [37] I. Loshchilov and F. Hutter. Fixing weight decay regularization in adam. arXiv preprint arXiv:1711.05101, 2017.

- [38] B. McCann, J. Bradbury, C. Xiong, and R. Socher. Learned in translation: Contextualized word vectors. In Advances in Neural Information Processing Systems, pages 6297--6308, 2017.

- [39] T. Mikolov, I. Sutskever, K. Chen, G. S. Corrado, and J. Dean. Distributed representations of words and phrases and their compositionality. In Advances in neural information processing systems, pages 3111--3119, 2013.

- [40] N. Mostafazadeh, M. Roth, A. Louis, N. Chambers, and J. Allen. Lsdsem 2017 shared task: The story cloze test. In Proceedings of the 2nd Workshop on Linking Models of Lexical, Sentential and Discourse-level Semantics, pages 46--51, 2017.

- [41] K. Nigam, A. McCallum, and T. Mitchell. Semi-supervised text classification using em. Semi-Supervised Learning, pages 33--56, 2006.

- [42] J. Pennington, R. Socher, and C. Manning. Glove: Global vectors for word representation. In Proceedings of the 2014 conference on empirical methods in natural language processing (EMNLP), pages 1532--1543, 2014.

- [43] M. E. Peters, W. Ammar, C. Bhagavatula, and R. Power. Semi-supervised sequence tagging with bidirectional language models. ACL, 2017.

- [44] M. E. Peters, M. Neumann, M. Iyyer, M. Gardner, C. Clark, K. Lee, and L. Zettlemoyer. Deep contextualized word representations. NAACL, 2018.

- [45] Y. Qi, D. S. Sachan, M. Felix, S. J. Padmanabhan, and G. Neubig. When and why are pre-trained word embeddings useful for neural machine translation? NAACL, 2018. 10

- [46] A. Rahman and V. Ng. Resolving complex cases of definite pronouns: the winograd schema challenge. In Proceedings of the 2012 Joint Conference on Empirical Methods in Natural Language Processing and Computational Natural Language Learning, pages 777--789. Association for Computational Linguistics, 2012.

- [47] P. Rajpurkar, J. Zhang, K. Lopyrev, and P. Liang. Squad: 100,000+ questions for machine comprehension of text. EMNLP, 2016.

- [48] P. Ramachandran, P. J. Liu, and Q. V. Le. Unsupervised pretraining for sequence to sequence learning. arXiv preprint arXiv:1611.02683, 2016.

- [49] M. Ranzato, C. Poultney, S. Chopra, and Y. LeCun. Efficient learning of sparse representations with an energy-based model. In Advances in neural information processing systems, pages 1137--1144, 2007.

- [50] M. Rei. Semi-supervised multitask learning for sequence labeling. ACL, 2017.

- [51] H. Robbins and S. Monro. A stochastic approximation method. The annals of mathematical statistics, pages 400--407, 1951.

- [52] T. Rocktäschel, E. Grefenstette, K. M. Hermann, T. Kocˇisky, and P. Blunsom. Reasoning about entailment with neural attention. arXiv preprint arXiv:1509.06664, 2015.

- [53] R. Sennrich, B. Haddow, and A. Birch. Neural machine translation of rare words with subword units. arXiv preprint arXiv:1508.07909, 2015.

- [54] R. Socher, A. Perelygin, J. Wu, J. Chuang, C. D. Manning, A. Ng, and C. Potts. Recursive deep models for semantic compositionality over a sentiment treebank. In Proceedings of the 2013 conference on empirical methods in natural language processing, pages 1631--1642, 2013.

- [55] S. Srinivasan, R. Arora, and M. Riedl. A simple and effective approach to the story cloze test. arXiv preprint arXiv:1803.05547, 2018.

- [56] S. Subramanian, A. Trischler, Y. Bengio, and C. J. Pal. Learning general purpose distributed sentence representations via large scale multi-task learning. arXiv preprint arXiv:1804.00079, 2018.

- [57] J. Suzuki and H. Isozaki. Semi-supervised sequential labeling and segmentation using giga-word scale unlabeled data. Proceedings of ACL-08: HLT, pages 665--673, 2008.

- [58] Y. Tay, L. A. Tuan, and S. C. Hui. A compare-propagate architecture with alignment factorization for natural language inference. arXiv preprint arXiv:1801.00102, 2017.

- [59] Y. Tay, L. A. Tuan, and S. C. Hui. Multi-range reasoning for machine comprehension. arXiv preprint arXiv:1803.09074, 2018.

- [60] J. Tian, Z. Zhou, M. Lan, and Y. Wu. Ecnu at semeval-2017 task 1: Leverage kernel-based traditional nlp features and neural networks to build a universal model for multilingual and cross-lingual semantic textual similarity. In Proceedings of the 11th International Workshop on Semantic Evaluation (SemEval-2017), pages 191--197, 2017.

- [61] Y. Tsvetkov. Opportunities and challenges in working with low-resource languages. CMU, 2017.

- [62] A. Vaswani, N. Shazeer, N. Parmar, J. Uszkoreit, L. Jones, A. N. Gomez, Ł. Kaiser, and I. Polosukhin. Attention is all you need. In Advances in Neural Information Processing Systems, pages 6000--6010, 2017.

- [63] P. Vincent, H. Larochelle, Y. Bengio, and P.-A. Manzagol. Extracting and composing robust features with denoising autoencoders. In Proceedings of the 25th international conference on Machine learning, pages 1096--1103. ACM, 2008.

- [64] A. Wang, A. Singh, J. Michael, F. Hill, O. Levy, and S. R. Bowman. Glue: A multi-task benchmark and analysis platform for natural language understanding. arXiv preprint arXiv:1804.07461, 2018.

- [65] A. Warstadt, A. Singh, and S. R. Bowman. Corpus of linguistic acceptability. http://nyu-mll.github.io/cola, 2018.

- [66] A. Williams, N. Nangia, and S. R. Bowman. A broad-coverage challenge corpus for sentence understanding through inference. NAACL, 2018.

- [67] Y. Xu, J. Liu, J. Gao, Y. Shen, and X. Liu. Towards human-level machine reading comprehension:

- [68] D. Yu, L. Deng, and G. Dahl. Roles of pre-training and fine-tuning in context-dependent dbn-hmms for real-world speech recognition. In Proc. NIPS Workshop on Deep Learning and Unsupervised Feature Learning, 2010.

- [69] R. Zhang, P. Isola, and A. A. Efros. Split-brain autoencoders: Unsupervised learning by cross-channel prediction. In CVPR, volume 1, page 6, 2017.

- [70] X. Zhu. Semi-supervised learning literature survey. 2005.

- [71] Y. Zhu, R. Kiros, R. Zemel, R. Salakhutdinov, R. Urtasun, A. Torralba, and S. Fidler. Aligning books and movies: Towards story-like visual explanations by watching movies and reading books. In Proceedings of the IEEE international conference on computer vision, pages 19--27, 2015.