在云原生 AI 和大数据场景下,Kubernetes(K8s)的原生资源管理模型在面对 GPU 等异构算力时显得力不从心。K8s 的 Device Plugin 机制虽然提供了扩展能力,但默认只能以 "整卡" 为单位分配 GPU,导致资源利用率低下。Volcano 作为云原生批量计算引擎,通过扩展 Device Plugin 机制,实现了包括 GPU 显存共享在内的多元算力精细化管理。本文将从 K8s Device Plugin 的基础原理出发,深入剖析 Volcano 的多元算力管理方案,并结合实战演示 GPU 显存共享的完整流程。

一、K8s Device Plugin:原生机制的局限

1. 工作原理

K8s Device Plugin 是一个标准的扩展机制,允许第三方厂商将特定硬件资源(如 GPU、FPGA、InfiniBand 网卡)接入 K8s 的资源管理体系。其核心工作流程如下:

- 资源上报 :Device Plugin 通过 gRPC 服务向 Kubelet 注册,上报节点上可用的硬件资源(如

nvidia.com/gpu)。 - 调度决策:当用户创建的 Pod 请求这些资源时,K8s 调度器会根据节点的资源容量进行调度。

- 执行分配 :调度完成后,Kubelet 调用 Device Plugin 的

Allocate方法,执行具体的设备分配操作(如设置环境变量、挂载设备文件)。

2. 核心局限

- 资源粒度粗:原生 Device Plugin 只能以 "整卡" 为单位分配 GPU,无法实现显存或算力的细粒度共享。

- 调度能力弱:K8s 调度器仅关注资源是否存在,缺乏针对批量计算场景的高级调度策略(如 Gang scheduling、队列管理)。

- 缺乏多元算力统一管理:不同类型的异构算力(GPU、NPU、TPU)需要各自独立的 Device Plugin,缺乏统一的管理入口。

二、Volcano Device Plugin:突破原生限制的多元算力管理

Volcano 通过对 K8s Device Plugin 机制的深度扩展,构建了一套完整的多元算力管理体系,其核心优势在于:

- 细粒度资源共享:支持 GPU 显存、算力的共享,突破 "整卡" 限制。

- 高级调度策略:集成 Gang scheduling、优先级、队列等特性,满足 AI 训练、大数据等批量计算场景的需求。

- 统一管理入口 :通过自定义资源(如

volcano.sh/gpu-memory、volcano.sh/gpu-number)实现对多元算力的统一调度和管理。

1. Volcano Device Plugin 的核心组件

- Volcano Device Plugin:负责收集节点上的异构算力信息(如 GPU 数量、显存大小),并以自定义资源的形式上报给 K8s API Server。

- Volcano Scheduler :扩展了 K8s 调度器,支持对自定义算力资源的感知和调度,并通过插件(如

predicates、proportion)实现细粒度的资源分配和共享策略。 - JobFlow:用于编排依赖异构算力的作业流,实现端到端的多元算力工作流管理。

2. GPU 显存共享的核心流程

结合你提供的流程和截图,Volcano 实现 GPU 显存共享的完整步骤如下:

-

资源上报 :Volcano GPU Device Plugin 启动后,会自动检测节点上的 GPU 硬件信息,包括

gpu-number(GPU 卡数)和gpu-memory(单卡显存大小),并将这些信息以volcano.sh/gpu-number和volcano.sh/gpu-memory的形式上报给 K8s API Server。$ kubectl get node {node name} -oyaml ... allocatable: volcano.sh/gpu-memory: "89424" volcano.sh/gpu-number: "8" capacity: volcano.sh/gpu-memory: "89424" volcano.sh/gpu-number: "8" -

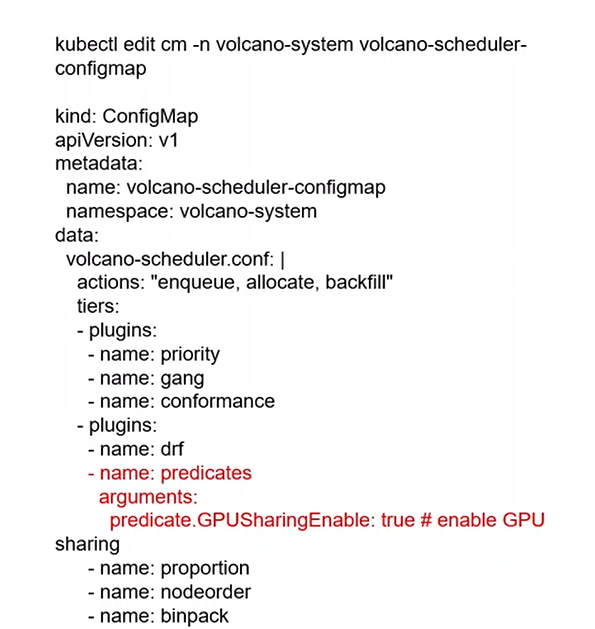

调度配置 :在 Volcano 调度器的配置中启用 GPU 共享功能。通过修改

volcano-scheduler-configmap,设置predicate.GPUSharingEnable: true,让调度器感知并支持显存共享。kubectl edit cm -n volcano-system volcano-scheduler-configmap ... - name: predicates arguments: predicate.GPUSharingEnable: true # enable GPU sharing -

作业提交 :用户在 Pod 或 Volcano Job 的定义中,通过

resources.requests字段指定需要的显存大小(如volcano.sh/gpu-memory: "1024"),并指定schedulerName: volcano,将作业交由 Volcano 调度器处理。 -

调度决策 :Volcano 调度器根据作业的显存请求和节点的可用显存,进行调度决策。调度成功后,会将分配的 GPU 卡序号(

volcano.sh/gpu-index)等信息写入 Pod 的 Annotation 中。 -

执行分配 :调度结果通知 Kubelet 后,Kubelet 调用 Volcano Device Plugin 的

Allocate方法。Device Plugin 会设置关键的环境变量,如:NVIDIA_VISIBLE_DEVICES:指定 Pod 可见的 GPU 卡序号。VOLCANO_GPU_ALLOCATED:Pod 分配到的显存量。VOLCANO_GPU_TOTAL:对应 GPU 卡的总显存量。

-

Pod 运行:Pod 启动后,容器内的应用程序通过读取这些环境变量,即可使用指定的 GPU 显存,实现多任务共享同一张 GPU 卡。

三、实战:在 K8s 中启用 Volcano GPU 显存共享

1. 环境准备

- 一个已安装 NVIDIA GPU 驱动的 K8s 集群。

- 已部署 Volcano(v1.8.0+)和 Volcano GPU Device Plugin。

2. 启用 GPU 共享调度

编辑 Volcano 调度器配置,启用 GPU 共享:

kubectl edit cm -n volcano-system volcano-scheduler-configmap在predicates插件的arguments中添加:

predicate.GPUSharingEnable: true

3. 提交一个共享显存的作业

# gpu-sharing-job.yaml

apiVersion: batch.volcano.sh/v1alpha1

kind: Job

metadata:

name: gpu-sharing-demo

spec:

schedulerName: volcano

minAvailable: 1

tasks:

- name: "worker"

replicas: 2

template:

spec:

containers:

- name: worker

image: nvidia/cuda:11.8.0-base-ubuntu22.04

command: ["sh", "-c", "echo 'GPU index: $NVIDIA_VISIBLE_DEVICES'; echo 'Allocated memory: $VOLCANO_GPU_ALLOCATED'; sleep 3600"]

resources:

requests:

volcano.sh/gpu-memory: "1024" # 请求1GB显存

limits:

volcano.sh/gpu-memory: "1024"

restartPolicy: OnFailure提交作业:

kubectl apply -f gpu-sharing-job.yaml4. 验证共享效果

查看 Pod 的 Annotation,确认分配的 GPU 卡:

kubectl describe pod gpu-sharing-demo-worker-0

...

Annotations:

volcano.sh/gpu-index: 0

volcano.sh/predicate-time: 0

...查看 Pod 日志,确认环境变量:

kubectl logs gpu-sharing-demo-worker-0

GPU index: 0

Allocated memory: 1024可以看到,两个 Pod 都被调度到了同一张 GPU 卡(index 0)上,各自使用 1GB 显存,实现了显存共享。