章节一:Sentinel 原理剖析

一、前言

在微服务架构的洪流中,服务间的每一次调用都像一次冒险。流量突增、依赖故障、系统过载......任何一个环节的"雪崩"都可能引发连锁反应。Sentinel 正是阿里为这场冒险配备的"智能护卫",它以流量为切入点,通过限流、熔断、系统保护等多重手段,守护着分布式系统的稳定性 。

与 Netflix Hystrix 等前辈不同,Sentinel 的设计理念更轻量、更灵活,它不仅关注故障隔离,更强调多样化的流量控制与实时的系统自适应保护。

二、核心设计:从资源定义到规则控制

Sentinel 的核心思想是"资源"与"规则"解耦。任何需要被保护的东西,无论是 Java 方法、HTTP 接口,还是一段代码,都可以被定义为一个"资源"。围绕资源,你可以动态地配置各种"规则",如每秒允许的请求数(QPS)、并发线程数、熔断策略等。

这种设计带来了极大的灵活性。开发者只需在代码中"埋点"定义资源,后续的流控、降级策略都可以通过动态配置实时生效,无需修改代码。

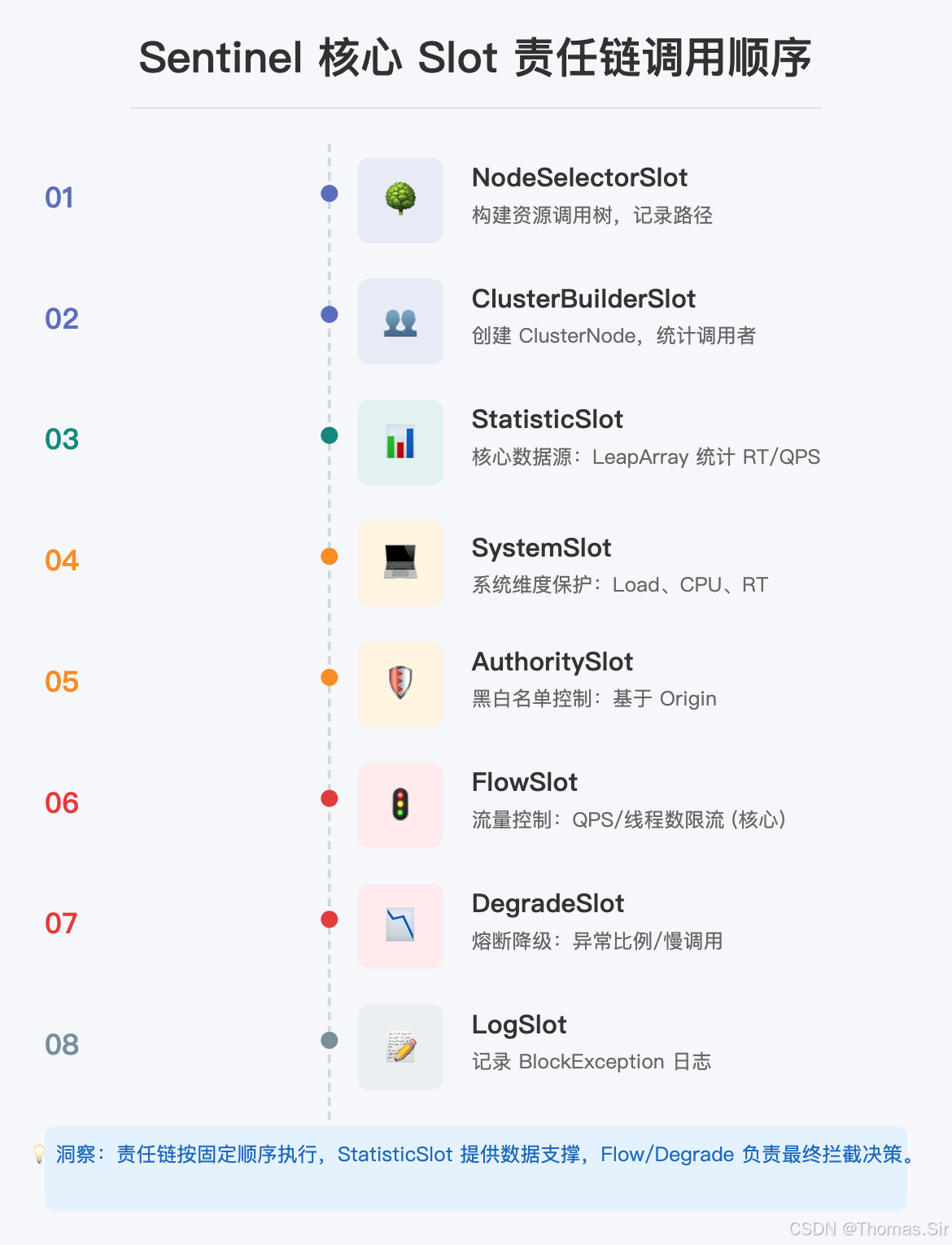

三、工作原理:责任链驱动的插槽模型

Sentinel 的运行时核心是一个名为 ProcessorSlotChain 的责任链。当通过 SphU.entry("resourceName") 尝试进入一个资源时,就会创建或获取该资源对应的 SlotChain,并依次执行链上各个 Slot 的逻辑。

这个链条上的每个 Slot 都各司其职,共同完成统计、校验和控制:

🔗 Slot 责任链详解

1、NodeSelectorSlot

负责收集资源的调用路径,并以树状结构存储,为基于调用链路的限流提供依据。

2、ClusterBuilderSlot

用于构建资源的 ClusterNode(存储资源的集群统计信息,如 QPS、RT)和调用来源节点(origin)。

3、StatisticSlot

这是最核心的统计槽,负责记录、统计不同维度的运行时指标监控信息(如通过数、阻塞数、异常数、响应时间)。其底层采用高性能的滑动窗口数据结构 LeapArray 进行实时统计。

4、SystemSlot

系统保护规则,检查全局的 QPS、线程数、平均 RT、系统负载等,防止系统被压垮。

5、AuthoritySlot

根据配置的黑白名单和调用来源信息,进行授权控制。

6、FlowSlot

根据预设的流量控制规则及前面 Slot 统计的状态,进行流量控制,决定是"通过"还是"拒绝"。

7、DegradeSlot

根据统计信息及预设的规则,进行熔断降级。当资源响应时间过长或异常比例过高时,自动熔断。

前三个 Slot(NodeSelector, ClusterBuilder, Statistic)负责数据统计,后四个 Slot(System, Authority, Flow, Degrade)则根据统计结果和配置规则进行实际控制。任何一个 Slot 判定需要拦截,都会抛出

BlockException终止链条。

四、高性能统计引擎:滑动窗口与 LeapArray

实时、准确的统计是流量控制的基础。Sentinel 的高性能秘诀在于其底层统计结构------滑动窗口(Sliding Window) ,具体实现为 LeapArray。

你可以把它想象成一个环形的时钟表盘,被均匀分割成多个时间格(比如60格,每格代表1秒)。每个时间格(桶)只记录该秒内的统计数据(如通过数、异常数)。随着时间推移,当前指针顺时针移动,过期的桶会被循环复用。统计时,只需累加当前时间窗口内(如最近1分钟)所有有效桶的数据,即可获得实时指标。

这种设计巧妙地将无限的时间流映射到固定大小的数组中,通过计算时间戳与窗口长度的取模运算,实现 O(1) 时间复杂度的数据查找和更新,同时保证了线程安全和高并发写性能。

五、与 Hystrix 的核心差异

Sentinel 常被拿来与 Netflix Hystrix 比较。两者都致力于提升微服务的弹性,但设计哲学和实现方式有显著不同。

| 对比维度 | Sentinel | Hystrix |

|---|---|---|

| 核心关注点 | 流量控制(多样化)、熔断降级、系统负载保护 | 容错机制(隔离与熔断),提供快速失败和回退 |

| 隔离策略 | 信号量隔离(通过并发线程数限流),更轻量 | 线程池隔离(主流)或信号量隔离,隔离彻底但开销大 |

| 熔断降级 | 支持慢调用比例 和异常比例,更精细 | 主要基于失败比率 |

| 流量整形 | 支持慢启动预热 、匀速排队(漏桶)等丰富模式 | 不支持 |

| 规则配置 | 资源与规则解耦,支持多种动态数据源(如 Nacos, ZooKeeper) | 规则与命令绑定,也支持动态配置 |

| 生态与易用性 | 与 Spring Cloud Alibaba 深度集成,提供开箱即用的控制台,适配多种框架 | 集成于 Spring Cloud Netflix,后期维护减弱 |

简而言之,Hystrix 更像一个专注于故障隔离和回退 的"保险丝",而 Sentinel 则是一个功能更全面的流量调度与系统守护平台,尤其在动态流量控制和实时系统保护方面更为强大。

六、实战与扩展

Sentinel 的使用非常灵活。除了基本的 API 埋点(SphU.entry())外,更推荐使用 @SentinelResource 注解,可以方便地指定限流/降级处理方法和 fallback 方法。

其规则不仅可以通过代码硬编码(FlowRuleManager.loadRules()),更强大的功能在于对接各种动态数据源(如 Nacos、Apollo、ZooKeeper),实现规则的热更新。结合 Sentinel Dashboard,你可以可视化地管理规则、监控实时流量、查看调用链路,极大地提升了运维效率。

💡 设计精髓与启示

Sentinel 的成功离不开几个关键的设计选择:

- 职责链模式:将复杂的流量治理流程拆解为独立的 Slot,每个 Slot 职责单一,通过链条串联,易于扩展和维护。

- 滑动窗口统计:采用 LeapArray 实现高性能、低损耗的实时指标统计,这是实现精准控制的基石。

- 资源与规则解耦:使防护逻辑可以独立于业务代码动态调整,符合云原生时代"配置即代码"的理念。

- 轻量级与高性能:核心模块无多余依赖,引入性能损耗极小,使其能够应用于高 QPS 场景。

它告诉我们,一个好的中间件,不仅要有强大的功能,更要有优雅的扩展性、卓越的性能和对开发者友好的体验。

章节二:Sentinel 规则持久化:告别内存,拥抱稳定

在微服务架构中,Sentinel 的流量控制规则如果仅存于内存,服务重启便意味着规则"清零"。规则持久化正是解决这一痛点的关键,它让 Sentinel 从"临时工"升级为"正式员工",确保规则配置在服务重启、实例扩缩容时依然坚如磐石。

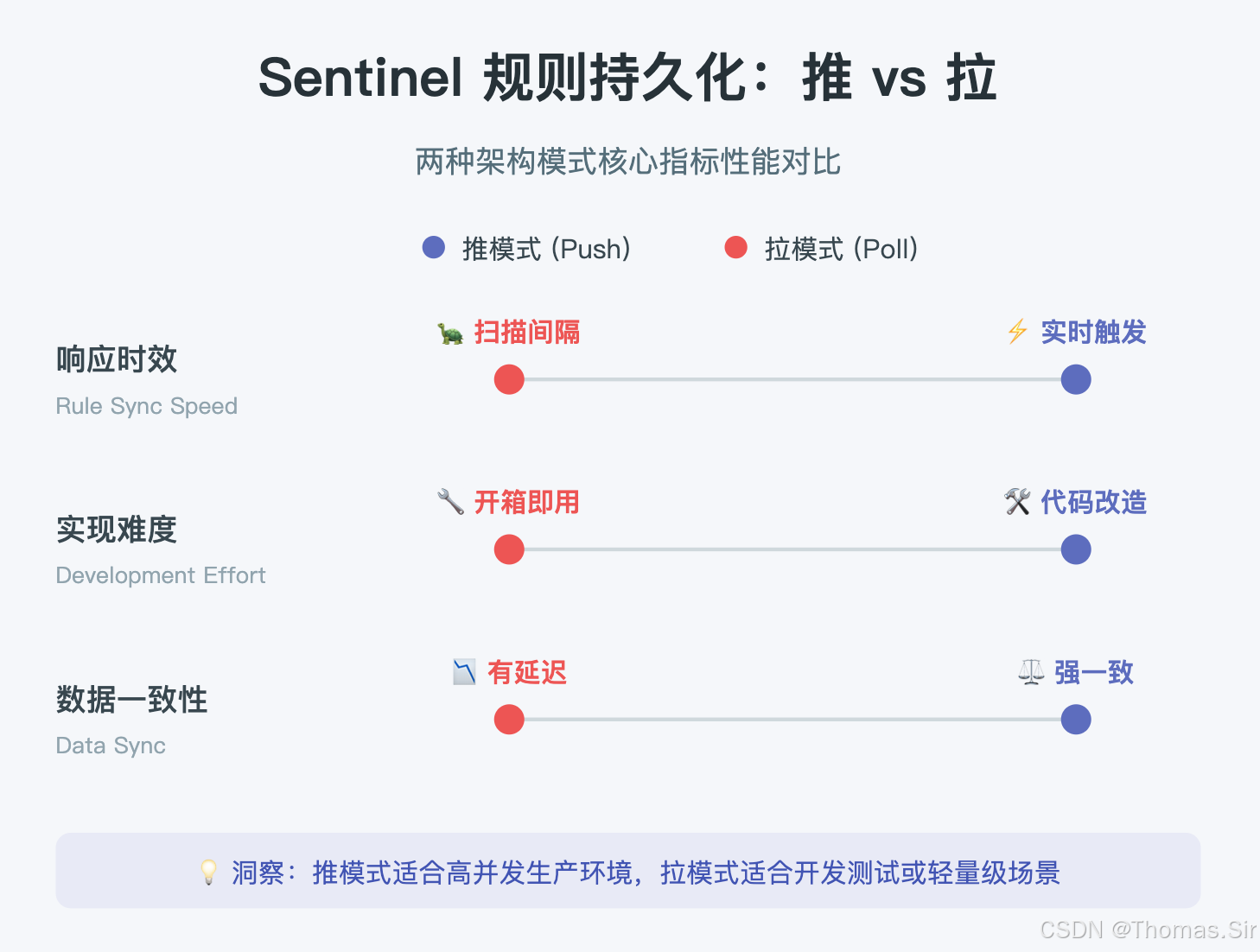

目前主流的持久化方案主要分为 "拉模式" 与 "推模式" 两大流派,并可通过 Nacos、ZooKeeper、Apollo 等主流配置中心实现。

一、两种核心模式:拉与推的博弈

规则持久化的核心在于如何将 Sentinel Dashboard 中配置的规则同步到外部存储,并让客户端应用感知到变化。根据数据流向和触发机制的不同,主要分为两种模式。

🔄 拉模式 (Pull Mode)

客户端定期主动从外部数据源(如本地文件)拉取规则配置。这种方式实现简单,无需修改 Sentinel Dashboard 源码,但存在延迟,规则变更无法实时生效。

核心组件 :主要依赖

sentinel-datasource-extension包,实现RefreshableDataSource(读)和WritableDataSource(写)接口。

🚀 推模式 (Push Mode)

规则中心(如 Nacos)在配置变更时,主动通知客户端。这种方式实时性高,是生产环境推荐方案,但通常需要改造 Sentinel Dashboard,使其将规则写入配置中心。

工作流程:Dashboard 修改规则 → 写入 Nacos/ZooKeeper → 配置中心推送变更 → 客户端监听器接收并更新本地规则。

二、主流配置中心集成方案

无论是拉模式还是推模式,都需要一个可靠的外部存储。以下是三种主流配置中心的集成要点。

| 配置中心 | 核心依赖 | 特点 | 适用场景 |

|---|---|---|---|

| Nacos | sentinel-datasource-nacos |

阿里系产品,与 Sentinel 集成度最高;支持配置管理和服务发现。 | Spring Cloud Alibaba 技术栈;追求开箱即用。 |

| ZooKeeper | sentinel-datasource-zookeeper |

基于 ZNode 和 Watch 机制,实现推送;强一致性保证。 | 对一致性要求极高的分布式系统;已有 ZooKeeper 集群。 |

| Apollo | sentinel-datasource-apollo |

携程开源,提供友好的管理界面;配置发布流程规范。 | 企业级配置管理,需要灰度发布、权限管控。 |

以 Nacos + 推模式 为例,其架构变化如下图所示:规则不再直接推送到客户端,而是由 Sentinel Dashboard 同步到 Nacos 配置中心,客户端通过配置的数据源监听 Nacos 的变化。

三、推模式改造实战(以Nacos为例)

要实现完整的推模式,需要对 Sentinel Dashboard 进行二次开发,使其将规则写入 Nacos,而非直接调用客户端 API。

bash

// 1. 添加依赖

<dependency>

<groupId>com.alibaba.csp</groupId>

<artifactId>sentinel-datasource-nacos</artifactId>

</dependency>

// 2. 应用配置 (application.yml)

spring:

cloud:

sentinel:

datasource:

ds:

nacos:

server-addr: localhost:8848

dataId: ${spring.application.name}-sentinel-flow

groupId: DEFAULT_GROUP

rule-type: flowDashboard 改造核心 :实现 DynamicRulePublisher 和 DynamicRuleProvider 接口,替换默认的规则推送逻辑。

java

@Component("flowRuleNacosPublisher")

public class FlowRuleNacosPublisher implements DynamicRulePublisher<List<FlowRuleEntity>> {

@Autowired

private ConfigService configService;

@Override

public void publish(String app, List<FlowRuleEntity> rules) throws Exception {

// 将规则列表转换为JSON,写入Nacos

configService.publishConfig(

app + "-sentinel-flow",

"DEFAULT_GROUP",

JSON.toJSONString(rules)

);

}

}改造后,在 Dashboard 界面上修改规则,会直接持久化到 Nacos,客户端监听配置变化并实时更新,实现了规则的多实例共享与永久存储。

四、规则数据结构与配置

无论使用哪种配置中心,规则最终都以 JSON 格式存储。了解其数据结构是正确配置的前提。

📝 流控规则 (Flow Rule) 示例

bash

[

{

"resource": "/api/test",

"limitApp": "default",

"grade": 1, // 1: QPS; 0: 并发线程数

"count": 100, // 阈值

"controlBehavior": 0, // 0: 快速失败; 1: WarmUp; 2: 排队等待

"strategy": 0, // 0: 直接; 1: 关联; 2: 链路

"clusterMode": false

}

]其他规则如熔断降级(DegradeRule)、系统保护(SystemRule)等均有对应的 JSON 结构。

五、方案选型与最佳实践

选择持久化方案时,需综合考虑团队技术栈、运维能力和业务需求。

- 评估阶段:若仅用于测试或学习,使用 Sentinel Dashboard 的原始内存模式或拉模式(如文件)即可。

- 生产环境 :强烈推荐推模式,并选择与现有基础设施集成的配置中心(如 Nacos for Spring Cloud Alibaba)。

- 改造注意:推模式需定制 Dashboard,务必做好版本管理和测试,因为 Sentinel 源码的 Controller 和接口可能随版本变化。

- 规则管理:在配置中心管理 JSON 规则,当规则增多时,可读性和维护性会下降,建议结合 CI/CD 进行规则的版本化管理。

规则持久化不仅是技术的选型,更是对系统稳定性的长期投资。它将随意的、易丢失的配置,转变为可追溯、可管理、可共享的资产,是微服务治理走向成熟的关键一步。

章节三、Sentinel集群流控:分布式系统的"中央流量调度器"

当你的微服务集群有数十甚至上百个实例时,单机限流就像让每个士兵各自为战------局部可能守住,但防线整体可能早已被冲垮。Sentinel的集群流控正是为了解决这个"全局视野"问题而生的分布式流量治理方案 。

它通过引入"令牌服务器"(Token Server)这一中心化角色,统一管理整个集群对某个关键资源(如"下单接口")的访问配额,确保无论请求落到哪个实例,总量都不会超过预设的全局阈值。

一、核心架构:中心化的令牌管理模式

Sentinel集群流控的核心思想是"集中管理,分散执行"。它将传统的单机限流决策,升级为由一个中心服务统一协调的分布式决策。

🚦 两大核心角色

Token Server(令牌服务器)

集群中的"交通指挥中心",独立部署或嵌入在某个应用实例中。它维护着全局的流量计数器,掌握着每个受保护资源(如某个API)在整个集群中的实时访问总量,并负责审批各个客户端发来的"通行请求"。

Token Client(令牌客户端)

部署在每个应用实例中的Sentinel客户端。当需要访问受集群保护的资源时,它会向Token Server发起请求,申请"令牌"(Token)。只有拿到令牌,请求才能继续执行;否则将被限流。

这种架构类似于银行系统的总行-分行模式。Token Server是总行,掌握着全行的信贷总额度;每个Token Client(应用实例)就像分行,在发放每一笔贷款(处理每一个请求)前,都需要向总行申请额度,确保不会超发。

二、工作原理:一次请求的完整旅程

当一个请求触发集群流控规则时,在Sentinel的责任链中,会经过一个特殊的ClusterSlot。这个Slot是集群流控的入口,它会拦截请求,并发起一次分布式协调。

具体流程可以分解为以下关键步骤:

- 1. 规则匹配:请求到达资源入口,Sentinel判断该资源是否配置了集群流控规则。

- 2. 令牌申请:Token Client通过Netty等高性能网络框架,向配置好的Token Server发送令牌申请请求,请求中包含了资源名、申请数量(通常是1)等信息。

- 3. 全局裁决 :Token Server收到请求后,查询该资源对应的全局计数器。它内部通常采用滑动时间窗口算法来精确统计过去一段时间(如1秒)内集群已消耗的令牌数。

- 4. 决策与响应 :

- 通过:如果全局计数未超过阈值,则计数器增加,并向Client返回成功响应和令牌。

- 拒绝:如果已超过阈值,则返回失败,请求在Client端被快速失败或进入等待队列(取决于配置)。

- 5. 执行或降级:Client根据Server的响应,决定是放行请求执行业务逻辑,还是执行预设的降级策略(如抛出BlockException、返回兜底数据)。

三、两种部署模式与容灾策略

为了适应不同的架构复杂度和隔离性要求,Sentinel提供了两种主要的Token Server部署模式:

🏗️ 部署模式对比

| 部署模式 | 架构简述 | 优点 | 缺点 | 适用场景 |

|---|---|---|---|---|

| 独立模式 (Alone) | Token Server作为独立进程单独部署,与业务应用完全隔离。 | 隔离性好,资源互不影响;易于维护和升级。 | 架构复杂,需要额外部署和保证其高可用。 | 作为全公司的全局流控服务;对稳定性要求极高的核心链路。 |

| 嵌入模式 (Embedded) | Token Server以库的形式嵌入到某个业务应用实例中,该实例同时承担业务和流控决策。 | 架构简单,无需额外组件;部署灵活。 | 隔离性差,业务流量可能影响流控决策,反之亦然。 | 小规模集群;快速验证;资源隔离要求不高的内部服务。 |

无论采用哪种模式,高可用和故障降级都是必须考虑的核心问题。Sentinel提供了完善的容灾机制:

- 连接失败降级 :当Token Client无法连接到Server时,可以自动降级到本地限流模式(

fallbackToLocalWhenFail=true),根据单机阈值进行流控,保证服务不彻底不可用。 - Server高可用:对于独立模式,需要自行实现Token Server的主备切换或集群方案,例如结合ZooKeeper进行选主,确保中心服务本身的高可用。

四、何时选择集群流控?

集群流控引入了额外的网络开销和架构复杂度,因此并非所有场景都适用。它的价值在以下场景中尤为突出:

1、精确的总量控制场景

例如,一个对外提供的API,购买套餐后每秒最多调用100次。如果服务有10个实例,单机限流设为10QPS,在负载均衡不均匀的情况下,可能总量远未到100次,但某个实例已达10次而被限流,导致总体服务能力未被充分利用。集群流控能确保精确的全局100QPS限制。

2、保护共享稀缺资源

例如,秒杀系统中的库存扣减接口、调用某个有严格配额限制的第三方服务。这些资源的访问总量有严格上限,必须从集群层面进行把控,防止因流量倾斜导致局部过热而整体资源被耗尽。

3、应对不均匀的流量分发

当使用哈希、随机等可能造成请求分布不均的负载均衡策略时,集群流控能弥补单机限流的不足,避免某些实例过早被压垮,而其他实例却处于空闲状态。

相反,对于仅仅为了保护单个实例自身不过载(即"各扫门前雪"),单机限流因其简单、无网络延迟、性能损耗极低,通常是更优的选择。

五、集群流控的本质与启示

从单机到集群,流控的维度从"点"扩展到了"面"。这背后是分布式系统设计思想的典型体现:用中心化的协调来应对分布式的状态不一致问题。集群流控通过引入一个轻量级的中心决策点(Token Server),牺牲了一点性能(网络往返)和复杂度,换来了全局状态的一致性和控制精度。

这也提醒我们,在微服务架构中,并非所有状态都需要去中心化。对于像"全局流量配额"这类需要强一致、精确控制的元信息,一个设计良好、高可用的中心化服务,往往是比复杂的分布式共识算法更简单、更高效的解决方案。