一、前言

GPT(Generative Pre-trained Transformer)不仅是人工智能领域的一次技术突破,更是人类认知边界的一次深刻拓展。本文将从底层原理、技术架构、能力边界到未来趋势,为您提供一份全面、深入的技术剖析。

二、核心原理:G、P、T的三重奏

G

Generative(生成式)

学习数据分布,生成与训练数据相似的新内容。它不是简单的信息检索,而是基于概率的创造性生成。

P

Pre-trained(预训练)

在海量无标签文本上学习通用语言模式,为后续特定任务提供基础能力。

T

Transformer(变换器)

基于自注意力机制,捕捉长距离依赖关系,实现并行计算和高效处理。

三、技术架构:Transformer的深度解析

1. 输入处理:文本到向量的转化

首先进行 令牌化(Tokenization) ,将文本分解为可处理的单元。然后通过 **嵌入表示(Embeddings)**将每个令牌映射为高维向量,这些向量在空间中编码了语义关系。

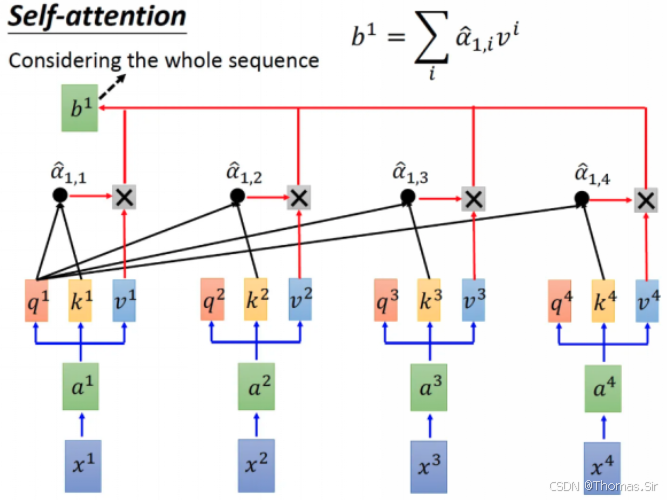

2. 核心机制:自注意力(Self-Attention)

通过 查询(Query) 、 键(Key) 和 **值(Value)**向量计算词与词之间的相关性权重。这种机制让模型能够"关注"句子中最重要的部分,实现对上下文的深刻理解。

3. 多头注意力(Multi-Head Attention)

通过多个并行注意力头,从不同角度分析文本关系。每个头关注不同的语义维度,如语法结构、实体关系、情感倾向等,最后整合所有头的信息得到更全面的理解。

四、能力边界:GPT的"超能力"与"软肋"

🚀 上限能力

超长文本处理:理解并生成百万级Token的内容

涌现能力:突然获得零样本学习、多步推理等新能力

语言无关性:无缝处理任何人类语言,包括Emoji和火星文

创造性生成:生成完全原创的内容,如诗歌、代码、故事

⚠️ 下限限制

事实错误:可能生成与现实不符的信息

幻觉问题:自信地编造不存在的细节

训练数据依赖:知识受限于训练数据范围

可控性差:难以通过参数直接控制输出

五、技术演进:从GPT-1到GPT-5.4的进化之路

GPT-1(2018)

首次将Transformer用于单向语言模型,奠定了现代大语言模型的基础架构。

GPT-2(2019)

展示出强大的零样本迁移能力,能够处理未见过的任务。

GPT-3(2020)

1750亿参数的巨无霸模型,首次展现"涌现"现象,小模型不具备的能力突然出现了。

GPT-4(2023)

多模态能力显著提升,在推理、理解复杂指令方面表现卓越。

GPT-5.4(2026)

具备原生计算机操作能力,可直接控制软件界面,成为真正的"数字员工"。

六、实战应用:如何与GPT高效协作

1. 提示词工程(Prompt Engineering)

通过结构化提示词明确任务目标,如"你是一位资深Java开发者,请用Spring Boot实现..."

2. 思维链(Chain-of-Thought)

让模型展示推理过程,提升复杂问题的解决准确性。

3. 角色扮演(Persona)

通过设定特定身份,让模型以特定风格或专业角度回应。

七、SpringBoot 整合 GPT:从零到一的实战指南

将 GPT 等大语言模型集成到 Spring Boot 应用中,是现代 Java 开发者为应用注入智能交互能力的关键一步。无论是通过官方的 Spring AI 框架,还是直接调用 OpenAI API,都能让你的应用瞬间拥有理解和生成自然语言的能力。

本指南将提供两种主流集成方案的完整代码、配置与最佳实践,助你快速构建智能应用。

方案一:使用 Spring AI(官方推荐)

Spring AI 是 Spring 官方推出的 AI 工程框架,旨在简化 AI 模型与 Spring 应用的集成。它提供了跨 AI 提供商的统一 API,是目前最优雅的集成方式。

1. 项目初始化与依赖配置

首先,通过 Spring Initializr 创建一个新的 Spring Boot 项目。选择 Maven、Java 语言以及 Spring Boot 3.2.4 或更高版本,并添加 Spring Web 依赖。

在项目的 pom.xml 文件中,添加 Spring AI OpenAI Starter 依赖。由于 Spring AI 版本迭代较快,你可能需要配置快照仓库。

XML

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0

http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<parent>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-parent</artifactId>

<version>3.2.4</version> <!-- 建议使用 3.2.x 或更高版本 -->

</parent>

<groupId>com.example</groupId>

<artifactId>spring-ai-demo</artifactId>

<version>0.0.1-SNAPSHOT</version>

<name>spring-ai-demo</name>

<description>Demo project for Spring Boot with Spring AI</description>

<properties>

<java.version>17</java.version>

<spring-ai.version>1.0.0-SNAPSHOT</spring-ai.version> <!-- 请检查最新版本 -->

</properties>

<dependencies>

<!-- Spring Boot Web -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<!-- Spring AI OpenAI Starter (核心依赖) -->

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-openai-spring-boot-starter</artifactId>

<version>${spring-ai.version}</version>

</dependency>

<!-- 测试依赖 -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

</dependencies>

<repositories>

<!-- 添加 Spring 里程碑和快照仓库以获取 Spring AI -->

<repository>

<id>spring-milestones</id>

<name>Spring Milestones</name>

<url>https://repo.spring.io/milestone</url>

<snapshots><enabled>false</enabled></snapshots>

</repository>

<repository>

<id>spring-snapshots</id>

<name>Spring Snapshots</name>

<url>https://repo.spring.io/snapshot</url>

<snapshots><enabled>true</enabled></snapshots>

</repository>

</repositories>

<build>

<plugins>

<plugin>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-maven-plugin</artifactId>

</plugin>

</plugins>

</build>

</project>2. 配置 API 密钥与模型参数

在 application.yml 或 application.properties 中配置你的 OpenAI API 密钥和模型参数。密钥务必妥善保管,不要提交到版本控制系统。

XML

spring:

ai:

openai:

api-key: "sk-your-openai-api-key-here" # 替换为你的真实 API 密钥

# base-url: "https://api.openai.com/v1" # 默认值,通常无需修改

chat:

options:

model: "gpt-3.5-turbo" # 指定使用的模型,如 gpt-4, gpt-3.5-turbo

temperature: 0.7 # 控制输出的随机性 (0.0-2.0)

max-tokens: 500 # 限制生成的最大令牌数3. 核心服务层与控制器

Spring AI 会自动配置 ChatClient 实例,你可以直接注入使用。首先创建一个服务类来封装 AI 调用逻辑。

AIService.java

java

import org.springframework.ai.chat.ChatClient;

import org.springframework.ai.chat.prompt.Prompt;

import org.springframework.ai.openai.OpenAiChatOptions;

import org.springframework.stereotype.Service;

import java.util.Map;

@Service

public class AIService {

private final ChatClient chatClient;

// 通过构造器注入 ChatClient

public AIService(ChatClient chatClient) {

this.chatClient = chatClient;

}

/**

* 基础文本生成方法

* @param prompt 用户输入的提示词

* @return AI 生成的文本响应

*/

public String generateText(String prompt) {

// 调用 chatClient 的 call 方法,发送提示并获取响应

return chatClient.call(prompt);

}

/**

* 高级文本生成方法,支持动态参数

* @param prompt 用户输入的提示词

* @param model 指定模型,如 "gpt-4"

* @param temperature 温度参数,控制创造性

* @return AI 生成的文本响应

*/

public String generateTextWithOptions(String prompt, String model, Double temperature) {

// 构建自定义的聊天选项

OpenAiChatOptions options = OpenAiChatOptions.builder()

.withModel(model)

.withTemperature(temperature)

.build();

// 创建包含自定义选项的 Prompt 对象

Prompt request = new Prompt(prompt, options);

// 调用 generate 方法并获取响应内容

return chatClient.generate(request).getOutput().getContent();

}

}AIController.java

java

import com.example.springaidemo.service.AIService;

import org.springframework.web.bind.annotation.*;

@RestController

@RequestMapping("/api/ai")

public class AIController {

private final AIService aiService;

// 通过构造器注入 AIService

public AIController(AIService aiService) {

this.aiService = aiService;

}

/**

* GET 请求示例:/api/ai/chat?prompt=你好

* @param prompt 用户输入的提示词

* @return AI 生成的响应

*/

@GetMapping("/chat")

public String chat(@RequestParam String prompt) {

return aiService.generateText(prompt);

}

/**

* POST 请求示例,支持 JSON 请求体传递更多参数

* @param request 包含提示词和可选参数的请求体

* @return AI 生成的响应

*/

@PostMapping("/chat/advanced")

public String advancedChat(@RequestBody ChatRequest request) {

// 调用服务层的高级方法,可传递模型和温度参数

return aiService.generateTextWithOptions(

request.getPrompt(),

request.getModel(),

request.getTemperature()

);

}

// 内部类,用于接收 POST 请求的 JSON 数据

static class ChatRequest {

private String prompt;

private String model = "gpt-3.5-turbo"; // 默认模型

private Double temperature = 0.7; // 默认温度

// Getter 和 Setter 方法

public String getPrompt() { return prompt; }

public void setPrompt(String prompt) { this.prompt = prompt; }

public String getModel() { return model; }

public void setModel(String model) { this.model = model; }

public Double getTemperature() { return temperature; }

public void setTemperature(Double temperature) { this.temperature = temperature; }

}

}4. 应用启动与测试

创建主应用类并启动 Spring Boot 应用。

SpringAiDemoApplication.java

java

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

@SpringBootApplication

public class SpringAiDemoApplication {

public static void main(String[] args) {

SpringApplication.run(SpringAiDemoApplication.class, args);

System.out.println("Spring Boot AI 应用已启动!");

}

}启动应用后,你可以使用浏览器、Postman 或 cURL 进行测试:

基础调用 :访问

GET http://localhost:8080/api/ai/chat?prompt=Spring Boot是什么?高级调用 :发送

POST http://localhost:8080/api/ai/chat/advanced,Body 为 JSON:{"prompt": "用Java写一个冒泡排序", "model": "gpt-4", "temperature": 0.3}

方案二:直接调用 OpenAI API

如果你希望更直接地控制 API 调用,或者项目暂时无法升级到支持 Spring AI 的 Spring Boot 版本,可以直接使用 OpenAI 的官方 Java 客户端库。

1. 依赖配置

在 pom.xml 中添加 OpenAI 客户端依赖。

java

<dependencies>

<!-- Spring Boot Web -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<!-- OpenAI Java Client -->

<dependency>

<groupId>com.theokanning.openai-gpt3-java</groupId>

<artifactId>service</artifactId>

<version>0.16.0</version> <!-- 请检查最新版本 -->

</dependency>

<!-- 可选:Lombok 简化代码 -->

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<optional>true</optional>

</dependency>

</dependencies>2. 配置与实体类

在 application.properties 中配置 API 密钥,并创建请求与响应的数据模型。

java

# OpenAI 配置

openai.api.key=sk-your-openai-api-key-here

openai.api.model=gpt-3.5-turbo

openai.api.timeout=60 # 超时时间(秒)ChatRequest.java & ChatResponse.java

java

import lombok.Data;

import java.util.List;

@Data

public class ChatRequest {

private String model = "gpt-3.5-turbo";

private List<Message> messages;

private Integer n = 1;

private Double temperature = 0.7;

private Integer max_tokens;

@Data

public static class Message {

private String role; // "user", "assistant", "system"

private String content;

}

}

// 响应实体

package com.example.openaidemo.dto;

import lombok.Data;

import java.util.List;

@Data

public class ChatResponse {

private String id;

private String object;

private Long created;

private String model;

private List<Choice> choices;

private Usage usage;

@Data

public static class Choice {

private Integer index;

private Message message;

private String finish_reason;

}

@Data

public static class Message {

private String role;

private String content;

}

@Data

public static class Usage {

private Integer prompt_tokens;

private Integer completion_tokens;

private Integer total_tokens;

}

}3. 服务层与 HTTP 调用

创建服务类,使用 RestTemplate 或 WebClient 直接调用 OpenAI 的 Chat Completions API。

OpenAIService.java

java

import com.example.openaidemo.dto.ChatRequest;

import com.example.openaidemo.dto.ChatResponse;

import lombok.extern.slf4j.Slf4j;

import org.springframework.beans.factory.annotation.Value;

import org.springframework.http.*;

import org.springframework.stereotype.Service;

import org.springframework.web.client.RestTemplate;

import javax.annotation.PostConstruct;

import java.util.*;

@Service

@Slf4j

public class OpenAIService {

@Value("openai.api.key")privateStringapiKey;@Value("{openai.api.model}")

private String model;

private static final String OPENAI_URL = "https://api.openai.com/v1/chat/completions";

private RestTemplate restTemplate;

@PostConstruct

public void init() {

this.restTemplate = new RestTemplate();

// 可以在这里配置连接超时、读取超时等

}

/**

* 调用 OpenAI Chat API 的核心方法

* @param userPrompt 用户输入的提示

* @return AI 生成的回复文本

*/

public String getChatResponse(String userPrompt) {

try {

// 1. 构建请求头

HttpHeaders headers = new HttpHeaders();

headers.setContentType(MediaType.APPLICATION_JSON);

headers.setBearerAuth(apiKey); // 使用 Bearer Token 认证

// 2. 构建消息列表

ChatRequest.Message userMessage = new ChatRequest.Message();

userMessage.setRole("user");

userMessage.setContent(userPrompt);

ChatRequest requestBody = new ChatRequest();

requestBody.setModel(model);

requestBody.setMessages(Collections.singletonList(userMessage));

requestBody.setTemperature(0.7);

// 3. 构建 HTTP 实体

HttpEntity<ChatRequest> requestEntity = new HttpEntity<>(requestBody, headers);

// 4. 发送 POST 请求

ResponseEntity<ChatResponse> response = restTemplate.exchange(

OPENAI_URL,

HttpMethod.POST,

requestEntity,

ChatResponse.class

);

// 5. 处理响应

if (response.getStatusCode() == HttpStatus.OK && response.getBody() != null) {

ChatResponse chatResponse = response.getBody();

if (!chatResponse.getChoices().isEmpty()) {

return chatResponse.getChoices().get(0).getMessage().getContent();

}

}

return "抱歉,AI 没有返回有效结果。";

} catch (Exception e) {

log.error("调用 OpenAI API 失败", e);

return "调用 AI 服务时发生错误: " + e.getMessage();

}

}

/**

* 支持多轮对话的方法(简单示例,实际需持久化历史)

* @param conversationHistory 对话历史记录

* @param newUserMessage 用户新消息

* @return AI 回复及更新后的历史

*/

public Map<String, Object> chatWithHistory(List<ChatRequest.Message> conversationHistory, String newUserMessage) {

// 添加用户新消息到历史

ChatRequest.Message userMsg = new ChatRequest.Message();

userMsg.setRole("user");

userMsg.setContent(newUserMessage);

conversationHistory.add(userMsg);

// 构建本次请求(发送整个历史)

ChatRequest request = new ChatRequest();

request.setModel(model);

request.setMessages(conversationHistory);

// ... (发送请求逻辑与 getChatResponse 类似)

// 获取 AI 回复后,将其作为 "assistant" 消息加入历史

// 返回 AI 回复和更新后的历史

// 此处为示例,返回简化结果

Map<String, Object> result = new HashMap<>();

result.put("aiResponse", "这是模拟的 AI 回复。");

result.put("updatedHistory", conversationHistory);

return result;

}

}两种方案对比与选型建议

1. Spring AI 方案

优点 :官方维护,抽象层次高,支持多模型提供商(OpenAI、Azure、Anthropic等),未来生态好,代码简洁。

缺点 :较新,版本可能不稳定,依赖 Spring Boot 3.2+。

适用场景:新建项目、希望快速集成且未来可能切换模型提供商。2. 直接调用 API 方案

优点 :控制力强,兼容性好(支持 Spring Boot 2.x),不依赖特定框架。

缺点 :代码量稍多,需要自己处理 HTTP 请求、错误和序列化。

适用场景:遗留项目升级、需要精细控制请求/响应、或暂时无法升级 Spring Boot 版本。

进阶配置与最佳实践

在实际生产环境中,你需要考虑更多因素以确保应用的稳定性、安全性和性能。

1. 配置管理(安全第一)

绝对不要将 API 密钥硬编码在代码中或提交到代码仓库。使用环境变量或配置中心。

使用环境变量 (推荐)

# 在系统环境变量或启动参数中设置 export OPENAI_API_KEY=sk-your-key-here # 在 application.yml 中引用 spring: ai: openai: api-key: ${OPENAI_API_KEY}

2. 异常处理与重试

网络调用可能失败,需要完善的异常处理和重试机制。

java

import org.springframework.ai.openai.api.OpenAiApiException;

import org.springframework.http.ResponseEntity;

import org.springframework.web.bind.annotation.ExceptionHandler;

import org.springframework.web.bind.annotation.RestControllerAdvice;

@RestControllerAdvice

public class GlobalAIExceptionHandler {

@ExceptionHandler(OpenAiApiException.class)

public ResponseEntity<String> handleOpenAiApiException(OpenAiApiException ex) {

// 记录日志

// 根据异常类型返回友好的错误信息

return ResponseEntity.status(503)

.body("AI 服务暂时不可用,请稍后重试。错误详情: " + ex.getMessage());

}

@ExceptionHandler(Exception.class)

public ResponseEntity<String> handleGenericException(Exception ex) {

return ResponseEntity.status(500)

.body("服务器内部错误: " + ex.getMessage());

}

}3. 连接池与超时设置

对于直接调用 API 的方案,配置 RestTemplate 的连接池和超时时间至关重要。

java

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

import org.springframework.http.client.HttpComponentsClientHttpRequestFactory;

import org.springframework.web.client.RestTemplate;

import java.util.concurrent.TimeUnit;

@Configuration

public class RestTemplateConfig {

@Bean

public RestTemplate openAiRestTemplate() {

// 使用 HttpComponentsClientHttpRequestFactory 以获得更多配置选项

HttpComponentsClientHttpRequestFactory factory = new HttpComponentsClientHttpRequestFactory();

// 连接超时 (单位: 毫秒)

factory.setConnectTimeout(10000);

// 读取超时

factory.setReadTimeout(30000);

// 连接请求超时

factory.setConnectionRequestTimeout(5000);

RestTemplate restTemplate = new RestTemplate(factory);

// 可以添加拦截器,例如用于统一添加请求头或日志记录

// restTemplate.getInterceptors().add(...);

return restTemplate;

}

}核心要点总结

依赖选择 :新项目优先使用 Spring AI ,老项目或需要精细控制可选用 OpenAI Java Client 或直接 HTTP 调用。

密钥安全:API 密钥必须通过环境变量或配置服务器管理,严禁硬编码。

模型参数 :

temperature(创造性,0-2)、max_tokens(输出长度)和model(模型版本)是影响效果和成本的关键参数。错误处理:网络超时、额度不足、模型过载等异常必须被捕获并优雅处理。

性能优化:考虑对频繁且结果固定的查询进行缓存,对耗时的生成请求采用异步处理。