最近想玩小龙虾openclaw,但是大模型调用不足,幸好Atomgit提供免费大模型调用啦!

踩坑完毕,这三个免费模型也没法用在小龙虾上。

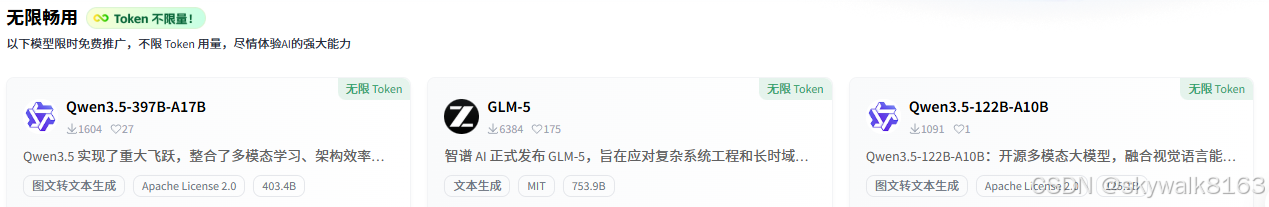

三种模型:

选用模型

首先登录网站:Atomgit AI社区 - 昇腾模型服务

然后找到模型,比如glm-5模型

废弃部分(这里走了弯路了)

点击api文档:

python

import http.client

import json

conn = http.client.HTTPSConnection("api.atomgit.com")

payload = json.dumps({

"temperature": 0,

"top_k": 0,

"top_p": 0,

"frequency_penalty": 0,

"messages": [

"string"

],

"model": "string",

"maxTokens": 0

})

headers = {

'Content-Type': 'application/json',

'Accept': 'application/json',

'Authorization': '个人令牌'

}

conn.request("POST", "/api/v5/chat/completions", payload, headers)

res = conn.getresponse()

data = res.read()

print(data.decode("utf-8"))说实话,我没看懂,为什么不用openai调用啊?

当然我也不想屈从与openai,问题是目前openai是最兼容的啊!

curl是这样的:

python

curl -L 'https://api.atomgit.com/api/v5/chat/completions' \

-H 'Content-Type: application/json' \

-H 'Accept: application/json' \

-H 'Authorization: 个人令牌' \

-d '{

"temperature": 0,

"top_k": 0,

"top_p": 0,

"frequency_penalty": 0,

"messages": [

"string"

],

"model": "string",

"maxTokens": 0

}'调用模型

是我唐突了,给了例子的,应该这样用,点击在线体验:

然后就能看到调用代码了:

Max Tokens 最大可以设置为4k,所以这些模型可以一试,但无法再AI agent如OpenClaw里面使用。

详细curl调用::

python

curl https://api-ai.gitcode.com/v1/chat/completions \

-H "Authorization: Bearer mhhsCRBz13zFRKjVWbfPkG9P" \

-H 'Content-Type: application/json' \

-d '{

"model": "zai-org/GLM-5",

"messages": [

{

"role": "user",

"content": "告诉我一个有关宇宙的有趣事实?"

}

],

"stream": true,

"max_tokens": 2048,

"temperature": 0.6,

"top_p": 0.95,

"top_k": 50,

"frequency_penalty": 0,

"thinking_budget": 32768

}'openai调用是这样的:

python

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api-ai.gitcode.com/v1",

api_key="mhhsCRBz13zFRKjVWbfPkG9P",

)

stream = client.chat.completions.create(

model="zai-org/GLM-5",

messages=[

{

"role": "user",

"content": "告诉我一个有关宇宙的有趣事实?"

}

],

stream=True,

max_tokens=2048,

temperature=0.6

)

for chunk in stream:

print(chunk.choices[0].delta.content, end = "")看了一下,key可能经常变动的。

qwen模型是这样的:

python

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api-ai.gitcode.com/v1",

api_key="ibhrNs-rpyPoyLaXUvd6xvM",

)

stream = client.chat.completions.create(

model="Qwen/Qwen3.5-122B-A10B",

messages=[

{

"role": "user",

"content": [

{

"type": "image_url",

"image_url": {

"url": "data:image/jpeg;base64,iVBORw0KGgoAAAANSUhEUgAA..."

}

},

{

"type": "text",

"text": "用一句话描述这张图片"

}

]

}

],

stream=True,

max_tokens=1024,

temperature=0.7

)

for chunk in stream:

print(chunk.choices[0].delta.content, end = "")第一次晚上试用的时候发现很长时间没有响应,我估计服务被冲了吧?

后来第二天再测试,就正常了。

后来仔细看了一下,它的上限:调用上限500 次/分钟

是全国所有人的总上限吗?那没法玩了...

速度

速度,有时候开了thinging之后有些慢:

推理

42秒内完成

总结

免费调用,但是token最大4k,所以无法在OpenClaw等AI智能体里使用。

刚开始服务有时候不太稳定,现在可能越来越稳定了。

对一些小项目,比如智能问答,酒馆应用等,还是可以一用的。