本文首发于公众号「技术落地手记」,一个国企技术管理者的实战笔记。关注回复「落地」获取更多技术管理实践。

上次写过一篇 用了12年CD系统,我在2026年用AI把它替换掉了,讲我们把CD系统换成自研系统的事。

那篇发出来之后,有几位同行后台聊过,说他们也在折腾类似的事。今天这篇算上一篇的续集,讲新系统跑了一段时间之后,又冒出来的新问题。

先说结论:研发环节用上AI之后,效率确实涨了一截,但测试这个环节没动,于是它从原来的"看起来还行"变成了现在的"明显拖后腿"。

研发提速之后,测试就堵在那里

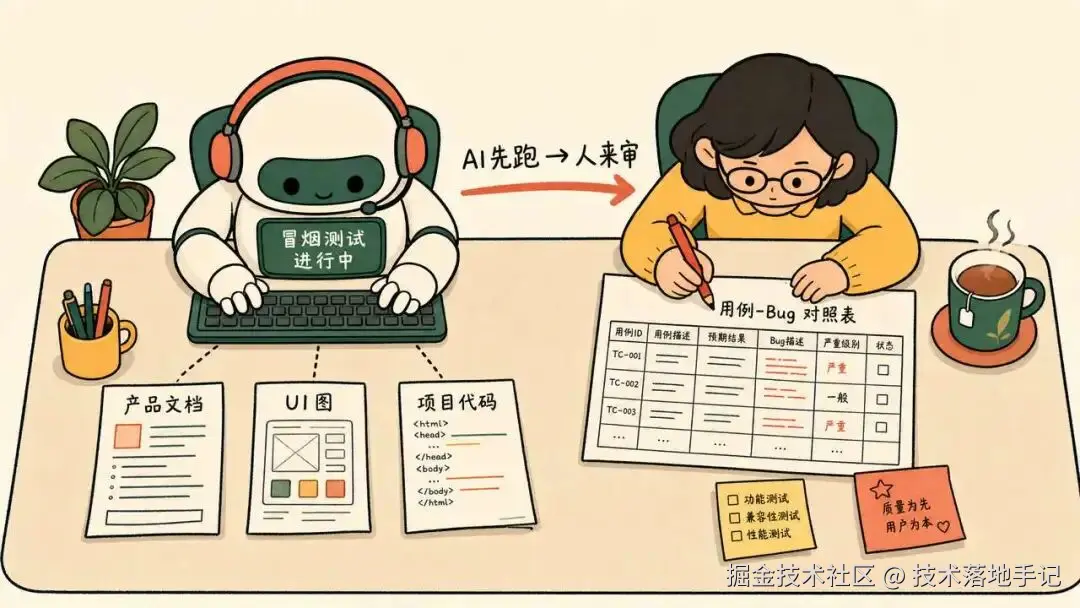

需求分析、产品文档、架构方案、代码,这几个环节我们都接了AI辅助。不是百分之百靠它,是开发同事先用AI跑一版,自己再过一遍。

这种节奏下,一个中等需求原来要走三天的,现在一天多就能进入提测。

听起来是好事。但提测之后画风就变了。

测试同事原来一周接3个需求,节奏刚刚好。现在一周来5个,写测试用例、执行用例、提Bug、回归,全是手工的。AI在前面跑得越快,测试这边堆得越多。

有一周连续加班,测试同事跟我说:你们前面拿AI跑,后面让我用手干,这账你算过吗。

我当时没接上话。账确实没算过。

为什么以前没动测试

老实说,AI能不能用在测试,我心里一直有数,但一直没动手。

一是测试这个环节比代码生成复杂。代码错了好回滚,测试错了你还不一定发现,悄悄漏过去就上了线,风险更难控。

二是没现成的路子可抄。研发用AI业内案例已经一大把,测试这块大家都在试,没几家把整条链路跑通。

三是我们之前在CD系统上,CD系统是封闭系统,想接也接不进去。

但这三个理由,到现在已经站不住了。

模型这一年的进步比预想的快,做点用例生成、UI自动化这种事,能力是够的。研发系统自研之后,整条链子在自己手里,想接哪里接哪里,没人挡着。最重要的是,测试这个瓶颈是真痛,再不解决就要给项目排队。

这条AI测试链路是怎么走的

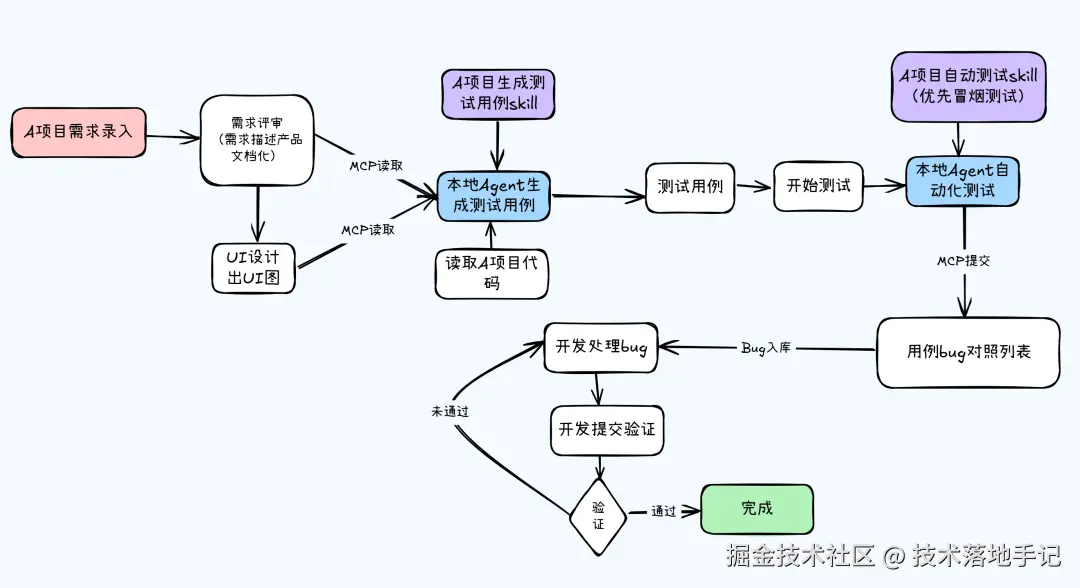

整体思路是把"AI生成测试用例 + AI执行测试 + Bug自动入库"这条链子,嵌到自研系统里。流程大致是这样:

需求录入之后走需求评审,评审通过后产品文档落地、UI图出来。这两份东西通过MCP读到本地Agent,Agent再去读这个项目的代码,三份信息合在一起,生成测试用例。这一步用一个专门为这个项目调好的skill来跑。

测试用例生成完之后,本地Agent开始自动化测试,优先跑冒烟,先把主流程兜一遍。这步也是一个项目专属的测试skill,因为不同项目的环境、依赖、登录态都不一样,得做项目级的适配,通用skill不顶用。

测试跑完之后,结果通过MCP回写到自研系统,形成"用例-Bug对照表"。Bug自动入库,分配给开发。开发改完提验证,验证不过就回到改Bug那一步,验证通过就走完一个完整闭环。

整个过程里,测试同事的角色变了。原来是一线执行者,现在是审核者:审AI生成的用例靠不靠谱,审AI跑出来的Bug是真的还是假阳性。

AI测试流程图

几个关键的取舍

为什么是项目专属skill,不是通用工具?

我们试过通用的测试用例生成工具,效果一般,用例都是大路货,缺对项目业务的理解。每个项目自己的skill,可以把这个项目的业务规则、边界条件、历史踩过的坑都喂进去,生成出来的用例才有针对性。

为什么是本地Agent,不是云端服务?

代码不出本地是底线。云端方案虽然方便,但代码、UI图、产品文档都得传出去,过不了内部安全这一关。本地Agent慢一点,但合规上没问题,长期看也省钱。

为什么先做冒烟,不是全量?

全量UI自动化是个无底洞,界面变一下用例就要维护一轮,投入产出不划算。冒烟覆盖主流程,每次发版必跑,把"明显坏了"先挡住,剩下的复杂场景人来兜。这个分工更现实。

能解决什么,不能解决什么

能解决的:

测试用例从"凭经验从零写"变成"有产物垫底再调整",写用例的时间能省一大半。

冒烟测试不再占人,每次发版自动跑,测试同事腾出手做更深的探索测试。

Bug从"测出来再手工录"变成"跑完自动入库",少一道转抄的工。

不能解决的:

复杂业务逻辑、奇怪的边界用例,AI还是看不到,得靠测试同事的经验。

线上环境特有的问题,Agent本地再怎么跑也跑不出来。

跨系统的集成测试,AI能帮忙搭场景,但判断结果对不对,还是人来看。

我希望大家对这件事的预期不要拉太高。AI不是来替代测试的,是把测试的活分一层出来:低层重复性的让AI干,高层判断性的留给人。

写在最后

现在还在搭的阶段,第一个版本这个月底能跑起来。等真跑一段时间之后,再写一篇复盘。

跟上次自研CD系统替代品的逻辑一样:以前算不过来的账,现在算过来了。AI辅助编程改变的不是代码质量,是自研的决策门槛;这次AI辅助测试改变的也不是测试质量,是"要不要把测试自动化做起来"这个老问题的答案。以前做这件事得专门组个自动化测试组,现在一个本地Agent加一套skill就能起步。

如果你的团队也卡在测试这个环节,先想清楚一件事:你们的瓶颈是用例不够,还是执行不过来,还是回归太重。这三个问题对应的解法不一样,别一上来就上工具,先搞清楚自己卡的是哪一段。

以上是我们正在踩的路,不一定走得通,仅供参考。

如果你也在折腾类似的事,欢迎后台聊聊。