让 OpenClaw 帮干活还不够,现在,程序员们正想方设法让龙虾自己变强。

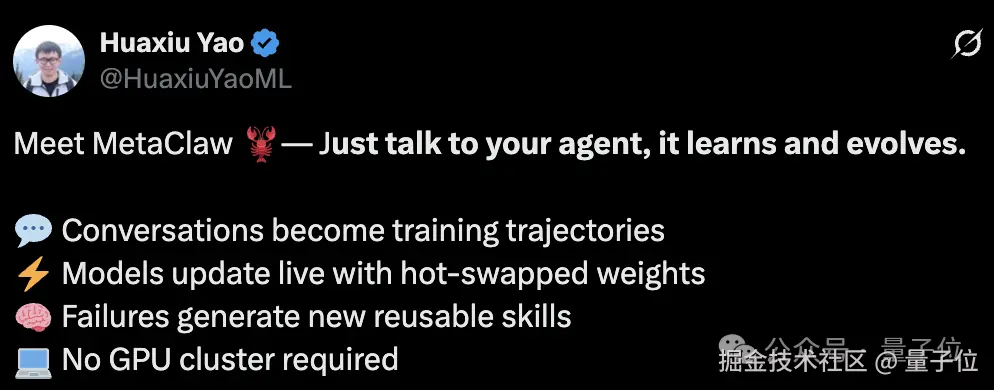

注意注意!还不是某个任务上的单点提升,这次有人直接给整个智能体套一层在线强化学习系统 MetaClaw------

不用自己维护 GPU 集群、不用数据集也无需人工微调,让 AI 跟你聊着聊着就能自己变聪明。

这种新的学习模式就是把用户和 AI 的日常对话直接变成训练数据,整个学习循环全在后台完成,也不耽误正常使用。

咱平时跟 AI 该聊啥聊啥,MetaClaw 会默默拦截 OpenClaw 的交互过程,给每一轮对话打分,再通过在线微调优化 AI 的决策策略。

而且它还吃一堑长一智,要是 AI 哪句话翻车了,MetaClaw 会自动扒完整的交互轨迹,分析问题出在哪,然后自动生成一个新技能存进技能库。

下次再遇到类似的坑,相关技能会被精准搜索出来注入系统提示,同款错误直接拜拜。

技能注入 + 技能进化

模型底座基于 Kimi-2.5 构建,同时也准备了 Qwen3-4B 这个轻量级替代方案,低配设备也能跑。

核心机制是自研的 SkillRL 技能增强强化学习框架 ,说白了就是技能注入 + 技能进化的组合拳。

-

技能注入

每轮对话里精准匹配相关技能指令,不用等训练结束,AI 当场就能优化表现;

-

技能进化

让 AI 从被动接收指令变成主动生成技能,技能库越用越丰富,能力水涨船高。

而最吸引人的,是不依赖本地 GPU 集群,不用自己维护这个设定。

MetaClaw 把所有训练任务全甩给了 Tinker 云平台,训练和部署彻底分家。

只要你的设备能连上网,就能跑通整个系统,不用操心算力,也不用专门的工程团队盯着维护。

这波直接把 AI 持续学习的门槛干到了地板级,普通人也能养出会进化的龙虾了。

除此之外,MetaClaw 的细节设计也很懂开发者的痛点。

异步架构 + 双学习模式,把服务、奖励建模和训练彻底解耦,AI 一边给用户实时响应,后台一边做打分和优化,"工作学习" 两不耽误。

学习模式也给足了选择,想轻量化就用强化学习,从用户隐式反馈里优化;想深度提升就用在线策略蒸馏,结合高质量文本反馈进阶。

主打一个你想怎么训就怎么训。

三步上手

用起来还贼简单,就 3 步。

第一步先安装依赖,前面的是常规服务和大模型相关库,跑 API、发请求、接大模型都用得上。

后面的 tinker 和 tinker-cookbook 是关键,这是云端 LoRA 训练的 SDK。

- pip install fastapi uvicorn httpx openai transformers

- pip install tinker tinker-cookbook

第二步运行配置脚本将 OpenClaw 网关指向 MetaClaw 的代理,比较推荐的是 Kimi2.5.

- bash openclaw_model_kimi.sh

第三步是设置 Tinker API 密钥,直接跑训练脚本。

- export TINKER_API_KEY="xxx"

- cd /path/to/metaclaw

- python examples/run_conversation_rl.py

搞定,之后你只需要像平常一样和 Agent 聊天,MetaClaw 会自动收集对话轮次、评分、训练模型。

每攒够一批样本就热替换一次权重,全程无需人工干预。

如果想启用技能注入,只需在配置中设置:

- config = MetaClawConfig(use_skills=True)

想开始技能进化,可以设置(以 GPT5.2 为例):

- config = MetaClawConfig(

use_skills=True,

enable_skill_evolution=True,

azure_openai_deployment="gpt-5.2",

)

然后配好密钥:

- export AZURE_OPENAI_API_KEY="xxx"

- export AZURE_OPENAI_ENDPOINT="your-endpoint.openai.azure.com/"

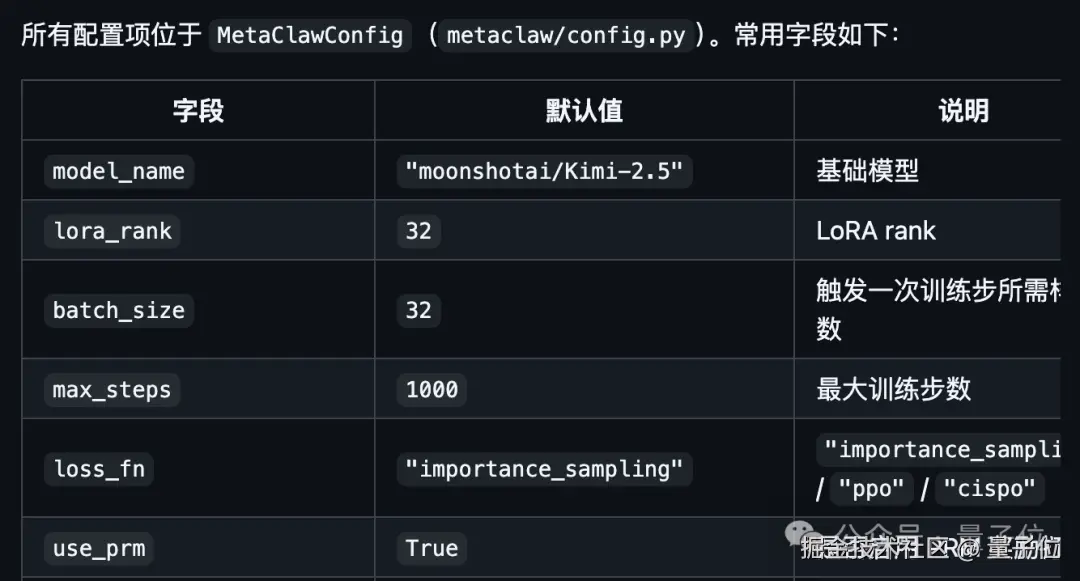

所有配置项都集中在 MetaClawConfig 中,包括模型选择、LoRA 参数、批次大小、训练步数、损失函数类型等,一目了然。

好好好,这下变成真 · 养虾了(doge)。

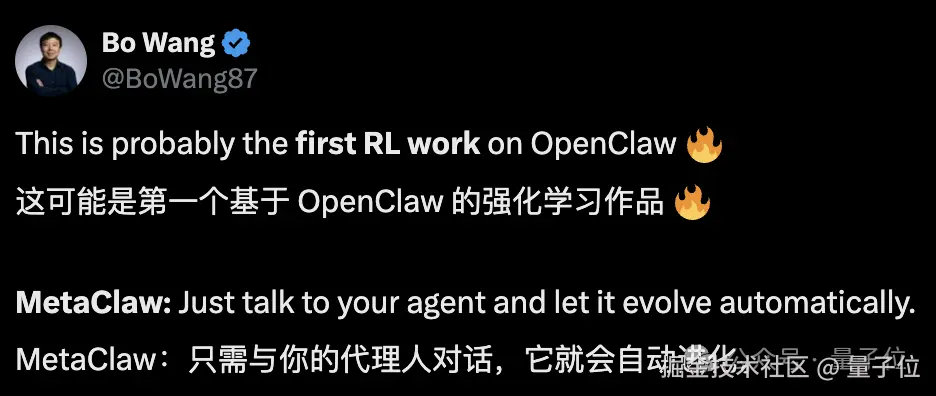

MetaClaw 这项工作由姚骅修领导,他是电子科技大学校友,现任 UNC 计算机科学系的助理教授,曾在 Stanford AI Lab 做博士后,专注于 Agent 和具身 AI。

项目地址:github.com/aiming-lab/...

参考链接:

[1]x.com/BoWang87/st...

[2]x.com/HuaxiuYaoML...

欢迎在评论区留下你的想法!

--- 完 ---