体验了一下lm studio,感觉lm studio对新手更加友好,它有一整套UI,并且设置比较完善,基本上可以靠点鼠标把事情做完了,包括模型下载、测试、网络接口、自身配置等。

尽管部分高级功能需要登录且付费使用,但是本地用基本不需要。

它会自动识别本地硬件(N卡、A卡、苹果M)并使用对应的加速引擎,并且对外做服务的时候有少量的并发(4个),体验上来说这点要强过ollama了。

下载:

这里会自动给你选好平台的,直接下载就行了。

第一次运行它会让你下载第一个模型、以及登录,跳过,不需要。

启动后界面:

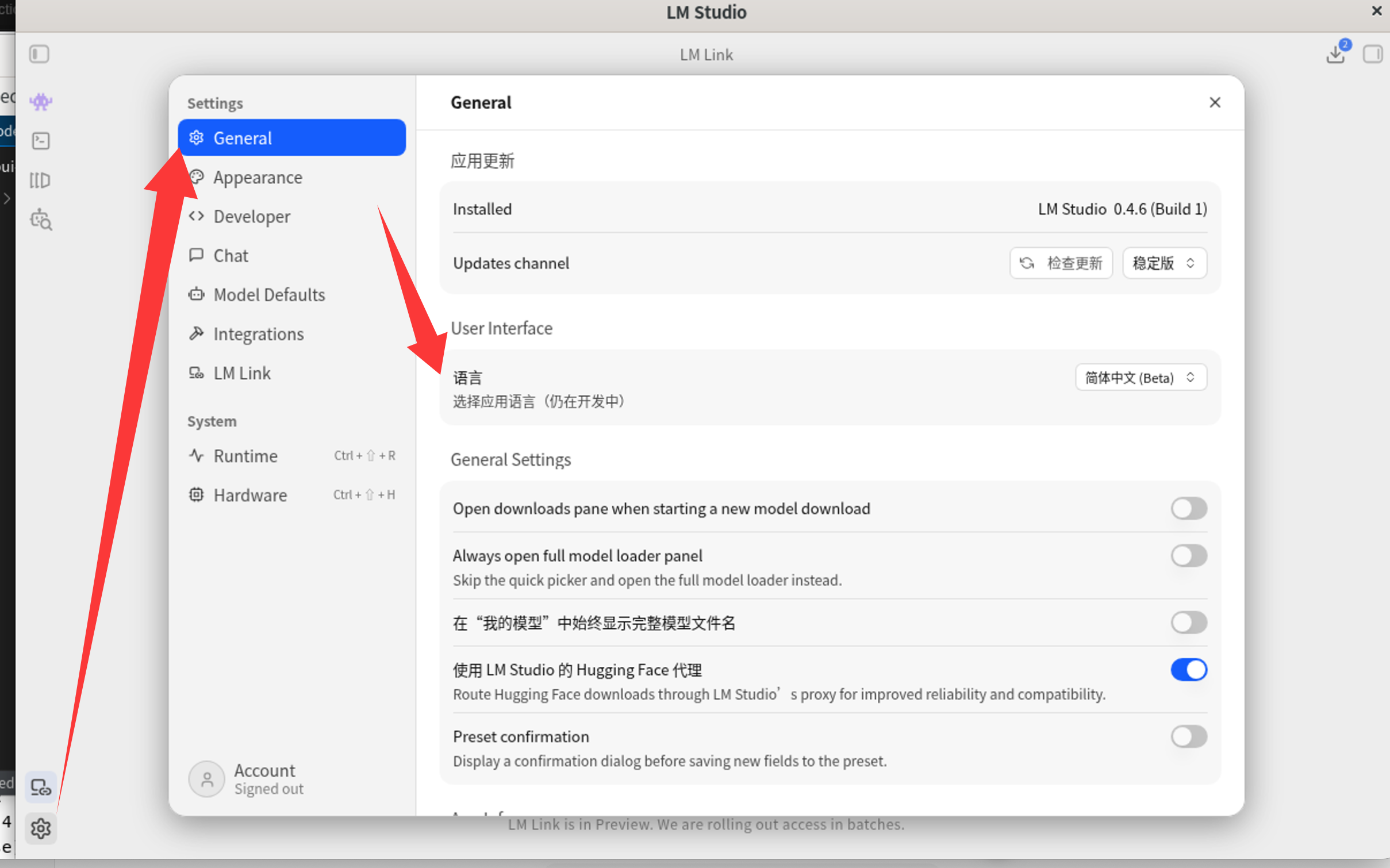

可选简体中文,但不是很完善。

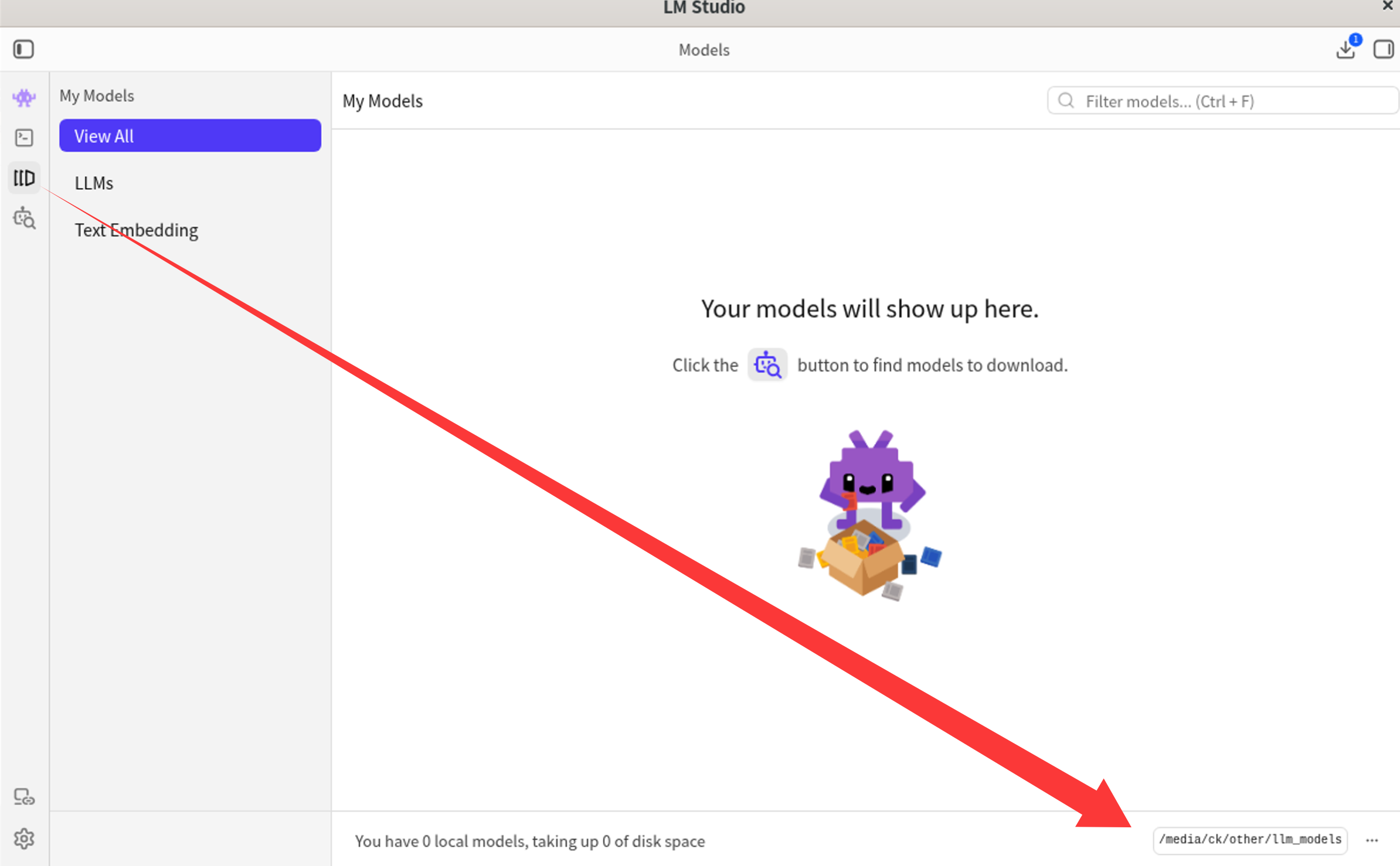

先改模型存储路径,避免变成C盘战士:把模型存储路径换到后面的盘

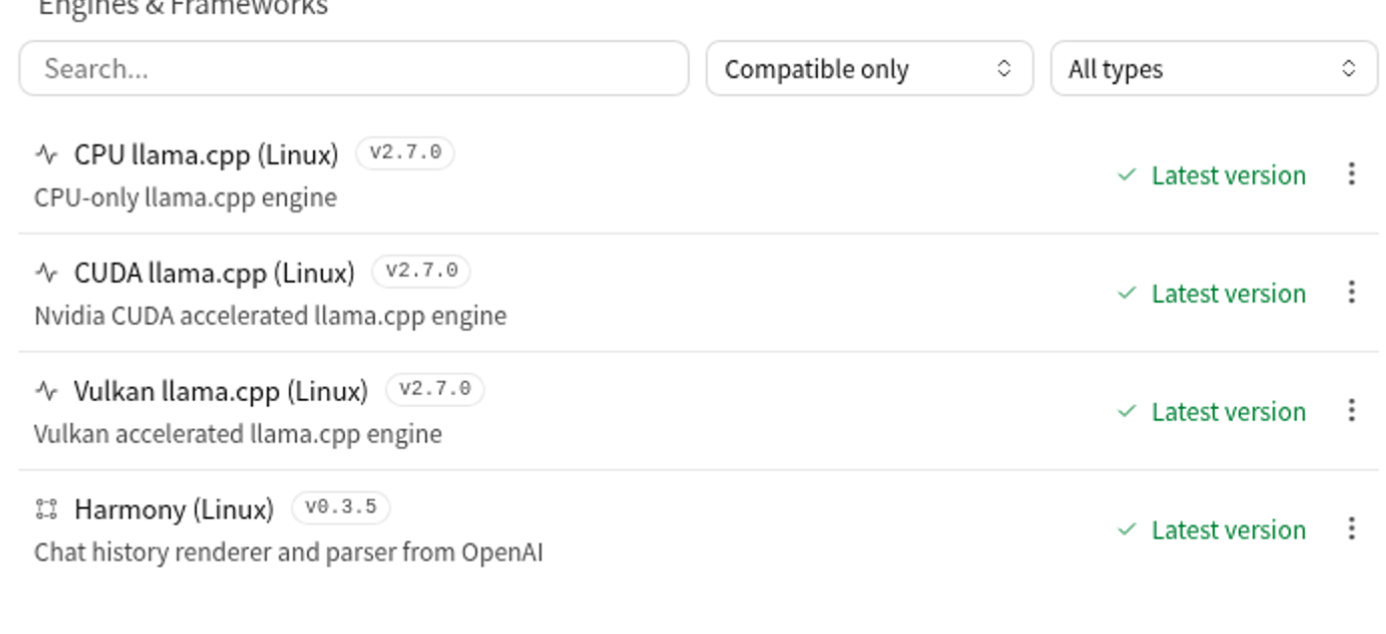

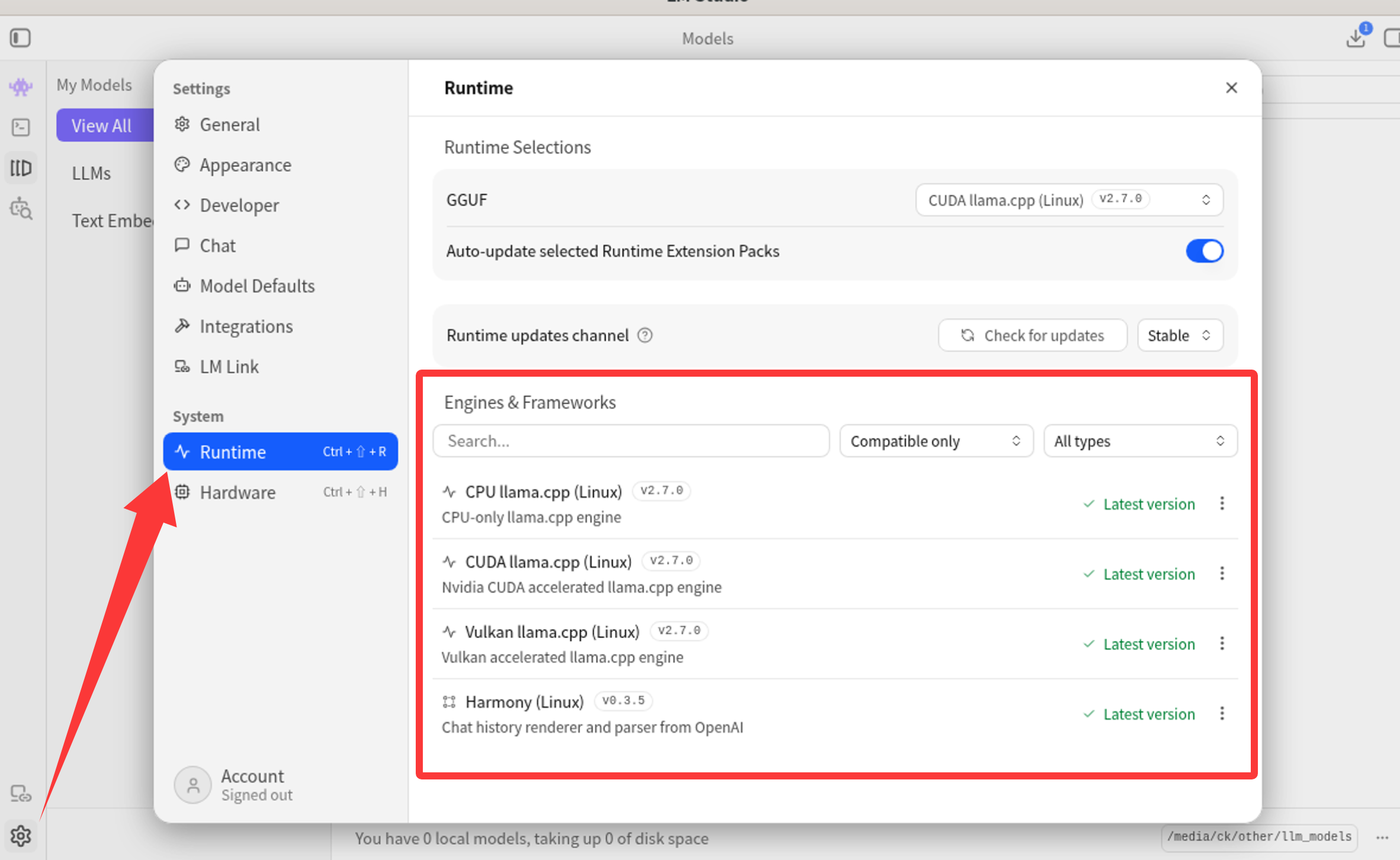

然后更新模型的驱动引擎:这里有显示的都更新就好

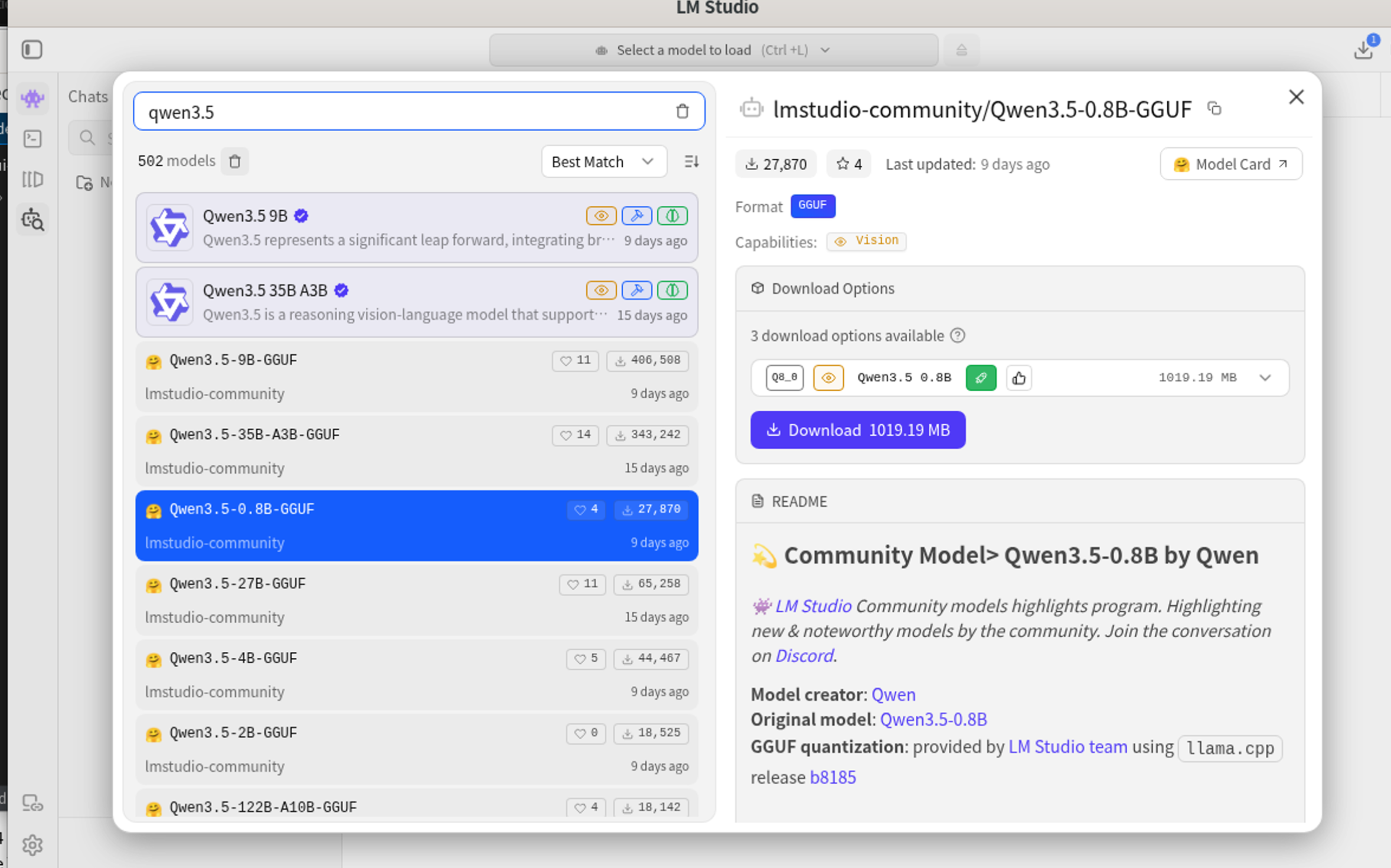

再点击这个图标来找模型

搜索 qwen3.5

qwen3.5是原生的多模态模型,可以解析文字和图片。

如果有显卡,8G显卡最多选择 9B模型(6.55G),再多就背不动了。

参数越高、结果精度越高,同时消耗资源。

如果没有显卡,选择 2B 先体验一下,如果感觉速度还行,再试试4B模型。

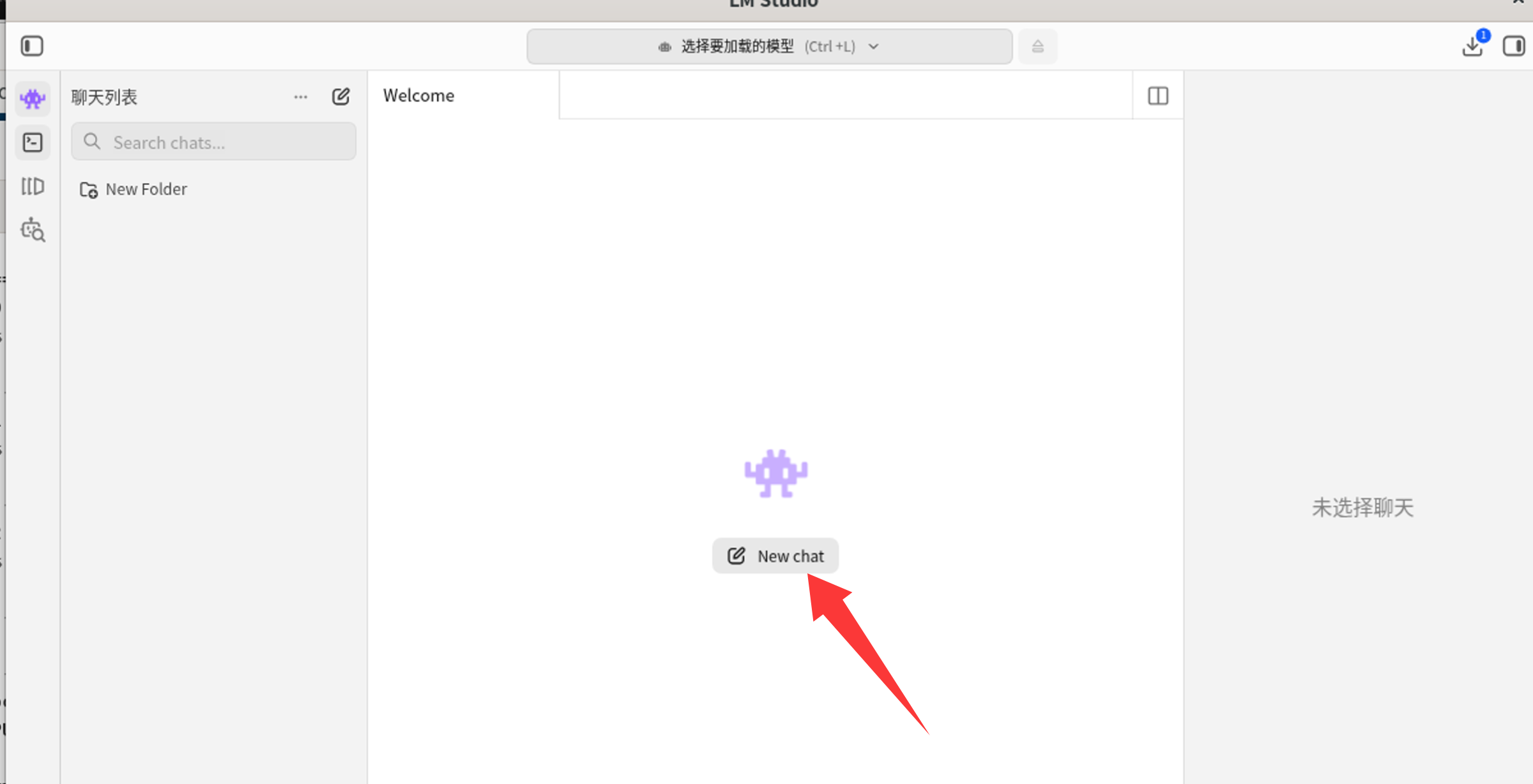

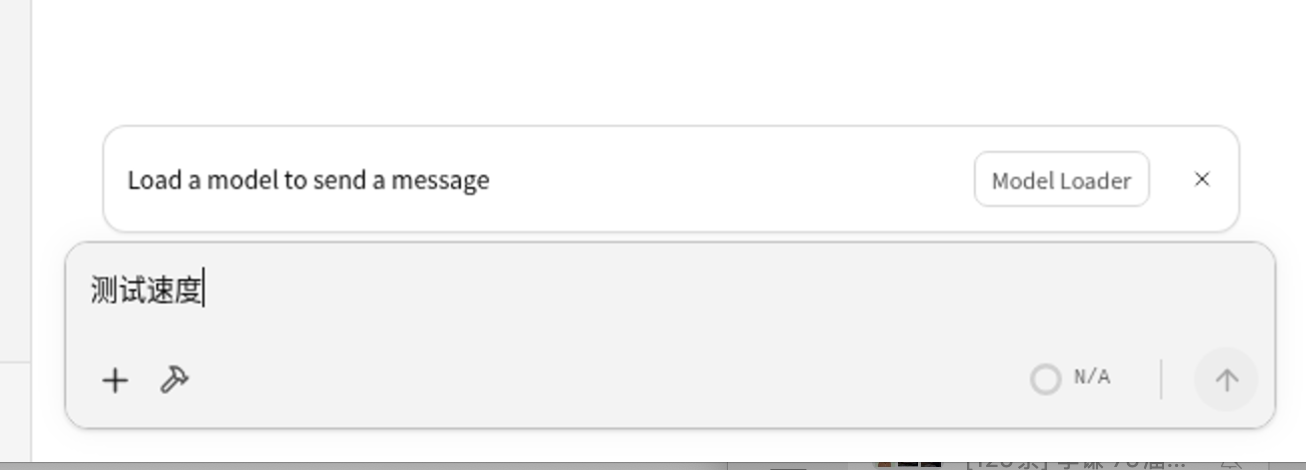

启动聊天界面:

选择你想启动的模型即可,加载可能需要一点时间

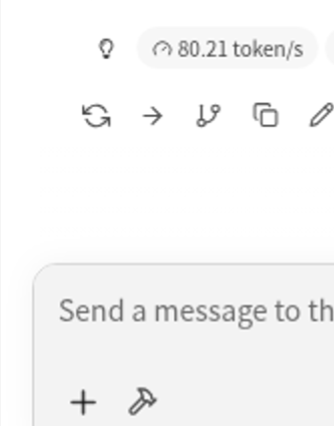

关注这个速度指标

小任务:

感受同一个问题多不个不同模型回答的效果。

问题示例如下:

我是一名初一学生,最近一周每天的作息和学习数据如下:

- 周一:23:00 睡,6:30 起,作业 2h,额外刷题 0.5h

- 周二:22:40 睡,6:30 起,作业 1.5h,背单词 0.8h

- 周三:23:20 睡,6:20 起,作业 2h,看课外书 1h

- 周四:23:10 睡,6:30 起,作业 1.8h,整理错题 0.3h

- 周五:22:50 睡,6:30 起,作业 1.2h,复习当天知识点 0.6h

- 周六:23:40 睡,8:00 起,作业 1h,自由阅读 2h

- 周日:23:30 睡,7:30 起,作业 1.5h,预习新课 0.5h

请帮我分析:

- 目前作息和学习安排存在哪些问题?

- 给出 3 条具体可执行的改进建议,每条建议要说明 "怎么做" 和 "预期能带来什么变化"。

最后,你再把这个问题给豆包或者deepseek,他们的模型参数远不止9B,答案会要更丰满一些,体会这里面的不同。