目录

-

- 前言

- [Why CS336?](#Why CS336?)

- [How CS336?](#How CS336?)

- Reflection

- Epilogue

前言

完成这篇文章时已经是深夜了,想了想还是简单写一个课程总结吧,聊聊博主学完整个课程后的一些想法和感受。

整个课程的学习是从去年 9 月份开始,一直持续到今年 3 月份才结束,一晃半年时间过去了,不过好在成功赶在 2026 年新课程开始之前结束了😄

Why CS336?

首先需要说明的是,博主并不是从事 LLM 相关工作的,最开始是做 CV 相关的工作,对模型部署、推理框架、高性能优化比较感兴趣,对 NLP 领域相关的知识既不了解,也谈不上太感兴趣。

奈何 2025 年初 DeepSeek 的出圈让博主不得不重视 NLP 的学习,由于之前没接触过因此刚开始学习的时候也是东一榔头西一棒子式地学习,学过 RoPE、Transformer、FlashAttention、llama.cpp、Qwen2.5-VL 等等,由于没有方向和目标很多东西都只停留在表面,并没有深入的理解,也就是为了学而学。

之后由于 Cursor、Claude Code 等 Agent 火爆,让博主瞬间觉得自己还是一个原始人,跟不上时代的发展,当别人都在谈论各种 Coding Agent 帮助完成复杂的任务的时候,博主还是一脸懵,由于内心的焦虑,博主开始学习马克叔讲解的一些 Agent 相关视频,包括 MCP 协议、Function Calling、RAG、A2A 协议等等。

虽然也学了一些东西,但是博主总是感觉零零散散,没有一个系统性的知识体系的构建,后来无意间刷到 CS336 这门课程,了解了一些大概之后博主决定正式开始进入学习。起初博主想的就是学习课程记记笔记就行了,课程作业压根没想过去完成,后来发现听了课程后确实理解了一些 LLM 相关知识,但很容易就忘了,等到真正要实操写代码的时候也是一脸困惑,因此才下定决心完成课后作业(哪怕不是自己手写的😂)。

How CS336?

整个课程体验下来,博主的整体观感非常好,无论是课程讲解还是课后作业都非常 nice。

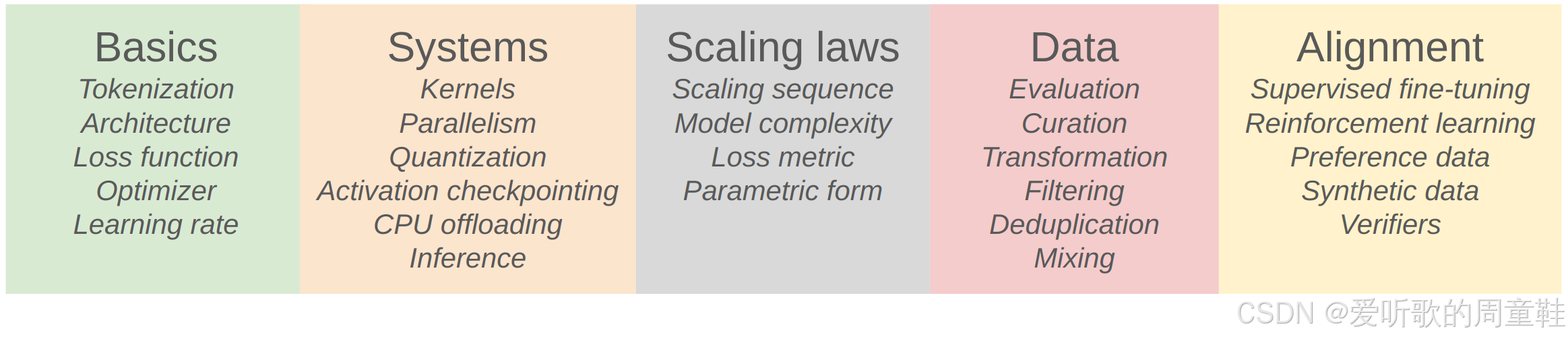

在课程讲解方面,他会帮助你构建完整的 LLM 知识体系,如上图所示,从最基础的 tokenizer 分词器开始到 Transformer 模型架构,再从 GPU 硬件到并行化,之后关于缩放定律和训练数据的讲解,则会让你理解训练一个 LLM 所需的关键组成部分,最后是对齐部分包括 SFT、RLHF 等后训练,旨在让你对 LLM 做一个深入的了解。

当然你需要有一定的基础,正如课程前置提到的例如机器学习、深度学习、数学(微积分、概率论、线性代数)、Python、Pytorch、系统优化等等,如果没有这些基础,或者某一部分有所欠缺,那么某些讲座听起来可能会比较吃力。比如说博主对 RL 领域一窍不通,因此对课程第五部分 Alignment 学习起来非常吃力,特别这一部分还涉及大量的数学理论推导,那确实会有一种在听天书的感觉。

课后作业方面博主刚开始并不在意,认为可能只是给你几个编程题让你去完成,但真正了解之后发现并不是这样的,每个作业说明文档都会非常详细地讲解当前章节的知识脉络,从上至下,让你有种读 paper 的感觉,然后中间穿插着一些需要你实现或者完成的内容,最最重要的是对于大部分组件都有测试要求,你不必担心你实现的组件是否存在问题,因为只要能通过作业提供的测试用例,基本就说明实现是正确的。这确实在某种程度上给了博主一些自信,成功通过测试了开心,没有通过则找问题,一个个组件慢慢实现,最后组合在一起构建完整的 LLM。

可以这样说,对于博主而言,整个课程如果分为 10 成,讲座讲解的内容仅占 3 成,而课后作业则占 7 成!如果你自己本身对 LLM 有一些了解,你甚至可以只去完成课后作业也会有很大的收获。

总之,博主认为这门课程适合有一定基础的,想系统性了解 LLM 相关知识的,对 LLM 感兴趣的人。

Reflection

首先,博主必须要承认的是自身的不足,课后作业代码的实现基本上都是 ChatGPT 帮忙写的,并没有遵循 from-scratch 的初衷(博主 Coding 能力实在是太差😭),此外课程中的很多内容也并没有完全理解,特别是 RL 后训练部分基本还是一头雾水,博主认为 "完成先于完美" 吧,有些内容确确实实博主现在没办法理解,或者说理解得没那么透彻,之后再慢慢来吧,总的来说,收获颇丰。

近几年 AI 的发展速度实在是太快了,各种 Agent 层出不穷,博主有点找不到学习的方向了,也经常思考这样的学习是否真的有意义,因为 AI 写的代码更好,做的总结也更全面,似乎自己做的一切都失去了意义,像是迷失在一片汪洋大海中,随波逐流。现在大家都习惯了用 AI 去解决问题,包括博主也是,开发、写文档、咨询等等都是用的 AI,似乎一旦脱离它就不行了。

如今站在 AI 的风口博主有时也想应该如何抓住这次机会,但好像又不知道具体该怎么做,总感觉它离我很近,却又似乎很遥远,网上有一段话分享给大家:

这一刻突然懂了父亲当年的无奈 --- 他站在改革开放的浪潮里,国家 GDP 翻了几十倍,可他为什么没赶上那班时代列车?

如今我也站在 AI 浪潮下,大模型迭代不停,机会明明就在眼前,却抓不住风口。原来,我正走着他当年的路啊。

钱塘江上潮信来,今日方知我是我。

不过迷茫归迷茫,路还是要走的,只有持续的学习才能够缓解博主本身的一些焦虑,因为当博主真正尝试去学习一些自己喜欢的东西时,压根没有时间去胡思乱想,焦不焦虑,加油吧诸位!🤗

Epilogue

最后,博主想引用 UP 主 WhynotTV 在他的视频 video 结尾的一段话送给可能和博主一样迷茫的人:

"在 2025 年这个时间节点上,这也许是 AI 和机器人最好的时代,资金、热情、关注日渐高涨,为学生、研究人员和创业者开启了前所未有的窗口。但这同时可能也是 AI 和机器人最坏的时代,因为在这条日渐拥挤的赛道上,焦虑、泡沫、迷茫如影随形。但我更愿意相信,这是一个重塑的时代,一个技术、梦想与耐心交汇的时代,无论潮起还是潮落,真正推动时代前行的是那些在深夜还在调 bug 的人,是那些无论失败多少次,仍然相信机器人应该 work,应该解锁更多可能性的人,我愿意成为这样的人。"

完结撒花!🎉🎉🎉