OpenClaw 完整部署 + 接入飞书指南

包含两种稳定方案:

- OpenClaw + Kimi大模型(云模型方案,最稳定)

- OpenClaw + 本地大模型(Ollama / Qwen2.5 / DeepSeek)开发环境

适用于 Windows 开发环境

一、OpenClaw + 云模型(终极稳定配置)

1. 环境准备

需要安装:

- Node.js 22+

- OpenClaw

- Kimi2.5 API key

推荐系统:

Windows 10/111.1 安装 Git

OpenClaw 的部分功能依赖 Git 进行版本管理或资源拉取。

- 下载 :访问 Git 官网 下载 Windows 版本安装包。

- 安装:运行安装程序,保持默认选项即可。

- 验证 :打开 PowerShell或命令提示符,输入以下命令: git --version

若显示版本号(如git version 2.x.x),则安装成功。

1.2 安装 Node.js

后面执行一键安装命令,可以自动安装nodejs,但是如果为了加快速度,防止安装意外,可以先安装nodejs。

下载:

官方下载地址:https://nodejs.org/zh-cn/download建议版本:

Node 22+

- 下载完,安装,默认下一步即可直到安装完毕。

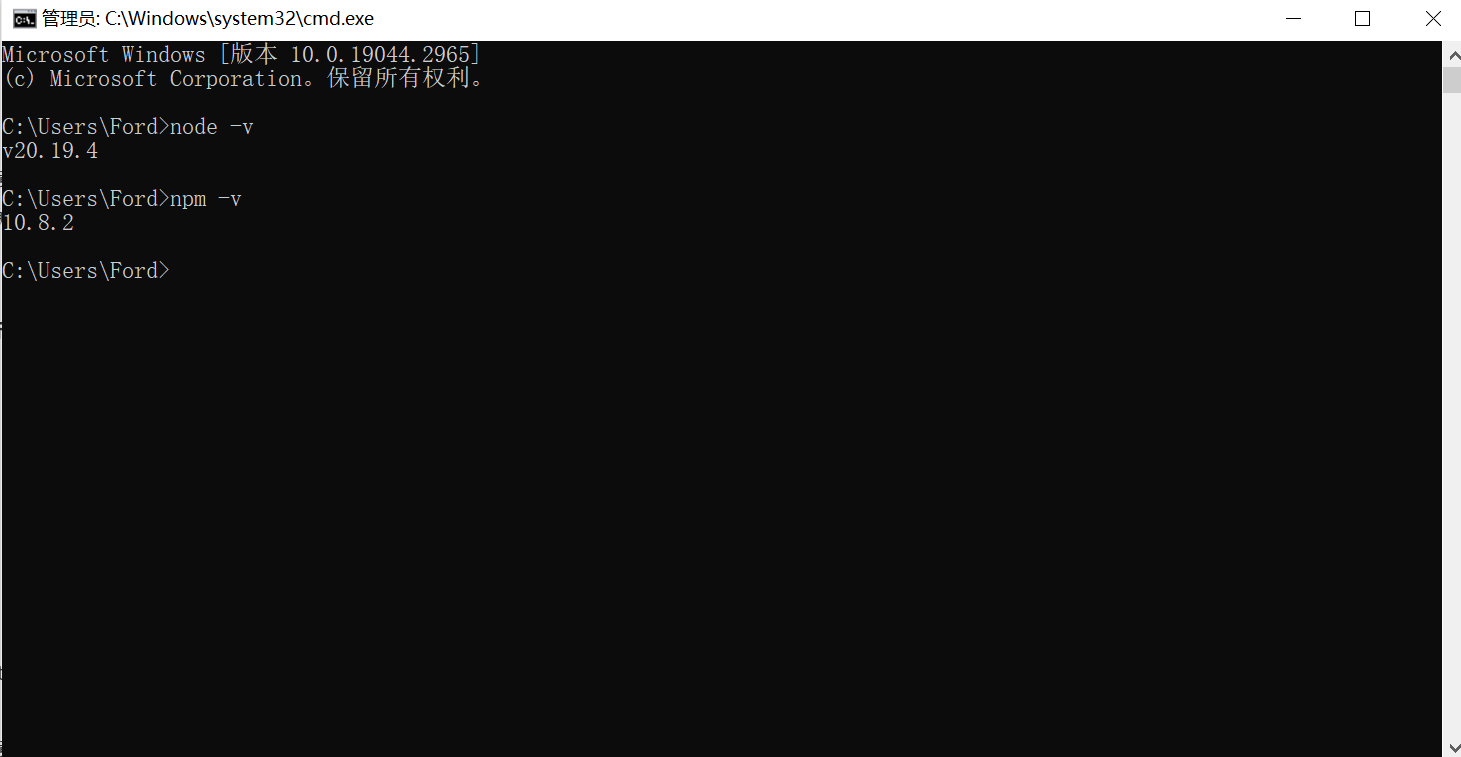

验证NodeJs是否安装成功:

bash

node -v

npm -v- 如下图表示安装成功

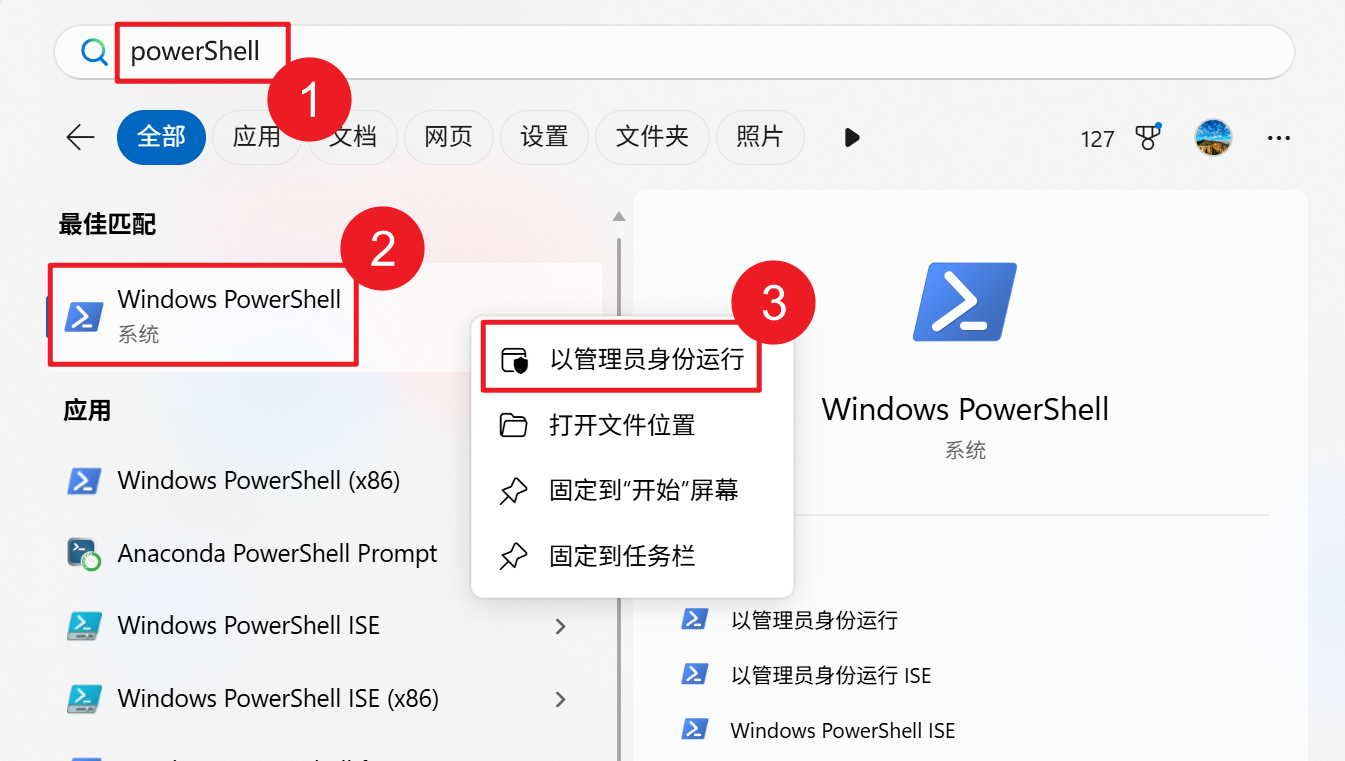

一)设置 PowerShell 执行权限

以管理员身份运行 PowerShell:

- 按

Win键,搜索 PowerShell - 右键点击 Windows PowerShell

- 选择 以管理员身份运行

- 点击 是 确认

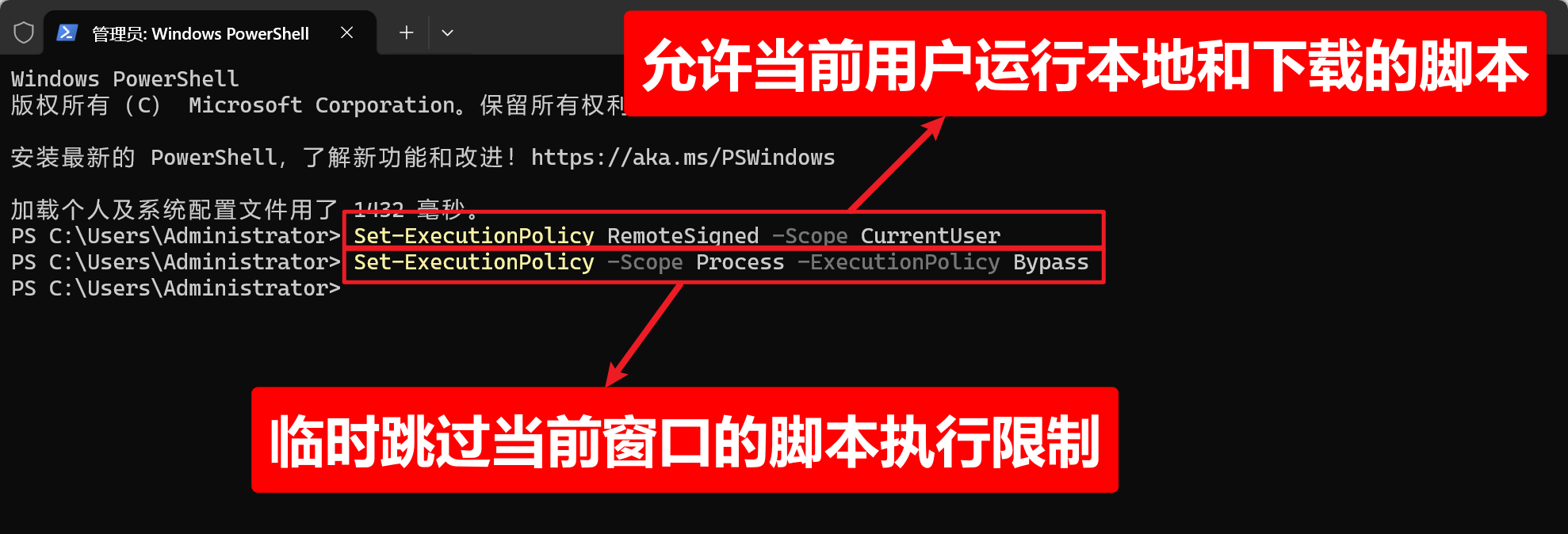

在管理员 PowerShell 窗口中,依次执行以下两条命令:

代码语言:powershell

powershell

Set-ExecutionPolicy RemoteSigned -Scope CurrentUser

Set-ExecutionPolicy -Scope Process -ExecutionPolicy Bypass这是什么意思?

- 第一条命令:允许当前用户运行本地和下载的脚本

- 第二条命令:允许当前用户运行本地和下载的脚本

安全提示:这些命令只会影响您自己的账户,不会影响系统安全或其他用户。

2. 安装 OpenClaw

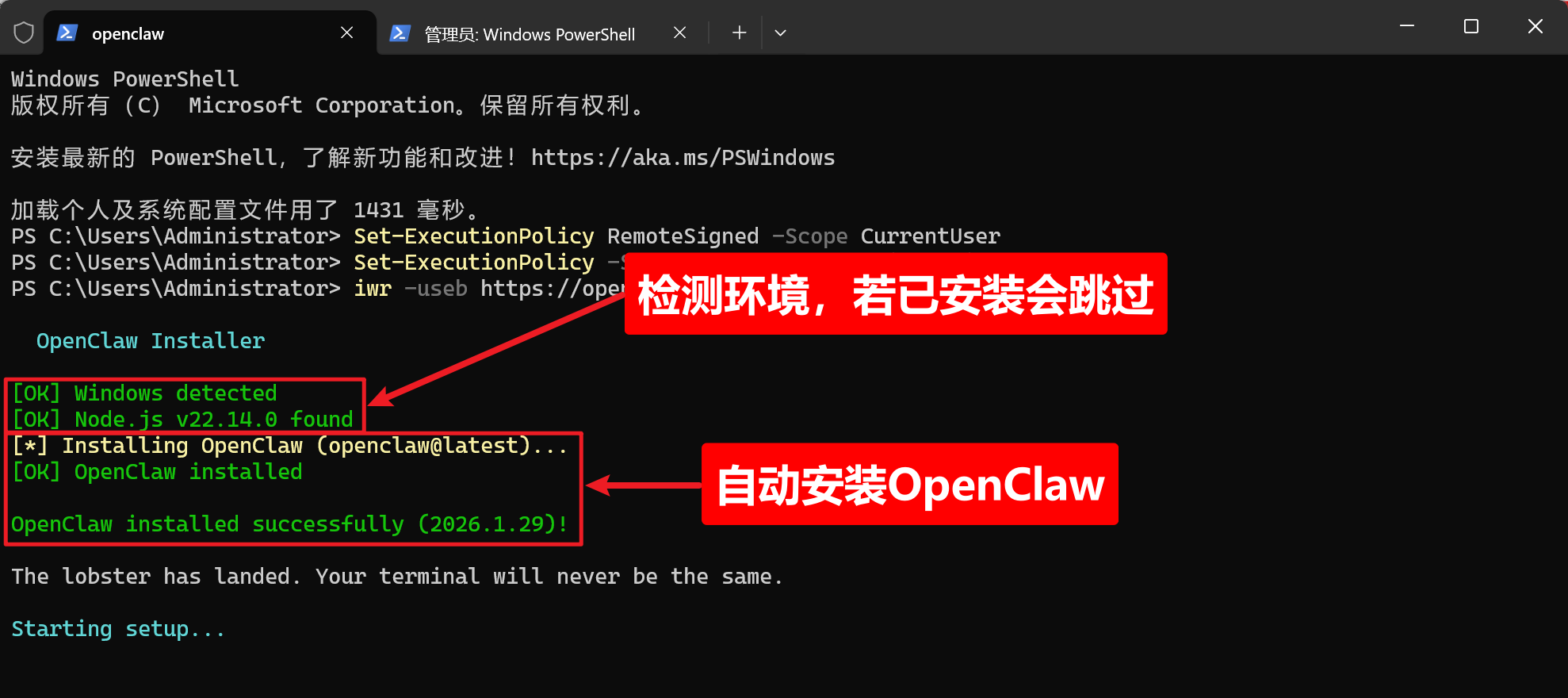

执行一键安装命令

复制以下命令,粘贴到 PowerShell 窗口中,按 Enter 执行:

代码语言:powershell

powershell

iwr -useb https://openclaw.ai/install.ps1 | iex安装过程会自动完成:

- 检测系统环境

- 安装必要依赖(Node.js 等)

- 下载 OpenClaw 核心文件

- 配置环境变量

- 启动配置向导

注意:如果命令执行后,还是报错,可以自己到官网下载node安装包,自己安装node环境,注意版本最好在 node v22.x 以上。

初始配置向导

安装完成后,会自动进入配置向导(openclaw onboard)。

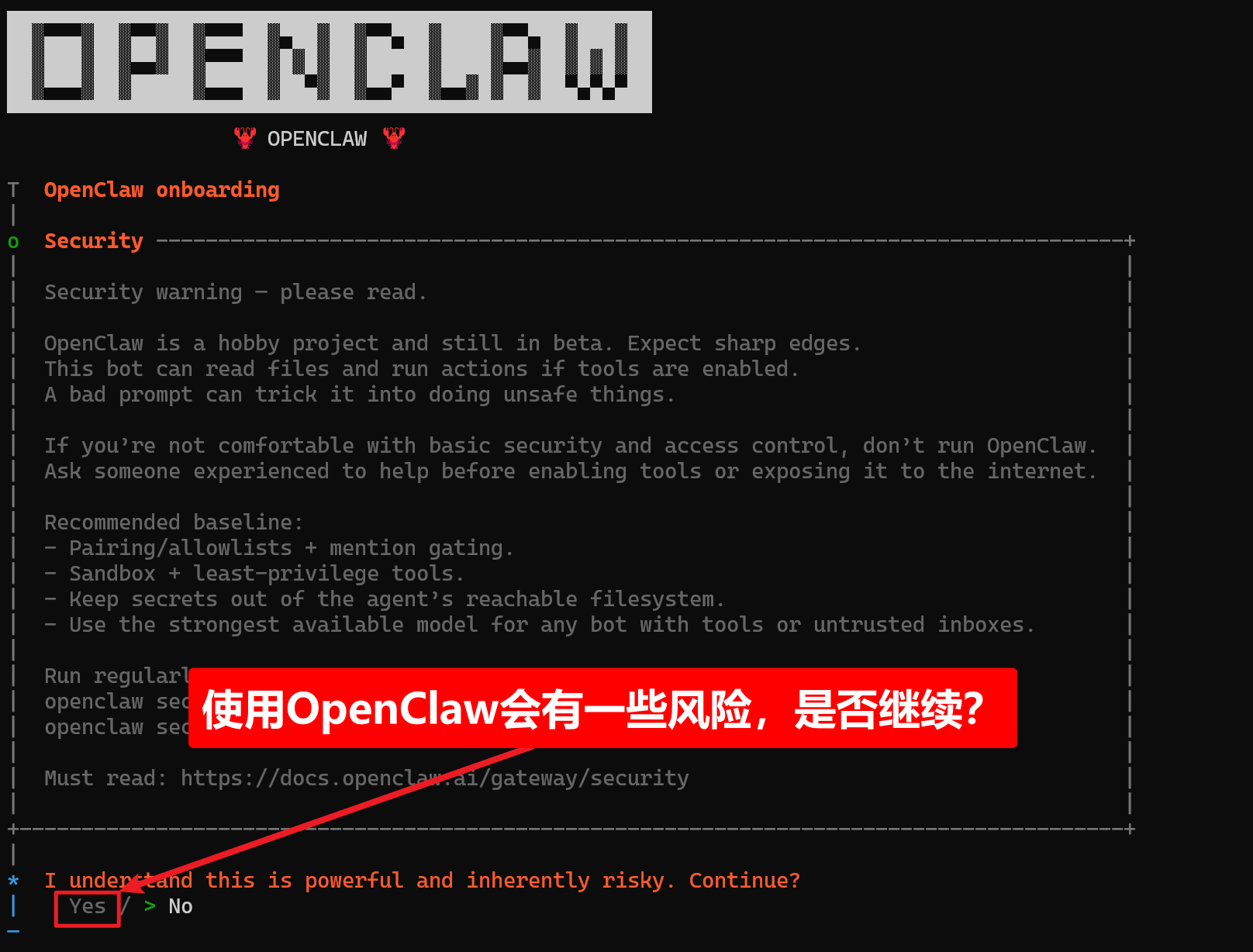

一)风险告知

这一步主要是告诉你,使用OpenClaw可能会有一些风险。请问你是否继续?

按 向左方向键 ←,选择 Yes,按 Enter 回车确认。

二)选择 QiuickStart 模式

三)配置 AI 模型 API Key

OpenClaw 需要连接到大语言模型才能工作。Openclaw 比较费token,国外模型成本高,门槛也高,这里我选择国内的智谱的 GLM 4.7

如果没有智谱的API Key,点击官方地址自己注册账号获取API key:API key

输入自己的 API Key:

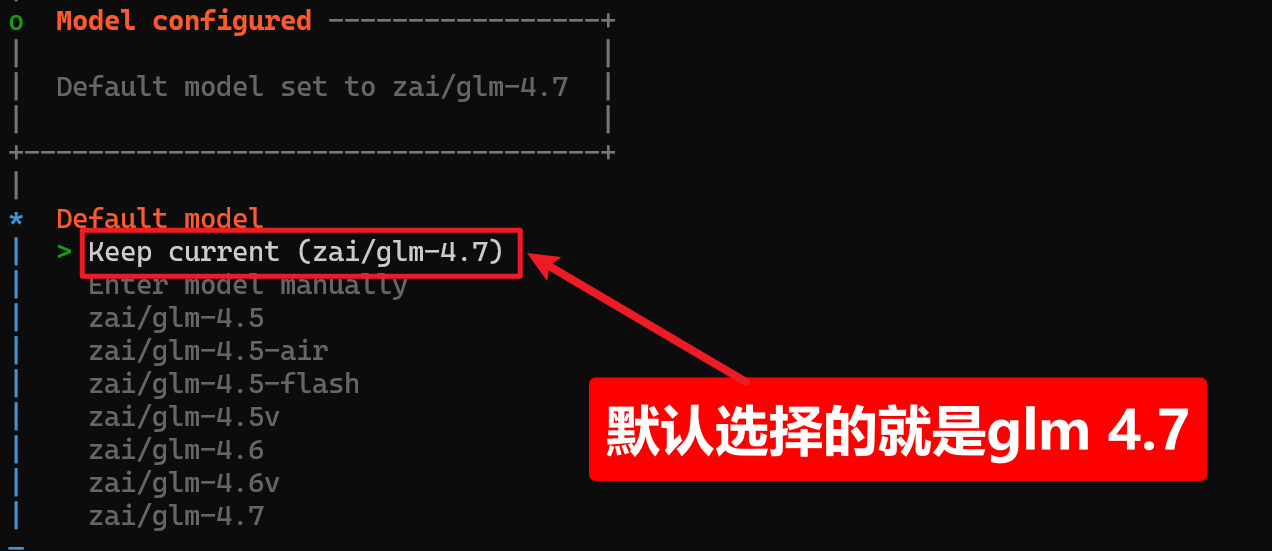

四)选择 AI 模型

这里我选择默认的GLM 4.7,也是智普当前的旗舰模型

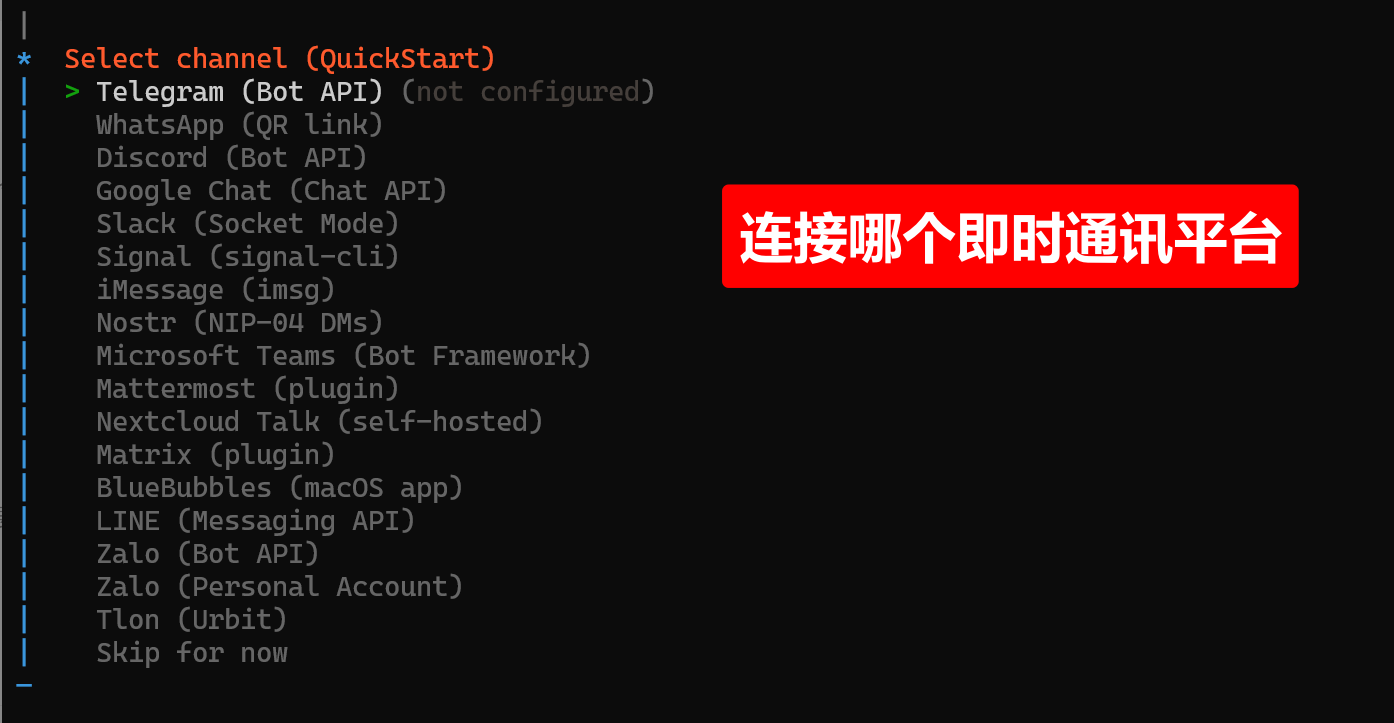

五)连接即时通讯平台

配置完 AI 模型后,OpenClaw 会询问你要连接哪个通讯平台?

- 先跳过这步,选择Skip for now回车

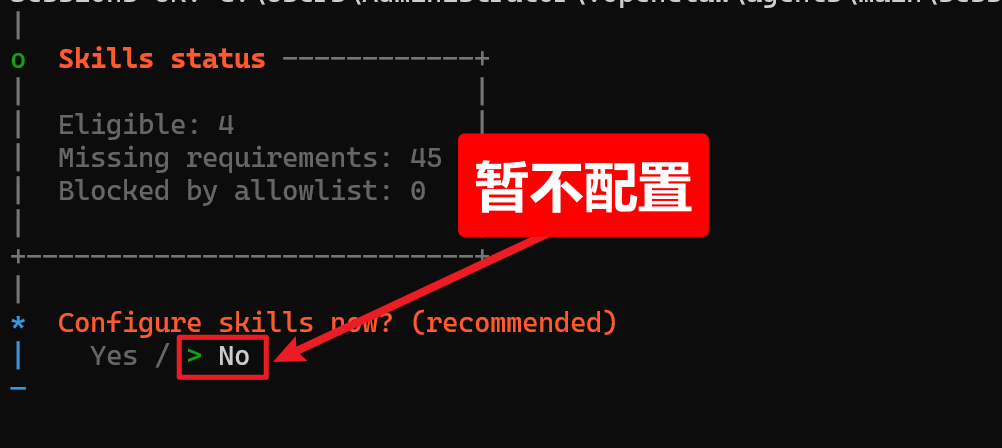

六)选择Skills

这里也选择:No,暂不配置,后面通过UI界面进行配置:

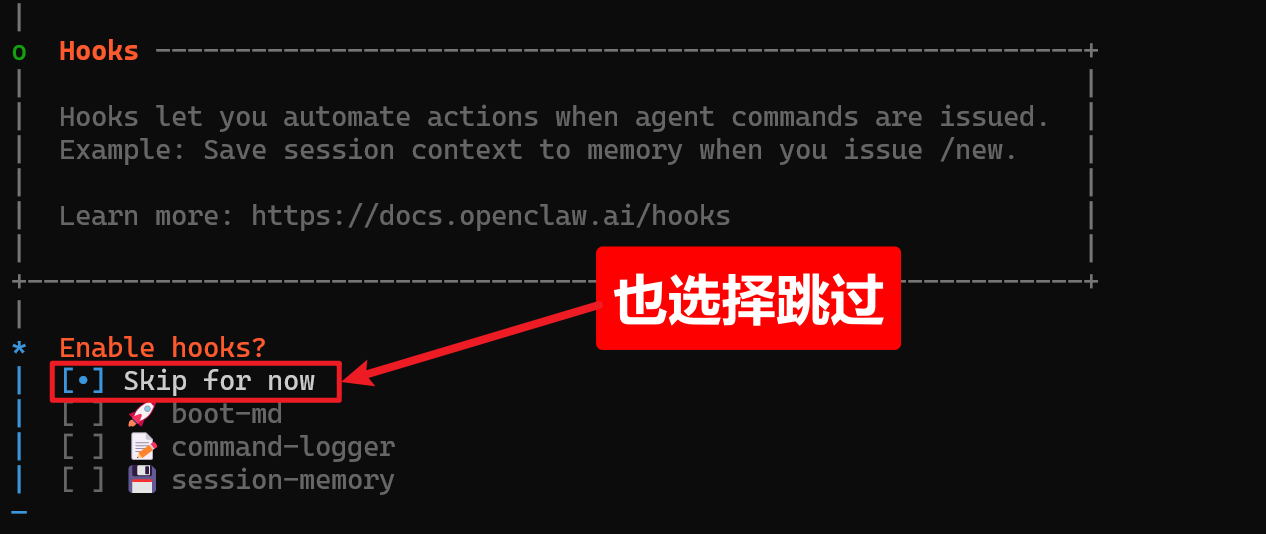

七)是否开启Hooks

- 跳过此设置

操作步骤:先敲空格,表示选中当前项,再敲回车键

在这里插入图片描述

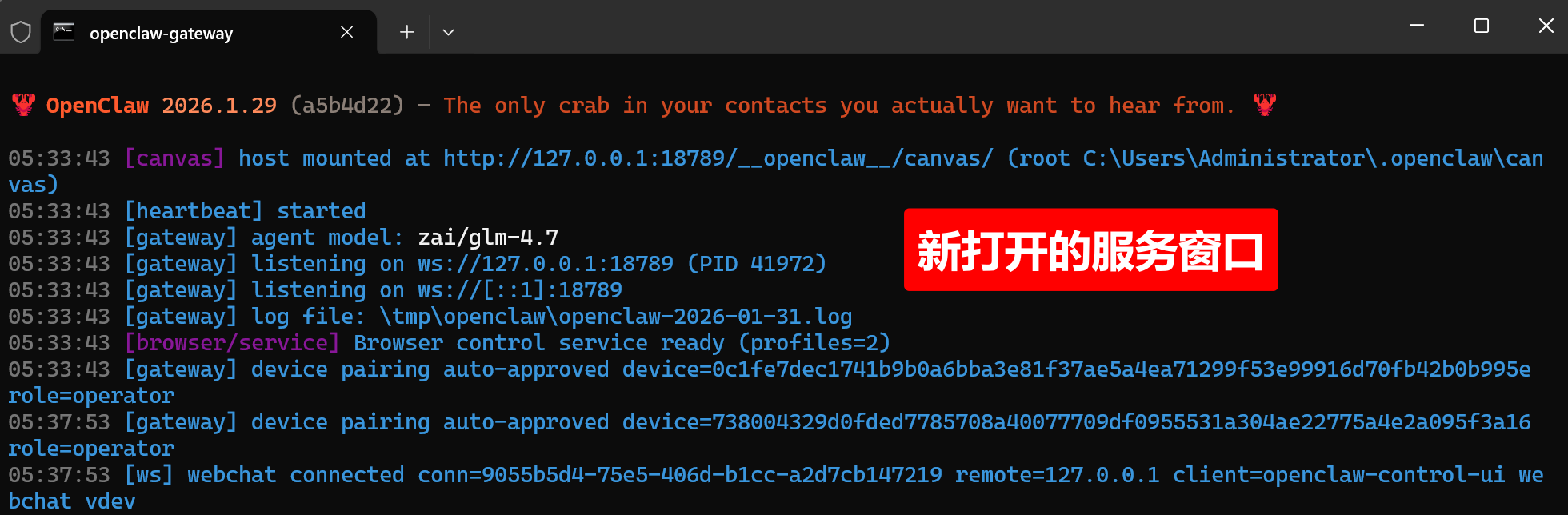

八)启动服务并打开UI界面

此时它会自动再打开一个命令窗口来启动服务:

这个过程是在启动服务,可能会需要等一点时间

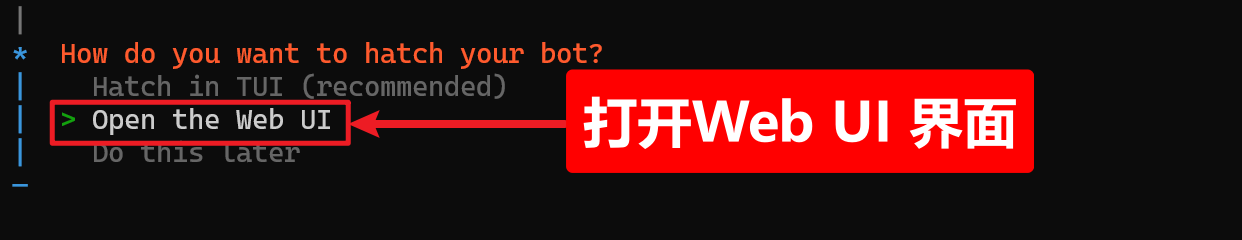

同时,大约过30秒左右,我们回到刚才的设置窗口,选择 Open the Web UI ,打开 OpenClaw 的UI界面:

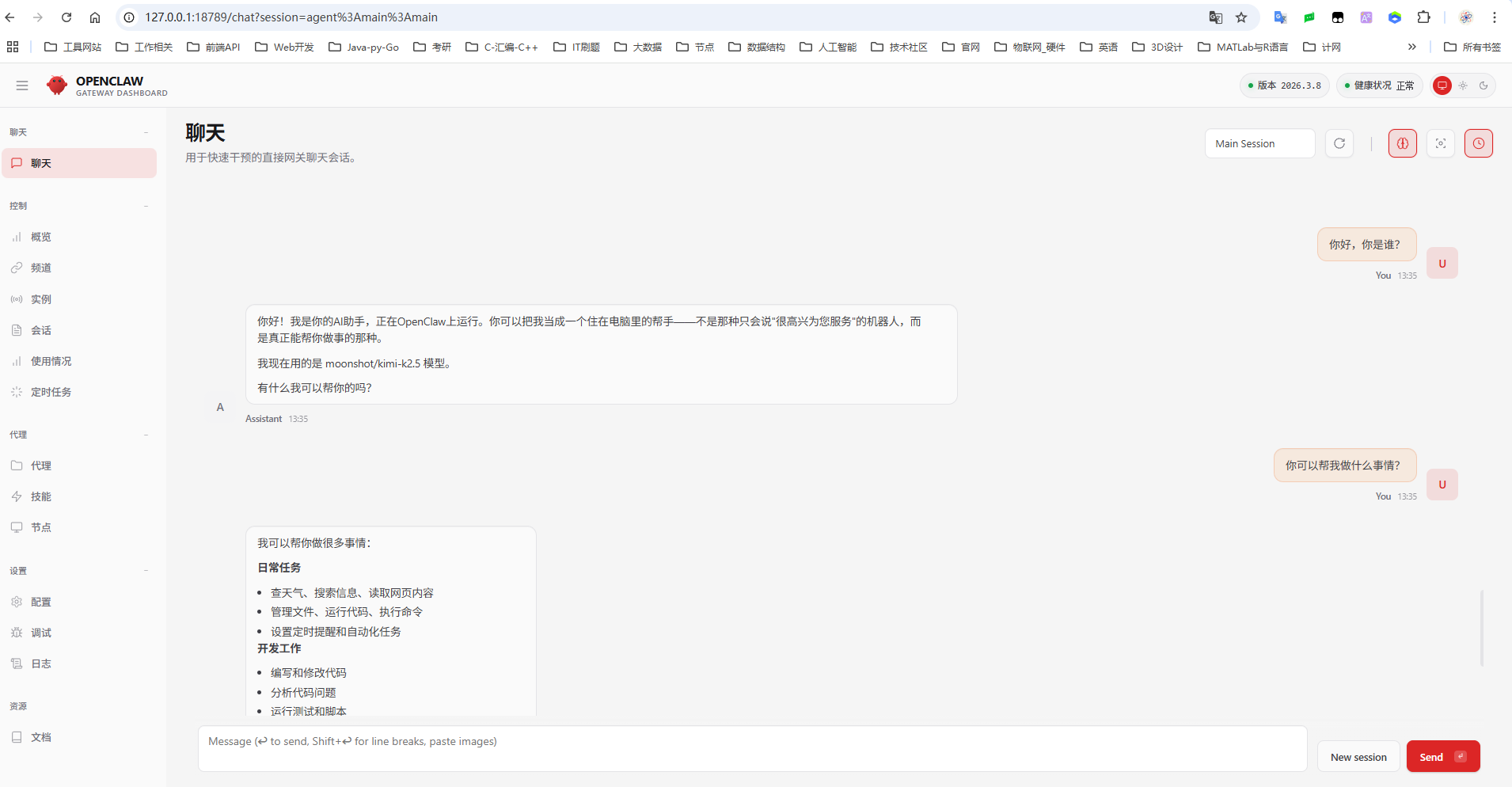

浏览器打开Web UI界面:

到此龙虾安装完毕。

win +R 键,cmd命令行窗口输入下面命令验证。

验证:

bash

openclaw --version示例:

OpenClaw 2026.x.x3. 如何申请API key

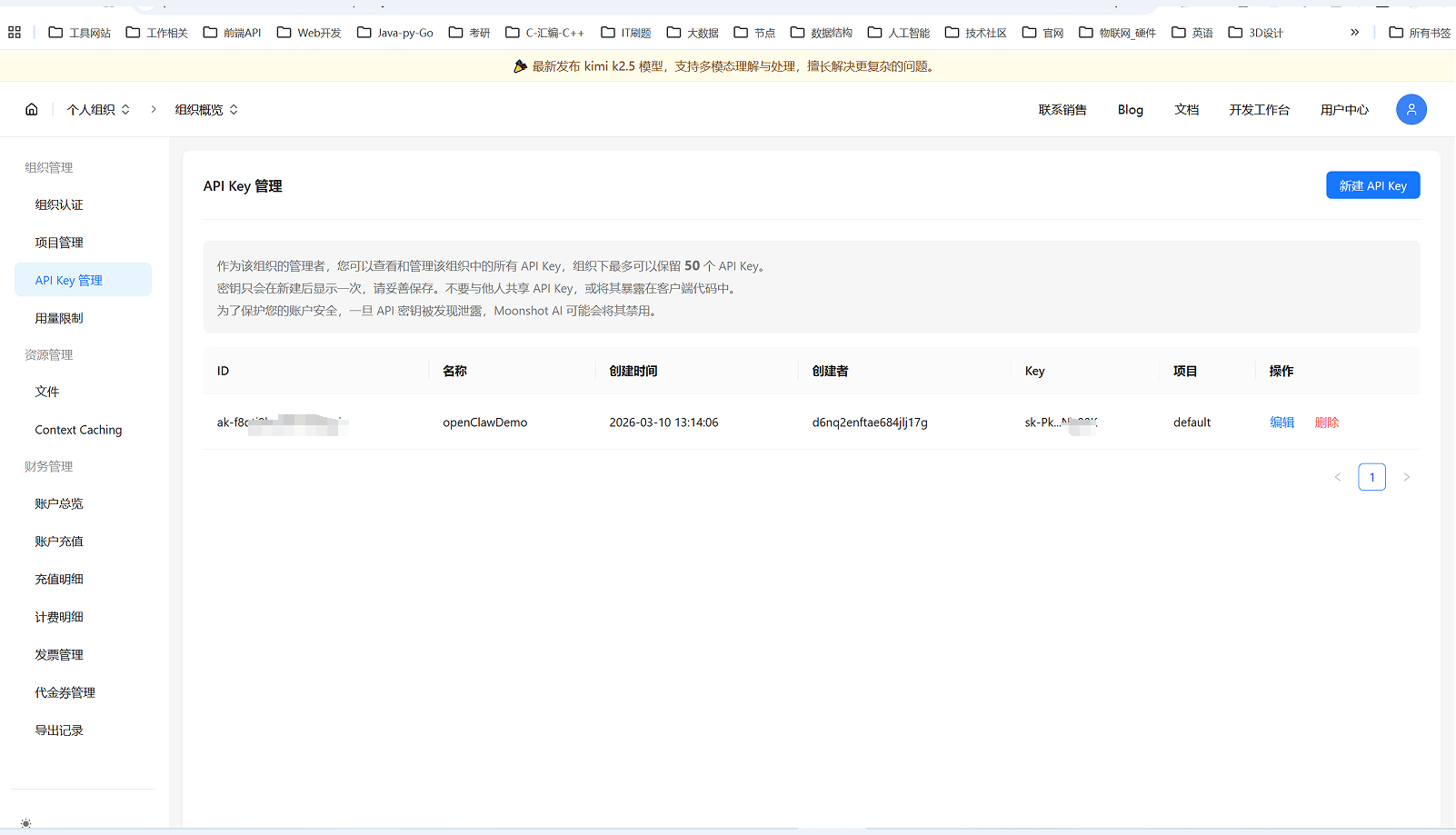

Kimi大模型获取API key

- 注册账号登陆

- 点击用户中心

API key管理,创建API key

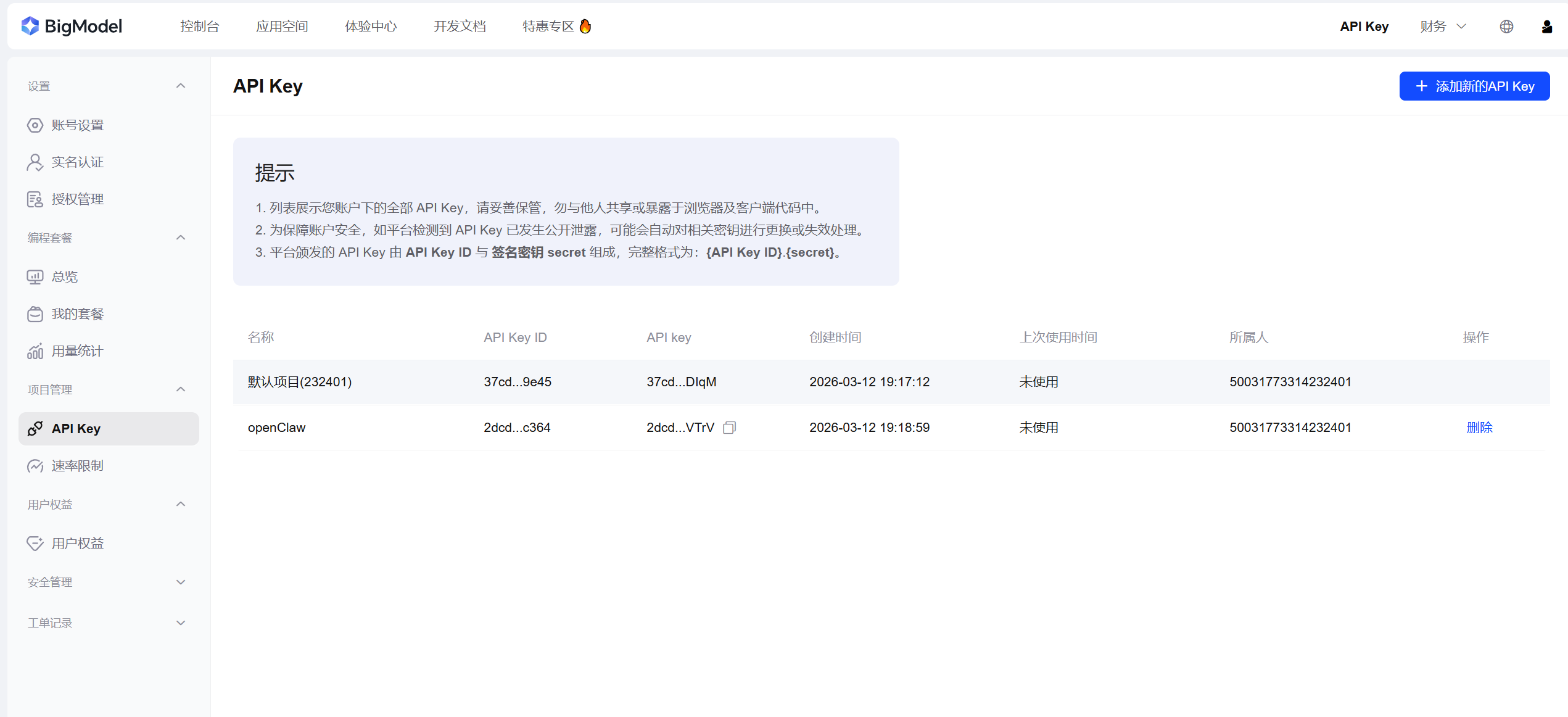

GLM5

-

清华智普大模型

-

打开网页注册账号并登陆

-

点击控制台 => 点击API key => 创建api key

4.OpenClaw 配置文件

如果在安装openClaw的时候没有配置大模型操作:

一)设置系统环境变量:

Windows PowerShell:

powershell

setx MOONSHOT_API_KEY "sk-xxxx"重新打开终端。

验证:

powershell

echo $env:MOONSHOT_API_KEY有输出证明设置成功

二)修改配置

配置文件默认路径在

C:\用户\用户名\ .openclaw\openclaw.json找到这段配置,查看配置是否成功,agents里面的defaults默认的模型"primary": "kimi-k2.5",就对了。

json

"models": {

"mode": "merge",

"providers": {

"moonshot": {

"baseUrl": "https://api.moonshot.cn/v1",

"apiKey": "${MOONSHOT_API_KEY}",

"api": "openai-completions",

"models": [

{

"id": "kimi-k2.5",

"name": "Kimi K2.5"

}

]

},

"agents": {

"defaults": {

"model": {

"primary": "moonshot/kimi-k2.5"

},

"compaction": {

"mode": "safeguard"

}

}

},

"tools": {

"web": {

"search": {

"enabled": true,

"provider": "brave"

},

"fetch": {

"enabled": true

}

}

},5. 启动 OpenClaw

- 记得每次设置完配置都需要重启网关

关闭 gateway:

openclaw gateway stop启动 gateway:

bash

openclaw gateway start网页访问地址:

http://127.0.0.1:18791WebSocket:

ws://127.0.0.1:187896. 验证模型连接

测试:

bash

openclaw models status --probe成功示例:Status: ok即为成功

Model: moonshot/kimi-k2.5

Status: ok二、OpenClaw + 本地 AI 开发环境

如果不想使用 云端大模型,在本地电脑配置尚可的情况下,可以部署 本地大模型。

| 硬件配置 | 操作系统 |

|---|---|

| 硬盘至少500GB~1TB,内存至少16GB ~ 32GB | win10 、win11 |

| CPU至少i5 | |

| 显卡至少4060或者5060,显存至少16GB或者更高 |

推荐:

Ollama架构:

OpenClaw

│

▼

Ollama API

│

▼

Local LLM优点:

- 不需要连接云端模型

- 私有数据安全

- 可离线运行

缺点:

- 需要 GPU / CPU

- 模型能力略弱

1. 架构说明

OpenClaw

│

▼

Ollama (localhost:11434)

│

▼

LLM Model2. 安装 Ollama

2.1 下载Ollama

Ollama官网:Ollama

https://ollama.com点击Download,选择自己的电脑版本相应的Ollama安装包。

2.2 安装Ollama

这里由于Ollama默认安装到C盘,修改安装路径。

以管理员身份打开 PowerShell 或命令提示符(CMD)。这很重要,否则可能因权限不足导致安装失败。切换到你想要安装的目录,比如D:\Ollama,执行:

安装运行:

powershell

.\OllamaSetup.exe /DIR="D:\ollama"命令执行后,会弹出图形化的安装界面,点击 "Install" 即可开始安装。

2.3 修改模型储存路径(推荐)

方法一:使用命令行修改

在 管理员身份 运行的 PowerShell 或 CMD 中,输入以下命令(注意变量值是你想存放模型的具体路径):

setx OLLAMA_MODELS "D:\ollama\models"或者在Windows的环境变量窗口修改。

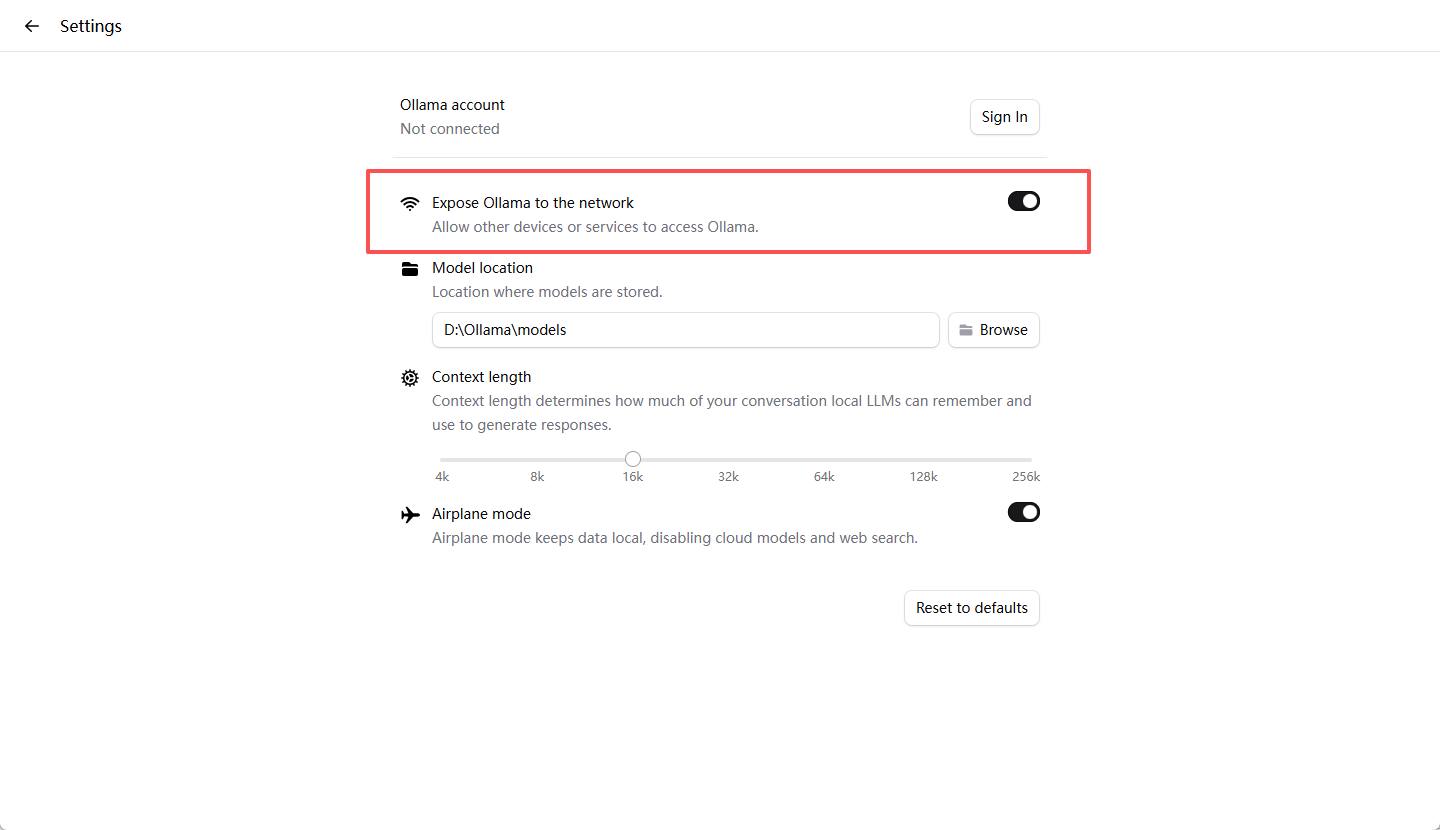

方法二:通过图形界面设置

打开Ollama程序,在Settings选项卡,也有Model Location的设置,可以在这里修改。

2.4 验证

在命令行输入:

bash

ollama -v正常出现版本号,就说明安装成功了。

2.4 下载模型

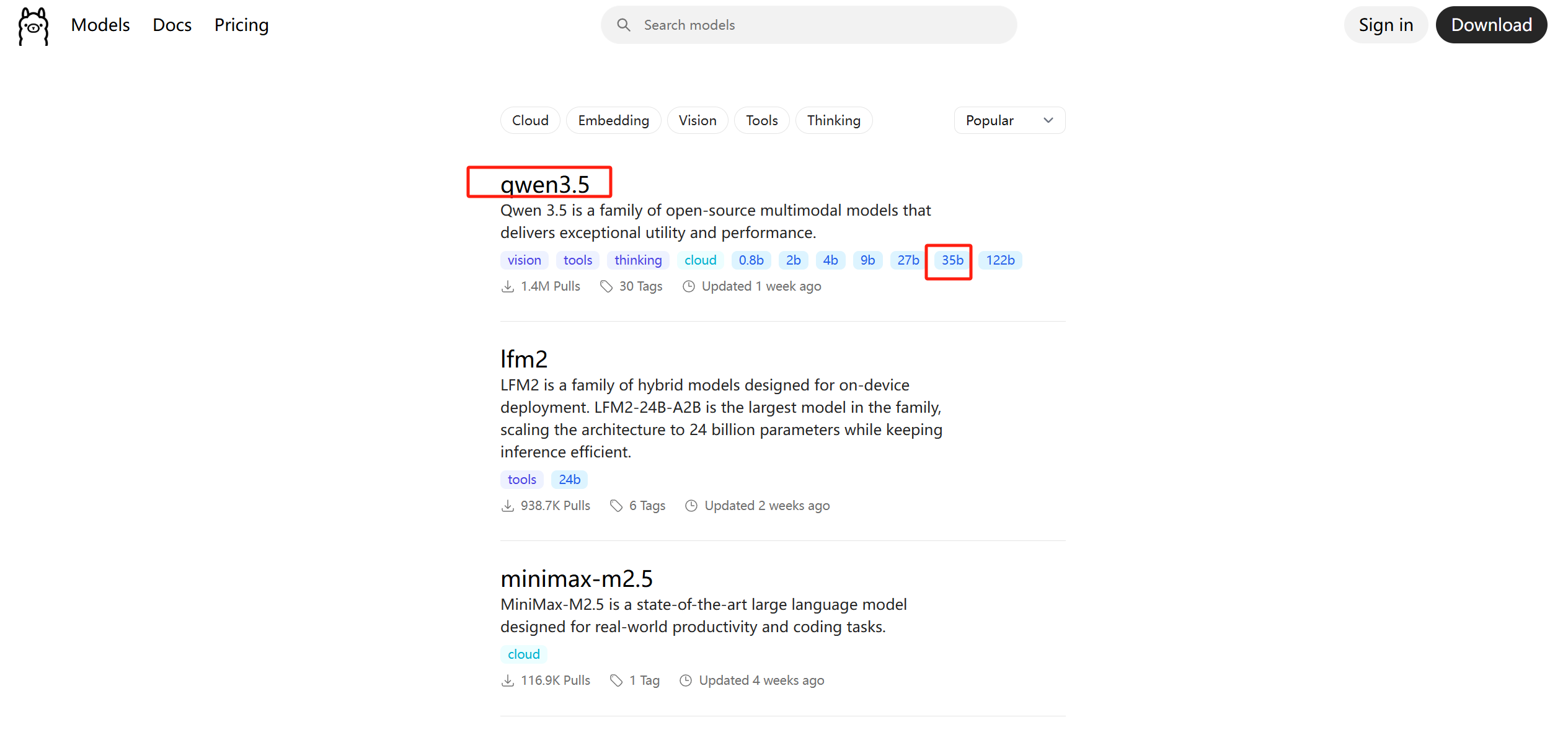

安装之后就可以在Ollama下载模型了,Ollama的模型仓库提供了基本我们需要的所有模型。模型仓库的地址:Ollama模型仓库

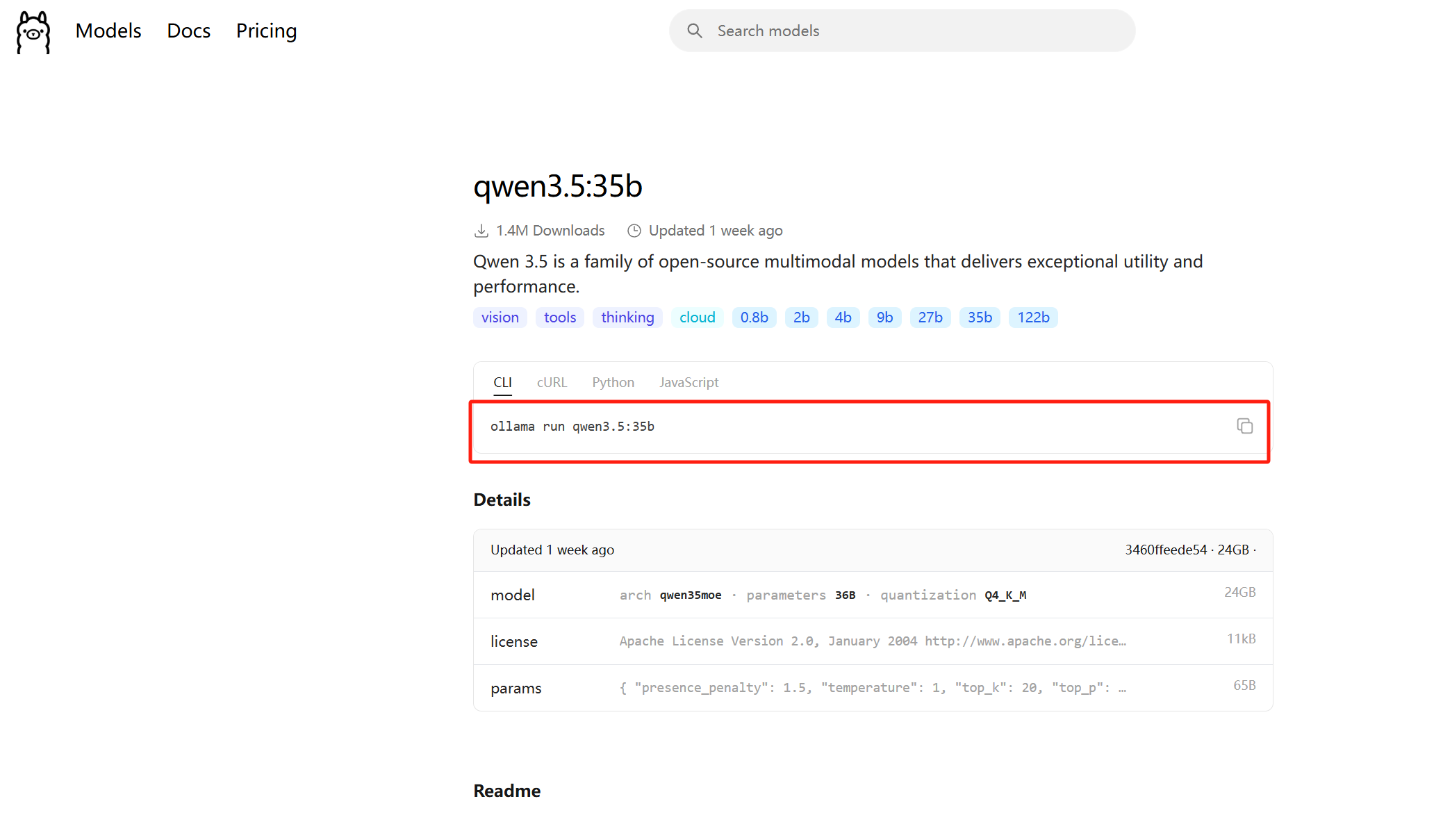

比如下载Qwen3.5-35B 模型:

这里面有很多个,不同参数量的模型,个人电脑根据电脑的配置不同,可以选择不同参数的模型,建议个人电脑选择30b以下的模型进行部署。

选择模型点击进入页面

复制命令:ollama run qwen3.5:35b

然后在命令行直接执行,Ollama就会自动下载这个模型,等待下载完成即可。

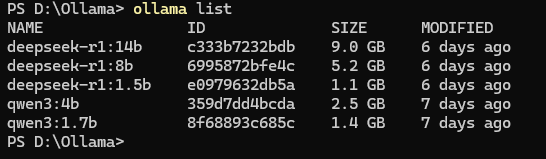

下载之后,执行:

ollama list例如列表中可以看到你的模型。

Ollama 页面

2.5 模型测试

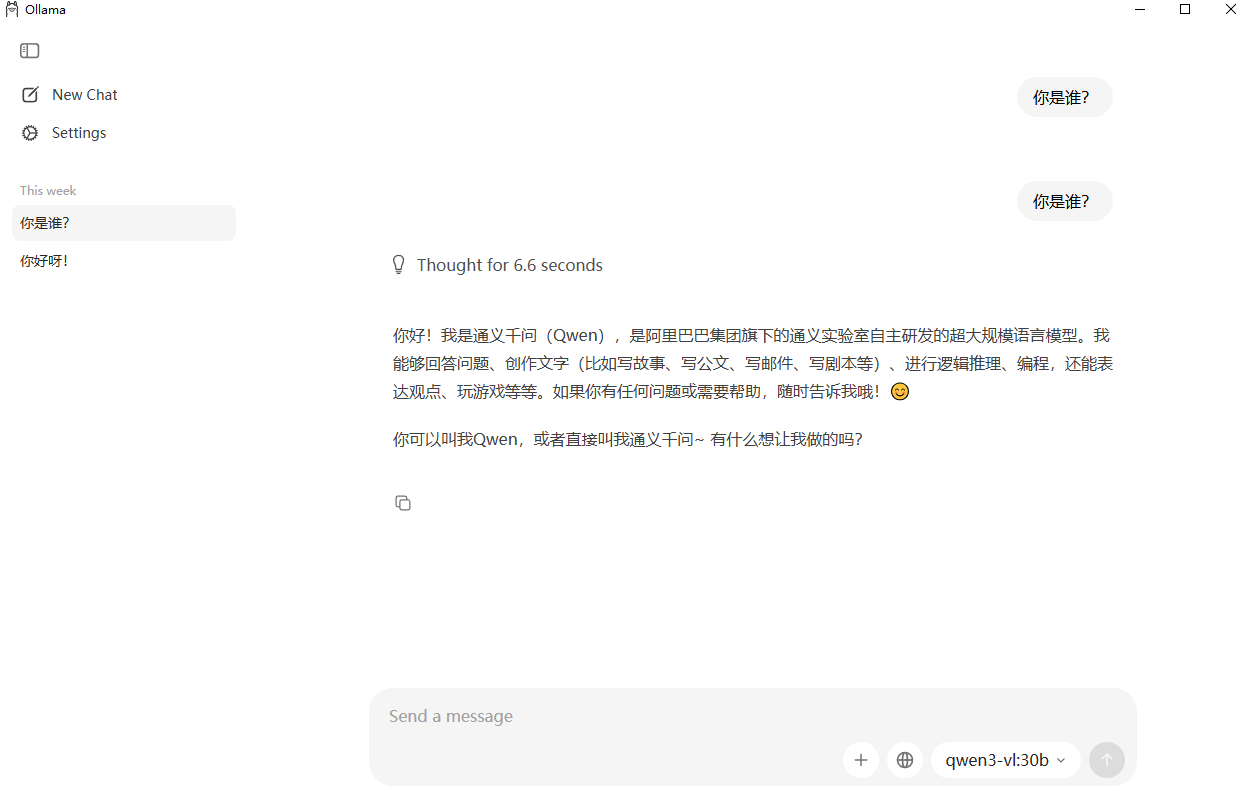

下载完成之后,可以测试下这个模型,有两种测试方式

Ollama应用测试

Ollama接口测试

接口测试,我们需要先在Ollama应用里面,把这个选项打开:

API:

http://localhost:114344. 配置 OpenClaw 使用 Ollama

编辑:

~/.openclaw/openclaw.json找到对应的json的配置:要不默认的大模型改成ollama/qwen3.5:35b

json

"models": {

"mode": "merge",

"providers": {

"moonshot": {

"baseUrl": "https://api.moonshot.cn/v1",

"apiKey": "${MOONSHOT_API_KEY}",

"api": "openai-completions",

"models": [

{

"id": "kimi-k2.5",

"name": "Kimi K2.5"

}

]

},

"ollama": {

"baseUrl": "http://127.0.0.1:11434/v1",

"apiKey": "ollama",

"api": "openai-completions",

"models": [

{

"id": "qwen3.5:35b",

"name": "Qwen 3.5 35B"

},

{

"id": "qwen3:30b",

"name": "Qwen 3 30B"

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "ollama/qwen3.5:35b"

},

"compaction": {

"mode": "safeguard"

}

}

},改完配置重启openClaw的网关。

然后再次刷新页面,访问:http://127.0.0.1:18791

5. 推荐本地模型

| 模型 | 用途 |

|---|---|

| Qwen2.5 | 综合能力 |

| DeepSeek-Coder | 代码 |

| Llama3 | 通用 |

| Mistral | 轻量 |

推荐配置:

32GB RAM

GPU ≥ 8GB三、openClaw接入飞书机器人

创建飞书机器人

一)来到飞书开发者后台

飞书开放平台地址:https://open.feishu.cn

没有飞书账号的,需要自己注册账号

点击右上角进入 开发者后台:

二)创建应用

三)填写应用信息

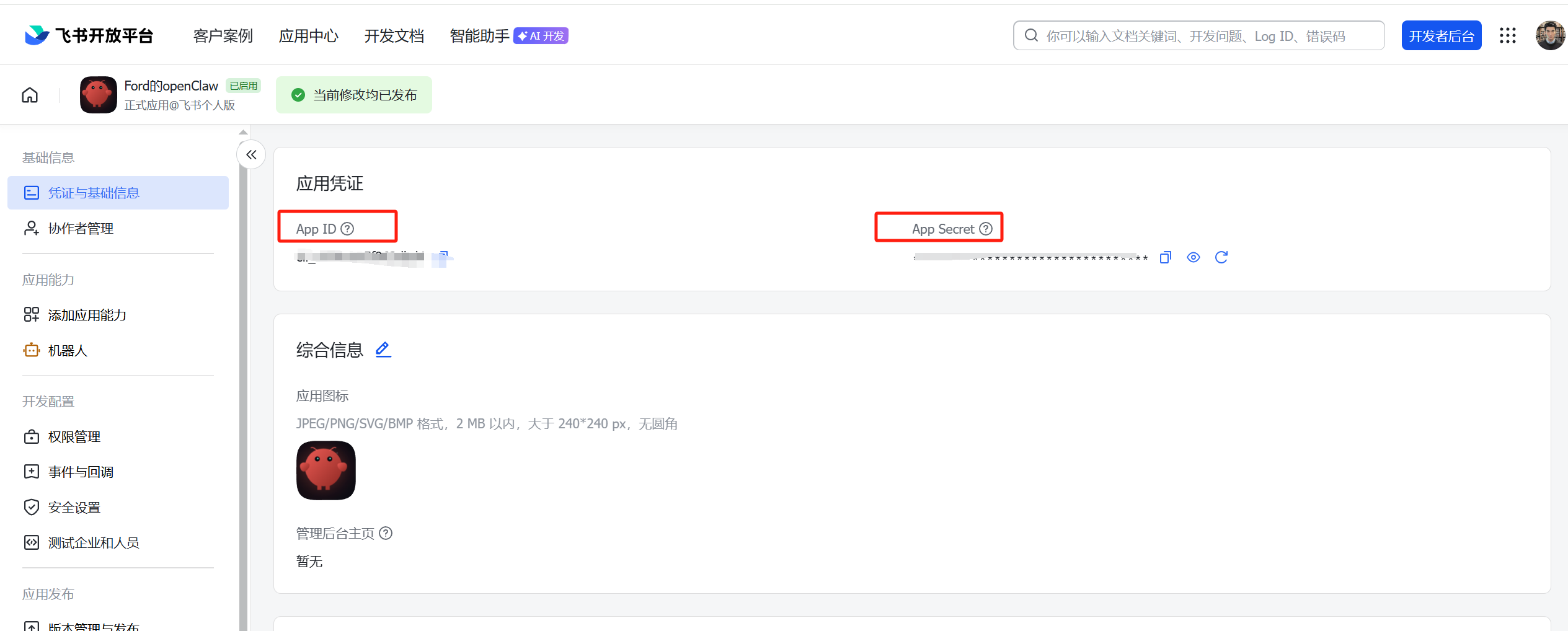

四)获取自己的应用凭证

五)给应用添加机器人

六)给应用配置权限

把即时通讯相关的权限全部开通:

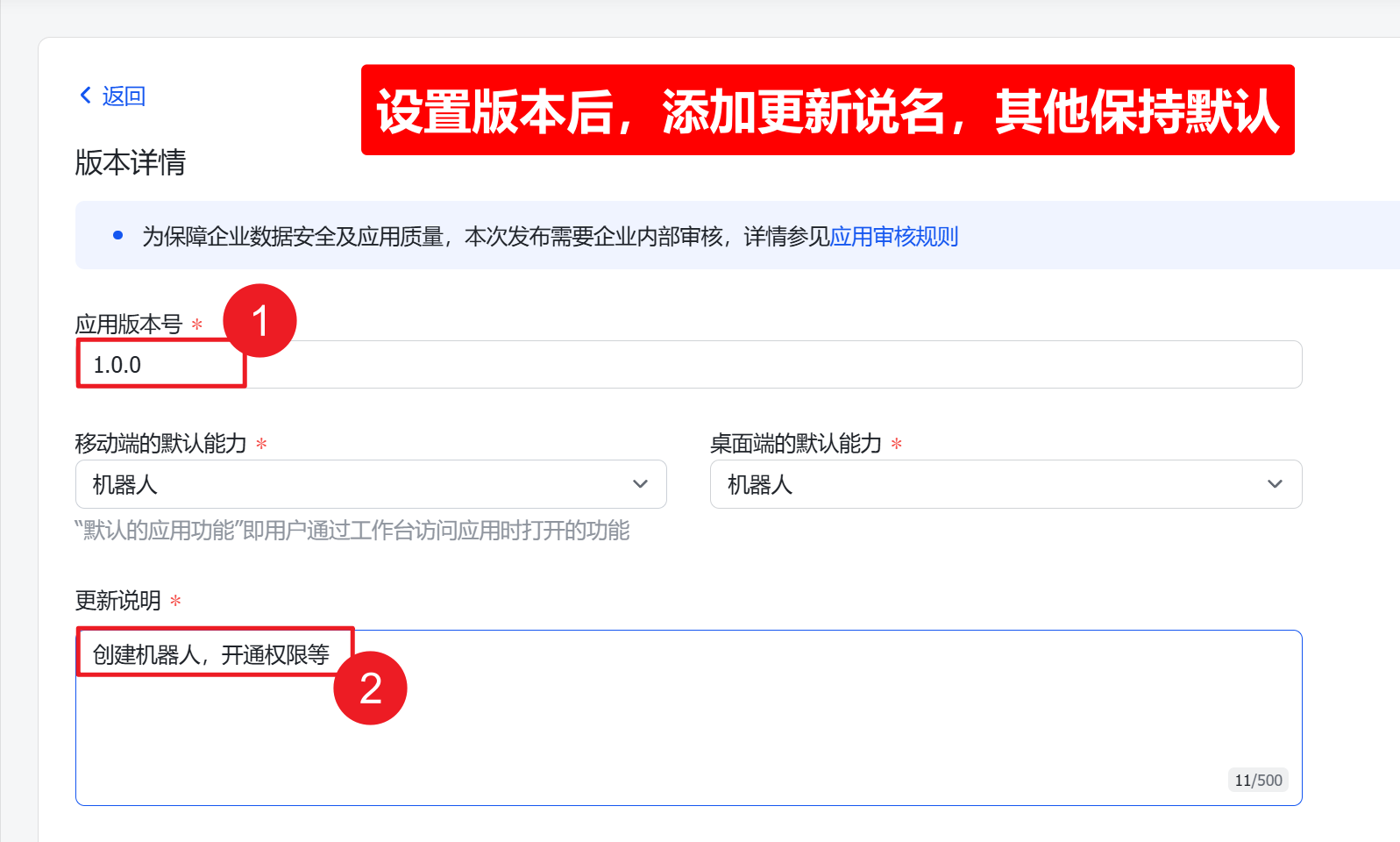

七)创建版本并发布

八)安装飞书插件

打开powershell,输入以下命令,安装飞书插件:

代码语言:powershell

powershell

openclaw plugins install @m1heng-clawd/feishu安装成功后,再打开一个新的命令窗口,开始配置飞书插件:

输入命令:

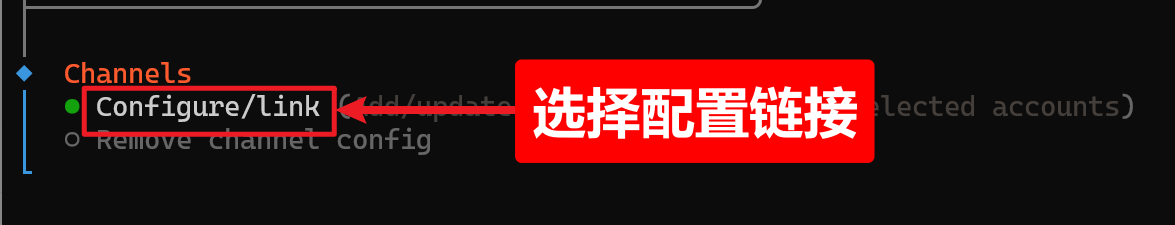

openclaw config

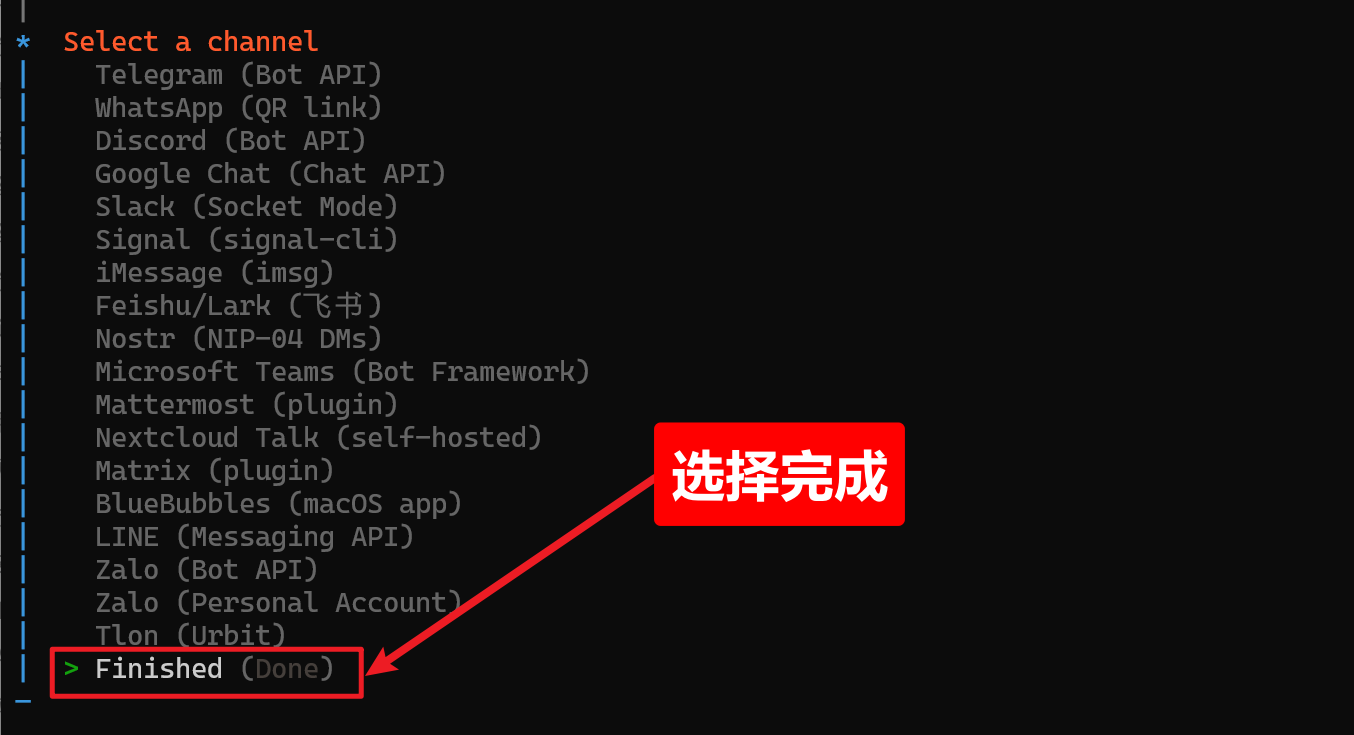

选择管道:

选择配置链接:

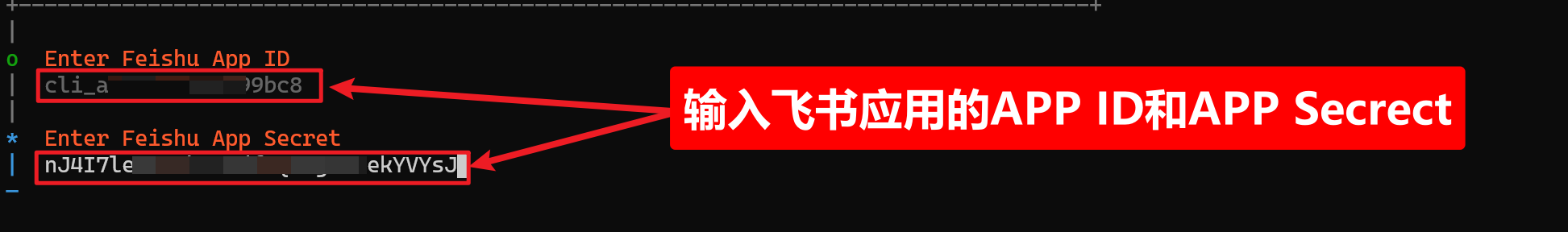

输入飞书的AppID,AppSecrect:

- 飞书开发者后台找到机器人的AppId、App Secret

输入飞书的AppID,AppSecrect:

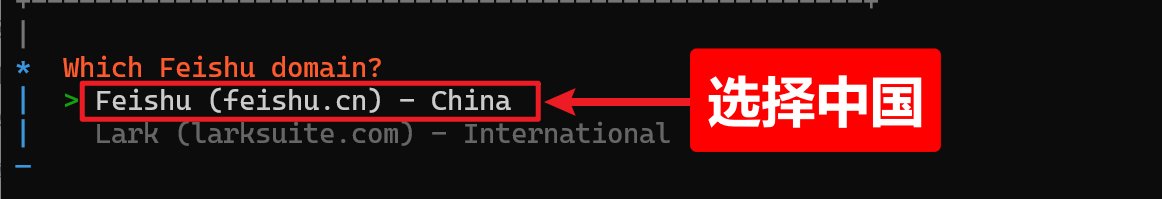

域名选择中国的:

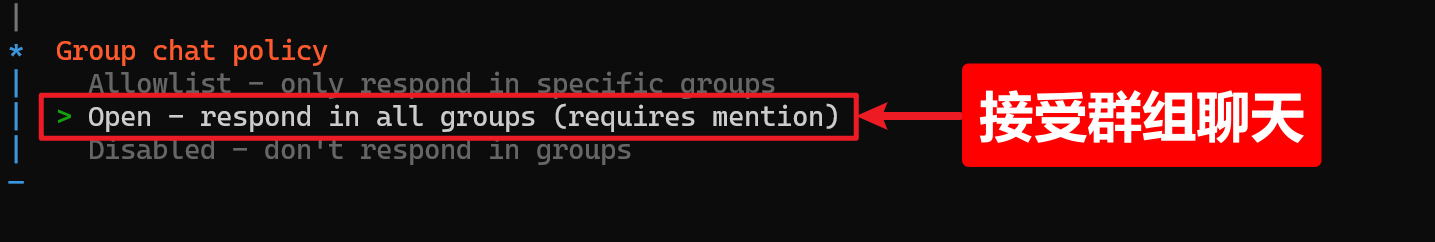

接受群组聊天:

选择完成:

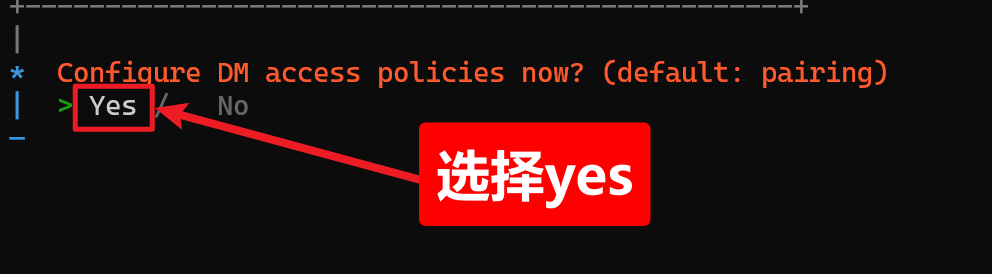

选择yes:

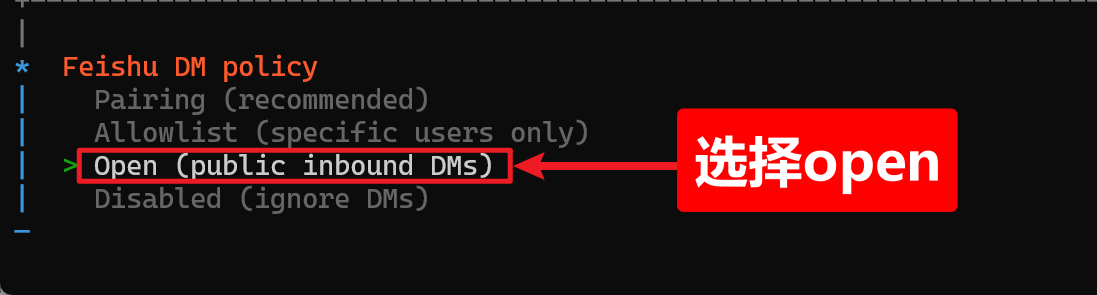

选择open:

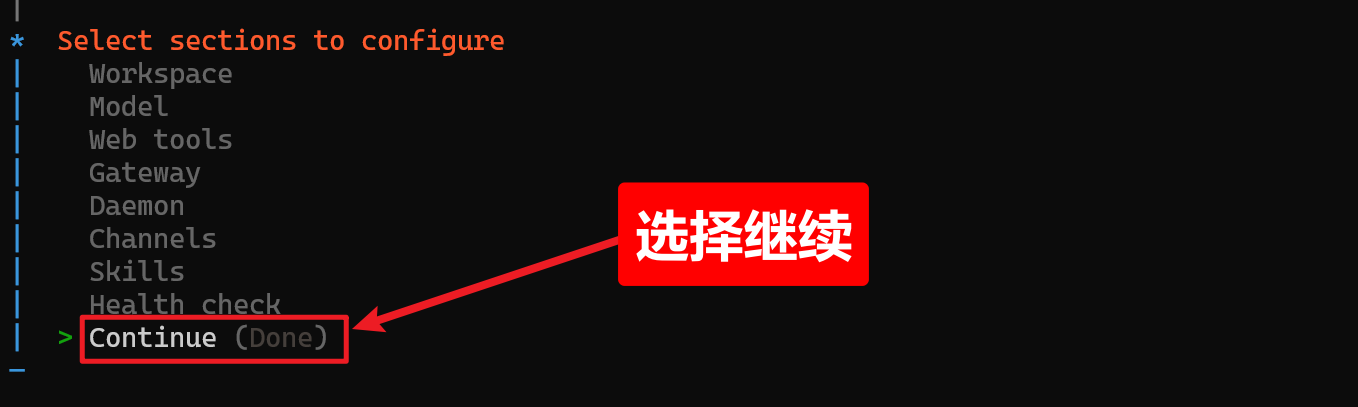

选择继续,完成配置:

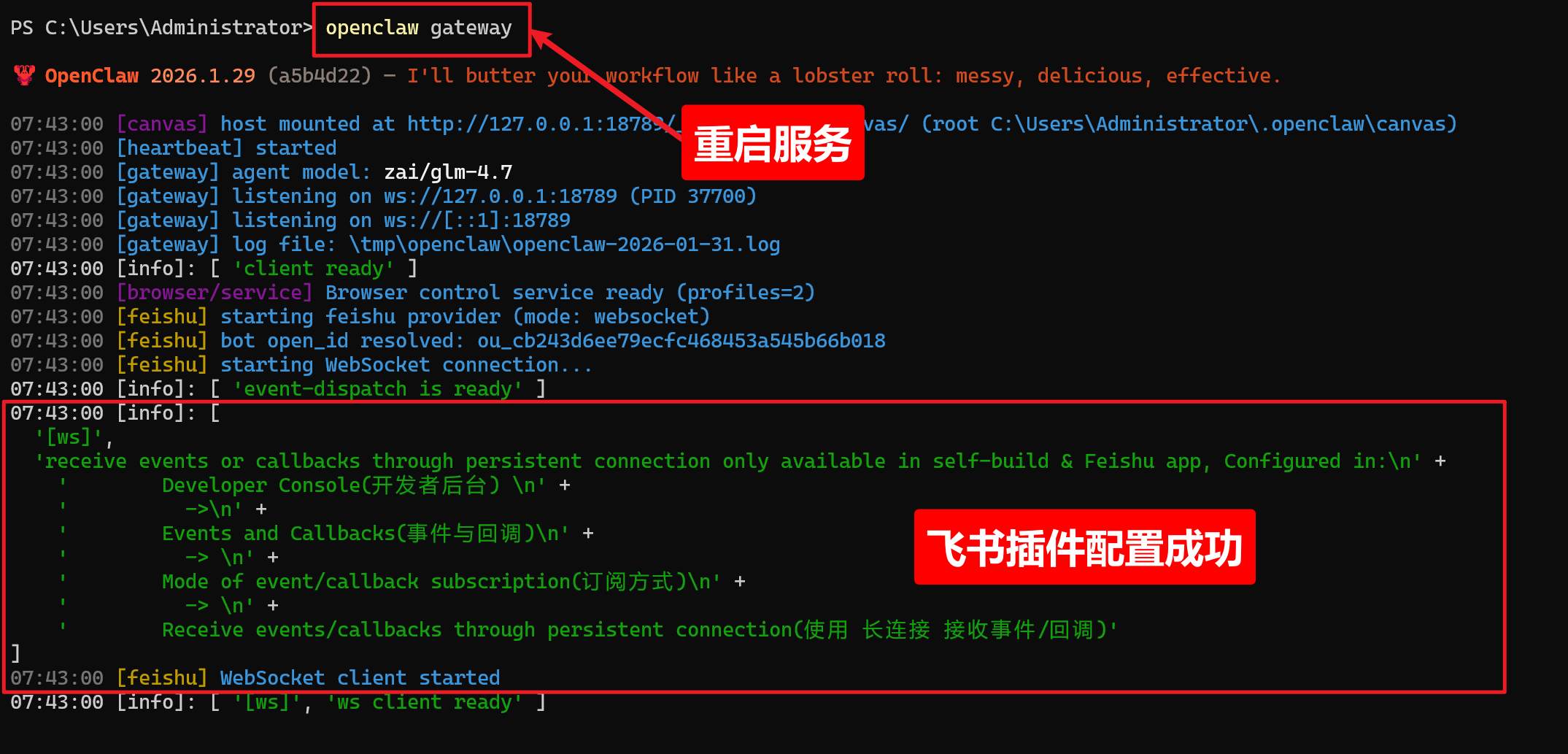

重启服务,使配置生效:

openclaw gateway restart

控制可以看到飞书插件已经配置成功.

七)回到飞书后台设置事件回调

选择 使用长连接接收事件 :

可以看到添加事件按钮由原来的灰色不可点击变为可点击:

添加接收消息事件:

给应用开通获取通讯录基本信息的权限:

【注意】需要重新发布版本。

八)在飞书中与OpenClaw对话

来到飞书客户端或者手机飞书app上:

四、常用命令速查

| 命令 | 功能 |

|---|---|

openclaw onboard |

重新进入配置向导 |

openclaw status |

查看运行状态 |

openclaw health |

健康检查 |

openclaw gateway start |

启动服务 |

openclaw gateway stop |

停止服务 |

openclaw update |

更新到最新版本 |

openclaw doctor |

诊断问题 |

openclaw uninstall |

卸载 OpenClaw |