深入剖析Docker核心架构:从组件交互到内核原理详解

文章目录

- 深入剖析Docker核心架构:从组件交互到内核原理详解

-

- 引言:为什么需要理解Docker架构?

- [一、 整体架构概览:C/S模型与组件协作](#一、 整体架构概览:C/S模型与组件协作)

-

- [1.1 核心组件一览](#1.1 核心组件一览)

- [1.2 核心工作流程(以`docker run nginx`为例)](#1.2 核心工作流程(以

docker run nginx为例))

- [二、 核心组件深度解析](#二、 核心组件深度解析)

-

- [2.1 Docker Daemon (dockerd): 大脑与调度中心](#2.1 Docker Daemon (dockerd): 大脑与调度中心)

- [2.2 containerd 与 runc: 容器运行时的基石](#2.2 containerd 与 runc: 容器运行时的基石)

- [三、 镜像与存储架构:分层与联合文件系统](#三、 镜像与存储架构:分层与联合文件系统)

-

- [3.1 镜像分层原理与写时复制(CoW)](#3.1 镜像分层原理与写时复制(CoW))

- [3.2 存储驱动选型:Overlay2为何成为首选?](#3.2 存储驱动选型:Overlay2为何成为首选?)

- [四、 网络架构:从Bridge到CNI](#四、 网络架构:从Bridge到CNI)

-

- [4.1 默认Bridge网络深度解析](#4.1 默认Bridge网络深度解析)

- [4.2 用户自定义网络与DNS服务](#4.2 用户自定义网络与DNS服务)

- [五、 数据持久化:Volume与Bind Mount的抉择](#五、 数据持久化:Volume与Bind Mount的抉择)

- [六、 内核基石:Namespace与Cgroups](#六、 内核基石:Namespace与Cgroups)

-

- [6.1 Namespace:隔离视图](#6.1 Namespace:隔离视图)

- [6.2 Cgroups:资源管控](#6.2 Cgroups:资源管控)

- [七、 实战:从架构视角排查常见问题](#七、 实战:从架构视角排查常见问题)

-

- [问题1:容器启动失败,报错"OCI runtime create failed"](#问题1:容器启动失败,报错“OCI runtime create failed”)

- 问题2:容器内无法解析域名

- [八、 总结与展望](#八、 总结与展望)

引言:为什么需要理解Docker架构?

Docker已成为容器技术的事实标准,其简洁的命令行背后是一套强大而复杂的底层架构。许多开发者仅停留在docker run的使用层面,当遇到镜像构建缓慢、容器网络不通或资源泄露等问题时往往无从下手。理解Docker的核心架构,不仅是高级使用的必备知识,更是排查复杂问题、进行性能调优以及学习Kubernetes等编排技术的基石。 本文将带你深入Docker内部,逐一拆解其核心组件、数据流与工作原理。

本文价值:你将获得一张清晰的Docker内部"地图",不仅能知道命令如何执行,更能理解其背后的"为什么",从而在运维和开发中更加得心应手。

一、 整体架构概览:C/S模型与组件协作

Docker采用经典的客户端-服务器(C/S)架构,实现了职责分离与良好的可扩展性。其核心组件并非单一进程,而是一个协同工作的生态系统。

1.1 核心组件一览

| 组件 | 进程/工具名 | 核心职责 | 类比 |

|---|---|---|---|

| Docker 客户端 | docker CLI |

接收用户命令,转换为API请求 | 餐厅顾客(下单者) |

| Docker 守护进程 | dockerd |

接收API请求,协调所有Docker对象管理 | 餐厅经理(总协调) |

| 容器运行时 (containerd) | containerd |

容器生命周期管理、镜像传输 | 后厨主管(任务分发) |

| OCI运行时 (runc) | runc |

调用内核接口,创建/运行容器 | 厨师(具体执行者) |

| 容器垫片 | containerd-shim |

守护容器进程,管理I/O和状态 | 服务员(持续服务) |

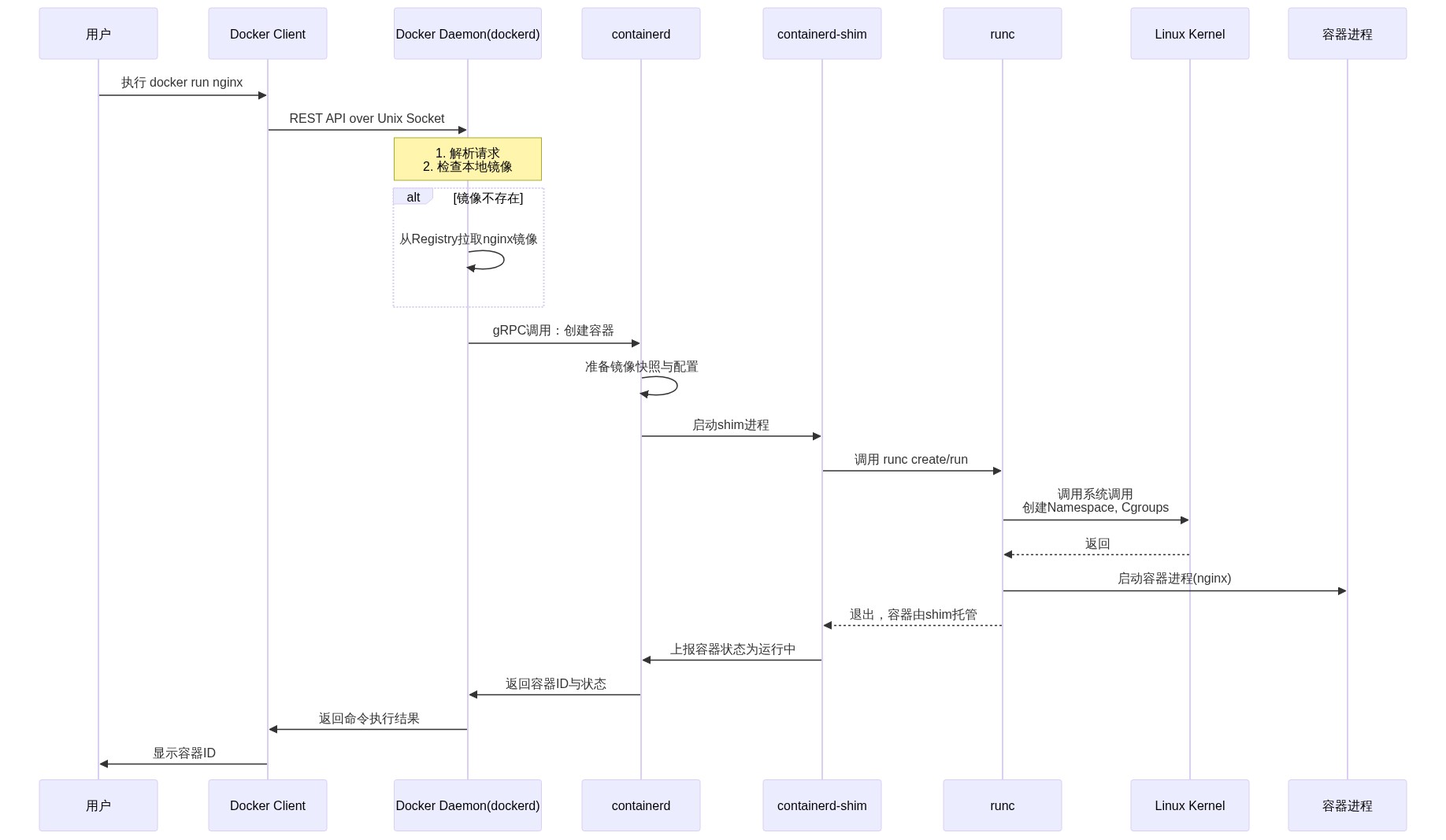

1.2 核心工作流程(以docker run nginx为例)

为了更直观地展示各组件间的交互顺序与协议,我们使用Mermaid绘制其时序图:

流程关键点解析:

- 协议分层:Client与Daemon间使用REST API,Daemon与containerd间使用gRPC,这是为了兼顾外部接口的通用性和内部调用的高性能。

- 职责转移 :

dockerd负责高层管理,但具体的容器创建任务通过gRPC"委托"给了containerd,实现了架构解耦。 - 进程托管 :

runc创建容器后即退出,由containerd-shim作为父进程托管容器,这确保了即使dockerd重启,容器也不会被意外终止。

二、 核心组件深度解析

2.1 Docker Daemon (dockerd): 大脑与调度中心

dockerd远不止是一个API转发器。它是一个多模块集成的守护进程:

go

// 概念性代码,说明dockerd内部模块协作逻辑

type DockerDaemon struct {

ImageService ImageManager // 镜像管理:拉取、构建、缓存

ContainerService ContainerManager // 容器管理(委托给containerd)

NetworkService NetworkManager // 网络管理:创建网桥、配置iptables

VolumeService VolumeManager // 数据卷管理

EventService EventPublisher // 事件发布

}

// 处理 `docker run` 请求的核心逻辑(简化)

func (d *DockerDaemon) RunContainer(request RunRequest) error {

// 1. 镜像准备

image := d.ImageService.GetOrPull(request.Image)

// 2. 配置整合(网络、存储、环境变量等)

config := MergeConfig(image.Config, request.Options)

// 3. 委托containerd创建容器

containerID, err := d.ContainerService.CreateContainer(config)

// 4. 记录元数据并发布事件

d.EventService.Publish("container_create", containerID)

return err

}为什么这样设计? 将容器运行时职责剥离给containerd,使得dockerd可以更专注于Docker特有的上层功能(如Dockerfile构建、Swarm集群管理等),也使得底层运行时可以独立演进(如被Kubernetes的CRI接口使用)。

2.2 containerd 与 runc: 容器运行时的基石

containerd 是一个专注于容器生命周期和镜像管理的守护进程。它不直接操作内核,而是通过操作**容器运行时接口(CRI)**来调用如runc这样的底层工具。

runc 是一个极简的CLI工具,它只做一件事:根据OCI(开放容器倡议) 运行时规范格式的配置文件(config.json),调用Linux系统调用创建容器。

bash

# 手动使用runc运行一个容器的极简示例(需提前准备好rootfs和config.json)

# 1. 创建容器(配置Namespace, Cgroups)

runc create mycontainer

# 2. 启动容器内的进程

runc start mycontainer

# 3. 查看状态

runc state mycontainercontainerd-shim的关键作用:

- 守护进程:作为容器进程(1号进程)的父进程,确保容器不会成为孤儿进程。

- I/O中继 :负责处理容器的

stdin/stdout/stderr,并将其转发给containerd和dockerd。 - 状态汇报:收集容器退出码,并向上汇报。

- 独立存活 :使得容器生命周期与

dockerd/containerd解耦,管理进程重启不影响业务容器。

三、 镜像与存储架构:分层与联合文件系统

3.1 镜像分层原理与写时复制(CoW)

Docker镜像的本质是一系列只读的文件系统层(Layer)。每一层是文件系统的一组差分变更。这种设计带来了巨大优势:

运行中的容器

镜像: myapp:v2

镜像: myapp:v1

Layer 4: ADD app.jar /opt

Layer 3: RUN apt-get install -y openjdk

Layer 2: ENV JAVA_HOME ...

Layer 1: FROM ubuntu:22.04

Layer 4': 更新app.jar

可写层(容器层)

最佳实践建议:

- 优化Dockerfile :将变动频率低的层放在前面(如基础镜像

FROM),变动频率高的层放在后面(如添加应用ADD),以最大化利用层缓存,加速构建。 - 合并层 :在构建的最后阶段,可以考虑使用

多阶段构建或docker-squash工具减少层数,以精简镜像大小。

3.2 存储驱动选型:Overlay2为何成为首选?

存储驱动负责实现分层和CoW。以下是主流驱动的对比:

| 存储驱动 | 原理简述 | 优点 | 缺点 | 适用场景 |

|---|---|---|---|---|

| overlay2 | 使用OverlayFS,将lowerdir(只读层)和upperdir(可写层)联合挂载 | 性能好,内存使用少,主流内核支持 | 需要内核>=4.0 | Linux生产环境首选 |

| aufs | 联合多个目录,上层覆盖下层 | 早期默认,兼容性好 | 未进入主线内核,社区支持弱 | 旧系统过渡 |

| devicemapper | 使用块设备快照 | 兼容RHEL/CentOS旧版 | 性能差,配置复杂 | 特定企业旧环境 |

| zfs/btrfs | 使用对应文件系统的快照功能 | 高级特性(压缩、去重) | 配置复杂,对主机文件系统有要求 | 有特定存储需求的场景 |

配置示例(/etc/docker/daemon.json):

json

{

"storage-driver": "overlay2",

"storage-opts": [

"overlay2.override_kernel_check=true"

]

}四、 网络架构:从Bridge到CNI

4.1 默认Bridge网络深度解析

当你运行一个容器而未指定网络时,Docker会将其连接到默认的bridge网络(对应网桥docker0)。其内部实现如下:

bash

# 在宿主机上查看Docker网络配置

$ ip addr show docker0

3: docker0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 ...

inet 172.17.0.1/16 brd 172.17.255.255 scope global docker0

# 查看容器网络命名空间内的veth端点

$ docker run -d --name web nginx

$ docker exec web ip addr show eth0

# 在宿主机上找到对应的veth pair

$ ip link show | grep veth网络创建与通信流程:

- Docker创建

docker0虚拟网桥(默认网段172.17.0.0/16)。 - 为每个容器创建一对

veth设备,一端放入容器的Network Namespace(命名为eth0),另一端连接到docker0。 - 为容器的

eth0分配IP(如172.17.0.2)。 - 通过

iptables设置NAT规则,实现容器访问外网和端口映射(-p 8080:80)。

4.2 用户自定义网络与DNS服务

使用默认bridge网络时,容器间只能通过IP通信。创建自定义网络可以启用容器名称发现。

bash

# 1. 创建自定义bridge网络

$ docker network create --driver bridge --subnet 192.168.100.0/24 mynet

# 2. 将容器连接到该网络

$ docker run -d --name app1 --network mynet myapp

$ docker run -d --name app2 --network mynet myapp

# 3. 在app2容器内,可以直接通过容器名ping通app1

$ docker exec app2 ping app1 # 成功!原理 :Docker为每个自定义网络内置了一个DNS服务器。当容器app2解析app1时,Docker DNS会返回app1在该网络中的IP地址。

五、 数据持久化:Volume与Bind Mount的抉择

数据卷(Volume)是Docker管理的持久化存储首选。与绑定挂载(Bind Mount)对比如下:

| 特性 | Docker Volume | Bind Mount |

|---|---|---|

| 管理方 | Docker引擎 | 用户自行管理主机目录 |

| 可移植性 | 高(仅需卷名) | 低(依赖主机特定路径) |

| 备份/迁移 | docker volume命令支持 |

需手动操作文件系统 |

| 性能 | 与存储驱动相关,通常较好 | 直接使用主机文件系统,性能最佳 |

| 安全隔离 | 更好(卷在Docker控制下) | 容器可直接访问主机敏感文件 |

生产环境最佳实践:

- 使用命名Volume :

docker volume create app_data,然后通过-v app_data:/app/data挂载。 - 避免使用匿名Volume:不利于管理和迁移。

- 谨慎使用Bind Mount:仅在需要直接编辑主机配置文件或进行开发调试时使用。

六、 内核基石:Namespace与Cgroups

容器隔离的本质是Linux内核特性的组合使用。

6.1 Namespace:隔离视图

每个Namespace为进程提供一套独立的系统资源视图。Docker主要使用以下六种:

c

// 概念性系统调用,展示创建新进程时启用多个Namespace

#define _GNU_SOURCE

#include <sched.h>

#include <sys/types.h>

#include <unistd.h>

int child_func(void *arg) {

// 在这个新进程中,它拥有独立的:

// - PID Namespace: 它认为自己的PID是1

// - Mount Namespace: 独立的文件系统挂载点

// - Network Namespace: 独立的网络设备、IP、端口

// - UTS Namespace: 独立的主机名

// - IPC Namespace: 独立的信号量、消息队列

// - User Namespace: 独立的用户ID映射(可选,增强安全)

printf("Hello from container! My PID is %d\n", getpid());

return 0;

}

int main() {

char *stack = malloc(STACK_SIZE);

// CLONE_NEWNS: Mount namespace

// CLONE_NEWPID: PID namespace

// CLONE_NEWNET: Network namespace

// ... 等标志位组合

int flags = CLONE_NEWNS | CLONE_NEWPID | CLONE_NEWNET | CLONE_NEWUTS | CLONE_NEWIPC;

clone(child_func, stack+STACK_SIZE, flags | SIGCHLD, NULL);

// ...

}6.2 Cgroups:资源管控

Cgroups用于限制、统计和隔离进程组的资源(CPU、内存、IO等)。Docker通过Cgroups实现容器资源限制。

bash

# 查看一个运行中容器的Cgroups配置(以内存为例)

$ docker run -d --name test --memory="512m" nginx

$ CONTAINER_ID=$(docker inspect -f '{{.Id}}' test)

# 在宿主机上查看该容器的内存限制(路径可能因系统而异)

$ cat /sys/fs/cgroup/memory/docker/$CONTAINER_ID/memory.limit_in_bytes

536870912 # 即512MB七、 实战:从架构视角排查常见问题

问题1:容器启动失败,报错"OCI runtime create failed"

排查思路:

- 定位故障层级 :此错误通常来自

runc。说明dockerd和containerd的请求已下达,但在调用内核创建容器时失败。 - 检查内核特性 :运行

docker info,确认存储驱动、Cgroups支持等是否正常。 - 查看详细日志 :使用

docker --debug运行命令,或查看containerd日志(journalctl -u containerd)。 - 常见原因 :宿主机内核版本过低、缺少某些内核模块(如

overlay)、/var/lib/docker磁盘空间不足、Cgroups配置错误。

问题2:容器内无法解析域名

排查思路:

- 检查容器网络配置 :

docker exec <container> cat /etc/resolv.conf,确认DNS服务器地址(默认应为Docker网桥IP,如172.17.0.1)。 - 检查宿主机DNS :Docker容器默认使用宿主机的DNS配置。检查宿主机

/etc/resolv.conf。 - 检查防火墙/iptables:宿主机防火墙规则可能阻断了DNS查询(UDP 53端口)。

- 自定义网络DNS:如果使用自定义网络,确保没有错误地覆盖了DNS设置。

八、 总结与展望

通过本文的深度剖析,我们可以看到Docker架构的精妙之处在于清晰的层次划分 和标准的接口定义:

- 应用层 :

docker CLI提供用户体验。 - 引擎层 :

dockerd整合Docker生态功能。 - 运行时层 :

containerd提供稳定的容器生命周期管理,遵循CRI标准。 - 内核层 :

runc调用Namespace和Cgroups实现隔离,遵循OCI标准。

这种架构不仅使Docker稳定高效,也使得其底层组件(如containerd、runc)能够被其他容器项目(如Kubernetes、Podman)复用,推动了整个云原生生态的繁荣。

理解这些核心原理,你将能:

- 更精准地定位生产环境中的容器问题。

- 更合理地规划容器资源与存储方案。

- 更顺畅地过渡到学习Kubernetes等编排系统,因为它们建立在相同的容器运行时基础之上。

参考资料与延伸阅读:

- Docker Official Documentation: Architecture - 官方权威架构说明

- containerd Project - 了解容器运行时的核心

- Open Container Initiative (OCI) Specifications - 容器标准的源头

- Linux man-pages: namespaces, cgroups - 深入理解内核机制