📖标题:EvoPrune: Early-Stage Visual Token Pruning for Efficient MLLMs

🌐来源:arXiv, 2603.03681v1

🌟摘要

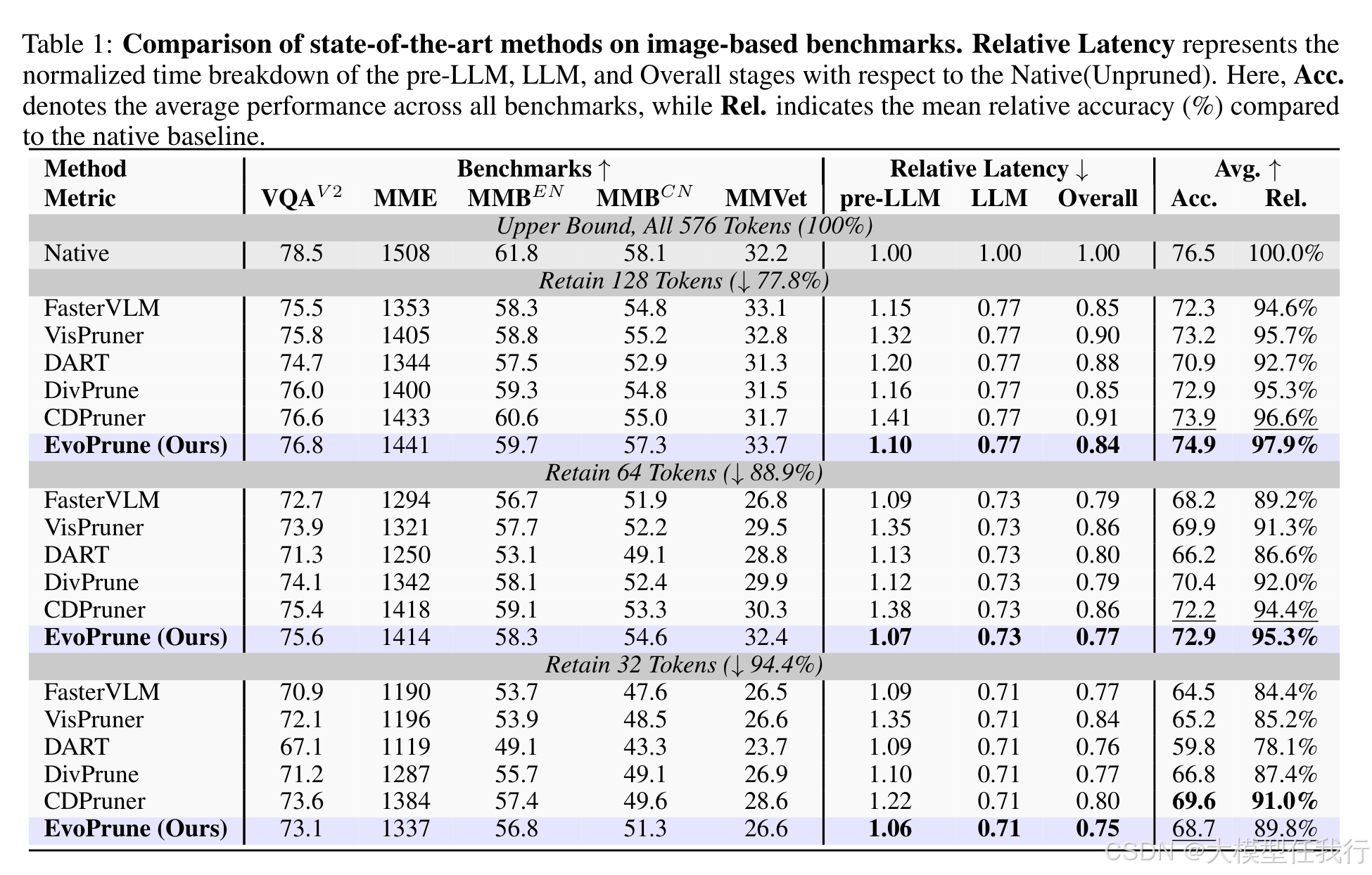

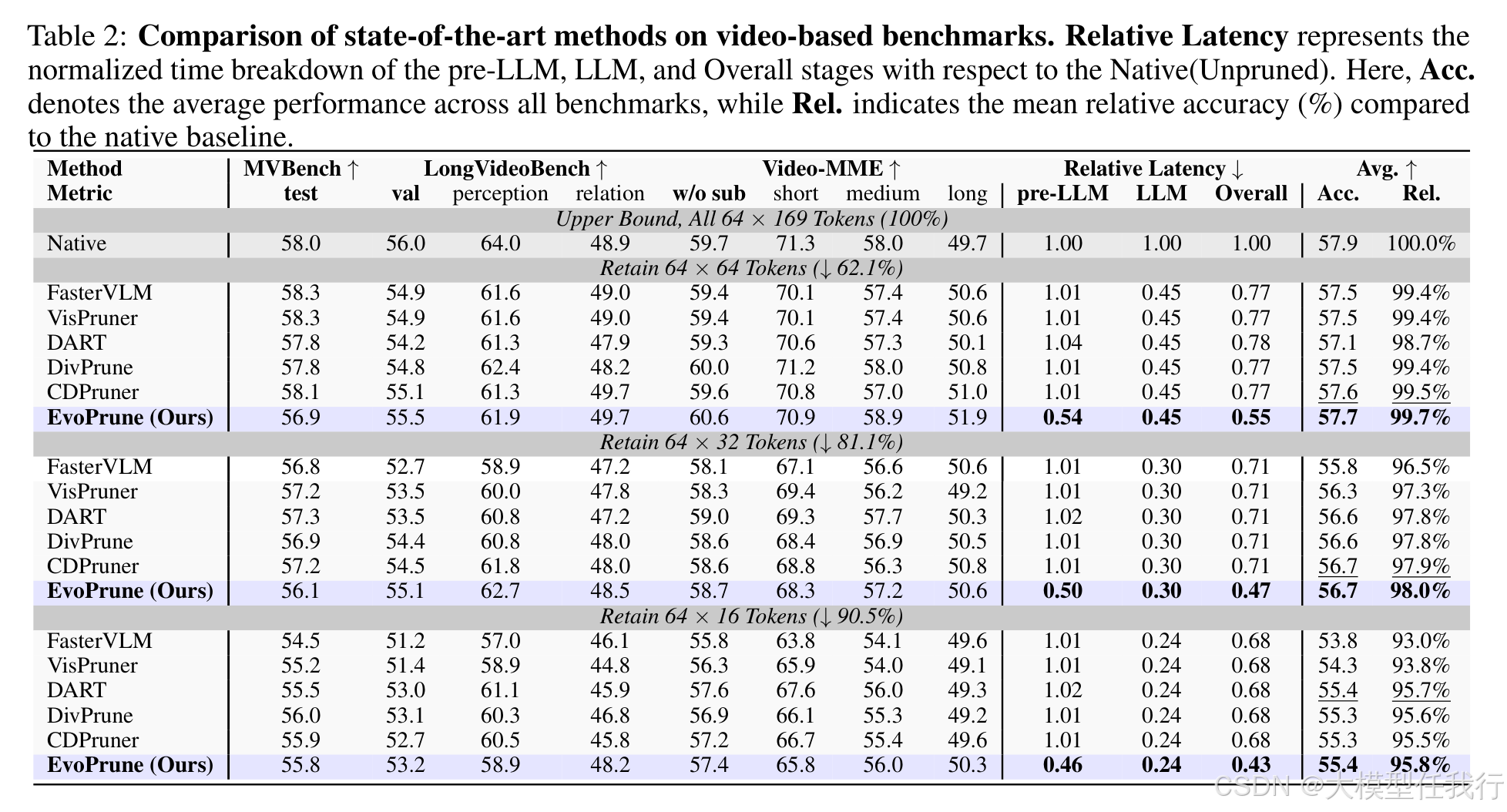

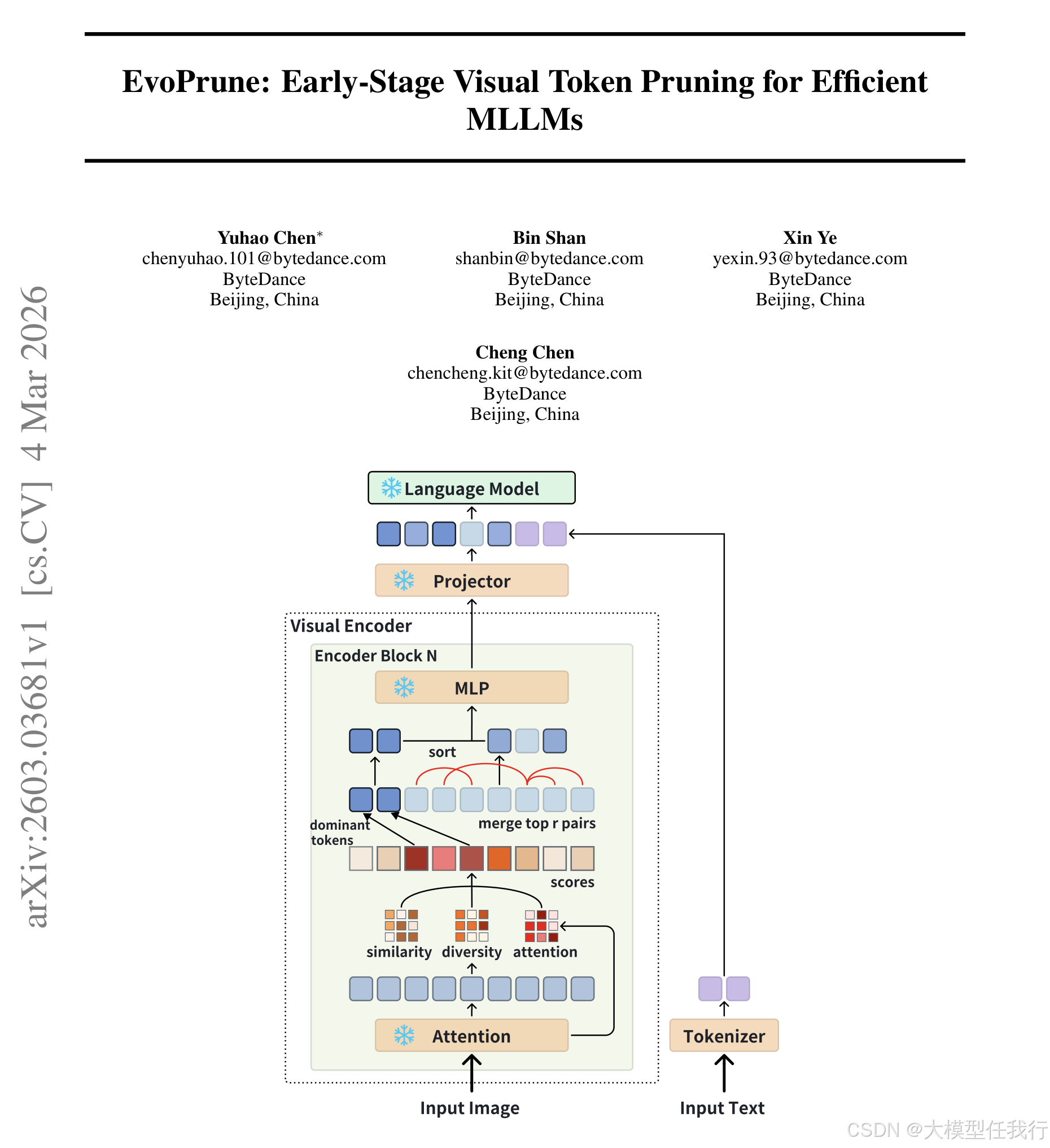

多模态大语言模型(MLLM)在视觉-语言任务中表现出了强大的性能,但其推理效率受到高分辨率图像和视频等复杂场景中视觉标记指数级增长的严重限制。现有的视觉标记剪枝方法主要在视觉编码之后运行,忽略了编码阶段产生的大量计算成本。为了解决这个问题,我们提出了EvoPrune,这是一种针对MLLM的早期视觉标记剪枝方法,在视觉编码期间直接执行剪枝。具体来说,EvoPrune采用了由标记相似性、多样性和基于注意力的重要性指导的分层剪枝策略,以在选定的编码层保留最具信息性的视觉标记。图像和视频基准测试的广泛实验验证了EvoPrune的有效性。特别是,在VideoMME数据集上,EvoPrune实现了2倍的推理加速,性能下降不到1%,展示了其对延迟敏感的MLLM部署的潜力。

🛎️文章简介

🔸研究问题:如何在多模态大语言模型(MLLMs)中高效减少高分辨率图像和视频带来的视觉令牌爆炸问题,同时避免现有方法仅在视觉编码后剪枝导致的编码阶段计算瓶颈?

🔸主要贡献:论文提出EvoPrune,首个在视觉编码器内部、前向传播过程中即进行分层引导式视觉令牌剪枝的方法,实现端到端推理加速与信息保留的统一。

📝重点思路

🔸设计早阶段剪枝范式,将令牌合并操作嵌入视觉编码器的多个Transformer层中,而非仅在编码完成之后。

🔸采用层-wise剪枝预算分配策略,支持灵活配置各层剪枝数量(如Skip、First、Last等模式),并实证选择交替层(Skip)为最优方案。

🔸提出三因素融合的打分机制:基于余弦相似度的语义吸引项、基于局部密度估计的多样性惩罚项、以及基于多头注意力权重平均的重要性保留项。

🔸引入临界令牌比(CTR)动态保护高重要性令牌,通过设置负无穷权重禁止其参与合并,确保关键视觉-语义信息不被破坏。

🔸采用二部图软匹配策略,在token分组间定向筛选合并对,兼顾结构一致性与计算可控性。

🔎分析总结

🔸在VideoMME上实现2×端到端加速且性能下降<1%,显著优于所有基线方法,验证早阶段剪枝对视频理解任务的强适配性。

🔸消融实验表明,同时移除注意力保留与多样性惩罚会导致平均准确率下降1.8个百分点,证明二者互补且不可或缺。

🔸相比基线方法(如FasterVLM、VisPruner),EvoPrune在视觉编码阶段即获得1.8×加速,中间模块5×加速,LLM阶段约2×加速,全面缓解全链路瓶颈。

🔸在极端压缩下(90.5%令牌削减),仍保持95.8%相对准确率,说明其在高压缩率下具备鲁棒的信息保留能力。

🔸Skip策略在精度-延迟权衡中表现最优,既避免早期过度剪枝导致特征坍塌,又防止晚期集中剪枝带来计算冗余。

💡个人观点

论文将剪枝视为编码过程的一部分,从根源上削减计算负载;其多准则打分机制兼具可解释性与有效性,无需微调、即插即用,为MLLM边缘部署提供了切实可行的技术路径。

🧩附录