我的背景:

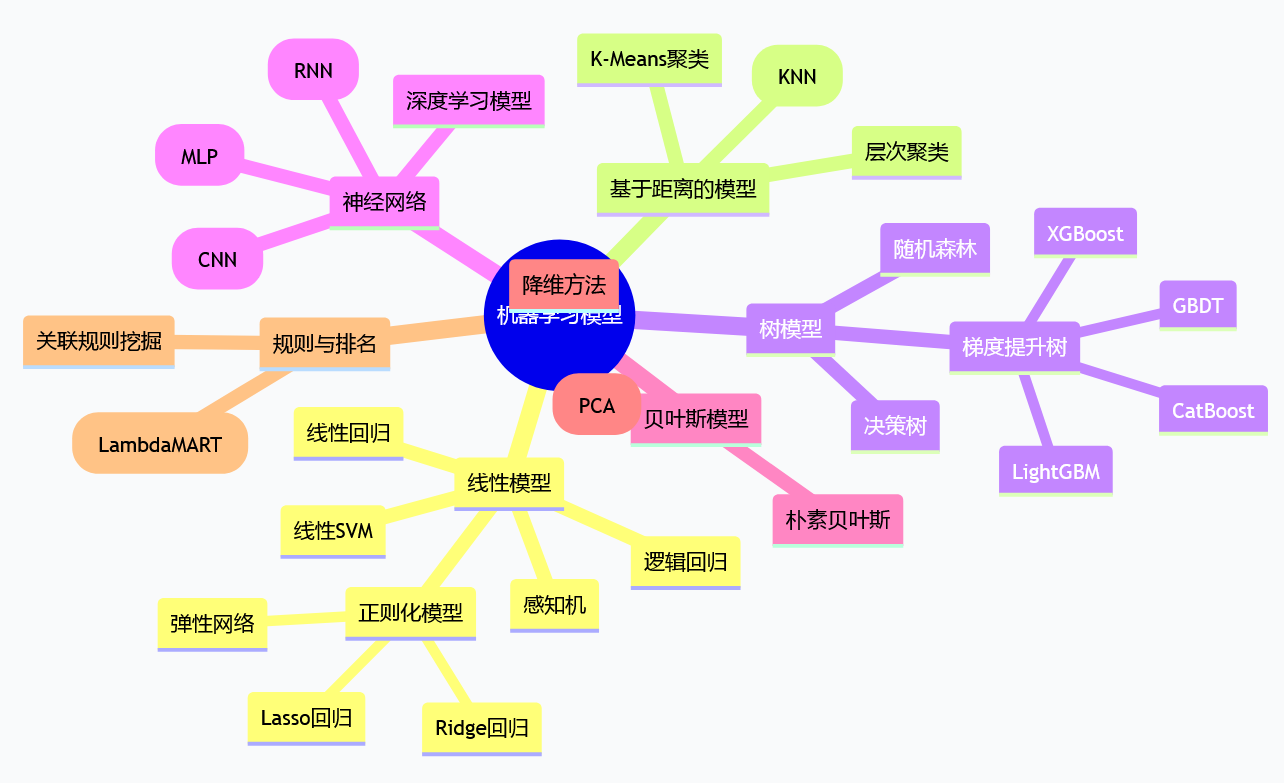

我目前所知道名字的有很多模型,如:

1.线性模型与广义线性模型:线性回归、逻辑回归、线性SVM(支持向量机)、感知机。

2.基于距离的模型:K近邻(KNN)、K-Means聚类、层次聚类。

3.神经网络与深度学习:多层感知机(MLP)、卷积神经网络(CNN)、循环神经网络(RNN)。

4.主成分分析(PCA)

5.正则化模型:Lasso回归、Ridge回归、弹性网络。

6.树模型:决策树、随机森林、梯度提升树(GBDT、XGBoost、LightGBM、CatBoost)。

7.朴素贝叶斯

8.基于规则或排名的模型:排名算法(如LambdaMART)、关联规则挖掘。

等等,反正有很多。但是我也只是知道它们的名字而已,我对他们并不了解,不知道它们都适合什么场景的任务?***********************************

另外针对我的任务,根据我的特征提取的方法和我的分类任务来看,我应该选什么模型?比较适合我的实验场景呢?为什么?请推荐几个我可以尝试的模型,并给出你的理由依据

机器学习模型种类繁多,但我们可以根据任务类型 将它们分类,并理解每个模型的核心假设 和适用场景。下面我将按照常见的任务类别(回归、分类、聚类、降维、规则挖掘)逐一讲解你列出的模型,并补充一些关键知识点。学完之后,你将能根据实际问题快速筛选合适的模型。

一、回归任务(预测连续数值)

1. 线性回归

-

核心思想:假设目标值与特征是线性关系,通过最小化均方误差拟合直线/超平面。

-

适用场景:特征与目标关系近似线性,且特征间无强共线性;数据量不大时效果好。

-

优点:简单、可解释性强(系数直接反映特征影响)。

-

缺点:无法处理非线性;对异常值敏感;容易欠拟合。

2. Ridge回归 / Lasso回归 / 弹性网络(Elastic Net)

-

核心思想:在线性回归基础上加入正则化项,防止过拟合。

-

Ridge(L2正则化):使系数趋近于0但不等于0,适合特征间存在相关性的情况。

-

Lasso(L1正则化):可使部分系数变为0,实现特征选择,适合高维稀疏特征。

-

弹性网络:结合L1和L2,兼具两者优点。

-

-

适用场景:特征维度高、可能有多重共线性、希望自动特征选择时。

-

优点:提升泛化能力,Lasso可做特征筛选。

-

缺点:仍假设线性关系;需要调正则化参数。

3. 支持向量回归(SVR)

-

核心思想:寻找一个超平面,使尽可能多的样本落在"间隔带"内,容忍一定误差。

-

适用场景:中等规模数据集,特征维度较高,且可能存在非线性关系(通过核函数)。

-

优点:通过核技巧可处理非线性;对异常值鲁棒。

-

缺点:参数多(核函数、惩罚系数),训练慢;不适用于超大样本。

二、分类任务(预测离散类别)

- 逻辑回归

-

核心思想:用sigmoid函数将线性组合映射到[0,1],作为概率输出。

-

适用场景:二分类或多分类,特征与对数几率近似线性;作为基线模型。

-

优点:输出概率,可解释性强;训练快;不易过拟合。

-

缺点:决策边界线性;对特征交互无能为力。

- 线性SVM(支持向量机)

-

核心思想:寻找最大化类别间隔的超平面,仅用支持向量决定决策边界。

-

适用场景:小规模数据,特征维度高,类别线性可分。

-

优点:泛化能力强(最大间隔原则);对高维有效。

-

缺点:原始形式只能处理线性;对参数敏感。

- 核SVM

-

核心思想:通过核函数将数据映射到高维空间,在高维空间做线性SVM。

-

适用场景:数据非线性可分,但样本量不太大(<10万)。

-

优点:强大而灵活,可处理复杂边界。

-

缺点:计算复杂度高;难以解释;需选择合适的核函数和参数。

- 感知机

-

核心思想:最简单的神经网络,通过错误驱动更新权重。

-

适用场景:线性可分数据的二分类;通常作为神经网络的入门概念。

-

优点:极其简单,收敛性有理论保证。

-

缺点:只能处理线性可分;不输出概率;对噪声敏感。

- K近邻(KNN)

-

核心思想:基于距离度量,找最近的K个样本,用它们的类别投票。

-

适用场景:低维空间,数据分布复杂但边界不规则;适合作为非参数基准。

-

优点:简单直观;无需训练;可处理多分类。

-

缺点:预测慢(需计算所有样本距离);对特征缩放敏感;维度灾难。

- 朴素贝叶斯

-

核心思想:基于贝叶斯定理,假设特征条件独立。

-

适用场景:文本分类(如垃圾邮件过滤),特征离散且相互独立假设近似成立。

-

优点:计算快;对小规模数据有效;可处理多分类。

-

缺点:特征独立假设往往不成立,可能影响精度。

- 决策树

-

核心思想:通过递归划分特征空间,构建树状决策规则。

-

适用场景:数据有非线性关系,希望模型可解释。

-

优点:可解释性强(可视化树);无需特征缩放;能处理混合类型特征。

-

缺点:容易过拟合;不稳定(数据微小变化可能生成不同树)。

- 随机森林

-

核心思想:集成多棵决策树,通过Bagging和随机特征选择降低方差。

-

适用场景:各种分类/回归问题,尤其当特征多、样本量大时。

-

优点:精度高;抗过拟合;能输出特征重要性;处理高维数据好。

-

缺点:模型较大;预测速度较慢;可解释性比单棵树差。

- 梯度提升树(GBDT / XGBoost / LightGBM / CatBoost)

-

核心思想:逐步添加树,每棵树拟合前一棵树的残差或梯度。

-

适用场景:表格数据竞赛首选,几乎适用于任何结构化数据分类/回归。

-

优点:精度通常极高;处理缺失值、类别特征(CatBoost);内置正则化。

-

缺点:参数多,需仔细调优;训练时间较长;对异常值敏感。

- 多层感知机(MLP)

-

核心思想:由输入层、若干隐藏层和输出层组成的全连接神经网络,通过反向传播学习。

-

适用场景:特征已经提取好(如你的256维向量),数据量足够,且需要学习复杂非线性关系。

-

优点:万能近似定理;可灵活设计结构。

-

缺点:需要大量数据;调参复杂;可解释性差。

- 卷积神经网络(CNN)

-

核心思想:利用卷积核提取局部特征,适合具有空间结构的数据(如图像、语音)。

-

适用场景:图像分类、目标检测、文本分类(一维卷积)。

-

优点:参数共享,平移不变性;自动提取局部特征。

-

缺点:需要大量数据;不适合你的256维特征(无空间结构)。

- 循环神经网络(RNN / LSTM / GRU)

-

核心思想:处理序列数据,通过循环单元记忆历史信息。

-

适用场景:时间序列预测、自然语言处理、语音识别。

-

优点:擅长捕捉序列依赖。

-

缺点:训练慢,易梯度消失;不适合你的固定长度特征(无时序性)。

三、聚类任务(无监督分组)

- K-Means聚类

-

核心思想:将样本划分为K个簇,每个簇由质心代表,通过迭代优化簇内距离平方和。

-

适用场景:数据呈球形分布,簇大小大致均匀;需要预先指定K。

-

优点:简单、快速,适合大规模数据。

-

缺点:对初始值敏感;只能发现凸形簇;需指定K。

- 层次聚类

-

核心思想:构建树状结构,可自底向上(凝聚)或自顶向下(分裂)。

-

适用场景:小样本数据(<1000),希望可视化聚类层次。

-

优点:无需指定K;输出树状图,可解释。

-

缺点:计算复杂度高;对噪声和离群点敏感。

- DBSCAN(你未列出,但值得补充)

-

核心思想:基于密度,将高密度区域连成簇,能发现任意形状簇。

-

适用场景:数据形状复杂,有噪声点,无需指定K。

-

优点:自动识别离群点;对簇形状无假设。

-

缺点:对密度参数敏感;高维数据效果差。

四、降维与特征提取

- 主成分分析(PCA)

-

核心思想:通过线性变换,将数据投影到方差最大的方向上,达到降维目的。

-

适用场景:可视化高维数据;去除噪声;作为预处理步骤。

-

优点:无监督,计算快;降维后各主成分正交。

-

缺点:线性变换,可能丢失非线性结构;新特征难以解释。

- t-SNE / UMAP(你未列出,常用可视化)

-

核心思想:非线性降维,保留局部邻域结构,常用于可视化。

-

适用场景:将高维数据映射到2D/3D便于观察。

-

优点:可视化效果好。

-

缺点:计算慢;结果随机;不能用于新样本(仅可视化)。

五、规则挖掘与排名

- 关联规则挖掘(如Apriori算法)

-

核心思想:发现频繁项集,挖掘形如"购买A → 购买B"的规则。

-

适用场景:购物篮分析、推荐系统。

-

优点:可解释性强,能发现意外关联。

-

缺点:需设定最小支持度和置信度;数据需是事务型。

- 排名算法(如LambdaMART)

-

核心思想:基于梯度提升树,优化排序指标(如NDCG)。

-

适用场景:搜索引擎排序、推荐系统列表排序。

-

优点:针对排序任务优化,效果好。

-

缺点:实现复杂;需要标注好的排序数据。

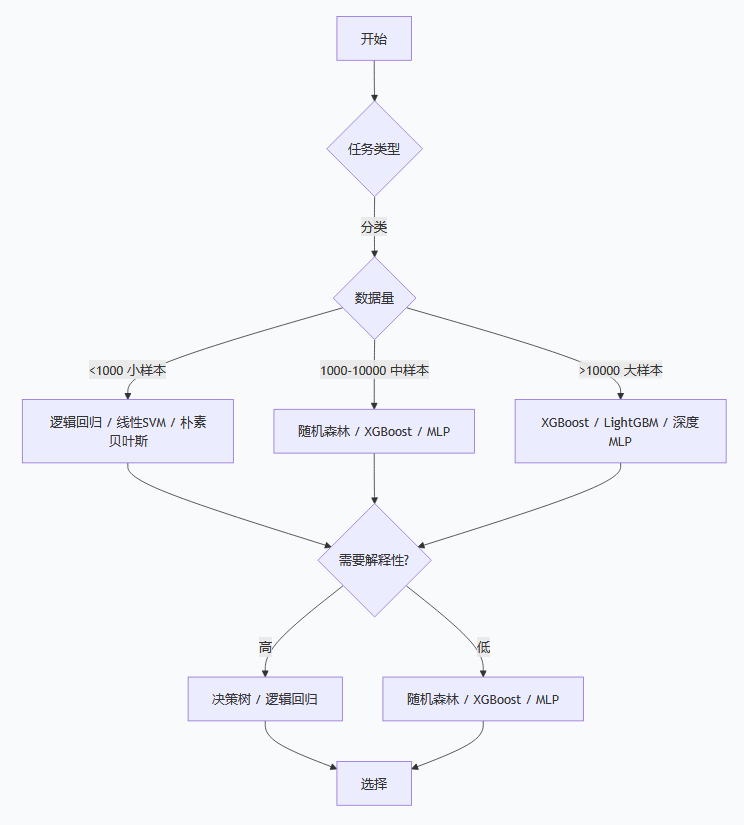

六、如何根据任务选择模型?

-

明确任务类型 :回归?分类?聚类?降维?

-

考虑数据特性:

-

数据量 :小样本(<1000)选朴素贝叶斯、SVM、逻辑回归;大样本选神经网络、随机森林、XGBoost。

-

特征维度 :高维(>10000)选Lasso、线性SVM、随机森林;低维可考虑KNN、决策树。

-

线性关系:若线性,逻辑回归、线性SVM即可;非线性用核SVM、树模型、神经网络。

-

可解释性需求:高则选逻辑回归、决策树;低则用随机森林、XGBoost、深度学习。

-

数据是否结构化 :图像用CNN;文本用RNN/Transformer;表格数据用树模型或MLP。

-

-

常用实践:

-

分类问题先试逻辑回归、随机森林、XGBoost。

-

回归问题先试线性回归、Ridge、随机森林回归、XGBoost回归。

-

聚类先试K-Means(数据量大时)或层次聚类(小样本)。

-

降维用PCA或t-SNE。

-

-

交叉验证与调参:最终通过交叉验证比较多个候选模型的性能,选出最佳。

线性关系:若线性,逻辑回归、线性SVM即可;非线性用核SVM、树模型、神经网络。

但是这个线性关系如何判断呢?什么是线性?什么是非线性?我的场景下应该如何判断是线性还是非线性?

请见附录1!!!

七、回到我的任务

- 我的场景是:目前我已经通过semantic_feature_extractor_v3提取到了128维的语义特征,另外也通过main_workflow_v2提取到了128维的程序级的图嵌入。

- 我的目标:融合128维的语义特征+128维的程序级图嵌入,然后做恶意代码文件的监督分类任务(二分类)。

- 我的方案是:将semantic_feature_extractor_v3提取的128维特征向量与fcg_gnn产生的程序级128维图级嵌入拼接起来,再将256维的融合特征+标签文件输入到下游的模型做二分类。

一、任务分析

-

任务类型 :监督分类(二分类),目标是区分恶意/正常程序。

-

数据特性:

-

特征维度 :256维(拼接后),属于低维(通常<1000可视为低维)。

-

数据量:未指定,需分情况讨论。恶意代码检测数据集可能从几百到几十万不等。

-

线性关系 :未知,但恶意代码特征往往复杂,通常非线性。

-

可解释性需求 :安全领域常需理解模型为何判定恶意,因此可解释性有一定要求,但不是绝对必须。

-

数据结构 :特征已提取为固定长度向量,属于表格数据,无空间/时序结构。

-

二、根据数据量选择模型

1. 小样本(<1000 条样本)

-

推荐模型:

-

逻辑回归 :线性基线,不易过拟合,输出概率,可解释。

-

线性SVM :最大化间隔,对小样本泛化能力强。

-

朴素贝叶斯:假设特征独立,计算快,适合小文本特征(但你的特征是数值型,可能不太适合)。

-

决策树(限制深度):可解释,但需控制深度避免过拟合。

-

-

理由:小样本下复杂模型(如XGBoost、神经网络)容易过拟合,简单模型更稳定。

2. 中等样本(1000 ~ 10000 条)

-

推荐模型:

-

随机森林 :集成树,抗过拟合,能自动捕捉非线性,输出特征重要性。

-

XGBoost / LightGBM :梯度提升树,精度高,内置正则化,适合表格数据。

-

核SVM(RBF核):可处理非线性,但训练时间随样本量增长较快。

-

MLP(2~3层):可尝试,配合Dropout和早停。

-

-

理由:数据量足够支撑复杂模型,树模型和MLP能学习非线性关系,且随机森林和XGBoost在表格数据上表现优异。

3. 大样本(>10000 条)

-

推荐模型:

-

XGBoost / LightGBM / CatBoost:依然是最强基线,可处理大规模数据。

-

MLP(3~4层):深度网络可发挥优势,需注意正则化和调参。

-

随机森林(可并行训练,但模型较大)。

-

线性模型可作为对比基线。

-

-

理由:大样本下复杂模型能充分学习,梯度提升树和神经网络均可取得好效果。

三、不适合的模型

-

KNN:预测需计算所有样本距离,慢且受维度灾难影响,256维虽不高但仍不推荐。

-

CNN / RNN / LSTM / Transformer :这些模型依赖空间或时间结构,你的特征是全局拼接的向量,无局部顺序,强行使用会引入虚假先验,且参数多易过拟合。不推荐。

-

PCA:这是降维方法,不是分类器。可在预处理时使用,但你的维度已不高,可能不需要。

四、可解释性考虑

若业务需要解释模型为何判定恶意:

-

逻辑回归:系数直接反映特征影响。

-

决策树:可生成可视化规则。

-

随机森林 / XGBoost:可输出特征重要性,但难以追溯单条决策路径。

-

MLP:可解释性差。

五、实验建议

-

数据预处理:对256维特征进行标准化(Z-score),有助于线性模型和MLP收敛;树模型不需要。

-

基线模型:先用逻辑回归快速验证特征有效性。

-

重点候选:随机森林、XGBoost/LightGBM、MLP(2层)。根据数据量选择。

-

交叉验证:使用5折交叉验证评估F1、AUC等指标,避免单次划分的随机性。

-

超参数调优:对每个模型进行简单网格搜索。

六、总结推荐表

| 模型 | 适合数据量 | 优点 | 缺点 | 适用性(你的任务) |

|---|---|---|---|---|

| 逻辑回归 | 小/中 | 简单、可解释、快速 | 线性边界 | ✅ 强基线 |

| 线性SVM | 小/中 | 最大间隔,泛化好 | 线性 | ✅ 可选 |

| 核SVM | 中(<5000) | 非线性,强大 | 训练慢,难调参 | ⚠️ 数据量适中可试 |

| 随机森林 | 中/大 | 非线性、抗过拟合、特征重要性 | 模型大,慢 | ✅ 推荐 |

| XGBoost/LightGBM | 中/大 | 精度高、速度快、正则化 | 参数多,需调优 | ✅ 推荐 |

| MLP(2~3层) | 中/大 | 万能近似,灵活 | 需调参,数据少易过拟合 | ✅ 可选 |

| 朴素贝叶斯 | 小 | 极快 | 特征独立假设强 | ❌ 不太适合数值特征 |

| KNN | 小 | 简单 | 慢,维度敏感 | ❌ 不推荐 |

| CNN/LSTM | 大 | 有时序/空间结构时好 | 无结构,易过拟合 | ❌ 不推荐 |

根据你的实际数据量,从"推荐"和"可选"中选择2~3个模型进行对比实验即可。

附录

1.如何判断数据是线性还是非线性关系?

在机器学习中,"线性"与"非线性"通常指的是特征与目标变量之间的关系 ,或者更具体地说,类别之间的决策边界的形状。理解这一概念有助于选择合适的模型。

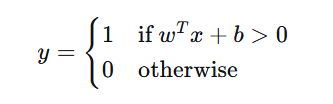

一、什么是线性关系?

1. 线性可分(分类问题)

如果存在一个线性超平面(在二维中是直线,三维中是平面,更高维中是超平面)能够将不同类别的样本完全分开,那么数据是线性可分的。

数学形式 :

对于二分类,线性模型试图找到一个权重向量 w 和偏置 b,使得对于所有样本 x,有:

如果这样的 w,b 存在,则数据线性可分。

直观理解:在二维平面上,你能用一条直线将两类点分开,就是线性可分;如果不能,就是非线性。

二、什么是非线性关系?

如果决策边界不是直线(或超平面),而是曲线、折线、不规则形状等,那么数据就是非线性可分的。

例如:

-

两类点呈环形分布,内圈一类,外圈一类,没有直线能分开。

-

两类点呈螺旋状交织。

-

特征与目标之间是复杂的函数关系,如 y=sin(x)。

在非线性情况下,线性模型无法准确分类,需要用能够拟合复杂边界的模型(如核SVM、树模型、神经网络)。

三、如何判断自己的数据是线性还是非线性?

在实际项目中,我们通常不知道数据的内在分布,需要借助一些方法来判断或验证。

- 可视化降维

-

如果特征是二维或三维,可以直接画散点图观察。

-

对于高维数据(如你的256维),可以使用PCA 或t-SNE将数据降到2维,然后观察类别分布。

-

如果降维后两类点明显被一条直线或简单曲线分开,可能近似线性。

-

如果两类点混杂、缠绕、呈复杂形状,则很可能是非线性。

-

注意:降维会损失信息,只能提供直观参考,不能完全确定。

- 先用线性模型尝试

-

训练一个逻辑回归或线性SVM,在训练集和验证集上评估性能。

-

如果准确率、F1等指标已经很高(例如>95%),且与复杂模型差距不大,说明数据可能近似线性。

-

如果线性模型表现很差(比如低于70%),而树模型或神经网络显著提升,则说明存在较强的非线性。

-

- 特征交互的复杂性

-

如果特征之间存在明显交互作用(例如,某个特征的值需要与另一个特征的值配合才能区分类别),往往是线性的。

-

在恶意代码检测中,攻击者可能使用多种混淆技术,导致特征组合复杂,通常需要非线性模型。

- 领域知识

-

根据业务经验判断。例如,在图像分类中,像素与类别的关系显然是高度非线性的;在房价预测中,面积与价格可能近似线性,但加上地理位置等特征后也可能非线性。

-

在恶意代码检测中,单一特征可能不足以区分恶意性,往往需要多个特征的复杂组合,因此通常认为是非线性问题。

四、你的任务场景:恶意代码检测

- 特征来源

-

语义特征:从源代码中提取的容器逃逸相关统计特征,如敏感函数调用次数、攻击模式匹配数等。

-

图嵌入:从FCG(函数调用图)中通过GNN学习到的程序结构表示。

- 线性还是非线性?

-

这些特征已经过提取和压缩,但原始代码中的恶意模式往往需要组合多个线索才能发现。例如,仅出现某个敏感函数可能正常,但结合网络连接和特定路径才构成恶意。

-

因此,特征之间的交互关系很可能是非线性的,线性模型可能无法捕捉到这些高阶组合。

-

实际项目中,恶意代码检测通常使用树模型或深度学习,因为它们的决策边界更灵活。

- 建议

不必事先纠结于线性/非线性的判断,直接通过实验对比即可:

-

将逻辑回归作为基线(如果它表现尚可,说明数据有一定线性成分)。

-

同时测试随机森林、XGBoost、MLP等非线性模型。

-

如果非线性模型显著优于线性模型,说明数据本质上是非线性的。

-

如果所有模型表现都差不多,数据可能偏线性,选择最简单的模型即可。

五、总结

-

线性:可用直线/超平面分开,对应模型:逻辑回归、线性SVM、感知机。

-

非线性:需要曲线/复杂边界,对应模型:核SVM、决策树、随机森林、XGBoost、神经网络。

-

判断方法:可视化、线性模型基线实验、领域知识。

-

你的任务:建议优先尝试非线性模型,同时保留线性模型作为对比,以实验结果为最终依据。

希望这些解释能帮你真正理解线性与非线性的概念,并在实践中灵活运用。