Docker 网络配置指南:Bridge、Host、None、Container 全攻略

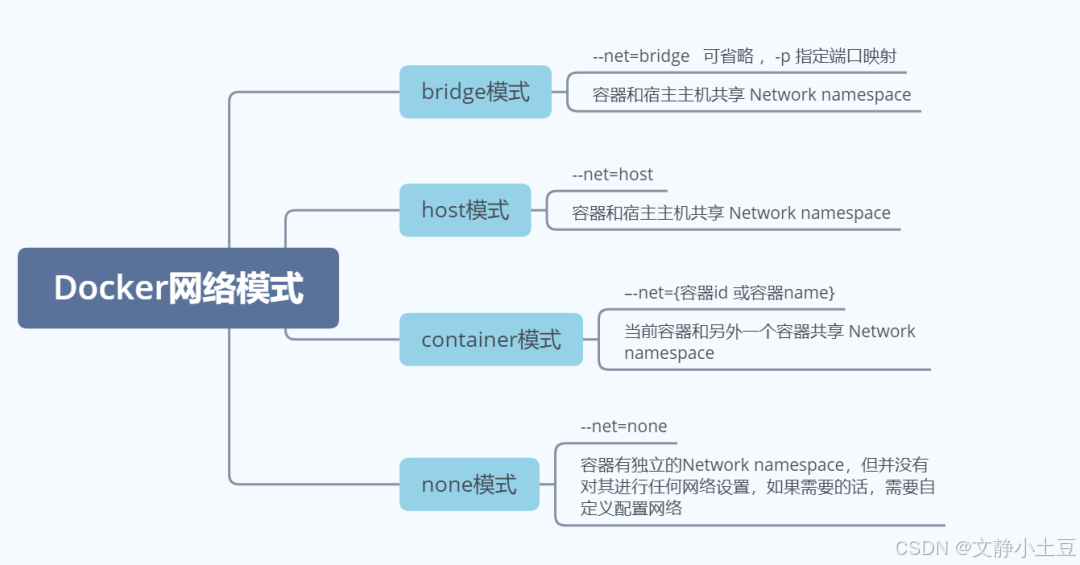

Docker 内置的 4 种核心网络模式(Bridge、Host、None、Container)各有适配场景,掌握其原理与实战配置,才能让容器部署更高效、更稳定。本文将从生产环境实际需求出发,深入拆解每种网络模式的底层原理、实操命令、适用场景,同时分享自定义 Bridge 网络的核心实操和网络管理常用命令,帮助你快速掌握选型逻辑。

前置基础:Docker 网络的核心底层逻辑

在深入具体模式前,我们需要了解 Docker 网络依赖的 Linux 内核技术,这是理解所有模式的关键,也是生产环境排查网络问题的基础:

- 网络命名空间(Network Namespace):实现网络环境隔离的核心,每个容器默认拥有独立的命名空间,包含独立的网卡、路由表、防火墙规则,相当于给每个容器分配了一个"独立的网络环境"。

- 虚拟以太网设备(veth pair):成对出现的虚拟网卡,一端挂载在容器内部(通常命名为 eth0),另一端连接宿主机的网桥或网络,是容器与外部通信的"专属管道"。

- 虚拟网桥(Bridge):相当于一台虚拟交换机,用于连接同一宿主机上的多个容器网络接口,实现容器间的二层通信,Docker 启动时会默认创建 docker0 虚拟网桥。

通过 docker network ls 命令,可直接查看 Docker 默认创建的三类网络:

bash

# 查看Docker默认网络

docker network ls

# 输出示例

NETWORK ID NAME DRIVER SCOPE

abc123456 bridge bridge local # 默认桥接模式网络

def789012 host host local # 主机网络模式

ghi345678 none null local # 无网络模式一、Bridge 模式:默认首选,单机多容器部署标配

Bridge 模式是 Docker 的默认网络模式,也是生产环境中最常用的模式,适用于单机多容器部署场景(如同一主机上的 Web 服务 + 数据库服务),核心优势是兼顾隔离性与灵活性,配置简单且兼容性强。

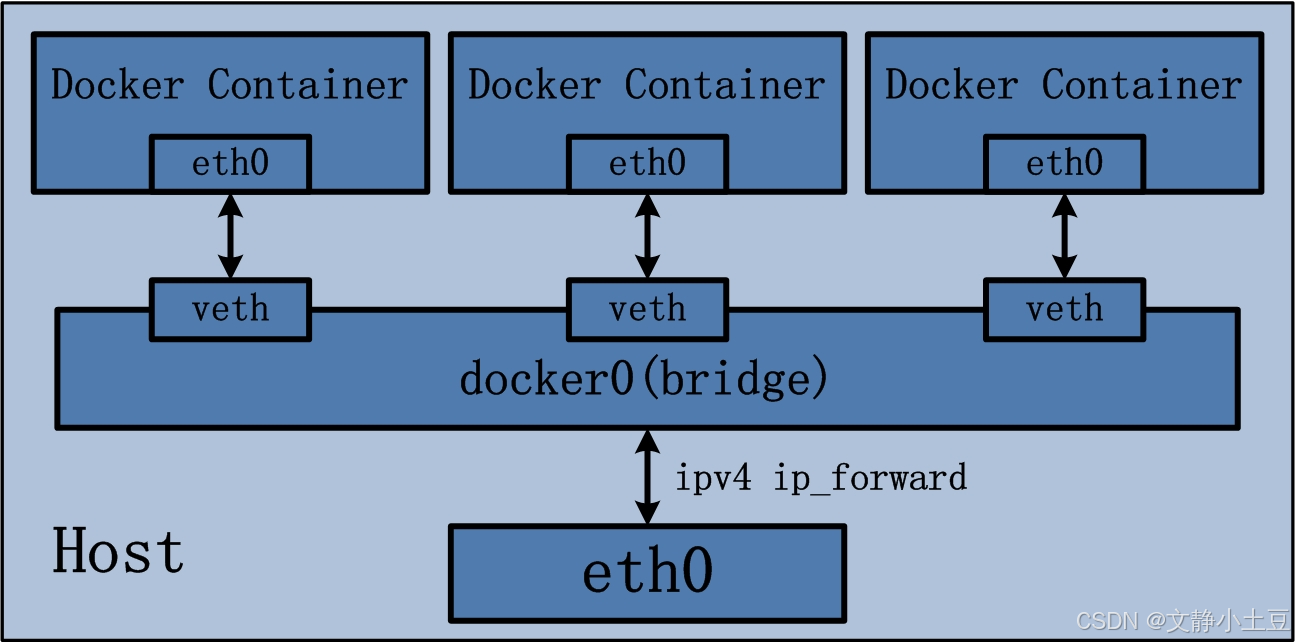

1. 底层原理

Docker 启动时会自动创建一个名为 docker0 的虚拟网桥(默认网段为 172.17.0.0/16),当容器以 Bridge 模式启动时,会完成以下操作:

- 为容器创建独立的网络命名空间,分配一对 veth pair 虚拟网卡

- veth pair 的一端作为容器内网卡(eth0),从 docker0 网桥的网段中分配一个私有 IP

- veth pair 的另一端挂载到 docker0 网桥上,实现容器与宿主机、容器与容器之间的通信

- 外部访问容器需通过 iptables 的 DNAT 规则实现端口映射(即

-p参数),容器出站流量则通过 MASQUERADE 规则完成 NAT 转换,实现外网访问

2. 生产环境实操配置

默认情况下,启动容器时无需显式指定 Bridge 模式,但默认 docker0 网桥不支持容器名 DNS 解析,仅能通过 IP 通信,且易出现网段冲突。生产环境强烈推荐创建自定义 Bridge 网络,支持容器名解析、自定义网段和访问控制。

(1)默认 Bridge 模式实操

bash

# 1. 启动多个默认 Bridge 模式容器,映射不同端口

docker run -d --name nginx1 -p 8081:80 nginx

docker run -d --name nginx2 -p 8082:80 nginx

# 2. 查看容器私有 IP(默认网桥仅能通过 IP 通信)

docker inspect -f '{{.NetworkSettings.IPAddress }}' nginx1

docker inspect nginx2 | grep "IPAddress"

# 3. 宿主机查看 docker0 网桥和 veth 虚拟网卡

ip addr show docker0

ip link show | grep veth

# 4. 验证容器间通信(仅能通过 IP 互 ping)

docker exec nginx2 ping -c 2 172.17.0.2 # 替换为 nginx1 的实际 IP(2)推荐自定义 Bridge 模式实操

bash

# 1. 创建自定义 Bridge 网络(推荐,规避网段冲突)

docker network create \

--driver bridge \

--subnet 192.168.50.0/24 \ # 自定义网段,根据生产环境规划调整

--gateway 192.168.50.1 \ # 网关地址

--opt com.docker.network.bridge.enable_icc=true \ # 允许容器间通信

my-custom-bridge # 自定义网络名称

# 2. 启动容器并加入自定义 Bridge 网络

docker run -d --name nginx-web \

--network my-custom-bridge \

--ip 192.168.50.10 \ # 给容器分配固定 IP(生产环境可选,便于管理)

-p 8080:80 \ # 端口映射,宿主机 8080 端口映射到容器 80 端口

nginx:alpine

# 3. 验证容器名 DNS 解析(自定义网桥核心优势,无需记 IP)

docker run -it --rm --network my-custom-bridge alpine ping nginx-web3. 生产环境适配场景与避坑点

适配场景:

- 单机多容器协同部署(如 Web 服务 + Redis + MySQL)

- 开发环境与测试环境部署

- 对网络隔离性有基础要求且无需极致性能的场景

注意事项:

- 避免使用默认 docker0 网桥,自定义网段需与宿主机网段、其他网络环境不冲突

- 端口映射时需注意宿主机端口占用,避免端口冲突(可通过

netstat -tulpn查看端口占用情况) - Bridge 模式存在轻微 NAT 转发开销,不适合对网络延迟要求极高的场景

- 默认 docker0 网桥无容器名解析功能,跨容器通信需先通过

docker inspect查询 IP

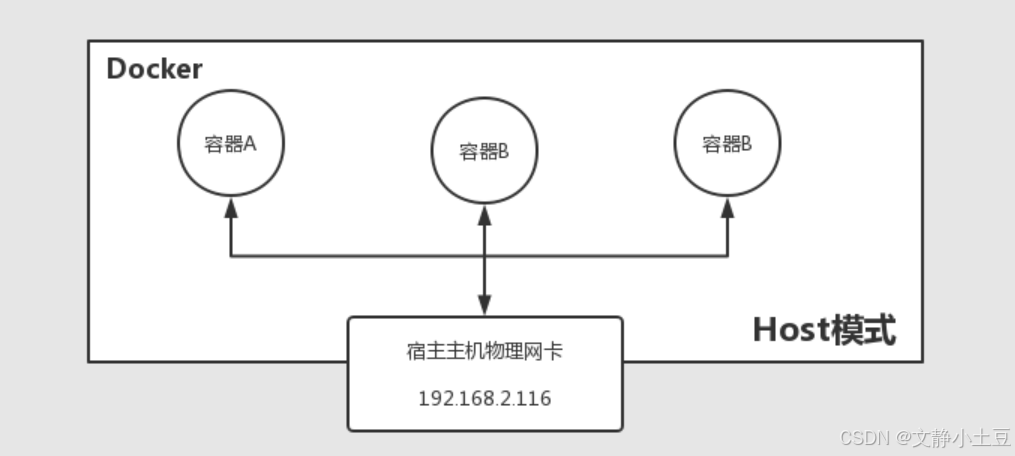

二、Host 模式:性能拉满,无隔离的"高性能选择"

Host 模式与 Bridge 模式完全相反,核心是容器不创建独立的网络命名空间,直接复用宿主机的网络协议栈。简单说,容器就是"裸奔"在宿主机网络上,没有任何网络隔离,换来的是零 NAT 转发开销,极致的网络性能。

1. 底层原理

Host 模式下,容器会跳过虚拟网卡、网桥转发和 NAT 转换等环节,直接使用宿主机的网卡、IP 和端口资源:

- 容器内服务监听的端口直接占用宿主机对应端口,无需使用

-p参数进行端口映射,-p参数在 Host 模式下完全无效 - 容器的网络配置完全依赖宿主机,无法自定义 IP 或端口,容器内看到的 IP 就是宿主机的 IP

- 数据流转路径极短:应用请求 → 宿主机协议栈 → 物理网卡 → 外部网络,无任何"中间商",延迟极低

可通过以下命令验证 Host 模式的共享特性(容器与宿主机网络命名空间一致):

bash

# 查看容器的网络命名空间 inode 号

ls -l /proc/$(docker inspect -f '{{.State.Pid}}' 容器名)/ns/net

# 查看宿主机的网络命名空间 inode 号

ls -l /proc/1/ns/net

# 两者输出一致,说明容器共享宿主机网络命名空间2. 生产环境实操配置

Host 模式配置极简,只需在启动容器时指定 --network host 即可,无需配置端口映射,实操命令如下:

bash

# 启动 Host 模式的 Nginx 容器(高性能场景)

docker run -d --name nginx-high-performance --network host nginx:alpine

# 验证:直接访问宿主机 80 端口,即可直达容器服务

curl http://宿主机IP:803. 生产环境适配场景与避坑点

适配场景:

- 对网络性能要求极高的场景(如高并发 API 网关、低延迟游戏服务器、Redis 主从节点)

- 监控工具部署(如 Prometheus Node Exporter,需读取宿主机网卡流量)

- 网络调试(如 tcpdump 抓包,需获取宿主机真实流量)

注意事项:

- 无网络隔离,容器端口与宿主机端口冲突会导致容器启动失败,需严格管理宿主机端口资源

- 仅支持 Linux 系统,不支持 macOS 和 Windows,生产环境需注意系统兼容性

- 安全风险高:容器可访问宿主机 127.0.0.1 服务,仅运行绝对可信的镜像,同时在宿主机层面配置防火墙限制入站流量

- 不支持 Swarm/K8s 集群环境,仅适用于单机部署

- 容器无独立 IP,查看网络地址需直接在宿主机执行

ip a或ifconfig

提示:生产环境中,90% 的场景无需使用 Host 模式,仅当 Bridge 模式的性能无法满足需求时,再考虑使用。

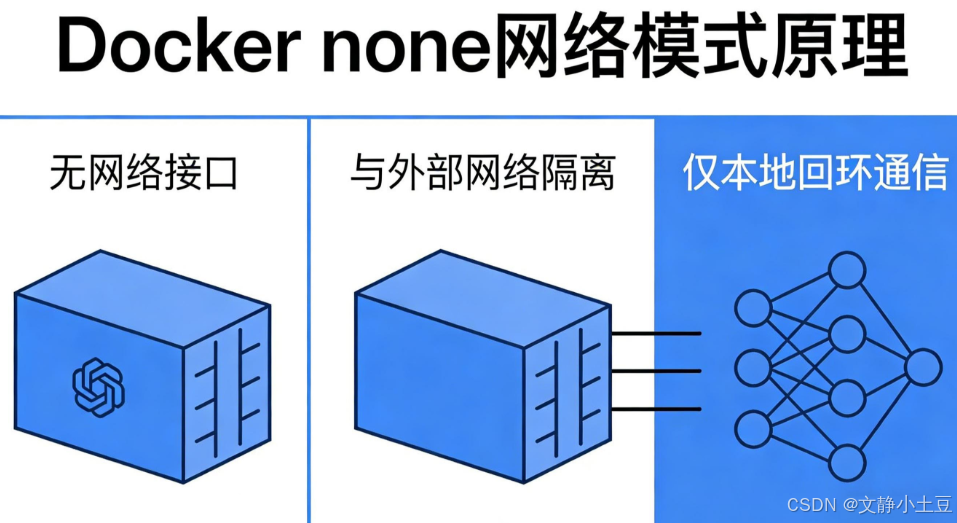

三、None 模式:极致隔离,"断网"的安全空间

None 模式是最"特殊"的网络模式,与 Host 模式完全相反:容器会创建独立的网络命名空间,但不配置任何网络参数------没有 IP 地址、子网掩码、网关,仅保留回环地址(127.0.0.1),相当于一个"与世隔绝"的纯净空间,无法与外部网络通信。

1. 底层原理

None 模式下,Docker 仅为容器创建网络命名空间,不创建 veth pair 虚拟网卡,不连接任何网桥,也不配置路由规则:

- 容器内只能访问自身的回环地址,无法 ping 通宿主机、其他容器或外网

- 外部网络也无法访问容器,完全切断了网络连接

- 可手动配置网络参数(如 IP、路由),打造自定义隔离网络环境

2. 生产环境实操配置

启动容器时指定 --net=none 即可启用 None 模式,实操命令如下:

bash

# 启动 None 模式的容器(无网络,仅本地计算)

docker run -d --name task-isolated --network none tomcat

docker run -it --name centos-isolated --network none centos:latest

# 宿主机查看 None 模式容器网络配置(无 IP/网关,仅 lo 回环)

docker inspect task-isolated | tail -20

docker exec -it centos-isolated ip addr若需让 None 模式的容器临时访问外部网络,可手动配置网络参数(容器内执行):

bash

# 手动配置 IP 和路由(示例)

ip addr add 192.168.100.10/24 dev eth0

ip route add default via 192.168.100.13. 生产环境适配场景与避坑点

适配场景:

- 离线操作:容器内仅执行本地计算、文件处理(如密码破解、科学计算、数据加密、日志分析),无需访问外部网络

- 高安全级服务:存放敏感数据、执行加密操作的容器,断开网络可大幅降低被攻击风险

- 自定义网络测试:模拟内网隔离环境,手动配置网络规则进行测试

注意事项:

- 默认无法访问外部网络,若需通信需手动配置网络,配置复杂且易出错

- 不适合需要网络通信的服务,仅用于特殊隔离场景,避免滥用

- 启动时指定

-p端口映射参数无效,None 模式无端口暴露能力

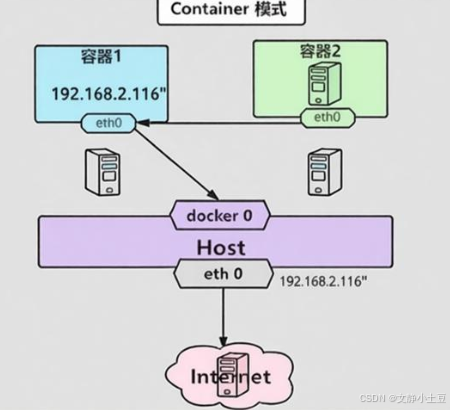

四、Container 模式:网络共享,协同工作的"伙伴模式"

Container 模式(也叫"共享网络模式")的核心是:新容器不创建自己的网络命名空间,而是复用另一个已存在容器的网络命名空间。相当于两个容器"共享同一个网络身份",IP、端口、网络接口完全一致,但 PID、文件系统、用户等其他命名空间仍相互隔离。

1. 底层原理

Container 模式下,新容器会"依附"于目标容器的网络环境:

- 新容器与目标容器共享同一个 IP、端口、路由表等网络资源,目标容器的端口被占用后,新容器无法再使用相同端口

- 新容器可直接通过

localhost访问目标容器的网络服务,无需端口映射,通信延迟极低 - 目标容器停止运行后,新容器的网络也会失效,需确保目标容器始终处于运行状态

2. 生产环境实操配置

启动容器时指定 --network container:目标容器名/ID 即可,最典型的应用是 Sidecar 边车模式(主应用+辅助工具,如日志收集、监控代理),实操命令如下:

bash

# 1. 启动目标容器(主应用,Nginx)

docker run -d --name nginx-main -p 80:80 nginx:alpine

# 2. 启动 Sidecar 容器(日志收集/监控,共享主应用网络)

docker run -it --name sidecar --network container:nginx-main busybox

# 3. 验证:Sidecar 通过 localhost 直接访问主应用服务

wget -qO- http://localhost # Sidecar 容器内执行

docker exec -it sidecar curl localhost:80 # 宿主机执行3. 生产环境适配场景与避坑点

适配场景:

- Sidecar 模式:主应用 + 辅助工具(日志收集、监控代理、配置中心),辅助工具需共享主应用网络,便于采集数据

- 容器调试:用 netshoot 等调试工具容器,复用目标容器网络,直接诊断目标容器的网络问题

- 多容器协同:多个容器需共享网络身份,简化通信配置(如微服务中的多个组件协同)

注意事项:

- 目标容器必须处于运行状态,否则新容器无法启动或网络失效

- 共享端口资源,需避免端口冲突,合理规划容器内服务的监听端口

- 仅共享网络命名空间,其他资源(文件、进程)仍隔离,需注意数据挂载和权限控制

- 新容器无独立网络配置,

docker inspect查看不到专属 IP/网关信息

五、自定义 Bridge 网络:生产环境最佳实践

在生产环境或复杂多容器应用中,强烈推荐使用自定义 Bridge 网络。相比默认 docker0 网桥,其具备多项核心优势,是企业级部署的标配方案。

1. 自定义 Bridge 网络核心优势

| 优势 | 详细说明 |

|---|---|

| 自动 DNS 解析 | 容器间可通过容器名直接通信,无需手动查询和配置 IP,大幅简化部署和维护 |

| 更佳网络隔离 | 不同自定义网络之间默认完全隔离,可按业务划分网络(如前端网/后端网/数据库网),提升安全性 |

| 灵活的网络管理 | 支持动态将容器加入/移出网络,无需重启容器,适配生产环境弹性部署需求 |

| 自定义网段配置 | 可根据企业网络规划自定义子网、网关,避免与宿主机/其他网络网段冲突 |

2. 网络管理常用命令(生产必备)

自定义网络的全生命周期管理均可通过 Docker 命令完成,以下为高频实操命令,建议熟记:

bash

# 1. 创建自定义 Bridge 网络

docker network create <网络名> # 基础创建

docker network create --driver bridge --subnet 192.168.60.0/24 backend-net # 自定义网段

# 2. 列出所有 Docker 网络(查看已创建的自定义网络)

docker network ls

# 3. 查看网络详情(含连接的容器、网段、网关等核心信息)

docker network inspect <网络名>

# 4. 将已运行的容器动态加入网络(无需重启容器,生产核心操作)

docker network connect <网络名> <容器名/ID>

# 5. 将容器从网络中动态移出(隔离故障容器,无需重启)

docker network disconnect <网络名> <容器名/ID>

# 6. 删除空闲的自定义网络(网络内无容器时才可删除)

docker network rm <网络名>3. 自定义网络实战:按业务隔离

bash

# 1. 按业务创建 3 个自定义网络(前端/后端/数据库)

docker network create frontend-net

docker network create backend-net

docker network create db-net

# 2. 启动容器并加入对应网络

docker run -d --name web --network frontend-net nginx

docker run -d --name api --network backend-net tomcat

docker run -d --name mysql --network db-net -e MYSQL_ROOT_PASSWORD=123456 mysql:5.7

# 3. 让后端 api 容器同时访问前端和数据库(动态加入多网络)

docker network connect frontend-net api

docker network connect db-net api

# 4. 验证隔离性:前端 web 容器无法直接访问 mysql(未加入 db-net)

docker exec web ping mysql # 失败,网络隔离

docker exec api ping mysql # 成功,已加入 db-net生产环境选型总结:一张表搞定 4 种模式

为了方便大家在生产环境快速选型,整理了 4 种网络模式的核心特性、适配场景对比,一目了然:

| 网络模式 | 网络隔离性 | IP 地址 | 端口映射 | 核心优势 | 生产环境适配场景 |

|---|---|---|---|---|---|

| Bridge(默认) | 高(独立命名空间) | 私有 IP(docker0 网段) | 需要(-p 参数) | 兼顾隔离与灵活,配置简单 | 单机多容器基础部署、开发/测试环境 |

| Bridge(自定义) | 高(独立命名空间,网络间隔离) | 私有 IP(自定义网段) | 需要(-p 参数) | 容器名 DNS 解析、业务隔离、灵活管理 | 企业级生产部署、复杂多容器应用、按业务划分网络 |

| Host | 无(共享宿主机网络) | 宿主机 IP | 不需要(-p 无效) | 零 NAT 开销,性能极致 | 高并发、低延迟服务,监控工具,网络调试 |

| None | 极高(断网隔离) | 仅回环地址(127.0.0.1) | 不可用(-p 无效) | 安全纯净,避免网络攻击 | 离线计算、敏感数据处理、高安全级任务 |

| Container | 无(共享目标容器网络) | 与目标容器一致 | 不需要(共享端口) | 协同工作,localhost 直连,延迟低 | Sidecar 边车模式、容器调试、多容器网络共享 |

生产环境网络配置最佳实践

- 优先使用自定义 Bridge 网络:彻底摒弃默认 docker0 网桥,按业务划分自定义网络,利用 DNS 解析简化通信,通过网络隔离提升安全性

- 不滥用 Host 模式:仅在 Bridge 模式出现性能瓶颈时使用,且严格控制镜像可信度,同时在宿主机层面配置防火墙限制入站流量

- None 模式仅用于特殊隔离场景:仅适用于无需网络的离线计算/敏感操作,避免用于需要网络通信的服务

- Container 模式聚焦 Sidecar 架构:用于主应用+辅助工具的协同部署,注意目标容器的稳定性,避免端口冲突

- 熟练掌握网络动态管理 :利用

docker network connect/disconnect实现容器网络的弹性调整,无需重启容器,适配生产环境故障处理 - 结合编排工具统一管理:生产环境中,配合 Docker Compose 或 Kubernetes 编排工具,统一定义和管理容器网络,提升部署效率和可维护性

- 做好网络规划与监控:自定义网段提前与企业网络规划对齐,避免网段冲突;同时监控容器网络流量,及时发现端口冲突、通信异常等问题

Docker 网络模式的选型,本质是"隔离性"与"性能"、"便捷性"与"安全性"的权衡,结合自身业务场景(单机/集群、性能需求、安全需求、业务划分),才能做出最优选择。掌握以上 4 种核心模式+自定义 Bridge 网络的原理与实操,就能轻松应对生产环境中的各类容器网络问题。

如果觉得本文有用,欢迎分享给身边的运维和开发小伙伴,一起精进容器技术!