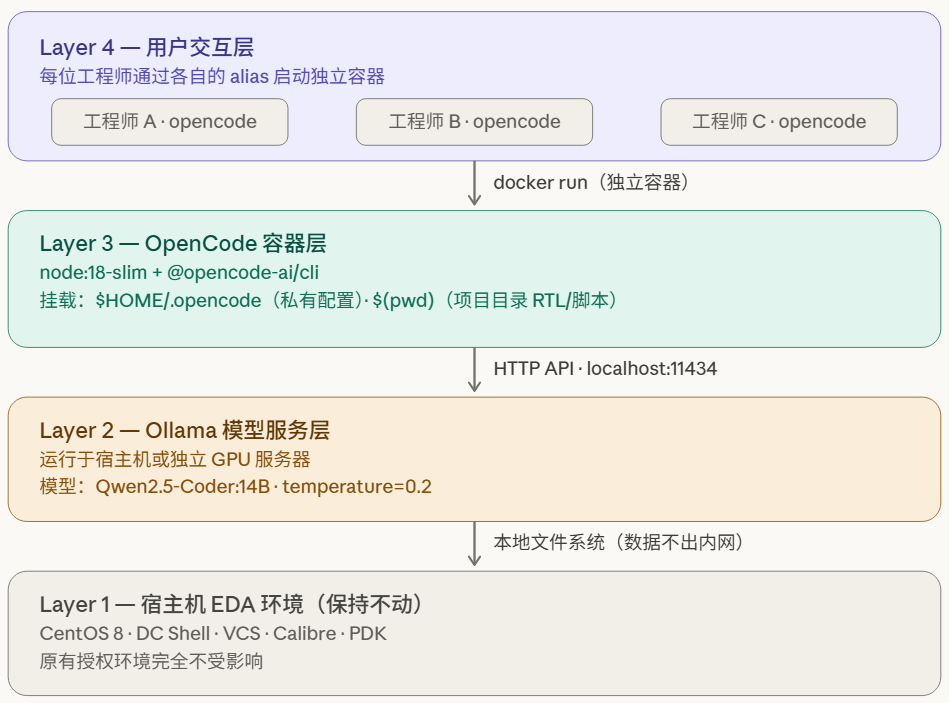

在数字前端综合业务中,我们面临着极端矛盾:一边是需要保护核心 RTL 资产的"物理隔离"需求,另一边是陈旧的宿主机系统(如 CentOS 7/8)无法兼容现代 AI 开发工具。本文将详细解析如何通过 Docker 容器化技术,在不触动底层 EDA 环境的前提下,构建一套支持多用户、高性能的本地 AI 代码助手集群。

一、 引言:EDA 环境下的 AI "破局"

在数字前端综合业务中,我们面临着极端矛盾:一边是需要保护核心 RTL 资产的"物理隔离"需求,另一边是陈旧的宿主机系统(如 CentOS 8)无法兼容现代 AI 开发工具。本文将详细解析如何通过 Docker 容器化技术,在不触动底层 EDA 环境的前提下,构建一套支持多用户、高性能的本地 AI 代码助手集群。

二、 深度解析:多用户生产环境的容器化架构

1. 核心镜像构建(解决 GLIBC 冲突)

直接在 CentOS 8 运行 OpenCode 会触发 GLIBC_2.28 缺失错误。我们通过 Dockerfile 预装环境,确保环境"开箱即用"。

Dockerfile

# 使用 Node 18 镜像避开宿主机库冲突

FROM node:18-slim

RUN npm install -g @opencode-ai/cli

WORKDIR /app

# 预留配置路径

RUN mkdir -p /root/.opencode

ENTRYPOINT ["opencode"]2. 多用户隔离与权限逻辑

在多用户服务器上,最忌讳的是 root 权限污染和配置冲突。我们通过 动态 Alias 实现用户目录的精准隔离。

每个工程师(如工程师 A、工程师 B)的对话记录和私有配置需要互不干扰。我们利用宿主机的 $HOME 变量进行映射:

Bash

# 建议写入 /etc/profile.d/opencode.sh 供全员生效

alias opencode='docker run -it --rm \

--name opencode_$(whoami)_$(date +%s) \

--network host \

--user $(id -u):$(id -g) \

-v $HOME/.opencode:/root/.opencode \

-v $HOME/.opencode/cache:/root/.cache \

-v $(pwd):/app -w /app \

opencode-v1.2.22'关键点解析:

-

--user $(id -u):$(id -g):强制容器内进程以当前登录用户身份运行,彻底杜绝产生的.opencode目录被 root 锁死的问题。 -

--network host:使容器直接访问宿主机 11434 端口的 Ollama 服务,消除容器间网络通信的延迟。

三、 配置进阶:针对数字前端业务的 JSON 调优

1.2.22 版本的 OpenCode 采用了分层配置结构。为了支持 Qwen2.5-Coder:14B 的最佳性能,配置需精细化:

JSON

{

"$schema": "https://opencode.ai/config.json",

"provider": {

"ollama": {

"npm": "@ai-sdk/openai-compatible",

"name": "Ollama-Synthesis-Server",

"options": {

"baseURL": "http://127.0.0.1:11434/v1"

},

"models": {

"qwen2.5-coder": {

"name": "qwen2.5-coder:14b",

"parameters": { "temperature": 0.2, "top_p": 0.95 }

}

}

}

},

"defaultModel": "qwen2.5-coder"

}注意: 在实际应用中发现 qwen 对 opencode 的tools 支持非常不友好,无法实现操作文件和执行命令的功能,最终采用的是其他模型。

- 低 Temperature 设置:在处理 SDC 语法和 RTL 逻辑时,我们需要 AI 结果具备高确定性而非创造性。

四、 业务实战:数字前端综合的 AI 赋能

1. SDC 约束生成的"逻辑锚点"

数字前端最头疼的是海量异步时钟。通过 @ 引用设计规格书(Markdown 格式),AI 可以根据端口描述自动生成 set_input_delay 脚本。

- 示例指令 :

@spec.md 参照此规格书的 IO 时序要求,为当前顶层模块生成 DC 综合所需的初步 SDC 约束。

2. 多文件 Agent:打通 RTL 与综合脚本

在综合迭代中,经常需要根据 report_timing 反向修改 RTL。

-

场景 :同时打开

top.v和synthesis.tcl。 -

协作 :AI 可以识别由于 RTL 层级过深导致的路径违例,并建议在 Tcl 脚本中加入

set_structure优化指令或修改 RTL 打拍。

3. 排除杂讯:高效 RAG 索引

数字前端会有大量的 .vcd、.fsdb 仿真文件和 /work 综合中间目录。如果不配置忽略,向量索引会崩溃。

-

配置

.opencodeignore:Plaintext

/work/ /sim/ *.vcd *.fsdb /scripts/temp/

五、 多用户协作:从个人助手到团队知识中枢

-

配置模板分发 :管理员维护一份

opencode.json.template,新员工入职后一键拷贝,立即可用。 -

知识库共享(RAGFlow 进阶) :当团队积累了海量设计手册(PDF)时,单一的本地索引性能会下降。此时应在后台部署 RAGFlow,将全团队的 PDF 规范进行深度切片索引,OpenCode 通过 API 接入,实现"全员共享一个超级大脑"。

六、 避坑与维护(运维视角)

-

数据库迁移锁 :若启动提示

Database migration耗时过久,通常是由于挂载的 NFS 盘 I/O 延迟过大,建议将.opencode放在本地 SSD。 -

进程残留清理 :通过

kill -9 $(jobs -p)清理宿主机挂起的vi进程,防止配置文件被文件系统死锁。