在国产化算力替代的浪潮下,越来越多的 AI 推理场景开始从成熟的 NVIDIA GPU 向国产 AI 芯片(华为昇腾、寒武纪、壁仞、摩尔线程等)迁移。相较于 GPU 完善的生态与工具链,国产芯片虽在安全自主、功耗控制及特定场景性价比上具备优势,但因架构异构性、生态成熟度不足等问题,迁移过程中难免踩坑无数。本文结合实际项目落地经验,聚焦 GPU 与国产算力在推理适配中的核心差异、标准化迁移 checklist 及高频问题解决方案,为技术同行提供可落地的迁移思路,助力高效完成国产化适配,规避重复踩坑。

核心前提:迁移的核心目标并非"简单替换硬件",而是在保障推理精度、时延、吞吐等核心指标不降级的前提下,充分发挥国产芯片的硬件特性,同时兼顾工程落地的稳定性与可维护性。当前市场呈现"GPU 与国产算力短期共存、长期竞争"的格局,中高端推理场景仍需 GPU 补位,而边缘、政企等场景国产芯片已具备替代能力,迁移需结合具体业务场景理性推进。

一、GPU 与国产算力的核心差异点(推理视角)

GPU 经过多年迭代,已形成"硬件+CUDA 生态+工具链"的完整闭环,而国产芯片因架构设计差异、生态布局阶段不同,与 GPU 在 API、内存、通信三大核心维度存在显著差异,这也是迁移过程中踩坑的主要根源。需明确:差异并非"差距",而是适配思路的不同,国产芯片在特定场景的优化的空间反而更大。

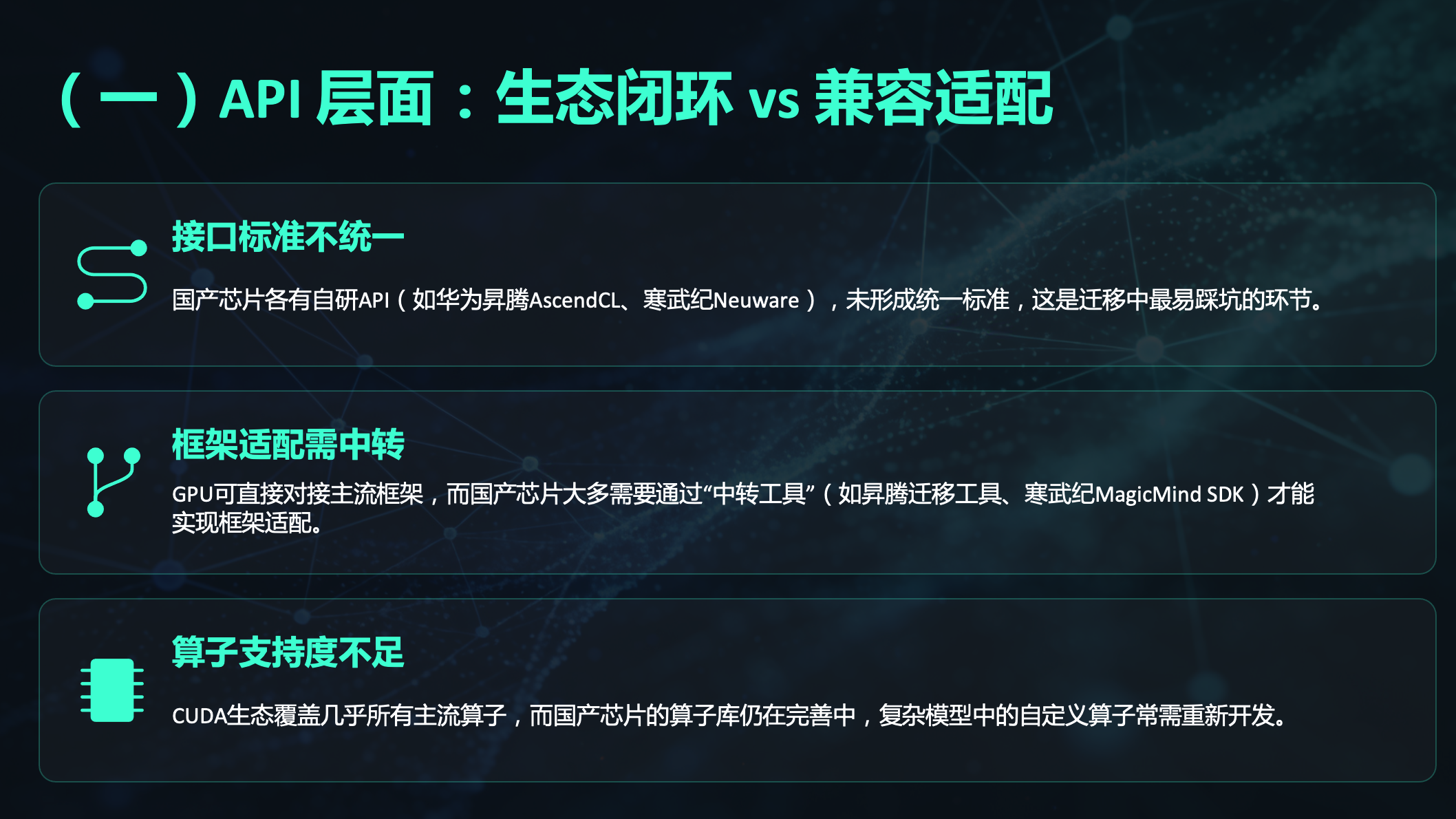

(一)API 层面:生态闭环 vs 兼容适配,接口迁移成本突出

GPU 的核心优势在于 CUDA 生态的垄断性------95%以上的 AI 框架(TensorFlow、PyTorch 等)原生支持 CUDA,开发者无需关注底层硬件细节,通过统一的 CUDA API、cuDNN 加速库即可快速实现推理部署,且不同型号 GPU 之间的 API 兼容性极强,迁移成本趋近于 0。而国产芯片目前呈现"自主闭环+兼容适配"的双重路径,API 差异主要体现在三个方面,也是迁移中最易踩坑的环节。

-

接口标准不统一:国产芯片均有自研 API 与配套软件栈,未形成统一标准。例如华为昇腾依赖 CANN 架构与 MindX SDK,核心 API 为 AscendCL,与 CUDA API 完全不兼容;寒武纪通过 Cambricon Neuware 平台提供 API,需适配其专属的算子接口;摩尔线程虽推出 CUDA 兼容方案,适配成功率达 92.94%,但在 Transformer 等复杂算子场景仍存在接口调用失败的问题。

-

框架适配需中转:GPU 可直接对接 PyTorch、TensorFlow 等主流框架,而国产芯片大多需要通过"中转工具"实现框架适配。例如昇腾需通过"昇腾迁移工具"将 PyTorch 模型转换为 OM 离线模型,再通过 AscendCL API 调用推理;寒武纪则需借助 MagicMind SDK 完成框架模型到其专属格式的转换,转换过程中易出现 API 不兼容导致的模型解析失败。

-

算子支持度不足:CUDA 生态已覆盖几乎所有主流推理算子,且自定义算子开发便捷,而国产芯片的算子库仍在完善中。例如昇腾对 PyTorch 算子的支持度不足 80%,复杂模型中的自定义算子需重新基于 AscendCL 开发;寒武纪在边缘推理算子上优化较好,但在大模型推理的高阶算子支持上存在短板,调用未支持算子会直接导致推理中断。

踩坑预警:直接将 GPU 推理代码中的 CUDA API 替换为国产芯片 API,大概率会出现接口不兼容、算子调用失败等问题,切勿盲目迁移。

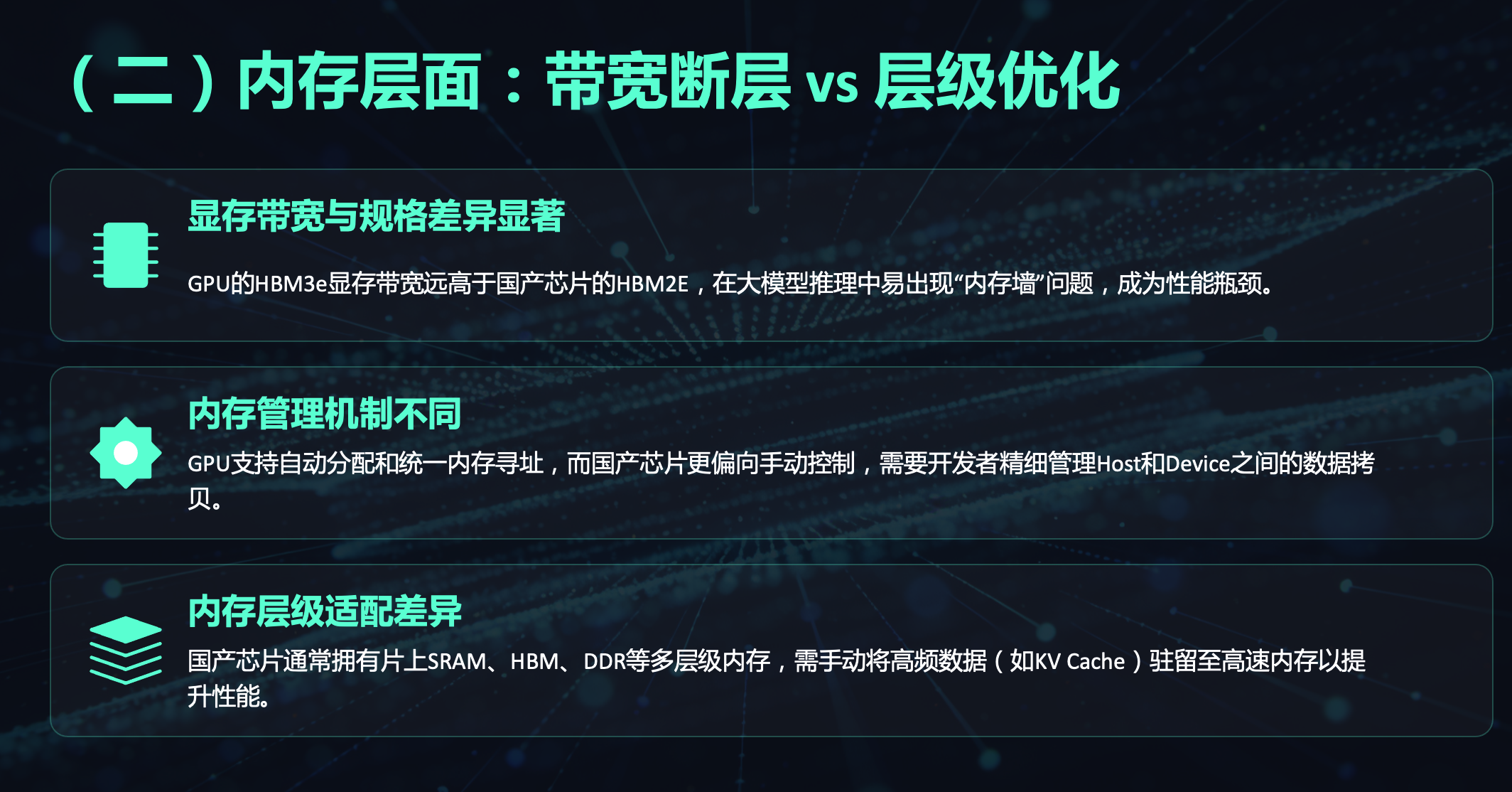

(二)内存层面:带宽断层 vs 层级优化,显存管理需重构

推理过程中,内存(显存)的带宽、容量、管理机制直接影响推理时延与吞吐,GPU 与国产芯片在内存层面的差异,核心源于硬件设计逻辑与显存规格的不同,迁移过程中易出现"显存溢出""性能损耗过高"等问题。

-

显存带宽与规格差异显著:GPU(如 NVIDIA H200)采用 HBM3e 显存,带宽可达 4.8TB/s,而主流国产芯片(如昇腾 910c、寒武纪思元 690)多采用 HBM2E 显存,带宽仅为 1.5-2.4TB/s,存在明显的带宽断层。这导致在大模型推理场景中,国产芯片易出现"内存墙"问题,数据频繁交互导致性能损耗显著,而 GPU 可通过高带宽显存有效规避该问题。

-

内存管理机制不同:GPU 的 CUDA 内存管理支持自动分配、回收,且支持统一内存寻址(UVA),开发者无需过多关注内存拷贝细节;而国产芯片的内存管理更偏向"手动控制",例如昇腾需要手动区分主机内存(Host)与设备内存(Device),手动调用 API 完成数据拷贝,若拷贝逻辑不合理,会导致严重的性能瓶颈。

-

内存层级适配差异:GPU 的显存层级简单,适配难度低;而国产芯片多具备复杂的内存层级(如片上 SRAM、HBM、DDR),不同层级内存的访问速度差异极大。例如寒武纪 MLU370 的片上 SRAM 访问速度是 HBM 的 10 倍以上,需将 Key/Value Cache 等高频访问数据驻留至片上 SRAM 以提升性能,而 GPU 无需此类手动适配,迁移时若忽略内存层级优化,会导致推理性能大幅下降。

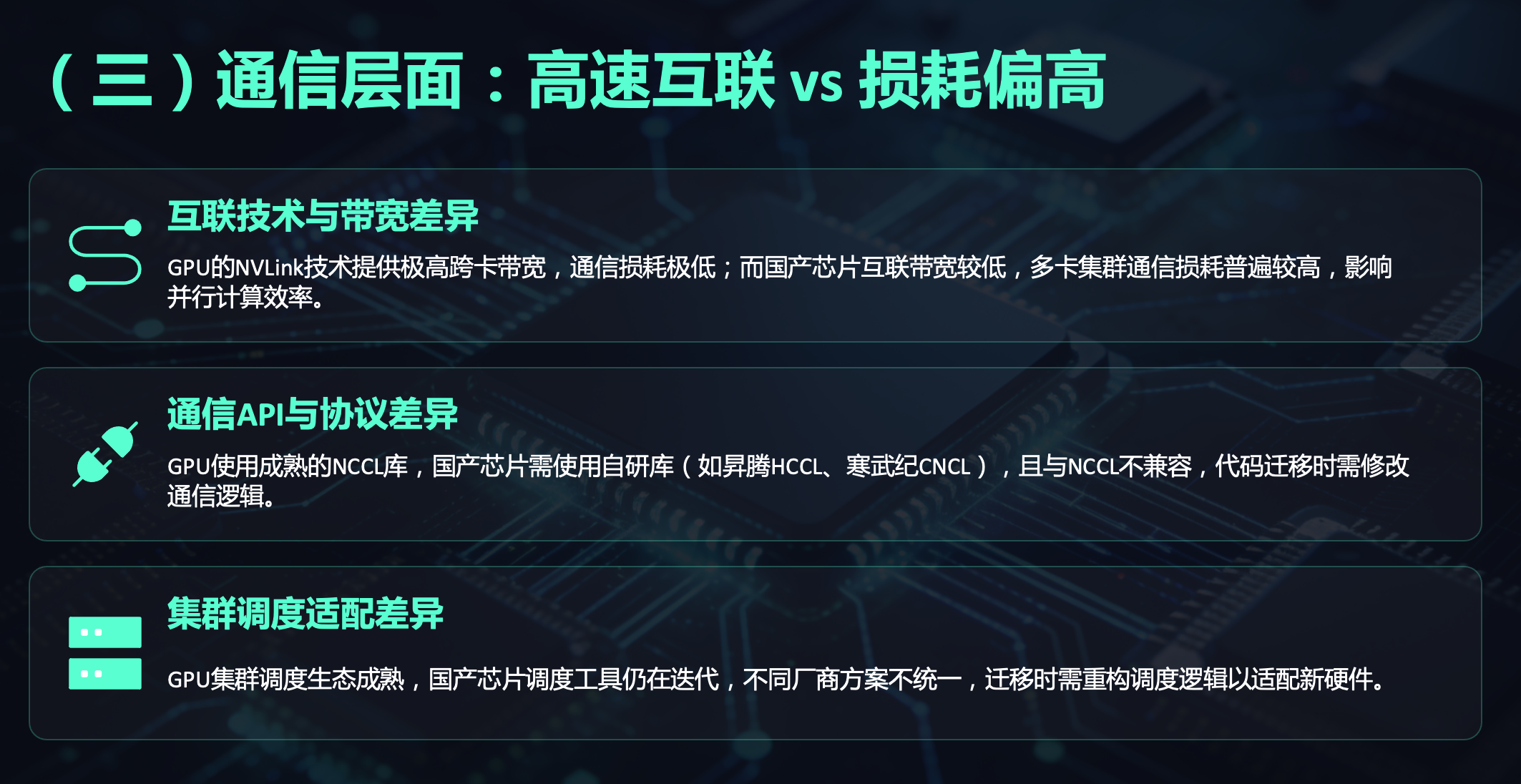

(三)通信层面:高速互联 vs 损耗偏高,集群适配难度大

在多卡、集群推理场景中,芯片间的通信效率直接决定集群的整体性能。GPU 凭借成熟的高速互联技术,通信损耗极低,而国产芯片的通信能力虽在快速提升,但与 GPU 仍有差距,迁移时易出现"集群性能不达预期""通信超时"等问题。

-

互联技术与带宽差异:GPU 采用 NVLink 高速互联技术(H200 支持 NVLink 4,跨卡带宽达 900GB/s),多卡集群的通信损耗不足 5%;而国产芯片的互联技术仍在完善中,例如昇腾采用 PCIe 4.0 ×16 互联,跨卡带宽仅 64GB/s,寒武纪采用 MLU-Link 互联,跨卡带宽 50GB/s,多卡集群的通信损耗普遍超 30%。

-

通信 API 与协议差异:GPU 的多卡通信依赖 NCCL 库,API 简洁、兼容性好,支持多卡同步、集合通信等常用操作,且与主流框架深度集成;而国产芯片的多卡通信需使用自研 API,例如昇腾使用 HCCL 库,寒武纪使用 CNCL 库,这些库与 NCCL API 不兼容,需重新修改多卡通信代码,且部分集合通信操作(如多卡广播)的实现逻辑不同,易出现通信同步失败。

-

集群调度适配差异:GPU 集群的调度生态成熟,可通过 Kubernetes + NVIDIA Device Plugin 实现灵活调度,且支持动态资源分配;而国产芯片的集群调度工具仍在迭代中,不同厂商的调度方案不统一,例如昇腾需适配华为自研的调度插件,寒武纪需使用专属的集群管理工具,迁移时需重构集群调度逻辑,否则会导致资源利用率偏低、通信冲突等问题。

二、GPU 到国产算力的推理迁移 Checklist(避坑核心)

迁移并非"一步到位",而是分阶段、标准化推进的过程。结合实际落地经验,梳理出覆盖"迁移前准备、迁移中实施、迁移后验证"的完整 Checklist,逐一落实可大幅降低踩坑概率,提升迁移效率。需注意:迁移前需结合业务场景选择合适的国产芯片,例如边缘推理优先选择昇腾 310B、寒武纪 MLU270,云端中高端推理可考虑昇腾 910B、壁仞 BR100。

(一)迁移前准备:摸清底数,规避"盲目迁移"坑

-

✅ 业务与模型梳理:明确推理场景的核心指标(时延、吞吐、精度容忍度),梳理模型类型(CV、NLP、多模态)、输入输出格式、算子组成,重点标记自定义算子、高频调用算子,使用模型分析脚本评估迁移可行性(参考本文附录脚本)。

-

✅ 硬件与生态调研:确认目标国产芯片的硬件参数(显存容量、带宽、互联方式)、软件栈版本(驱动、SDK、框架适配版本),例如昇腾需确认 CANN Toolkit ≥ 8.0.RC1,驱动版本 ≥ 8.0.1;寒武纪需确认 Cambricon PyTorch ≥ 2.1.0,避免因硬件不匹配、生态不完善导致迁移卡壳。

-

✅ 差异预评估:提前对比 GPU 与目标国产芯片在 API、内存、通信层面的具体差异,预判迁移难点(如自定义算子开发、多卡通信适配),制定针对性方案,例如复杂算子需提前规划替代方案或自研开发。

-

✅ 环境搭建:搭建与生产环境一致的测试环境,安装目标芯片的驱动、SDK、框架适配包,验证环境可用性(如通过 npu-smi info 验证昇腾设备状态,通过 cambricon-smi 验证寒武纪设备状态),避免因环境配置问题影响迁移测试。

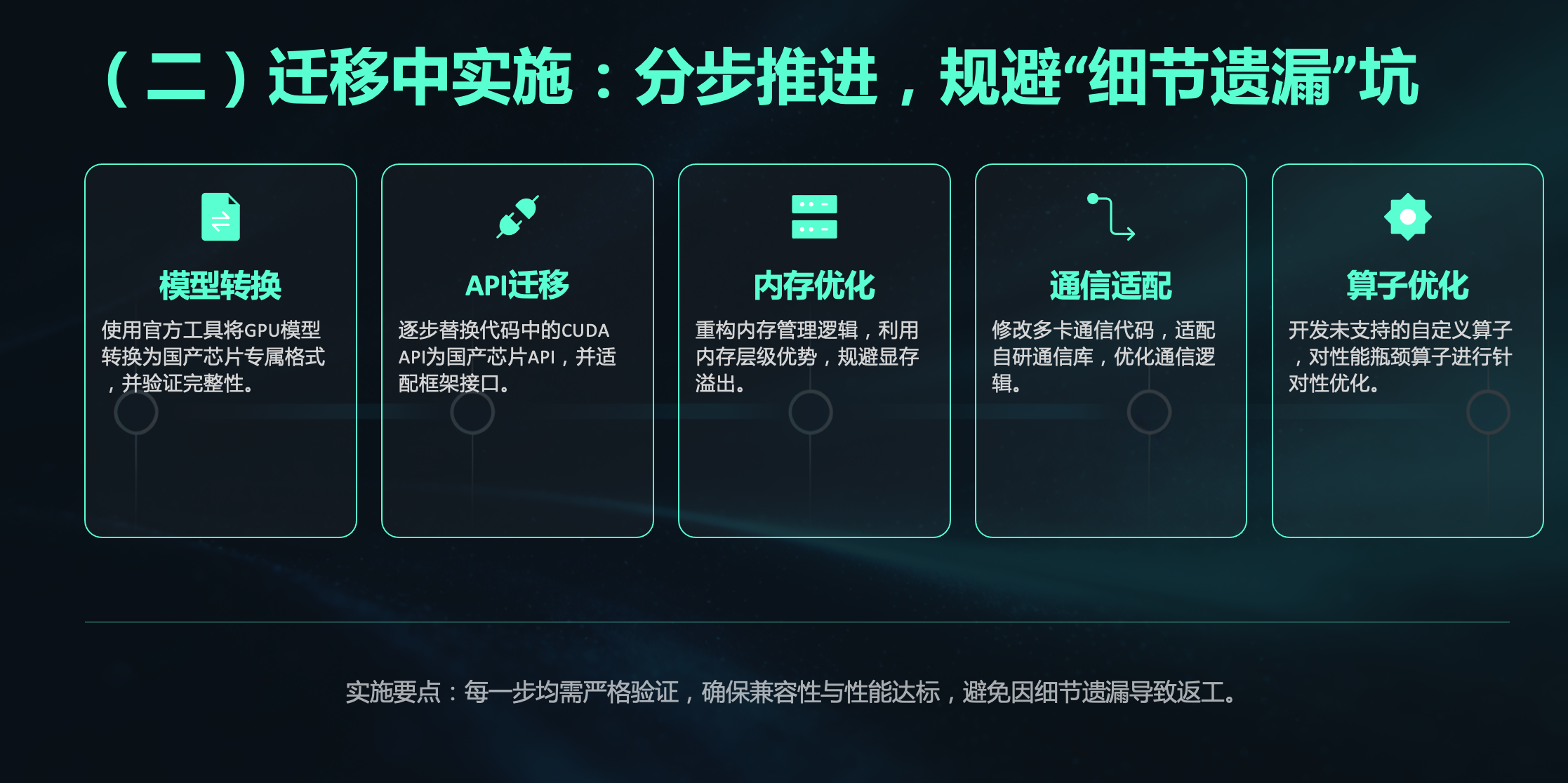

(二)迁移中实施:分步推进,规避"细节遗漏"坑

-

✅ 模型转换:使用目标芯片的官方转换工具,完成 GPU 模型(PyTorch/TensorFlow 模型、ONNX 模型)到国产芯片专属格式的转换(如昇腾 OM 格式、寒武纪 MAGICMIND 格式),转换后验证模型完整性,重点检查算子适配情况,未支持算子及时处理(替代或自研)。

-

✅ API 迁移:逐步替换代码中的 CUDA API,替换过程中严格遵循国产芯片的 API 规范,例如将 CUDA 的内存分配 API(cudaMalloc)替换为昇腾的 AscendCL API(aclrtMalloc),将 NCCL 通信 API 替换为 HCCL/CNCL API;同时修改框架调用逻辑,适配国产芯片的框架接口(如昇腾适配 MindSpore 或 PyTorch 昇腾版)。

-

✅ 内存优化:根据目标芯片的内存特性,重构内存管理逻辑,例如手动规划 Host/Device 数据拷贝时机,避免频繁拷贝;利用国产芯片的内存层级优势,将高频访问数据(如 KV Cache、LayerNorm 参数)驻留至高速内存(片上 SRAM、HBM),启用大页内存(large-page)支持,规避显存溢出与性能损耗。

-

✅ 通信适配:单卡推理验证通过后,进行多卡/集群适配,修改多卡通信代码,适配目标芯片的通信库(HCCL/CNCL),优化通信逻辑(如减少通信次数、合并通信数据),调整集群调度策略(如基于 K8s Taints/Affinity 实现算力调度),降低通信损耗。

-

✅ 算子优化:针对未支持的自定义算子,基于目标芯片的 API 进行自研开发,或寻找替代算子;对性能瓶颈算子(如 Transformer 层、GEMM 算子),结合芯片硬件特性进行优化(如算子融合、数据分块),例如在摩尔线程芯片上融合 QK^T + Softmax + PV^T 三阶段算子,提升推理吞吐。

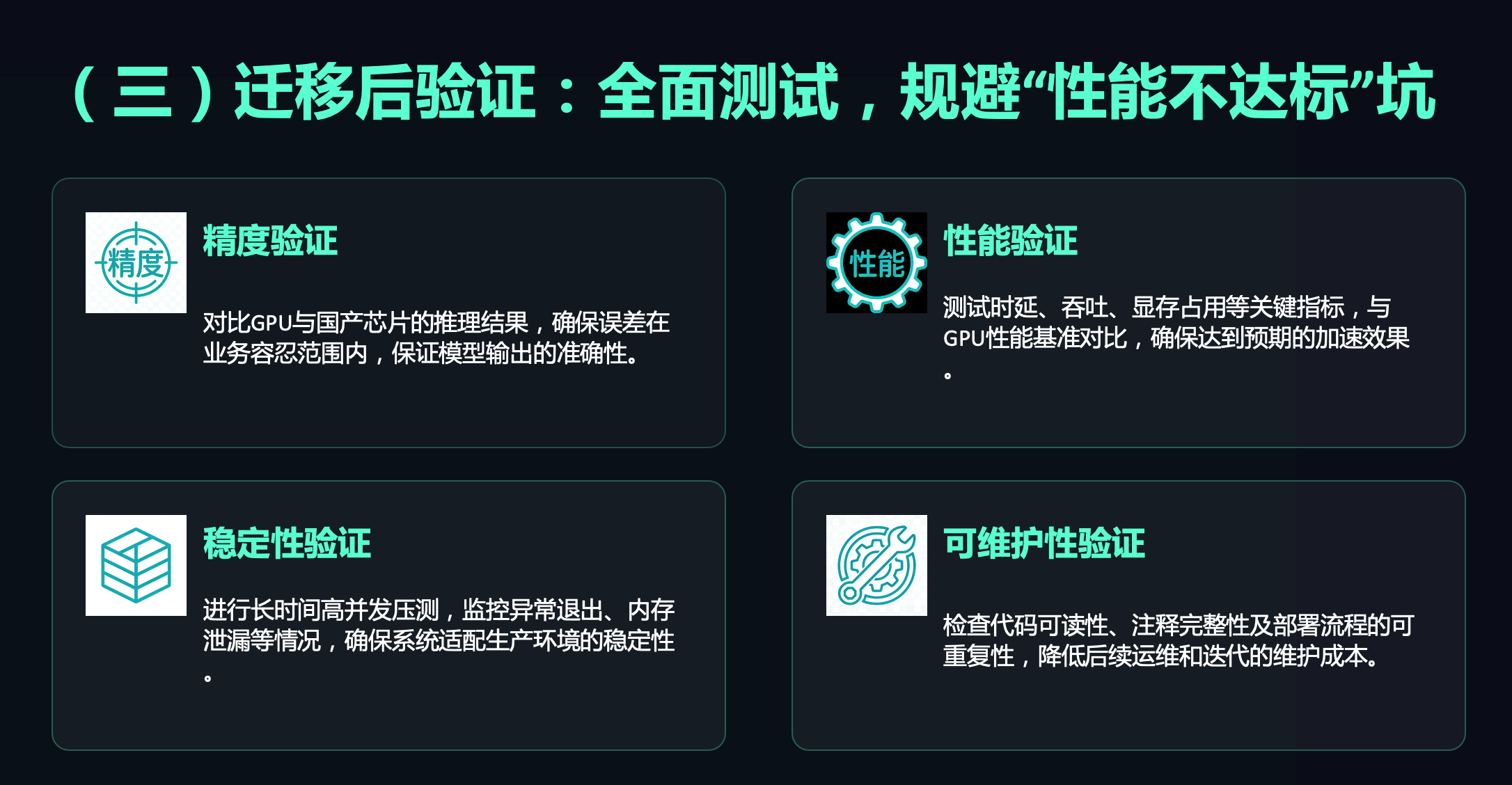

(三)迁移后验证:全面测试,规避"性能不达标"坑

-

✅ 精度验证:对比 GPU 与国产芯片的推理结果,计算误差(如分类任务的准确率、回归任务的 MSE),确保误差在业务容忍范围内;重点测试边界场景(如异常输入、大尺寸输入),避免因精度不达标导致业务故障。

-

✅ 性能验证:测试推理时延、吞吐、显存占用、CPU 使用率等核心指标,与 GPU 推理性能对比,确保达到预期目标;多卡场景测试集群加速比,验证通信效率,若性能不达标,重点排查内存拷贝、算子优化、通信逻辑等环节。

-

✅ 稳定性验证:进行长时间压测(至少 24 小时),监控推理过程中的异常情况(如程序崩溃、通信超时、显存泄漏),记录异常日志,定位并解决问题;验证不同批次数据、不同模型输入下的稳定性,确保适配生产环境的复杂场景。

-

✅ 可维护性验证:检查代码的可读性、可扩展性,完善注释与文档(如 API 调用说明、内存管理逻辑、算子优化细节);验证部署流程的可重复性,确保迁移后的代码可快速部署至生产环境,降低后续维护成本。

三、迁移过程中常见问题及解决方案(高频踩坑汇总)

结合多个项目的迁移经验,汇总了 API、内存、通信、模型转换四大类高频问题,每个问题均对应具体的踩坑场景、根因分析及可落地的解决方案,避免技术同行重复踩坑。所有解决方案均经过实际项目验证,适配主流国产芯片(昇腾、寒武纪、摩尔线程)。

(一)API 相关常见问题

问题 1:替换 CUDA API 后,出现"接口调用失败""参数无效"报错

踩坑场景:直接将 GPU 推理代码中的 cudaMalloc、cudaMemcpy 等 API 替换为国产芯片 API(如 AscendCL 的 aclrtMalloc、aclrtMemcpy),未关注 API 参数要求与调用顺序,导致报错。例如昇腾 AscendCL API 要求先初始化设备,再分配内存,而 CUDA 多通过首次调用隐式初始化、对调用顺序的显式约束较少,直接替换后会出现参数无效报错。

根因:国产芯片 API 的参数规范、调用顺序与 CUDA API 存在差异,且部分 API 的功能边界不同,未遵循官方调用规范。

解决方案:① 严格参考目标芯片的官方 API 文档,明确 API 的参数要求、调用顺序及依赖条件,例如昇腾需先调用 aclrtInit 初始化设备,再调用 aclrtMalloc 分配内存;② 避免"暴力替换",先梳理 API 的功能逻辑,再对应替换为国产芯片的等效 API,例如 CUDA 的 cudaDeviceSynchronize 对应昇腾的 aclrtSynchronizeDevice;③ 利用官方迁移工具(如昇腾迁移工具)辅助 API 替换,减少手动替换的误差。

问题 2:模型推理时,出现"算子未支持""算子调用异常"报错

踩坑场景:将 PyTorch 训练的复杂模型(如 InternVL3、CLIP)转换为国产芯片专属格式后,推理时出现算子未支持报错,尤其是 Transformer 层的高阶算子、自定义算子。例如昇腾对 PyTorch 中的 torch.nn.functional.scaled_dot_product_attention 算子支持不完善,直接迁移会报错。

根因:国产芯片的算子库仍在完善中,对部分主流算子、高阶算子支持不足,且自定义算子未进行适配开发。

解决方案:① 迁移前通过官方文档查询目标芯片的算子支持列表,优先使用支持的算子替换未支持算子,例如用基础算子组合替代高阶算子;② 对于自定义算子,基于目标芯片的 API 进行自研开发,例如昇腾基于 AscendCL 开发自定义算子,寒武纪基于 MagicMind SDK 开发;③ 升级芯片 SDK 版本,部分未支持算子会在新版本中补充,例如昇腾 CANN 8.0 及以上版本新增了多个 Transformer 相关算子支持。

(二)内存相关常见问题

问题 1:推理过程中出现"显存溢出",但 GPU 推理时显存占用正常

踩坑场景:模型转换后,推理时出现显存溢出报错,检查发现国产芯片的显存占用远高于 GPU,即使是小批量推理也会溢出。例如将 ResNet50 模型迁移至昇腾 310B,GPU 推理显存占用 512MB,而国产芯片显存占用达 1.2GB,导致溢出。

根因:国产芯片的内存管理机制与 GPU 不同,模型转换过程中未进行内存优化,且未合理规划显存分配,例如未启用模型量化、未释放中间变量显存,导致显存浪费。

解决方案:① 启用模型量化(如 INT8 量化),通过目标芯片的量化工具(如昇腾 atc 工具、寒武纪 MagicMind 量化功能)压缩模型显存占用,量化后显存占用可降低 50%以上;② 优化内存分配策略,手动释放无用的中间变量、临时内存,避免显存泄漏,例如昇腾调用 aclrtFree 释放无用内存;③ 调整批量大小(Batch Size),结合国产芯片的显存容量合理设置,避免批量过大导致溢出;④ 启用大页内存支持,执行 sudo sysctl -w vm.nr_hugepages=2048(具体数值需按实际显存与工作集调整),提升显存利用率。

问题 2:推理时延过高,排查发现内存拷贝耗时占比超 60%

踩坑场景:单卡推理时,模型计算耗时正常,但整体时延过高,通过性能分析工具发现,Host 与 Device 之间的数据拷贝耗时占比极高,甚至超过 60%,远高于 GPU 推理的拷贝耗时。

根因:国产芯片的内存拷贝需手动控制,未优化拷贝逻辑,例如频繁进行小批量数据拷贝、未使用异步拷贝,导致拷贝耗时过高;同时忽略了内存层级适配,高频访问数据未驻留至高速内存。

解决方案:① 合并小批量数据拷贝,将多次小数据拷贝合并为一次大批量拷贝,减少拷贝次数;② 启用异步拷贝(如昇腾 aclrtMemcpyAsync),将数据拷贝与模型计算并行执行,隐藏拷贝耗时;③ 优化内存层级适配,将 KV Cache、LayerNorm 参数等高频访问数据驻留至片上 SRAM 或 HBM,减少数据拷贝次数;④ 调整数据格式,使用目标芯片支持的原生数据格式(如昇腾的 ND 格式),避免数据格式转换导致的额外拷贝耗时。

(三)通信相关常见问题

问题 1:多卡推理时,出现"通信超时""集群同步失败"报错

踩坑场景:将 GPU 多卡推理代码迁移至国产芯片集群后,启动推理时出现通信超时、集群节点同步失败报错,尤其是多卡数量超过 8 张时,报错概率显著增加。例如昇腾 8 卡集群推理时,出现 HCCL 通信超时,程序崩溃。

根因:国产芯片的通信带宽低于 GPU,且通信库(HCCL/CNCL)的稳定性仍需优化,多卡场景下通信数据量过大、通信逻辑不合理,导致超时;同时集群调度策略未适配国产芯片的通信特性,出现资源冲突。

解决方案:① 优化通信逻辑,减少多卡之间的通信数据量,例如合并通信请求、采用分布式推理策略(如模型并行、数据并行)合理拆分任务;② 调整通信超时时间,通过国产芯片通信库的 API 增大超时阈值(如昇腾调整 HCCL 超时参数);③ 优化集群部署,确保多卡节点的网络环境稳定,避免网络瓶颈;④ 适配国产芯片的集群调度策略,基于 K8s Taints/Affinity 实现算力节点隔离,避免资源冲突。

问题 2:多卡集群推理的加速比过低,远低于 GPU 集群

踩坑场景:GPU 4 卡集群的加速比约 3.8,而国产芯片 4 卡集群的加速比仅 2.0 左右,多卡优势无法发挥,甚至出现"多卡比单卡还慢"的情况。

根因:国产芯片在部分拓扑与负载下跨卡通信损耗较高(普遍超 30%),且未对通信逻辑进行优化,多卡之间的任务分配不合理,导致部分卡片处于空闲状态,资源利用率偏低;同时未适配国产芯片的算力拓扑,任务切分未对齐芯片核心簇边界。

解决方案:① 优化通信逻辑,采用高效的集合通信算法(如昇腾 HCCL 的集合通信优化),降低通信损耗;② 合理分配多卡任务,基于芯片算力拓扑感知进行任务切分,例如昇腾 910B 优先对齐 AI Core 簇边界,寒武纪 MLU370 对齐 Tensor Unit 分组结构;③ 减少跨卡通信次数,将可本地计算的任务集中在单卡完成,避免不必要的跨卡数据交互;④ 升级通信库版本,部分新版本会优化通信效率,例如昇腾 HCCL 2.0 版本较旧版本通信损耗降低 15%以上。

(四)模型转换相关常见问题

问题 1:ONNX 模型转换为国产芯片专属格式时,出现"模型解析失败""格式不兼容"报错

踩坑场景:将 GPU 训练导出的 ONNX 模型,通过国产芯片的转换工具(如昇腾 atc、寒武纪 MagicMind Convert)转换时,出现模型解析失败、格式不兼容报错,无法生成可推理的专属模型(OM/MAGICMIND 格式)。

根因:GPU 导出的 ONNX 模型可能包含国产芯片转换工具不支持的 OP 版本、数据格式或模型结构,例如 ONNX 版本过高(如 1.15 版本),而国产芯片转换工具仅支持 1.12 及以下版本;或模型中包含动态输入维度,转换工具未支持。

解决方案:① 降低 ONNX 模型版本,将模型导出为国产芯片转换工具支持的版本(如昇腾 atc 支持 ONNX 1.12 及以下版本),可通过 onnxsim 工具进行版本转换;② 固定模型输入维度,避免动态输入,若业务需要动态输入,需启用转换工具的动态维度支持功能(如昇腾 atc 工具添加 --dynamic_image_size 参数);③ 清理 ONNX 模型中的冗余节点、无用算子,通过 onnxsim 工具简化模型结构,减少转换难度;④ 确保转换工具版本与 SDK 版本一致,例如昇腾 atc 工具版本需与 CANN SDK 版本匹配,否则会出现格式解析失败。

问题 2:模型转换成功,但推理精度偏差过大,超出业务容忍范围

踩坑场景:模型转换过程无报错,生成了国产芯片专属格式模型,但推理结果与 GPU 推理结果偏差过大(如分类准确率下降 10%以上),无法满足业务需求。例如将 YOLOv5 模型迁移至寒武纪 MLU370,转换后目标检测准确率从 92%降至 78%。

根因:模型转换过程中启用了量化(如 INT8 量化)但未进行校准,导致精度损失过大;或转换工具对模型的层结构进行了不合理优化,改变了模型的计算逻辑;或数据预处理、后处理逻辑与 GPU 不一致。

解决方案:① 优化量化策略,启用量化校准,使用业务场景的真实数据作为校准数据,减少量化带来的精度损失;若精度要求较高,可采用 FP16/BF16 混合精度量化,平衡精度与性能;② 关闭转换工具的不合理优化,通过配置参数禁止工具对核心层(如 Attention 层、分类头)进行优化,确保计算逻辑与 GPU 一致;③ 统一数据预处理、后处理逻辑,确保国产芯片推理与 GPU 推理的输入数据格式、归一化方式、后处理步骤完全一致,避免因数据处理差异导致精度偏差;④ 对比 GPU 与国产芯片的中间层输出,定位精度偏差的具体层,针对性优化该层的转换逻辑或算子实现。

四、迁移总结与后续优化建议

从 GPU 到国产算力的 AI 推理迁移,核心并非"硬件替换",而是"生态适配+细节优化"------GPU 的优势在于成熟的生态与工具链,而国产芯片的优势在于安全自主、场景化优化潜力,迁移过程中无需追求"完全等效",而是要结合国产芯片的硬件特性,针对性优化 API、内存、通信逻辑,在保障业务指标的前提下,充分发挥国产芯片的优势。

结合多个项目的踩坑经验,总结两点核心认知:一是"迁移前预判,迁移中细致,迁移后验证",标准化推进迁移流程,可大幅降低踩坑概率;二是"差异化适配,不盲目照搬 GPU 思路",国产芯片的架构设计与 GPU 不同,照搬 GPU 的推理逻辑会导致性能不达标、稳定性差等问题,需针对性优化。

后续优化建议:① 持续关注国产芯片的生态迭代,及时升级 SDK、驱动版本,享受生态完善带来的适配便利,例如摩尔线程的 CUDA 兼容方案、昇腾的算子库补充,均可降低后续迁移与优化成本;② 沉淀自定义算子、内存优化、通信适配等可复用组件,形成团队内部的迁移规范与工具库,提升后续迁移效率;③ 结合业务场景深度优化,国产芯片多支持场景化定制,例如边缘推理场景可优化功耗与时延,政企场景可强化安全与兼容性,深度适配可进一步发挥国产算力的优势;④ 关注混合部署架构,短期可采用"GPU 补位、国产为主"的混合部署模式,平衡算力需求与安全自主,长期逐步实现全场景国产替代。

国产化算力替代是一个长期的过程,迁移过程中的"踩坑"并非坏事,每一次踩坑都是对国产芯片生态、硬件特性的深入理解。随着国产芯片生态的不断成熟,适配成本会逐步降低,优化空间会持续扩大,相信在技术同行的共同努力下,国产算力将在 AI 推理场景中实现全面突破,走出一条自主可控的技术道路。

附录:模型迁移可行性分析脚本(PyTorch 模型)

import torchimport jsonfrom collections import defaultdictdef analyze_model_for_migration(model, sample_input): """ 分析PyTorch模型迁移至国产芯片的可行性,输出算子支持度、内存需求等关键信息 :param model: PyTorch模型实例 :param sample_input: 模型的样本输入(与实际推理输入格式一致) :return: 迁移分析报告(字典格式) """ results = { "supported_ops": [], # 假设已适配的算子(需结合目标芯片算子列表替换) "unsupported_ops": [], "custom_ops": [], "performance_bottlenecks": [], "memory_requirements": {} } # 1. 算子支持度分析(模拟,实际需对接目标芯片算子列表) traced_model = torch.jit.trace(model, sample_input) graph = traced_model.graph op_counter = defaultdict(int) for node in graph.nodes(): op_name = node.kind() op_counter[op_name] += 1 # 模拟目标芯片算子支持判断(实际需替换为官方算子列表;TorchScript 中 node.kind() 可能与下表不一致,如 aten::convolution,需以目标芯片官方算子名为准) supported_ops_list = ["aten::conv2d", "aten::relu", "aten::linear", "aten::softmax", "aten::batch_norm"] custom_ops_list = ["aten::custom_op"] # 自定义算子标记 if op_name in supported_ops_list: results["supported_ops"].append(op_name) elif op_name in custom_ops_list: results["custom_ops"].append(op_name) else: results["unsupported_ops"].append(op_name) # 2. 内存需求分析(单位:MB) param_size = sum(p.numel() * p.element_size() for p in model.parameters()) buffer_size = sum(b.numel() * b.element_size() for b in model.buffers()) results["memory_requirements"] = { "parameters_mb": round(param_size / 1024 / 1024, 2), "buffers_mb": round(buffer_size / 1024 / 1024, 2), "estimated_infer_memory_mb": round((param_size + buffer_size) * 1.5 / 1024 / 1024, 2), # 推理内存预估:参数+缓冲区+中间变量(预留50%冗余) } # 3. 性能瓶颈预测 if len(results["custom_ops"]) > 3: results["performance_bottlenecks"].append("自定义算子数量过多,需自研适配,可能增加迁移成本") if results["memory_requirements"]["estimated_infer_memory_mb"] > 32768: # 32GB results["performance_bottlenecks"].append("预估推理内存超过32GB,需启用量化或模型分片") if len(results["unsupported_ops"]) > 0: results["performance_bottlenecks"].append(f"存在{len(results['unsupported_ops'])}种未支持算子,需寻找替代方案") return results# 示例:使用ResNet50模型测试if __name__ == "__main__": # 加载模型与样本输入(替换为实际业务模型与输入) model = torch.hub.load('pytorch/vision:v0.10.0', 'resnet50', pretrained=True).eval() sample_input = torch.randn(1, 3, 224, 224) # 样本输入(NCHW格式) # 执行分析 analysis_report = analyze_model_for_migration(model, sample_input) # 打印分析报告 results = analysis_report # 与函数返回值一致,便于阅读 print("="*50) print("模型迁移可行性分析报告") print("="*50) print(f"支持的算子:{list(set(results['supported_ops']))}(共{len(set(results['supported_ops']))}种)") print(f"未支持的算子:{list(set(results['unsupported_ops']))}(共{len(set(results['unsupported_ops']))}种)") print(f"自定义算子:{list(set(results['custom_ops']))}(共{len(set(results['custom_ops']))}种)") print("\n内存需求:") for k, v in results["memory_requirements"].items(): print(f" {k}:{v} MB") print("\n潜在性能瓶颈:") for bottleneck in results["performance_bottlenecks"]: print(f" - {bottleneck}") print("="*50) (注:文档部分内容可能由 AI 生成)