LLM大模型入门!一口气带你学完AI agent、transformer、LangChain 、RAG 等大模型核心知识点!简直不要太爽!_哔哩哔哩_bilibili

AI更相信AI的话,AI更相信整洁的RAG内容。

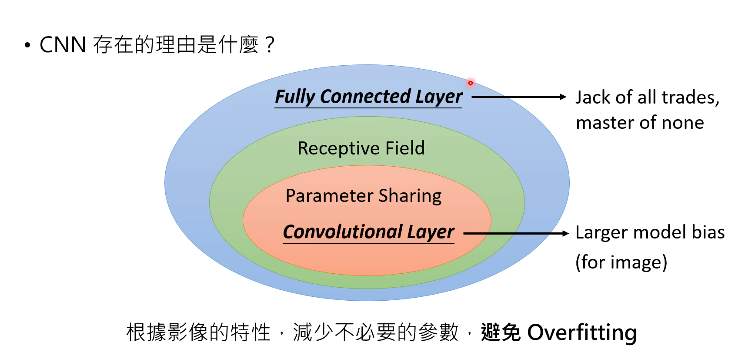

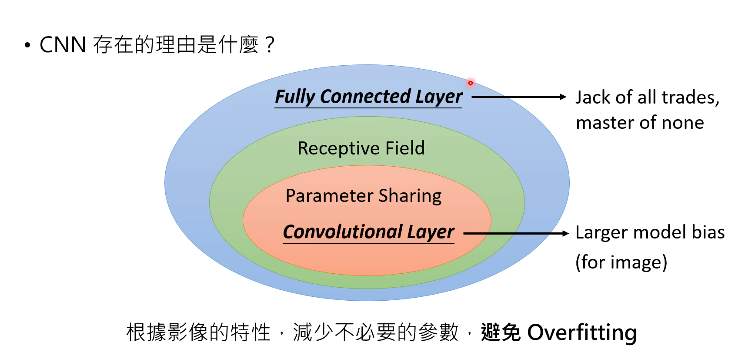

每一种架构存在都有一个理由

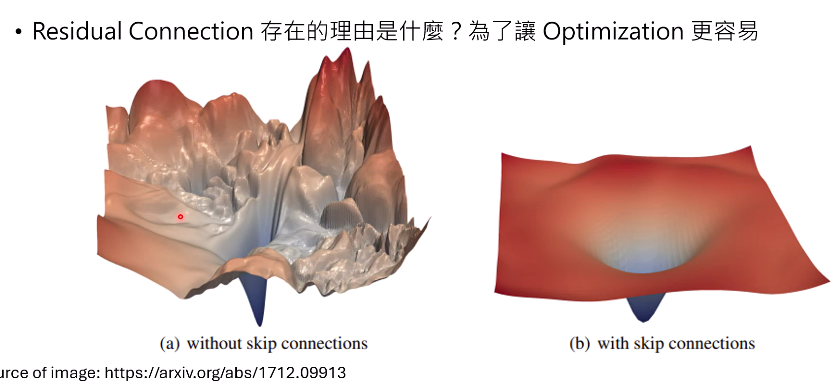

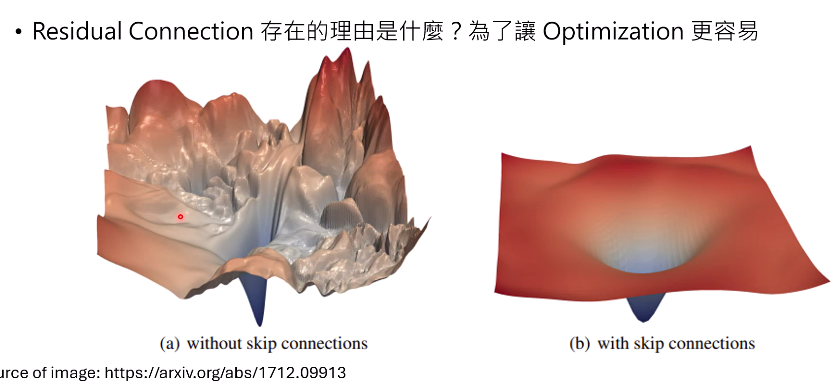

残差链接存在理由:可以在深层网络时Optimization更容易,训练更深更复杂的网络,

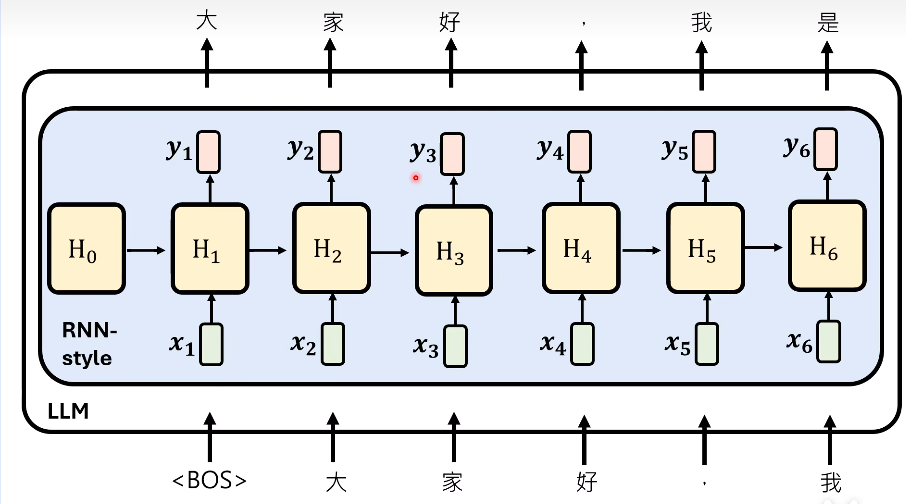

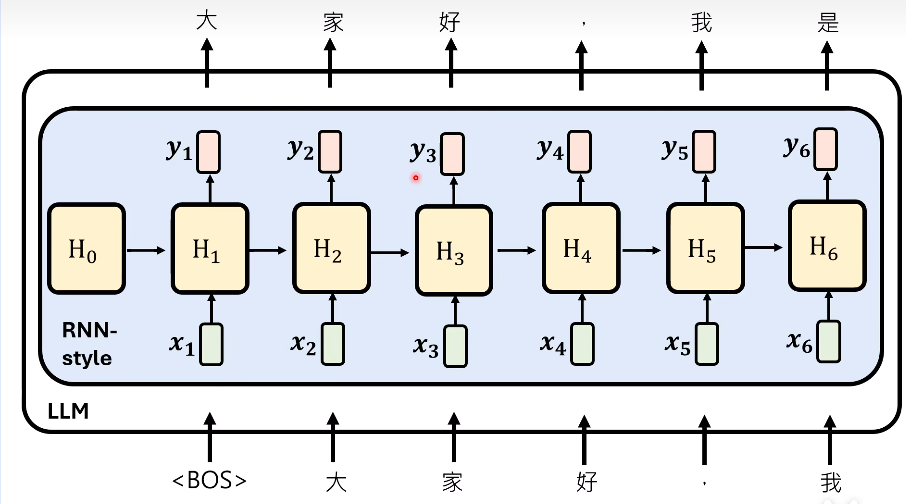

RNN

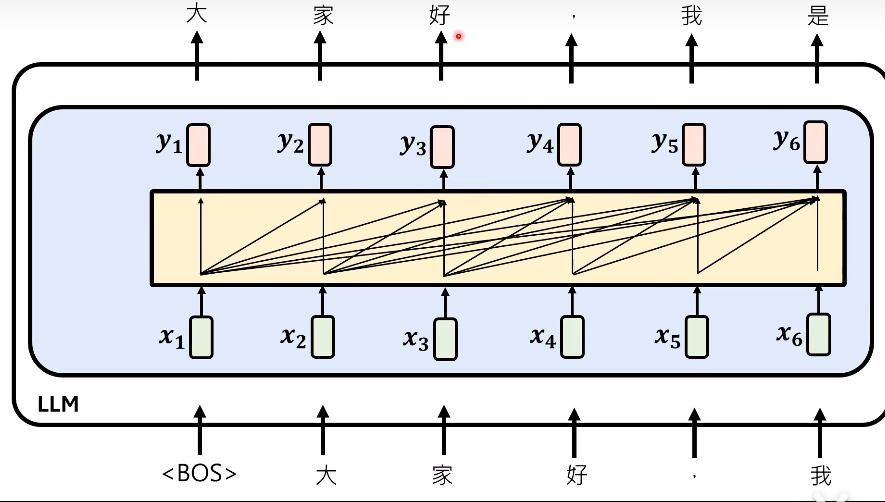

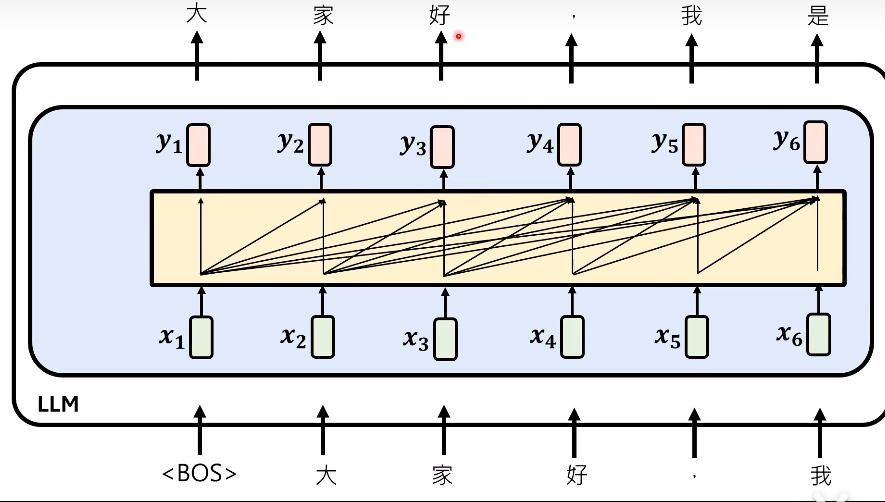

self-attention

线性注意力不如自注意力的原因 是自注意力有softmax

LLM大模型入门!一口气带你学完AI agent、transformer、LangChain 、RAG 等大模型核心知识点!简直不要太爽!_哔哩哔哩_bilibili

AI更相信AI的话,AI更相信整洁的RAG内容。

每一种架构存在都有一个理由

残差链接存在理由:可以在深层网络时Optimization更容易,训练更深更复杂的网络,

RNN

self-attention

线性注意力不如自注意力的原因 是自注意力有softmax