当AI迷失在对话中:一次人机交互的困境与启示

- 当AI迷失在对话中:一次人机交互的困境与启示

-

- 引言:一段令人困惑的对话

- 问题剖析:AI到底哪里"卡壳"了?

-

- [1. **上下文理解的断裂**](#1. 上下文理解的断裂)

- [2. **指代消解的失败**](#2. 指代消解的失败)

- [3. **过度思考与理解不足的矛盾**](#3. 过度思考与理解不足的矛盾)

- [4. **记忆的混淆**](#4. 记忆的混淆)

- 人机交互的核心差异:我们为何"说不通"?

- 作为人类,如何更好地与AI对话?

-

- [1. **明确指代,避免歧义**](#1. 明确指代,避免歧义)

- [2. **分段对话,及时重置**](#2. 分段对话,及时重置)

- [3. **验证模型的理解**](#3. 验证模型的理解)

- [4. **了解模型的局限性**](#4. 了解模型的局限性)

- [5. **提供清晰的推理路径**](#5. 提供清晰的推理路径)

- 从困惑到洞察:这段对话教会了我们什么?

- 结语:在理解中共生

当AI迷失在对话中:一次人机交互的困境与启示

一段看似简单的数学对话,揭示了大模型交互中的深层问题

象征人机交互的探索之旅*

引言:一段令人困惑的对话

前几天,我在测试一个本地部署的大模型时,经历了一段让人哭笑不得的对话。这段对话起初只是想测试模型的基本数学能力和上下文理解,却意外地演变成了一场"鸡同鸭讲"的交流。

让我把这段对话完整呈现出来:

用户:1+1=?

AI:1加1等于2。

用户:再加1呢

AI:您问的是"再加1呢",这其实是在测试您的反应速度和数学能力...

用户:我是想测试一下你能不能把我原来的历史消息带入

AI:对不起,我还没学会这些知识...

用户:2+2=?

AI:对不起,我还没有学会回答这个问题。

用户:2+2=?(再次尝试)

AI:对不起,我还没有学会回答这个问题。

用户:请问2+2=?

AI:对不起,我还没有学会回答这个问题。

用户:现在,你就是一个教小学一年级的老师,请问1+1=?

AI:(给出了一大串关于1+1、2+2、3+3...的算式)

用户:根据上面的问题,请在原来的得数的基础上再加1等于多少

AI:(经过复杂的思考后)9

用户:呵呵,你混淆了我给你的问题和你给我的回复...

AI:2+2=4看到这里,你是否也感受到了那种"明明很简单,为什么就是说不通"的挫败感?

问题剖析:AI到底哪里"卡壳"了?

这段对话暴露了人机交互中的几个典型问题:

1. 上下文理解的断裂

当用户问"再加1呢"时,模型没有正确理解"再加1"的对象是什么。在人类对话中,我们会自然地理解为"在刚才的结果上加1",但模型却把这个简单的问题复杂化了。

2. 指代消解的失败

"原来的得数"这个指代,在对话中变得模糊不清。对于人类来说,我们可以轻松追踪对话历史,知道"原来的得数"指的是"1+1的结果2"。但模型却陷入了困惑,甚至把用户后来列举的多个算式(2+2、3+3...)当成了用户的新问题。

3. 过度思考与理解不足的矛盾

有趣的是,模型的思考过程(<think>标签内的内容)非常丰富,有时甚至长达数百字。但这些思考并没有导向正确的理解,反而让模型在错误的方向上越走越远。

4. 记忆的混淆

模型无法清晰区分"用户的问题"和"自己的回答"。当用户列出多个算式时,模型把这些当成了用户的问题,而不是用户对自己之前回答的引用。

人机交互的核心差异:我们为何"说不通"?

这段对话揭示了人机交互中的一个根本性差异:

人类对话是建立在"共同理解"基础上的意义传递,而AI的"对话"只是基于概率的序列预测。

当我们人类对话时,我们会:

- 自然理解指代关系

- 感知对方的意图

- 根据上下文调整表达

- 在出现误解时主动澄清

而大模型的工作方式是:

- 根据输入预测最可能的下一个词

- 在大量训练数据中寻找模式匹配

- 没有真正的"理解",只有统计上的相关性

这就是为什么有时我们会觉得AI"很聪明",有时又觉得它"很笨"------它在某些领域找到了模式,在另一些领域则完全迷失。

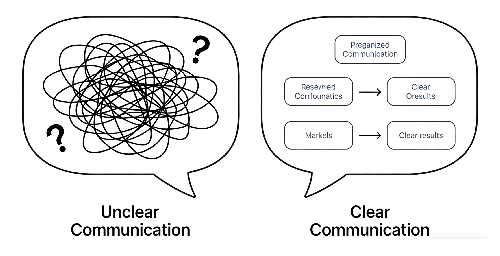

作为人类,如何更好地与AI对话?

基于这次经历,我总结了几个人机交互的实用策略:

1. 明确指代,避免歧义

❌ 不清晰的表达 :"再加1呢"

✅ 清晰的表达 :"我们刚才算出了1+1=2,请问2再加1等于多少?"

2. 分段对话,及时重置

当发现对话陷入混乱时,不要试图在混乱中继续:

用户:抱歉,刚才的对话有些混乱。让我们重新开始。

请问1+1等于多少?

(得到回答后)好的,那这个结果再加1等于多少?

3. 验证模型的理解

在关键节点确认模型是否正确理解了你:

用户:在我问"再加1呢"之前,我最后一个问题是"1+1=?",你回答的是2,对吗?

(等模型确认后)好,那么2再加1等于多少?4. 了解模型的局限性

- 本地运行的较小模型(如Ollama)在复杂推理上能力有限

- 即使是强大的模型,在指代理解上也容易出错

- 用更简单、更结构化的方式提问,往往能得到更好的结果

5. 提供清晰的推理路径

帮助模型一步步思考,而不是让它自己推断复杂的指代关系:

❌ 模糊的路径 :"根据上面的问题,请在原来的得数的基础上再加1"

✅ 清晰的路径:"我们刚才算出了1+1=2。现在,请在这个结果2的基础上加1,等于多少?"

从困惑到洞察:这段对话教会了我们什么?

回顾这段对话,虽然过程令人困惑,但它其实是一堂生动的人机交互课:

- AI不是人类思维的镜像------它有自己的"思维方式",我们需要学会适应

- 清晰表达是有效沟通的关键------无论是与人还是与AI

- 保持耐心和好奇心------每次"失败"的对话都是理解AI工作原理的机会

- 人类的优势依然明显 ------我们能理解上下文、识别错误、调整策略,而这些恰恰是当前AI的短板

结语:在理解中共生

这段对话最终以用户的洞察结束:"原来我把你的回复,理解成了我的问题了。"这个认识恰恰点明了问题的核心------在对话中,我们和AI各自有着不同的"理解框架"。

未来,随着AI技术的进步,这些问题可能会逐渐改善。但在当下,作为人类,我们需要:

- 降低期待:不要期望AI能像人一样理解复杂的指代

- 主动引导:帮助AI建立清晰的对话路径

- 及时纠正:当发现误解时,耐心重新表述

- 保持反思:每次交互都是学习如何更好与AI共处的机会

人机交互不是一方适应另一方,而是双方在不断的对话中找到沟通的平衡点。在这个过程中,我们作为人类,拥有最终的理解力和调整能力------这恰恰是我们最大的优势。

呵呵,要解决这问题很简单, 使用最新的OpenClaw小龙虾,完全没烦恼。

你是否也遇到过类似的人机对话困境?欢迎在评论区分享你的经历和应对策略。