一、前言

云原生数据库是企业数字化转型的核心基础设施,依托存算分离、弹性伸缩、高可用的核心设计,已成为中小规模到中大型业务场景的主流选择。阿里云PolarDB作为国内云原生数据库领域的标杆产品,技术体系成熟且经过大规模实际业务场景验证;移动云海山数据库紧跟云原生技术发展趋势,在核心能力上实现全面对标,同时采用差异化技术方案,更适配通用硬件的部署场景。

本文聚焦二者核心架构能力,从技术演进、整体架构、存储设计、数据访问、持久化、数据一致性六大核心维度,深度拆解海山数据库与PolarDB的底层实现差异、技术选型思路及各自优劣,为企业数据库技术选型、架构设计提供可落地的实操性参考。

二、技术演进与核心定位

2.1 阿里云PolarDB:自研驱动的标杆化演进

PolarDB的技术演进之路,依托阿里云深厚的技术积淀与内部高并发业务场景的实际驱动,是国内云原生数据库发展历程的典型缩影,其核心发展节点与技术突破如下:

- 2005-2013年:技术储备期:从搭建亚洲最大Oracle集群,到"去IOE"战略落地实施,依托双十一高并发OLTP场景的实战考验,积累了大量数据库性能优化、高可用架构设计的宝贵经验;

- 2017-2018年:产品诞生期:国内首款自研云原生数据库PolarDB正式发布,核心落地存算分离架构,兼容MySQL、PostgreSQL两大主流数据库引擎,彻底解决传统数据库计算与存储耦合导致的资源浪费问题;

- 2019-2022年:产品完善与Serverless化:升级为独立品牌产品,持续深化软硬协同能力优化,2022年实现全面Serverless化,支持计算、存储资源按需分配、按使用计费,成为云原生数据库领域的行业标杆;

- 2023年至今:架构深度优化期:基于软硬协同技术实现计算-内存-存储三层解耦,持续打磨存算分离架构下的性能表现与数据一致性,同时为集分一体化架构打下坚实技术基础,产品的稳定性与高性能优势进一步凸显。

PolarDB的核心技术路线围绕"软硬协同、存算分离、高性能共享存储"三大方向展开,通过RDMA、Smart SSD等硬件级技术优化,结合自研分布式文件系统PolarFS,实现云原生能力的最大化释放。

2.2 移动云海山数据库:对标研发的本土化适配

海山数据库是移动云核心产品布局之一,核心定位为对标行业标杆产品,实现云原生数据库能力的商业化落地,其研发与演进全程围绕"核心能力齐平、落地方案差异化"的核心思路展开,核心特征如下:

- 研发背景:紧跟云原生存算分离的主流设计理念,摒弃传统数据库计算与存储耦合的落后架构,采用存算分离核心设计,兼容MySQL、PostgreSQL两大主流引擎,精准匹配企业级OLTP业务的核心需求;

- 核心能力:在存算分离、高可用、读写分离、弹性伸缩等云原生核心能力上,与行业标杆产品实现全面齐平,可满足企业级业务的可靠性、扩展性需求;

- 技术差异:摒弃对高性能专用硬件的依赖,采用纯软件模块化设计实现所有核心能力,大幅降低硬件部署门槛,更适配通用x86服务器部署场景,有效解决高性能标杆产品硬件成本高、部署门槛高的行业痛点;

- 技术现状:存储、数据访问、持久化、数据一致性等核心功能模块均已落地商用,聚焦云原生架构的性能优化与本土化运维适配,未涉及分布式架构相关研发投入。

2.3 演进核心差异总结

|------|-----------------------------------------|---------------------------------------|

| 对比维度 | PolarDB | 海山数据库 |

| 驱动方式 | 业务驱动+技术前瞻,从阿里云内部高并发场景出发,自研落地后标准化输出 | 对标研发+本土化适配,紧跟行业技术路线,实现核心能力对标,适配通用部署场景 |

| 硬件依赖 | 高,依托RDMA、NVMe SSD、Smart SSD等高性能硬件实现性能优化 | 低,纯软件方案,无专用硬件依赖,完美适配通用x86服务器 |

| 核心优势 | 技术成熟,性能领先,经过大规模互联网业务场景长期验证 | 部署灵活,硬件兼容性强,成本可控,本土化服务与运维适配性好 |

| 发展重点 | 持续优化软硬协同能力,结合Serverless化进一步提升资源利用率 | 优化软件模块资源占用,提升通用硬件下的性能表现,完善本土化运维体系 |

三、整体架构:存算分离的共性与核心差异

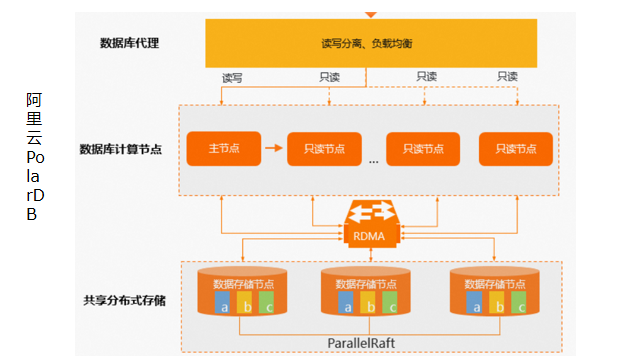

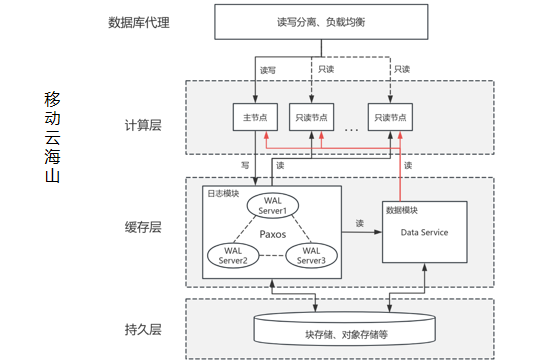

海山数据库与PolarDB均采用云原生存算分离作为核心架构,整体设计理念高度一致,均致力于解决传统数据库资源耦合的痛点,但在底层实现细节、架构解耦方式、硬件依赖度上存在显著差异,这也是二者后续所有核心功能模块差异的根本根源。

3.1 架构核心共性

作为成熟的云原生数据库产品,二者的架构设计具备四大核心共性,也是云原生数据库区别于传统数据库的核心特征:

- 存算分离核心设计:将计算节点与存储节点独立部署、独立弹性伸缩,计算节点专注于SQL解析、查询优化、事务处理、并发控制等计算密集型工作,存储节点负责数据持久化、WAL日志管理、数据备份等存储密集型工作,从根源上解决传统架构资源耦合导致的资源浪费问题;

- 一主多从读写分离:均采用"1个读写主节点+多个只读节点"的服务模式,通过数据库代理实现请求智能分发与负载均衡,读请求由只读节点分担,写请求由主节点集中处理,大幅提升架构的并发处理能力;

- 多可用区高可用保障:均支持多可用区部署,通过分布式一致性算法实现数据多副本存储,支持可用区无缝迁移、数据无损容灾,彻底解决传统数据库的单点故障隐患,保障业务连续可用;

- 无感弹性伸缩能力:计算节点可按需添加或移除只读节点,存储节点可实现容量线性弹性扩容,整个过程无需中断业务,完美适配业务流量的动态变化,避免资源闲置或运力不足。

3.2 架构核心差异

二者的核心差异集中在三层解耦实现、存储架构设计、核心协议支撑三大维度,本质是"软硬协同"与"纯软件实现"的技术路线差异,这也是决定二者性能表现、部署成本的核心因素:

|--------|-------------------------------------------------|-----------------------------------------------------------------|

| 对比维度 | PolarDB | 海山数据库 |

| 三层解耦 | 硬件级解耦:通过RDMA构建共享内存池+共享存储,实现计算-内存-存储的物理解耦,资源全局共享 | 软件级解耦:无硬件共享内存池,通过软件整合计算节点本地内存实现内存池化,存储层拆分为日志/数据模块实现逻辑解耦,无全局共享存储 |

| 核心协议 | 依赖RDMA高速硬件协议,结合文件系统协议实现数据访问 | 采用通用软件协议:GRPC协议实现数据页读写,流复制协议实现WAL日志同步 |

| 节点设计 | 计算节点(主/只读)+共享存储节点,无额外功能模块 | 计算节点(主/只读)+日志模块(WS)+数据模块(Data Service),双模块独立部署、独立容灾 |

| 硬件适配 | 仅支持高性能硬件环境(RDMA、NVMe SSD) | 全兼容通用x86服务器,无硬件门槛,普通SSD/HDD均可部署 |

| 工程化复杂度 | 高,软硬件协同设计,对部署、运维团队技术要求高 | 低,纯软件模块化设计,部署流程简单,适配企业通用运维体系 |

PolarDB架构图

移动云海山数据库架构图

简言之,PolarDB是软硬协同的高性能架构,以硬件投入换取极致性能;海山数据库是纯软件的高适配架构,以软件调度实现通用硬件的云原生能力落地,二者从架构底层就决定了各自的场景适配方向。

四、存储架构:架构差异的核心根源

存储架构是海山数据库与PolarDB最核心的差异点,直接决定了后续数据访问、持久化、数据一致性的底层实现逻辑,也是二者技术路线选择的直接体现,其设计思路完全适配各自的整体架构定位。

4.1 PolarDB:硬件级共享分布式存储

PolarDB摒弃了传统数据库的本地存储设计,采用硬件级共享分布式存储架构,核心依托RDMA高速网络+自研分布式文件系统PolarFS实现,这也是其高性能优势的核心技术支撑,设计核心如下:

- 全局共享存储集群:所有计算节点(读写主节点、只读节点)通过RDMA网络访问同一个分布式存储集群,所有节点共享同一份数据,无数据冗余存储,避免了传统主从架构的数据同步开销,大幅提升数据一致性;

- PolarFS文件系统深度优化:专为存算分离架构设计的用户态分布式文件系统,摒弃传统内核I/O栈,将3副本跨节点写入延迟优化至本地PCIe SSD级别,彻底解决存算分离架构下的网络I/O性能瓶颈,让共享存储的访问性能与本地盘持平;

- 软硬协同深度定制:结合Smart SSD、CXL技术对存储硬件进行深度定制,优化数据读写、持久化的底层性能;同时通过RDMA构建跨节点的共享内存池,整合所有存储节点的内存资源,为计算节点提供低延迟的内存访问能力;

- 标准文件系统协议访问:计算节点通过标准的文件系统协议访问共享存储集群,工程化实现简单,大幅降低开发、维护成本。

核心优劣

- 优势:数据全局统一管理,无数据同步开销,访问性能接近本地盘,高并发场景下的读写吞吐能力强,工程化实现与维护简单;

- 劣势:硬件依赖度极高,必须部署在具备RDMA、NVMe SSD的高性能硬件环境,部署成本高昂,对机房、服务器的硬件标准要求严苛。

4.2 海山数据库:软件级模块化存储

海山数据库摒弃了硬件级共享存储设计,采用纯软件级模块化存储架构,核心通过存储层解耦+通用软件协议实现存算分离,完全不依赖高性能专用硬件,设计核心如下:

- 存储层双模块解耦设计:将传统的单一存储节点拆分为日志模块(WS)和数据模块(Data Service),两个模块独立部署、独立弹性伸缩、独立容灾,分别负责WAL日志的管理/持久化和数据页的管理/持久化,实现功能解耦,大幅降低单模块故障对整个系统的影响;

- 无共享存储设计:计算节点不共享任何物理存储,每个计算节点通过通用软件协议独立访问日志模块和数据模块,实现数据的分布式访问,无需全局共享存储,彻底规避硬件级共享的部署门槛;

- 通用软件协议支撑:通过GRPC协议为计算节点提供标准化的数据页读写接口,通过PostgreSQL原生流复制协议实现WAL日志的读写、同步与回放,无需依赖RDMA等硬件协议,通用x86服务器均可完美支持;

- 模块化精细化资源调度:日志模块和数据模块均支持多副本部署,可根据业务写压力(日志模块)、数据存储需求(数据模块)分别弹性扩容,实现资源的精细化调度,避免资源浪费。

核心优劣

- 优势:无高性能硬件依赖,适配所有通用x86服务器,部署成本低、门槛低;模块化设计让资源调度更灵活,本土化、私有化部署适配性强;

- 劣势:日志模块与数据模块作为额外功能组件,会占用一定的系统资源;软件协议的交互存在轻微性能开销,目前正通过模块化、多租户设计持续优化资源利用率。

4.3 存储架构核心对比

|--------|----------------------------|-------------------------|

| 特性 | PolarDB | 海山数据库 |

| 核心架构 | 硬件级共享分布式存储 | 软件级日志+数据双模块解耦存储 |

| 网络协议 | RDMA(高速硬件协议)+文件系统协议 | GRPC(通用软件协议)+流复制协议 |

| 数据管理 | 全局共享一份数据,无数据冗余 | 无共享设计,计算节点通过协议访问模块化存储 |

| 硬件要求 | 高(RDMA、NVMe SSD、Smart SSD) | 低(通用x86服务器,普通SSD/HDD均可) |

| 额外资源开销 | 无,无额外功能模块 | 有,日志/数据模块占用部分系统资源 |

| 部署灵活性 | 低,依赖专用高性能硬件环境 | 高,通用硬件均可部署,支持按需模块化扩容 |

| 核心性能支撑 | 硬件性能+PolarFS文件系统优化 | 软件调度+冷热数据分层优化 |

五、后续

基于存储架构的差异点,后续将继续拆解海山数据库与PolarDB架构上的区别,分别从数据访问、数据持久化、数据一致性等数据库基本能力表现出发,详细介绍两者的差异,以体现其架构上的不同。