机器人想要在真实场景里完成倒水、抓取、摆放、拧瓶盖 等精细动作,核心在于稳定、连续、符合指令 的手 - 物交互(HOI) 。但现有方法普遍存在三大瓶颈:1. 语义与几何难以兼顾长时程操作容易穿模、接触漂移,动作与语言指令、3D 场景不匹配。2. 推理速度无法实时主流扩散模型生成一段动作需要 3--7 秒,难以用于在线规划。3. 高质量 HOI 数据极度稀缺手 - 物交互遮挡严重、动捕成本高、标注难度大,公开数据集规模有限。

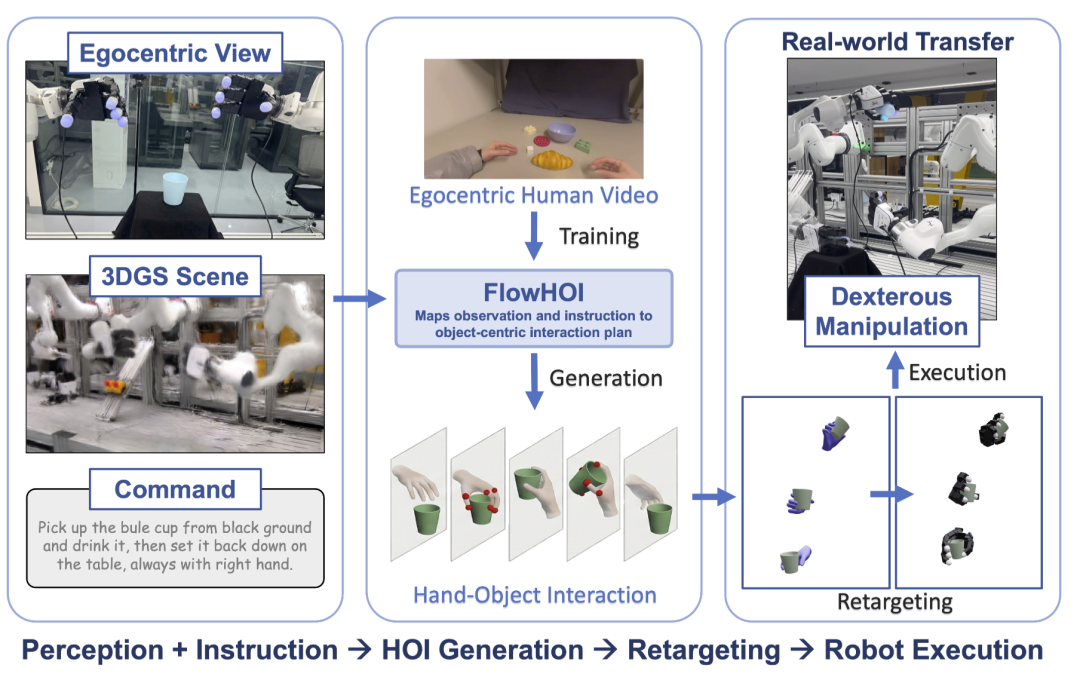

为解决这些问题,本文提出 FlowHOI :一个基于流匹配、语义对齐、可真机部署 的两阶段手 - 物交互生成框架。FlowHOI 的目标非常明确:以第一视角观测、文本指令、3D 高斯场景为输入,生成时序连贯、物理合理、语义对齐的 HOI 序列,并直接迁移到灵巧机器人执行。

为解决数据稀缺,文章提出一套无需动捕、从第一视角视频自动生成高质量 HOI 数据 的流程:① 过渡帧检测通过手腕速度与方向变化,定位 "抓取结束、开始操作" 的关键帧。② 物体 3D 重建使用 SAM3 分割 + DepthAnything3 深度估计 + SAM3D 重建物体网格。③ 手 - 物精准对齐基于 MANO 手部模型,优化位移与姿态,保证指尖接触、无穿透、抓握稳定。④ 输出对齐轨迹自动生成可用于训练的手 - 物交互序列,大幅降低数据成本。

FlowHOI 最关键的设计:模仿人类行为 ------ 先抓稳,再操作。

🔹 第一阶段:抓取(Grasping)

-

专注:几何稳定、接触可靠

-

任务:生成 "接近 → 触碰 → 抓稳" 的手部运动

-

训练:使用大规模重建数据预训练抓取先验

-

目标:无抖动、不穿模、抓握姿态自然

🔹 第二阶段:操作(Manipulation)

-

专注:语义对齐 + 场景约束

-

任务:在稳定抓取基础上,完成倾倒、转动、放置等长时程动作

-

输入:语言指令 + 3D 场景信息 + 抓取结束状态

-

设计:时序掩码 + 过渡硬约束,保证动作连贯不崩坏

为让动作符合真实空间布局,模型使用双场景编码:

① 局部场景

-

3D 点云采样

-

几何特征(Concerto)+ 语义特征(SceneSplat)融合

-

Perceiver 压缩,降低计算量

② 全局场景

-

体素化占用网格

-

ViT 编码,提供整体布局先验

-

避免大碰撞,保证全局合理性

FlowHOI 放弃扩散模型,使用条件流匹配(CFM):

-

推理仅需 0.16 秒 / 序列

-

比扩散模型快 40 倍

-

采用 x-prediction 目标,动作更平滑、抖动更少

-

天然适合机器人实时控制与在线规划

在 GRAB、HOT3D 两大权威数据集上:动作识别精度最高;物理仿真成功率 55.96%,较最优扩散基线提升1.7 倍;穿模体积最多降低21%; 推理速度0.16s / 序列,满足实时性;真机成功执行4 类任务。