TL;DR

- 场景:需要从 Linux Crontab 过渡到 Airflow,完成离线任务的定时调度与依赖编排。

- 结论:Crontab 适合单点定时,Airflow 适合可视化、可编排、可追踪的任务流管理,但示例需区分版本差异。

- 产出:给出 Crontab 基础、Airflow 核心概念、DAG 入门示例,以及错误速查卡用于快速排障。

Crontab简介

基础介绍

Linux系统是由cron(crond)系统服务来控制的,Linux系统上原本那就有非常多的计划性工作,因此这个系统服务是默认启动的。 Linux系统也提供了Linux用户控制计划任务的命令:crontab命令

- 日志文件:ll /var/log/cron*

- 编辑文件: vim /etc/crontab

- 进程: ps -ef | grep crond => /etc/init.d/crond restart

- 作用:任务(命令)定时调度 定时备份等

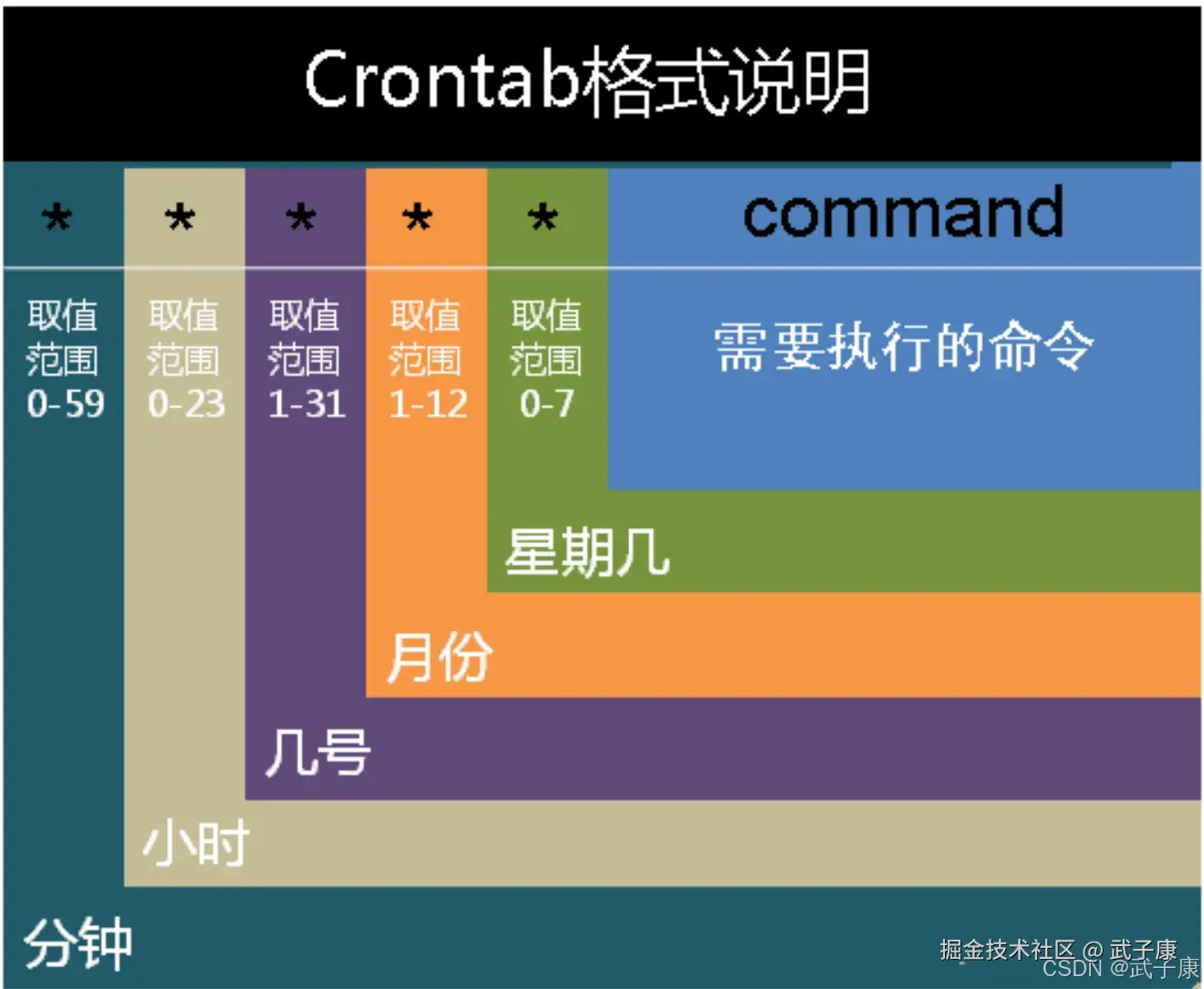

格式说明

以上各个字段中,还可以使用以下特殊字符:

以上各个字段中,还可以使用以下特殊字符:

- 代表所有的取值范围内的数字,如月份字段为,则表示1到12个月

- /代表每一定时间间隔的意思,如分钟字段为*/10,表示每10分钟执行1次

- -代表从某个区间范围,是闭区间,如2-5表示2,3,4,5,小时字段中0-23/2表示在0~23点范围内每两小时执行一次

- ,分散的数字(不连续),如1,2,3,6,8,9

- 由于各个地方每周的第一天不一样,因此Sunday=0(第一天)或Sunday=7(最后一天)

配置实例

shell

# 每一分钟执行一次command(因cron默认每1分钟扫描一次,因此全为*即可)

* * * * * command

# 每小时的第3和第15分钟执行command

3,15 * * * * command

# 每天上午8-11点的第3和15分钟执行command

3,15 8-11 * * * command

# 每隔2天的上午8-11点的第3和15分钟执行command

3,15 8-11 */2 * * command

# 每个星期一的上午8点到11点的第3和第15分钟执行command

3,15 8-11 * * 1 command

# 每晚的21:30执行command

30 21 * * * command

# 每月1、10、22日的4:45执行command

45 4 1,10,22 * * command

# 每周六、周日的1 : 10执行command

10 1 * * 6,0 command

# 每小时执行command

0 */1 * * * command

# 晚上11点到早上7点之间,每隔一小时执行command

* 23-7/1 * * * command任务集成部署

Airflow核心概念

DAGs

有向无环图(Directed Acyclic Graph),将所有需要运行的tasks按照依赖关系组织起来,描述的是所有tasks执行的顺序

Operators

Airflow内置了很多Operators

- BashOperator 执行一个Bash命令

- PythonOperator 调用任意的Python函数

- EmailOperator 用于发送邮件

- HTTPOperator 用于发送HTTP请求

- SqlOperator 用于执行SQL命令

- 自定义 Operator

Task

Task:Task是Operator的一个实例

Task Instance

Task Instance:由于Task会被重复调度,每次Tasks的运行就是不同的Task Instance,Task Instance 有自己的状态,包括 success、running、failed、skipped、up_for_rechedule、up_for_retry、queued、no_status等

Task Relationships

Task Relationships:DAGs中的不同Tasks之间可以有依赖关系

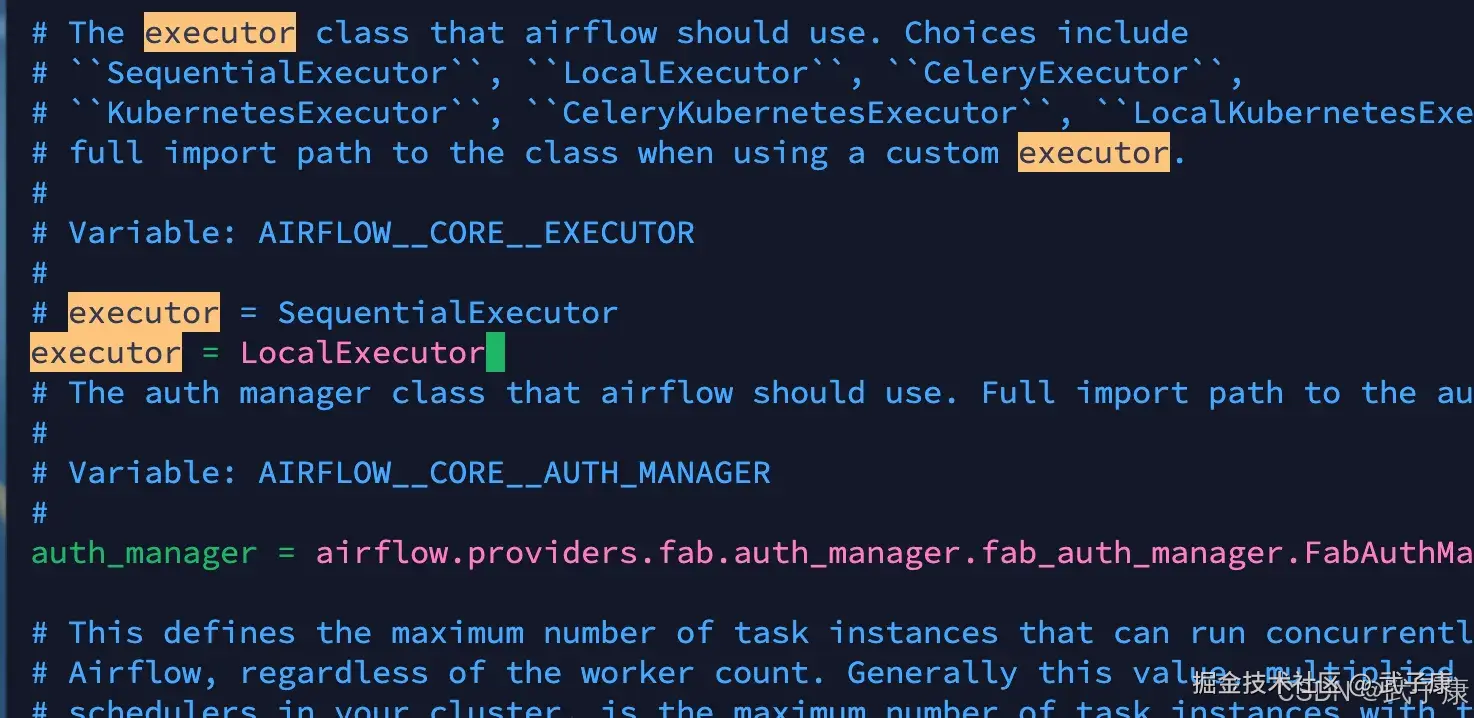

Executor

Executor,在Airflow中支持的执行器就有四种:

- SequentialExecutor:单进程顺序执行任务,默认执行器,通常只用于测试

- LocalExecutor:多进程本地执行任务

- CeleryExecutor:分布式调度,生产常用,Celery是一个分布式调度框架,其本身没有队列功能,需要使用第三方组件,如RabbitMQ

- DaskExecutor:动态任务调度,主要用于数据分析

- 执行器的修改:修改 $AIRFLOW_HOME/airflow.cfg 中:executor = LocalExecutor 这里关于执行器的修改,修改如下所示:

入门案例

编写脚本

shell

mkdir $AIRFLOW_HOME/dags

vim $AIRFLOW_HOME/dags/helloworld.py我们需要写入的内容如下:

python

from datetime import datetime, timedelta

from airflow import DAG

from airflow.utils import dates

from airflow.utils.helpers import chain

from airflow.operators.bash_operator import BashOperator

from airflow.operators.python_operator import PythonOperator

# 定义默认参数

def default_options():

default_args = {

'owner': 'airflow', # 拥有者名称

'start_date': dates.days_ago(1), # 第一次开始执行的时间

'retries': 1, # 失败重试次数

'retry_delay': timedelta(seconds=5) # 失败重试间隔

}

return default_args

# 定义Bash任务

def task1(dag):

t = "pwd"

task = BashOperator(

task_id='MyTask1', # task_id

bash_command=t, # 指定要执行的命令

dag=dag # 指定归属的dag

)

return task

# Python任务函数

def hello_world():

current_time = str(datetime.today())

print('hello world at {}'.format(current_time))

# 定义Python任务

def task2(dag):

task = PythonOperator(

task_id='MyTask2',

python_callable=hello_world, # 指定要执行的函数

dag=dag

)

return task

# 定义另一个Bash任务

def task3(dag):

t = "date"

task = BashOperator(

task_id='MyTask3',

bash_command=t,

dag=dag

)

return task

# 定义DAG

with DAG(

'HelloWorldDag', # dag_id

default_args=default_options(), # 指定默认参数

schedule_interval="*/2 * * * *" # 执行周期,每分钟2次

) as d:

task1 = task1(d)

task2 = task2(d)

task3 = task3(d)

chain(task1, task2, task3) # 指定执行顺序写入的内容如下所示:

测试运行

shell

# 执行命令检查脚本是否有错误。如果命令行没有报错,就表示没问题

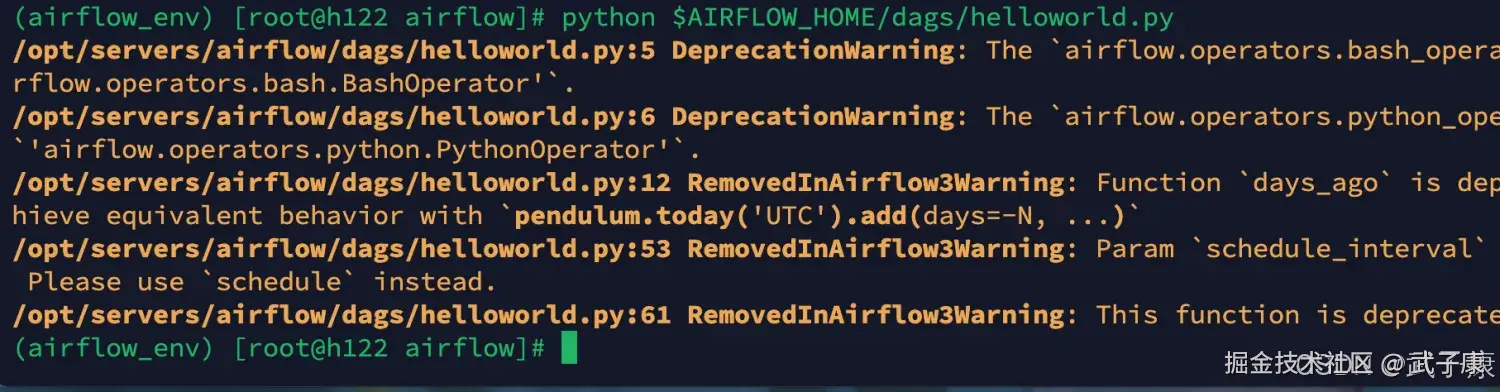

python $AIRFLOW_HOME/dags/helloworld.py执行的结果如下图所示:  查看生效的 dags

查看生效的 dags

shell

# 查看生效的 dags

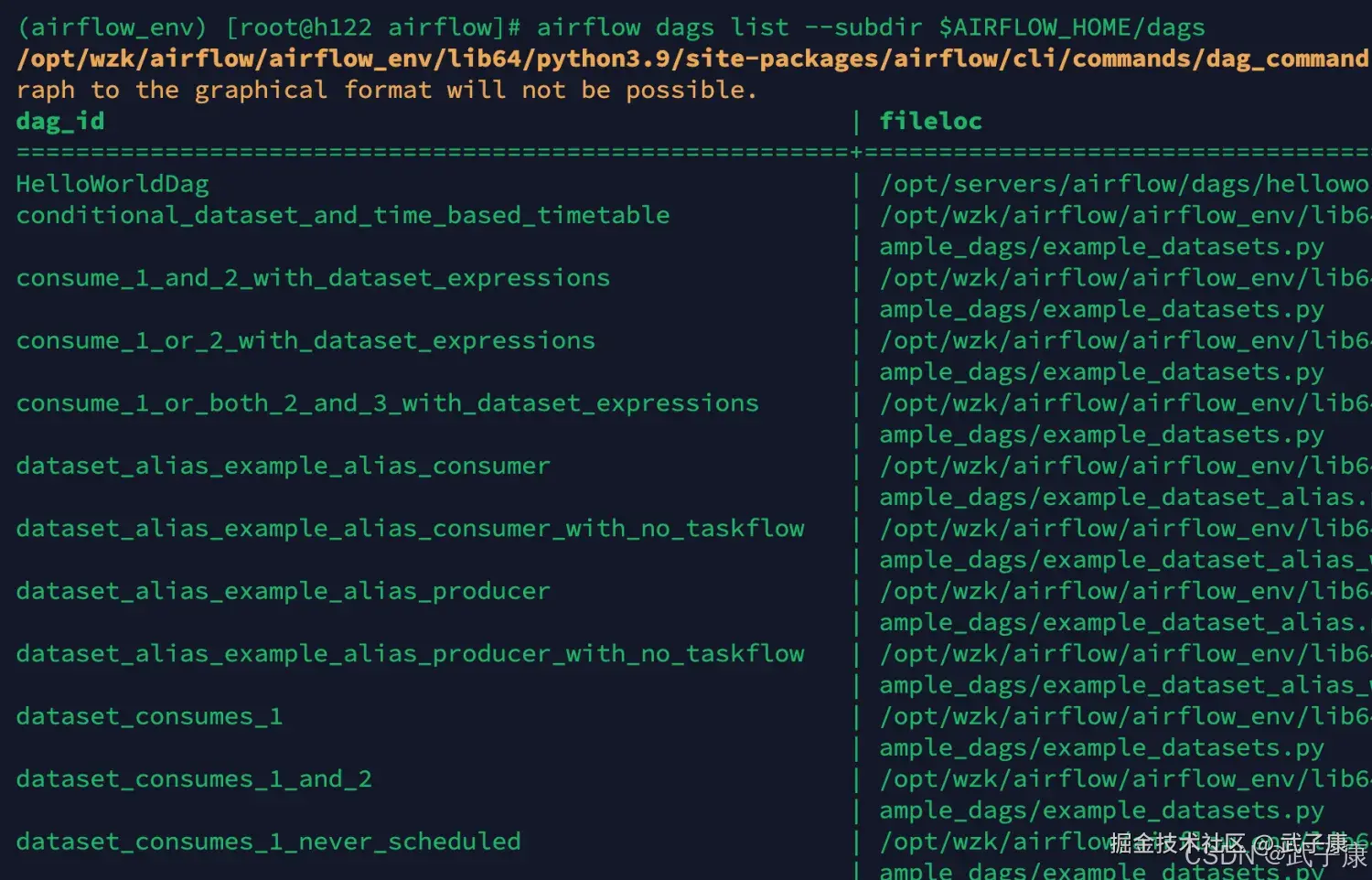

airflow dags list --subdir $AIRFLOW_HOME/dags执行结果如下图所示:  查看指定dag中的task

查看指定dag中的task

shell

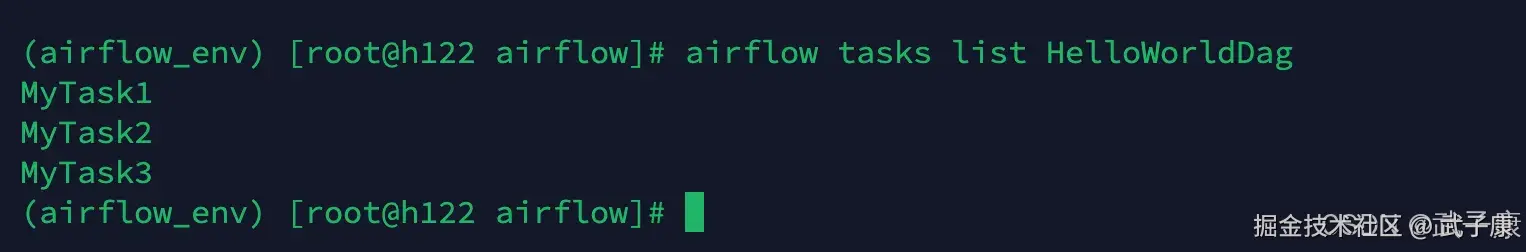

airflow tasks list HelloWorldDag执行的结果如下图所示:

测试dag中的task

shell

airflow tasks test HelloWorldDag MyTask2 2020-08-01执行的结果如下所示:

错误速查

| 症状 | 根因 | 定位 | 修复 |

|---|---|---|---|

| ModuleNotFoundError: airflow.operators.bash_operator | 使用了 Airflow 1.x 导包路径,但实际环境是 Airflow 2.x | 直接执行 DAG 文件或 airflow dags list 时出现 | 按实际版本修改导包路径,统一代码与环境版本 |

| DAG 文件无报错,但 airflow dags list 看不到 | 文件可被 Python 执行,不代表被 Airflow 成功注册;也可能 DAG 对象未正确生成 | 查看 Scheduler 日志、执行 airflow dags list | 检查 DAG 对象是否在全局可见、导包是否兼容、Scheduler 是否正常运行 |

| schedule_interval="*/2 * * * *" 被解释错误 | 文字描述写错,把"每 2 分钟一次"写成"每分钟 2 次" | 对照 cron 表达式含义改正文案 | 不改表达式,仅修正文字描述 |

| * 23-7/1 * * * command 不按预期执行 | 小时字段跨天范围写法存在歧义,不同实现下可读性差 | 手工拆分表达式验证 | 改成两个明确规则,或拆成 23,0-7 这类更直白表达 |

| 修改 airflow.cfg 后执行器未生效 | 改了配置但未重启相关进程 | 检查 Webserver/Scheduler/Worker 进程状态 | 修改配置后重启 Airflow 相关服务 |

| airflow tasks test 失败,提示找不到 DAG 或 Task | dag_id、task_id、执行日期不匹配,或 DAG 未被加载 | 先执行 airflow dags list、airflow tasks list HelloWorldDag | 先确认 DAG 可见,再核对 Task 名称与测试日期 |

| Bash 任务执行失败 | bash_command 所依赖命令不存在或环境变量不一致 | 查看 task log | 使用绝对路径、补齐环境变量、先在同一运行用户下手工执行 |

| Python 任务能导入但运行失败 | python_callable 逻辑报错或运行环境依赖缺失 | 查看 task log 的 traceback | 补齐依赖、缩小函数副作用、先本地独立验证函数 |

| 任务一直排队不执行 | Executor 与资源配置不匹配,Scheduler/Worker 未正常工作 | 查 Airflow UI 状态、Scheduler/Worker 日志 | 检查执行器类型、并发参数、Worker 进程与消息队列状态 |

| 文章示例能跑但读者环境跑不通 | 正文混用了不同 Linux 发行版习惯和不同 Airflow 大版本写法 | 对比系统版本与 Airflow 版本 | 在文首明确"系统环境 + Airflow 版本"前置条件 |

其他系列

🚀 AI篇持续更新中(长期更新)

AI炼丹日志-29 - 字节跳动 DeerFlow 深度研究框斜体样式架 私有部署 测试上手 架构研究 ,持续打造实用AI工具指南! AI研究-132 Java 生态前沿 2025:Spring、Quarkus、GraalVM、CRaC 与云原生落地

💻 Java篇持续更新中(长期更新)

Java-218 RocketMQ Java API 实战:同步/异步 Producer 与 Pull/Push Consumer MyBatis 已完结,Spring 已完结,Nginx已完结,Tomcat已完结,分布式服务已完结,Dubbo已完结,MySQL已完结,MongoDB已完结,Neo4j已完结,FastDFS 已完结,OSS已完结,GuavaCache已完结,EVCache已完结,RabbitMQ已完结,RocketMQ正在更新... 深入浅出助你打牢基础!

📊 大数据板块已完成多项干货更新(300篇):

包括 Hadoop、Hive、Kafka、Flink、ClickHouse、Elasticsearch 等二十余项核心组件,覆盖离线+实时数仓全栈! 大数据-278 Spark MLib - 基础介绍 机器学习算法 梯度提升树 GBDT案例 详解