图形化界面工具 - webUI 使用

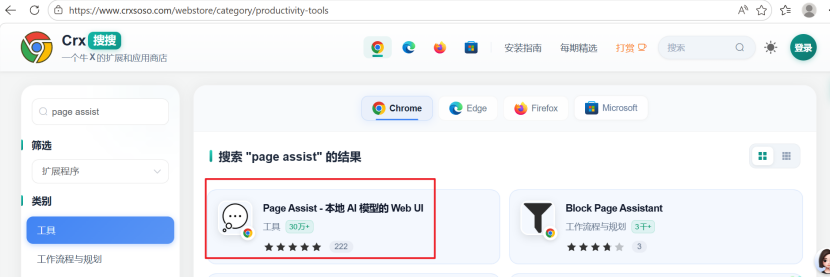

1、Page Assist 插件下载

安装 Page Assist 插件:本地 AI 模型的 Web UI 界面。

1 - 打开网站 Crx 搜搜:https://www.crxsoso.com

2 - 搜索:Page Assist,下载 crx 安装包

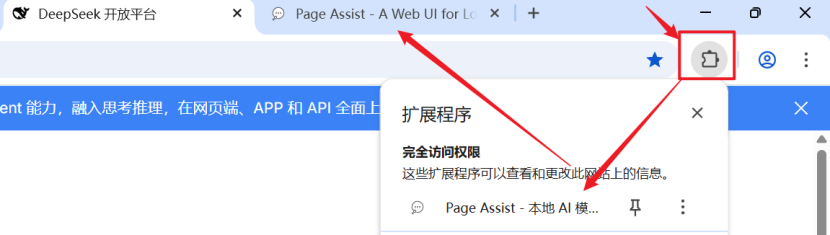

2、插件安装

谷歌浏览器打开:chrome://extensions/,右上角打开开发者模式,将下载好的 crx 文件拖入浏览器,完成插件的安装。

- 插件使用

1)启动 Ollama 服务

确保本地 Ollama 正在运行(WebUI 界面已显示 Ollama is running 即代表服务正常)。如果未启动,可在终端执行:

bash

ollama serve

2) 打开 WebUI 界面

点击 Chrome 浏览器右上角扩展程序图标,在列表中找到 Page Assist 并点击。

3) 基础对话使用

选择模型:在界面顶部 Select a Model 下拉框中,选择已下载的本地模型(如 deepseek-r1:8b、qwen3-vl:8b 等)。

选择提示词模板(可选):在 Select a Prompt 下拉框中,可选择预设的对话模板(如总结、翻译、代码助手等),也可直接使用默认。

发起对话:在底部输入框 Type a message... 中输入问题,按回车发送,即可与本地 AI 模型对话。

4)网页辅助功能(核心场景)

网页内容总结/提问:打开任意网页后,点击 Page Assist 插件,AI 可自动读取当前网页内容,帮你总结、提取重点或回答相关问题。

翻译/润色:选中网页上的文本,右键菜单中选择 Page Assist 相关选项,可快速翻译或润色文字。

代码辅助:在 GitHub、Stack Overflow 等技术页面,可直接让 AI 解释代码、生成注释或优化逻辑。

5.)高级设置

点击界面右上角 ⚙️ 图标,可进入设置页:

配置 Ollama 服务地址(默认 http://localhost:11434,无需修改)。

自定义提示词模板、调整生成参数(温度、最大 tokens 等)。

管理已下载模型、切换模型版本。

6.)常见问题排查

若显示 Ollama is not running:检查终端是否执行 ollama serve,或确认 OLLAMA_HOST 环境变量配置正确。

若模型列表为空:执行 ollama pull 模型名 下载模型,或重启 Ollama 服务后刷新 WebUI。

若插件无响应:在 chrome://extensions/ 页面关闭再开启 Page Assist 插件,或重新加载扩展。

7)核心使用场景示例

|------------|-----------------------------------------------|

| 场景 | 操作步骤 |

| 总结长文章 | 打开文章页 → 点击 Page Assist → 输入「总结这篇文章的核心观点」 |

| 代码解释 | 打开代码页面 → 选中代码片段 → 右键 → Page Assist → 「解释这段代码」 |

| 网页翻译 | 选中外文文本 → 右键 → Page Assist → 「翻译成中文」 |