用矩阵形式理解全连接网络

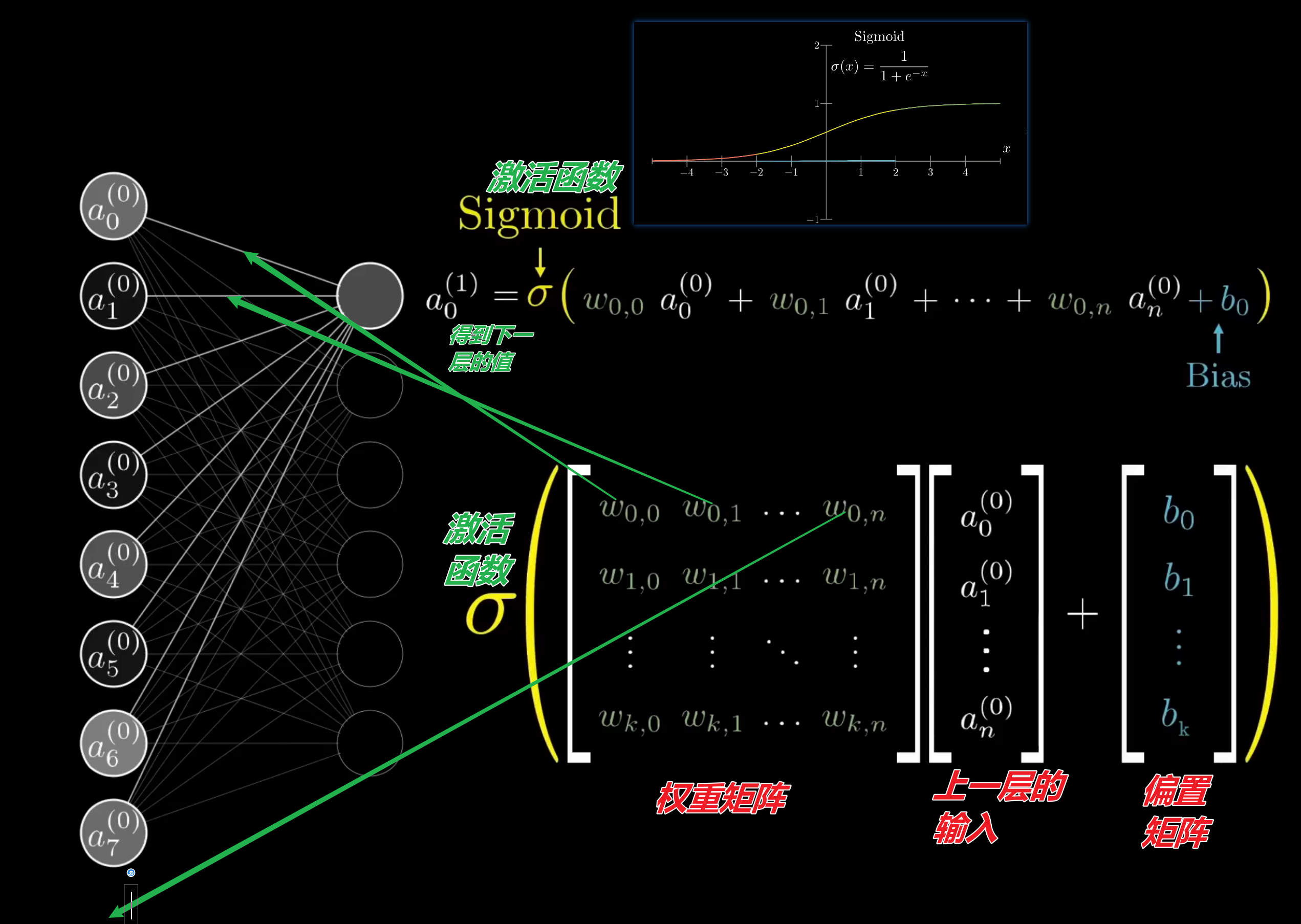

偏置矩阵:训练完成后,每个神经元的偏置项 b 会学习到一个具体的数值。这个数值的作用是控制神经元激活的"阈值" ,或者说为模型的输出提供一个"基准线"。在线性变换 z = Wx + b 中,偏置 b 实现了对决策边界的平移(translation) 。这意味着,即使输入 x 为零或很小,神经元也可能因为一个正的偏置值而被激活(例如,在ReLU函数中输出正值),反之亦然。这使得模型的决策边界不必强制通过坐标原点,极大地增强了模型的表达能力

输出:

在图像分类任务中,对于一个需要识别0-9数字的神经网络,其输出确实是十个数值,这十个数值通常被解释为输入图片分别属于这十个类别的概率

具体来说,神经网络的输出层会设计为具有十个神经元,每个神经元对应一个数字类别(0, 1, 2, ..., 9)

。然而,这些神经元直接输出的原始值(通常称为"logits"或"得分")并不能直接作为概率,因为它们可能为任意实数,且总和不一定为1。为了将其转化为符合概率公理(每个值≥0且总和为1)的预测概率分布,需要经过一个称为 Softmax 的激活函数处理。

Softmax函数的工作原理是对每个原始输出值进行指数运算,确保其变为正数,然后除以所有指数值的总和,从而实现归一化

。例如,假设网络最后一层线性运算后的输出向量为 [2.0, 1.0, 0.1, ...],经过Softmax处理后,可能变为 [0.659, 0.288, 0.053, ...]。这表示模型预测该图片是数字"0"的概率为65.9%,是数字"1"的概率为28.8%,是数字"2"的概率为5.3%,以此类推。