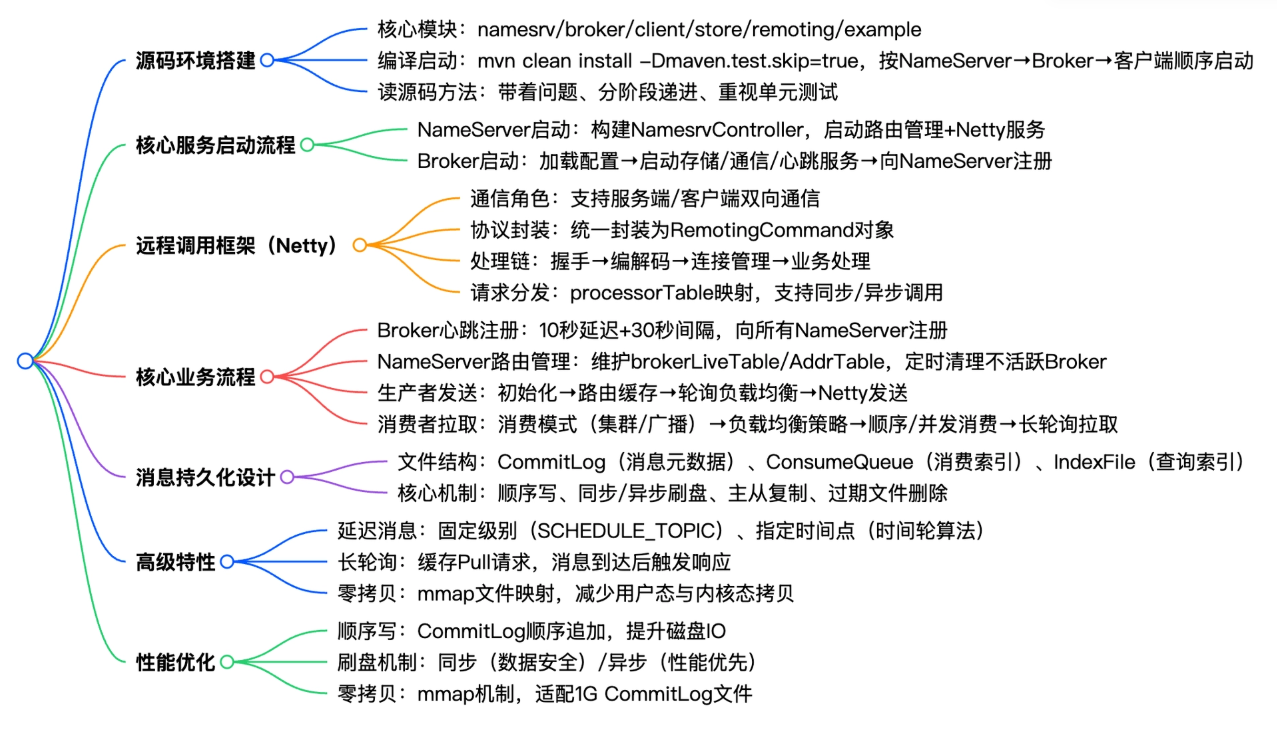

在掌握 RocketMQ 的基础使用与集群部署后,深入其源码层面理解底层实现逻辑,是解锁高吞吐、高可用、高性能"三高"特性的关键。本文基于 RocketMQ 5.3.0 版本源码,从环境搭建、核心流程、关键机制到性能优化手段,全面拆解其服务端与客户端的核心设计,帮助开发者从"会用"升级到"懂原理"。

一、源码环境搭建:从编译到调试

1.1 核心功能模块

RocketMQ 源码结构清晰,核心模块各司其职,关键模块如下:

- namesrv:命名服务模块,负责 Broker 注册与路由管理;

- broker:核心服务模块,承载消息存储、转发、持久化等核心功能;

- client:客户端模块,包含生产者、消费者相关实现类;

- store:消息存储模块,负责 CommitLog、ConsumeQueue 等文件的管理;

- remoting:远程通信模块,基于 Netty 实现跨进程 RPC 调用;

- example:示例代码模块,提供快速上手的参考案例。

源码获取地址:Apache RocketMQ 官方仓库 或 官网下载页面。

1.2 源码编译与启动

- 编译命令 :导入 IDEA 后,执行 Maven 编译指令

clean install -Dmaven.test.skip=true,跳过测试用例加速编译; - 服务启动顺序 :

- 启动 NameServer:运行

namesrv模块的NamesrvStartup类,可通过c参数指定配置文件; - 启动 Broker:运行

broker模块的BrokerStartup类,通过c参数指定broker.conf配置文件; - 启动客户端:通过

example模块的生产者/消费者示例代码验证服务可用性。

- 启动 NameServer:运行

1.3 读源码的核心方法

- 带着问题读:聚焦核心业务场景(如消息发送、负载均衡),避免陷入细节冗余;

- 分阶段递进:从"热身阶段"(服务启动流程)到"小试牛刀"(简单业务逻辑),再到"融汇贯通"(复杂机制),逐步深入;

- 重视单元测试:源码中的测试用例是理解功能设计的重要参考,可辅助验证逻辑猜想。

二、热身阶段:核心服务启动流程

2.1 NameServer 启动过程

NameServer 作为 RocketMQ 的"路由中枢",启动核心是构建 NamesrvController 对象,其核心组件包括:

- 配置类 :

NamesrvConfig(命名服务配置)、NettyServerConfig(Netty 服务配置); - 业务组件 :

RouteInfoManager(路由信息管理)、BrokerHousekeepingService(Broker 状态管理); - 通信组件 :

NettyRemotingServer(Netty 服务端)、NettyRemotingClient(Netty 客户端,5.x 新增)。

启动关键日志:The Name Server boot success. serializeType=JSON, address 0.0.0.0:9876,表示服务启动成功并监听 9876 端口。

2.2 Broker 启动过程

Broker 是业务核心,启动流程围绕 BrokerController 对象展开,核心包括:

- 配置加载 :加载

BrokerConfig(服务配置)、MessageStoreConfig(存储配置)、NettyServerConfig(默认监听 10911 端口)等; - 核心服务启动 :

messageStore:消息存储组件,负责消息持久化;timerMessageStore:时间轮服务,处理延迟消息;remotingServer/fastRemotingServer:两个 Netty 服务端,支持 VIP 通道(默认 10909 端口);registerBrokerAll:向所有 NameServer 注册心跳,默认 30 秒间隔。

启动关键日志:The broker[xxxxx] boot success. serializeType=JSON and name server is localhost:9876,表示 Broker 成功注册到 NameServer。

三、小试牛刀:核心业务流程源码解析

3.1 基于 Netty 的远程调用框架

RocketMQ 的跨进程通信基于 Netty 封装,核心设计如下:

- 通信角色:组件既可为服务端(如 Broker 响应客户端请求),也可为客户端(如 Broker 向 NameServer 注册心跳),支持双向通信;

- 协议封装 :所有 RPC 请求统一封装为

RemotingCommand对象,包含code(响应码)、opaque(请求 ID)、customHeader(业务头)、body(请求体)等属性; - 处理链构建 :服务端通过

ChannelPipeline构建处理链,核心流程为:握手 → 编解码 → 连接管理 → 业务处理; - 请求分发 :通过

processorTable(服务码 → 处理器映射)分发请求,支持同步/异步调用:- 同步调用:通过

CountDownLatch阻塞线程,等待响应; - 异步调用:通过

responseTable缓存结果,客户端后续主动查询。

- 同步调用:通过

3.2 Broker 心跳注册与 NameServer 路由管理

- Broker 心跳机制:启动后 10 秒延迟,30 秒间隔向所有 NameServer 发送心跳,携带 Broker 地址、Topic 路由等信息;

- NameServer 路由维护 :通过

RouteInfoManager维护brokerLiveTable( Broker 存活表)和brokerAddrTable(Broker 地址表),并启动定时任务(默认 10 秒间隔)清理不活跃 Broker; - 极简注册中心设计:NameServer 之间不同步信息,依赖 Broker 多播注册,牺牲数据一致性换取轻量性,只要有一个 NameServer 存活即可提供服务。

3.3 生产者发送消息流程

- 启动准备 :通过

MQClientFactory初始化客户端,启动定时任务更新路由信息,维护本地topicPublishInfoTable缓存; - 负载均衡策略 :默认轮询 Topic 下的所有 MessageQueue,跳过上次失败的 Broker;支持通过

MessageQueueSelector指定队列,保证局部消息有序; - 核心流程 :

DefaultMQProducerImpl.send()→ 获取路由信息 → 选择 MessageQueue→ 通过 Netty 发送请求 →Broker 处理并返回结果。

3.4 消费者拉取消息流程

RocketMQ 的"推模式"本质是"定时拉模式",核心设计如下:

- 消费模式 :

- 集群模式:Offset 存储在 Broker(

RemoteBrokerOffsetStore),消息仅被组内一个消费者消费; - 广播模式:Offset 存储在本地(

LocalFileOffsetStore),消息推送给组内所有消费者;

- 集群模式:Offset 存储在 Broker(

- 负载均衡策略 :通过

AllocateMessageQueueStrategy接口实现,默认提供 6 种策略(如平均分配、轮询分配、一致性哈希分配),核心是"一个 MessageQueue 仅被一个消费者消费"; - 顺序消费 vs 并发消费 :

- 并发消费:

ConsumeMessageConcurrentlyService,多线程并行消费,不保证顺序; - 顺序消费:

ConsumeMessageOrderlyService,对 MessageQueue 加锁,保证同一队列消息顺序处理;

- 并发消费:

- 核心流程 :

PullMessageService定时拉取 →Broker 返回消息 → 提交消费 Offset→ 触发下一次拉取。

3.5 客户端负载均衡总结

| 角色 | 负载均衡逻辑 | 核心目标 |

|---|---|---|

| 生产者 | 轮询 MessageQueue,跳过失败 Broker | 消息均匀分布,提升吞吐量 |

| 消费者(集群模式) | 按策略分配 MessageQueue,实例变更时重新均衡 | 消息不重复消费,负载分摊 |

| 消费者(广播模式) | 所有消费者订阅全部 MessageQueue | 消息全量投递 |

四、融汇贯通:核心机制深度解析

4.1 消息持久化设计

RocketMQ 通过"日志文件 + 索引文件"的结构实现高效持久化,核心组件如下:

- 文件结构 :

CommitLog:存储消息元数据,所有 Topic 消息顺序写入,单个文件固定 1G,文件名即起始偏移量;ConsumeQueue:消费逻辑队列,每个 MessageQueue 对应一个文件,存储消息在 CommitLog 的偏移量、大小、Tag 哈希值,加速消费检索;IndexFile:索引文件,支持按消息 Key 或时间戳查询,辅助消息轨迹等功能;- 辅助文件:

checkpoint(刷盘时间戳)、abort(服务状态标识)、config/*.json(配置与 Offset 存储)。

- 核心机制 :

- 顺序写:CommitLog 采用顺序写机制,避免磁盘寻道,提升写入性能;

- 刷盘策略:支持同步刷盘(

SYNC_FLUSH,消息写入 PageCache 后立即刷盘,数据安全)和异步刷盘(ASYNC_FLUSH,批量刷盘,性能更高); - 主从复制:Master 通过

GroupTransferService将 CommitLog 同步到 Slave,支持同步复制(Master 等待 Slave 确认)和异步复制(Master 无需等待); - 过期文件删除:默认保留 3 天数据(

fileReservedTime配置),磁盘利用率达 72%(默认阈值)时触发强制删除。

4.2 延迟消息机制

RocketMQ 支持两种延迟消息类型,核心实现如下:

- 固定延迟级别 (18 级预设):

- 消息转发:生产者发送消息时指定

delayTimeLevel,Broker 将消息转发至系统 TopicSCHEDULE_TOPIC_XXXX对应的队列; - 定时投递:

ScheduleMessageService定时扫描延迟队列,延迟时间到后将消息转存回原 Topic,推送给消费者;

- 消息转发:生产者发送消息时指定

- 指定时间点延迟 :

- 消息转发:消息转发至系统 Topic

rmq_sys_wheel_timer; - 时间轮算法:通过

TimerWheel组件(类似时钟盘)管理延迟任务,按秒级精度划分 Slot,指针推进时触发到期消息投递,支持 7 天内延迟。

- 消息转发:消息转发至系统 Topic

4.3 长轮询机制

为解决 Push 模式的空轮询问题,RocketMQ 实现长轮询机制:

- 请求缓存 :Broker 接收 Pull 请求后,若暂无消息,将请求缓存至

pullRequestTable(Key 为topic@queueId); - 消息触发 :Producer 发送消息后,通过

ReputMessageService触发notifyMessageArriving,检查缓存的 Pull 请求并立即响应; - 超时保护:缓存请求默认超时时间为 15 秒,避免请求长期阻塞。

五、性能优化核心:零拷贝与顺序写

5.1 顺序写加速

磁盘顺序写无需寻道操作,性能接近内存级别。RocketMQ 的 CommitLog 采用固定 1G 文件大小,消息顺序追加写入,避免文件碎片,最大化磁盘 IO 效率。

5.2 刷盘机制与数据安全

- PageCache 缓存:应用程序写入消息先存入操作系统 PageCache(内存缓存),再由操作系统异步刷盘;

- 强制刷盘 :通过

fsync系统调用实现强制刷盘,同步刷盘模式下,消息写入后立即触发刷盘,保证断电不丢失; - Dirty Page 监控 :Linux 通过

/proc/meminfo监控脏页比例,达到阈值时自动刷盘,平衡性能与安全性。

5.3 零拷贝技术

零拷贝的核心是减少用户态与内核态之间的 CPU 拷贝,RocketMQ 主要采用 mmap 机制:

- mmap 文件映射 :通过

FileChannel.map()将 CommitLog 文件映射到堆外内存,用户态直接操作内核态数据,减少一次 CPU 拷贝; - 适用场景:RocketMQ 的 CommitLog 固定 1G 大小,适配 mmap 的 2G 限制,兼顾性能与稳定性;

- 与 Kafka 对比 :Kafka 大量使用

sendfile机制(内核态直接数据传输,无用户态参与),性能更高但灵活性不足;RocketMQ 使用 mmap,支持用户态数据处理,功能更丰富。

六、总结

RocketMQ 的源码设计围绕"三高"目标展开,核心亮点包括:

- 极简架构:NameServer 轻量无状态,Broker 主从备份,兼顾可用性与部署复杂度;

- 高效通信:基于 Netty 的 RPC 框架支持同步/异步调用,适配分布式场景;

- 存储优化:顺序写 + 零拷贝 + 分层索引,平衡写入性能与检索效率;

- 灵活机制:延迟消息、长轮询、多负载均衡策略,适配复杂业务场景。

深入理解这些源码设计,不仅能帮助开发者快速定位问题、优化性能,更能为分布式系统设计提供参考(如高并发场景的锁设计、数据一致性取舍、性能优化手段等)。后续可进一步探索事务消息、死信队列、Dledger 集群等高级功能的源码实现,全面掌握 RocketMQ 的核心能力。