序列模型

非序列模型:说人话 去快餐店点餐 点十个汉堡 你只要点厨师就会给你汉堡 这次点什么和之前没有关系;也就是这次事情的输出只依靠现在的输入不依靠之前的状态

序列模型: 说人话 已经点了红烧肉这次一般不会再推荐给吃红烧肉 即便你再要求

这次事情的输出 依靠之前的状态以及现在的输入 :

自回归模型: 说人话 用昨天的我集合预测今天的我,用如今的我的集合预测明天的我

两种情况:马尔科夫假设 潜变量

马尔可夫假设: 说人话 最近的三道菜预测下一道菜 只根据最近 三道菜红烧肉 回锅肉 把子肉 预测下一道菜还是肉

马尔科夫链代码实现说人话 固定看刚刚三道菜 红烧肉 红烧肉 红烧肉 数字化为1 1 1 将三道菜通过f感知为具体感受去**预测xt 【再来一盘子红烧肉】**发生的概率

在MLP中 p(xt∣xt−τ,...,xt−1)p(x_t | x_{t-\tau}, \dots, x_{t-1})p(xt∣xt−τ,...,xt−1) 其中 p(xt−τ,...,xt−1)p(x_{t-\tau}, \dots, x_{t-1})p(xt−τ,...,xt−1) 体现就是既定事实 【将红烧肉 1,1,1 】 在这个既定事实下进行预测p(x1) 更甚一步 p(xt∣f(xt−τ,...,xt−1))p(x_t | f(x_{t-\tau}, \dots, x_{t-1}))p(xt∣f(xt−τ,...,xt−1)) 加了f就变成了对这些输入的感知下 xt发生的概率

马尔科夫链本质还是固定输入数量【向量】【将红烧肉固定为 1,1,1 】;感知;矩阵感知 【W * H + b】 非线性激活函数[ relu ] 通过概率函数预测某道菜概率 发现不符合实际更新权重

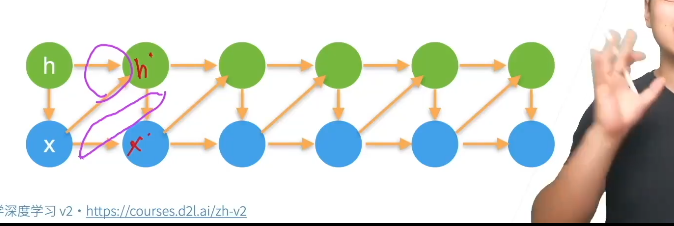

潜变量模型: 不会记下来你之前吃的菜 根据之前的记录 f化来感知 + 这次点菜信息输入 预测你想要吃酸的 根据本子的旧记录【前面状态】+ 这次新输入 来预测输出

潜变量模型:代码说人话 : 刚刚开始随机概率 第一道菜红烧肉 模型:序列感知更新 通过新的感知f + 上一次点的红烧肉信息 预测这一次客户点什么呢

为什么 h'感知被x更新了 还要通过x + h' 实现预测客户点啥菜?

- 信息不要丢失

- 最近发生的对下一刻发生的事情预测权重一般最大

- 必须看最近在做什么

对之前的输入序列的感知【矩阵运算+ 激活函数】 然后在这个感知下 进行预测概率 如果不对就更新感知权重 潜变量是一个不断增加时间输入的感知机 马尔科夫假设

x是向量 预测一个标量 通过每个警察的特征感觉 一个感知机【MLP】

预测一个标量 通过每个警察的特征感觉 一个感知机【MLP】