序章:一个聊天的诞生

2022年11月30日,一个平平无奇的周三,硅谷一家名为OpenAI的公司悄悄上线了一个产品------ChatGPT。没有人想到,这个能像真人一样聊天的对话框,将点燃一场持续至今的技术革命。

从那时起,AI从一个实验室里的玩具,变成了街头巷尾的热议。而到了2026年,Open Claw 的大范围应用,标志着AI真正从"对话者"进化成了"执行者"。这短短三年的时间里,无数关键概念涌现又迭代,从最早的对话型,到如今2026年3月已经深耕于各行各业开始替代人进行工作,这中间经历了什么?本篇文章为您揭示。

第一阶段:破冰(2022---2023)------LLM与幻觉

什么是LLM(大语言模型)?

ChatGPT 3.5的发布标志着AI从"识别分析"向"创造生成"的根本性转变。这款基于GPT-3.5架构的对话式AI在没有任何大规模营销的情况下,仅用5天就突破了百万用户,2个月后月活跃用户突破1亿,成为史上用户增长速度最快的消费级应用程序。

ChatGPT 3.5 的核心,是一个 LLM(Large Language Model,大语言模型)。你可以把它理解为一个"超级接龙游戏玩家"。

-

训练方式:在互联网上数万亿字的文本中,学习"在给定上文的情况下,下一个词最可能是什么"。

-

本质:它不是"理解",而是"概率预测"。当它输出一句话时,每一步都在计算:"以目前的内容来看,哪个词接上去最合理?"

正是这种机制,赋予了它惊人的流畅性,也埋下了后续所有问题的种子。

伴随而来的"幻觉"

幻觉(Hallucination):指AI生成看似合理、实则与事实不符或完全虚构的内容。

早期的ChatGPT自信满满地编造参考文献、虚构历史事件、杜撰名人名言。用户问"某某学者的某篇论文讲了什么",它能洋洋洒洒写出摘要,但论文可能根本不存在。

这不是bug,而是LLM的"天性"------它只追求"语言上合理",不追求"事实上真实"。如何驯服幻觉,成了此后两年技术攻坚的核心命题。

而一个底层大模型的好坏的指标之一就是AI反馈的准确性,幻觉问题则是技术人必须逾越的大门槛。我们可以很明显地感受到,2023-2024年,当你询问某个精确领域问题的时候,AI一本正经胡说八道的概率非常高,而到2026年,在大多数情况下,AI面对某个知识盲区时会明确地告诉用户,这个我不知道。从一定要有正向的反馈到如今的实事求是,只有两年时间。但目前AI幻觉仍是AI开发工程师和运用工程师面临的挑战。

幻觉产生的原因

-

自回归生成机制的本质

大模型基于概率预测逐个生成 token,本质上是在做"续写",也就是它没有人的自主决策,有的只有next Token。它追求的是连贯性 和统计合理性 ,而非事实真实性。即使训练数据中不存在某个事实,模型也可能"编造"出逻辑自洽的内容来填补空缺。

-

训练数据与知识边界

-

模型训练时只能"见过"有限的公开数据,无法实时更新知识。

-

训练数据本身可能包含错误、偏见或过时信息,模型会无差别学习。

-

模型没有真正的"记忆"或"理解",所有知识都以参数形式模糊存储,无法精确追溯来源。

-

-

缺乏内建的真理检验机制

传统模型在被训练时,优化目标是"下一个词预测的准确性",而不是"陈述的真实性"。模型无法在生成时主动判断一句话是否与客观事实一致。

-

指令理解与意图对齐不足

当用户提问模糊、超出模型能力范围,或隐含了矛盾信息时,模型会强行给出一个看似完整的答案,而不是坦承"不知道"。

-

长尾知识与过度泛化

在长对话过程中,AI会基于自己的训练数据,根据用户的指令进行思考回答,在回答的过程中模型回复的内容会反过来引导模型往一个方向继续深入,它会基于相似案例"类推"出似是而非的内容,导致事实性错误。

第二阶段:进化(2023---2024)------从单轮到复杂,MCP与Agent的萌芽

模型的"感官扩展"

2023年下半年开始,AI不再满足于"文字接龙"。多模态模型让AI能"看见"图片、"听懂"语音。但更重要的是,人们开始思考:如果AI只能输出文字,它永远是个旁观者。

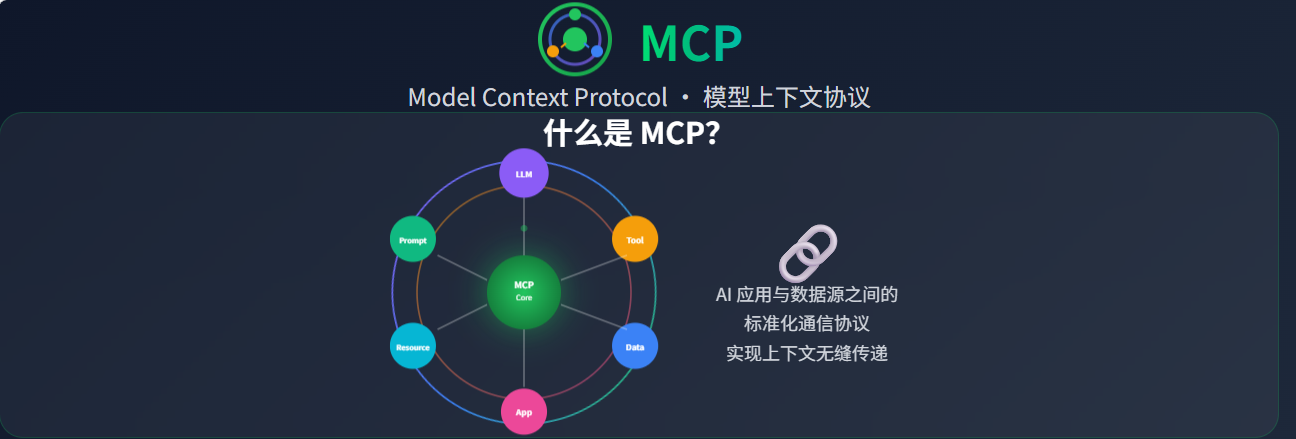

于是,MCP(Model Context Protocol,模型上下文协议) 应运而生。

什么是MCP?

MCP可以理解为AI的"USB-C接口"------一个标准化的协议(模型上下文协议),让大语言模型能够安全、规范地与外部世界交互:

-

调用API查询实时天气

-

操作数据库读取订单信息

-

执行代码运行数据分析

-

控制智能家居开关

有了MCP,AI不再被囚禁在对话框里。它第一次拥有了"手"和"眼睛"以外的"工具使用权"。

MCP解决了什么问题?

如何让AI模型与各种外部工具、数据源和应用程序进行标准化、无缝化的交互?在MCP出现之前,每集成一个新的工具或数据源,都需要编写专门的接口代码,这不仅耗时耗力,而且难以扩展。

MCP的核心思想是建立一个标准化的通信协议,让AI模型能够以统一的方式与各种外部系统进行交互。这个协议定义了模型如何发送请求、如何接收响应、如何管理状态以及如何处理错误。无论后端是数据库、云存储、API服务还是其他任何系统,只要遵循MCP协议,AI模型就能够轻松地与其进行交互。这种设计理念极大地简化了AI系统的集成复杂度,使得开发者可以更加专注于业务逻辑本身,而非底层接口的适配工作。

核心痛点:

-

集成复杂性:传统方式需要为每个模型-工具组合编写定制代码

-

数据孤岛:大模型无法直接访问实时、专有数据

-

工具复用性:缺乏统一的工具调用标准

Agent的雏形

当LLM+MCP的组合开始被封装成能够自主规划、执行、纠错 的实体时,Agent(智能体) 的概念开始清晰。

一个Agent不再是"你问一句,它答一句"的被动工具,而是:

-

接收一个目标(比如"帮我订周五晚上7点适合约会的餐厅")

-

自主拆解任务(调用地图MCP查餐厅→筛选评分→查看日历MCP确认时间→调用短信MCP发确认信息)

-

处理异常(如果第一家订满,自动找备选)

-

完成闭环

2024年,Agent化的浪潮席卷硅谷。人们意识到:未来的AI不是"软件",而是"数字员工"。

第三阶段:精炼(2024---2025)------Agent Skills与对抗噪声

Agent Skills:让Agent成为专家

早期的Agent虽然能调用工具,但每个任务都需要大模型临时"思考"该用什么工具、怎么用,既慢又容易出错。

Agent Skills(智能体技能) 的出现解决了这一问题。它相当于为Agent预装了"技能包":

-

一个"Excel分析师技能"包含了数据处理、透视表生成、图表绘制的最佳实践路径

-

一个"邮件助理技能"包含了邮件分类、优先级排序、自动回复的完整工作流

Skills让Agent从"什么都会一点但都不精",进化成"在特定领域拥有标准化、高效率的执行能力"。你可以理解为:LLM是大脑,Skills是经过训练的肌肉记忆。

噪声:Agent世界的"雾霾"

随着Agent自主性越来越强,一个新的问题凸显出来------噪声(Noise)。

在AI语境下,噪声指:

-

输入噪声:用户指令模糊、信息残缺、前后矛盾

-

环境噪声:API返回的数据格式混乱、网络延迟、第三方服务返回意外结果

-

执行噪声:Agent在多步操作中,某一步的错误被不断放大

举例:你让Agent"帮我订机票",它查询时恰好遇到航空公司官网临时维护,返回了一串错误代码。如果没有良好的噪声处理机制,Agent可能就此卡死,或者误以为"没有航班"并告诉你错误结论。

2024---2025年,顶尖的AI团队将大量精力投入在抗噪声架构上------让Agent能够识别噪声、过滤噪声、在噪声中保持稳定。

一个完整的AI智能体系统包含以下关键组件:

-

LLM(大脑):负责语言理解、推理和生成

-

记忆模块:包括短期记忆(对话历史)、长期记忆(用户偏好)和工作记忆(当前任务状态)

-

RAG检索增强生成:结合信息检索和文本生成,访问外部知识库

-

MCP模型上下文协议:标准化连接器,连接AI应用与外部系统

-

Tools工具:原子操作能力,如文件操作、API调用

-

Skills技能:复合工作流,协调多个工具完成复杂任务

-

ReAct推理与行动:决策引擎,生成推理轨迹并执行任务

第四阶段:融合(2025---2026)------Open Claw与Agent的普及

什么是Open Claw?

Open Claw 并非一个单一的模型,而是一个开源Agent操作系统生态。它整合了过去三年所有的技术积累:

-

底层是高性能的LLM(支持本地部署与云端混合)

-

中层是标准化的MCP协议,兼容数千种工具和API

-

上层是丰富的Agent Skills市场,企业和个人可以下载、定制、上传技能

-

核心是强大的噪声处理与自我纠错引擎

"Claw"(爪子)这个名字寓意着AI终于有了"抓取世界、操作世界"的能力。而"Open"则标志着这场技术不再属于少数巨头------开源社区的力量让任何开发者都能构建自己的Agent。

2026年:大范围运用

到2026年,Open Claw的生态已经渗透进各行各业:

| 领域 | 应用场景 |

|---|---|

| 个人助理 | 一个Agent管理全家的日历、邮件、电商退换货、旅行规划 |

| 软件开发 | 代码Agent根据需求文档直接生成PR,并自动跑测试、修bug |

| 金融分析 | 多个Agent协同,实时监控市场、生成报告、执行交易策略 |

| 医疗辅助 | 病历整理Agent、文献检索Agent、用药提醒Agent形成医护网络 |

| 制造业 | 工业Agent通过MCP连接PLC系统,预测性维护、调度生产计划 |

重要的是,用户不再需要"学习使用软件"------你只需要用自然语言告诉Open Claw你想要的结果,它自己会调动合适的Agent、加载对应的Skills、通过MCP操作工具,最终交付成果。

概念全景图

为方便理解,这里将所有核心概念串联成一个比喻:

LLM(大语言模型) 是大脑。

MCP(模型上下文协议) 是神经系统,连接大脑与四肢。

Agent(智能体) 是一个完整的人,能思考、能行动。

Agent Skills 是这个人的专业技能,比如"会弹钢琴""会做财务报表"。

噪声 是工作中的干扰------电话铃、模糊的指令、错误的信息。

幻觉 是这个人大脑偶尔的"脑补",把没发生过的事说得言之凿凿。