Xiaowen Zhang1^11, Zijie Yue1^11, Yong Luo2^22, Cairong Zhao3^33, Qijun Chen1^11, Miaojing Shi1,4∗^{1,4*}1,4∗

1^11 同济大学电子与信息工程学院

2^22 武汉大学计算机学院

3^33 同济大学计算机学院

4^44 自主智能无人系统全国重点实验室

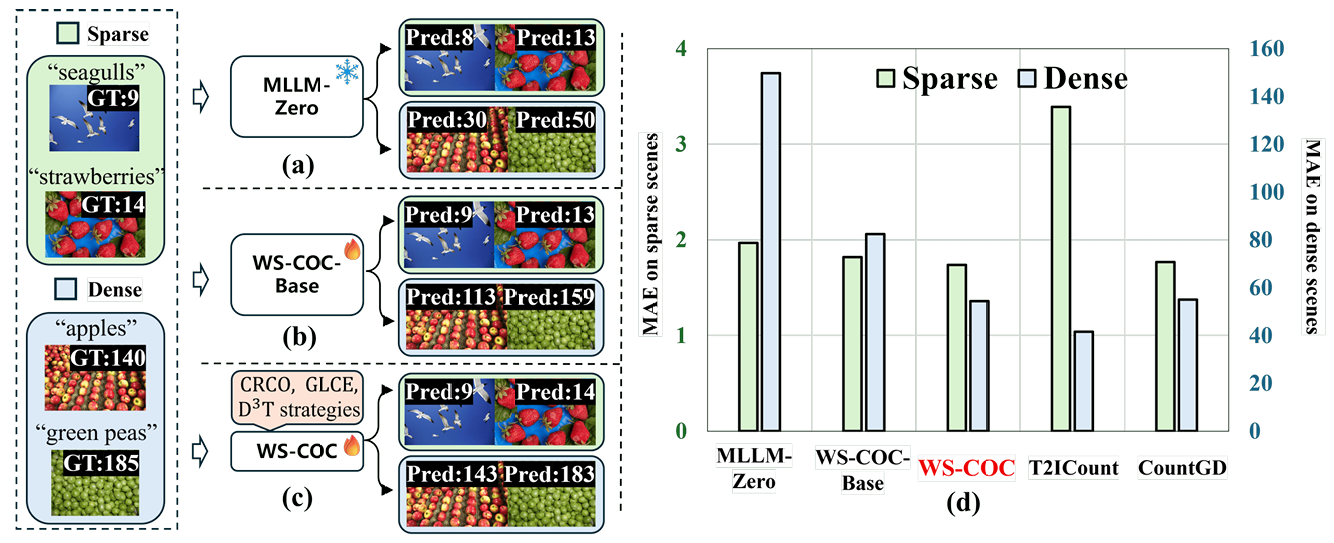

图 1: (a)- ( c) MLLM-Zero、WS-COC-Base 和 WS-COC 的可视化结果。(d) MLLM-Zero、WS-COC-Base、WS-COC 以及两种最先进的全监督计数方法(T2ICount (Qian et al., 2025) 和 CountGD (Amini-Naieni et al., 2024))在稀疏(每张图像最多 20 个实例)和密集(每张图像超过 100 个实例)物体场景上的 MAE 结果。WS-COC 显著优于 MLLM-Zero 和 WS-COC-Base,并产生了与 T2ICount 和 CountGD 具有竞争力的性能。实验基于 FSC-147 (Ranjan et al., 2021),MLLM 为 LLaVA-OneVision-7B (Li et al., 2024)。

https://arxiv.org/pdf/2602.12774

摘要

物体计数是计算机视觉中的一项基本任务,在许多现实世界场景中具有广泛的适用性。全监督计数方法需要每个物体昂贵的点级标注。少数弱监督方法仅利用图像级物体计数作为监督,并取得了相当有希望的结果。然而,它们通常仅限于计数单一类别,例如人。在本文中,我们提出了 WS-COC,这是第一个由多模态大语言模型(MLLM)驱动的弱监督类无关物体计数框架。我们没有直接微调 MLLM 来预测物体计数(由于模态差距,这可能具有挑战性),而是结合了三种简单而有效的策略来在训练和测试中引导计数范式:首先,提出了一种**分而辨之对话微调(divide-and-discern dialogue tuning, D3^33T)策略,引导 MLLM 判断物体计数是否落在特定范围内,并通过多轮对话逐步缩小范围。其次,引入了一种 比较与排序计数优化(compare-and-rank count optimization, CRCO)策略,训练 MLLM 根据物体计数优化多个图像的相对排序。第三,一种全局与局部计数增强(global-and-local counting enhancement, GLCE)**策略聚合并融合局部和全局计数预测,以提高密集场景中的计数性能。在 FSC-147、CARPK、PUCPR+ 和 ShanghaiTech 上的大量实验表明,WS-COC 匹配甚至超越了许多最先进的全监督方法,同时显著降低了标注成本。代码 available at https://github.com/viscom-tongji/WS-COC。

*通讯作者:mshi@tongji.edu.cn

1 引言

物体计数是指估计给定图像内目标实例数量的任务。传统方法 (Radford et al., 2021; Liu et al., 2022a; Amini-Naieni et al., 2023) 主要估计图像的密度图,其中对密度图的积分给出物体总数。密度图是通过用图像中每个物体的点标注卷积高斯核获得的。尽管这些全监督方法在各种计数基准 (Ranjan et al., 2021; Hsieh et al., 2017; Mundhenk et al., 2016) 上取得了强大的性能,但获取点级标注是劳动密集型和耗时的,特别是在数百或数千个物体共存甚至相互遮挡的密集场景中。

为了减轻高昂的标注成本,少数研究 (Wang et al., 2024; Yang et al., 2020; Lei et al., 2021) 探索了弱监督学习范式。他们利用图像级物体计数作为真值,学习从图像视觉特征到图像中目标实例总数的映射。现有的弱监督计数方法仍处于早期阶段,通常局限于单一物体类别,即人 (Yang et al., 2020; Lei et al., 2021; Xiong et al., 2022)。受益于视觉 - 语言对的大规模预训练,多模态大语言模型 (MLLMs) 的最新进展为以文本提示方式的类无关物体计数提供了新的机会,其中文本提示指定感兴趣的目标类别,然后转换为适当的指令。结合相应的图像,这些多模态指令被输入到 MLLM 中以自回归方式预测物体计数。这呈现了一个基于 MLLM 的基本物体计数流程。我们首先在一个标准物体计数基准 FSC-147 (Ranjan et al., 2021) 上评估此流程(即 MLLM-Zero), without any fine-tuning。如图 1(a) 所示:我们观察到它确实在稀疏场景中产生了合理的估计,但其性能在密集场景中显著下降。这可以直观地解释为 MLLM 在其预训练语料库中主要见到的是稀疏而非密集的物体分布。鉴于 MLLM 潜在的计数能力,本研究旨在探索如何以最小的微调成本将这种潜力扩展到准确的类无关物体计数。

在本文中,我们引入了一个弱监督类无关物体计数网络 WS-COC,它仅使用图像级计数监督来引导 MLLM 进行物体计数。一个朴素的基线(即 WS-COC-Base)是直接微调 MLLM 以从给定图像预测物体计数。然而,如图 1(b) 所示,由于缺乏物体分布监督,学习直接映射是困难的;特别是在密集场景中,这仍然导致明显的低估。为了解决这个问题,我们引入了三种简单而有效的策略:

- 首先,我们不一次性回归确切计数,而是引入了一种分而辨之对话微调 (D3^33T) 策略,引导 MLLM 判断计数是否落在某个范围内,并逐步从大到小分解范围。这种多步推理帮助 MLLM 从易到难学习计数。当范围足够小时,我们要求模型预测实际物体计数;

- 其次,由于视觉和文本之间的模态差距,直接针对真值优化预测计数仍然具有挑战性。相反,引导 MLLM 判断图像之间的相对计数差异可以在视觉上更容易探测。受此启发,我们引入了一种比较与排序计数优化 (CRCO) 策略,训练 MLLM 根据物体计数预测多个图像的相对排序。

- 最后,在推理过程中,为了进一步减轻密集人群中的计数偏差,我们引入了一种全局与局部计数增强 (GLCE) 策略。我们首先预测给定图像的全局计数,然后将输入图像划分为更小的子图像,独立查询每个子图像以获得局部计数。融合全局和局部计数以获得最终计数。

如图 1(d) 所示,通过实施这些策略,我们显著增强了 MLLM 的数量意识,导致计数误差大幅减少,特别是在密集条件下。我们在四个广泛使用的基准上进行了大量实验:FSC-147 (Ranjan et al., 2021)、CARPK (Hsieh et al., 2017)、PUCPR+ (Hsieh et al., 2017) 和 ShanghaiTech (Zhang et al., 2016)。我们的方法作为第一个 MLLM 驱动的弱监督物体计数方法,在与最先进的全监督物体计数方法 (Pelhan et al., 2024; Zhu et al., 2024; Hui et al., 2024) 相当的水平上产生了令人惊讶的好结果。

2 相关工作

2.1 物体计数

现有的计数方法大致可分为类特定和类无关方法,取决于它们是否可以计数任意物体类别。

类特定物体计数旨在预测特定类别的物体数量,例如人 (Ranasinghe et al., 2024; Guo et al., 2024; Peng & Chan, 2024; Wu & Yang, 2023; Du et al., 2023; Liu et al., 2022b; Shi et al., 2019)、车辆 (Hsieh et al., 2017; Mundhenk et al., 2016)、细胞 (Xie et al., 2018)、鱼 (Sun et al., 2023) 等。传统方法通常是基于检测的 (Liu et al., 2023; Liang et al., 2022; Liu et al., 2019) 或基于回归的 (Ranasinghe et al., 2024; Guo et al., 2024; Peng & Chan, 2024; Wu & Yang, 2023; Li et al., 2023; Wang et al., 2020)。前者检测每个单独实例的边界框,并将物体计数获得为边界框的数量;后者估计给定图像的密度图,并通过在密度图上积分像素值获得物体计数。总体而言,类特定方法固有地局限于某些物体类别,限制了它们的应用。

最近,提出了类无关计数 (Chattopadhyay et al., 2017; Lu et al., 2019; Xu et al., 2023) 方法来计数图像内任意类别的物体。常见的做法是提供视觉示例来指示目标类别 (Lu et al., 2019; Liu et al., 2022a; Pelhan et al., 2024),如 CounTR (Liu et al., 2022a),它融合图像和示例特征进行密度图估计。然而,由于手动选择示例需要大量的标注成本,一种新兴的方式是用使用类别名称指定目标物体类别的文本提示替换它们 (Xu et al., 2023; Amini-Naieni et al., 2024; Jiang et al., 2023; Kang et al., 2024; Zhu et al., 2024; Hui et al., 2024; Dai et al., 2024; Qian et al., 2025; Zhai et al., 2025; Shi et al., 2025)。例如,VLPG (Zhai et al., 2025) 利用 CLIP (Radford et al., 2021) 从给定图像中提取视觉嵌入,从文本提示中提取文本嵌入,然后通过交叉注意力融合它们进行密度图估计。

到目前为止,大多数物体计数方法采用全监督学习范式,其中模型使用点级标注进行训练。为了降低标注成本,少数方法 (Yang et al., 2020; Meng et al., 2021; Lei et al., 2021; Xiong et al., 2022; Wang et al., 2024) 探索了弱监督学习范式,其中仅提供图像级物体计数作为真值。例如,Xiong et al. (2022) 利用视觉变换器 (ViT) 从图像中提取多尺度视觉特征,并将它们直接映射到人计数。GCNet (Wang et al., 2024) 利用预训练的 ResNet (He et al., 2016) 计数图像中出现最频繁的物体类别。这些基于 CNN 或 ViT 的初步探索局限于类特定物体计数;而我们新颖地利用 MLLM 实现类无关物体计数。

2.2 多模态大模型

早期的多模态大模型,通常称为视觉 - 语言模型 (VLMs),如 CLIP (Radford et al., 2021) 和 BLIP (Li et al., 2022),通过在视觉 - 语言对上的大规模预训练学习跨模态表示。它们通常执行视觉 - 语言对比学习和视觉 - 语言匹配以对齐视觉和文本模态,并已广泛用于多模态下游任务 (Jiang et al., 2023; Kang et al., 2024; Monsefi et al., 2024)。

近年来,多模态大语言模型 (MLLMs) (Liu et al., 2024a; Li et al., 2024; Bai et al., 2025) 作为 VLMs 的升级版出现,具有多模态推理和生成能力。通过 Incorporating 大语言模型 (LLMs) 作为核心语义理解和推理引擎,MLLMs 在广泛的任务中取得了显著成功,例如视觉问答 (Goyal et al., 2017) 和图像字幕 (Agrawal et al., 2019)。

几项研究 (Jiang et al., 2023; Qharabagh et al., 2024) 利用多模态大模型以文本提示方式解决物体计数问题。例如,CLIP-Count (Jiang et al., 2023)、VLPG (Zhai et al., 2025) 和 VLCounter (Kang et al., 2024) 微调预训练的 VLM,即 CLIP Radford et al. (2021),用于类无关计数。CLIP 和其他 VLMs 主要是判别模型,其中物体计数必须通过设计额外的计数头获得。我们的 WS-COC 则完全依赖 MLLM,其中物体计数可以自回归生成。值得注意的是,一些基于 VLM 的计数方法,如 CrowdCLIP (Liang et al., 2023),采用了一种看似与我们提出的比较与排序计数优化策略相似的排序策略,但存在关键差异。首先,Liang et al. (2023) 通过将单个图像裁剪成不同大小的子图像来构建图像集,假设较大的裁剪包含更多物体。相比之下,WS-COC 在同一类别内采样具有不同物体计数的不同图像。其次,Liang et al. (2023) 依赖于对比优化,而 WS-COC 直接使用语言建模损失生成排序。

3 预备知识

在本节中,我们首先提供 MLLM 的简要背景,然后在此基础上设计一个用于弱监督物体计数的基线模型。

多模态大语言模型。 针对视觉和语言的 MLLM 由视觉编码器、投影模块和 LLM 组成。它们接受图像 III 和文本指令 TinstT_{inst}Tinst 作为输入,并输出文本响应 TresT_{res}Tres。具体而言,视觉编码器从 III 中提取视觉特征。投影模块将这些特征转换为可以输入到 LLM 的特征。然后,LLM 基于投影的视觉特征和 TinstT_{inst}Tinst 的指令令牌执行语义理解和推理,以自回归方式生成 TresT_{res}Tres。MLLM 使用语言建模损失进行训练,该损失最小化 TresT_{res}Tres 和真值响应 TgtT_{gt}Tgt 之间的交叉熵。

基线。 我们设计了一个基线模型(即 WS-COC-Base),其中我们微调一个 MLLM,默认为 LLAVA-OneVision (Li et al., 2024),用于弱监督物体计数。具体而言,对于每个图像 III 及其全局物体计数 ccc,我们使用固定模板构建文本指令 TinstT_{inst}Tinst 和真值响应 TgtT_{gt}Tgt。TinstT_{inst}Tinst formulated as "How many [obj] are there in the image?"(图像中有多少个 [obj]?),而 TgtT_{gt}Tgt 遵循 "a photo of [num] [obj]"(一张 [num] 个 [obj] 的照片),其中 [num] 令牌被替换为 ccc,[obj] 令牌表示特定的物体类别。然后我们遵循基于 LoRA 的微调范式 (Hu et al., 2022) 来优化 MLLM。WS-COC-Base 的性能如图 1(d) 所示。

4 方法

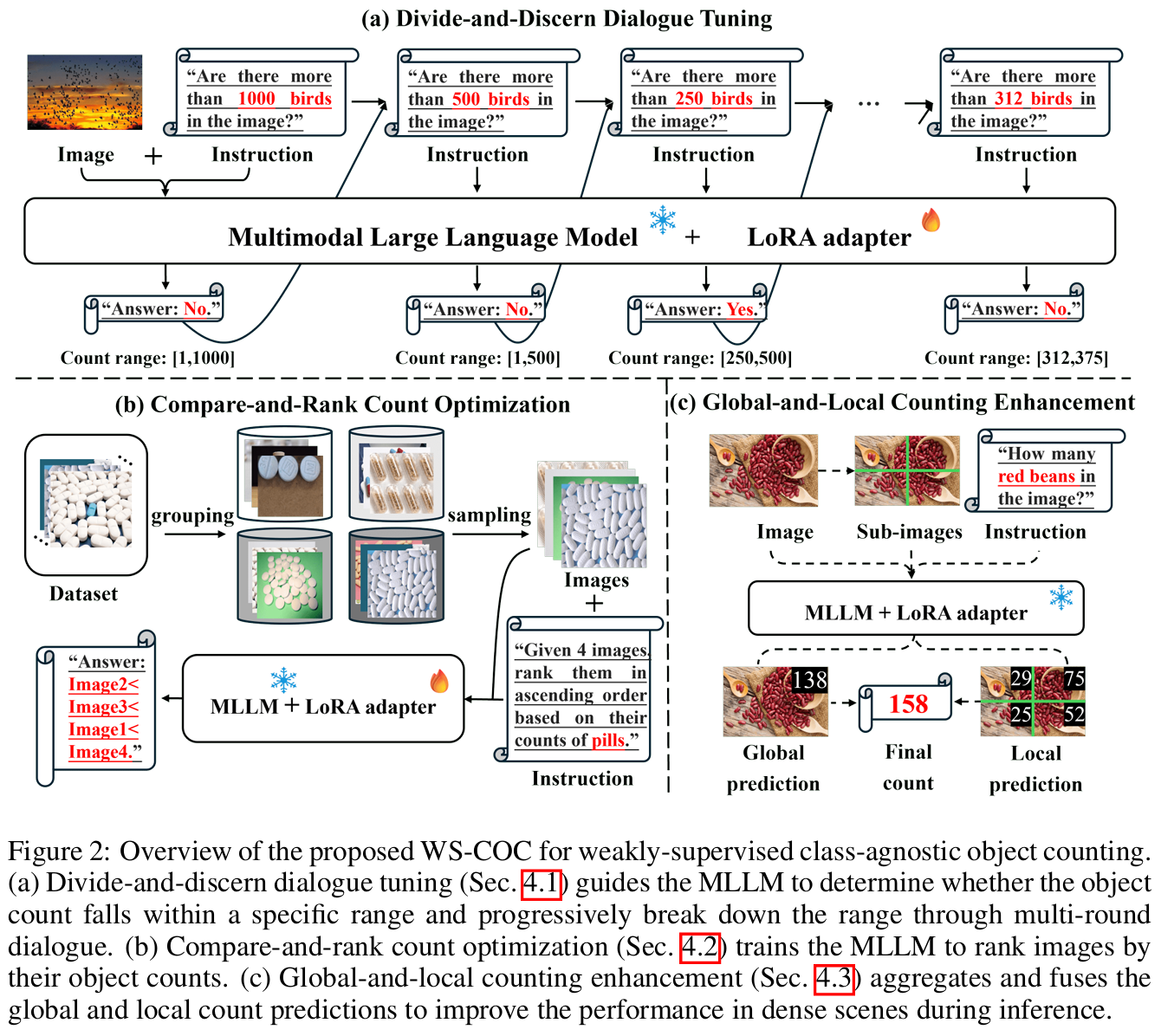

图 2 说明了我们提出的 WS-COC 的框架,其中我们仅使用图像级计数监督来引导 MLLM 进行弱监督物体计数。在基线模型的基础上,我们引入了三种简单而有效的策略:分而辨之对话微调、比较与排序计数优化和全局 - 局部计数增强。

4.1 分而辨之对话微调 (Divide-and-Discern Dialogue Tuning)

从图像学习预测绝对物体计数对于 MLLM 来说是困难的,特别是没有对单个物体的明确监督。为了应对这一点,我们将计数预测任务重新 formulat 为一系列范围判断任务:我们不一次性回归确切计数,而是引导模型通过多轮对话迭代地确定计数是否落在特定范围内。通过从粗到细逐步分解范围,模型能够以课程方式学习计数,从易到难。

具体而言,给定图像 III 及其全局物体计数 ccc,我们为第一轮对话设置初始范围 [L1,U1][L_1, U_1][L1,U1],例如 FSC-147 数据集 (Ranjan et al., 2021) 中的最小和最大物体计数 [1,2000][1, 2000][1,2000]。我们计算该范围的中点 τ1=⌊L1+U12⌋\tau_1 = \lfloor \frac{L_1 + U_1}{2} \rfloorτ1=⌊2L1+U1⌋ 并使用模板 "Are there more than τ1\tau_1τ1 [obj] in the image?"(图像中是否有超过 τ1\tau_1τ1 个 [obj]?)构建文本指令 Q1Q_1Q1,其中 [obj] 令牌被替换为目标物体类别。如果 c>τ1c > \tau_1c>τ1,则真值响应 R1gR^g_1R1g 设置为 "yes",否则为 "no"。然后我们使用 III 和 Q1Q_1Q1 查询 MLLM 以预测响应 R1R_1R1,并使用语言建模损失针对 R1gR^g_1R1g 进行优化。

我们逐步将范围减半并重复上述过程多轮。例如,在第 ttt 轮,我们根据第 (t−1)(t-1)(t−1) 轮的真值响应 Rt−1gR^g_{t-1}Rt−1g 更新 [Lt,Ut][L_t, U_t][Lt,Ut]:

Lt,Ut\]={\[τt−1+1,Ut−1\],if Rt−1g=Yes,\[Lt−1,τt−1\],if Rt−1g=No.(1) \[L_t, U_t\] = \\begin{cases} \[\\tau_{t-1} + 1, U_{t-1}\], \& \\text{if } R\^g_{t-1} = \\text{Yes}, \\\\ \[L_{t-1}, \\tau_{t-1}\], \& \\text{if } R\^g_{t-1} = \\text{No}. \\end{cases} \\quad (1) \[Lt,Ut\]={\[τt−1+1,Ut−1\],\[Lt−1,τt−1\],if Rt−1g=Yes,if Rt−1g=No.(1)

当 Ut−LtU_t - L_tUt−Lt 低于 δ=0.2×c\\delta = 0.2 \\times cδ=0.2×c 时,对话终止。然后,要求 MLLM 预测实际物体计数。

#### 4.2 比较与排序计数优化 (Compare-and-Rank Count Optimization)

视觉特征是高维表示,而真值计数是表示为文本令牌的离散标量。由于模态差距,直接针对真值优化预测计数可能具有挑战性。这使得模型难以建立鲁棒的映射。相反,引导模型判断图像之间的相对计数差异可以直观地更容易访问。因此,我们提出了一种比较与排序计数优化策略,训练模型比较多个图像并根据物体计数优化它们的相对排序。

首先,我们需要采样多个图像进行计数比较。由于计数数据集通常表现出物体计数的长尾分布,具有大物体计数的密集场景是罕见的,并且不太可能通过随机采样采样到。因此,我们引入一个简单的方案根据计数对图像进行聚类。具体而言,我们获得训练集中每个物体类别的最小和最大计数(即 \[cmin,cmax\]\[c_{min}, c_{max}\]\[cmin,cmax\]),然后将 \[cmin,cmax\]\[c_{min}, c_{max}\]\[cmin,cmax\] 划分为 KKK(默认为 4)个等长区间。因此,每个类别的图像根据其物体计数落入的区间分为四组。在每次训练迭代中,我们从每组中随机采样一个图像以构建图像集 I={I1,I2,I3,I4}\\mathcal{I} = \\{I_1, I_2, I_3, I_4\\}I={I1,I2,I3,I4},其中相应的计数固有地满足 c1\