目 录

-

- 摘要

- [1. 引言](#1. 引言)

- [2. 会话基础概念](#2. 会话基础概念)

-

- [2.1 什么是 Session](#2.1 什么是 Session)

- [2.2 Session Key 的设计](#2.2 Session Key 的设计)

- [3. 单聊会话管理](#3. 单聊会话管理)

-

- [3.1 单聊会话的特点](#3.1 单聊会话的特点)

- [3.2 单聊会话的生命周期](#3.2 单聊会话的生命周期)

- [3.3 单聊会话的实现](#3.3 单聊会话的实现)

- [4. 群聊会话管理](#4. 群聊会话管理)

-

- [4.1 群聊会话的复杂性](#4.1 群聊会话的复杂性)

- [4.2 触发模式设计](#4.2 触发模式设计)

- [4.3 权限控制机制](#4.3 权限控制机制)

- [4.4 群聊会话管理实现](#4.4 群聊会话管理实现)

- [5. 多模型切换机制](#5. 多模型切换机制)

-

- [5.1 为什么需要多模型支持](#5.1 为什么需要多模型支持)

- [5.2 手动模型切换](#5.2 手动模型切换)

- [5.3 自动模型路由](#5.3 自动模型路由)

- [6. 会话上下文管理](#6. 会话上下文管理)

-

- [6.1 上下文的重要性](#6.1 上下文的重要性)

- [6.2 上下文压缩策略](#6.2 上下文压缩策略)

- [6.3 上下文管理实现](#6.3 上下文管理实现)

- [7. API 接口设计](#7. API 接口设计)

-

- [7.1 RESTful API 设计](#7.1 RESTful API 设计)

- [7.2 API 实现代码](#7.2 API 实现代码)

- [8. 监控统计](#8. 监控统计)

-

- [8.1 监控指标设计](#8.1 监控指标设计)

- [8.2 监控系统架构](#8.2 监控系统架构)

- [8.3 监控实现代码](#8.3 监控实现代码)

- [9. 高级功能](#9. 高级功能)

-

- [9.1 会话继承](#9.1 会话继承)

- [9.2 会话分支](#9.2 会话分支)

- [9.3 会话回放](#9.3 会话回放)

- [10. 总结](#10. 总结)

- 参考资料

摘要

本文深入探讨 OpenClaw 框架的会话管理机制,这是构建多渠道 AI 助手的核心技术基础。文章从 Session 和 Session Key 的基础概念出发,详细解析单聊会话、群聊会话的差异化处理策略,以及多模型智能路由的实现原理。通过源码分析和架构图解,读者将掌握会话上下文管理、权限控制、监控统计等关键技能,并能运用会话继承、分支、回放等高级功能构建复杂对话场景。无论你是 OpenClaw 的初学者还是希望深入理解其内部机制的进阶用户,本文都将为你提供系统性的技术指导。

1. 引言

在多渠道 AI 助手的开发过程中,会话管理是最基础也是最核心的技术挑战之一。想象这样一个场景:用户在 Telegram 私聊中与 AI 助手讨论技术问题,同时在 Discord 群组中让助手协助团队协作,而在飞书群里又有另一个独立的对话上下文------如何确保每个对话都有独立的记忆?如何让同一个 AI 助手在不同平台、不同场景下都能准确理解上下文?

OpenClaw 的会话管理系统正是为解决这些问题而设计的。它提供了一套完整的会话抽象层,能够:

- 隔离对话上下文:每个会话都有独立的对话历史和状态

- 支持多种会话类型:单聊、群聊、临时会话各有不同的处理策略

- 灵活的模型路由:根据场景自动或手动切换 AI 模型

- 丰富的上下文管理:支持上下文继承、分支、回放等高级功能

本文将从基础概念开始,逐步深入到实现细节和高级应用,帮助你全面掌握 OpenClaw 的会话管理能力。

2. 会话基础概念

2.1 什么是 Session

Session(会话)是 OpenClaw 中管理对话上下文的核心抽象。每个 Session 代表一个独立的对话场景,包含以下关键信息:

| 属性 | 类型 | 说明 |

|---|---|---|

sessionId |

string | 会话唯一标识符 |

channel |

string | 消息渠道(telegram、discord、feishu 等) |

chatId |

string | 聊天 ID(群组 ID 或用户 ID) |

userId |

string | 发送消息的用户 ID |

model |

string | 当前使用的 AI 模型 |

context |

array | 对话历史消息列表 |

metadata |

object | 会话元数据(创建时间、最后活跃时间等) |

Session 的生命周期从用户首次发送消息开始,到会话超时或被显式销毁结束。在生命周期内,所有相关的对话消息都会被记录在 Session 的 context 中,形成完整的对话历史。

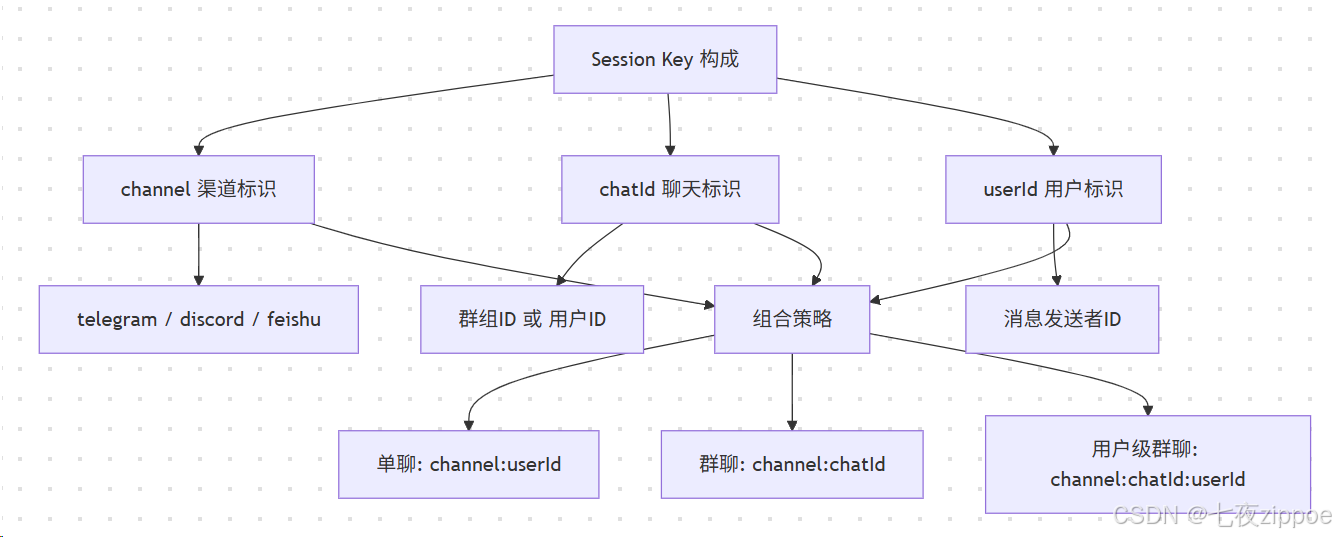

2.2 Session Key 的设计

Session Key 是用于唯一标识一个 Session 的字符串。OpenClaw 采用分层组合的方式构建 Session Key,确保不同渠道、不同聊天、不同用户之间的会话能够正确隔离。

Session Key 的生成策略根据会话类型有所不同:

单聊会话 :使用 channel:userId 格式,确保每个用户在特定渠道上有独立的会话上下文。例如,用户 A 在 Telegram 上的 Session Key 为 telegram:12345678,而同一用户在 Discord 上的 Session Key 则为 discord:87654321。

群聊会话 :使用 channel:chatId 格式,让群组内的所有成员共享同一个会话上下文。这在团队协作场景中非常有用,所有成员都能看到之前的对话历史。

用户级群聊会话 :使用 channel:chatId:userId 格式,在群聊中为每个用户维护独立的会话。这种模式适用于需要个性化响应的场景,比如群内的个人助手功能。

python

# Session Key 生成器实现

class SessionKeyGenerator:

"""根据会话类型生成唯一的 Session Key"""

def __init__(self, separator: str = ":"):

self.separator = separator

def generate(

self,

channel: str,

chat_id: str,

user_id: str,

is_group: bool,

user_level: bool = False

) -> str:

"""

生成 Session Key

参数说明:

- channel: 消息渠道标识(如 'telegram', 'discord')

- chat_id: 聊天 ID(群组 ID 或用户 ID)

- user_id: 发送消息的用户 ID

- is_group: 是否为群聊

- user_level: 是否为用户级群聊

返回格式化的 Session Key 字符串

"""

if not is_group:

# 单聊:channel:userId

return f"{channel}{self.separator}{user_id}"

elif user_level:

# 用户级群聊:channel:chatId:userId

return f"{channel}{self.separator}{chat_id}{self.separator}{user_id}"

else:

# 群聊:channel:chatId

return f"{channel}{self.separator}{chat_id}"上述代码展示了 Session Key 的生成逻辑。SessionKeyGenerator 类封装了三种不同场景的 Key 生成策略,通过 is_group 和 user_level 参数来区分。这种设计使得会话隔离策略灵活可配置,能够适应各种复杂的业务场景。

3. 单聊会话管理

3.1 单聊会话的特点

单聊(Private Chat)是最基础的会话类型,具有以下特点:

- 一对一交互:用户与 AI 助手之间的私密对话

- 独立上下文:每个用户有独立的对话历史,互不干扰

- 持久化存储:对话历史可以长期保存,支持跨会话记忆

- 个性化定制:可以根据用户偏好调整模型参数和响应风格

单聊会话的管理相对简单,主要关注会话的创建、更新、查询和销毁四个基本操作。

3.2 单聊会话的生命周期

数据存储 SessionManager Gateway 用户 数据存储 SessionManager Gateway 用户 alt Session 存在 Session 不存在 发送消息 获取/创建 Session 查询现有 Session 返回 Session 数据 创建新 Session 返回新 Session 更新对话历史 持久化 Session 返回 Session AI 响应

上图展示了单聊会话的完整生命周期。当用户发送消息时,Gateway 首先通过 SessionManager 获取或创建对应的 Session,然后将新消息添加到对话历史中,最后持久化存储并返回给 AI 模型处理。

3.3 单聊会话的实现

python

# 单聊会话管理器实现

class PrivateSessionManager:

"""管理单聊会话的核心类"""

def __init__(

self,

storage_backend: StorageBackend,

session_timeout: int = 3600,

max_context_length: int = 50

):

"""

初始化单聊会话管理器

参数:

- storage_backend: 存储后端(Redis、MongoDB 等)

- session_timeout: 会话超时时间(秒),默认 1 小时

- max_context_length: 最大上下文消息数,默认 50 条

"""

self.storage = storage_backend

self.timeout = session_timeout

self.max_context = max_context_length

self.key_generator = SessionKeyGenerator()

async def get_or_create(

self,

channel: str,

user_id: str,

metadata: dict = None

) -> Session:

"""

获取现有会话或创建新会话

这是单聊会话管理的核心方法,实现了会话的懒加载

和自动创建逻辑。

"""

session_key = self.key_generator.generate(

channel=channel,

chat_id=user_id,

user_id=user_id,

is_group=False

)

# 尝试获取现有会话

session = await self.storage.get(session_key)

if session is None or session.is_expired():

# 创建新会话

session = Session(

session_id=session_key,

channel=channel,

chat_id=user_id,

user_id=user_id,

context=[],

metadata=metadata or {},

created_at=datetime.now(),

last_active=datetime.now()

)

await self.storage.set(session_key, session, self.timeout)

return session

async def add_message(

self,

session: Session,

role: str,

content: str

) -> Session:

"""

向会话添加新消息

自动管理上下文长度,超出限制时移除最早的消息

"""

message = {

"role": role,

"content": content,

"timestamp": datetime.now().isoformat()

}

session.context.append(message)

# 上下文长度控制

if len(session.context) > self.max_context:

session.context = session.context[-self.max_context:]

session.last_active = datetime.now()

await self.storage.set(

session.session_id,

session,

self.timeout

)

return session这段代码展示了单聊会话管理器的核心实现。PrivateSessionManager 类封装了会话的获取、创建和更新逻辑,通过 get_or_create 方法实现了会话的懒加载,通过 add_message 方法实现了对话历史的自动管理。值得注意的是,代码中实现了上下文长度控制,当消息数量超过限制时自动移除最早的消息,这是一个重要的内存优化策略。

4. 群聊会话管理

4.1 群聊会话的复杂性

相比单聊,群聊会话的管理要复杂得多。主要挑战包括:

- 多用户参与:群组内多个用户可能同时与 AI 交互

- 触发模式选择:AI 应该响应所有消息还是只响应特定触发

- 权限控制:不同用户可能有不同的操作权限

- 上下文共享:群组成员共享对话历史,需要考虑隐私问题

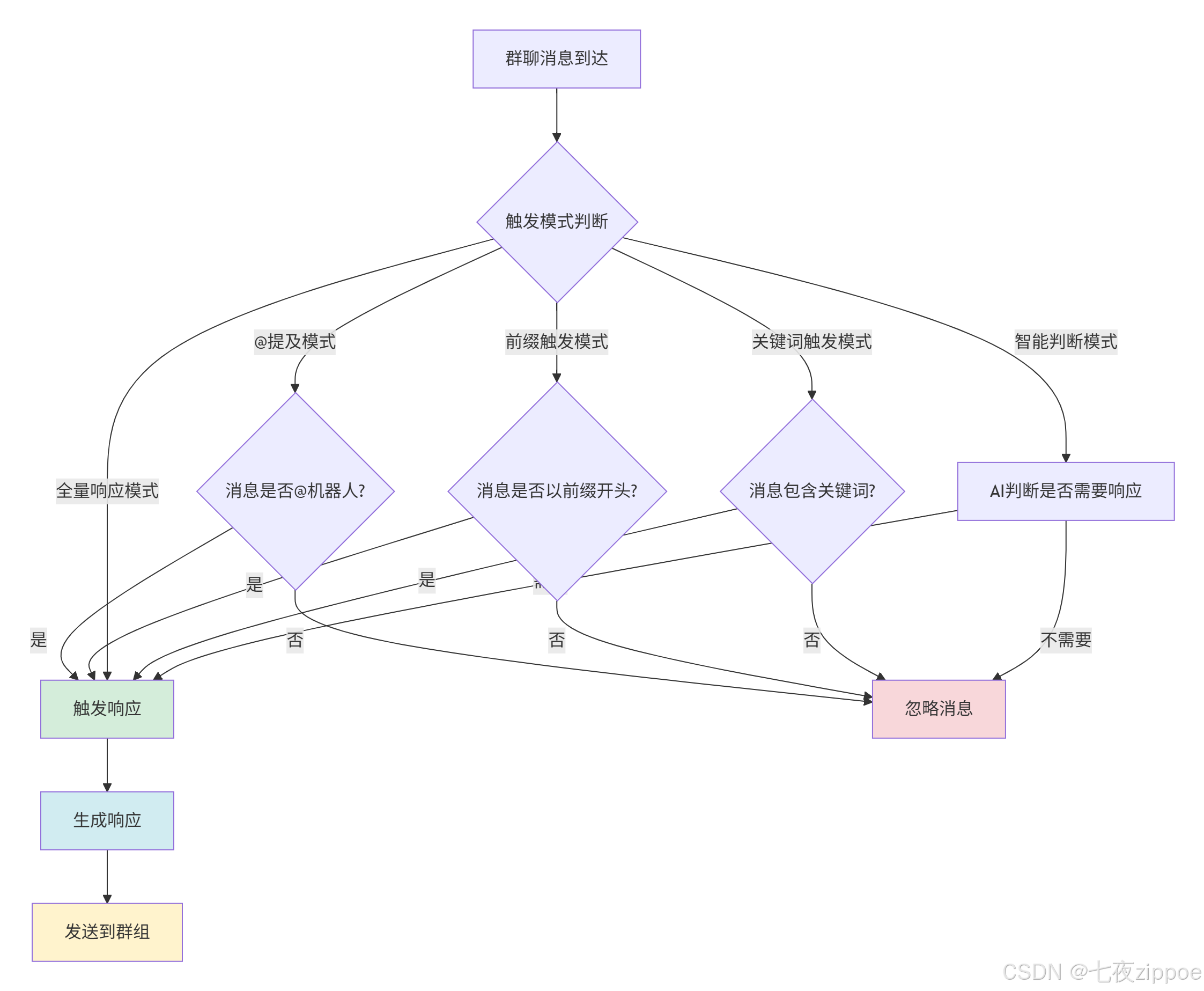

4.2 触发模式设计

OpenClaw 支持多种群聊触发模式,以适应不同的使用场景:

| 触发模式 | 说明 | 适用场景 |

|---|---|---|

| @提及 | 只有被 @ 时才响应 | 大型群组,避免干扰 |

| 前缀触发 | 以特定前缀开头的消息才响应 | 技术社区,指令式交互 |

| 全量响应 | 响应所有消息 | 小型团队,深度协作 |

| 关键词触发 | 包含特定关键词时响应 | 监控场景,自动响应 |

| 智能判断 | AI 自主判断是否需要响应 | 高级场景,需要模型支持 |

4.3 权限控制机制

群聊会话的权限控制是保障安全性的重要环节。OpenClaw 采用基于角色的权限控制(RBAC)模型:

python

# 群聊权限控制系统

from enum import Enum

from typing import Set, Optional

class Permission(Enum):

"""权限枚举定义"""

CHAT = "chat" # 基础对话权限

CHANGE_MODEL = "change_model" # 切换模型权限

CLEAR_CONTEXT = "clear_context" # 清空上下文权限

ADMIN = "admin" # 管理员权限

USE_TOOLS = "use_tools" # 使用工具权限

class GroupPermissionManager:

"""群聊权限管理器"""

def __init__(self):

# 角色权限映射

self.role_permissions: dict[str, Set[Permission]] = {

"member": {Permission.CHAT, Permission.USE_TOOLS},

"moderator": {

Permission.CHAT,

Permission.USE_TOOLS,

Permission.CHANGE_MODEL,

Permission.CLEAR_CONTEXT

},

"admin": {p for p in Permission} # 所有权限

}

# 用户角色缓存

self.user_roles: dict[str, str] = {}

async def get_user_role(

self,

channel: str,

chat_id: str,

user_id: str

) -> str:

"""

获取用户在群组中的角色

优先从缓存获取,缓存未命中时查询平台 API

"""

cache_key = f"{channel}:{chat_id}:{user_id}"

if cache_key in self.user_roles:

return self.user_roles[cache_key]

# 查询平台 API 获取用户角色

role = await self._fetch_role_from_platform(

channel, chat_id, user_id

)

self.user_roles[cache_key] = role

return role

def check_permission(

self,

role: str,

permission: Permission

) -> bool:

"""

检查角色是否拥有指定权限

"""

allowed = self.role_permissions.get(role, set())

return permission in allowed

async def require_permission(

self,

channel: str,

chat_id: str,

user_id: str,

permission: Permission

) -> bool:

"""

验证用户权限,无权限时抛出异常

"""

role = await self.get_user_role(channel, chat_id, user_id)

if not self.check_permission(role, permission):

raise PermissionError(

f"用户 {user_id} 在群组 {chat_id} 没有 {permission.value} 权限"

)

return True上述代码实现了一个完整的群聊权限控制系统。Permission 枚举定义了所有可用的权限类型,GroupPermissionManager 类管理角色与权限的映射关系,并提供权限检查方法。这个设计允许灵活地扩展新的权限类型和角色,同时保持代码的可维护性。

4.4 群聊会话管理实现

python

# 群聊会话管理器

class GroupSessionManager:

"""管理群聊会话的核心类"""

def __init__(

self,

storage_backend: StorageBackend,

trigger_mode: str = "mention",

permission_manager: GroupPermissionManager = None

):

"""

初始化群聊会话管理器

参数:

- storage_backend: 存储后端

- trigger_mode: 触发模式(mention/prefix/all/keyword/smart)

- permission_manager: 权限管理器实例

"""

self.storage = storage_backend

self.trigger_mode = trigger_mode

self.permission_manager = permission_manager or GroupPermissionManager()

self.key_generator = SessionKeyGenerator()

# 触发前缀配置

self.trigger_prefixes = ["/ai", "!ai", "AI:"]

# 触发关键词配置

self.trigger_keywords = ["帮助", "help", "问题"]

async def should_respond(

self,

message: Message,

bot_id: str

) -> tuple[bool, str]:

"""

判断是否应该响应群聊消息

返回:(是否响应, 触发原因)

"""

content = message.content.strip()

if self.trigger_mode == "mention":

# @提及模式

if f"<@{bot_id}>" in content or f"@{bot_id}" in content:

return True, "mention"

return False, ""

elif self.trigger_mode == "prefix":

# 前缀触发模式

for prefix in self.trigger_prefixes:

if content.startswith(prefix):

return True, f"prefix:{prefix}"

return False, ""

elif self.trigger_mode == "all":

# 全量响应模式

return True, "all"

elif self.trigger_mode == "keyword":

# 关键词触发模式

for keyword in self.trigger_keywords:

if keyword.lower() in content.lower():

return True, f"keyword:{keyword}"

return False, ""

elif self.trigger_mode == "smart":

# 智能判断模式 - 使用轻量模型判断

return await self._smart_should_respond(message)

return False, ""

async def get_or_create(

self,

channel: str,

chat_id: str,

user_level: bool = False

) -> Session:

"""

获取或创建群聊会话

"""

session_key = self.key_generator.generate(

channel=channel,

chat_id=chat_id,

user_id="", # 群聊不区分用户

is_group=True,

user_level=user_level

)

session = await self.storage.get(session_key)

if session is None:

session = Session(

session_id=session_key,

channel=channel,

chat_id=chat_id,

user_id="", # 群聊会话不绑定特定用户

context=[],

metadata={"trigger_mode": self.trigger_mode},

created_at=datetime.now(),

last_active=datetime.now()

)

await self.storage.set(session_key, session)

return session这段代码展示了群聊会话管理器的核心实现。should_respond 方法实现了五种触发模式的判断逻辑,get_or_create 方法处理群聊会话的创建和获取。通过 user_level 参数,可以灵活切换群组共享会话和用户独立会话两种模式。

5. 多模型切换机制

5.1 为什么需要多模型支持

在实际应用中,不同的任务往往需要不同的 AI 模型:

- 快速响应场景:使用轻量模型(如 GPT-4o-mini)降低延迟和成本

- 复杂推理场景:使用推理模型(如 o1-mini)获得更准确的答案

- 代码生成场景:使用代码专用模型(如 Claude 3.5 Sonnet)

- 多模态场景:使用支持图像/音频的模型(如 GPT-4o)

OpenClaw 提供了灵活的多模型切换机制,支持手动切换和自动路由两种模式。

5.2 手动模型切换

用户可以通过命令或 API 显式切换当前会话使用的模型:

是

否

用户发送切换命令

解析目标模型

模型是否可用?

更新 Session 配置

返回确认消息

返回错误提示

5.3 自动模型路由

自动模型路由是 OpenClaw 的高级功能,它根据消息内容自动选择最合适的模型:

python

# 自动模型路由器实现

from dataclasses import dataclass

from typing import Optional

import re

@dataclass

class ModelRoute:

"""模型路由结果"""

model: str

reason: str

confidence: float

class AutoModelRouter:

"""自动模型路由器"""

def __init__(self, model_config: dict):

"""

初始化路由器

model_config 示例:

{

"default": "gpt-4o-mini",

"reasoning": "o1-mini",

"code": "claude-3-5-sonnet",

"vision": "gpt-4o"

}

"""

self.models = model_config

# 路由规则定义

self.routing_rules = [

# (模式, 模型, 原因, 置信度)

(r'\b(分析|推理|思考|为什么|如何理解)\b',

"reasoning", "检测到推理关键词", 0.8),

(r'```(python|javascript|java|go|rust)',

"code", "检测到代码块", 0.9),

(r'\b(写代码|编程|实现|debug|调试)\b',

"code", "检测到编程关键词", 0.85),

(r'\[image:|\.(jpg|png|gif|webp)\]',

"vision", "检测到图像内容", 0.95),

]

async def route(

self,

message: str,

context: list = None,

metadata: dict = None

) -> ModelRoute:

"""

根据消息内容自动选择模型

路由策略:

1. 首先匹配显式规则(代码块、图像等)

2. 然后匹配语义规则(推理、编程关键词)

3. 最后使用默认模型

"""

message_lower = message.lower()

# 遍历路由规则

for pattern, model_key, reason, confidence in self.routing_rules:

if re.search(pattern, message_lower, re.IGNORECASE):

model = self.models.get(model_key, self.models["default"])

return ModelRoute(

model=model,

reason=reason,

confidence=confidence

)

# 使用 AI 判断是否需要推理模型

if await self._needs_reasoning(message, context):

return ModelRoute(

model=self.models.get("reasoning", self.models["default"]),

reason="AI 判断需要深度推理",

confidence=0.7

)

# 默认模型

return ModelRoute(

model=self.models["default"],

reason="默认模型",

confidence=1.0

)

async def _needs_reasoning(

self,

message: str,

context: list = None

) -> bool:

"""

使用轻量模型判断是否需要推理模型

这是一个成本优化策略:用便宜的模型判断

是否需要使用昂贵的推理模型

"""

# 简化实现:基于消息长度和复杂度判断

if len(message) > 500:

return True

# 检测复杂问题标志

complex_indicators = [

"比较", "对比", "优缺点", "分析",

"为什么", "如何理解", "解释原因"

]

for indicator in complex_indicators:

if indicator in message:

return True

return False这段代码实现了一个智能的自动模型路由器。AutoModelRouter 类通过正则表达式匹配和语义分析,自动判断消息应该使用哪种模型。路由规则覆盖了代码生成、图像处理、复杂推理等常见场景,并支持通过 AI 判断来处理边界情况。这种设计既保证了响应速度,又能在需要时自动切换到更强大的模型。

6. 会话上下文管理

6.1 上下文的重要性

会话上下文是 AI 能够进行连贯对话的关键。一个良好的上下文管理策略需要平衡以下因素:

- 上下文长度:过长的上下文会增加 API 成本和响应延迟

- 上下文质量:保留关键信息,过滤无关内容

- 上下文一致性:确保多轮对话中信息的一致性

6.2 上下文压缩策略

否

是

新消息到达

上下文是否超限?

直接添加消息

执行压缩策略

计算消息重要性

移除低重要性消息

保留关键信息

添加新消息

更新会话

持久化存储

6.3 上下文管理实现

python

# 会话上下文管理器

from typing import List, Tuple

import tiktoken

class ContextManager:

"""管理会话上下文的核心类"""

def __init__(

self,

max_tokens: int = 4000,

compression_strategy: str = "sliding_window"

):

"""

初始化上下文管理器

参数:

- max_tokens: 最大 token 数量

- compression_strategy: 压缩策略

- sliding_window: 滑动窗口

- importance: 重要性排序

- summary: 摘要压缩

"""

self.max_tokens = max_tokens

self.strategy = compression_strategy

self.encoder = tiktoken.get_encoding("cl100k_base")

def count_tokens(self, messages: List[dict]) -> int:

"""计算消息列表的 token 数量"""

total = 0

for msg in messages:

content = msg.get("content", "")

total += len(self.encoder.encode(content))

# 消息格式开销

total += 4 # role + content 结构

return total

async def add_message(

self,

context: List[dict],

new_message: dict

) -> List[dict]:

"""

添加新消息到上下文,自动处理超限情况

"""

context.append(new_message)

while self.count_tokens(context) > self.max_tokens:

context = await self._compress(context)

return context

async def _compress(

self,

context: List[dict]

) -> List[dict]:

"""

根据策略压缩上下文

"""

if self.strategy == "sliding_window":

# 滑动窗口:移除最早的消息

# 但保留系统消息

system_messages = [

m for m in context if m.get("role") == "system"

]

other_messages = [

m for m in context if m.get("role") != "system"

]

# 移除最早的非系统消息

if other_messages:

other_messages.pop(0)

return system_messages + other_messages

elif self.strategy == "importance":

# 重要性排序:保留重要消息

scored = [

(msg, self._calculate_importance(msg))

for msg in context

]

scored.sort(key=lambda x: x[1], reverse=True)

# 保留高重要性消息

result = []

current_tokens = 0

for msg, score in scored:

msg_tokens = len(

self.encoder.encode(msg.get("content", ""))

)

if current_tokens + msg_tokens <= self.max_tokens:

result.append(msg)

current_tokens += msg_tokens

return result

elif self.strategy == "summary":

# 摘要压缩:生成历史摘要

# 这里简化实现,实际应调用 AI 生成摘要

return context[-10:] # 保留最近 10 条

return context

def _calculate_importance(self, message: dict) -> float:

"""

计算消息的重要性分数

考虑因素:

- 消息角色(系统消息 > 用户消息 > 助手消息)

- 内容长度(包含更多信息的消息更重要)

- 关键词(包含决策、结论的消息更重要)

"""

score = 0.0

# 角色权重

role_weights = {

"system": 10.0,

"user": 5.0,

"assistant": 3.0

}

score += role_weights.get(message.get("role"), 1.0)

# 内容长度

content = message.get("content", "")

score += min(len(content) / 100, 5.0)

# 关键词检测

important_keywords = [

"重要", "关键", "决定", "结论",

"important", "key", "decision", "conclusion"

]

for kw in important_keywords:

if kw in content.lower():

score += 2.0

break

return score这段代码实现了三种上下文压缩策略。滑动窗口策略简单高效,适合大多数场景;重要性排序策略能保留关键信息,但计算开销较大;摘要压缩策略能最大化信息密度,但需要额外的 AI 调用。_calculate_importance 方法通过角色权重、内容长度和关键词检测来评估消息重要性,这是一个可扩展的设计,可以根据实际需求添加更多评估维度。

7. API 接口设计

7.1 RESTful API 设计

OpenClaw 提供了完整的 RESTful API 用于会话管理:

| 端点 | 方法 | 说明 |

|---|---|---|

/api/sessions |

GET | 列出所有会话 |

/api/sessions/{id} |

GET | 获取指定会话详情 |

/api/sessions/{id} |

DELETE | 删除指定会话 |

/api/sessions/{id}/context |

GET | 获取会话上下文 |

/api/sessions/{id}/context |

DELETE | 清空会话上下文 |

/api/sessions/{id}/model |

PUT | 切换会话模型 |

7.2 API 实现代码

python

# 会话管理 API 实现

from fastapi import FastAPI, HTTPException, Depends

from pydantic import BaseModel

from typing import Optional

app = FastAPI(title="OpenClaw Session API")

class SessionResponse(BaseModel):

"""会话响应模型"""

session_id: str

channel: str

chat_id: str

user_id: str

model: str

context_length: int

created_at: str

last_active: str

class ModelSwitchRequest(BaseModel):

"""模型切换请求模型"""

model: str

reason: Optional[str] = None

# 依赖注入:获取会话管理器

def get_session_manager():

return session_manager # 全局实例

@app.get("/api/sessions", response_model=List[SessionResponse])

async def list_sessions(

channel: Optional[str] = None,

limit: int = 50,

offset: int = 0,

manager = Depends(get_session_manager)

):

"""

列出所有会话

支持按渠道筛选,支持分页

"""

sessions = await manager.list_all(

channel=channel,

limit=limit,

offset=offset

)

return [

SessionResponse(

session_id=s.session_id,

channel=s.channel,

chat_id=s.chat_id,

user_id=s.user_id,

model=s.model,

context_length=len(s.context),

created_at=s.created_at.isoformat(),

last_active=s.last_active.isoformat()

)

for s in sessions

]

@app.get("/api/sessions/{session_id}", response_model=SessionResponse)

async def get_session(

session_id: str,

manager = Depends(get_session_manager)

):

"""

获取指定会话详情

"""

session = await manager.get(session_id)

if session is None:

raise HTTPException(

status_code=404,

detail=f"Session {session_id} not found"

)

return SessionResponse(

session_id=session.session_id,

channel=session.channel,

chat_id=session.chat_id,

user_id=session.user_id,

model=session.model,

context_length=len(session.context),

created_at=session.created_at.isoformat(),

last_active=session.last_active.isoformat()

)

@app.put("/api/sessions/{session_id}/model")

async def switch_model(

session_id: str,

request: ModelSwitchRequest,

manager = Depends(get_session_manager)

):

"""

切换会话使用的模型

需要验证模型是否可用

"""

session = await manager.get(session_id)

if session is None:

raise HTTPException(

status_code=404,

detail=f"Session {session_id} not found"

)

# 验证模型是否可用

if not await manager.is_model_available(request.model):

raise HTTPException(

status_code=400,

detail=f"Model {request.model} is not available"

)

# 更新模型配置

session.model = request.model

session.metadata["model_switch_reason"] = request.reason

await manager.save(session)

return {

"success": True,

"session_id": session_id,

"new_model": request.model

}这段代码展示了 OpenClaw 会话管理 API 的核心实现。使用 FastAPI 框架构建,提供了会话列表、详情查询、模型切换等核心功能。API 设计遵循 RESTful 规范,使用 Pydantic 模型进行请求/响应验证,通过依赖注入管理会话管理器实例。这种设计使得 API 易于测试和扩展。

8. 监控统计

8.1 监控指标设计

有效的监控是保障系统稳定运行的关键。OpenClaw 提供了丰富的监控指标:

| 指标类别 | 指标名称 | 说明 |

|---|---|---|

| 会话统计 | session_total |

当前活跃会话总数 |

session_created |

新建会话数 | |

session_expired |

过期会话数 | |

| 消息统计 | message_total |

消息总数 |

message_by_channel |

按渠道统计消息数 | |

message_by_model |

按模型统计消息数 | |

| 性能指标 | response_time_p50 |

响应时间 P50 |

response_time_p99 |

响应时间 P99 | |

context_length_avg |

平均上下文长度 |

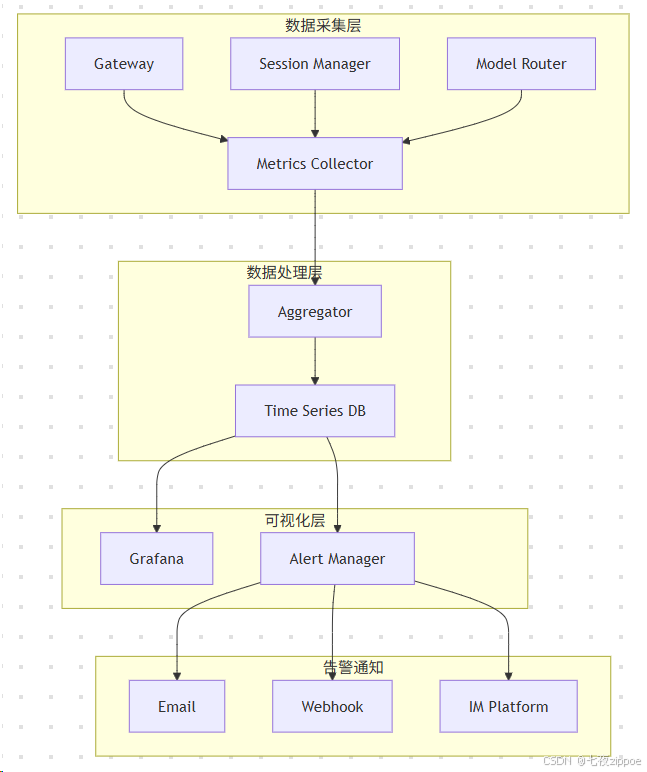

8.2 监控系统架构

8.3 监控实现代码

python

# 会话监控统计实现

from dataclasses import dataclass, field

from datetime import datetime

from typing import Dict, List

import asyncio

@dataclass

class SessionMetrics:

"""会话指标数据结构"""

timestamp: datetime

session_id: str

channel: str

model: str

message_count: int

context_tokens: int

response_time_ms: float

class SessionMonitor:

"""会话监控器"""

def __init__(self, export_interval: int = 60):

"""

初始化监控器

参数:

- export_interval: 指标导出间隔(秒)

"""

self.export_interval = export_interval

self.metrics_buffer: List[SessionMetrics] = []

# 聚合统计

self.stats = {

"session_total": 0,

"session_created": 0,

"session_expired": 0,

"message_total": 0,

"message_by_channel": {},

"message_by_model": {},

"response_times": [],

}

async def record_message(

self,

session_id: str,

channel: str,

model: str,

response_time_ms: float,

context_tokens: int

):

"""

记录消息处理指标

"""

metric = SessionMetrics(

timestamp=datetime.now(),

session_id=session_id,

channel=channel,

model=model,

message_count=1,

context_tokens=context_tokens,

response_time_ms=response_time_ms

)

self.metrics_buffer.append(metric)

# 更新聚合统计

self.stats["message_total"] += 1

self.stats["message_by_channel"][channel] = \

self.stats["message_by_channel"].get(channel, 0) + 1

self.stats["message_by_model"][model] = \

self.stats["message_by_model"].get(model, 0) + 1

self.stats["response_times"].append(response_time_ms)

async def record_session_event(

self,

event_type: str,

channel: str = None

):

"""

记录会话事件

"""

if event_type == "created":

self.stats["session_created"] += 1

self.stats["session_total"] += 1

elif event_type == "expired":

self.stats["session_expired"] += 1

self.stats["session_total"] -= 1

def get_percentile(

self,

values: List[float],

percentile: float

) -> float:

"""计算百分位数"""

if not values:

return 0.0

sorted_values = sorted(values)

index = int(len(sorted_values) * percentile / 100)

return sorted_values[min(index, len(sorted_values) - 1)]

async def export_metrics(self) -> dict:

"""

导出当前指标快照

"""

response_times = self.stats["response_times"]

return {

"timestamp": datetime.now().isoformat(),

"sessions": {

"total": self.stats["session_total"],

"created": self.stats["session_created"],

"expired": self.stats["session_expired"]

},

"messages": {

"total": self.stats["message_total"],

"by_channel": self.stats["message_by_channel"],

"by_model": self.stats["message_by_model"]

},

"performance": {

"response_time_p50": self.get_percentile(response_times, 50),

"response_time_p99": self.get_percentile(response_times, 99),

"response_time_avg": sum(response_times) / len(response_times) if response_times else 0

}

}

async def start_export_loop(self):

"""

启动指标导出循环

"""

while True:

await asyncio.sleep(self.export_interval)

metrics = await self.export_metrics()

await self._send_to_backend(metrics)

# 清空响应时间缓存,保留其他统计

self.stats["response_times"] = []

async def _send_to_backend(self, metrics: dict):

"""发送指标到后端存储"""

# 实际实现可对接 Prometheus、InfluxDB 等

print(f"[Metrics] {metrics}")这段代码实现了一个完整的会话监控系统。SessionMonitor 类负责收集、聚合和导出监控指标,支持消息处理统计、会话事件追踪和性能指标计算。export_metrics 方法生成标准化的指标快照,可对接 Prometheus、InfluxDB 等主流监控系统。通过 start_export_loop 方法实现定时导出,确保监控数据的实时性。

9. 高级功能

9.1 会话继承

会话继承允许新会话从现有会话中继承上下文,适用于用户在不同渠道间切换时保持对话连续性:

python

class SessionInheritance:

"""会话继承管理"""

async def inherit_context(

self,

source_session: Session,

target_channel: str,

inheritance_mode: str = "full"

) -> Session:

"""

从源会话继承上下文到新渠道

inheritance_mode:

- full: 完整继承所有上下文

- summary: 继承摘要而非完整历史

- selective: 选择性继承关键信息

"""

# 创建新会话

new_session = await self.create_session(

channel=target_channel,

user_id=source_session.user_id

)

if inheritance_mode == "full":

new_session.context = source_session.context.copy()

elif inheritance_mode == "summary":

summary = await self._generate_summary(source_session)

new_session.context = [

{"role": "system", "content": f"历史对话摘要:{summary}"}

]

elif inheritance_mode == "selective":

key_info = await self._extract_key_info(source_session)

new_session.context = [

{"role": "system", "content": f"关键信息:{key_info}"}

]

# 记录继承关系

new_session.metadata["inherited_from"] = source_session.session_id

new_session.metadata["inheritance_mode"] = inheritance_mode

return new_session9.2 会话分支

会话分支允许用户从历史对话中创建新的分支,探索不同的对话路径:

原始会话

消息1

消息2

消息3

消息4

分支点

分支消息1

分支消息2

9.3 会话回放

会话回放功能允许用户查看和恢复历史对话状态:

python

class SessionReplay:

"""会话回放管理"""

async def create_checkpoint(

self,

session: Session,

label: str = None

) -> str:

"""

创建会话检查点

返回检查点 ID,可用于后续恢复

"""

checkpoint_id = f"ckpt_{session.session_id}_{datetime.now().strftime('%Y%m%d%H%M%S')}"

checkpoint = {

"id": checkpoint_id,

"session_id": session.session_id,

"context": session.context.copy(),

"model": session.model,

"metadata": session.metadata.copy(),

"created_at": datetime.now().isoformat(),

"label": label or f"Checkpoint at {datetime.now()}"

}

await self.storage.set(

checkpoint_id,

checkpoint,

ttl=86400 * 30 # 保留 30 天

)

return checkpoint_id

async def restore_checkpoint(

self,

checkpoint_id: str

) -> Session:

"""

从检查点恢复会话状态

"""

checkpoint = await self.storage.get(checkpoint_id)

if checkpoint is None:

raise ValueError(f"Checkpoint {checkpoint_id} not found")

# 创建恢复的会话

restored = Session(

session_id=checkpoint["session_id"],

channel="", # 从 metadata 恢复

chat_id="",

user_id="",

context=checkpoint["context"],

model=checkpoint["model"],

metadata=checkpoint["metadata"],

created_at=datetime.now(),

last_active=datetime.now()

)

restored.metadata["restored_from"] = checkpoint_id

restored.metadata["restored_at"] = datetime.now().isoformat()

return restored

async def list_checkpoints(

self,

session_id: str

) -> List[dict]:

"""

列出会话的所有检查点

"""

pattern = f"ckpt_{session_id}_*"

keys = await self.storage.keys(pattern)

checkpoints = []

for key in keys:

checkpoint = await self.storage.get(key)

if checkpoint:

checkpoints.append({

"id": checkpoint["id"],

"label": checkpoint["label"],

"created_at": checkpoint["created_at"],

"context_length": len(checkpoint["context"])

})

return sorted(

checkpoints,

key=lambda x: x["created_at"],

reverse=True

)这段代码实现了会话回放的核心功能。create_checkpoint 方法创建会话快照,保存完整的上下文和配置信息;restore_checkpoint 方法从检查点恢复会话状态;list_checkpoints 方法列出会话的所有历史检查点。这个功能对于调试、审计和用户体验优化都非常有价值。

10. 总结

本文系统性地介绍了 OpenClaw 框架的会话管理机制,从基础概念到高级功能,覆盖了构建多渠道 AI 助手所需的核心技术。以下是关键要点的总结:

核心要点回顾

1. 会话基础概念

Session 是 OpenClaw 管理对话上下文的核心抽象,Session Key 通过分层组合策略确保不同渠道、不同聊天、不同用户之间的会话正确隔离。理解 Session Key 的生成规则是掌握会话管理的基础。

2. 单聊与群聊的差异化处理

单聊会话相对简单,主要关注用户级别的上下文隔离;群聊会话则需要处理触发模式、权限控制等复杂问题。OpenClaw 提供了五种触发模式(@提及、前缀触发、全量响应、关键词触发、智能判断),能够适应各种使用场景。

3. 多模型智能路由

自动模型路由是 OpenClaw 的高级功能,通过规则匹配和语义分析自动选择最合适的 AI 模型。这不仅优化了响应速度和成本,还能根据任务特点获得更好的输出质量。

4. 上下文管理策略

有效的上下文管理需要在长度、质量和一致性之间取得平衡。OpenClaw 提供了滑动窗口、重要性排序和摘要压缩三种策略,可根据实际需求灵活选择。

5. 高级功能的价值

会话继承实现了跨渠道的对话连续性,会话分支支持探索不同的对话路径,会话回放则为调试和审计提供了有力工具。这些高级功能使 OpenClaw 能够应对复杂的业务场景。

思考题

-

在你的应用场景中,群聊的触发模式应该如何选择?不同模式各有什么优缺点?

-

自动模型路由在什么情况下可能出现误判?如何优化路由规则的准确性?

-

如果要为 OpenClaw 添加一个新的会话管理功能,你会选择实现什么?为什么?