Java 的 I/O 模型 随着版本迭代不断发展,从传统的阻塞 I/O(BIO)到非阻塞 I/O(NIO),再到异步 I/O(AIO),每一种模型都是为了解决特定场景下的性能瓶颈和并发问题。理解其核心原理、优缺点和适用场景,是构建高性能网络应用的基础

一、BIO (Blocking I/O) - 同步阻塞 I/O

1.1 核心原理与架构

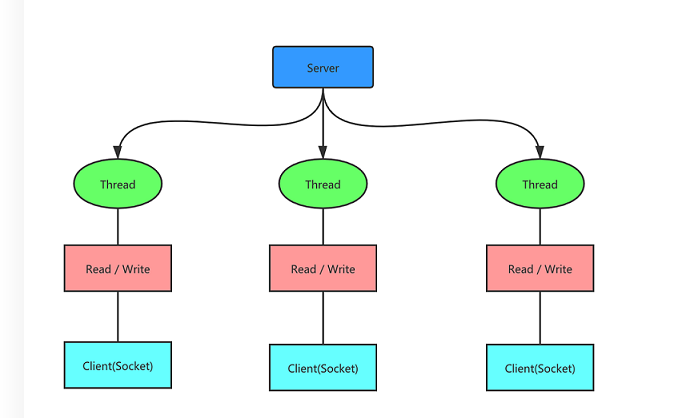

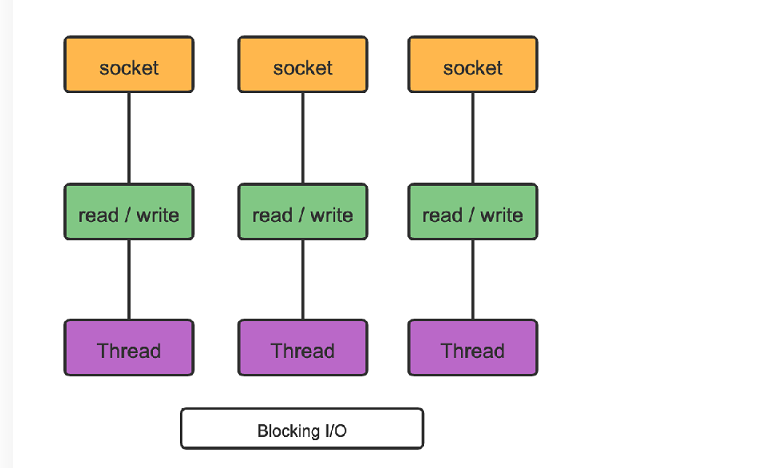

BIO 是 JDK 1.0 引入的最经典的 I/O 模型。其核心特点是 "一个连接,一个线程"。当服务器启动后,主线程(Acceptor)会在 ServerSocket.accept() 方法上阻塞,等待客户端的连接请求。

一旦有客户端连接成功,accept() 方法会返回一个 Socket 对象,服务器会为这个新的 Socket 连接创建一个新的线程(通常从线程池中获取),由该线程专门负责处理这个连接的所有 I/O 操作(Socket.read(), Socket.write())。

关键点:

-

同步:应用线程发起 I/O 操作后,必须等待内核将数据从内核空间拷贝到用户空间完成后,才能继续执行。

-

阻塞 :在等待数据就绪(

read)和数据拷贝的过程中,线程会被挂起,什么也做不了

1.2 架构

1.3 工作步骤与源码逻辑

1. 服务器启动: 创建 ServerSocket 并绑定端口

java

ServerSocket serverSocket = new ServerSocket(8080);2. 接受连接 (阻塞): 主线程在 accept() 上阻塞,等待客户端连接。

java

while (true) {

// 阻塞点 1: 等待客户端连接

Socket clientSocket = serverSocket.accept();

// 连接到来,创建新线程处理(通常使用线程池)

new Thread(() -> {

handleClient(clientSocket);

}).start();

}3. 处理连接 (阻塞): 在新线程中,进行数据的读取和写入。

java

private void handleClient(Socket socket) {

try (InputStream input = socket.getInputStream();

OutputStream output = socket.getOutputStream()) {

BufferedReader reader = new BufferedReader(new InputStreamReader(input));

String request;

// 阻塞点 2: 等待客户端发送数据

while ((request = reader.readLine()) != null) {

// 处理请求

String response = processRequest(request);

// 写入响应

output.write(response.getBytes());

output.flush();

}

} catch (IOException e) {

e.printStackTrace();

}

}1.4 应用实例

使用BIO模型编写一个服务器端,监听6666端口,当有客户端连接时,就启动一个线程与之通讯

要求使用线程池机制改善,可以连接多个客户端

服务器端可以接收客户端发送的数据(telnet方式即可)

1.5 优缺点分析

优点:

编程简单:模型直观,易于理解和调试。

代码可预测 :线程的行为是线性的,read 之后必然是 write。

缺点:

资源消耗大 :每个连接都需要一个独立的线程,线程本身占用大量内存(默认栈空间1MB),线程上下文切换开销巨大。

可扩展性差 :受限于硬件线程数(CPU核心数),当连接数达到数万时,系统无法支撑,性能急剧下降。

可靠性问题:大量线程可能导致 OOM(OutOfMemoryError)。

适用场景: 连接数非常固定且并发量不高的场景,例如内部系统、调试工具。

二、NIO (New I/O / Non-Blocking I/O) - 同步非阻塞 I/O

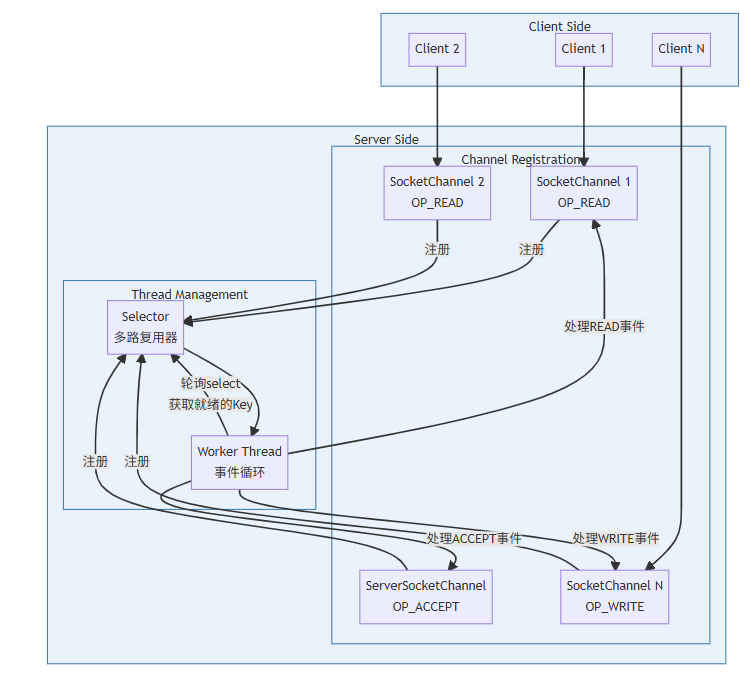

NIO 在 JDK 1.4 引入,旨在解决 BIO 的扩展性问题。其核心是 "一个线程,处理多个连接"。

2.1 核心原理与三大组件

NIO 基于 Reactor 模式,其核心是 Selector(选择器) 、Channel(通道) 和 Buffer(缓冲区)。

1. Channel (通道):

-

替代了传统的

InputStream和OutputStream,是双向的(可读可写) -

可以配置为非阻塞模式(

configureBlocking(false)) -

主要类型:

ServerSocketChannel(监听新连接)、SocketChannel(TCP连接)、DatagramChannel(UDP连接)

2. Buffer (缓冲区)

-

一个线性的、有限的数据容器,是 Channel 读写数据的直接对象

-

核心属性:

capacity(容量)、position(位置)、limit(上限)、mark(标记) -

操作:

flip()(写模式切换为读模式)、clear()/compact()(清空或压缩缓冲区,准备再次写入)

3. Selector (选择器)

-

多路复用器。一个 Selector 可以轮询(

select())注册到其上的多个 Channel -

当某个 Channel 上有事件(如连接就绪、读就绪、写就绪)发生时,Selector 会将这些 Channel 筛选出来,应用程序通过获取这些 Channel 进行后续的 I/O 操作

-

SelectionKey :表示 Channel 在 Selector 上的注册令牌,包含事件类型(

OP_ACCEPT,OP_CONNECT,OP_READ,OP_WRITE)和附加对象

关键点:

同步:I/O 操作(数据从内核缓冲区到用户缓冲区的拷贝)依然由应用线程完成。

非阻塞 :通过 Selector,应用线程无需在 accept 和 read 上死等,而是可以轮询哪些 Channel 已经就绪,然后只对就绪的 Channel 进行实际 I/O 操作

2.2 架构图

2.3 工作步骤与源码逻辑

1. 创建 Selector 和 ServerSocketChannel

java

Selector selector = Selector.open();

ServerSocketChannel serverSocketChannel = ServerSocketChannel.open();

serverSocketChannel.socket().bind(new InetSocketAddress(8080));

serverSocketChannel.configureBlocking(false); // 设置为非阻塞模式2. 注册 Accept 事件: 将 ServerSocketChannel 注册到 Selector,监听 OP_ACCEPT 事件

java

serverSocketChannel.register(selector, SelectionKey.OP_ACCEPT);3. 事件循环 (Event Loop): 核心循环,Selector 轮询已就绪的事件

java

while (true) {

// 阻塞,直到有至少一个通道的事件就绪

selector.select();

// 获取所有就绪的事件的 SelectionKey

Iterator<SelectionKey> keyIterator = selector.selectedKeys().iterator();

while (keyIterator.hasNext()) {

SelectionKey key = keyIterator.next();

keyIterator.remove(); // 必须移除,防止重复处理

if (key.isAcceptable()) {

// 处理新连接

handleAccept(key);

} else if (key.isReadable()) {

// 处理读事件

handleRead(key);

} else if (key.isWritable()) {

// 处理写事件(通常只在需要时才注册OP_WRITE)

handleWrite(key);

}

}

}4. 处理 Accept 事件

java

private void handleAccept(SelectionKey key) throws IOException {

ServerSocketChannel serverChannel = (ServerSocketChannel) key.channel();

SocketChannel clientChannel = serverChannel.accept(); // 不会阻塞,因为事件已就绪

clientChannel.configureBlocking(false);

// 将新连接的 SocketChannel 注册到 Selector,监听读事件

clientChannel.register(selector, SelectionKey.OP_READ, ByteBuffer.allocate(1024));

}5. 处理 Read 事件

java

private void handleRead(SelectionKey key) throws IOException {

SocketChannel channel = (SocketChannel) key.channel();

ByteBuffer buffer = (ByteBuffer) key.attachment(); // 获取关联的Buffer

int bytesRead = channel.read(buffer); // 从Channel读取数据到Buffer

if (bytesRead == -1) {

channel.close(); // 客户端关闭连接

return;

}

if (bytesRead > 0) {

buffer.flip(); // 切换Buffer为读模式

// 处理Buffer中的数据...

processBuffer(buffer);

buffer.clear(); // 或 buffer.compact(),准备下一次读取

// 如果需要回写数据,可以注册OP_WRITE事件

key.interestOps(SelectionKey.OP_WRITE);

}

}6. 处理 Write 事件

java

private void handleWrite(SelectionKey key) throws IOException {

SocketChannel channel = (SocketChannel) key.channel();

ByteBuffer buffer = (ByteBuffer) key.attachment();

buffer.flip(); // 确保Buffer处于读模式,以便写入Channel

while (buffer.hasRemaining()) {

channel.write(buffer); // 将Buffer中的数据写入Channel

}

buffer.compact(); // 或 buffer.clear()

// 数据写完,取消对OP_WRITE的监听,继续监听OP_READ

key.interestOps(SelectionKey.OP_READ);

}2.4 优缺点与源码分析

优点:

-

高并发:单线程即可处理大量连接,资源消耗远小于 BIO。

-

性能优势:避免了不必要的线程上下文切换

缺点:

-

编程复杂:需要处理缓冲区、选择键等概念,状态管理繁琐,容易出错。

-

调试困难:非线性的编程模型使得调试不如 BIO 直观。

-

依然同步 :数据就绪后,从内核空间拷贝到用户空间的过程(

channel.read(buffer))仍然是同步且可能阻塞的(虽然时间极短)

适用场景: 高并发、短连接的应用,如聊天服务器、游戏服务器、RPC 框架。Netty、Mina 等著名网络框架都是基于 NIO 构建的。

三、AIO (Asynchronous I/O) - 异步非阻塞 I/O

AIO 在 JDK 1.7 引入,也称为 NIO.2。其核心是 "异步回调" 或 "Future 等待"。

3.1 核心原理与架构

AIO 基于 Proactor 模式。应用程序发起一个 I/O 操作后,会立即返回,不会阻塞。当内核完成整个 I/O 操作(包括数据从内核空间拷贝到用户空间)后,会主动调用应用程序注册的回调函数,或者通知等待的 Future 对象

关键点:

-

异步:应用线程发起 I/O 操作后立即返回,由内核负责完成 I/O 操作(包括数据拷贝),并通知应用。

-

非阻塞:应用线程在发起操作和等待结果的过程中都不会被阻塞

AIO 主要提供两种 API:

Future 方式: AsynchronousChannelGroup 和 AsynchronousServerSocketChannel,通过 Future<V> 来等待结果**。

Callback 方式:**通过 CompletionHandler<V,A> 回调接口来处理成功或失败的结果

3.3 工作步骤与源码逻辑 (Callback 方式)

1. 创建异步服务器通道

java

AsynchronousServerSocketChannel serverChannel =

AsynchronousServerSocketChannel.open().bind(new InetSocketAddress(8080));2. 异步接受连接: 发起一个异步的 accept 操作,并传入一个 CompletionHandler

java

serverChannel.accept(null, new CompletionHandler<AsynchronousSocketChannel, Void>() {

// 成功接收到一个连接后的回调方法

@Override

public void completed(AsynchronousSocketChannel clientChannel, Void attachment) {

// 立即再次调用accept,准备接收下一个连接

serverChannel.accept(null, this);

// 处理新连接:例如,异步读取数据

ByteBuffer buffer = ByteBuffer.allocate(1024);

// 发起一个异步读操作,并传入另一个CompletionHandler

clientChannel.read(buffer, buffer, new CompletionHandler<Integer, ByteBuffer>() {

@Override

public void completed(Integer bytesRead, ByteBuffer buffer) {

// 读操作完成后的回调

if (bytesRead == -1) {

try { clientChannel.close(); } catch (IOException e) { ... }

return;

}

buffer.flip();

// 处理数据...

processBuffer(buffer);

buffer.clear();

// 可以继续发起异步读或写操作

clientChannel.read(buffer, buffer, this);

}

@Override

public void failed(Throwable exc, ByteBuffer buffer) {

// 读操作失败的处理

exc.printStackTrace();

try { clientChannel.close(); } catch (IOException e) { ... }

}

});

}

@Override

public void failed(Throwable exc, Void attachment) {

// 接受连接失败的处理

exc.printStackTrace();

}

});

// 主线程不能退出,需要等待异步操作

Thread.currentThread().join();3.4 优缺点分析

优点:

-

真正的异步:内核完成所有工作后通知应用,应用线程无需参与数据拷贝过程,效率理论上最高。

-

编程模型更简洁:基于回调,避免了复杂的线程同步

缺点:

推广度低:Linux 等主流操作系统对异步 I/O 的原生支持(如 io_uring)在 JDK 7 发布时并不完善,底层实现可能仍使用模拟方式(如 epool),性能优势未能完全发挥。

编程复杂(另一种复杂):回调地狱(Callback Hell)使得代码逻辑分散,不易理解和维护。

调试困难:异步回调的调试栈不连贯,问题定位困难

适用场景: 适用于连接数众多且连接时间较长的应用,如大型文件服务器、高性能 Web 服务器。但在 Linux 平台上,成熟的 NIO 框架(如 Netty)因其稳定性和更完善的生态,往往比 AIO 更受青睐

四、总结与对比

|------------|-----------------------|-----------------------------------|--------------------------------------|

| 特性 | BIO (同步阻塞 | NIO (同步非阻塞) | AIO (异步非阻塞) |

| 全称 | Blocking I/O | New I/O / Non-Blocking I/O | Asynchronous I/O |

| JDK 版本 | 1.0+ | 1.4+ | 1.7+ |

| 核心模式 | Thread-Per-Connection | Reactor | Proactor |

| 同步/异步 | 同步 | 同步 | 异步 |

| 阻塞/非阻塞 | 阻塞 | 非阻塞 | 非阻塞 |

| 编程复杂度 | 低 | 高 | 中高(回调思维) |

| 可靠性 | 连接数少时可靠 | 高 | 高 |

| 吞吐量/性能 | 低 | 高 | 理论上最高 |

| 底层机制 | - | select, poll, epoll (Linux) | IOCP (Windows), io_uring (Linux) |

选择建议 :

BIO :仅适用于连接数非常少且对开发速度要求极高的场景。

NIO :绝大多数网络应用的首选。尤其适合高并发、短连接的场景。直接使用 JDK NIO API 较复杂,推荐使用基于 NIO 的成熟框架 Netty,它封装了 JDK NIO 的复杂性,提供了强大且易用的 API,并做了大量性能优化。

AIO :在 Windows(IOCP 成熟)或 Linux(io_uring 成熟后的新版本)平台上,对性能有极致追求且能驾驭异步编程的特定场景。目前在生产环境中,直接使用 JDK AIO 的情况相对较少。

最终结论: 对于绝大多数 Java 开发者而言,学习和使用 Netty 是掌握高性能网络编程的最佳路径,它完美地构建在 NIO 的基础之上,并规避了其复杂性