本地部署OpenClaw,数据就一定安全吗?

不一定。很多人以为"本地部署"就是隐私保障,结果接了个云端API,数据照样传出去。真正的本地隐私,需要框架本地+模型本地,两头都关在自己电脑里。

这就是这套方案的核心:OpenClaw跑在虚拟机里,大模型用Ollama本地运行,对话内容完全不离开硬盘。如果需要更强的模型能力,也可以灵活接入云端API,但这时候数据流向是明确的------你自己做主。

所以这篇教程分两套方案:

- 方案A:完全离线,本地跑大模型,数据绝对不出电脑(需要好显卡)

- 方案B:折中方案,本地OpenClaw+云端API,但明确知道数据流向

整个过程跟着命令行敲就行,不需要懂编程。

这篇教程很长,但每一步都有详细说明,建议收藏后跟着做。

一、先搞清楚:你的数据到底去哪了?

很多人混淆了三个概念:

| 部署方式 | OpenClaw在哪 | 大模型在哪 | 你的数据去哪了 |

|---|---|---|---|

| 纯云端 | 对方服务器 | 对方服务器 | 全部上传 |

| 本地OpenClaw+云端API | 你的电脑 | 对方服务器 | 请求内容上传 |

| 完全本地 | 你的电脑 | 你的电脑 | 哪都不去 |

只有第三种,才是真正的"数据隐私" 。前两种只是"框架隐私",你的聊天记录、上传的文件,还是会通过API发送到模型提供商那里。

所以如果你要处理的是敏感文件、商业机密、个人隐私,必须用本地大模型。后面我会详细讲怎么搭。

二、准备工作:检查你的电脑能不能"虚拟化"

OpenClaw原生运行在Linux系统上。为了不和你的Windows冲突,我们用虚拟机给它隔离出一个独立空间。

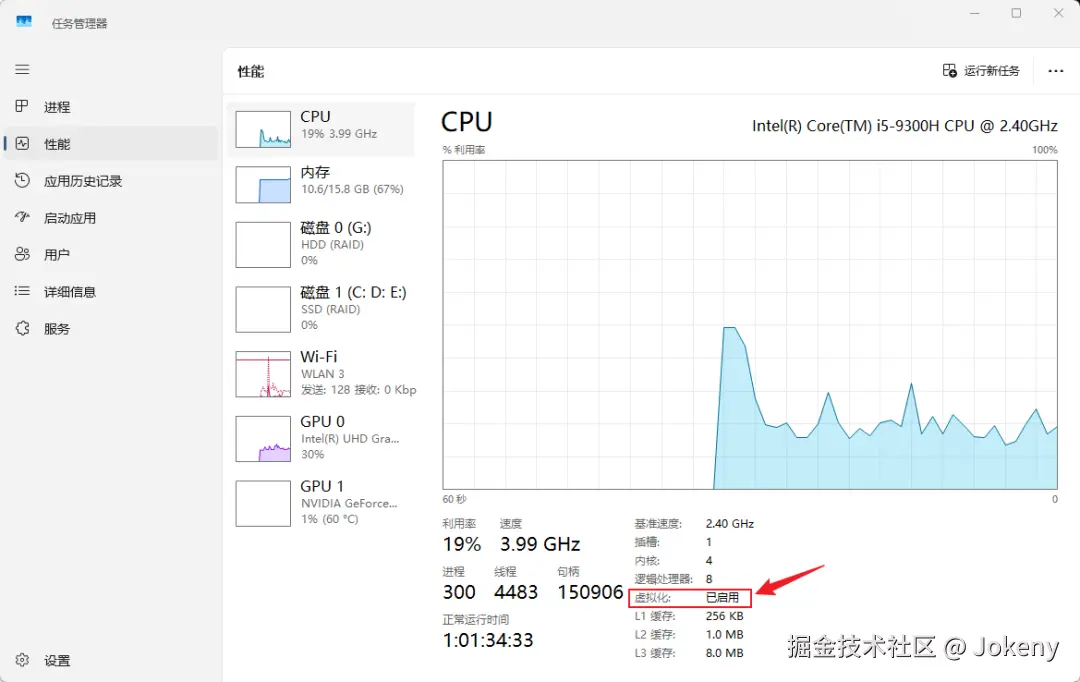

1. 检查CPU支不支持虚拟化:

右键任务栏 → 任务管理器 → 性能 → CPU,看右下角有没有"虚拟化"字样。

- 显示"已启用":直接跳到第三节

- 显示"已禁用":需要进BIOS开启,看下面

- 没有这选项:电脑太老了,只能直接本地安装或者用云端版

2. 怎么进BIOS开启?

重启电脑,开机时狂按 Del键 或 F2键 (具体看开机画面底部的提示)。进了BIOS后,不同品牌菜单位置不一样,教你个偷懒的办法:用手机拍一张BIOS界面,发给任意AI助手,问"怎么开启CPU虚拟化",它会指给你看。

华硕一般在"高级→北桥"里,微星一般在"OC→CPU特征"里。但真的,问AI比翻说明书快多了。

三、下载两个必备软件

你需要准备:

- VirtualBox(虚拟机软件,完全免费)

- Ubuntu 24.04桌面版(操作系统,完全免费)

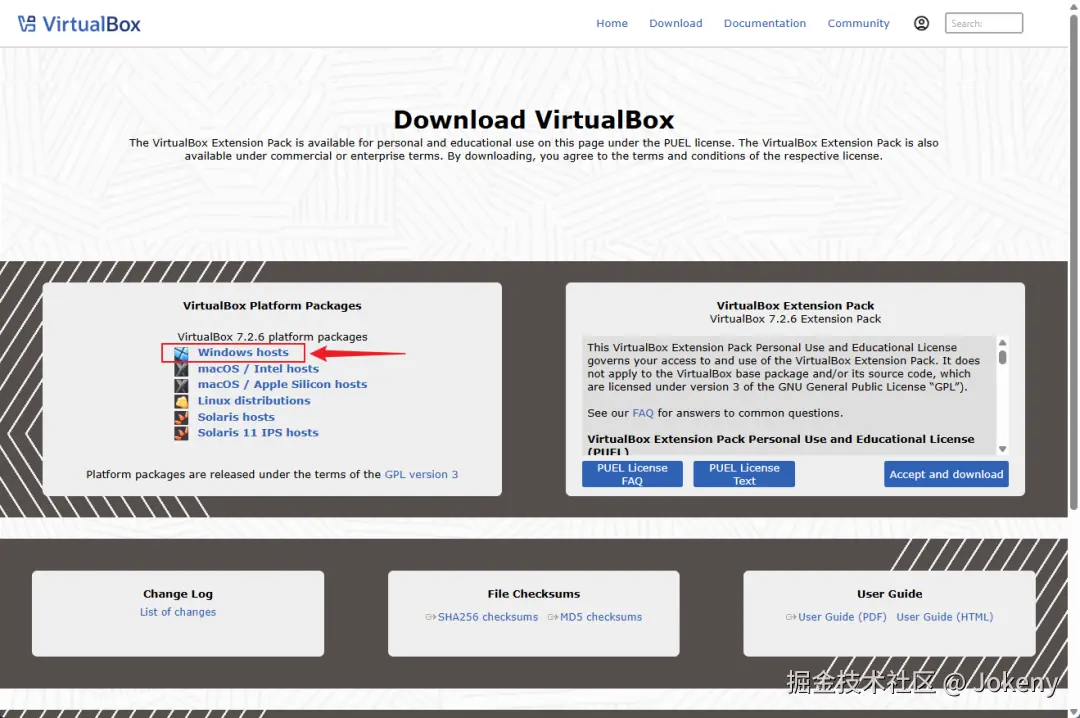

1. VirtualBox下载

官网 virtualbox.org → 点"Download" → 选"Windows hosts"。

安装时一路点"下一步",如果提示缺Microsoft Visual C++,就去微软官网搜"Visual C++ Redistributable",下载X64版本装上。

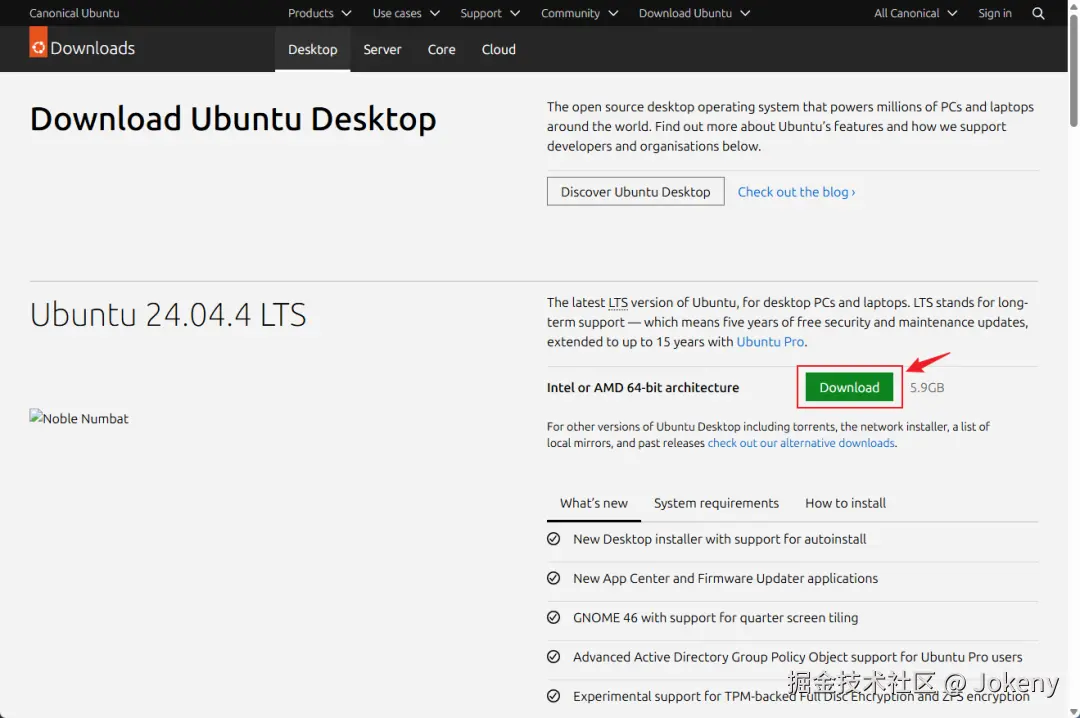

2. Ubuntu下载

官网 ubuntu.com → 点"Download Ubuntu" → 选24.04 LTS桌面版。文件大概5.9GB,建议找个WiFi稳定的地方下载。

四、安装Ubuntu系统

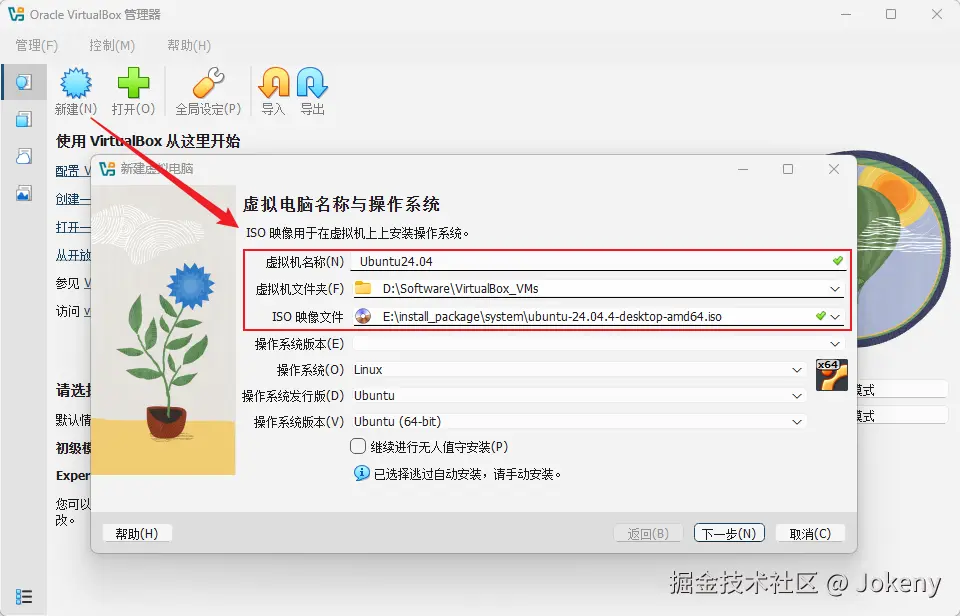

打开VirtualBox,点击蓝色的"新建"按钮:

基础设置:

- 名称:随便写,比如"Ubuntu24.04"

- 文件夹:默认位置就行,或者改到空间充裕的盘

- ISO镜像:浏览选中你下载的Ubuntu那个.iso文件

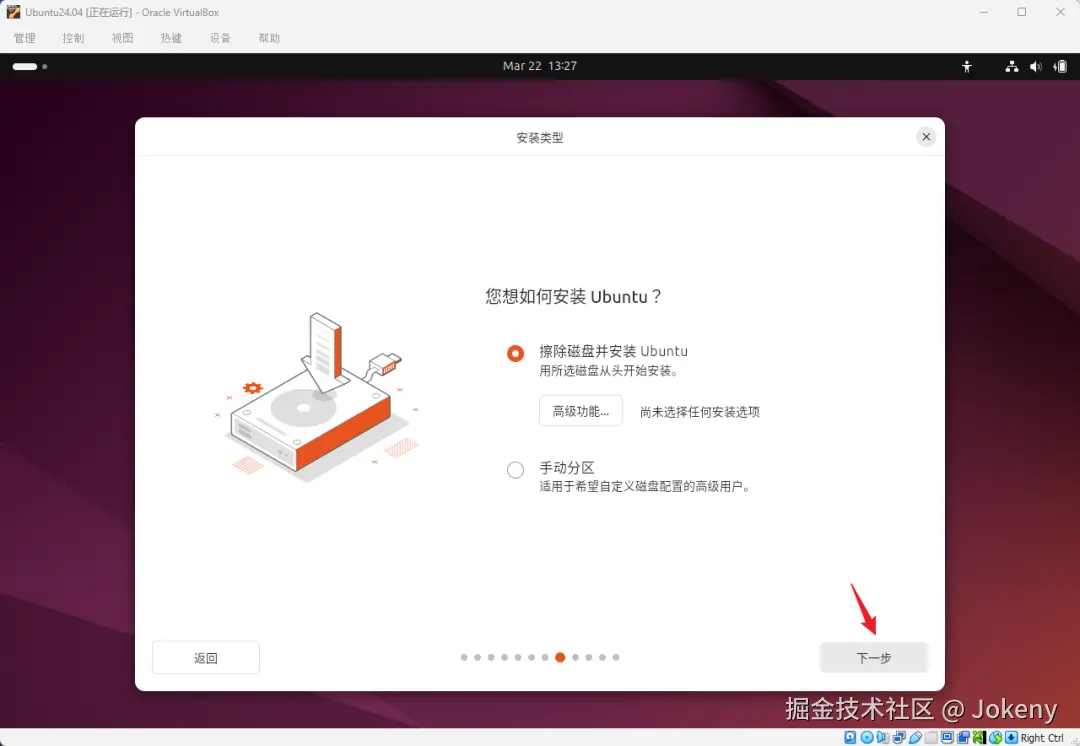

- 关键一步:取消勾选"继续进行无人值守安装"(我们要手动装,更可控)

硬件配置:

- 内存:建议给4GB,最低不能低于2GB,但也别超过你物理内存的一半

- CPU:给4核,最低2核,别超过实际核心数

- 虚拟硬盘:30GB够用,不用太大

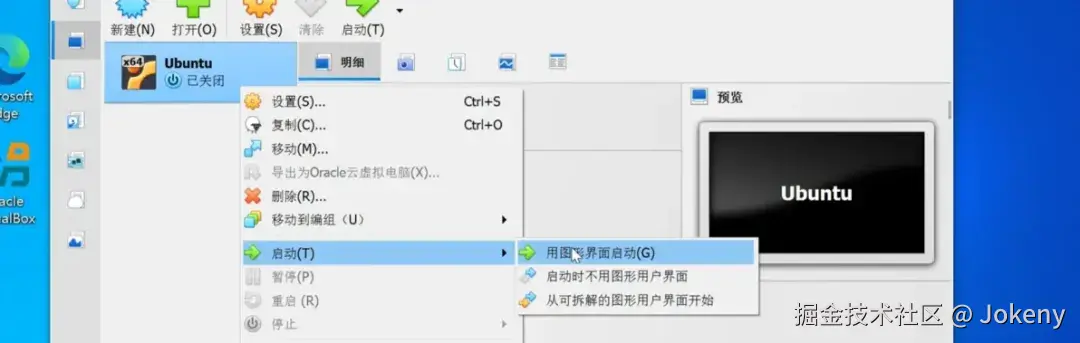

点"完成",右键刚创建的虚拟机,选择"启动" → "用图形界面启动"。

重要提示 :鼠标点进虚拟机窗口后,你会发现光标"被困住了"------按键盘右侧的Ctrl键就能切出来。记住这个操作,后面会经常用到。

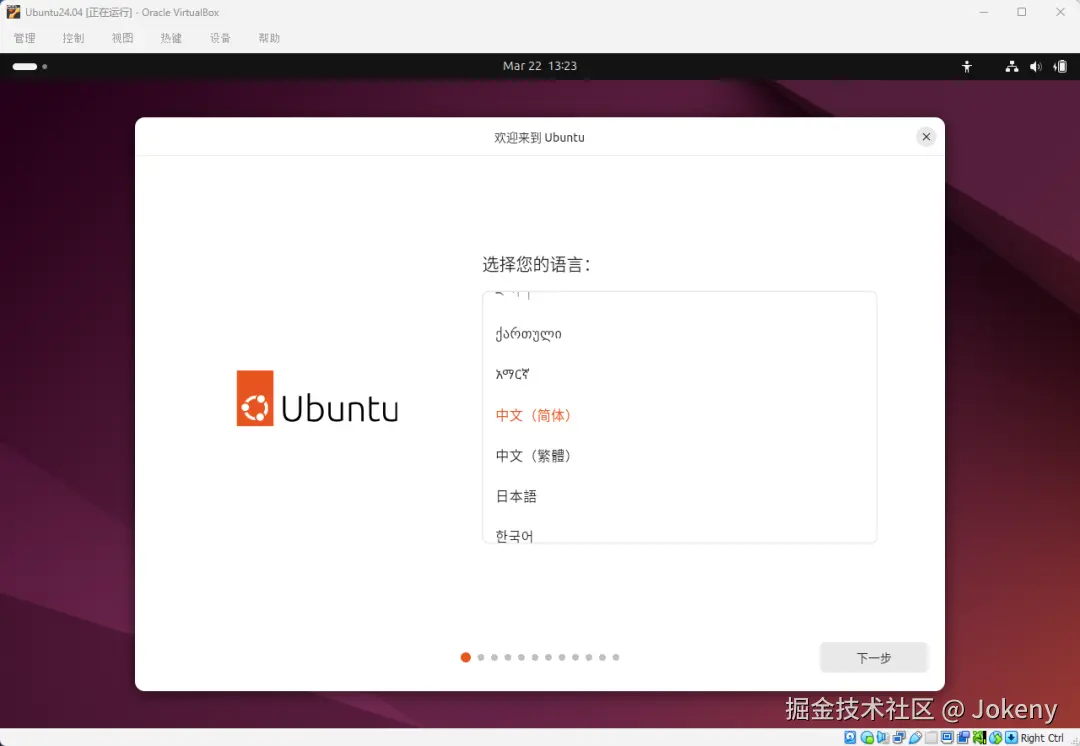

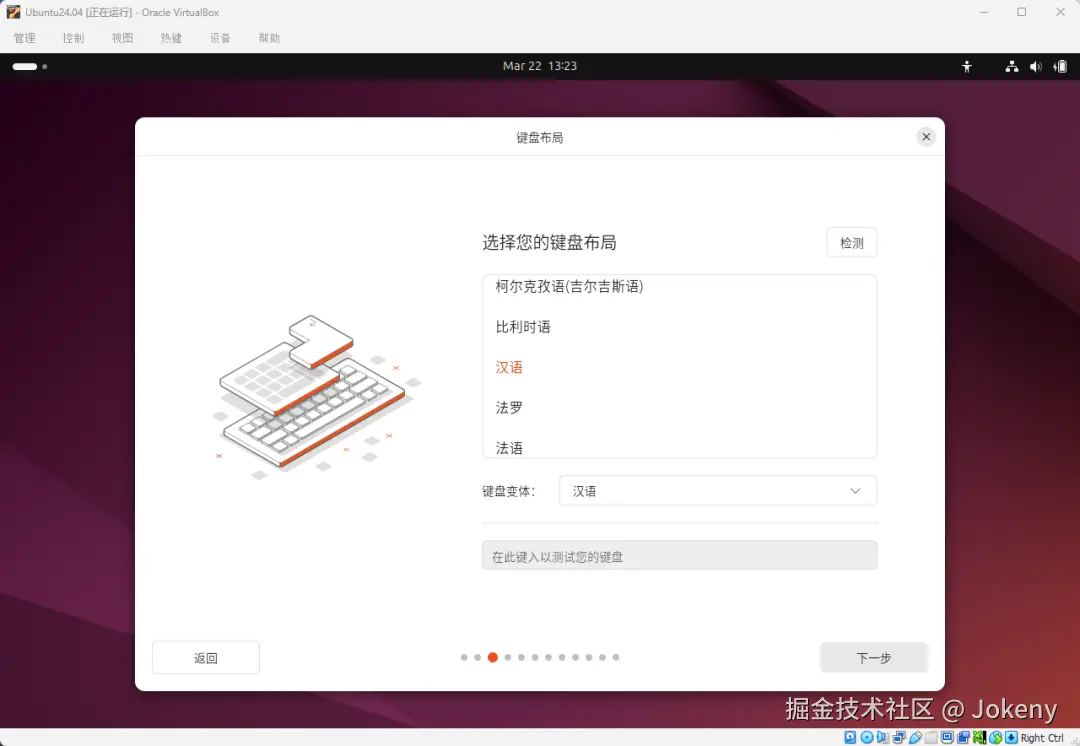

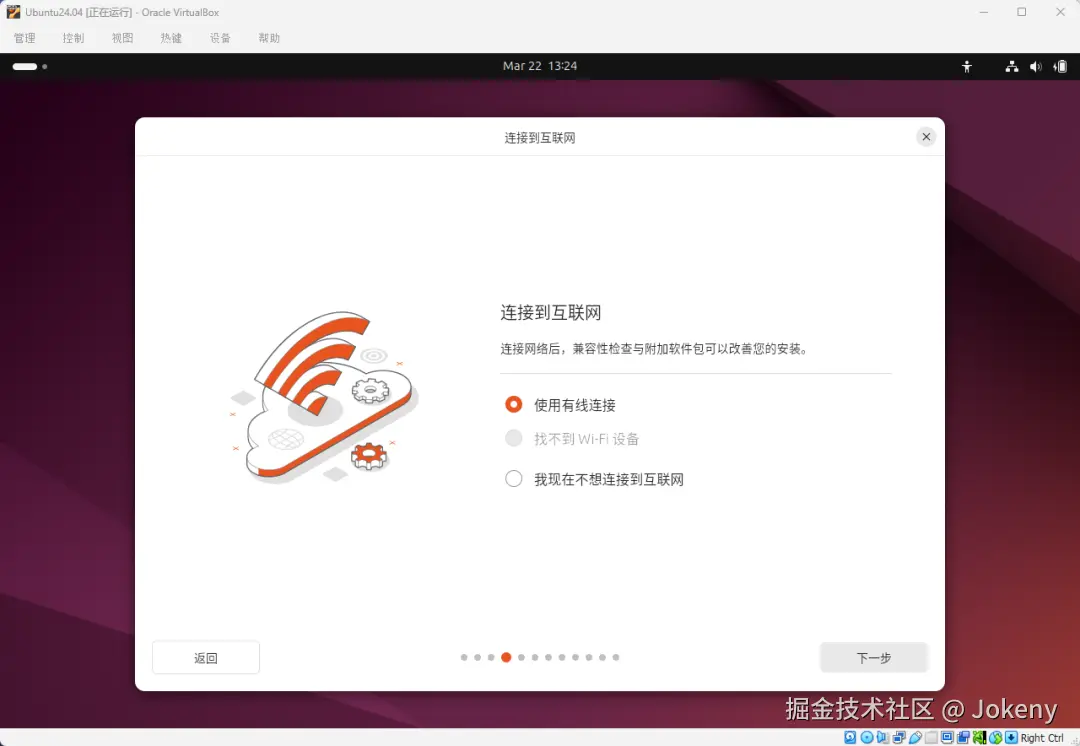

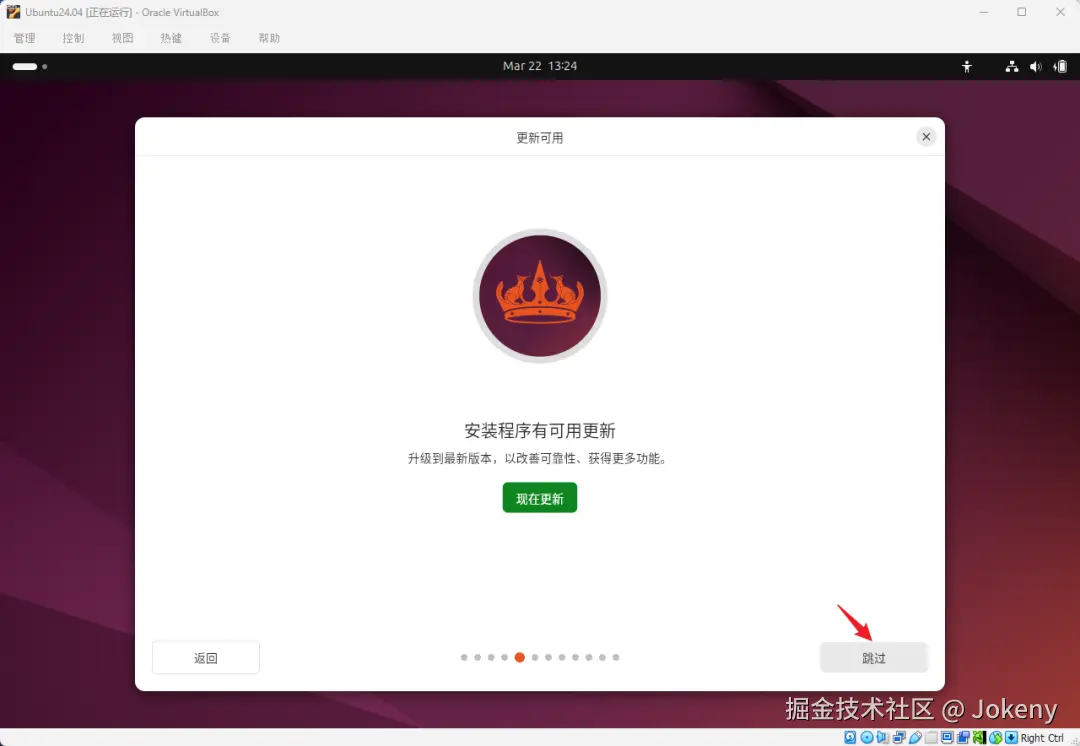

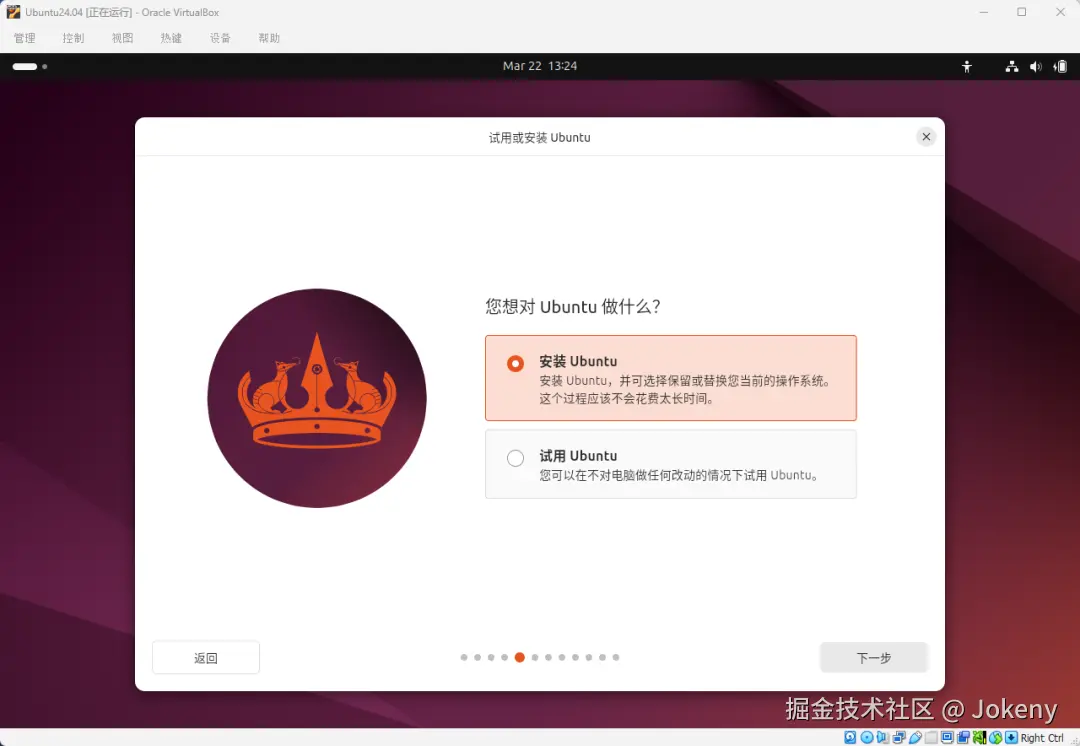

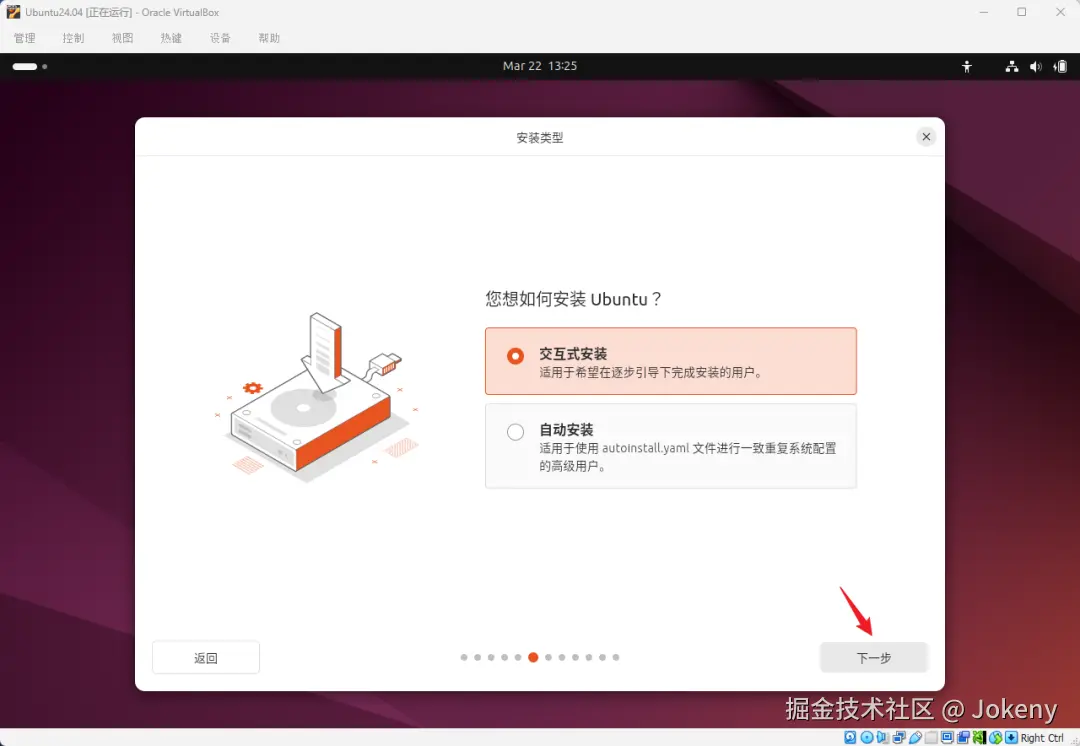

启动后看到黑色界面,选第一个"Try or Install Ubuntu",然后:

- 语言选"中文简体"

- 键盘布局选"汉语"

- 网络选"使用有线连接"(默认就行)

- 安装更新选"跳过"(装完系统再更新)

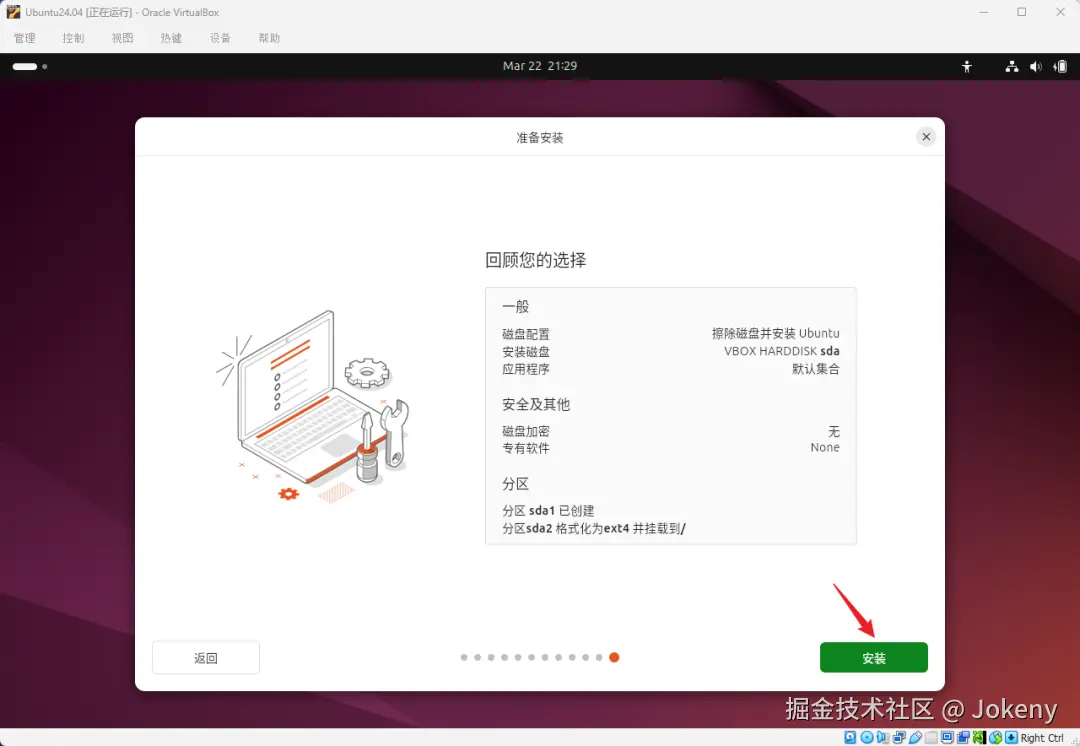

- 安装类型选"擦除磁盘并安装Ubuntu"(别怕,擦的是虚拟硬盘,不是你真硬盘)

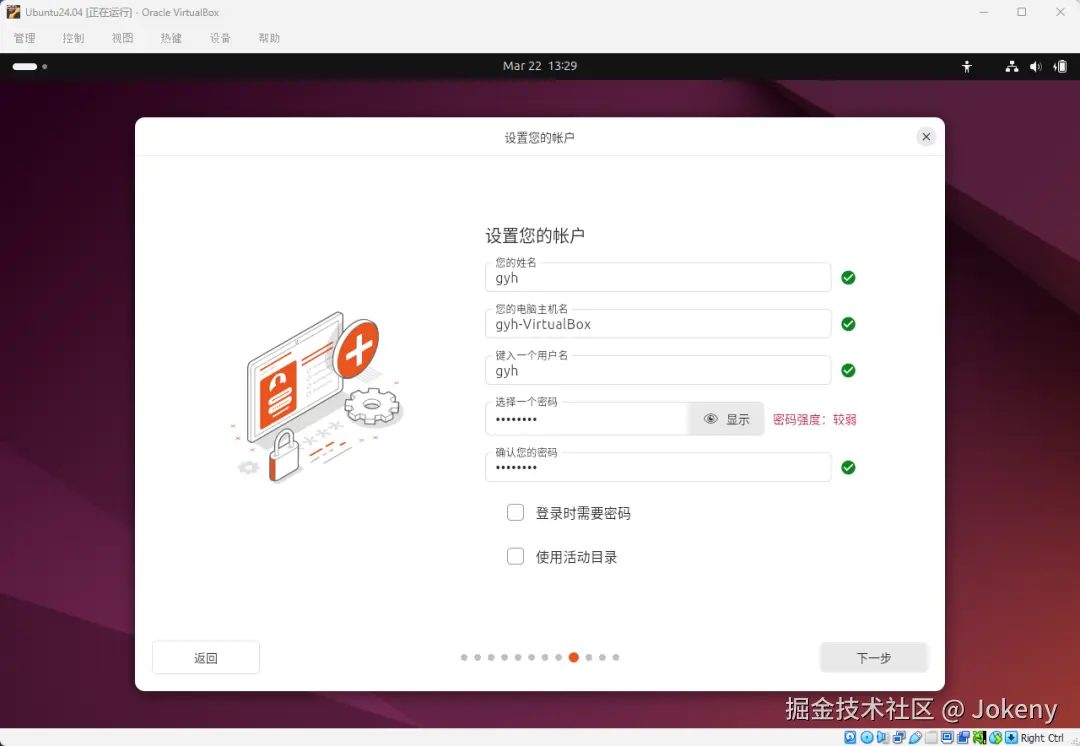

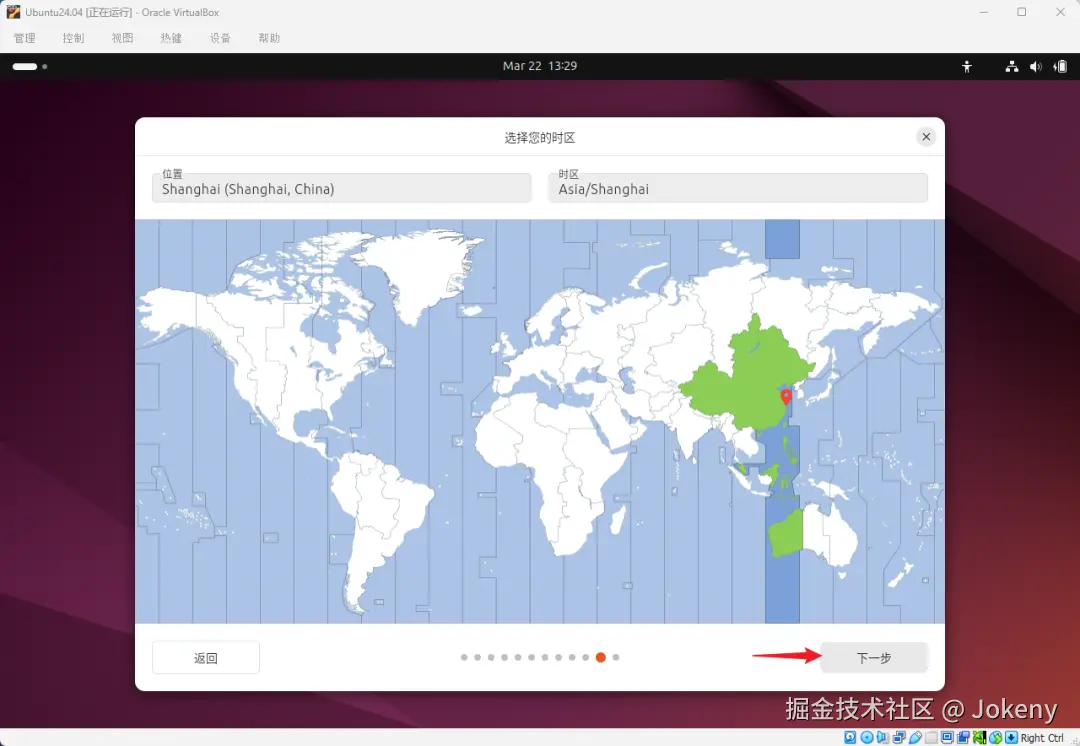

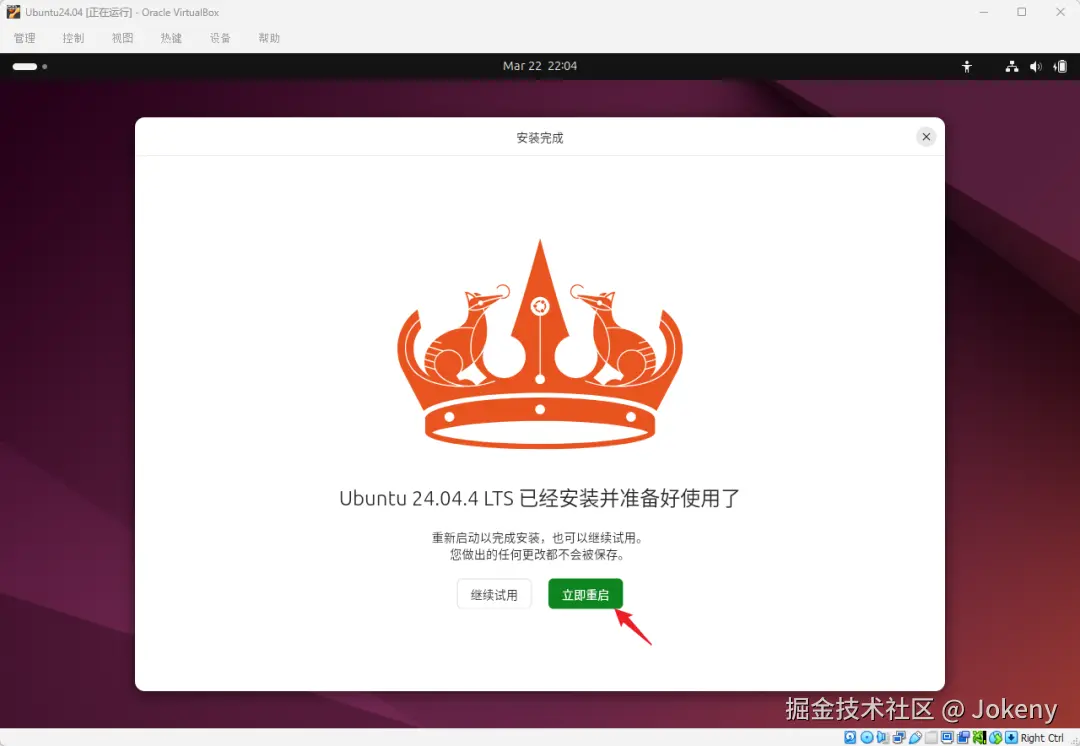

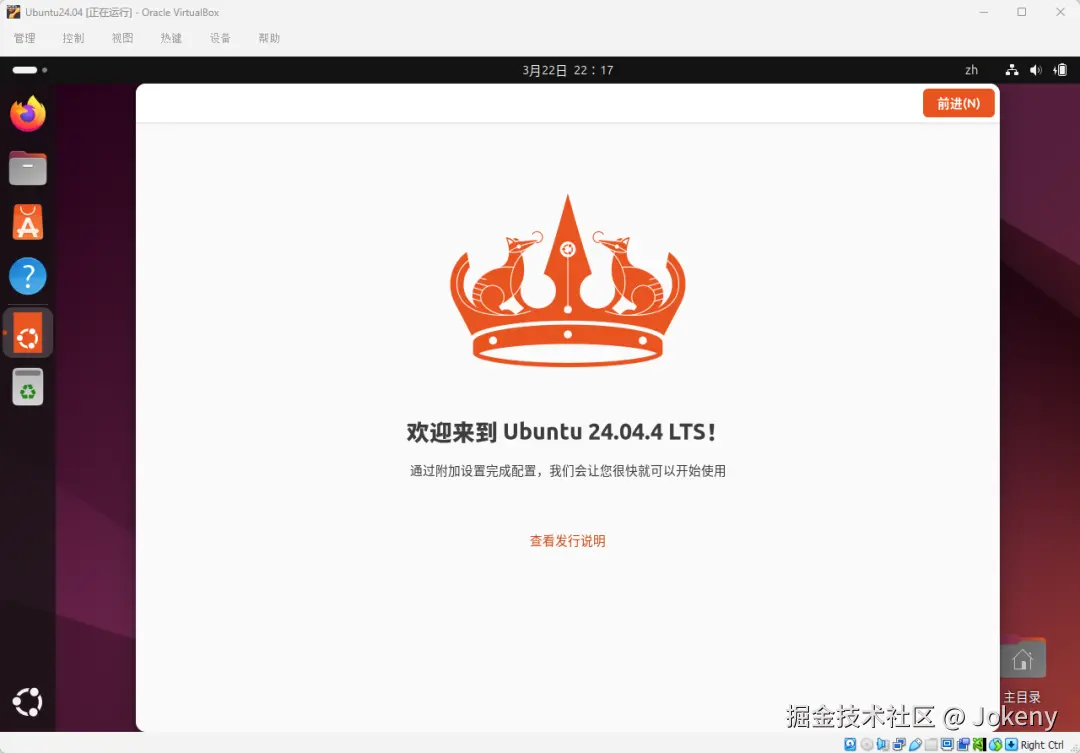

- 用户名和密码一定记牢,后面每一步都要用,取消登录时需要密码。然后点下一步、下一步,然后开始安装,这里安装需要耐心等待一段时间。

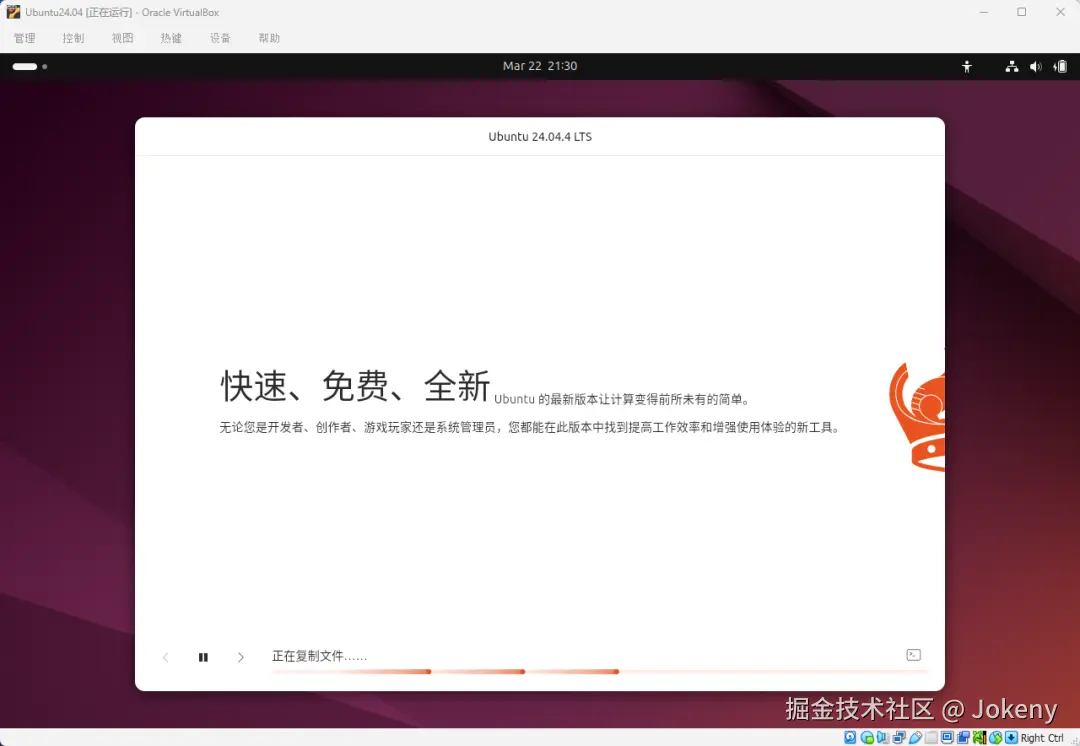

安装过程大概10-20分钟,取决于电脑性能,可以去泡杯茶。

五、打通虚实:让虚拟机和主机自由传文件

默认情况下,虚拟机和外面是"隔绝"的。我们要安装"增强功能",实现复制粘贴互通、文件直接拖拽。

第一步 :在虚拟机窗口顶部菜单,点击 设备 → 共享粘贴板 → 双向 ,然后 设备 → 拖放 → 双向。

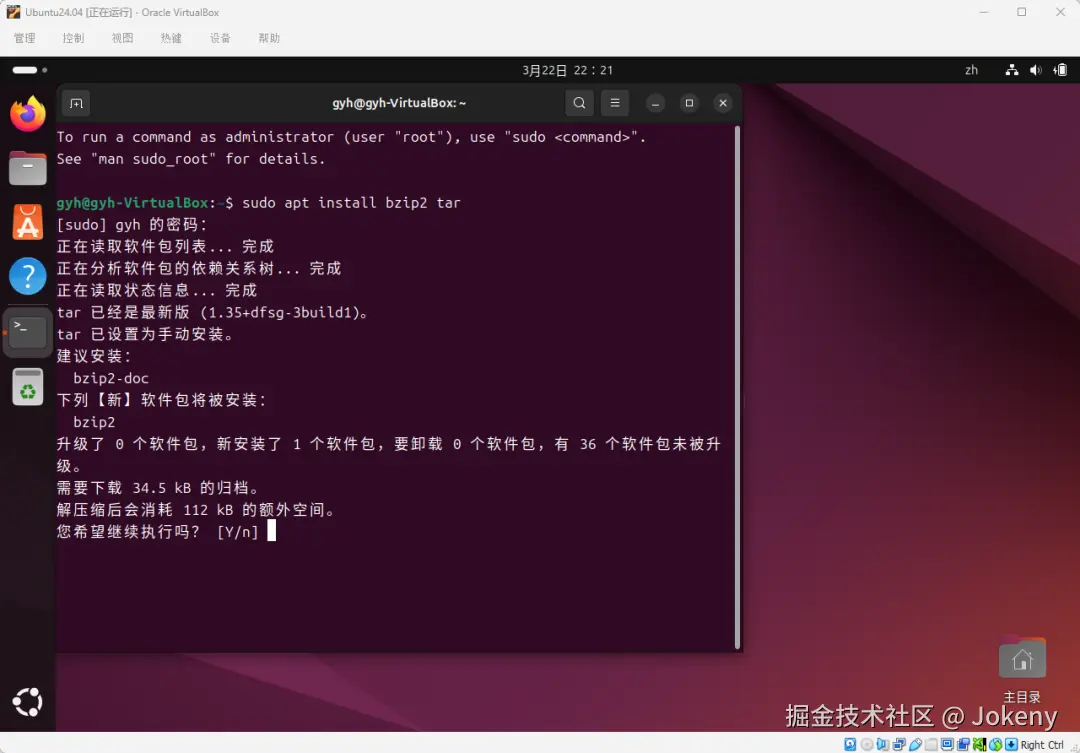

第二步:打开终端(点左下角应用列表,找到"终端"图标),输入:

sudo apt install bzip2 tar回车,输入你的密码(输的时候屏幕不显示,正常),然后输入 y 回车确认。

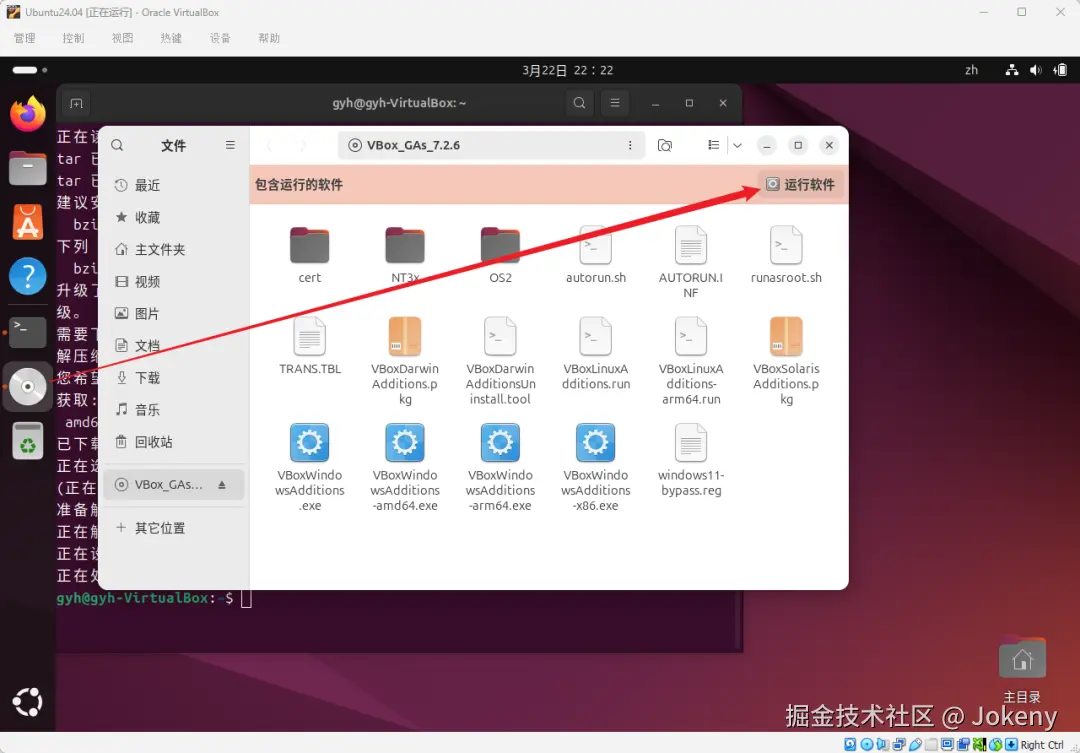

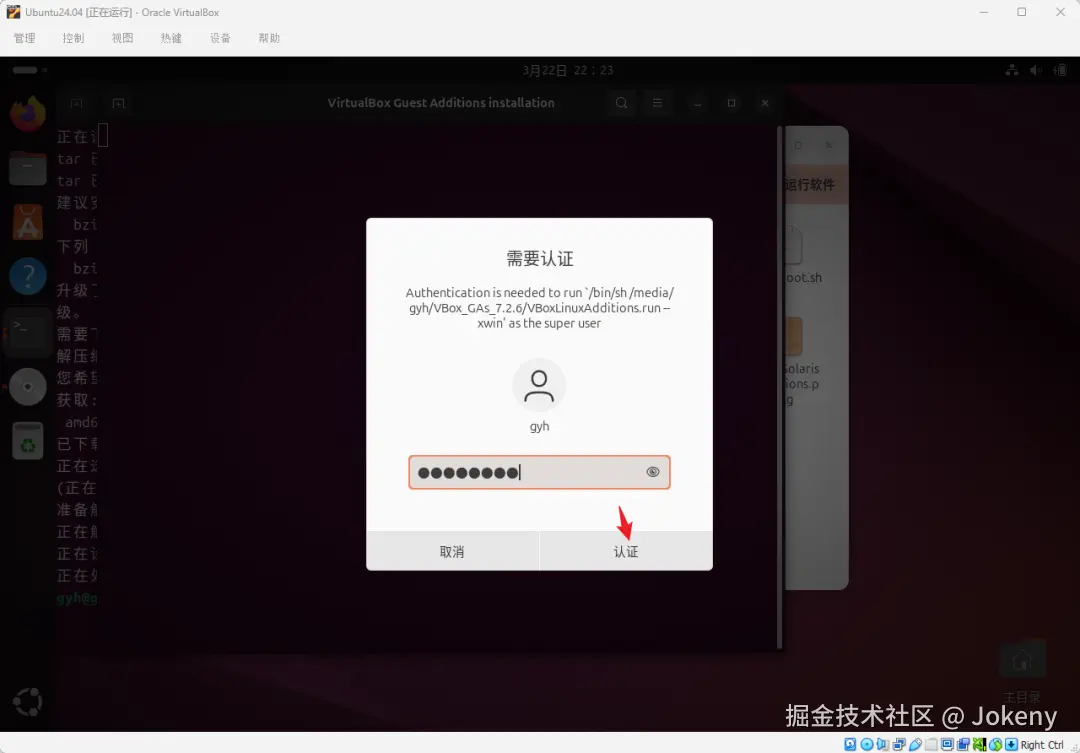

第三步 :点击 设备 → 安装增强功能。这时候桌面侧边栏会多出一个光盘图标,点开它,点右上角的"运行软件"按钮。

等它跑完,重启虚拟机。现在你就可以:

- 直接把文件从本地电脑桌面拖进虚拟机

- 在本地电脑中复制文字,虚拟机里直接粘贴

- 按 右Ctrl+F 全屏运行,体验跟真机几乎没区别

六、安装龙虾OpenClaw:核心步骤来了

重启进入Ubuntu桌面后,我们开始安装OpenClaw。

1. 更新系统并安装基础工具

点左下角"显示应用",找到终端图标打开,然后执行命令:

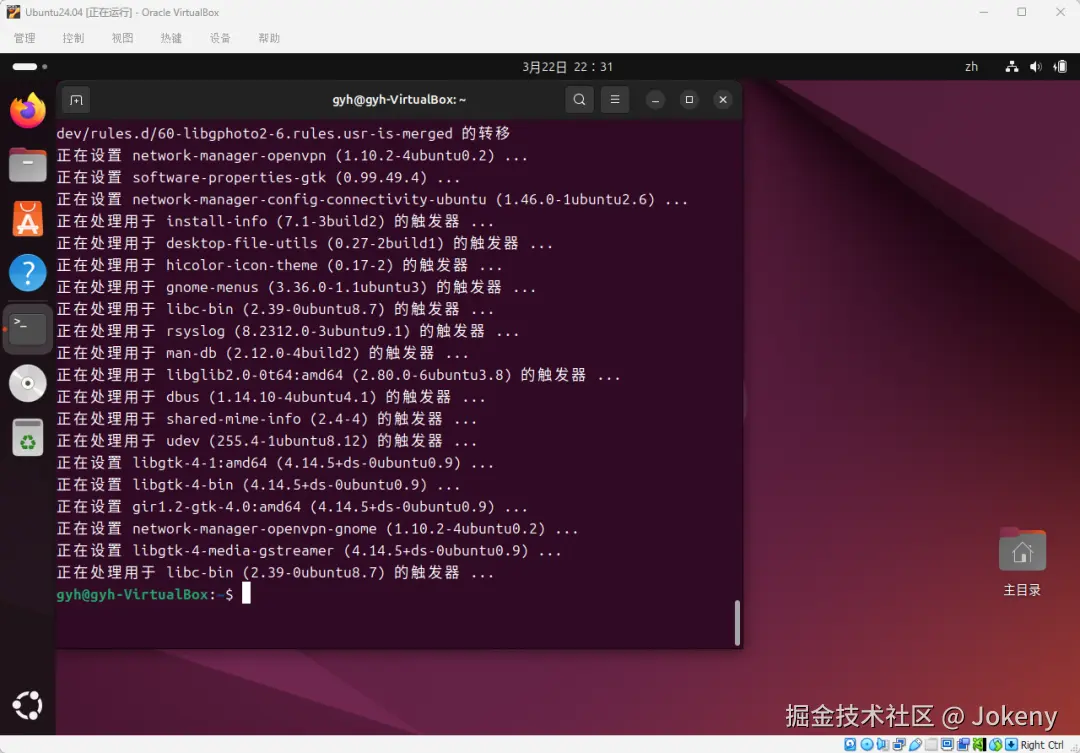

sql

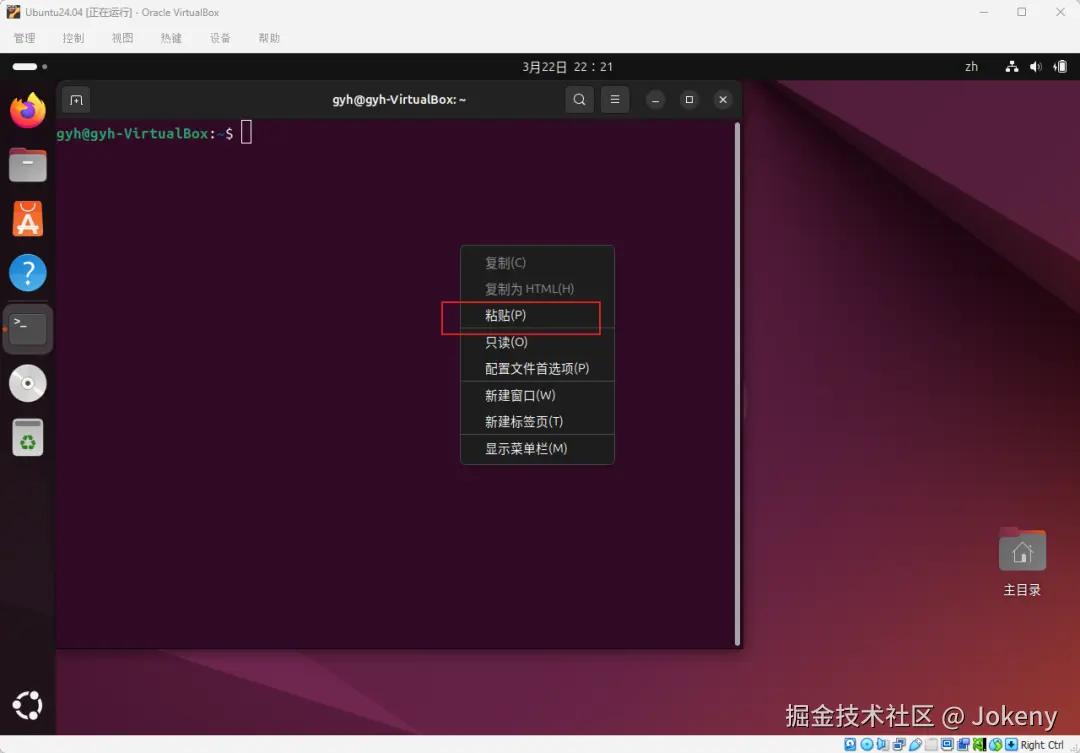

sudo apt update && sudo apt upgrade -y注意,在Ubuntu系统中,粘贴的快捷键是Shift+Insert或鼠标右键

运行时需要我们输入密码,然后回车。

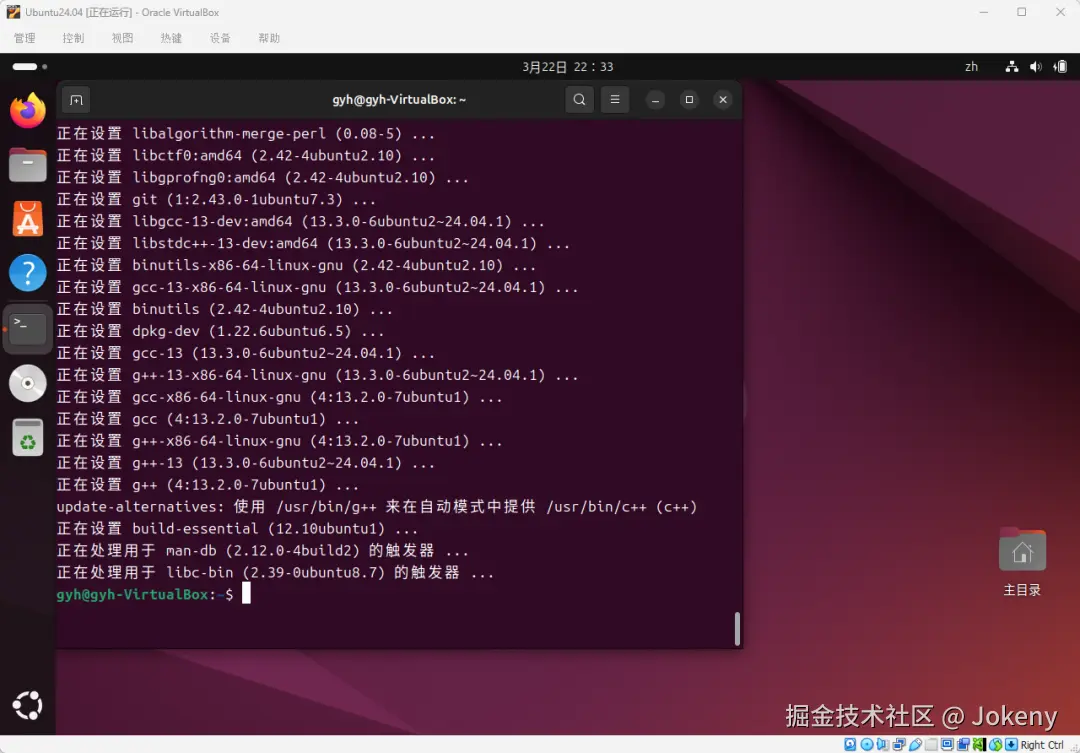

等待一会后,我们再输入第二行命令

sudo apt install -y curl git build-essential

2. 安装Node.js

这里我们重新打开一下终端,然后开始安装Node.js,我们将下载命令复制粘贴到终端,然后回车。

arduino

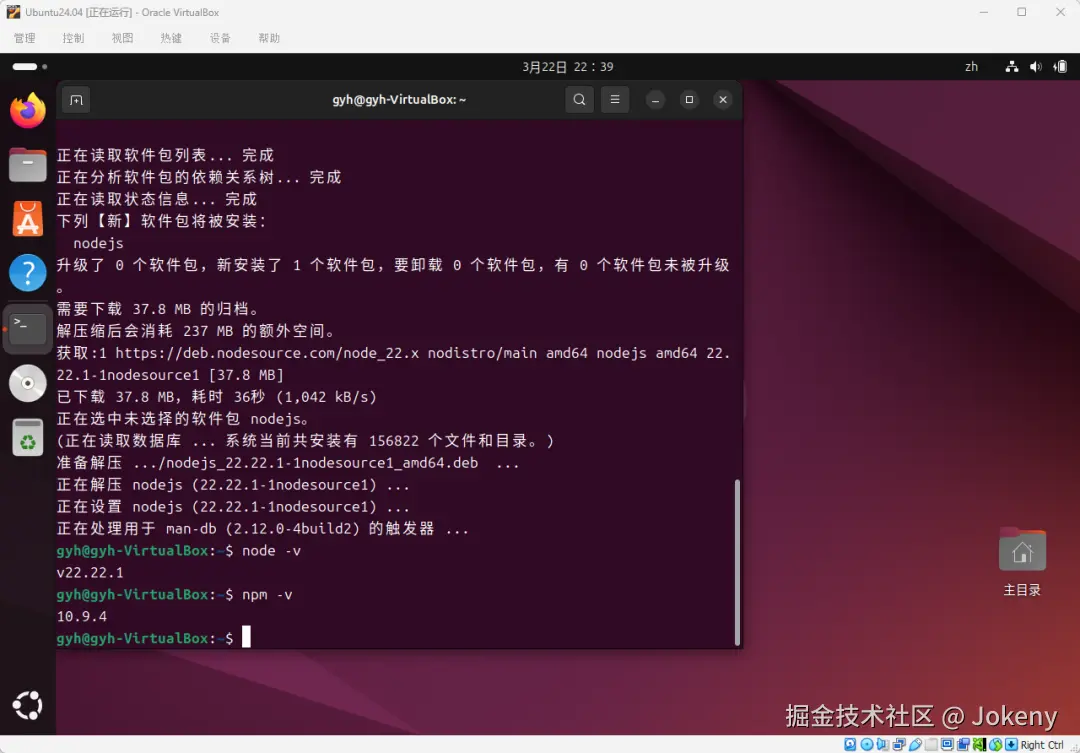

curl -fsSL https://deb.nodesource.com/setup_22.x | sudo -E bash - && sudo apt install -y nodejs输入密码,等待安装完成。接着我们输入node -v来验证安装。

bash

# 查看node版本

node -v

# 查看npm版本

npm -v如下图所示,输出了版本号,即为安装成功。

3. 安装OpenClaw

根据OpenClaw官方文档,执行安装命令。

arduino

curl -fsSL https://openclaw.ai/install.sh | bash

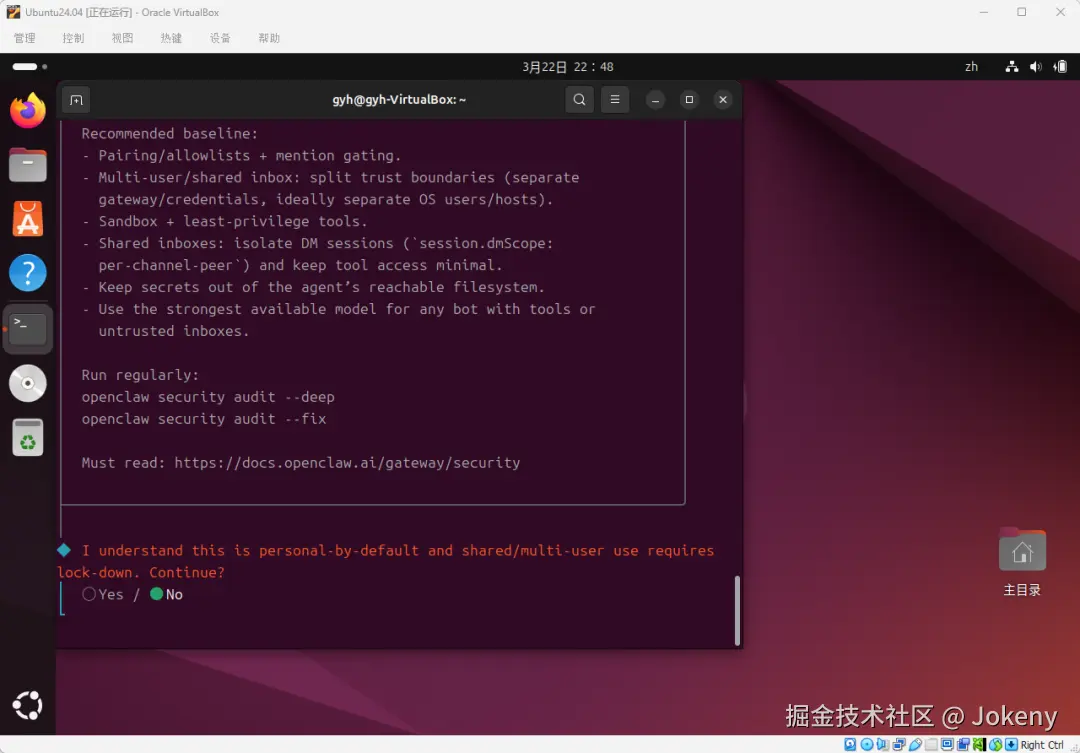

csharp

I understand this is personal-by-default and shared/multi-user use requires lock-down. Continue?Yes / ● No这是在问:

"我理解这个默认是个人使用的,如果要用在多用户/共享环境,需要进行安全加固。继续吗?"- Yes = 我理解了安全风险,继续运行/安装

- No = 取消

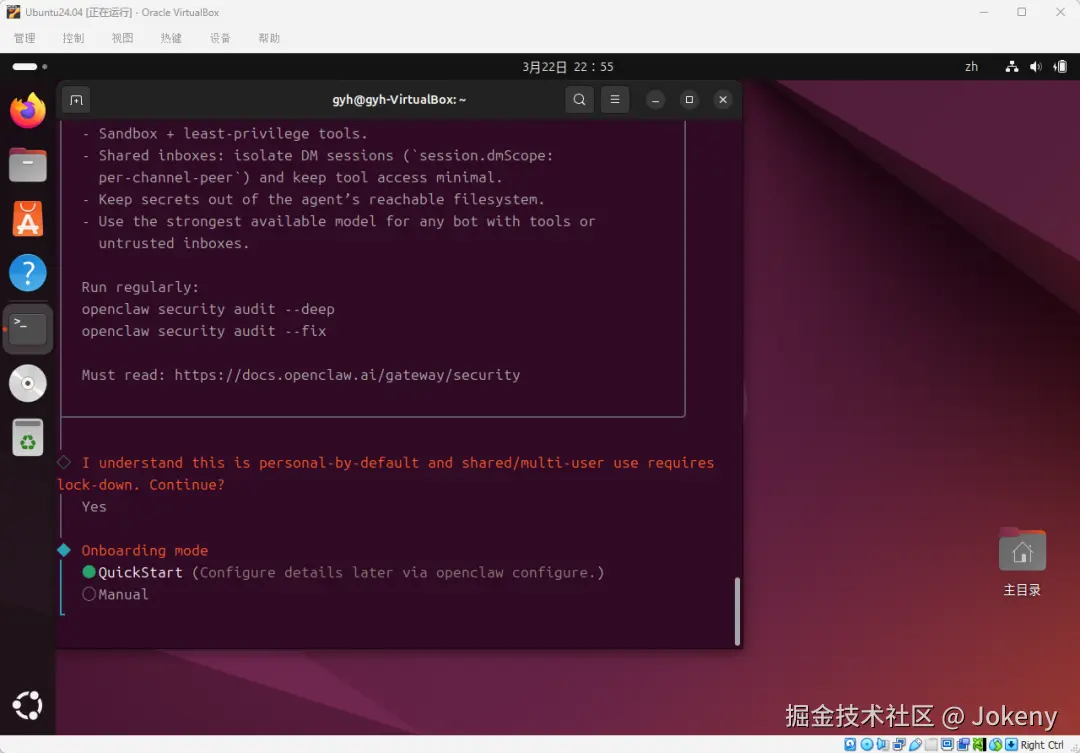

选 Yes 后回车即可(通过方向键左右移动来选中)。

这一步会让我们对龙虾进行配置,选择QuickStart后回车 (通过方向键上下移动来选中) 。

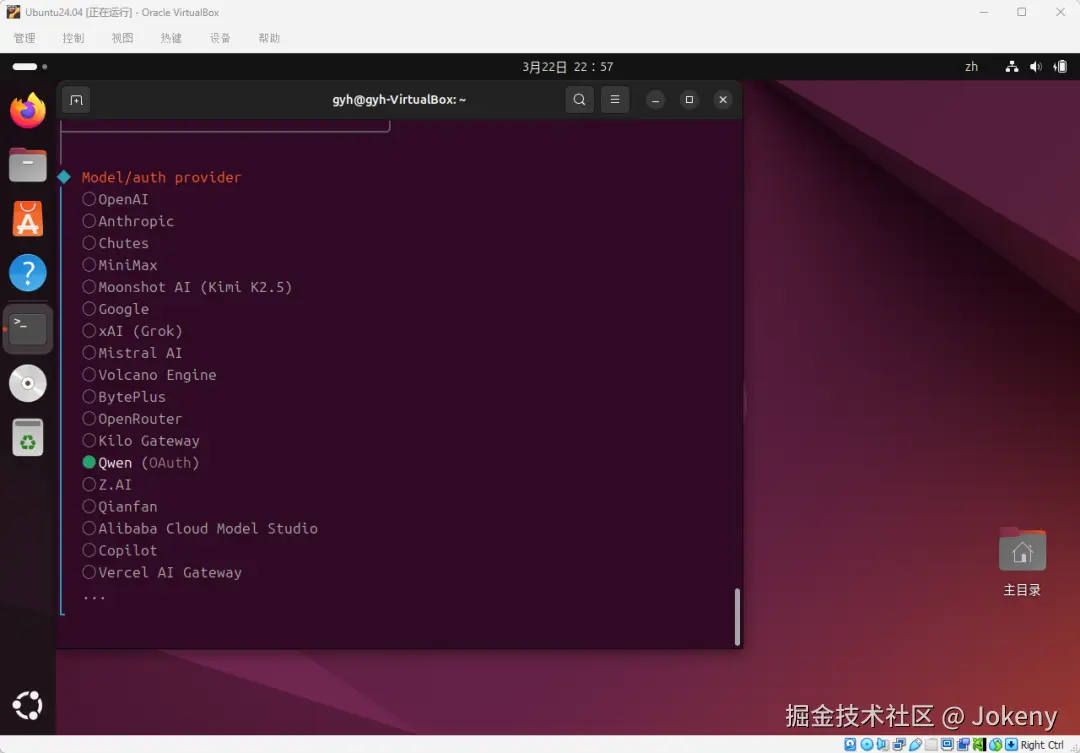

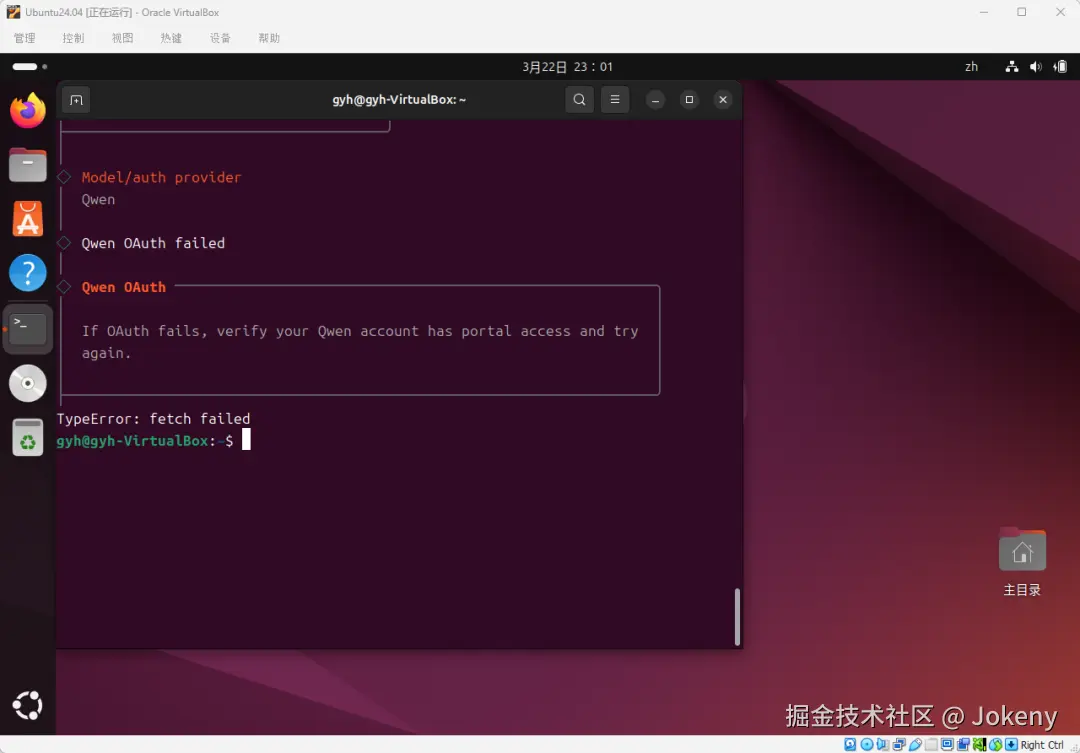

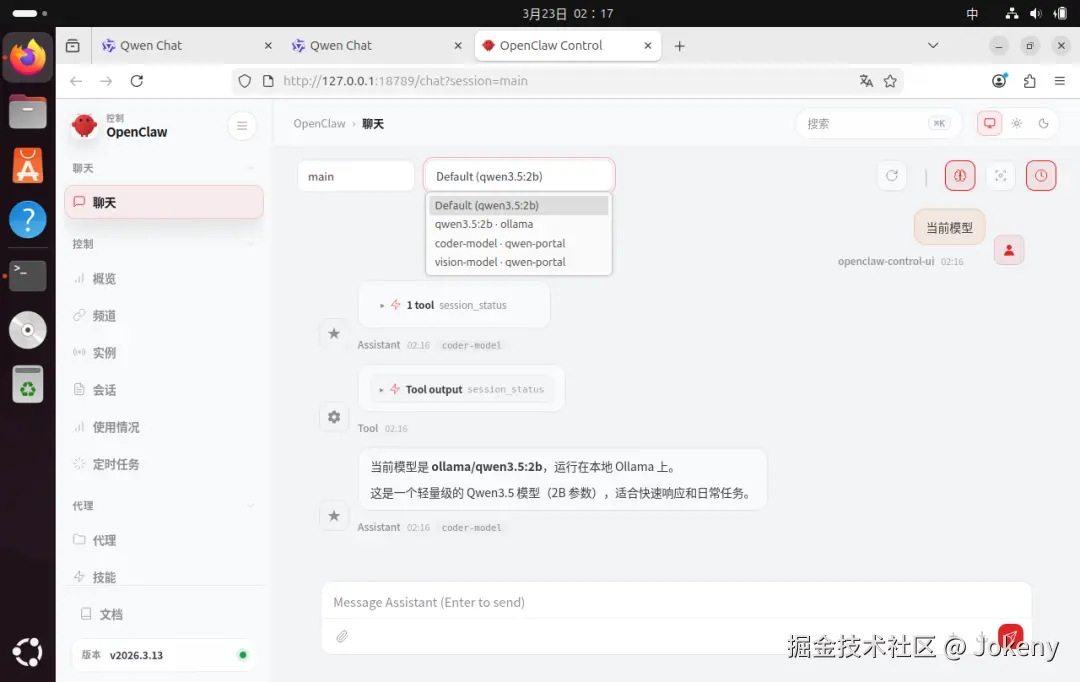

就只就是模型选择,这里我们选择Qwen,因为Qwen可以白嫖一定的免费额度。

如果这一步出现报错,可以直接截图给到Kimi或者DeepSeek去提问,让它给出解决方案。

最好是每执行一步报错后都问一下AI,直到最后解决为止。

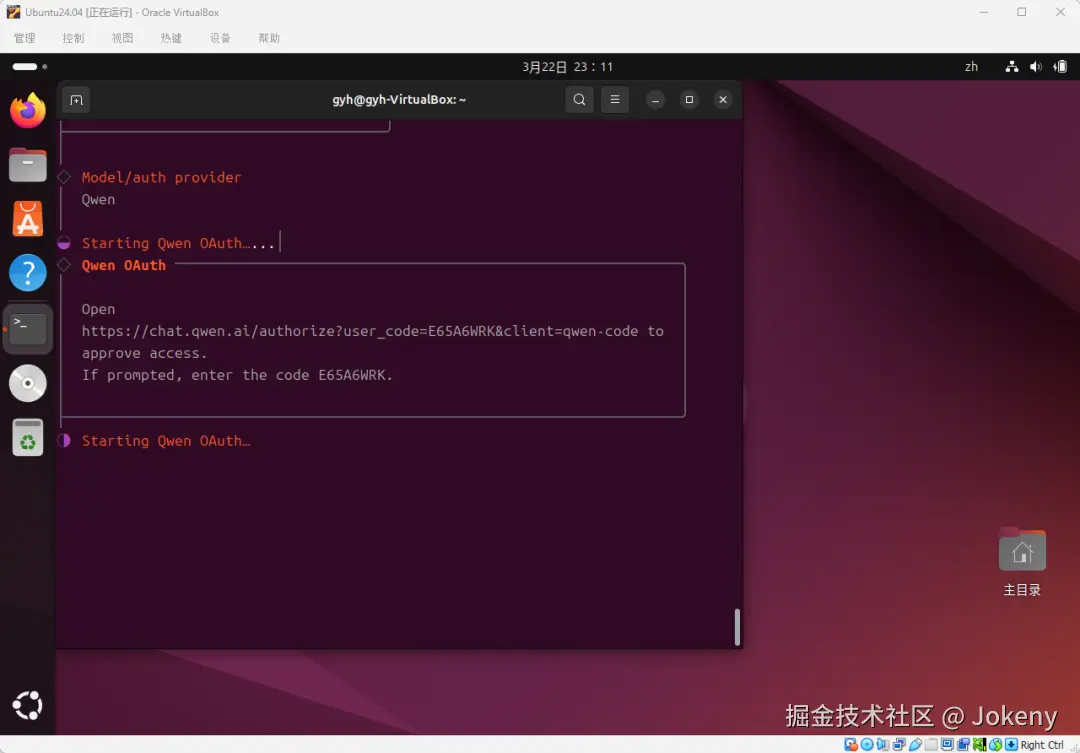

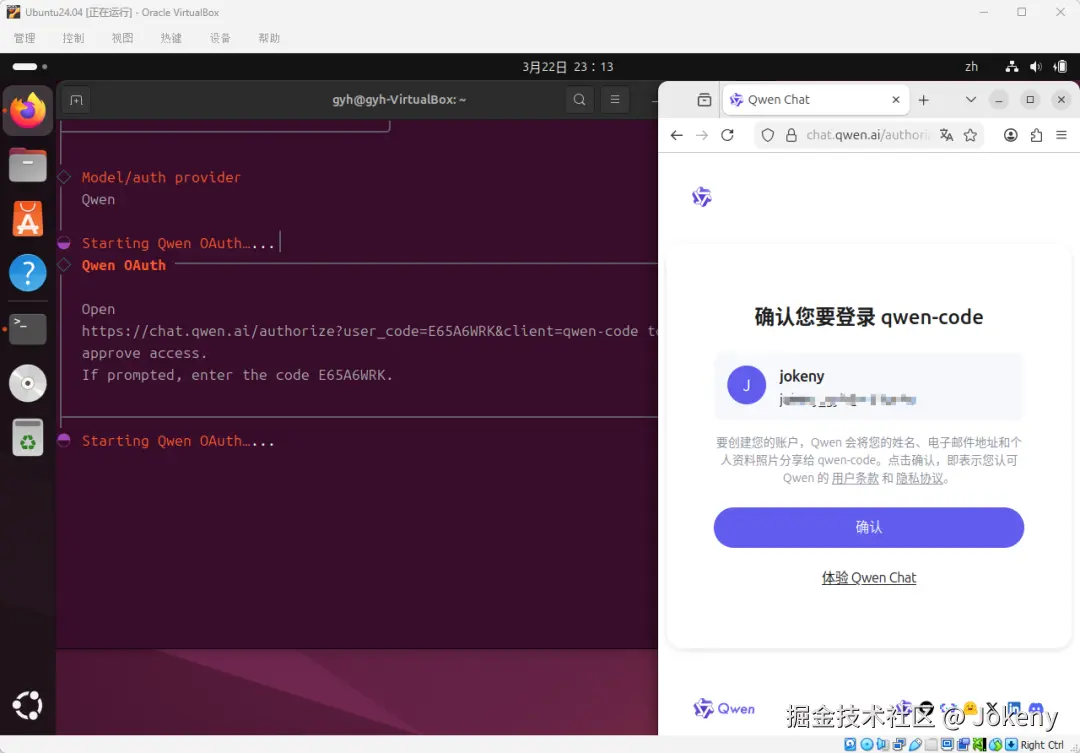

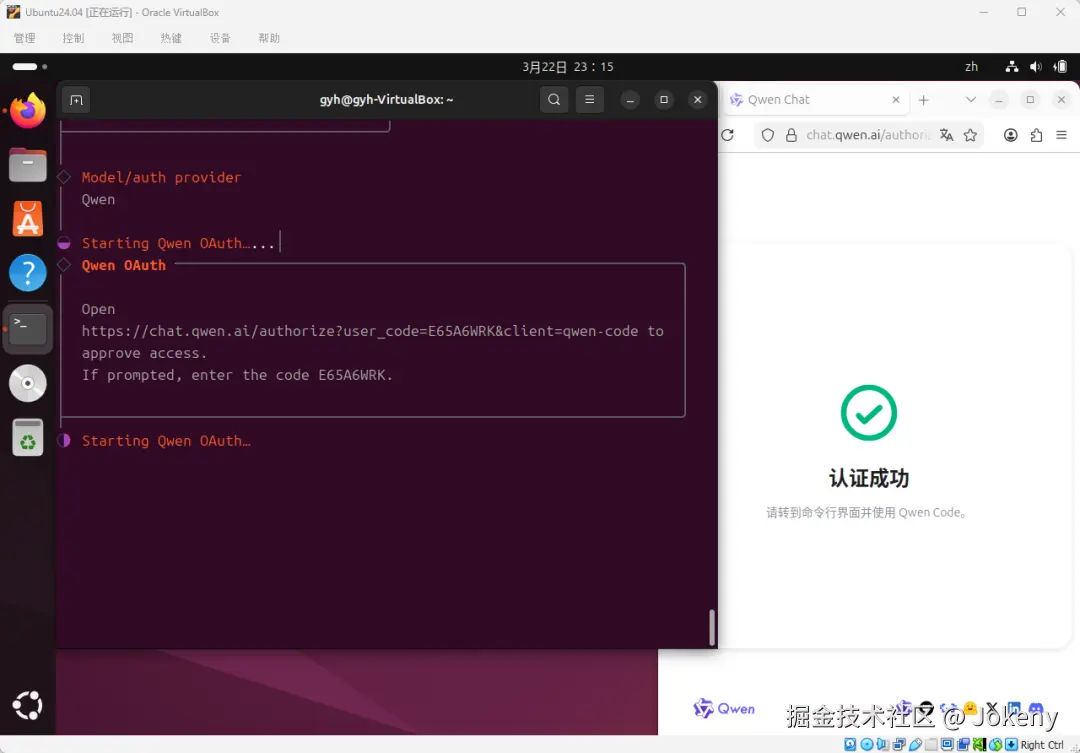

正常没有报错时,它会弹出一个授权页面,这里我们进行注册登录。

如果网页没有自动打开的话,可以将命令行中https到code为止的这段地址,复制到浏览器中打开。

这个地方如果认证成功后,命令一直停留在授权中,可以先终止,再执行下面的命令来重新配置和选择模型。

css

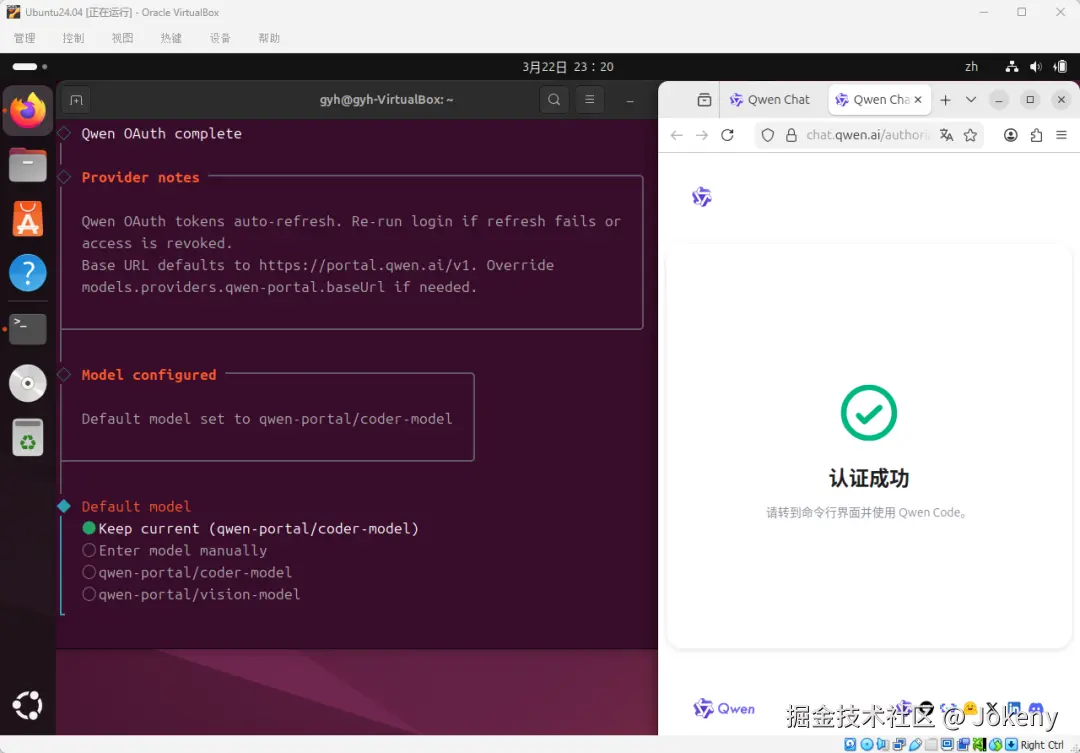

openclaw onboard --install-daemon授权成功后将会看到下图显示的界面:

这里选择Keep current,保持当前。

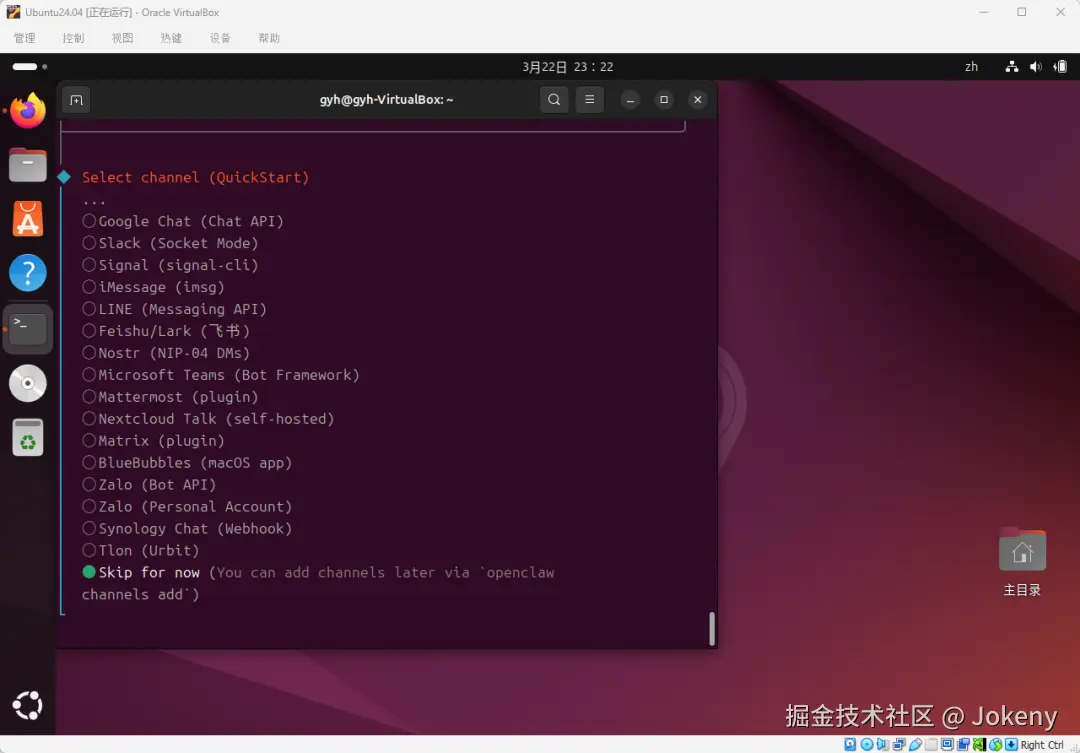

这里是选择用什么聊天软件跟龙虾沟通,这里我们选择Skip for now,先跳过,一会再来配置。

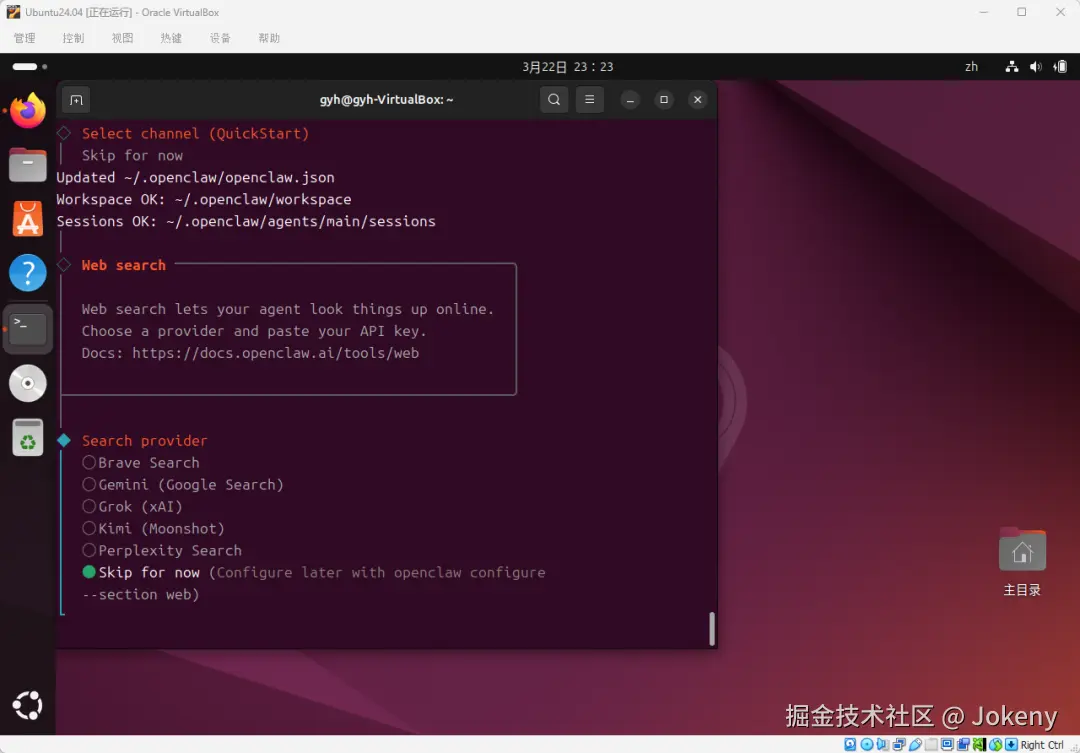

再就是搜索引擎这里也选择Skip for now,先跳过。

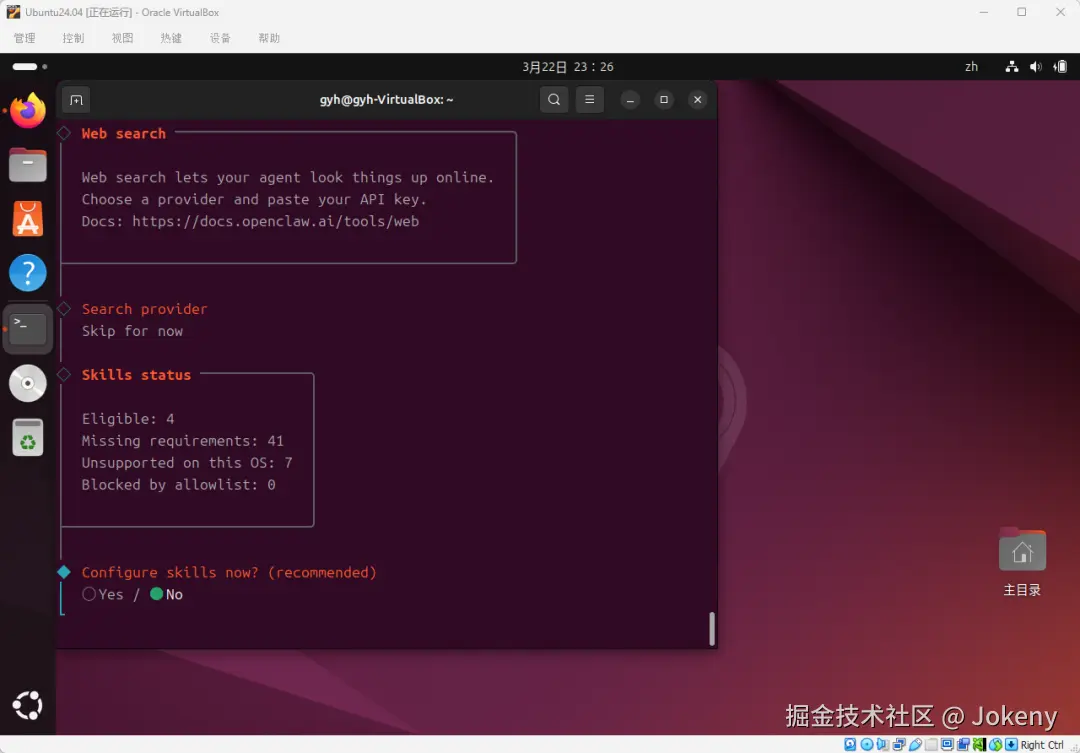

配置技能这里也先跳过,选择No

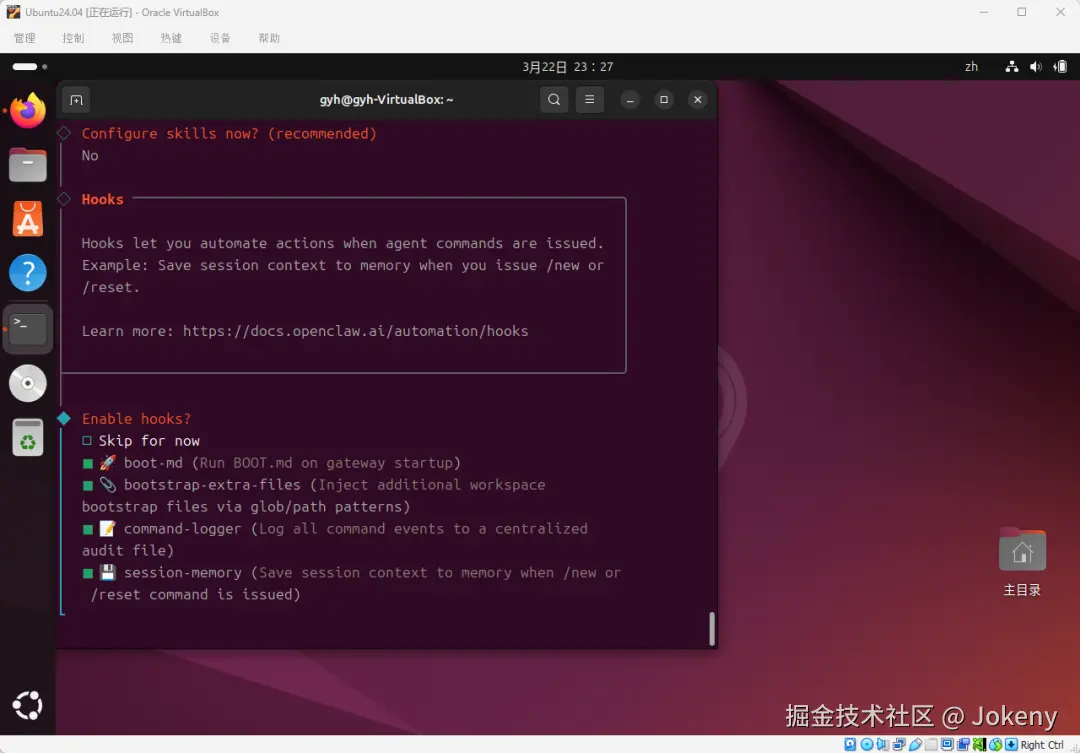

最后,hooks这里不要跳过,这是当遇到问题时如何处理的方式,我们通过按空格的形式把它都选上。

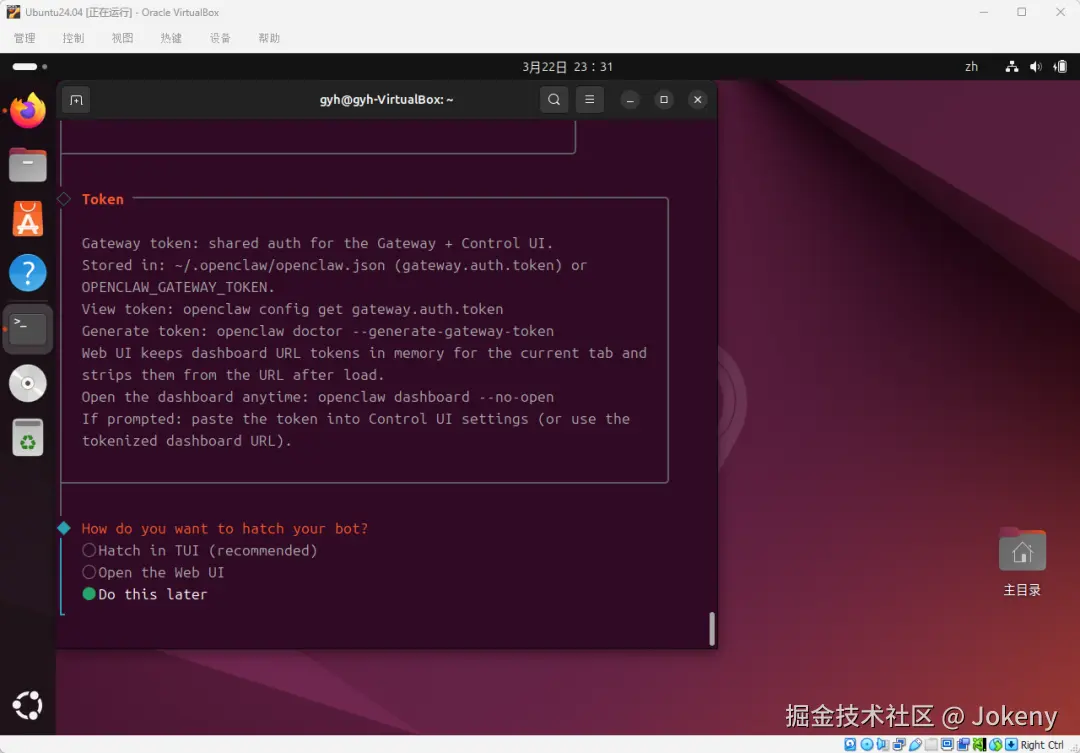

这是让你选择用什么方式来继续配置你的 AI 机器人,先跳过,以后再配置。

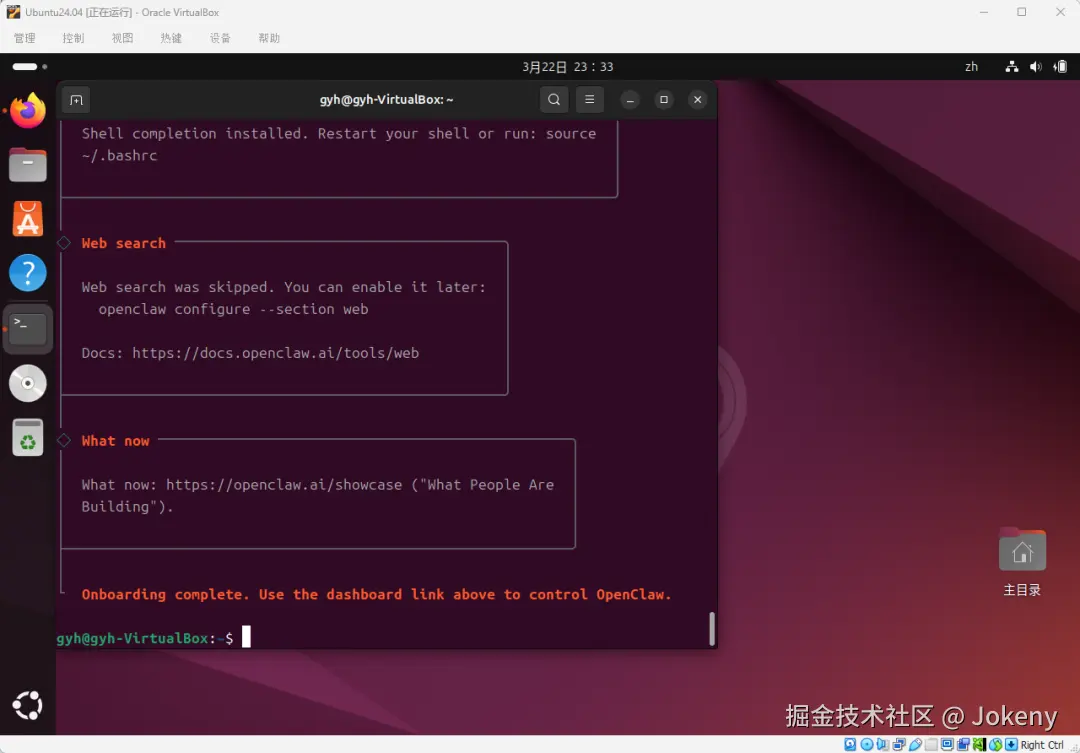

以上表示OpenClaw安装完成了。

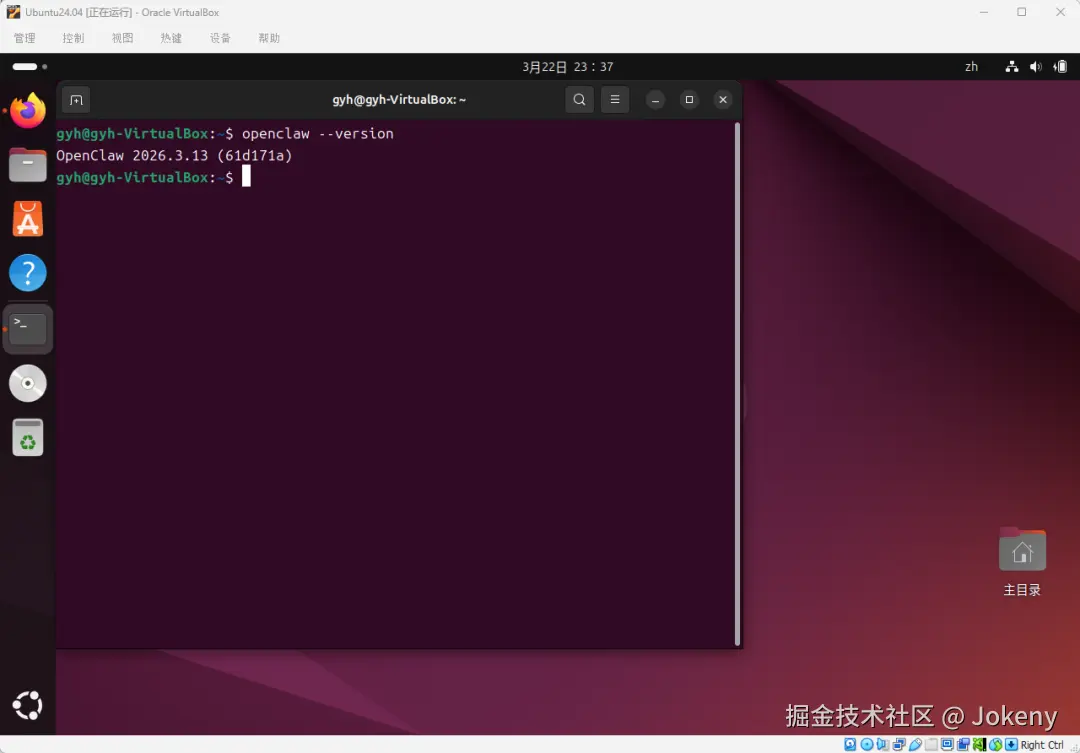

4. 验证安装

输入:

css

openclaw --version能看到版本号,说明安装成功。

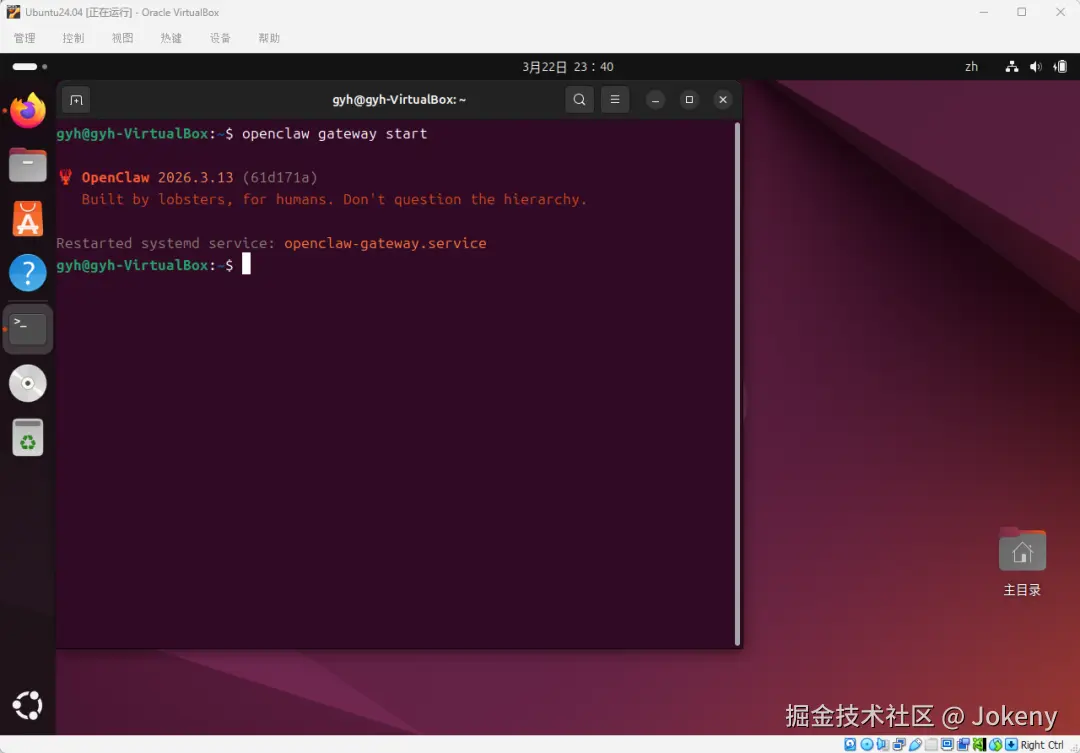

5. 启动OpenClaw

根据官方指引启动网关服务:

sql

openclaw gateway start

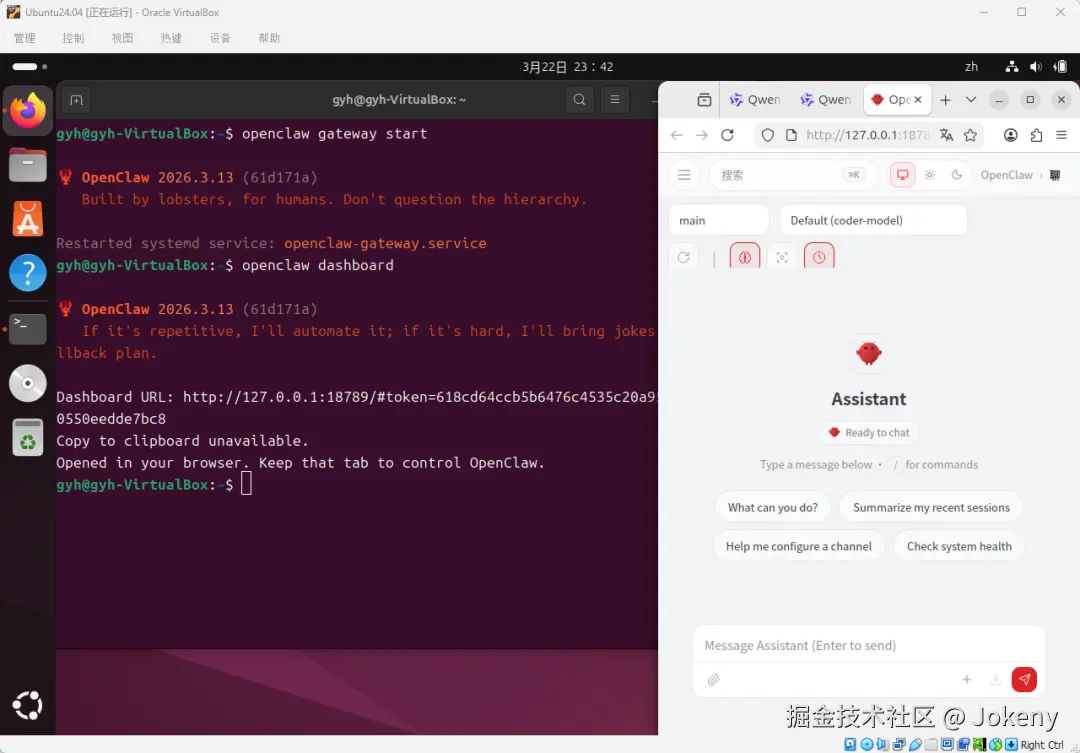

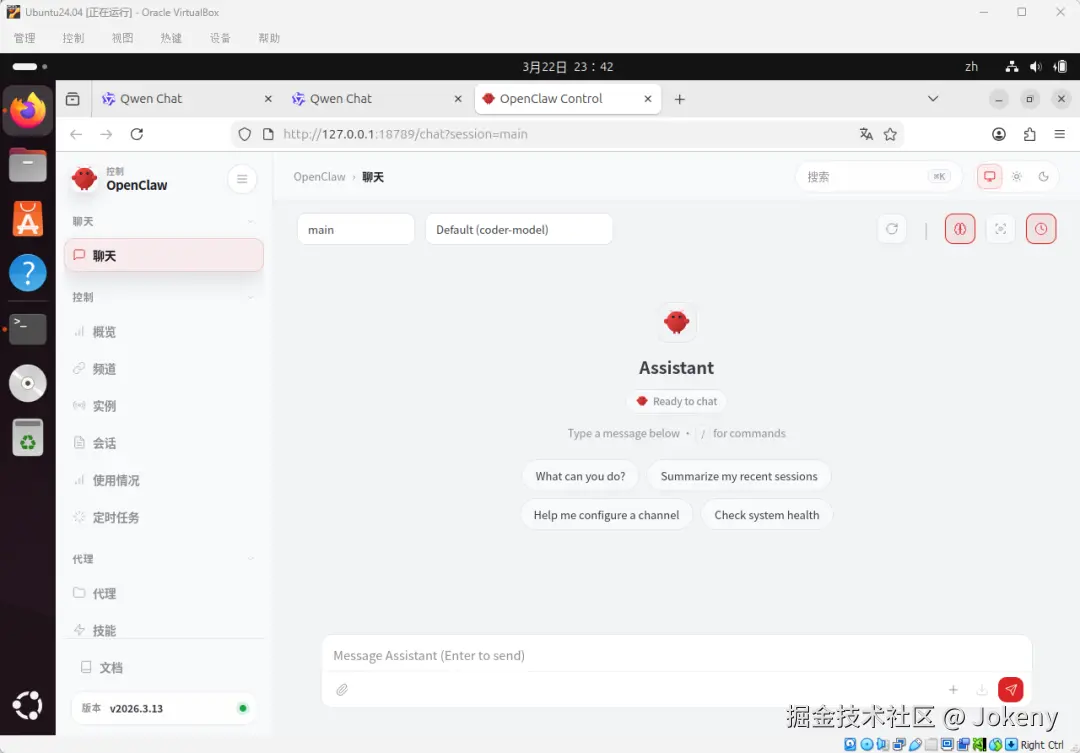

打开 Web 控制界面 :

openclaw dashboard如果浏览器没自动打开,可以手动访问:http://localhost:3000

(具体端口看官方文档),能看到OpenClaw的Web界面,说明跑起来了。

七、方案A:真正的隐私------本地部署大模型(完全离线)

前提条件:你的电脑需要有独立显卡,显存至少8GB(推荐12GB以上)。如果只有核显或低端显卡,这个方案跑不动,只能看方案B。

之前写过一篇 Ollama + DeepSeek 如何本地私有化部署的文章,也可以作为详细教程参考:

快上车!3 步搞定 DeepSeek 本地部署,小白也能轻松逆袭!

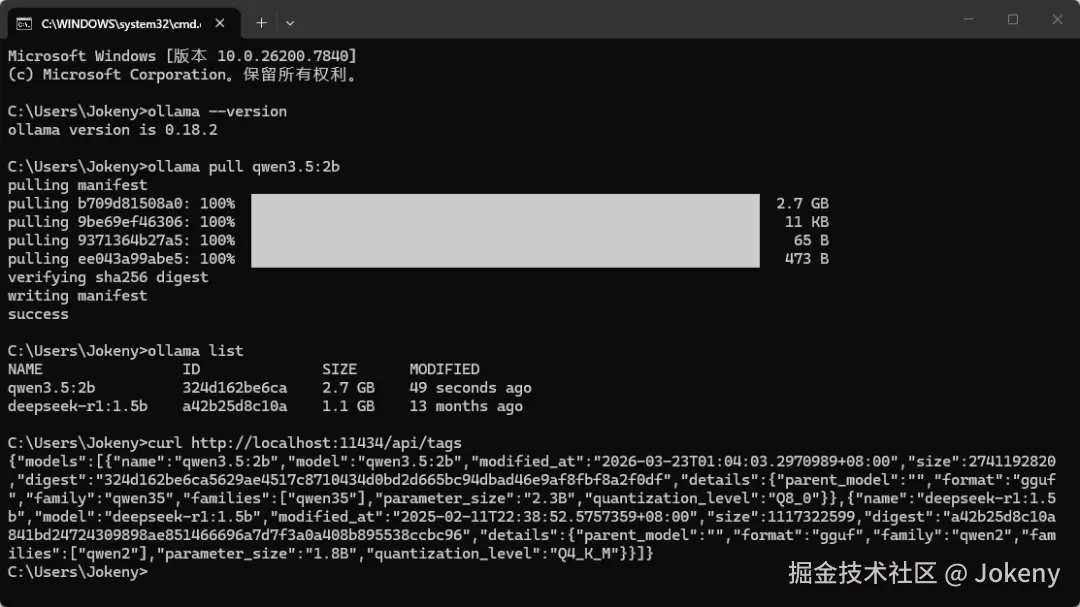

1. 安装Ollama(本地大模型管理工具)

Ollama是目前最简单的本地大模型运行方案,官网:ollama.com

安装命令:

arduino

curl -fsSL https://ollama.com/install.sh | sh安装完成后,验证:

css

ollama --version

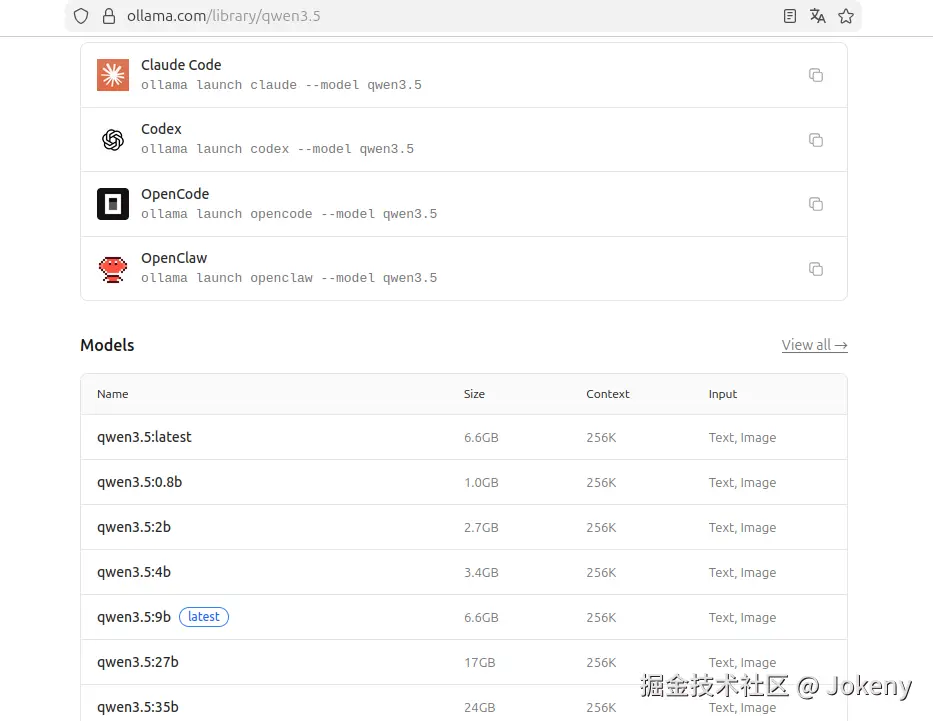

2. 下载并运行本地模型

根据你的显存大小选择模型:

显存8GB:选Llama 3.1 8B 或 Qwen 3.5 9B

ollama pull llama3.1:8b显存12GB+ :可以跑Llama 3.1 70B的量化版,或DeepSeek-Coder 33B

ollama pull deepseek-coder:33b显存16GB+ :几乎主流模型都能跑

ollama pull qwen3.5:35b这里我选择Qwen 3.5 2B(根据自己电脑显卡来)

ollama pull qwen3.5:2b

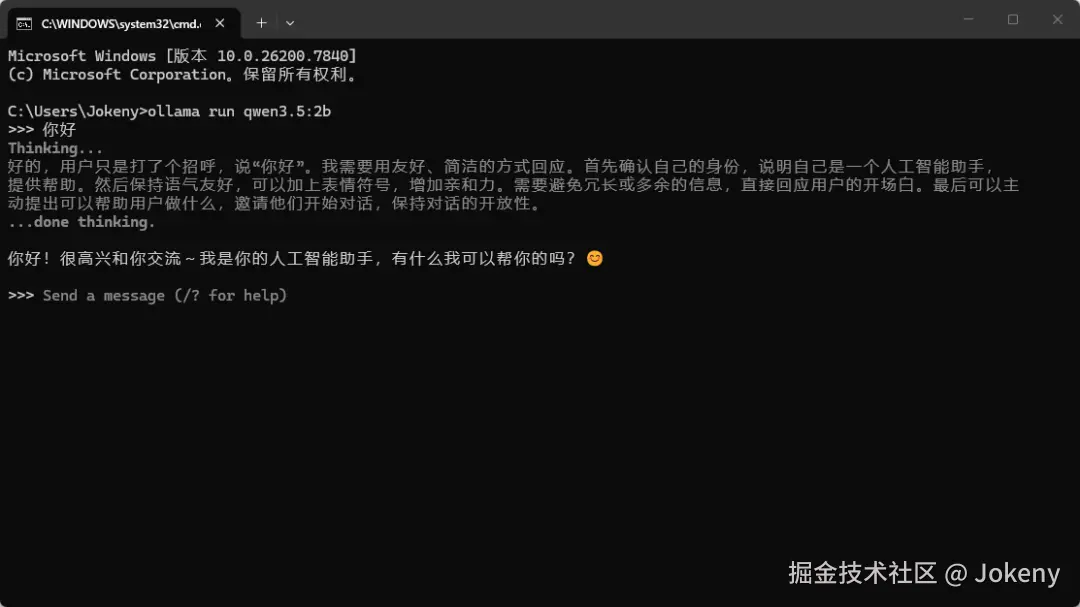

启动模型测试:

arduino

ollama run qwen3.5:2b能对话说明模型已经在本地跑起来了,按 Ctrl+D 退出。

3. 检查虚拟机能否访问本机Ollama

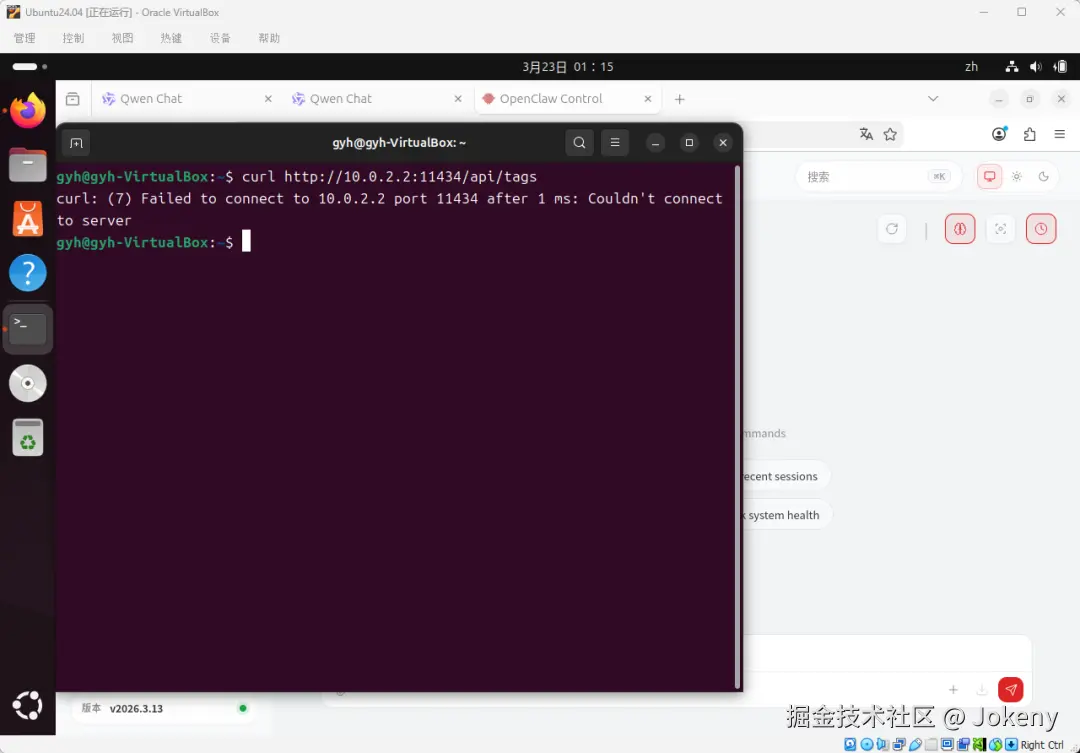

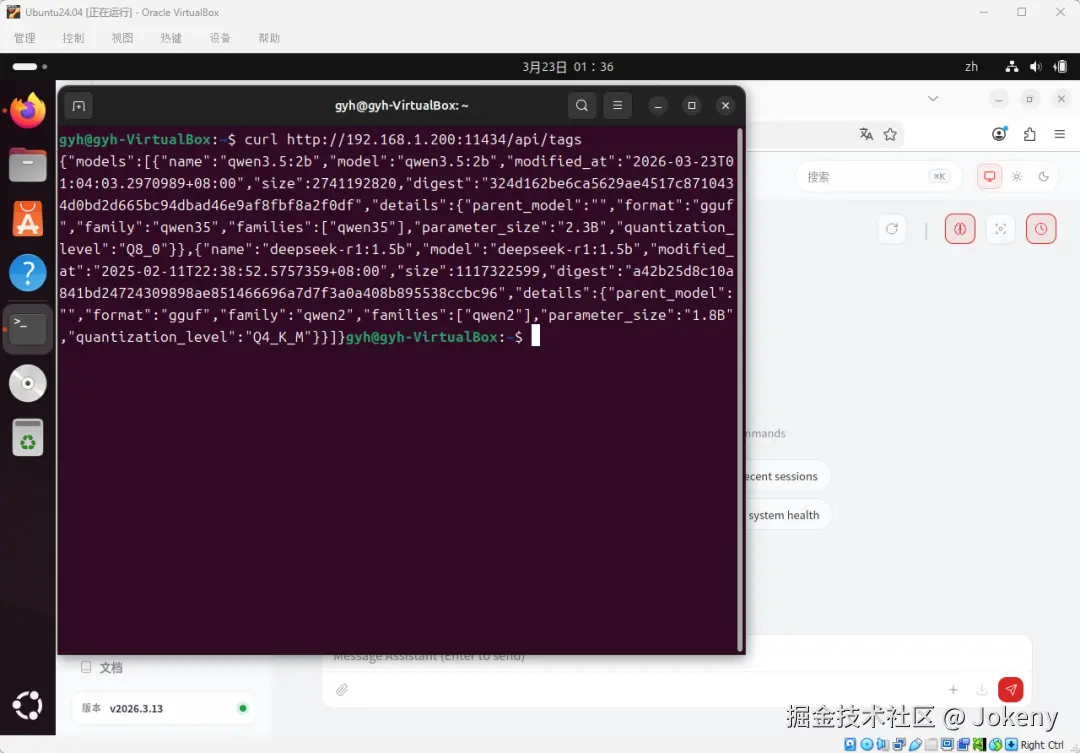

在终端执行命令(IP换成本机IP4,使用ipconfig可以查询本机IP):

arduino

curl http://10.0.2.2:11434/api/tags

出现错误,表示连接不通。

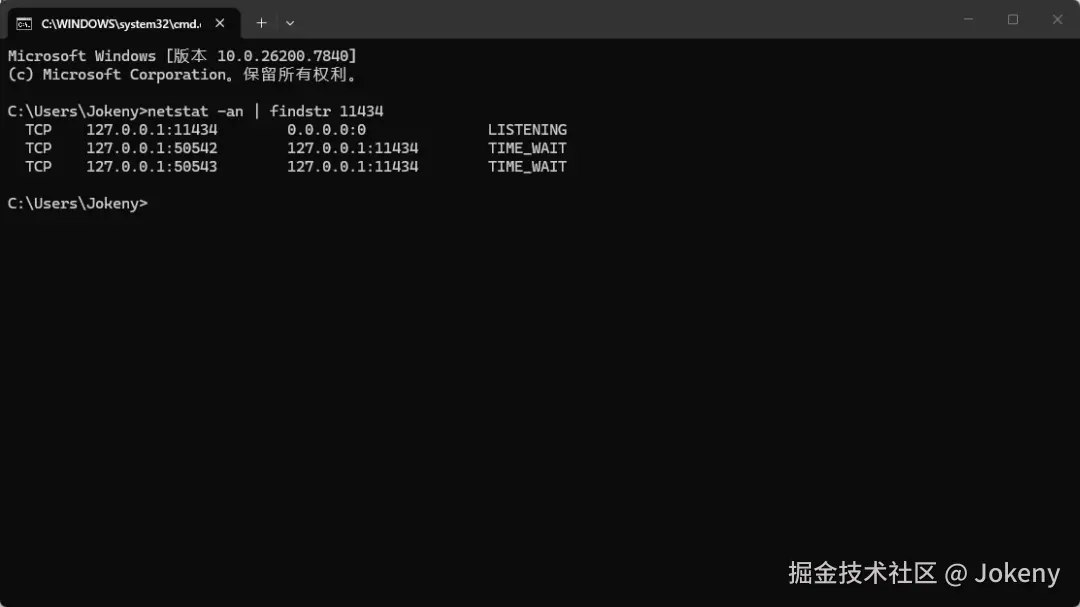

检查11434端口是否被0.0.0.0监听,执行命令:

netstat -an | findstr 11434

上图说明:Ollama 只监听了 127.0.0.1(本机),没有监听 0.0.0.0,所以虚拟机无法访问。进行如下操作:

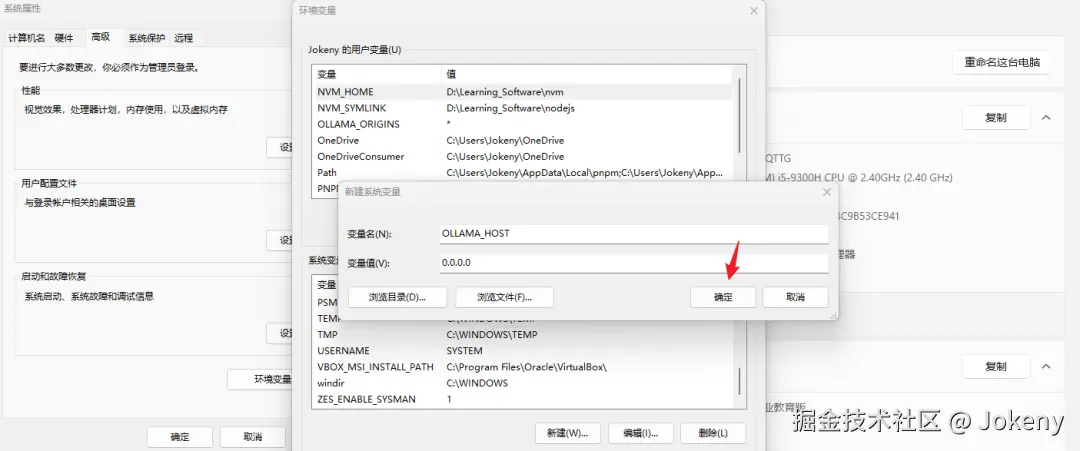

- 右键点击 "此电脑"或"我的电脑"→ 属性

- 点击 高级系统设置

- 点击 环境变量

- 在"系统变量"区域,点击 新建

- 变量名:

OLLAMA_HOST - 变量值:

0.0.0.0 - 点击 确定 保存所有对话框

- 完全退出 Ollama :右键点击系统托盘(任务栏右下角)的 Ollama 羊驼图标 → 选择 Quit 或 退出

- 重新打开 Ollama(从开始菜单)

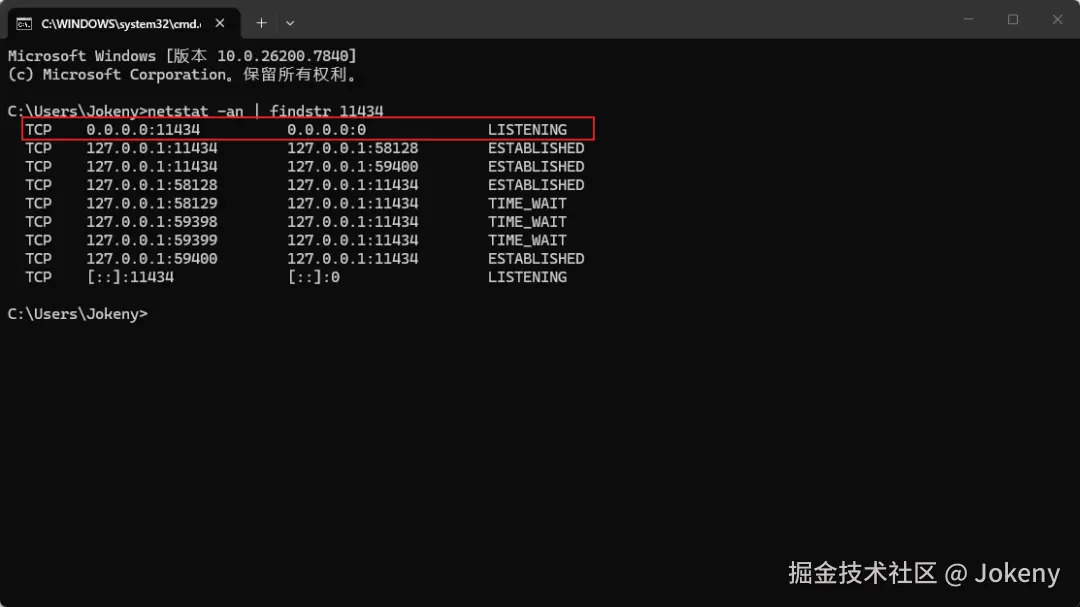

(请将 192.168.1.200 替换成你实际的 Windows IP)

出现JSON格式的数据说明连接正常。

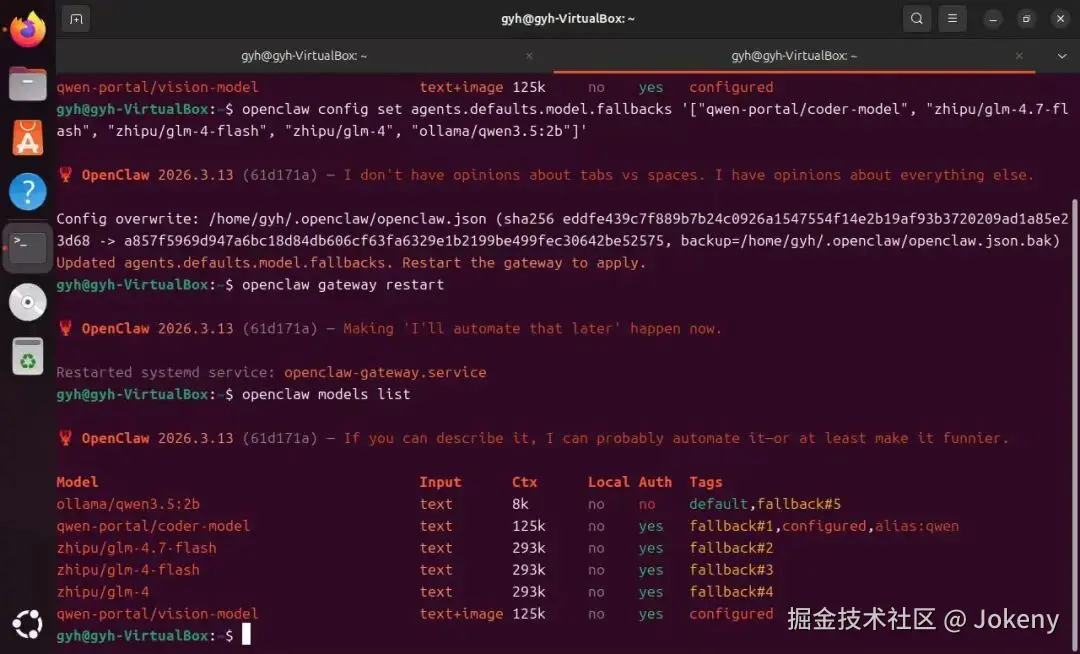

4. OpenClaw对接Ollama

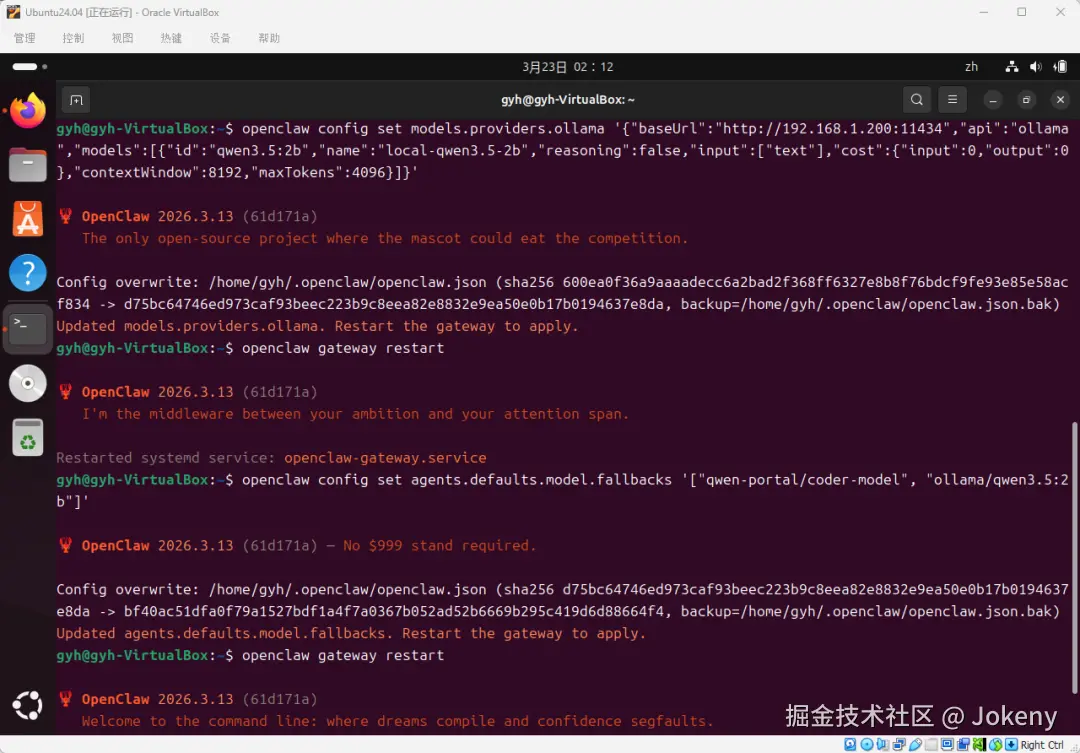

添加Ollama Provider ,直接在终端执行:

swift

openclaw config set models.providers.ollama '{"baseUrl":"http://192.168.1.200:11434","api":"ollama","models":[{"id":"qwen3.5:2b","name":"local-qwen3.5-2b","reasoning":false,"input":["text"],"cost":{"input":0,"output":0},"contextWindow":8192,"maxTokens":4096}]}'如果有多个本地模型(根据实际情况来),继续添加:

swift

openclaw config set models.providers.ollama '{"baseUrl":"http://192.168.1.200:11434","api":"ollama","models":[{"id":"qwen3.5:2b","name":"local-qwen3.5-2b","reasoning":false,"input":["text"],"cost":{"input":0,"output":0},"contextWindow":8192,"maxTokens":4096},{"id":"qwen3.5:7b","name":"local-qwen3.5-7b","reasoning":false,"input":["text"],"cost":{"input":0,"output":0},"contextWindow":8192,"maxTokens":4096}]}'设置默认使用本地模型(可选):

arduino

openclaw config set agents.defaults.model.primary "ollama/qwen3.5:2b"添加到Fallback列表(当主模型不可用时自动切换):

arduino

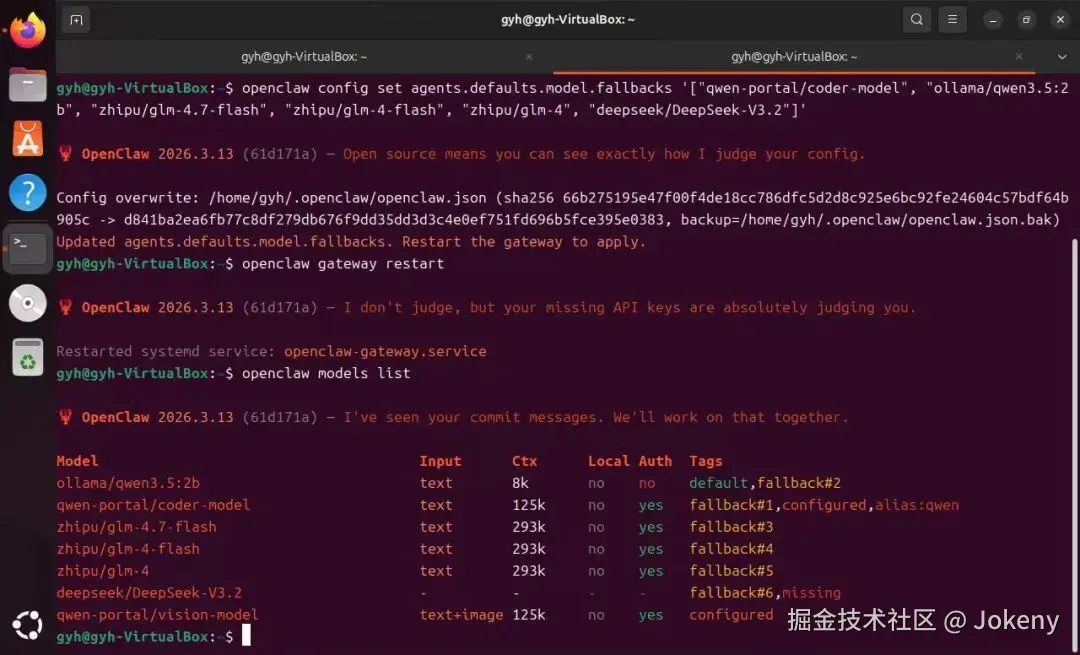

openclaw config set agents.defaults.model.fallbacks '["qwen-portal/coder-model", "ollama/qwen3.5:2b"]'重启生效:

openclaw gateway restart

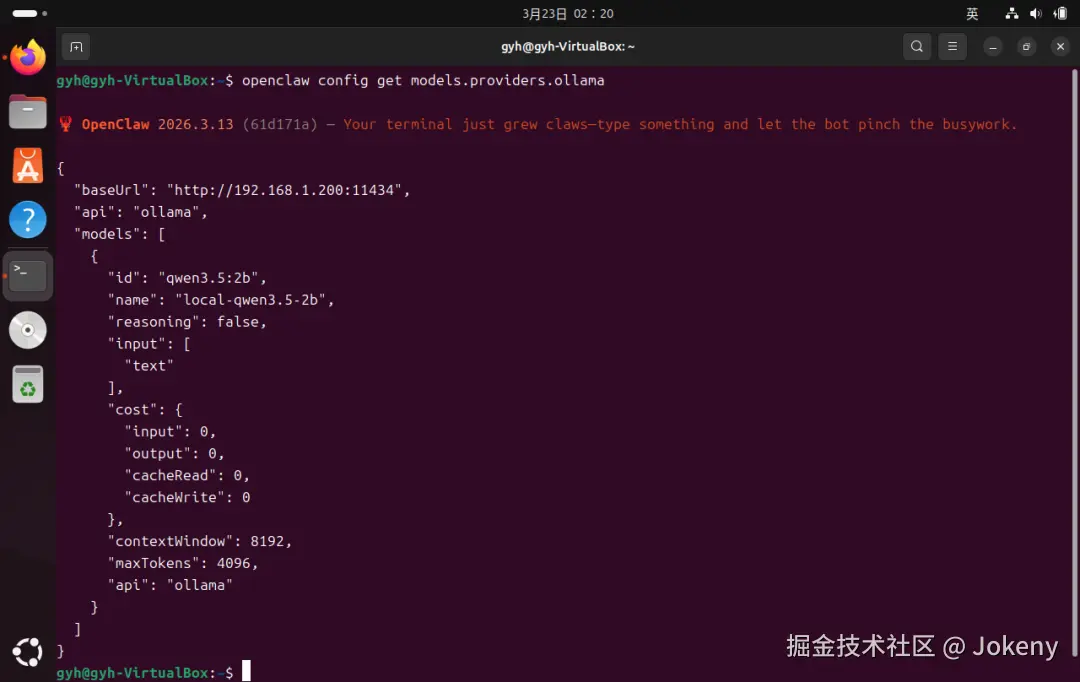

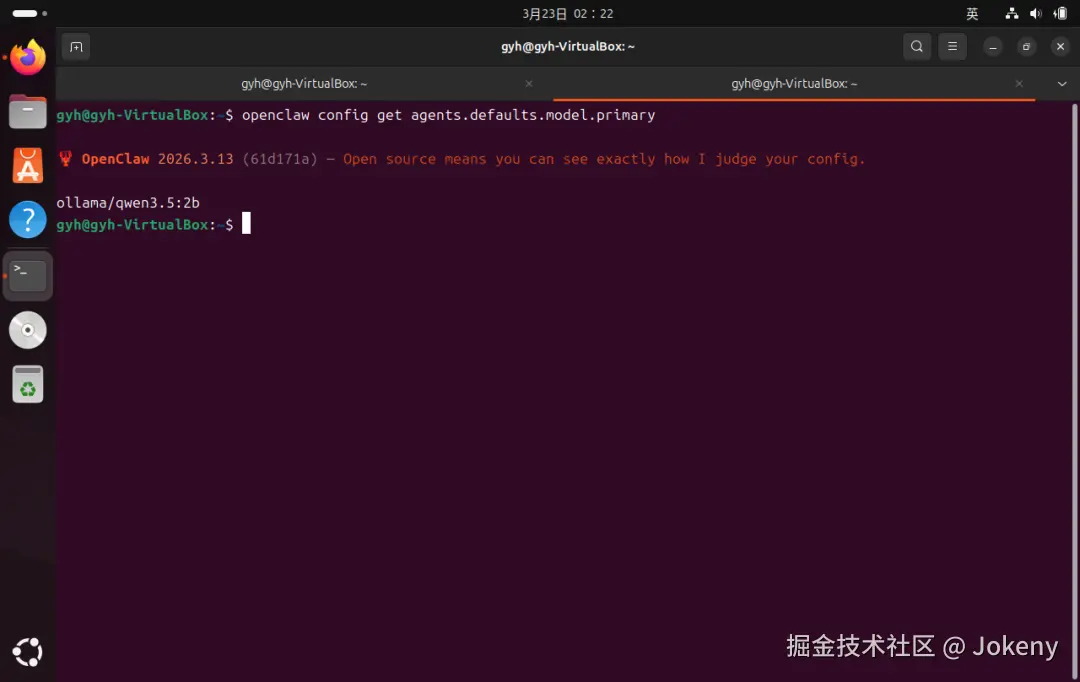

验证是否配置成功:

arduino

openclaw config get models.providers.ollamaopenclaw config get agents.defaults.model.primary能看到刚才配置的内容,说明成功了。

测试本地模型:

此时,所有对话都在本地完成,数据完全不离开电脑。

八、方案B:折中方案------本地OpenClaw+云端API

如果你电脑配置不够,或者需要更强的模型能力,可以用这个方案。但要清楚:数据会发送到模型提供商。

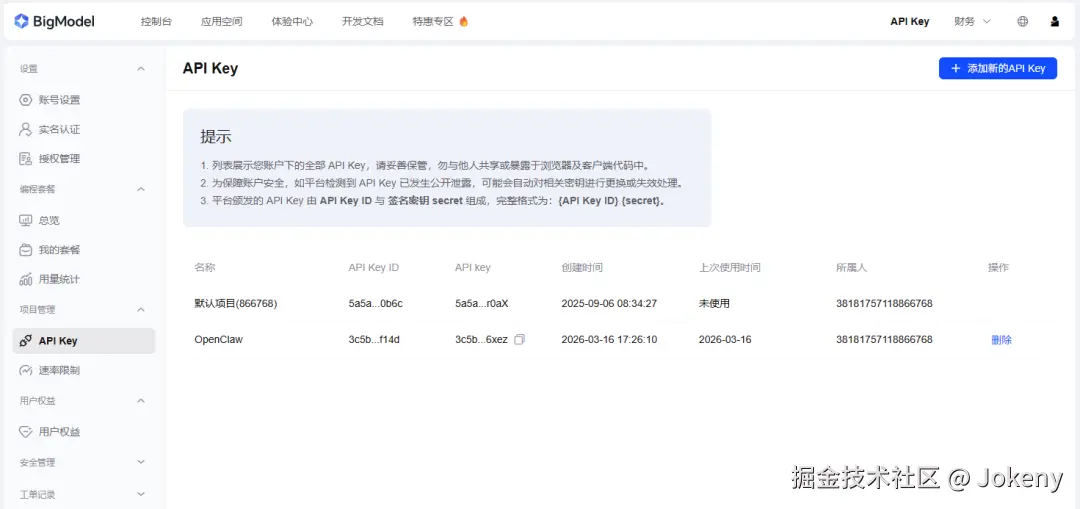

1. 接入智谱AI(免费模型GLM-4.7-Flash)

官网 bigmodel.cn,新用户免费赠送专享 2000万 tokens体验包!

登录后进入控制台,点击【API Key】,添加新的API Key并复制

添加智谱Provider(包含免费模型),执行下面的命令:

记得用刚才获取的API key 替换下方命令中的"你的KEY"

swift

openclaw config set models.providers.zhipu '{"baseUrl": "https://open.bigmodel.cn/api/paas/v4", "apiKey": "你的KEY", "api": "openai-completions", "models": [{"id": "glm-4.7-flash", "name": "GLM-4.7-Flash", "reasoning": false, "input": ["text"], "cost": {"input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0}, "contextWindow": 300000, "maxTokens": 4096}]}'添加到Fallback列表:

css

openclaw config set agents.defaults.model.fallbacks '["qwen-portal/coder-model", "ollama/qwen3.5:2b", "zhipu/glm-4.7-flash", "zhipu/glm-4-flash", "zhipu/glm-4"]'重启生效:

openclaw gateway restart

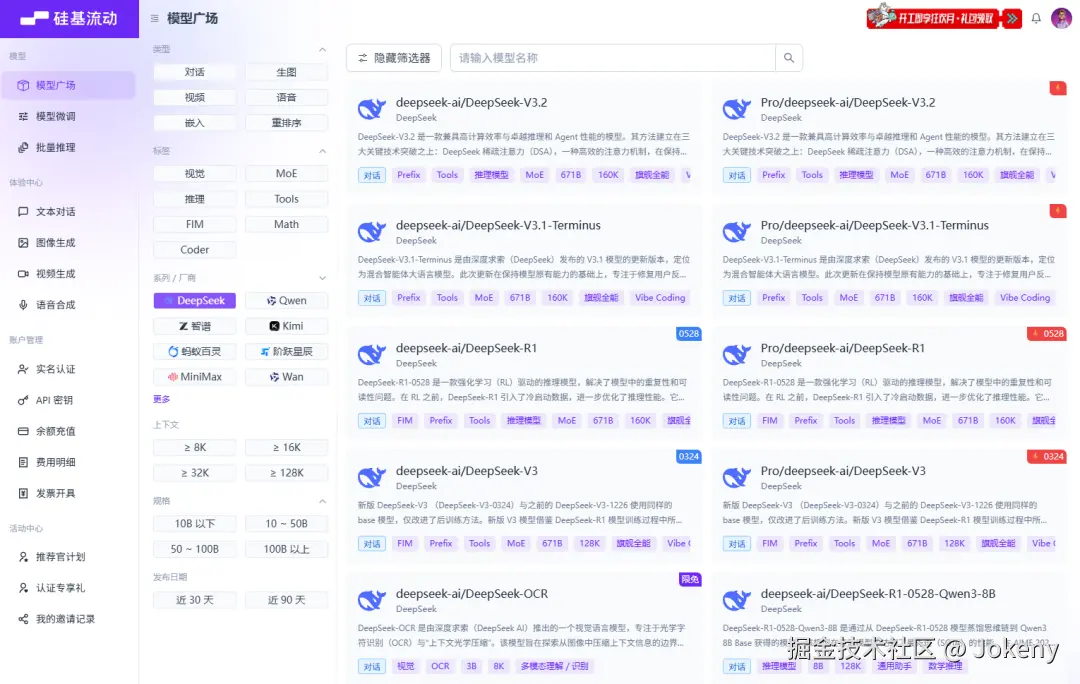

2. 接入硅基流动(免费额度)

官网 cloud.siliconflow.cn,注册后首次完成有效实名认证,即可获得面值 ¥16 的「认证奖励券」 1 张。

点击左侧菜单【API密钥】,新建API密钥并复制

点击左侧菜单【模型广场】,选择合适的模型(每个模型的价格不一样,也有免费的模型),我这里使用"DeepSeek-V3.2"

执行下面的命令:

记得用刚才获取的API密钥替换下方命令中的"sk-你的API_KEY"

swift

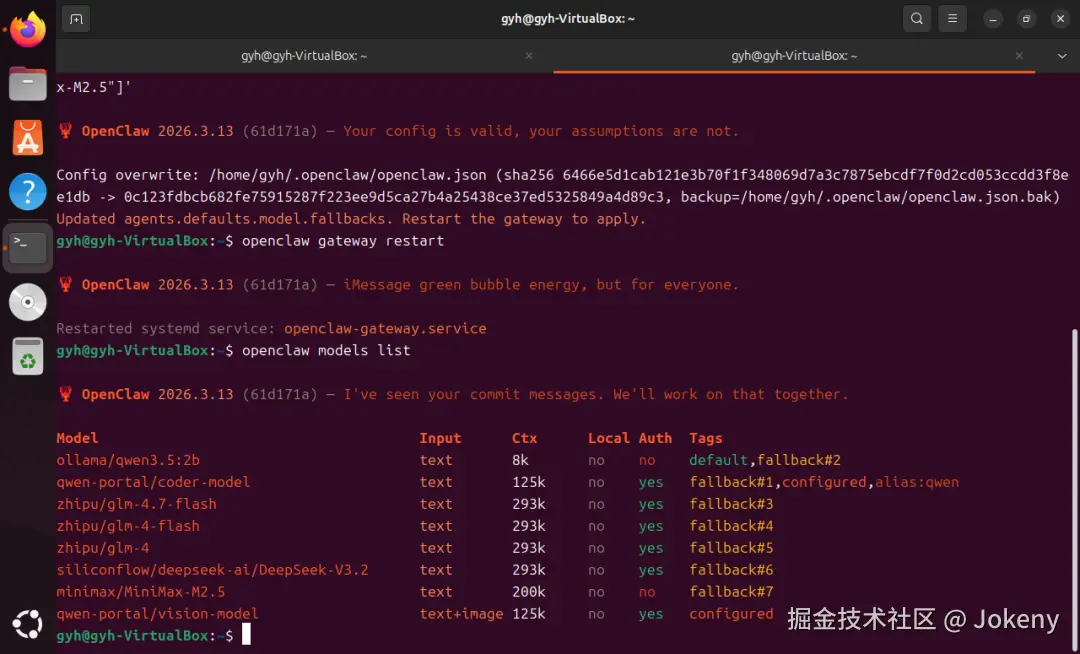

openclaw config set models.providers.siliconflow '{"baseUrl": "https://api.siliconflow.cn/v1", "apiKey": "sk-你的API_KEY", "api": "openai-completions", "models": [{"id": "deepseek-ai/DeepSeek-V3.2", "name": "DeepSeek-V3.2", "reasoning": false, "input": ["text"], "cost": {"input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0}, "contextWindow": 300000, "maxTokens": 4096}]}'添加到Fallback列表:

css

openclaw config set agents.defaults.model.fallbacks '["qwen-portal/coder-model", "ollama/qwen3.5:2b", "zhipu/glm-4.7-flash", "zhipu/glm-4-flash", "zhipu/glm-4", "siliconflow/deepseek-ai/DeepSeek-V3.2"]'重启生效:

openclaw gateway restart

3. 接入MinMax官方(付费)

官网 minimaxi.com,点击【登录】-【API开发平台】进行注册登录

进入平台首页后再点击左侧菜单【账户信息】-【获取你的key】,创建新的API Key

进入平台首页后再点击左侧菜单【账户信息】-【获取你的key】,创建新的API Key

添加 Minimax Provider,执行命令:

swift

openclaw config set models.providers.minimax '{"baseUrl": "https://api.minimaxi.com/anthropic", "apiKey": "你的KEY", "api": "anthropic-messages", "models": [{"id": "MiniMax-M2.5", "name": "MiniMax M2.5", "reasoning": true, "input": ["text"], "cost": {"input": 0.3, "output": 1.2, "cacheRead": 0, "cacheWrite": 0}, "contextWindow": 204800, "maxTokens": 131072}]}'添加到Fallback列表:

css

openclaw config set agents.defaults.model.fallbacks '["qwen-portal/coder-model", "ollama/qwen3.5:2b", "zhipu/glm-4.7-flash", "zhipu/glm-4-flash", "zhipu/glm-4", "siliconflow/deepseek-ai/DeepSeek-V3.2", "minimax/MiniMax-M2.5"]'重启生效:

openclaw gateway restart

重要提醒 :使用这些方案时,不要上传敏感文件,只用来处理公开信息或一般性工作。

九、对接飞书:让AI融入日常工作

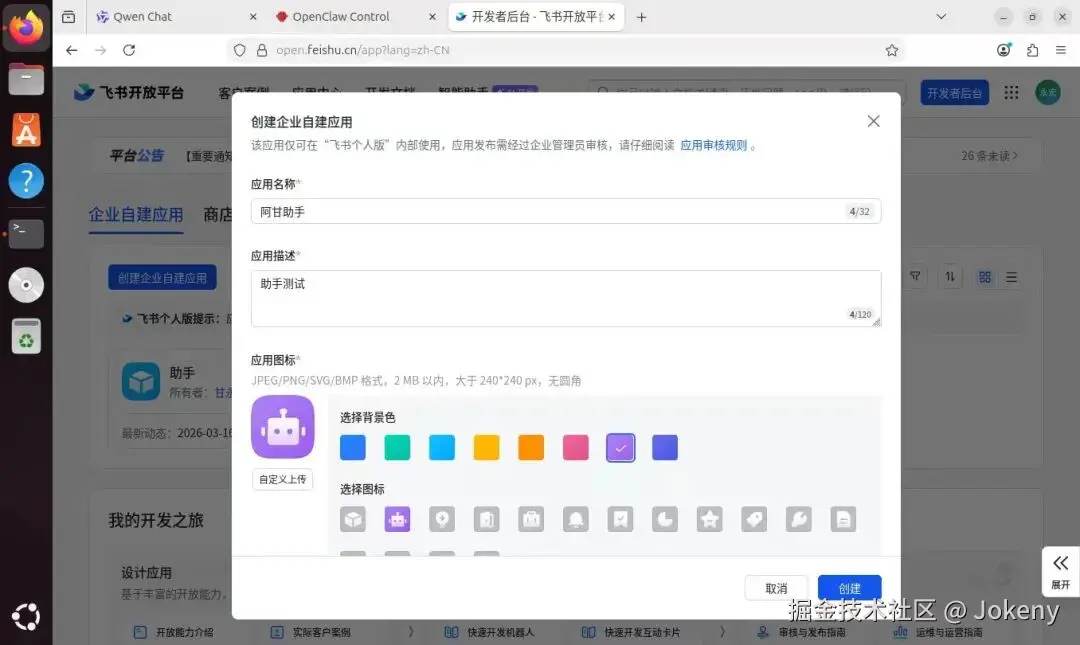

1. 创建飞书应用

打开飞书开放平台 open.feishu.cn

登录后点击【创建企业自建应用】

填写应用名称(比如"AI助手"),应用描述随便写,点击"创建"按钮后进入应用详情页

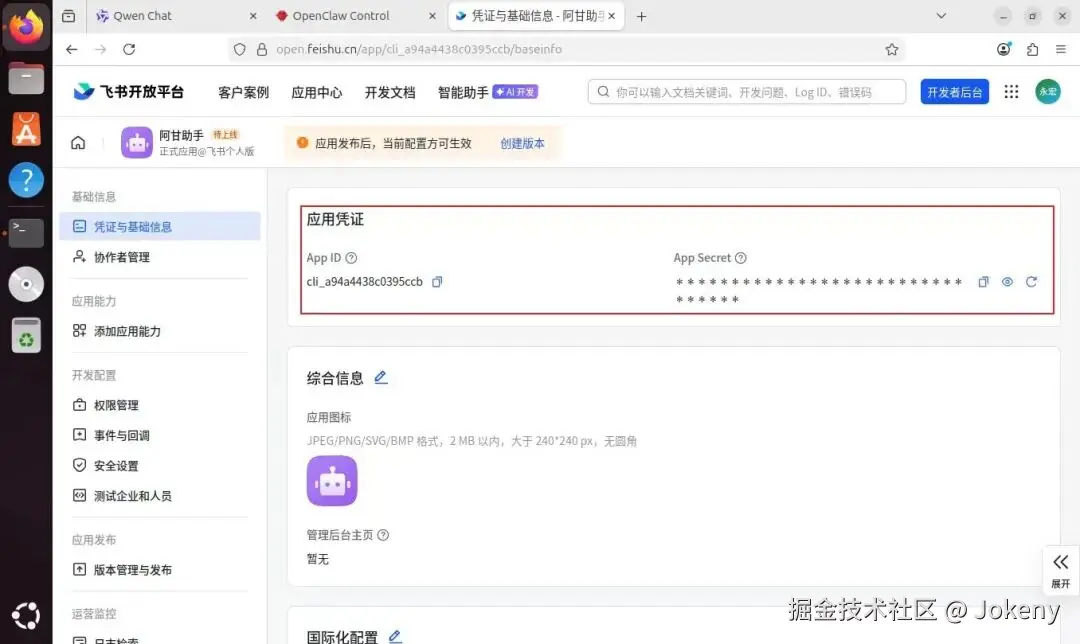

2. 获取凭证

在"凭证与基础信息"页面,找到:

-

App ID(以cli_开头)

-

App Secret(需要点击"查看"按钮)

把这两个记下来。

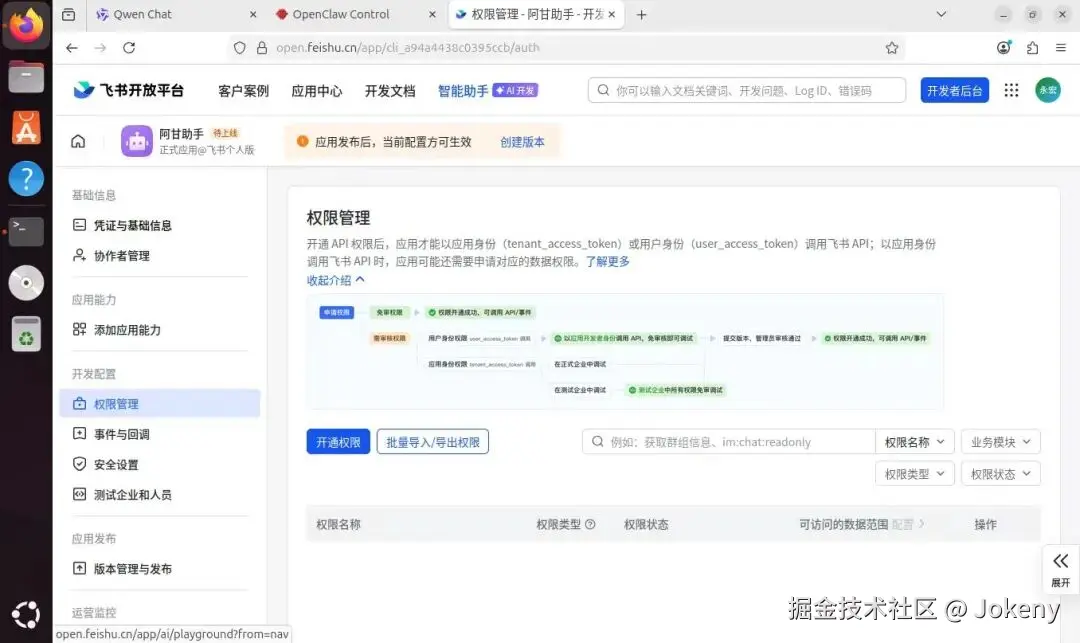

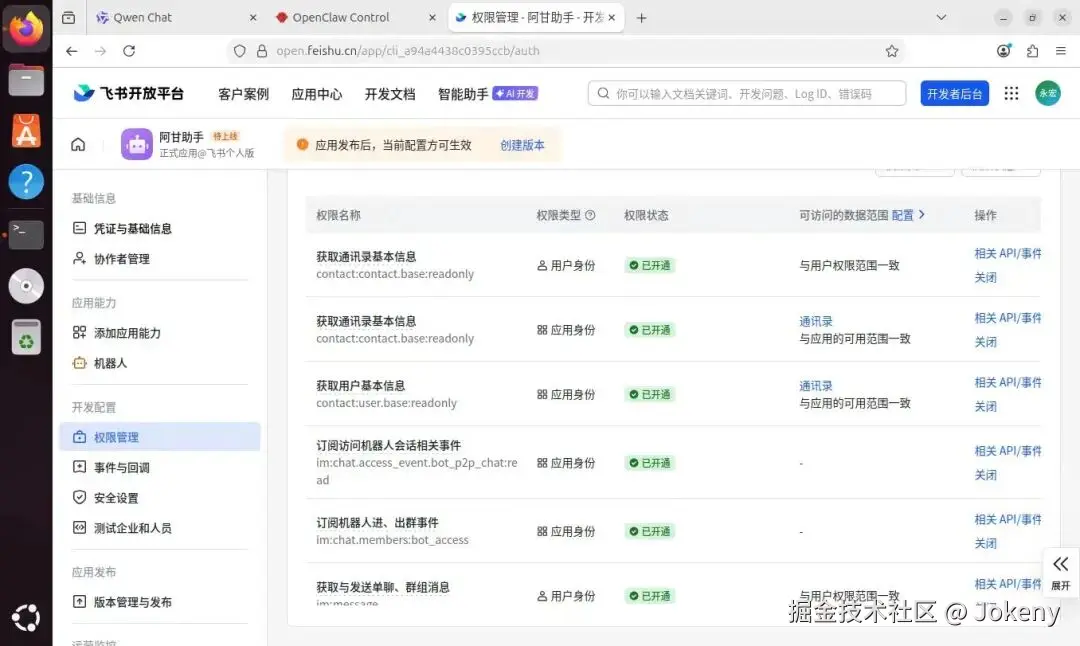

3. 配置权限

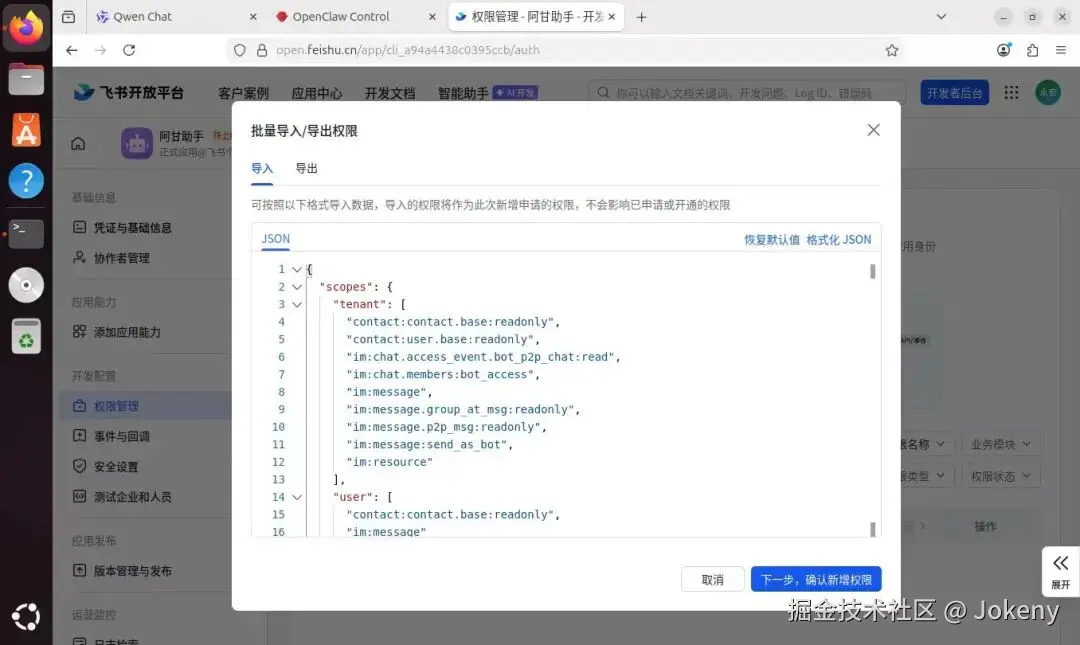

在"权限管理"页面点击按钮【批量导入/导出权限】:

复制粘贴以下JSON代码:

json

{

"scopes": {

"tenant": [

"contact:contact.base:readonly",

"contact:user.base:readonly",

"im:chat.access_event.bot_p2p_chat:read",

"im:chat.members:bot_access",

"im:message",

"im:message.group_at_msg:readonly",

"im:message.p2p_msg:readonly",

"im:message:send_as_bot",

"im:resource"

],

"user": [

"contact:contact.base:readonly",

"im:message"

]

}

}

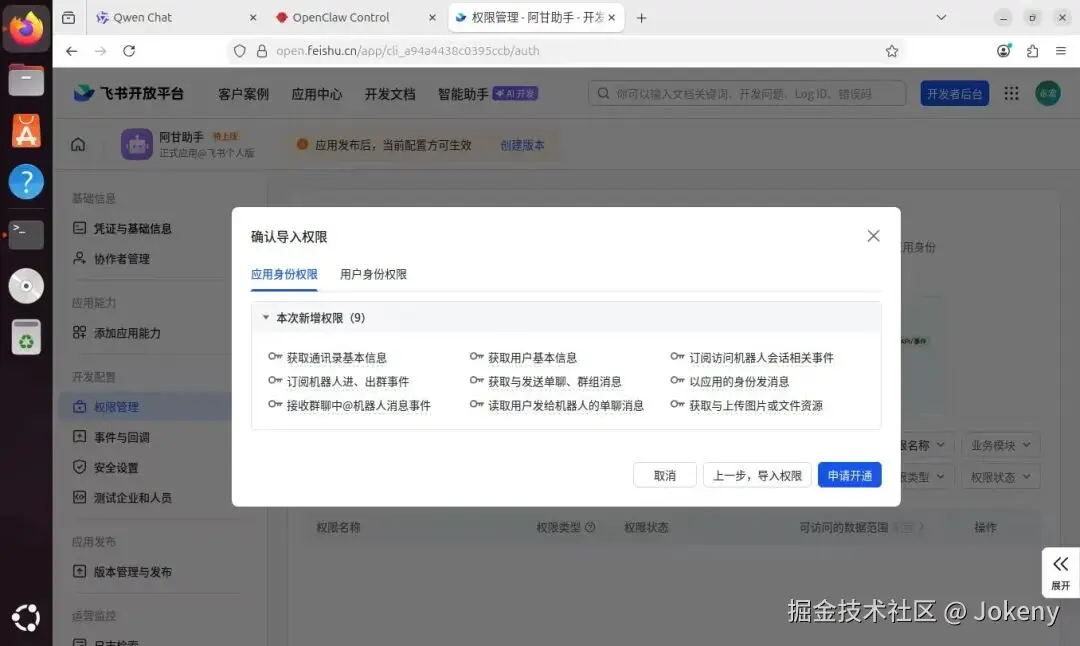

完成后点击【下一步,确认新增权限】。

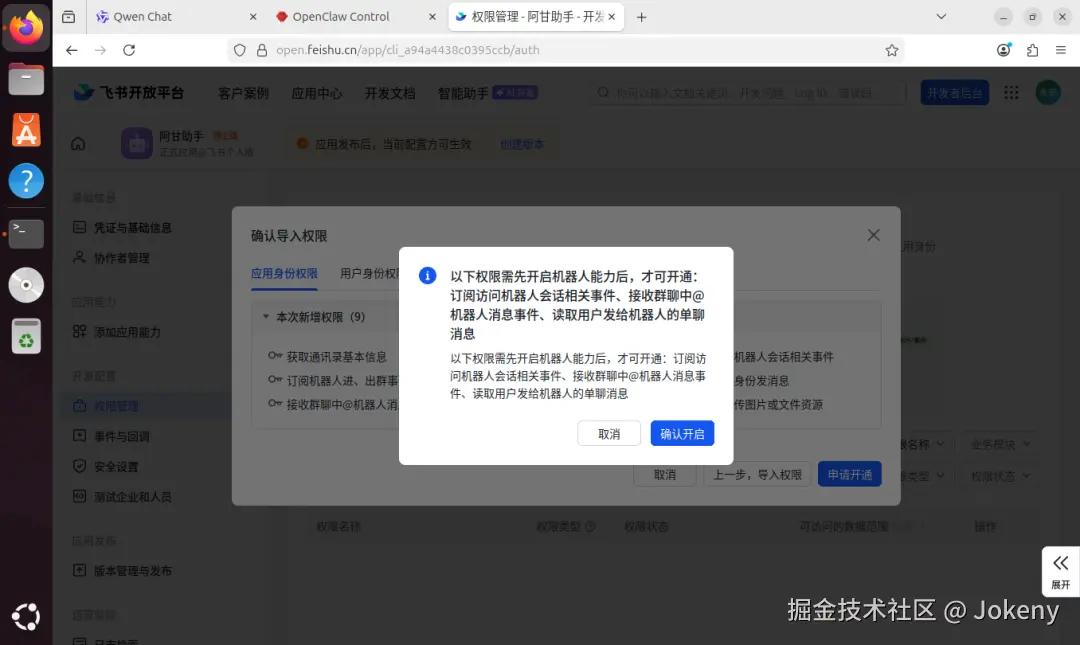

确认应用身份权限,点击【确认开通】

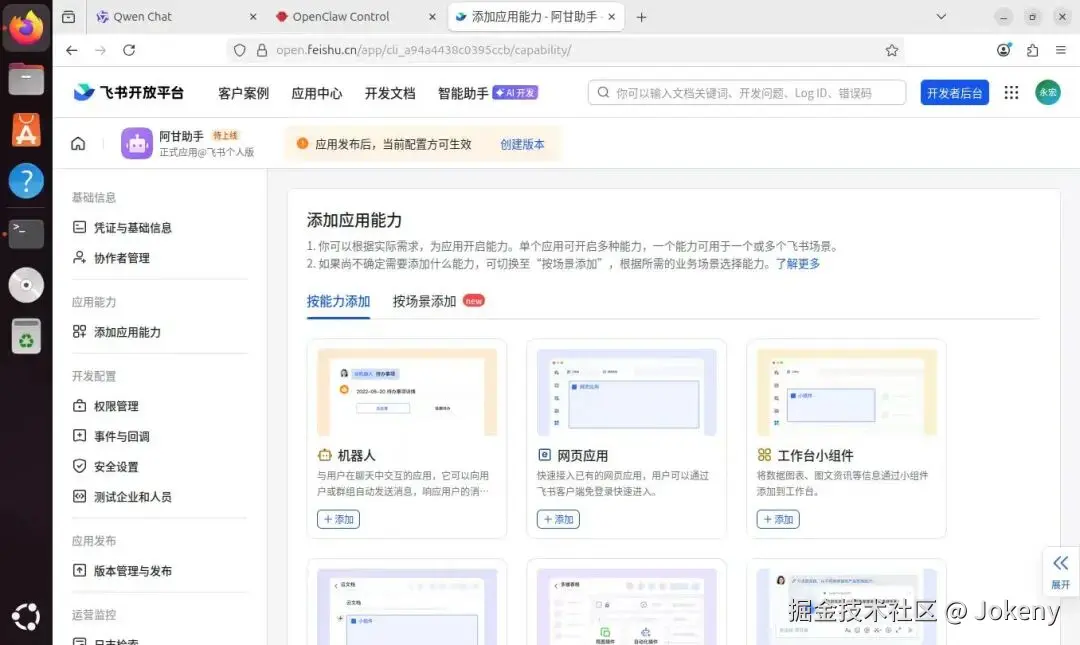

这里需要开启机器人的能力,点击【确认开启】

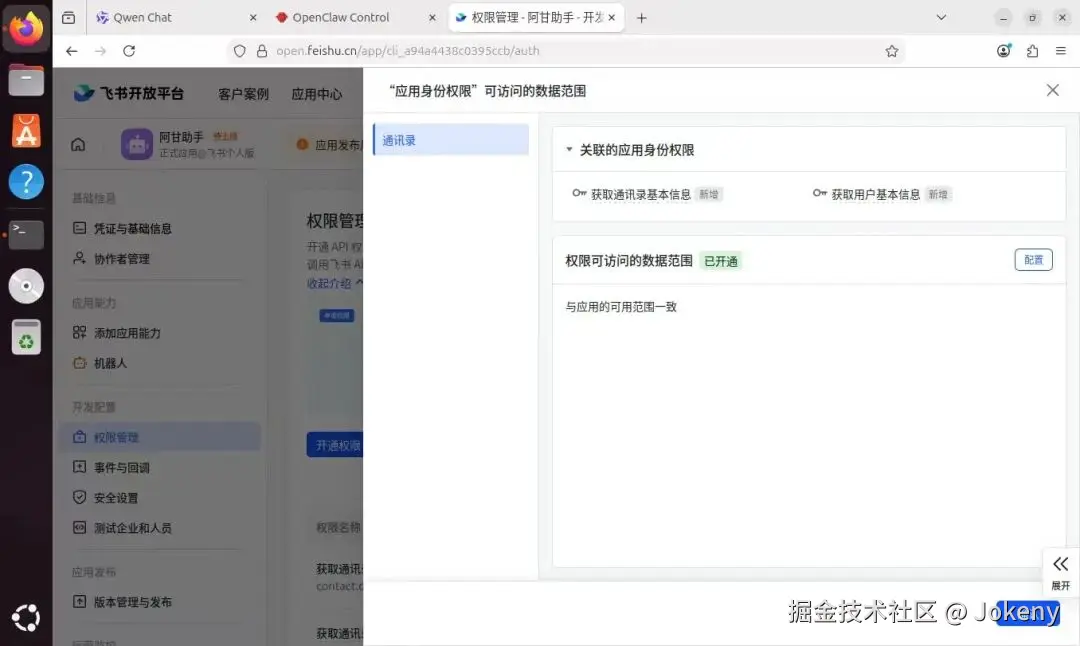

确认"应用身份权限"可访问的数据范围,点击【确认】

至此表示相关权限已经开通好了。

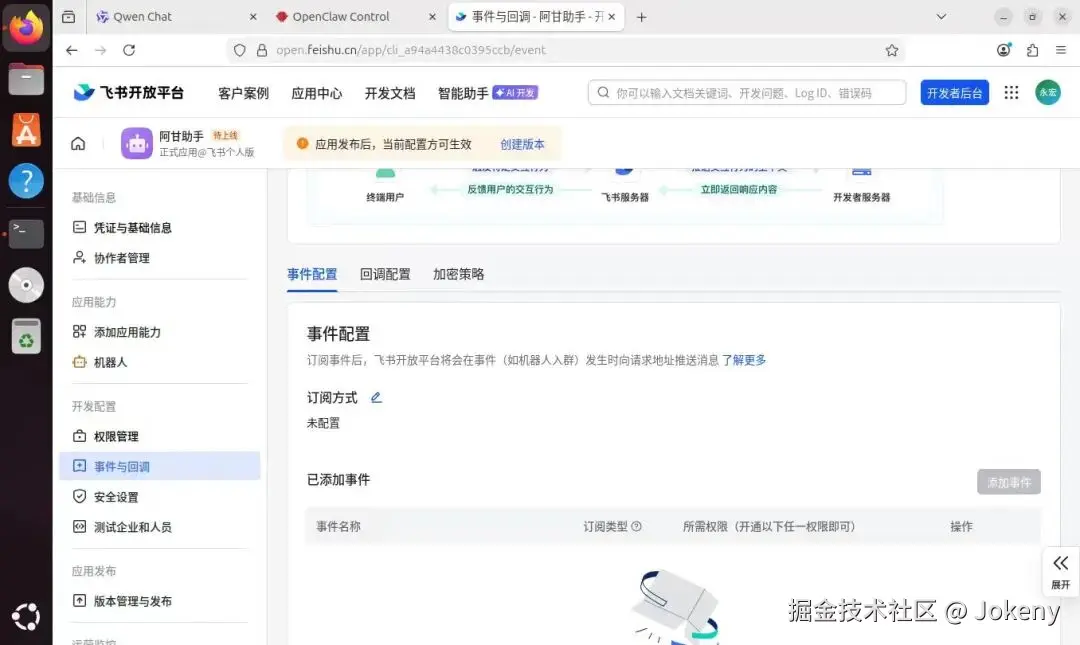

4. 配置事件订阅

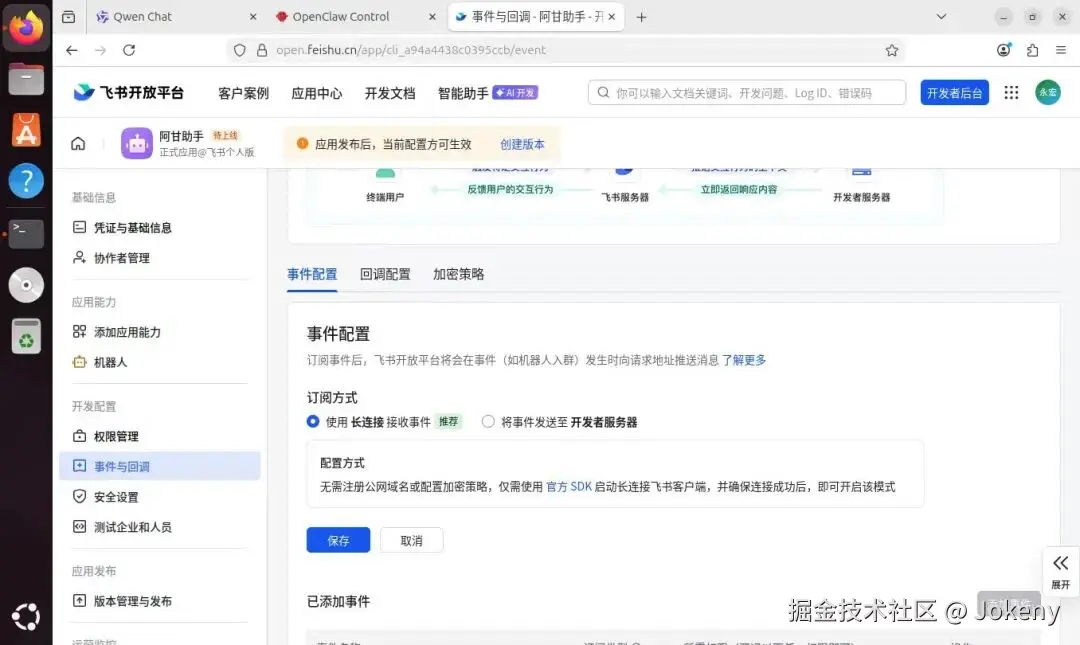

点击左侧菜单【事件与回调】-【订阅方式】,点击编辑按钮

将订阅方式修改为长链接,并点击【保存】按钮

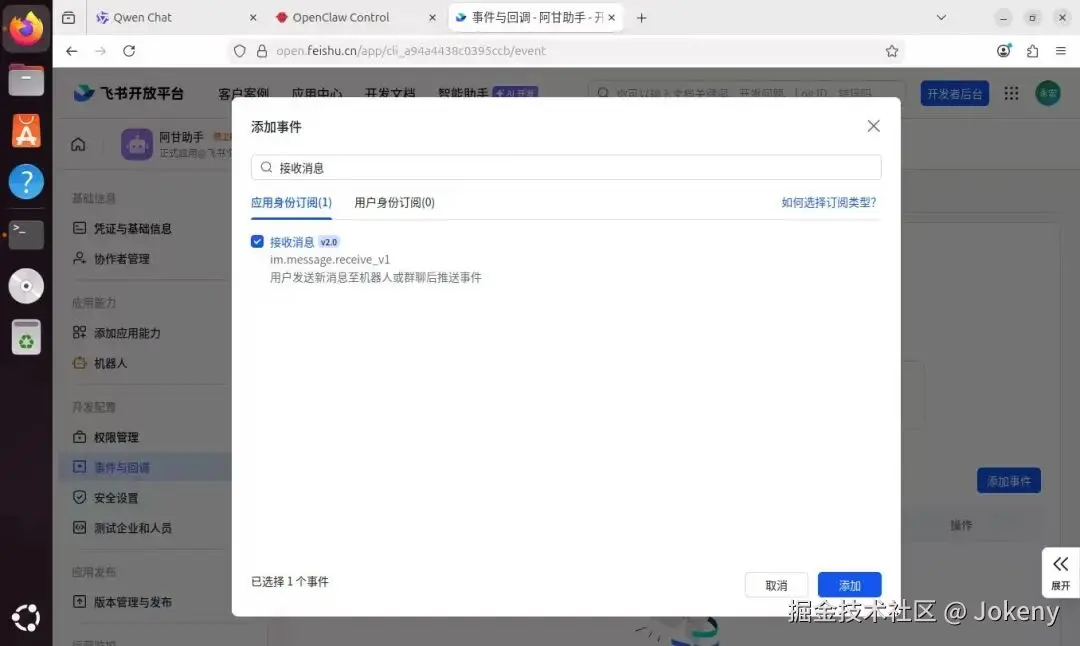

点击【添加事件】,搜索"接收消息",将"接收消息"添加进来。

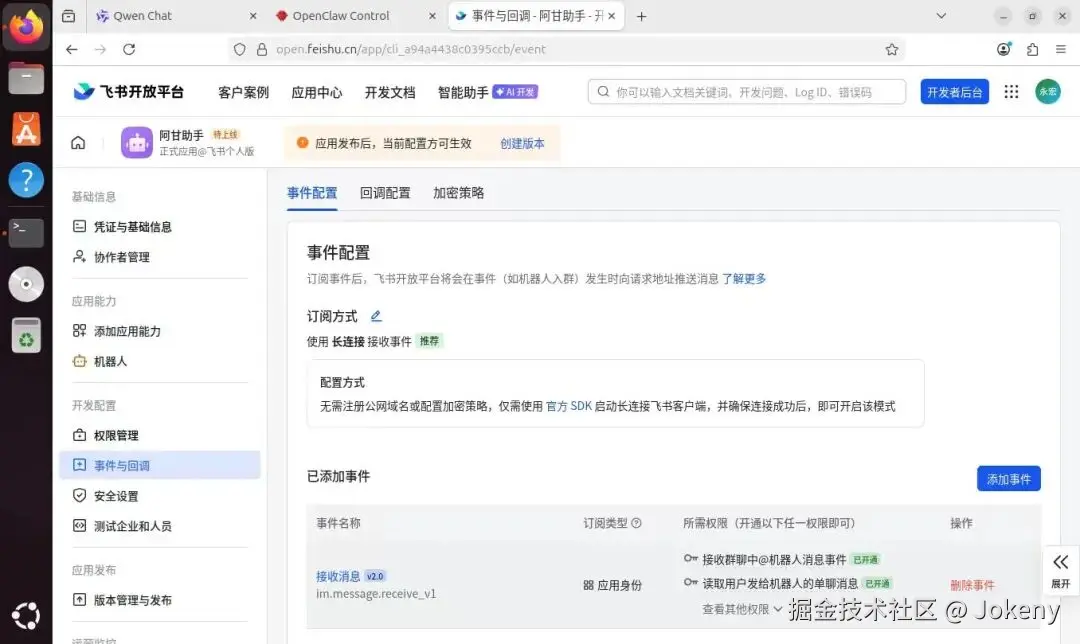

这样事件订阅就配置完成了。

5. 发布应用

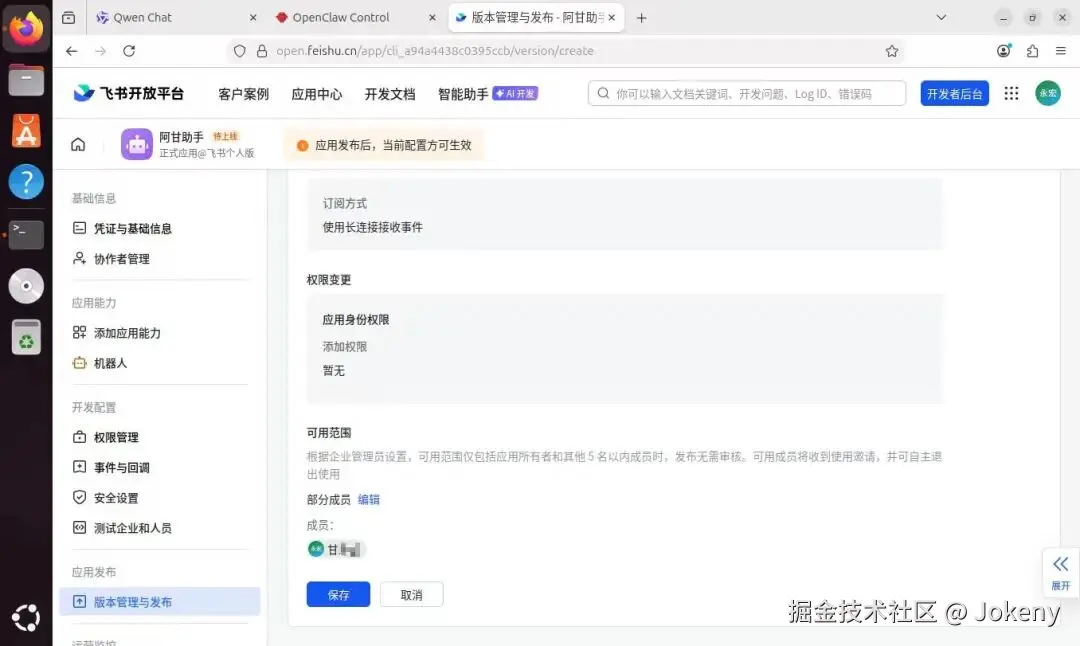

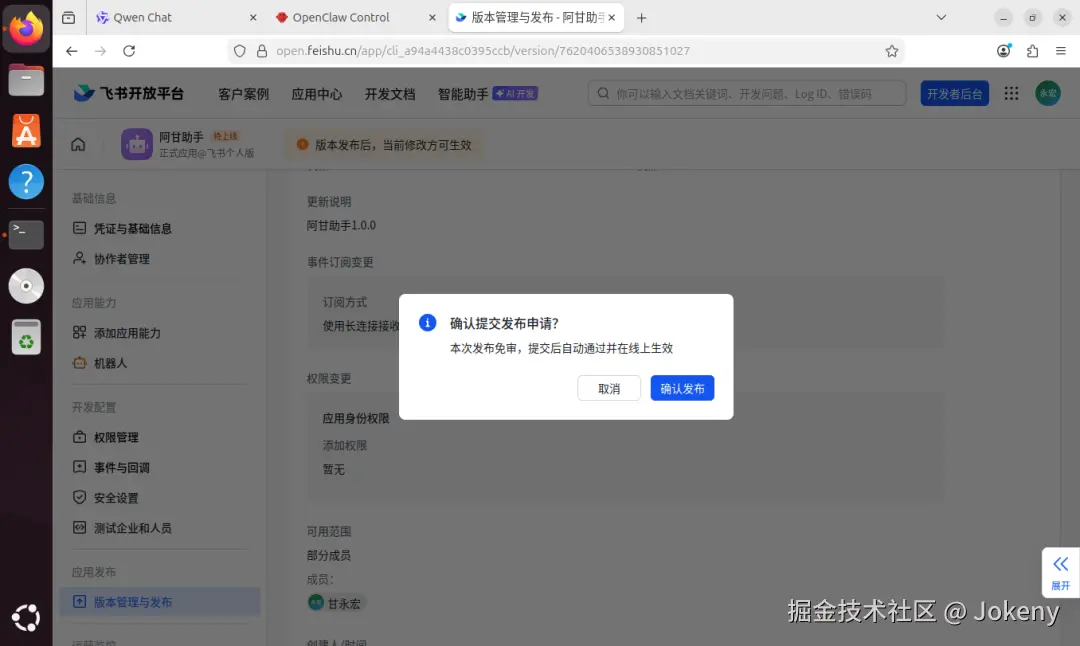

点击"创建版本"超链接,在弹出的界面中填写版本详情,如下图:

填写完成后点击【保存】按钮

再点击【确认发布】

发布成功后将会在飞书中收到审核消息,如下图:

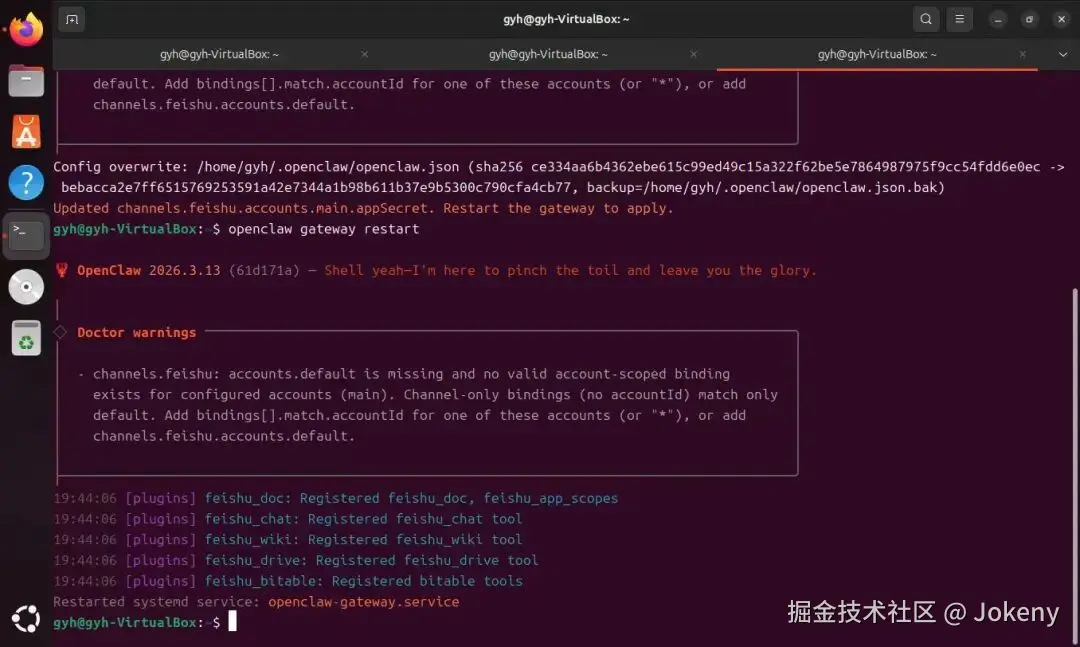

6. 在OpenClaw中配置飞书

复制飞书中的"APP ID"和"APP Secret",执行下面的命令:

配置App ID:

arduino

openclaw config set channels.feishu.accounts.main.appId "你的AppID"配置App Secret:

arduino

openclaw config set channels.feishu.accounts.main.appSecret "你的AppSecret"重启生效:

openclaw gateway restart

以上表示配置成功。

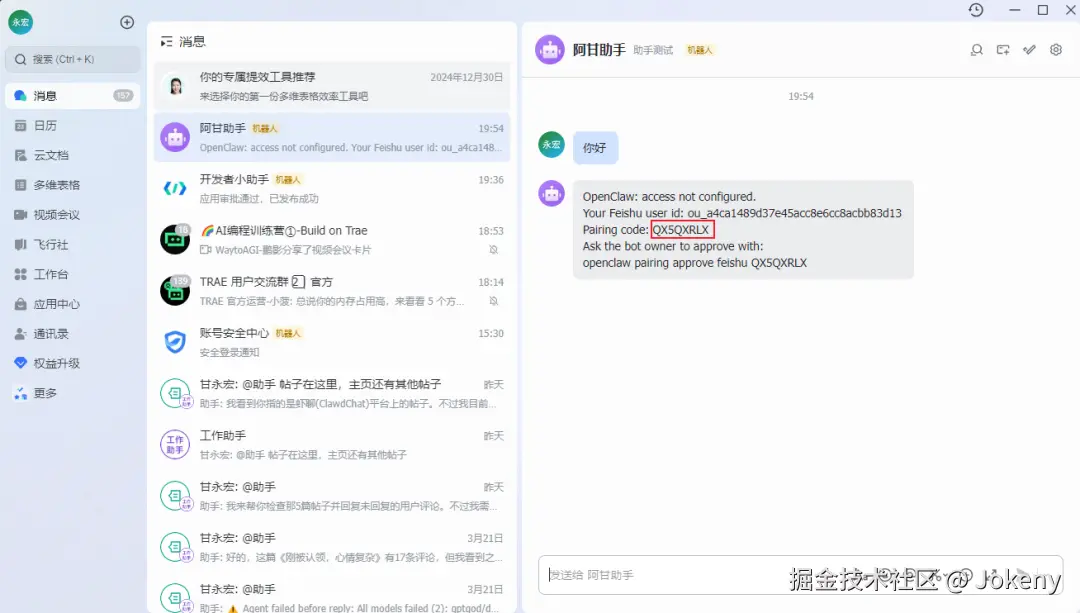

7. 测试飞书机器人

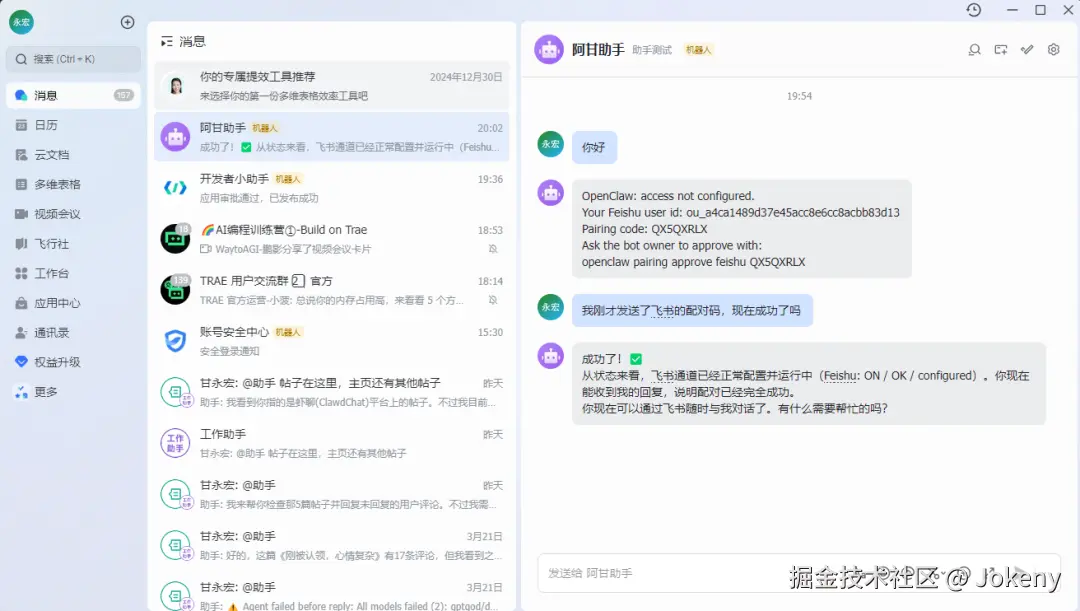

点击飞书中的"开发者小助手" → "打开应用",随便给我们的机器人发送一条消息,获取一下配对码,如下图:

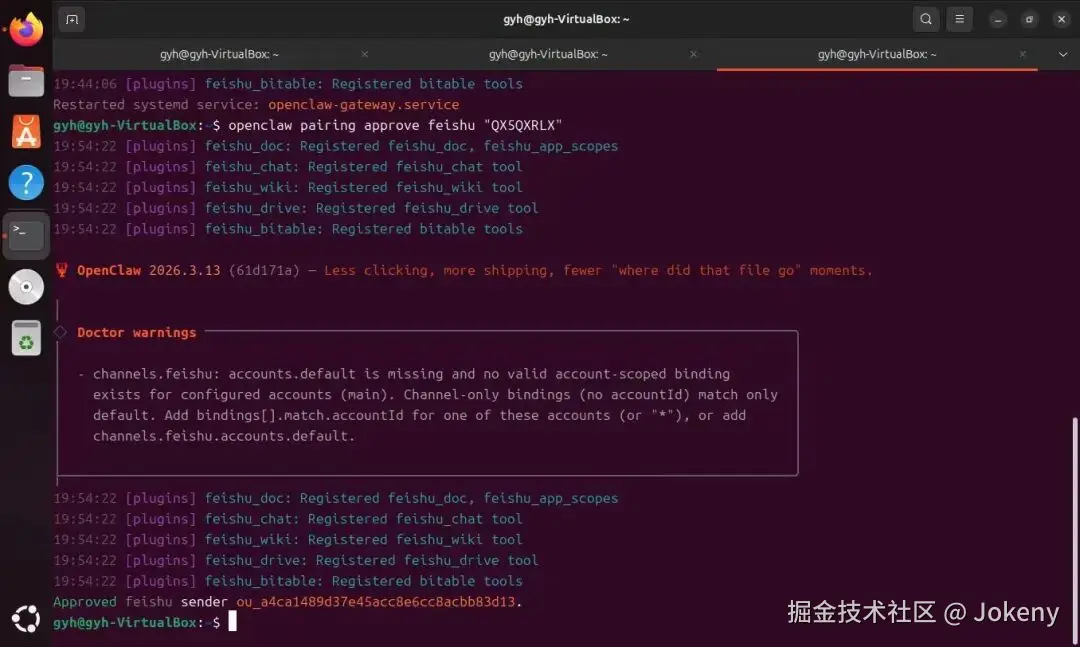

将配对码放入下方命令中,然后再粘贴到终端中执行

arduino

openclaw pairing approve feishu "你的配对码"

继续给机器人发送消息,询问是否配对成功

至此,飞书和龙虾配置成功,可以愉快的帮你打工了。

如果配置的是本地模型,此时飞书消息→OpenClaw→本地大模型→返回结果,全流程数据都在你电脑里。

十、常用命令速查表

| 操作 | 命令 |

|---|---|

| 查看版本 | openclaw --version |

| 启动服务 | openclaw start 或 openclaw gateway start |

| 停止服务 | openclaw stop 或 openclaw gateway stop |

| 重启服务 | openclaw restart 或 openclaw gateway restart |

| 查看日志 | openclaw logs |

| 查看配置 | openclaw config get 配置路径 |

| 设置配置 | openclaw config set 配置路径 "值" |

| 单论对话 | openclaw chat "内容" |

| 指定模型对话 | openclaw chat "内容" --model 模型名 |

| 交互式对话 | openclaw chat --interactive |

| 处理文件 | openclaw process 文件路径 --output 输出路径 |

| 所有可用的模型 | openclaw models list |

十一、进阶玩法与注意事项

1. 命令行批量处理

OpenClaw的命令行模式很适合批量处理文件:

bash

# 批量处理文件夹里的所有文档

for file in ~/documents/*.pdf; do

openclaw process "$file" --model ollama/qwen3.5:2b --output "${file%.pdf}.md"

done2. 多开虚拟机

电脑配置够的话(建议32GB内存+好显卡),可以:

- 一个虚拟机跑OpenClaw+本地小模型(处理敏感数据)

- 一个虚拟机跑OpenClaw+云端API(处理一般任务)

4. 快照备份

在VirtualBox里,右键虚拟机 → 快照 → 拍摄快照。配置搞乱了随时恢复。

关键提醒:即使本地部署,也要注意。

- 飞书消息本身是经过飞书官方服务器(

open.feishu.cn)处理和转发(这是飞书的机制) - 本地模型能力有限,70B模型也比不过GPT-4

- 显卡越好,本地模型越快,量化版会损失一些精度

十二、写在最后

说实话,第一次成功在虚拟机里跑通完全离线的OpenClaw,并且看到飞书群里AI自动回复消息的时候,那种"数据真·安全"的感觉,是云端服务给不了的。

现阶段,龙虾安装环节是使用龙虾过程中最简单的一环了,这个步骤省了,大概率使用过程中会还回来的。因为有了安装经验,命令行的操作我们就熟悉了,后续遇到异常,问问AI,基本能够自行处理。

重要认知:如果你用了云端API,就不要自欺欺人说是"本地部署"。要么接受数据上传换能力,要么接受本地模型的能力限制换隐私。没有两全其美。

你在搭建过程中遇到了什么问题?或者你已经跑通了本地模型,用的什么显卡、跑的什么模型? 评论区聊聊,我尽量帮大家解答。