无服务器推理理所当然地成为人工智能用户技术圈和非技术圈最热门的话题之一,这背后有其充分理由。虽然部署自定义模型通常需要控制部署的方方面面,但无服务器技术免去了维护和管理模型部署及 API 端点的麻烦。这对于众多不同的智能体大语言模型用例来说,可能极为有用。

在本教程中,我们将展示如何使用 DigitalOcean Gradient Platform 无服务器推理 API。之后,我们将讨论该方法在生产环境和日常工作流程中的一些潜在用例。

在 Gradient 平台上访问无服务器推理

首先,我们可以使用 DigitalOcean API 或云控制台。让我们来看看这两种方法。

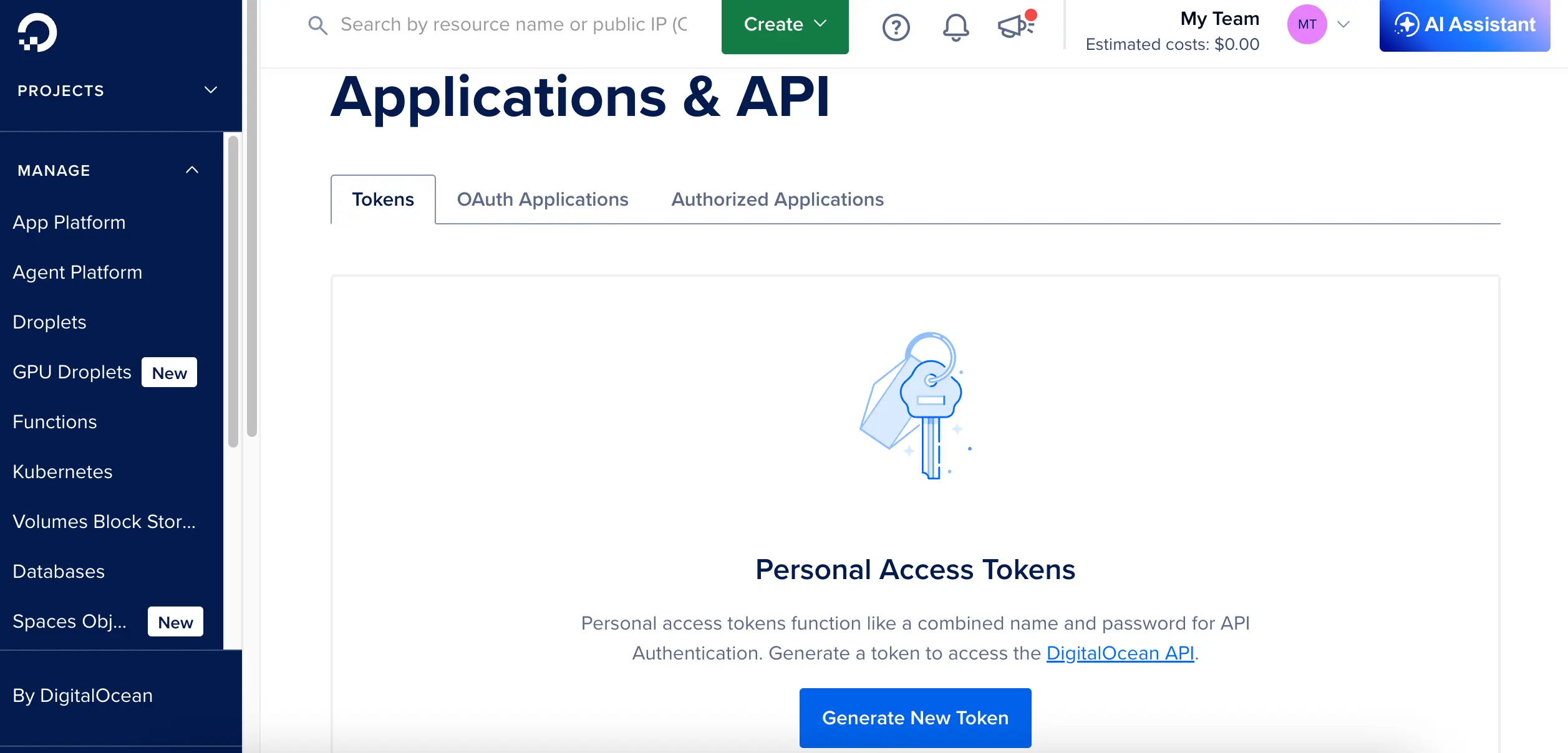

步骤 1A:创建 DigitalOcean API 密钥

首先,你需要创建自己的 DigitalOcean 帐户并登录。完成后,导航到你选择的团队空间。在这里,我们将创建一个 DigitalOcean API 密钥。这稍后将帮助我们创建模型访问 Token,所以我们可以跳过此步骤,直接进入"步骤 2b:使用云控制台创建模型访问密钥"部分。

使用主页左侧的导航栏,向下滚动直到看到"API"。点击进入 API 主页。然后我们可以使用右上角的按钮创建一个新密钥。

在密钥创建页面,根据需要为你的密钥命名并授予适当的权限。为此,你可以授予完全权限,或者在自定义范围选择中向下滚动到"genai"并全选。然后,创建密钥。保存此值以备后用。

注意:新注册用户建议可以先使用 qwen 模型,把 API 跑通。再更换 model ID 使用其他模型。目前 Opus 4.6、GPT 5.2 等高级模型,对新注册账号是不开通权限的。用户测试会出现 401 错误提示。如果新注册用户想使用,可联系卓普云来申请解除限制。

步骤 2A:使用 API 创建模型访问密钥

接下来,我们将为 Gradient 的无服务器推理创建模型访问密钥。为此,我们可以使用控制台或 API。要使用 API,请使用之前保存的 API 密钥,在终端中执行以下 curl 请求。将"$DIGITALOCEAN_TOKEN"的值替换为你自己的。

bash

curl -X POST -H 'Authorization: Bearer $DIGITALOCEAN_TOKEN' https://api.digitalocean.com/v2/gen-ai/models/api_keys这将输出我们的模型访问密钥。保存此值以备后用。我们在查询模型时会需要它。

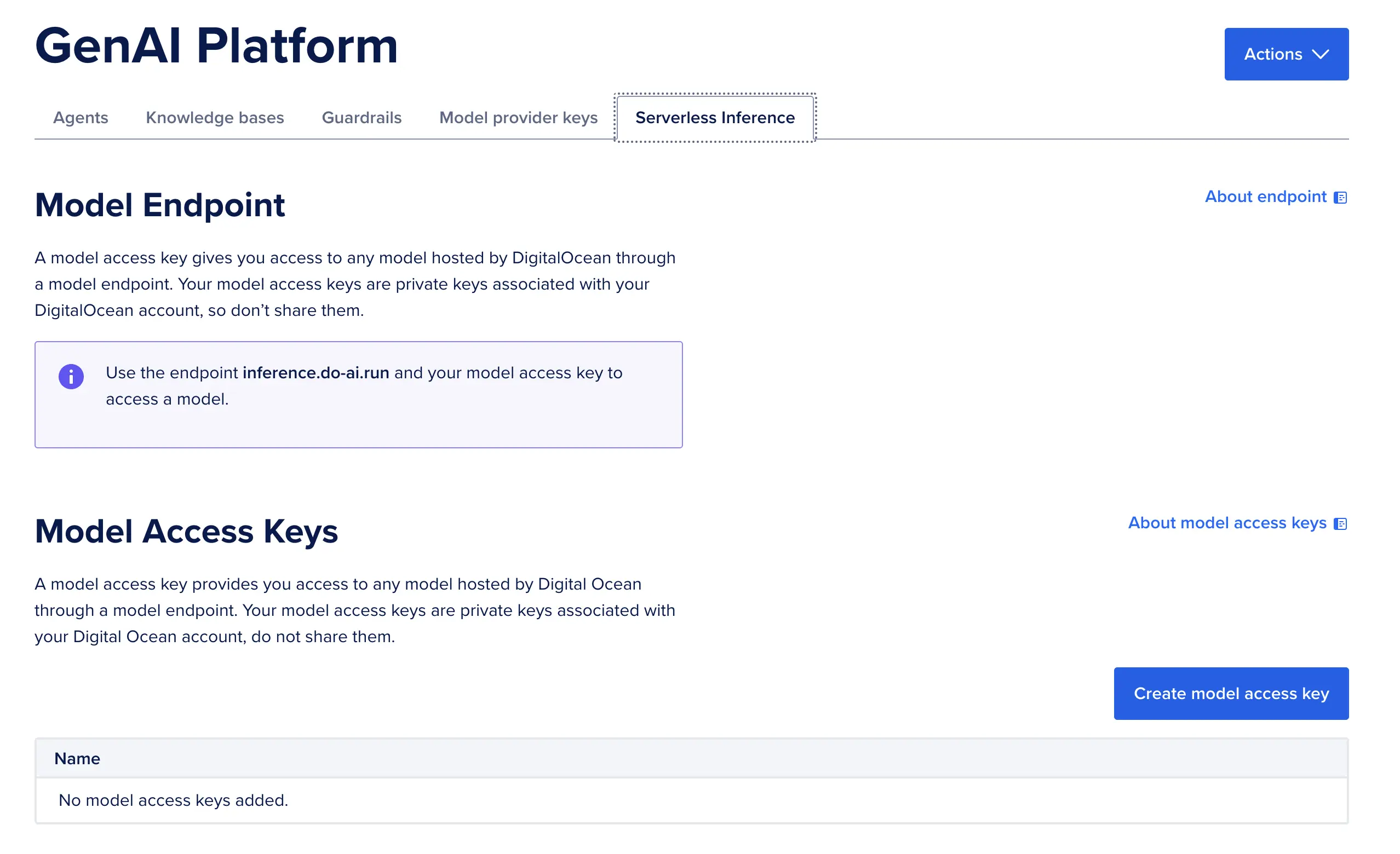

步骤 2B:使用云控制台创建模型访问密钥

如果我们想使用控制台,只需在控制台中导航到 Gradient 平台的"Serverless Inference"选项卡。到达后,使用右下角的按钮"Create model access key"。

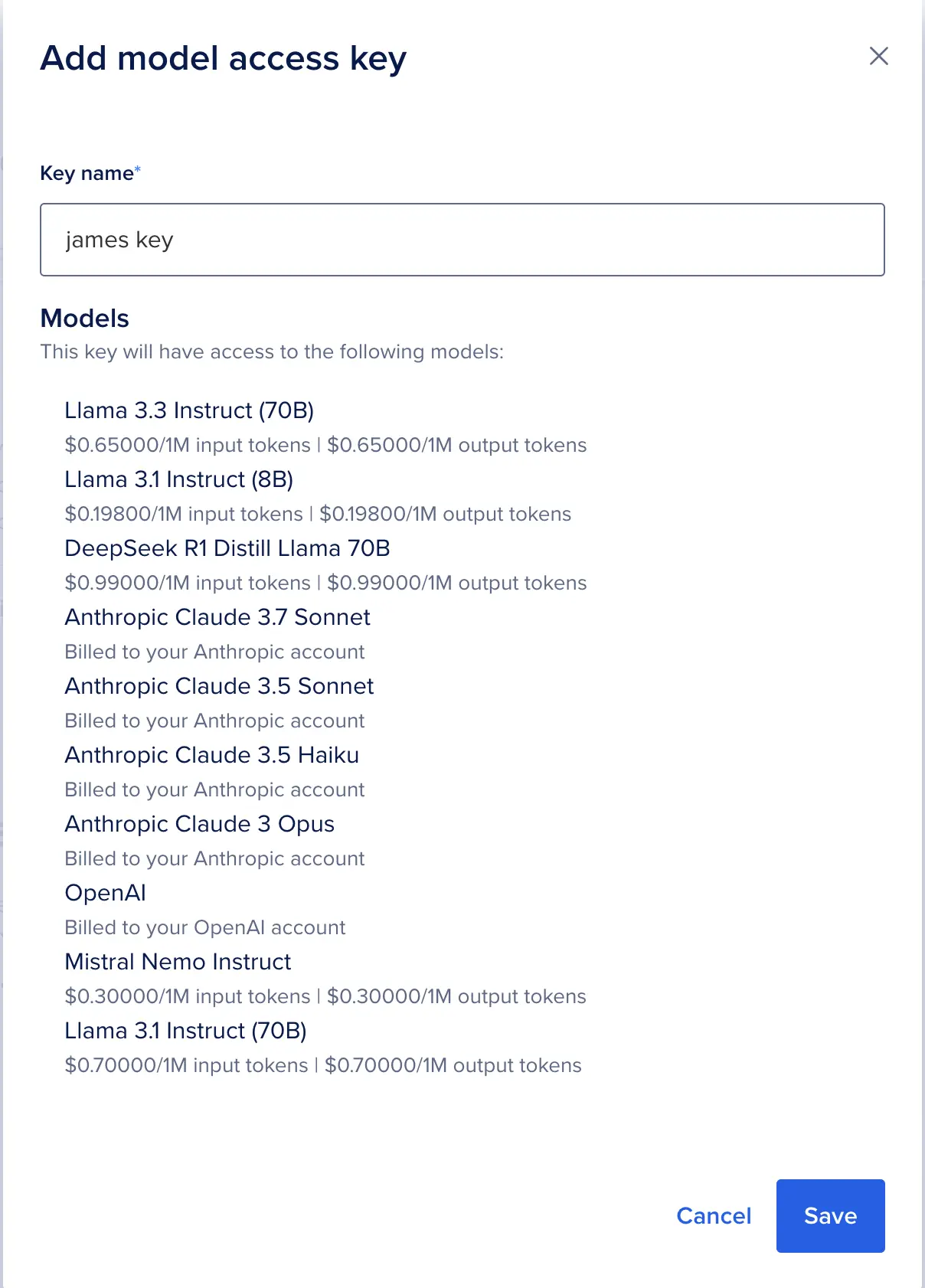

然后,我们只需为密钥命名。保存输出的值以备后用!我们稍后在 Python 中进行无服务器推理时会需要它。

步骤 3:使用 Python 和无服务器推理生成文本

有了新的模型访问密钥,我们就可以从任何能访问互联网的机器上开始运行 DigitalOcean 无服务器推理了!我们建议使用 Jupyter Notebook。按照本教程中概述的步骤,为本文设置你的环境。

环境设置好后,打开一个新的 .ipynb IPython Notebook 文件。使用下面的代码片段开始生成文本,具体来说,是回答法国首都是什么。编辑代码片段,将第 5 行的 API 密钥值替换为你自己的。

ini

from openai import OpenAI

import os

client = OpenAI(

api_key= **"你的模型访问密钥"**,

base_url="https://inference.do-ai.run/v1"

)

stream = client.chat.completions.create(

model="llama3-8b-instruct",

messages=[

{

"role": "developer",

"content": "你是一个乐于助人的助手。",

},

{

"role": "user",

"content": "法国的首都是什么?",

},

],

stream=True,

max_completion_tokens=10

)

for chunk in stream:

if chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end="", flush=True)这应该会输出"法国的首都是巴黎"。我们建议根据需要更改诸如 max_completion_tokens 之类的值,以更好地适应你的提示词。我们还可以编辑第 10 行的模型值,将其更改为 DigitalOcean Gradient 模型产品中列出的任何可用模型。这个模型库会不断更新以反映行业的发展,所以请经常回来查看更新。

DigitalOcean 无服务器 AI 的用例

现在我们已经设置好了运行无服务器推理的环境,我们可以使用该模型进行大量的活动。从大语言模型所能做的一切出发,我们可以创建强大的智能体应用程序,利用 AI 模型的优势。一些可能的用例包括:

- 事件驱动型应用程序:特定事件触发大语言模型的运行,这在智能体用例中很常见

- 可扩展的后端服务:当后端的推理可能需要无限扩展时,无服务器可以确保你的用户永远不会等待

- 数据处理:批处理作业和数据处理可以有效且高效地处理,而无需昂贵的服务器配置置

结语

对于寻求基于大语言模型的解决方案,但又不想费心聘请人员或学习部署自己服务器所需步骤的公司来说,无服务器推理是一个真正的答案。借助 DigitalOcean 的 Gradient Platform,从强大的 NVIDIA GPU 访问无服务器推理变得比以往任何时候都更容易!我们鼓励大家尝试这个新的解决方案!

感谢你与 DigitalOcean 社区一起学习。查看我们提供的计算、存储、网络和托管数据库产品,或新注册的用户希望使用 DigitalOcean Gradient AI 平台上的 Opus 4.6、GPT 5.2 等高级模型,可直接联系卓普云(aidroplet.com)。