在计算机视觉领域,OpenCV无疑是最经典、最常用的开源库之一。它封装了大量图像处理、特征提取、匹配与变换的算法,让开发者能够快速实现各类视觉任务。本文将从实战角度出发,带你一步步掌握角点检测、SIFT特征提取与匹配,最终实现图像拼接,全程结合代码案例拆解核心逻辑。

一、基础铺垫:角点检测的原理与实现

角点是图像中局部灰度变化剧烈的点,也是物体轮廓的关键特征点(比如矩形的四个角)。Harris角点检测是经典的角点提取算法,其核心思想是:在图像局部区域内,向任意方向移动窗口,若灰度值发生显著变化,则认为该区域存在角点。

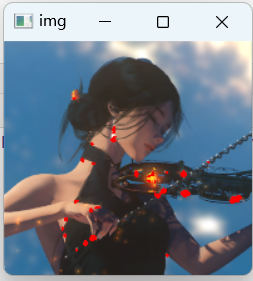

1.1 Harris角点检测代码实现

python

import cv2

import numpy as np

# 读取图像并转为灰度图

img = cv2.imread('333.png')

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

# Harris角点检测

# 参数说明:灰度图、领域大小、Sobel窗口大小、Harris自由参数

dst = cv2.cornerHarris(gray, 4, 3, 0.04)

# 标记角点(取响应值前5%的点,标为红色)

img[dst > 0.05 * dst.max()] = [0, 0, 255]

# 显示结果

cv2.imshow('Harris Corner Detection', img)

cv2.waitKey(0)

cv2.destroyAllWindows()1.2 关键参数解读

• blockSize:角点检测时考虑的邻域大小,值越大,检测到的角点越"粗糙",反之越精细;

• ksize:Sobel求导的窗口大小,用于计算图像梯度,影响角点检测的灵敏度;

• k:Harris方程的自由参数,通常取值在0.04~0.06之间,决定角点响应值的权重。

运行代码后,图像中的角点会被标记为红色,直观展现Harris算法的检测效果。

二、进阶核心:SIFT特征提取与匹配

角点检测只能提取简单的特征点,而实际场景中(比如指纹匹配、图像拼接),需要更具辨识度的"特征描述符"------SIFT(尺度不变特征变换)应运而生。SIFT的优势在于:具有尺度不变性和旋转不变性,即使图像缩放、旋转,仍能稳定提取特征。

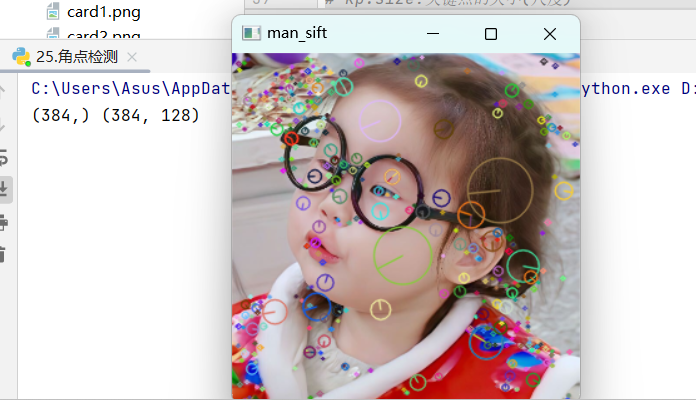

2.1 SIFT特征提取:关键点+描述符

SIFT的核心分为两步:检测关键点(尺度空间极值点)、计算描述符(128维向量,用于特征匹配)。

python

# 读取图像并转为灰度图

man = cv2.imread('222.png')

man_gray = cv2.cvtColor(man, cv2.COLOR_BGR2GRAY)

# 创建SIFT提取器

sift = cv2.SIFT_create()

# 检测关键点

kp = sift.detect(man_gray, None)

# 绘制关键点(带尺度和方向的富特征绘制)

man_sift = cv2.drawKeypoints(

man, kp, None, flags=cv2.DRAW_MATCHES_FLAGS_DRAW_RICH_KEYPOINTS

)

# 计算描述符

kp, des = sift.compute(man_gray, kp)

print(f"关键点数量:{len(kp)},描述符形状:{des.shape}")

# 显示结果

cv2.imshow('SIFT Keypoints', man_sift)

cv2.waitKey(0)

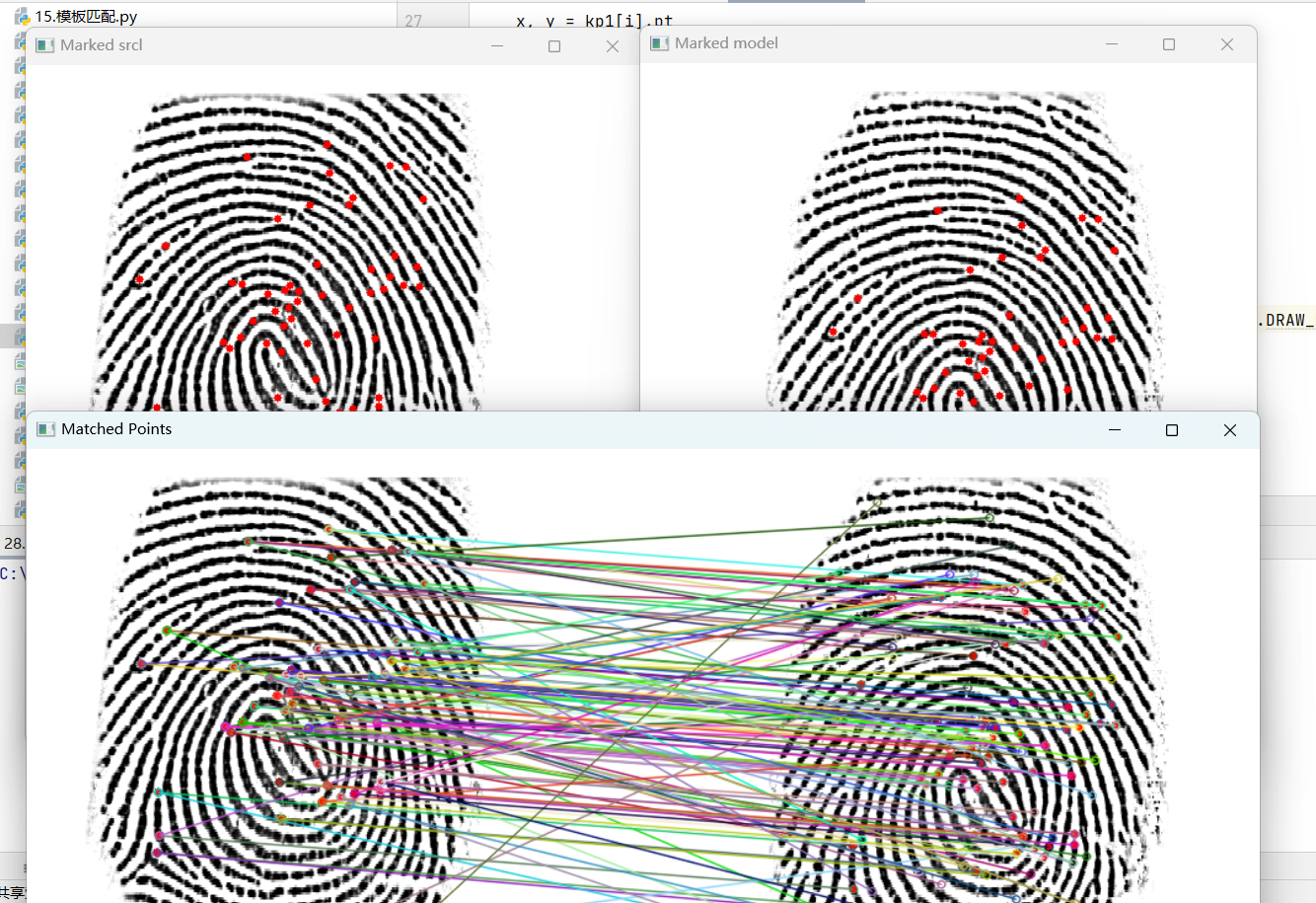

cv2.destroyAllWindows()2.2 特征匹配实战:指纹匹配

提取特征后,需要通过匹配算法找到两张图像中对应的特征点。以指纹匹配为例,我们使用FLANN(快速最近邻搜索库)实现高效匹配,并通过阈值筛选"好的匹配点"。

python

import cv2

def cv_show(name, img):

cv2.imshow(name, img)

cv2.waitKey(0)

# 读取指纹图像

src1 = cv2.imread("src1.bmp")

model = cv2.imread("src3.bmp")

# 1. SIFT检测+描述符计算

sift = cv2.SIFT_create()

kp1, des1 = sift.detectAndCompute(src1, None)

kp2, des2 = sift.detectAndCompute(model, None)

# 2. FLANN匹配器(适合大数据集)

flann = cv2.FlannBasedMatcher()

matches = flann.knnMatch(des1, des2, k=2) # 每个关键点返回2个最佳匹配

# 3. 筛选匹配点(距离阈值:0.4)

good = []

match_index = []

for m, n in matches:

if m.distance < 0.4 * n.distance: # 近邻距离远小于次近邻,视为有效匹配

match_index.append((m.queryIdx, m.trainIdx))

good.append((m, n))

# 4. 标记匹配的关键点

for i, j in match_index:

# 标记src1中的匹配点

x, y = kp1[i].pt

cv2.circle(src1, (int(x), int(y)), 3, (0, 0, 255), -1)

# 标记model中的匹配点

m, n = kp2[j].pt

cv2.circle(model, (int(m), int(n)), 3, (0, 0, 255), -1)

# 5. 绘制匹配连线

matched_img = cv2.drawMatchesKnn(

src1, kp1, model, kp2, good, None,

flags=cv2.DRAW_MATCHES_FLAGS_NOT_DRAW_SINGLE_POINTS

)

# 显示结果

cv_show('Marked src1', src1)

cv_show('Marked model', model)

cv_show('Matched Points', matched_img)

cv2.destroyAllWindows()2.3 匹配核心逻辑

• knnMatch:K近邻匹配,返回每个关键点的Top-K匹配结果,这里K=2;

• 阈值筛选:通过"最佳匹配距离 < 0.4*次佳匹配距离"过滤错误匹配,阈值越小,匹配越严格;

• 可视化:用圆形标记匹配点,用连线展示对应关系,直观验证匹配效果。

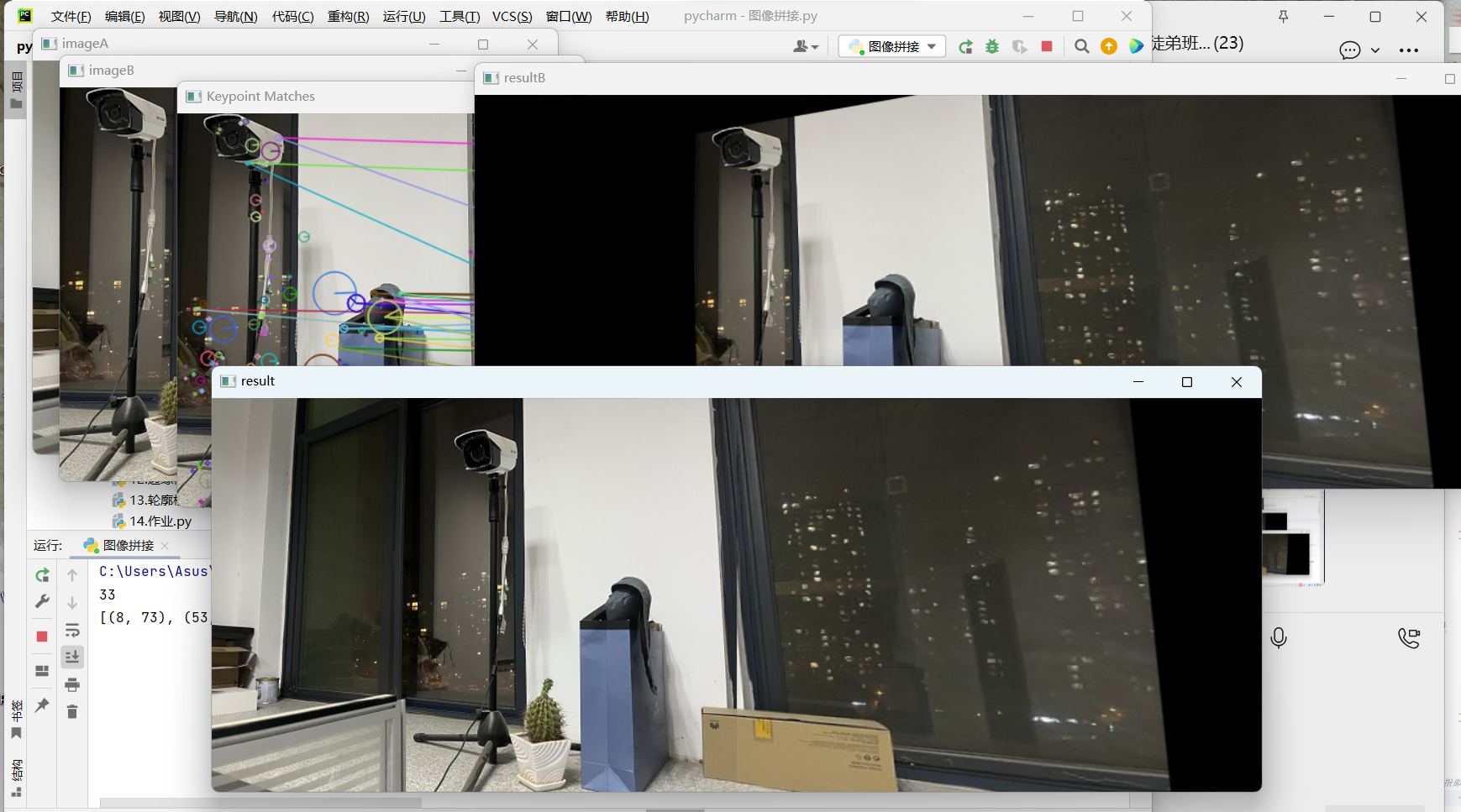

三、综合实战:基于SIFT的图像拼接

图像拼接是SIFT特征的经典应用场景,核心流程是:提取特征→匹配特征→计算透视变换矩阵→图像融合。

3.1 完整图像拼接代码

python

import cv2

import numpy as np

import sys

def cv_show(name, img):

cv2.imshow(name, img)

cv2.waitKey(0)

# 特征提取与描述符计算函数

def detectAndDescribe(image):

gray = cv2.cvtColor(image, cv2.COLOR_RGB2GRAY)

sift = cv2.SIFT_create()

kps, des = sift.detectAndCompute(gray, None)

# 转换关键点坐标为浮点型

kps_float = np.float32([kp.pt for kp in kps])

return (kps, kps_float, des)

# 1. 读取待拼接图像

imageA = cv2.imread('A.jpg')

imageB = cv2.imread('B.jpg')

# 2. 提取特征点和描述符

(kpsA, kps_floatA, desA) = detectAndDescribe(imageA)

(kpsB, kps_floatB, desB) = detectAndDescribe(imageB)

# 3. 暴力匹配器(小数据集更稳定)

matcher = cv2.BFMatcher()

rawMatches = matcher.knnMatch(desB, desA, 2)

# 4. 筛选有效匹配点

good = []

matches = []

for m in rawMatches:

if len(m) == 2 and m[0].distance < 0.65 * m[1].distance:

good.append(m)

matches.append((m[0].queryIdx, m[0].trainIdx))

# 可视化匹配点

vis = cv2.drawMatchesKnn(

imageB, kpsB, imageA, kpsA, good, None,

flags=cv2.DRAW_MATCHES_FLAGS_DRAW_RICH_KEYPOINTS

)

cv_show("Keypoint Matches", vis)

# 5. 计算透视变换矩阵(至少4个匹配点)

if len(matches) > 4:

ptsB = np.float32([kps_floatB[i] for (i, _) in matches])

ptsA = np.float32([kps_floatA[i] for (_, i) in matches])

# RANSAC算法去除外点,鲁棒性更强

H, mask = cv2.findHomography(ptsB, ptsA, cv2.RANSAC, 10)

else:

print("匹配点不足4个,无法拼接!")

sys.exit()

# 6. 透视变换(将imageB映射到imageA的坐标系)

result = cv2.warpPerspective(

imageB, H, (imageB.shape[1] + imageA.shape[1], imageB.shape[0])

)

# 融合图像A和变换后的B

result[0:imageA.shape[0], 0:imageA.shape[1]] = imageA

# 7. 显示并保存结果

cv_show('Final Result', result)

cv2.imwrite('panoramic.jpg', result)

cv2.destroyAllWindows()3.2 核心步骤拆解

-

特征提取:通过detectAndDescribe函数统一处理图像,输出关键点、坐标和描述符;

-

特征匹配:使用BFMatcher(暴力匹配),适合小数据集;若数据量大,可替换为FLANN;

-

透视变换矩阵(Homography):通过cv2.findHomography计算,RANSAC算法能有效排除错误匹配的外点;

-

图像融合:先对imageB做透视变换,再将imageA覆盖到变换后的图像上,完成拼接。

四、总结与拓展

本文从基础的角点检测入手,逐步深入到SIFT特征的提取、匹配,最终实现图像拼接,覆盖了OpenCV视觉开发的核心流程。需要注意的是:

• SIFT算法受专利保护,若需商用,可替换为ORB(开源、快速);

• 匹配阈值(如0.4、0.65)需根据实际场景调整,平衡匹配精度和数量;

• 图像拼接的最终效果,受图像重叠区域、特征点数量、透视变换精度影响,可通过增加图像预处理(如灰度均衡、去噪)提升稳定性。

OpenCV的魅力在于,它将复杂的视觉算法封装为简单的API,让我们能聚焦于业务逻辑。无论是指纹识别、图像拼接,还是目标检测、跟踪,掌握这些基础特征操作,都是进阶的关键。希望本文的实战案例能帮助你快速上手,玩转OpenCV!